引進國產開源MoE大模型,其性能媲美Llama 2-7B,同時計算量減少了60%

開源MoE模型,終於迎來首位國產選手!

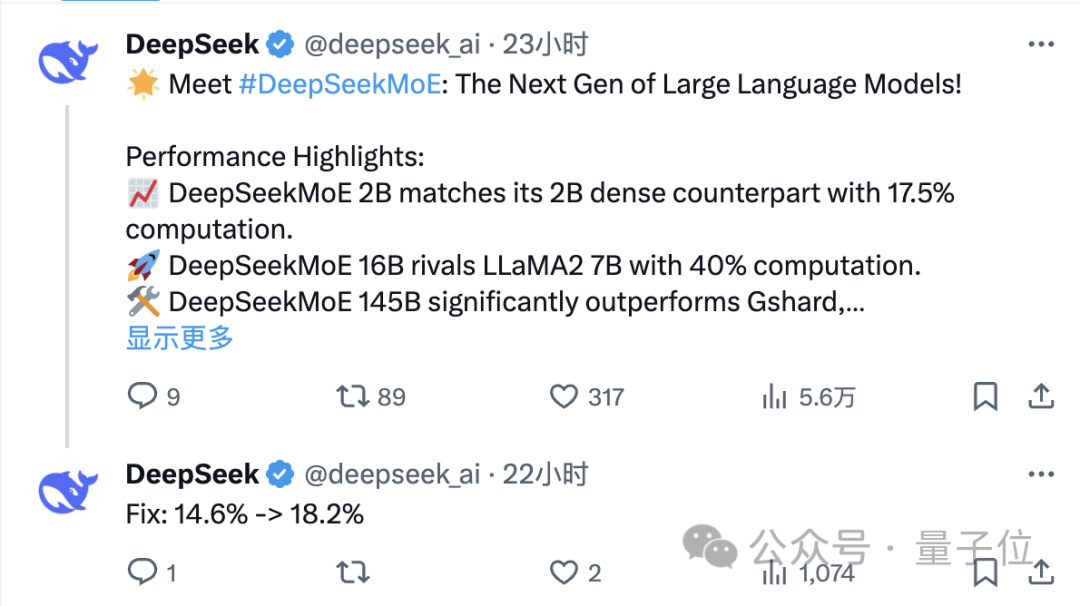

它的表現完全不輸給密集的Llama 2-7B模型,計算量卻只有40%。

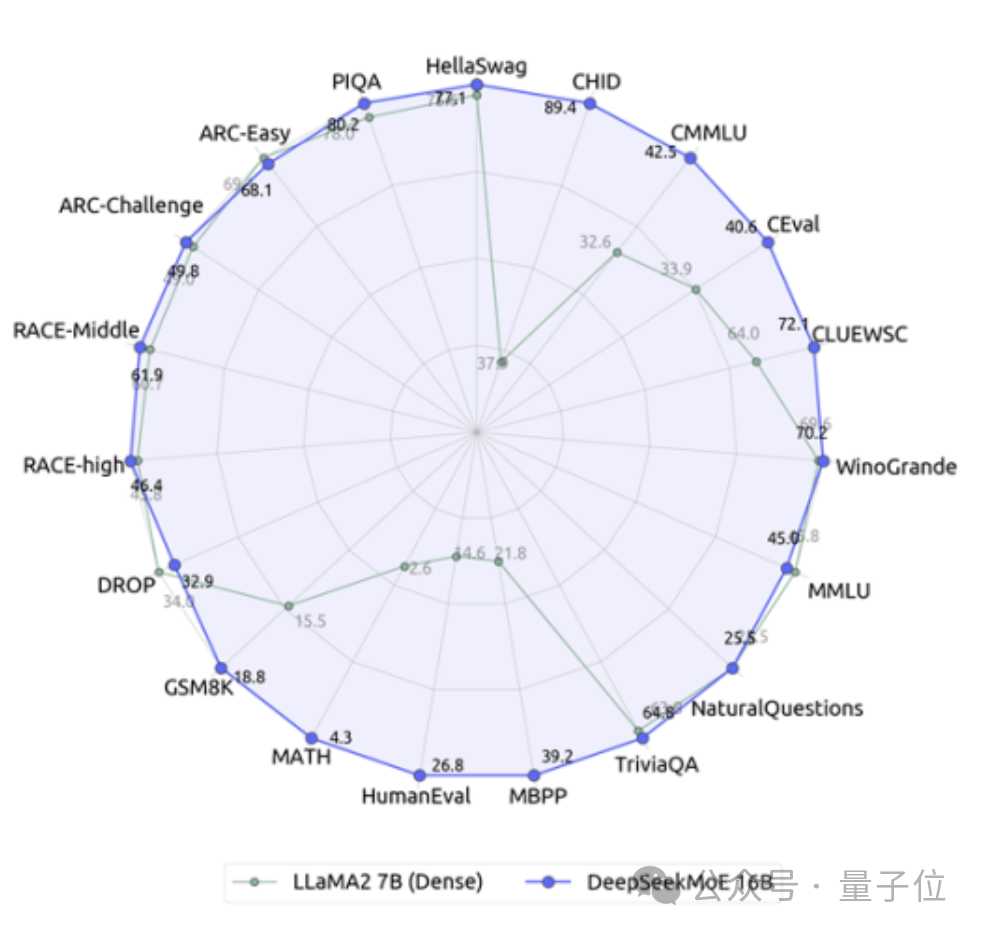

這個模型堪稱19邊形戰士,特別是在數學和程式碼能力上對Llama形成了碾壓。

它就是深度求索團隊最新開源的160億參數專家模型DeepSeek MoE。

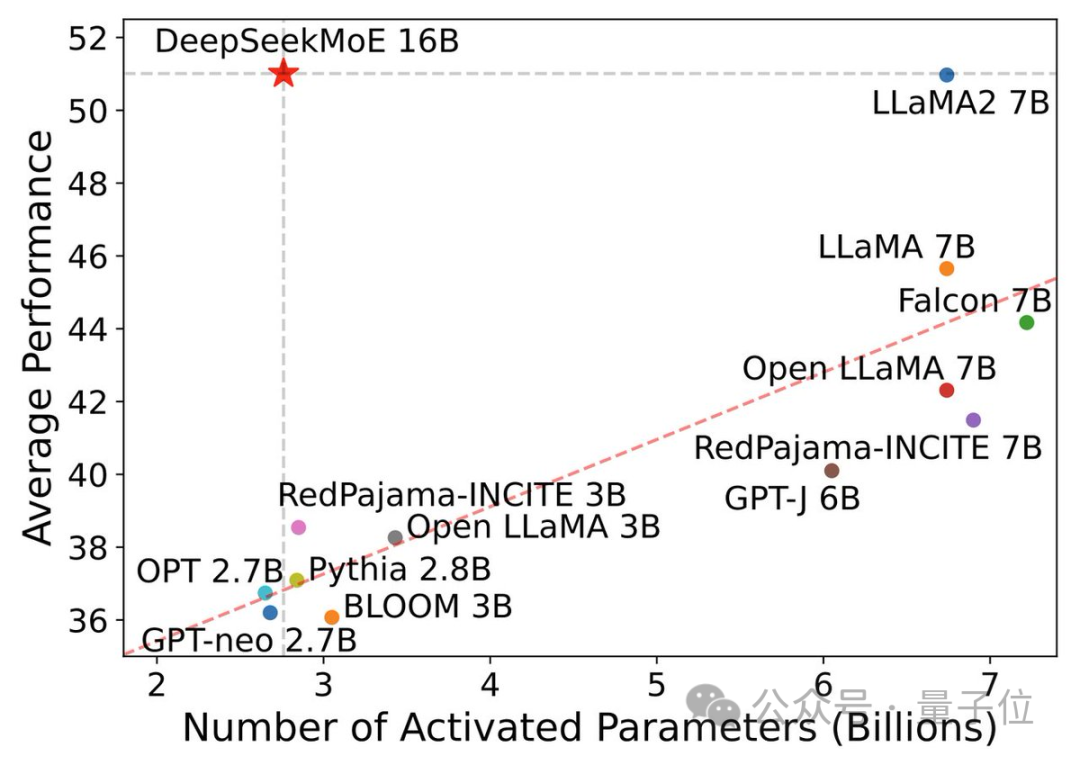

除了效能上表現優異,DeepSeek MoE主打的就是節省運算量。

在這張表現-激活參數量圖中,它「一枝獨秀」地佔據了左上角的大片空白區。

發布僅一天,DeepSeek團隊在X上的推文就有大量轉發關注。

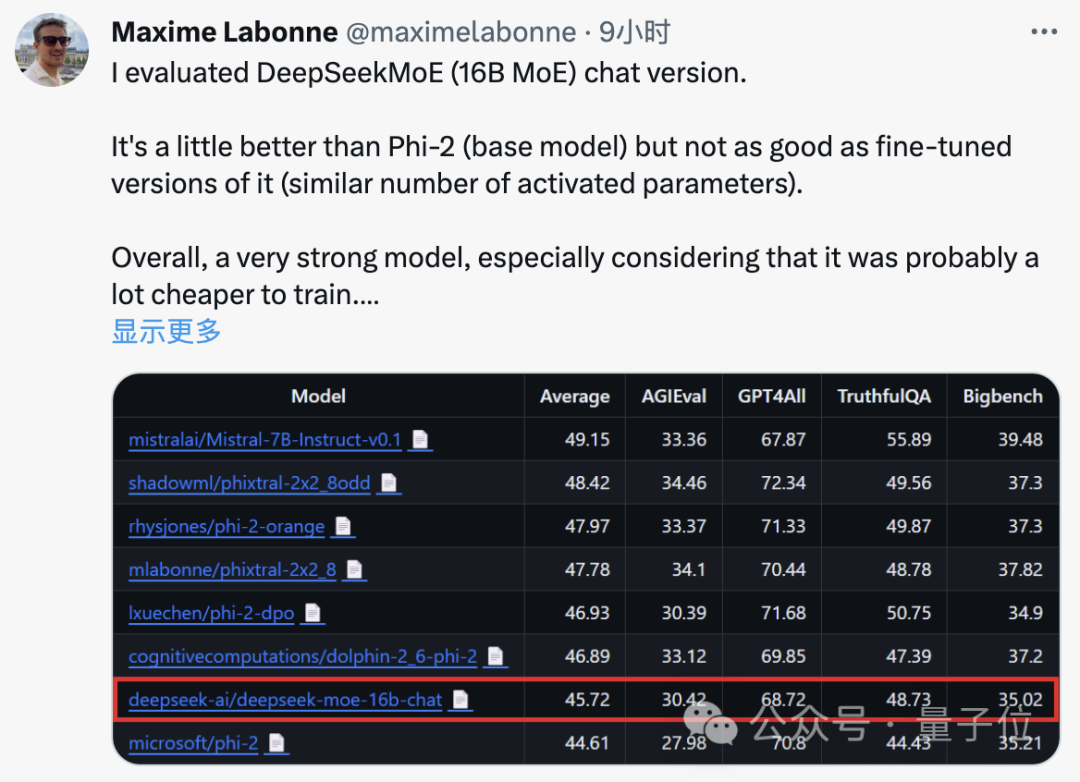

JP摩根的機器學習工程師Maxime Labonne測試後也表示,DeepSeek MoE的chat版本表現要略勝於微軟的「小模型」Phi-2。

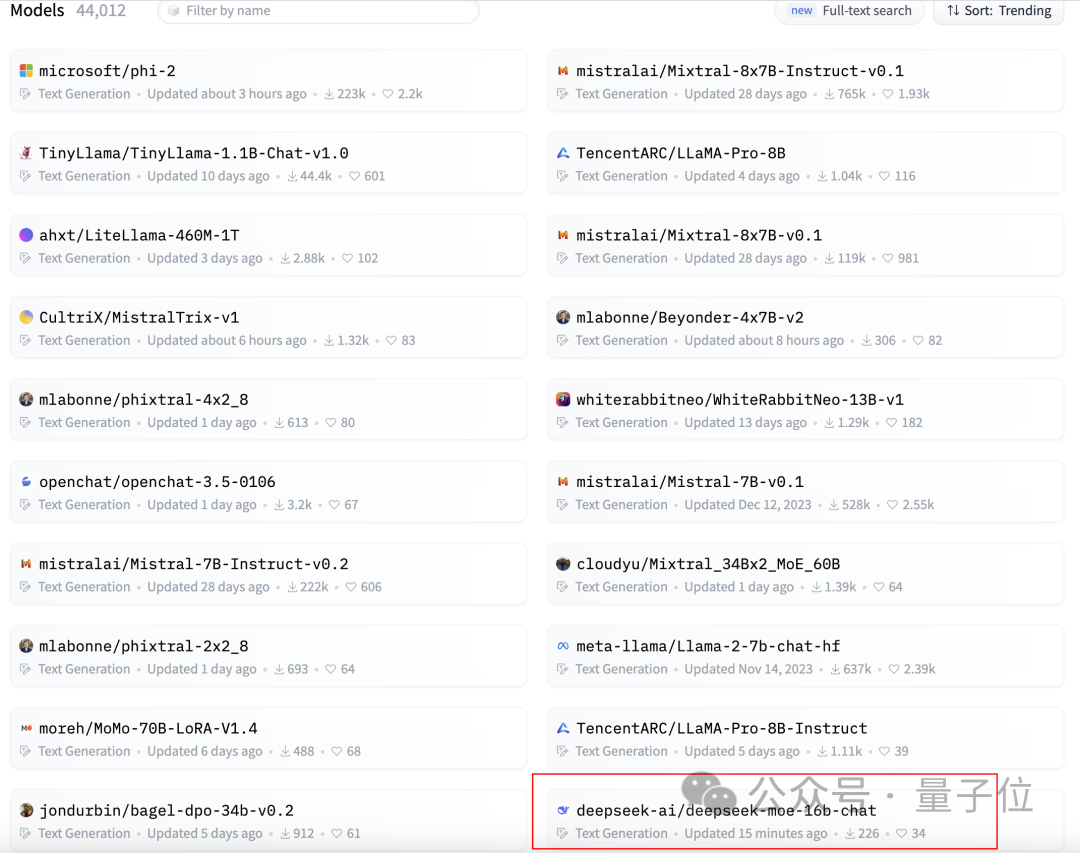

同時,DeepSeek MoE也在GitHub上獲得了300 星標,並登上了Hugging Face文本生成類模型排行榜的首頁。

那麼,DeepSeek MoE的具體表現究竟怎麼樣呢?

計算量減少60%

DeepSeek MoE目前推出的版本參數量為160億,實際啟動參數量大約是28億。

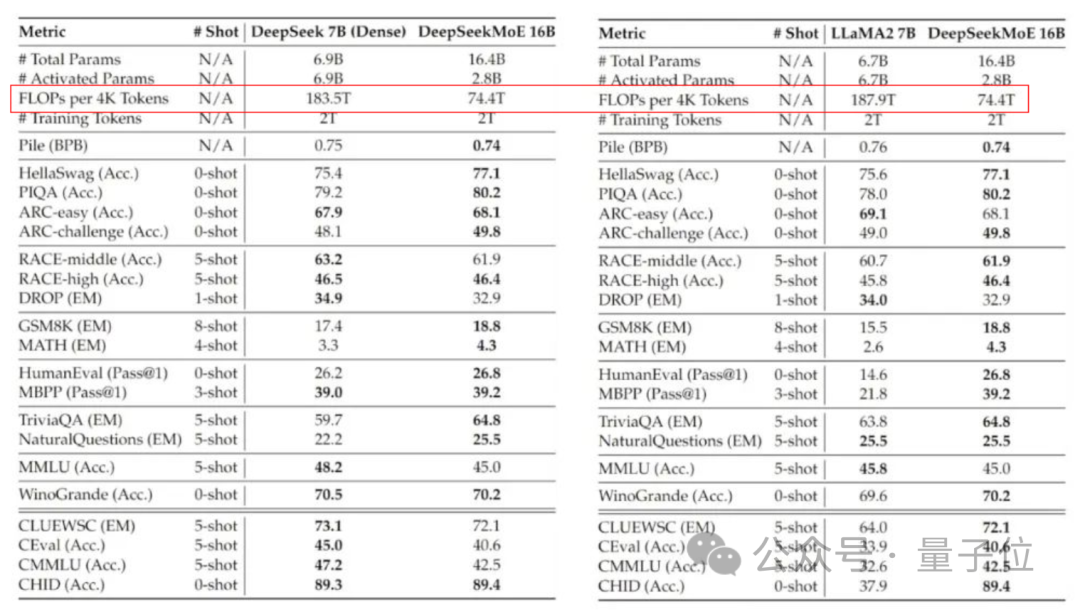

與自家的7B密集模型相比,二者在19個資料集上的表現各有勝負,但整體比較接近。

而與同為密集模型的Llama 2-7B相比,DeepSeek MoE在數學、程式碼等方面也體現出來明顯的優勢。

但兩種密集模型的計算量都超過了180TFLOPs每4k token,DeepSeek MoE卻只有74.4TFLOPs,只有兩者的40%。

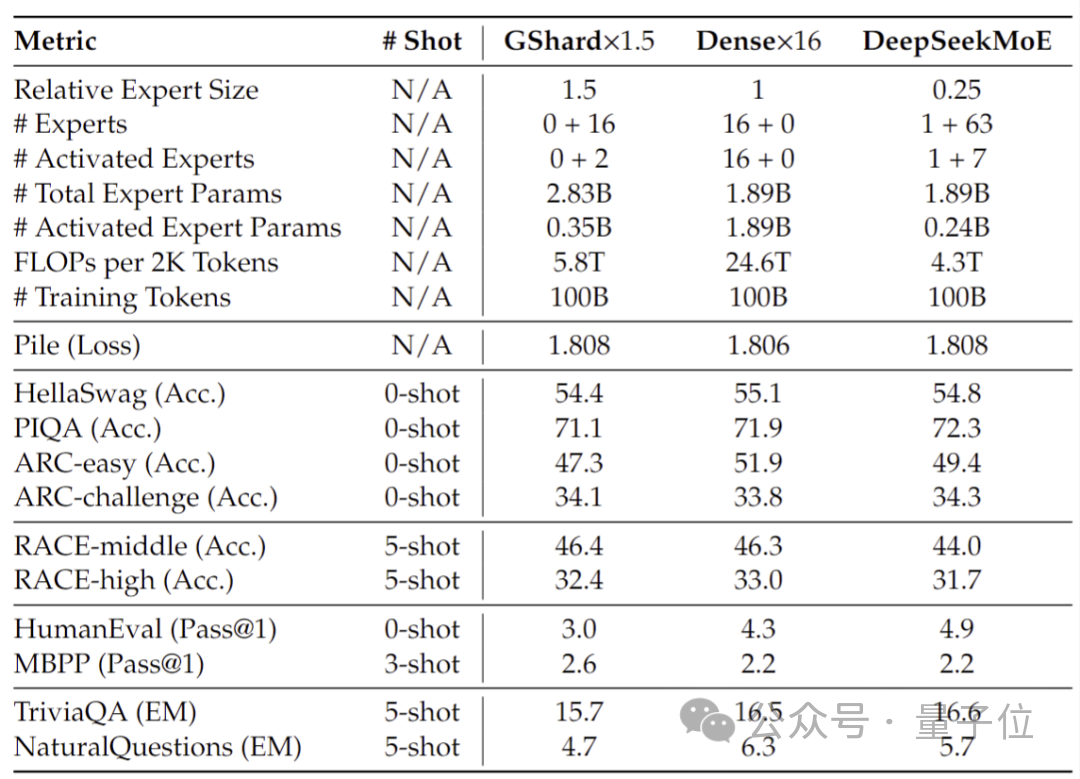

在20億參數量時進行的效能測試顯示,DeepSeek MoE同樣能以更少的計算量,達到與1.5倍參數量、同為MoE模型的GShard 2.8B相當甚至更好的效果。

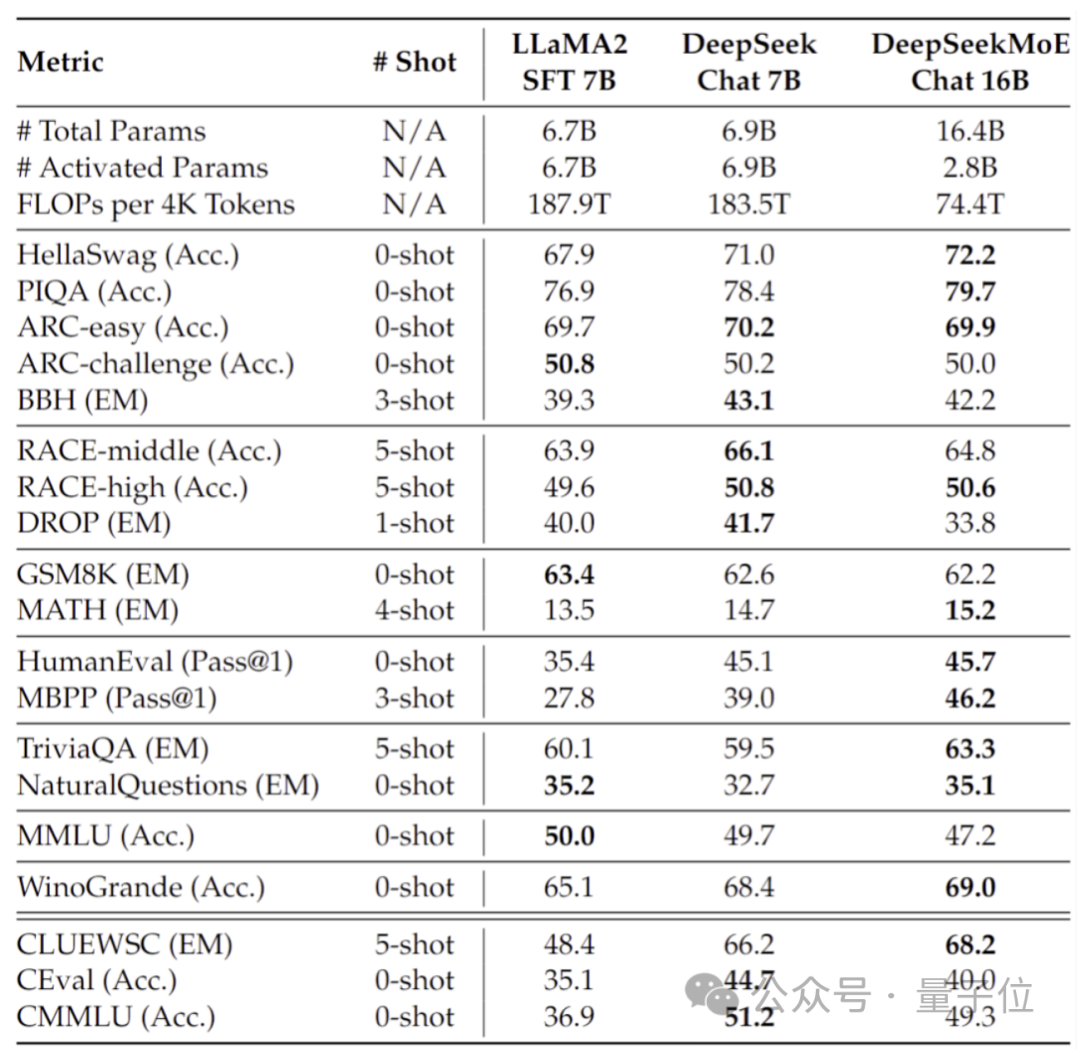

此外深度求索團隊也基於SFT微調除了DeepSeek MoE的Chat版本,表現同樣接近自家密集版本和Llama 2-7B。

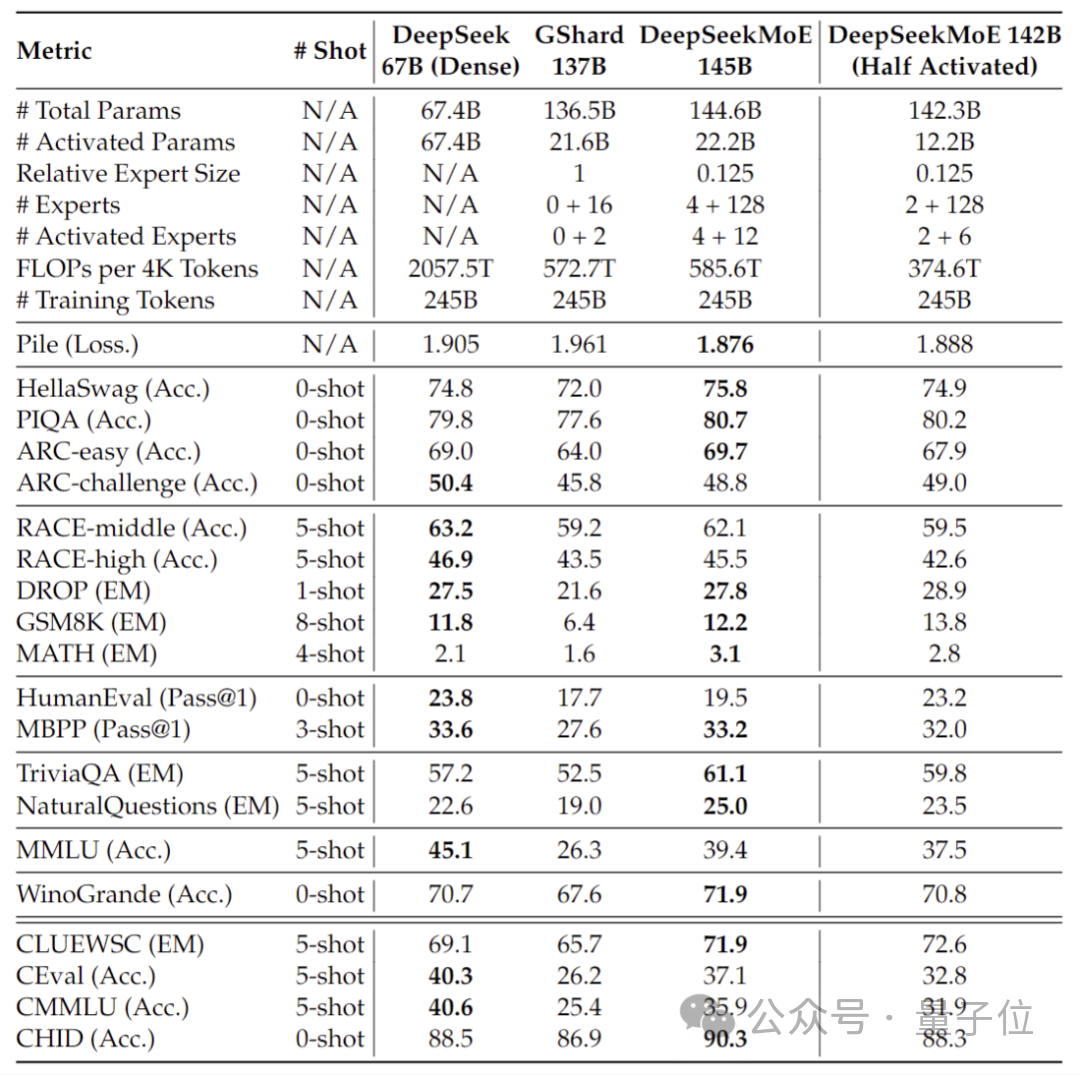

此外,深度求索團隊也透露,DeepSeek MoE模型還有145B版本正在研發。

階段性的初步試驗顯示,145B的DeepSeek MoE對GShard 137B具有極大的領先優勢,同時能夠以28.5%的計算量達到與密集版DeepSeek 67B模型相當的性能。

研發完畢後,團隊也將對145B版本進行開源。

而在這些模型表現的背後,是DeepSeek全新的自研MoE架構。

自研MoE新架構

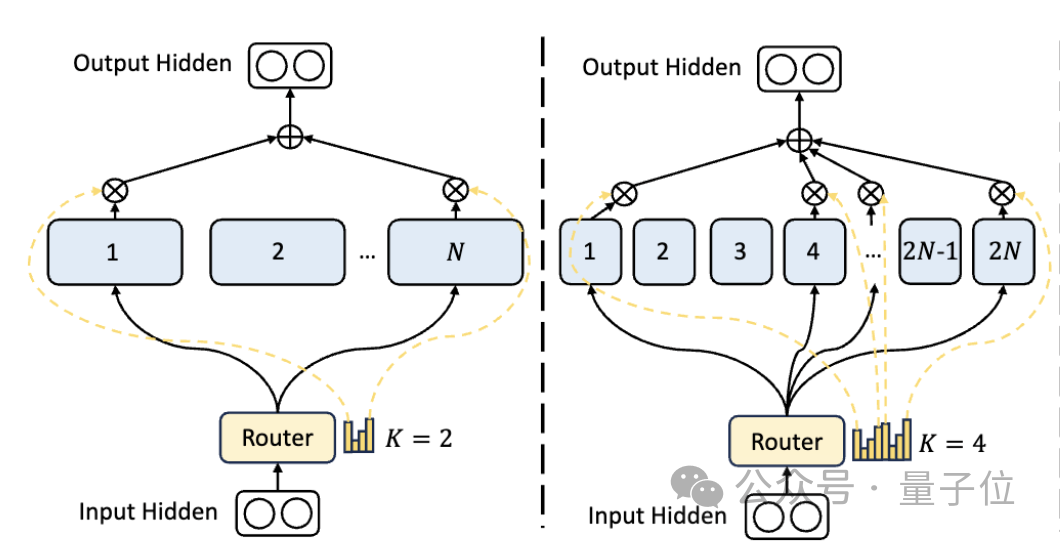

首先是相比於傳統的MoE架構,DeepSeek擁有更細粒度專家劃分。

在總參數量一定的情況下,傳統模型分出N個專家,而DeepSeek可能分出2N個。

同時,每次執行任務時選擇的專家數量也是傳統模型的2倍,所以整體使用的參數量也不變,但選擇的自由度增加了。

這種分割策略允許更靈活和適應性的激活專家組合,從而提高了模型在不同任務上的準確性和知識獲取的針對性。

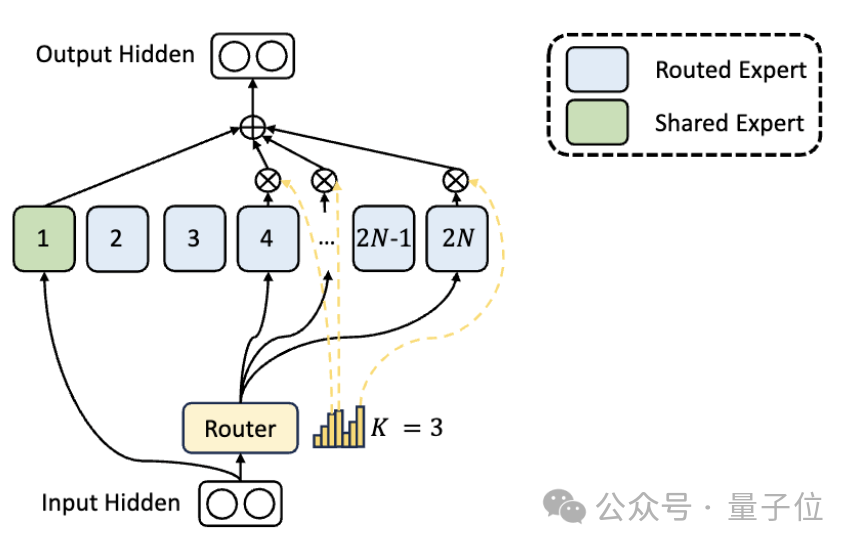

除了專家分割上的差異,DeepSeek也創新地引入了「共享專家」的設定。

這些共享專家對所有輸入的token激活,不受路由模組影響,目的是捕獲和整合在不同上下文中都需要的共同知識。

透過將這些共享知識壓縮到共享專家中,可以減少其他專家之間的參數冗餘,從而提高模型的參數效率。

共享專家的設定有助於其他專家更專注於其獨特的知識領域,從而提高整體的專家專業化水準。

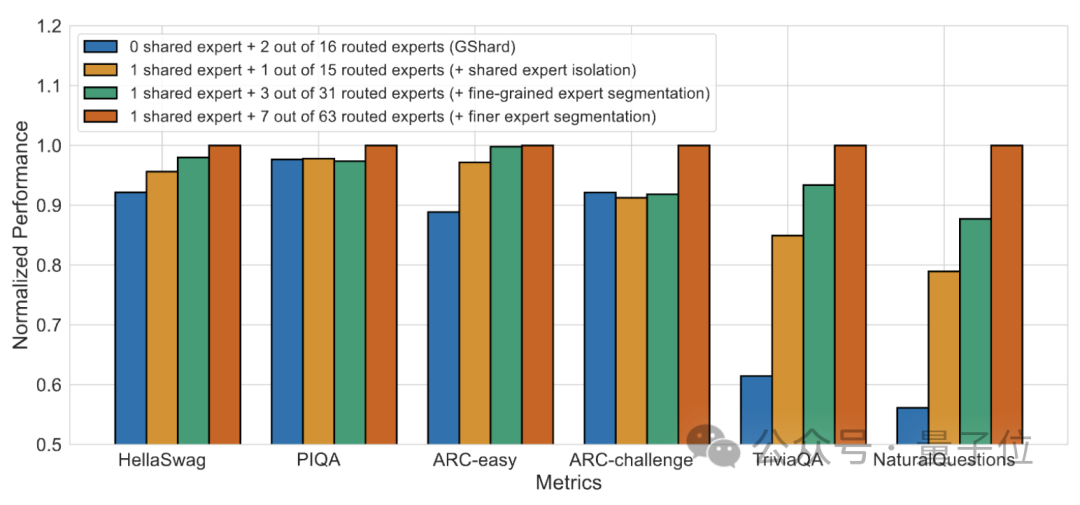

消融實驗結果表明,這兩個方案都為DeepSeek MoE的「降本增效」起到了重要作用。

論文網址:https://arxiv.org/abs/2401.06066。

參考連結:https://mp.weixin.qq.com/s/T9-EGxYuHcGQgXArLXGbgg。

以上是引進國產開源MoE大模型,其性能媲美Llama 2-7B,同時計算量減少了60%的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

位元組跳動剪映推出 SVIP 超級會員:連續包年 499 元,提供多種 AI 功能

Jun 28, 2024 am 03:51 AM

位元組跳動剪映推出 SVIP 超級會員:連續包年 499 元,提供多種 AI 功能

Jun 28, 2024 am 03:51 AM

本站6月27日訊息,剪映是由位元組跳動旗下臉萌科技開發的一款影片剪輯軟體,依託於抖音平台且基本面向該平台用戶製作短影片內容,並相容於iOS、安卓、Windows 、MacOS等作業系統。剪映官方宣布會員體系升級,推出全新SVIP,包含多種AI黑科技,例如智慧翻譯、智慧劃重點、智慧包裝、數位人合成等。價格方面,剪映SVIP月費79元,年費599元(本站註:折合每月49.9元),連續包月則為59元每月,連續包年為499元每年(折合每月41.6元) 。此外,剪映官方也表示,為提升用戶體驗,向已訂閱了原版VIP

使用Rag和Sem-Rag提供上下文增強AI編碼助手

Jun 10, 2024 am 11:08 AM

使用Rag和Sem-Rag提供上下文增強AI編碼助手

Jun 10, 2024 am 11:08 AM

透過將檢索增強生成和語意記憶納入AI編碼助手,提升開發人員的生產力、效率和準確性。譯自EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG,作者JanakiramMSV。雖然基本AI程式設計助理自然有幫助,但由於依賴對軟體語言和編寫軟體最常見模式的整體理解,因此常常無法提供最相關和正確的程式碼建議。這些編碼助手產生的代碼適合解決他們負責解決的問題,但通常不符合各個團隊的編碼標準、慣例和風格。這通常會導致需要修改或完善其建議,以便將程式碼接受到應

七個很酷的GenAI & LLM技術性面試問題

Jun 07, 2024 am 10:06 AM

七個很酷的GenAI & LLM技術性面試問題

Jun 07, 2024 am 10:06 AM

想了解更多AIGC的內容,請造訪:51CTOAI.x社群https://www.51cto.com/aigc/譯者|晶顏審校|重樓不同於網路上隨處可見的傳統問題庫,這些問題需要跳脫常規思維。大語言模型(LLM)在數據科學、生成式人工智慧(GenAI)和人工智慧領域越來越重要。這些複雜的演算法提升了人類的技能,並在許多產業中推動了效率和創新性的提升,成為企業保持競爭力的關鍵。 LLM的應用範圍非常廣泛,它可以用於自然語言處理、文字生成、語音辨識和推薦系統等領域。透過學習大量的數據,LLM能夠產生文本

微調真的能讓LLM學到新東西嗎:引入新知識可能讓模型產生更多的幻覺

Jun 11, 2024 pm 03:57 PM

微調真的能讓LLM學到新東西嗎:引入新知識可能讓模型產生更多的幻覺

Jun 11, 2024 pm 03:57 PM

大型語言模型(LLM)是在龐大的文字資料庫上訓練的,在那裡它們獲得了大量的實際知識。這些知識嵌入到它們的參數中,然後可以在需要時使用。這些模型的知識在訓練結束時被「具體化」。在預訓練結束時,模型實際上停止學習。對模型進行對齊或進行指令調優,讓模型學習如何充分利用這些知識,以及如何更自然地回應使用者的問題。但是有時模型知識是不夠的,儘管模型可以透過RAG存取外部內容,但透過微調使用模型適應新的領域被認為是有益的。這種微調是使用人工標註者或其他llm創建的輸入進行的,模型會遇到額外的實際知識並將其整合

你所不知道的機器學習五大學派

Jun 05, 2024 pm 08:51 PM

你所不知道的機器學習五大學派

Jun 05, 2024 pm 08:51 PM

機器學習是人工智慧的重要分支,它賦予電腦從數據中學習的能力,並能夠在無需明確編程的情況下改進自身能力。機器學習在各個領域都有廣泛的應用,從影像辨識和自然語言處理到推薦系統和詐欺偵測,它正在改變我們的生活方式。機器學習領域存在著多種不同的方法和理論,其中最具影響力的五種方法被稱為「機器學習五大派」。這五大派分別為符號派、聯結派、進化派、貝葉斯派和類推學派。 1.符號學派符號學(Symbolism),又稱符號主義,強調利用符號進行邏輯推理和表達知識。該學派認為學習是一種逆向演繹的過程,透過現有的

為大模型提供全新科學複雜問答基準與評估體系,UNSW、阿貢、芝加哥大學等多家機構共同推出SciQAG框架

Jul 25, 2024 am 06:42 AM

為大模型提供全新科學複雜問答基準與評估體系,UNSW、阿貢、芝加哥大學等多家機構共同推出SciQAG框架

Jul 25, 2024 am 06:42 AM

編輯|ScienceAI問答(QA)資料集在推動自然語言處理(NLP)研究中發揮著至關重要的作用。高品質QA資料集不僅可以用於微調模型,也可以有效評估大語言模型(LLM)的能力,尤其是針對科學知識的理解和推理能力。儘管目前已有許多科學QA數據集,涵蓋了醫學、化學、生物等領域,但這些數據集仍有一些不足之處。其一,資料形式較為單一,大多數為多項選擇題(multiple-choicequestions),它們易於進行評估,但限制了模型的答案選擇範圍,無法充分測試模型的科學問題解答能力。相比之下,開放式問答

SOTA性能,廈大多模態蛋白質-配體親和力預測AI方法,首次結合分子表面訊息

Jul 17, 2024 pm 06:37 PM

SOTA性能,廈大多模態蛋白質-配體親和力預測AI方法,首次結合分子表面訊息

Jul 17, 2024 pm 06:37 PM

編輯|KX在藥物研發領域,準確有效地預測蛋白質與配體的結合親和力對於藥物篩選和優化至關重要。然而,目前的研究並沒有考慮到分子表面訊息在蛋白質-配體相互作用中的重要作用。基於此,來自廈門大學的研究人員提出了一種新穎的多模態特徵提取(MFE)框架,該框架首次結合了蛋白質表面、3D結構和序列的信息,並使用交叉注意機制進行不同模態之間的特徵對齊。實驗結果表明,該方法在預測蛋白質-配體結合親和力方面取得了最先進的性能。此外,消融研究證明了該框架內蛋白質表面資訊和多模態特徵對齊的有效性和必要性。相關研究以「S

SK 海力士 8 月 6 日將展示 AI 相關新品:12 層 HBM3E、321-high NAND 等

Aug 01, 2024 pm 09:40 PM

SK 海力士 8 月 6 日將展示 AI 相關新品:12 層 HBM3E、321-high NAND 等

Aug 01, 2024 pm 09:40 PM

本站8月1日消息,SK海力士今天(8月1日)發布博文,宣布將出席8月6日至8日,在美國加州聖克拉拉舉行的全球半導體記憶體峰會FMS2024,展示諸多新一代產品。未來記憶體和儲存高峰會(FutureMemoryandStorage)簡介前身是主要面向NAND供應商的快閃記憶體高峰會(FlashMemorySummit),在人工智慧技術日益受到關注的背景下,今年重新命名為未來記憶體和儲存高峰會(FutureMemoryandStorage),以邀請DRAM和儲存供應商等更多參與者。新產品SK海力士去年在