使用Word2Vec模型:將單字轉換為向量化表示

Word2Vec是一種常用的自然語言處理技術,用於將單字轉換為數學向量,以便於電腦處理和操作。該模型已被廣泛應用於多種自然語言處理任務,包括文字分類、語音辨識、資訊檢索和機器翻譯等。它的應用範圍非常廣泛,能夠幫助電腦更好地理解和處理自然語言資料。

Word2Vec是Google於2013年發布的模型,採用神經網路的訓練方法,透過分析文字資料來學習單字之間的關係,並將其映射到向量空間中。

Word2Vec模型的核心思想是將單字映射到高維度向量空間,以便於衡量單字之間的相似性。在訓練Word2Vec模型時,需要輸入大量文字數據,並透過反向傳播演算法來調整模型參數,使得模型能夠準確地預測上下文單字。為了最小化模型的損失函數,可以採用多種最佳化演算法,如隨機梯度下降和自適應最佳化演算法等。這些最佳化演算法的目標是使模型的預測結果與真實上下文單字盡可能接近,從而提高模型的準確性。透過訓練Word2Vec模型,可以獲得單字在向量空間中的表示,進而可以利用這些向量進行各種自然語言處理任務,如文字分類、命名實體辨識等。

除了被用於單字表示和語言建模之外,Word2Vec模型在自然語言處理任務中有廣泛的應用。例如,在文字分類任務中,我們可以利用Word2Vec模型將文字中的單字轉換為向量表示,並用這些向量來訓練分類模型。在語音辨識任務中,可以使用Word2Vec模型來學習單字的發音特徵,並將這些特徵應用於語音辨識。另外,在資訊檢索任務中,Word2Vec模型可以用來計算文字之間的相似度,並將這些相似度用於文字檢索。總之,Word2Vec模型在各種自然語言處理任務中扮演重要的角色。

word2vec模型結構

Word2Vec模型有兩種不同的架構:連續詞袋模型(CBOW)和Skip-Gram模型。

連續字袋模型(CBOW)是將上下文單字當作輸入,預測中心單字的模型。具體來說,CBOW模型將一個視窗內的上下文單字作為輸入,並嘗試預測該視窗的中心單字。例如,對於句子“我喜歡吃蘋果”,CBOW模型將“我”、“吃”和“蘋果”作為輸入,並嘗試預測“喜歡”這個中心單字。 CBOW模型的優點是能夠處理相對較少的數據,並且在訓練速度和效果上都比較好。

Skip-Gram模型是一種將中心單字作為輸入,預測上下文單字的模型。具體來說,Skip-Gram模型將一個中心單字作為輸入,並嘗試預測該單字周圍的上下文單字。例如,對於句子“我喜歡吃蘋果”,Skip-Gram模型將“喜歡”作為輸入,並嘗試預測“我”、“吃”和“蘋果”這三個上下文單字。 Skip-Gram模型的優點是能夠處理更大的資料集,並且在處理罕見單字和相似單字時表現得更好。

word2vec模型訓練流程

Word2Vec模型的訓練過程可以分為以下步驟:

1.資料預處理:將原始文字資料轉換為可以輸入到模型中的格式,通常包括分詞、移除停用詞、建構字表等運算。

2.建立模型:選擇CBOW或Skip-Gram模型,並指定模型的超參數,如向量維度、視窗大小、學習率等。

3.初始化參數:初始化神經網路的權重和偏移參數。

4.訓練模型:將預處理後的文字資料輸入到模型中,並透過反向傳播演算法來調整模型參數,以最小化模型的損失函數。

5.評估模型:使用一些評估指標來評估模型的效能,如準確率、召回率、F1值等。

word2vec模型是否自動訓練?

Word2Vec模型是一種自動訓練的模型,它使用神經網路來自動學習單字之間的關係,並將每個單字映射到向量空間。在訓練Word2Vec模型時,我們只需要提供大量的文字數據,並透過反向傳播演算法來調整模型的參數,這使得模型能夠準確地預測上下文單字。 Word2Vec模型的訓練過程是自動的,不需要手動指定單字之間的關係或特徵,因此可以大幅簡化自然語言處理的工作流程。

word2vec模型辨識不準怎麼辦

#如果Word2Vec模型的辨識準確率較低,可能是因為以下幾個原因:

1)資料集不足:Word2Vec模型需要大量的文字資料來訓練,如果資料集太小,模型可能無法學習到足夠的語言知識。

#2)超參數選擇不當:Word2Vec模型有許多超參數需要調整,如向量維度、視窗大小、學習率等。如果選擇不當,可能會影響模型的效能。

3)模型結構不適合:Word2Vec模型有兩種不同的架構(CBOW和Skip-Gram),如果選擇的架構不適合目前任務,可能會影響模型的效能。

4)資料預處理不合理:資料預處理是Word2Vec模型訓練的重要步驟,如果分詞、移除停用詞等運算不合理,可能會影響模型的效能。

針對這些問題,我們可以採取以下措施來提高模型的識別準確率:

1)增加資料集的規模:盡可能收集更多的文字數據,並將其用於模型的訓練。

2)調整超參數:根據特定的任務和資料集,選擇合適的超參數,並進行調優。

3)嘗試不同的模型架構:嘗試使用CBOW和Skip-Gram模型,並比較它們在目前任務上的表現。

4)改進資料預處理:最佳化分詞、移除停用詞等操作,以確保輸入到模型中的文字資料品質較好。

此外,我們還可以使用一些其他的技巧來提高模型的效能,例如使用負採樣、層次softmax等最佳化演算法,使用更好的初始化方法,增加訓練的迭代次數等。如果模型的辨識準確率仍然較低,可能需要進一步分析模型的預測結果,找出可能存在的問題,並針對性地進行最佳化。例如,可以嘗試使用更複雜的模型結構,增加模型的層數和神經元數量,或使用其他的自然語言處理技術,如BERT、ELMo等。另外,還可以使用整合學習等技術將多個模型的預測結果結合起來,以提高模型的效能。

以上是使用Word2Vec模型:將單字轉換為向量化表示的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

探究RNN、LSTM和GRU的概念、區別和優劣

Jan 22, 2024 pm 07:51 PM

探究RNN、LSTM和GRU的概念、區別和優劣

Jan 22, 2024 pm 07:51 PM

在時間序列資料中,觀察值之間存在依賴關係,因此它們不是相互獨立的。然而,傳統的神經網路將每個觀察視為獨立的,這限制了模型對時間序列資料的建模能力。為了解決這個問題,循環神經網路(RNN)被引入,它引入了記憶的概念,透過在網路中建立資料點之間的依賴關係來捕捉時間序列資料的動態特性。透過循環連接,RNN可以將先前的資訊傳遞到當前觀察中,從而更好地預測未來的值。這使得RNN成為處理時間序列資料任務的強大工具。但是RNN是如何實現這種記憶的呢? RNN透過神經網路中的回饋迴路實現記憶,這是RNN與傳統神經

利用雙向LSTM模型進行文本分類的案例

Jan 24, 2024 am 10:36 AM

利用雙向LSTM模型進行文本分類的案例

Jan 24, 2024 am 10:36 AM

雙向LSTM模型是一種用於文字分類的神經網路。以下是一個簡單範例,示範如何使用雙向LSTM進行文字分類任務。首先,我們需要匯入所需的函式庫和模組:importosimportnumpyasnpfromkeras.preprocessing.textimportTokenizerfromkeras.preprocessing.sequenceimportpad_sequencesfromkeras.modelsimportSequentialfromkeras.layersimportDense,Emquencesfromkeras.modelsimportSequentialfromkeras.layersimportDense,Emquencesfromkeras.modelsimportSequentialfromkeras.layers

計算神經網路的浮點操作數(FLOPS)

Jan 22, 2024 pm 07:21 PM

計算神經網路的浮點操作數(FLOPS)

Jan 22, 2024 pm 07:21 PM

FLOPS是電腦效能評估的標準之一,用來衡量每秒鐘的浮點運算次數。在神經網路中,FLOPS常用於評估模型的計算複雜度和計算資源的使用率。它是一個重要的指標,用來衡量電腦的運算能力和效率。神經網路是一種複雜的模型,由多層神經元組成,用於進行資料分類、迴歸和聚類等任務。訓練和推斷神經網路需要進行大量的矩陣乘法、卷積等計算操作,因此計算複雜度非常高。 FLOPS(FloatingPointOperationsperSecond)可以用來衡量神經網路的運算複雜度,進而評估模型的運算資源使用效率。 FLOP

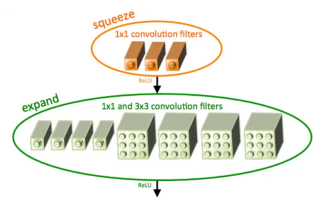

SqueezeNet簡介及其特點

Jan 22, 2024 pm 07:15 PM

SqueezeNet簡介及其特點

Jan 22, 2024 pm 07:15 PM

SqueezeNet是一種小巧而精確的演算法,它在高精度和低複雜度之間達到了很好的平衡,因此非常適合資源有限的移動和嵌入式系統。 2016年,DeepScale、加州大學柏克萊分校和史丹佛大學的研究人員提出了一個緊湊高效的捲積神經網路(CNN)-SqueezeNet。近年來,研究人員對SqueezeNet進行了多次改進,其中包括SqueezeNetv1.1和SqueezeNetv2.0。這兩個版本的改進不僅提高了準確性,還降低了計算成本。 SqueezeNetv1.1在ImageNet資料集上的精確度

比較擴張卷積和空洞卷積的異同及相互關係

Jan 22, 2024 pm 10:27 PM

比較擴張卷積和空洞卷積的異同及相互關係

Jan 22, 2024 pm 10:27 PM

擴張卷積和空洞卷積是卷積神經網路常用的操作,本文將詳細介紹它們的差異和關係。一、擴張卷積擴張卷積,又稱為膨脹卷積或空洞卷積,是一種卷積神經網路中的操作。它是在傳統的捲積操作基礎上進行的擴展,透過在卷積核中插入空洞來增大卷積核的感受野。這樣一來,網路可以更好地捕捉更大範圍的特徵。擴張卷積在影像處理領域有著廣泛的應用,能夠在不增加參數數量和運算量的情況下提升網路的效能。透過擴大卷積核的感受野,擴張卷積能夠更好地處理影像中的全局訊息,從而提高特徵提取的效果。擴張卷積的主要想法是,在卷積核的周圍引入一些

孿生神經網路:原理與應用解析

Jan 24, 2024 pm 04:18 PM

孿生神經網路:原理與應用解析

Jan 24, 2024 pm 04:18 PM

孿生神經網路(SiameseNeuralNetwork)是一種獨特的人工神經網路結構。它由兩個相同的神經網路組成,這兩個網路共享相同的參數和權重。同時,這兩個網路也共享相同的輸入資料。這個設計靈感源自於孿生兄弟,因為這兩個神經網路在結構上完全相同。孿生神經網路的原理是透過比較兩個輸入資料之間的相似度或距離來完成特定任務,如影像匹配、文字匹配和人臉辨識。在訓練過程中,網路會試圖將相似的資料映射到相鄰的區域,將不相似的資料映射到遠離的區域。這樣,網路能夠學習如何對不同的資料進行分類或匹配,以實現相應

使用卷積神經網路進行影像降噪

Jan 23, 2024 pm 11:48 PM

使用卷積神經網路進行影像降噪

Jan 23, 2024 pm 11:48 PM

卷積神經網路在影像去噪任務中表現出色。它利用學習到的濾波器對雜訊進行過濾,從而恢復原始影像。本文詳細介紹了基於卷積神經網路的影像去噪方法。一、卷積神經網路概述卷積神經網路是一種深度學習演算法,透過多個卷積層、池化層和全連接層的組合來進行影像特徵學習和分類。在卷積層中,透過卷積操作提取影像的局部特徵,從而捕捉影像中的空間相關性。池化層則透過降低特徵維度來減少計算量,並保留主要特徵。全連接層負責將學習到的特徵與標籤進行映射,以實現影像的分類或其他任務。這種網路結構的設計使得卷積神經網路在影像處理與識

模糊神經網路的定義與結構解析

Jan 22, 2024 pm 09:09 PM

模糊神經網路的定義與結構解析

Jan 22, 2024 pm 09:09 PM

模糊神經網路是一種將模糊邏輯和神經網路結合的混合模型,用於解決傳統神經網路難以處理的模糊或不確定性問題。它的設計受到人類認知中模糊性和不確定性的啟發,因此被廣泛應用於控制系統、模式識別、資料探勘等領域。模糊神經網路的基本架構由模糊子系統和神經子系統所組成。模糊子系統利用模糊邏輯對輸入資料進行處理,將其轉換為模糊集合,以表達輸入資料的模糊性和不確定性。神經子系統則利用神經網路對模糊集合進行處理,用於分類、迴歸或聚類等任務。模糊子系統和神經子系統之間的相互作用使得模糊神經網路具備更強大的處理能力,能夠