深入解析BERT模型

一、BERT模型能做什么

BERT模型是一种基于Transformer模型的自然语言处理模型,用于处理文本分类、问答系统、命名实体识别和语义相似度计算等任务。由于在多项自然语言处理任务中表现出色,BERT模型成为了当前最先进的预训练语言模型之一,因此受到广泛关注和应用。

BERT模型的全称是Bidirectional Encoder Representations from Transformers,即双向编码器转换器表示。相比于传统的自然语言处理模型,BERT模型具有以下几个显著优点:首先,BERT模型能够同时考虑前后文的上下文信息,从而更好地理解语义和语境。其次,BERT模型利用Transformer架构,使得模型能够并行处理输入序列,加快了训练和推断的速度。此外,BERT模型还通过预训练和微调的方式,能够在各种任务上实现更好的效果,并具有更好的迁移学

BERT模型是一种双向编码器,能够综合文本的前后上下文信息,更准确地理解文本的含义。

BERT模型通过无标注文本数据预训练,学习到更丰富的文本表示,提高下游任务表现。

Fine-tuning:BERT模型可通过微调来适应特定任务,这使得它可以在多个自然语言处理任务中应用,并且表现出色。

BERT模型在Transformer模型的基础上进行改进,主要有以下几个方面:

1.Masked Language Model(MLM):BERT模型在预训练阶段采用了MLM的方式,即对输入文本进行随机遮盖,然后让模型预测被遮盖的词是什么。这种方式强制模型学习上下文信息,并且能够有效地减少数据稀疏性问题。

2.Next Sentence Prediction(NSP):BERT模型还采用了NSP的方式,即在预训练阶段让模型判断两个句子是否是相邻的。这种方式可以帮助模型学习文本之间的关系,从而更好地理解文本的含义。

3.Transformer Encoder:BERT模型采用了Transformer Encoder作为基础模型,通过多层Transformer Encoder的堆叠,构建了深度的神经网络结构,从而获得更丰富的特征表示能力。

4.Fine-tuning:BERT模型还采用了Fine-tuning的方式来适应特定任务,通过在预训练模型的基础上微调模型,使其更好地适应不同的任务。这种方式在多个自然语言处理任务中都表现出了良好的效果。

二、BERT模型训练一次大概多久

一般来说,BERT模型的预训练需要花费数天到数周的时间,具体取决于以下因素的影响:

1.数据集规模:BERT模型需要大量的无标注文本数据进行预训练,数据集的规模越大,训练时间就越长。

2.模型规模:BERT模型的规模越大,需要的计算资源和训练时间就越多。

3.计算资源:BERT模型的训练需要使用大规模的计算资源,如GPU集群等,计算资源的数量和质量都会影响训练时间。

4.训练策略:BERT模型的训练还需要采用一些高效的训练策略,如梯度累积、动态学习率调整等,这些策略也会影响训练时间。

三、BERT模型的参数结构

BERT模型的参数结构可以分为以下几个部分:

1)词嵌入层(Embedding Layer):将输入的文本转化为词向量,一般使用WordPiece或BPE等算法进行分词和编码。

2)Transformer Encoder层:BERT模型采用多层Transformer Encoder进行特征提取和表示学习,每个Encoder包含多个Self-Attention和Feed-Forward子层。

3)池化层(Pooling Layer):将多个Transformer Encoder层的输出进行池化,生成一个固定长度的向量作为整个句子的表示。

4)输出层:根据具体的任务进行设计,可以是单个分类器、序列标注器、回归器等。

BERT模型的参数量非常大,一般采用预训练的方式进行训练,再通过Fine-tuning的方式在特定任务上进行微调。

四、BERT模型调优技巧

BERT模型的调优技巧可以分为以下几个方面:

1)学习率调整:BERT模型的训练需要进行学习率调整,一般采用warmup和decay等方式进行调整,使得模型能够更好地收敛。

2)梯度累积:由于BERT模型的参数量非常大,一次更新所有参数的计算量非常大,因此可以采用梯度累积的方式进行优化,即将多次计算得到的梯度进行累加,然后一次性对模型进行更新。

3)模型壓縮:BERT模型的規模很大,需要大量的運算資源進行訓練和推理,因此可以採用模型壓縮的方式來減少模型大小和計算量。常用的模型壓縮技術包括模型剪枝、量化和蒸餾等。

4)資料增強:為了提升模型的泛化能力,可以採用資料增強的方式,如隨機遮蓋、資料重複、字詞交換等方式,來擴充訓練資料集。

5)硬體最佳化:BERT模型的訓練和推理需要大量的運算資源,因此可以採用GPU或TPU等高效能硬體來加速訓練和推理過程,從而提高模型的訓練效率和推理速度。

6)Fine-tuning策略:針對不同的任務,可以採用不同的Fine-tuning策略來最佳化模型的效能,如微調層次、學習速率調整、梯度累積等方式。

總的來說,BERT模型是一種基於Transformer模型的預訓練語言模型,透過多層Transformer Encoder的堆疊和MLM、NSP等方式的改進,在自然語言處理方面取得了令人矚目的表現。同時,BERT模型也為其他自然語言處理任務的研究提供了新的思路和方法。

以上是深入解析BERT模型的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

熱門話題

我嘗試了使用光標AI編碼的Vibe編碼,這太神奇了!

Mar 20, 2025 pm 03:34 PM

我嘗試了使用光標AI編碼的Vibe編碼,這太神奇了!

Mar 20, 2025 pm 03:34 PM

Vibe編碼通過讓我們使用自然語言而不是無盡的代碼行創建應用程序來重塑軟件開發的世界。受Andrej Karpathy等有遠見的人的啟發,這種創新的方法使Dev

2025年2月的Genai推出前5名:GPT-4.5,Grok-3等!

Mar 22, 2025 am 10:58 AM

2025年2月的Genai推出前5名:GPT-4.5,Grok-3等!

Mar 22, 2025 am 10:58 AM

2025年2月,Generative AI又是一個改變遊戲規則的月份,為我們帶來了一些最令人期待的模型升級和開創性的新功能。從Xai的Grok 3和Anthropic的Claude 3.7十四行詩到Openai的G

如何使用Yolo V12進行對象檢測?

Mar 22, 2025 am 11:07 AM

如何使用Yolo V12進行對象檢測?

Mar 22, 2025 am 11:07 AM

Yolo(您只看一次)一直是領先的實時對象檢測框架,每次迭代都在以前的版本上改善。最新版本Yolo V12引入了進步,可顯著提高準確性

最佳AI藝術生成器(免費付款)創意項目

Apr 02, 2025 pm 06:10 PM

最佳AI藝術生成器(免費付款)創意項目

Apr 02, 2025 pm 06:10 PM

本文回顧了AI最高的藝術生成器,討論了他們的功能,對創意項目的適用性和價值。它重點介紹了Midjourney是專業人士的最佳價值,並建議使用Dall-E 2進行高質量的可定製藝術。

Chatgpt 4 o可用嗎?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4 o可用嗎?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4當前可用並廣泛使用,與諸如ChatGpt 3.5(例如ChatGpt 3.5)相比,在理解上下文和產生連貫的響應方面取得了重大改進。未來的發展可能包括更多個性化的間

哪個AI比Chatgpt更好?

Mar 18, 2025 pm 06:05 PM

哪個AI比Chatgpt更好?

Mar 18, 2025 pm 06:05 PM

本文討論了AI模型超過Chatgpt,例如Lamda,Llama和Grok,突出了它們在準確性,理解和行業影響方面的優勢。(159個字符)

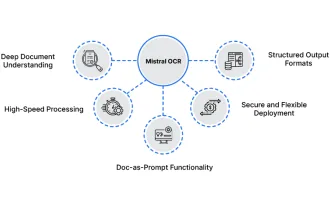

如何將Mistral OCR用於下一個抹布模型

Mar 21, 2025 am 11:11 AM

如何將Mistral OCR用於下一個抹布模型

Mar 21, 2025 am 11:11 AM

MISTRAL OCR:通過多模式文檔理解徹底改變檢索效果 檢索增強的生成(RAG)系統具有明顯高級的AI功能,從而可以訪問大量的數據存儲,以獲得更明智的響應

最佳AI聊天機器人比較(Chatgpt,Gemini,Claude&更多)

Apr 02, 2025 pm 06:09 PM

最佳AI聊天機器人比較(Chatgpt,Gemini,Claude&更多)

Apr 02, 2025 pm 06:09 PM

本文比較了諸如Chatgpt,Gemini和Claude之類的頂級AI聊天機器人,重點介紹了其獨特功能,自定義選項以及自然語言處理和可靠性的性能。