2 月8 日訊息,相比較微軟的風生水起,蘋果公司在AI 領域的佈局顯得低調很多,但這並不意味著蘋果在該領域就沒有絲毫建樹。 蘋果公司近日發布了名為「MGIE」的新型開源人工智慧模型,它可以根據自然語言指令編輯圖像。

圖源:VentureBeat 與Midjourney 合作製作

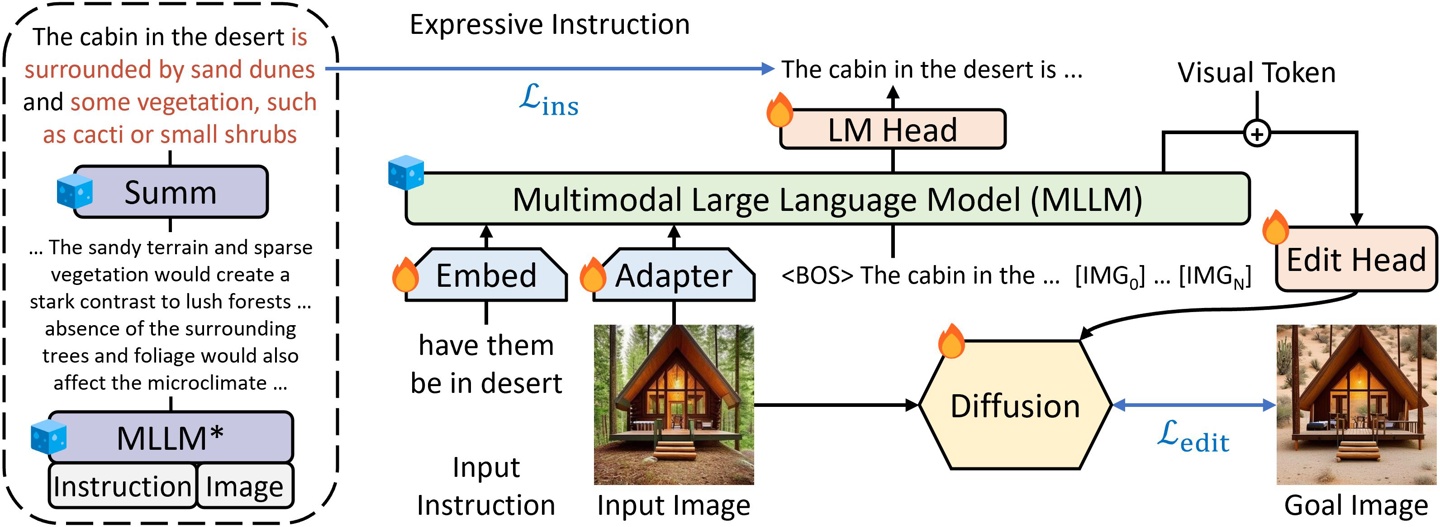

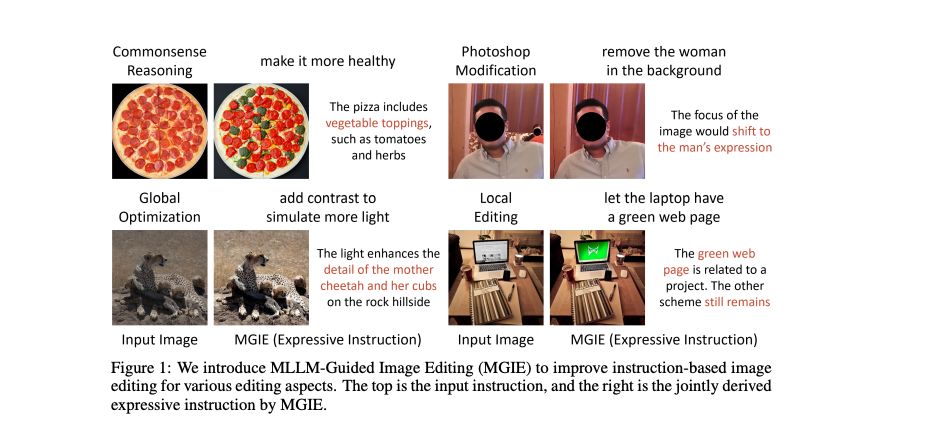

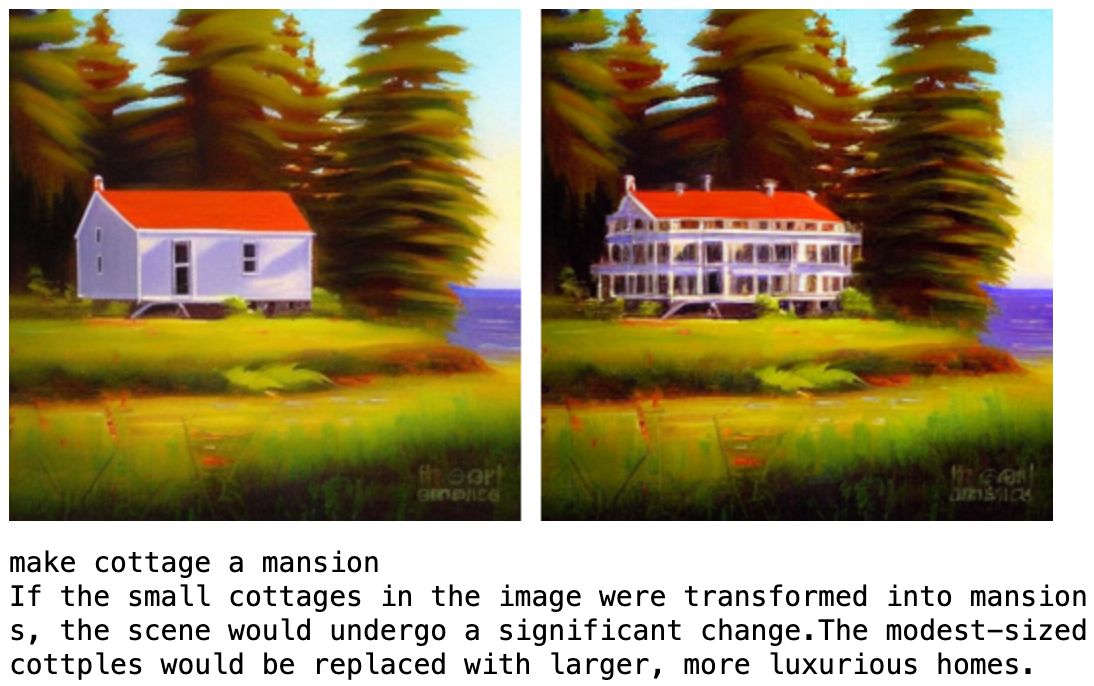

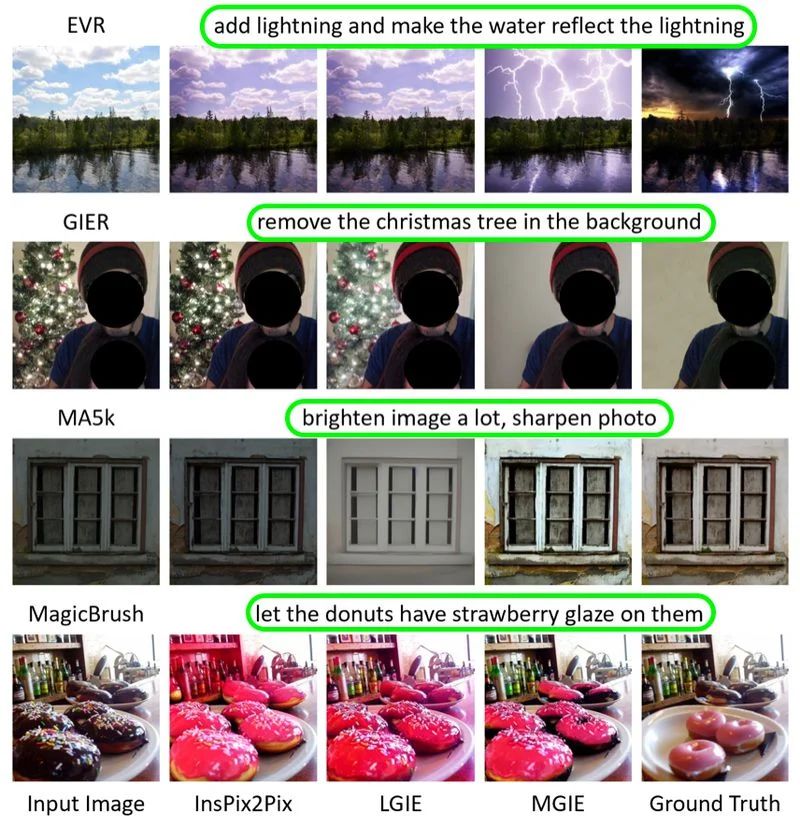

MGIE(MLLM-Guided Image Editing)是一種利用多模態大型語言模型(MLLM)解釋使用者指令並執行像素級操作的技術。它能夠理解使用者的自然語言命令,並進行類似Photoshop的修改、全域照片最佳化和局部編輯等操作。透過MGIE,使用者可以輕鬆地對圖片進行各種編輯,而無需熟悉複雜的影像處理軟體。這項技術在簡化影像編輯流程的同時,也提供了更直觀和高效的編輯方式。

蘋果公司與加州大學聖塔芭芭拉分校的研究人員合作,在2024年國際學習表徵會議(ICLR)上公佈了與MGIE相關的研究成果。 ICLR是人工智慧研究領域中最重要的會議之一。

在介紹 MGIE 之前,本站先來簡單介紹 MLLM(Multimodal Language Learning Model)。 MLLM 是一種強大的人工智慧模型,其獨特之處在於可以同時處理文字和圖像,從而增強了基於指令的圖像編輯能力。 MLLM 在跨模態理解和視覺感知反應生成方面表現出卓越的能力,然而,目前尚未廣泛應用於影像編輯任務。

MGIE 透過兩種方式將 MLLMs 整合到影像編輯過程中:其一,利用 MLLMs 從使用者輸入推導出精確而富有表現力的指令。這些指令既簡潔又明了,為編輯過程提供了清晰的指引。

例如,當輸入「讓天空更藍」時,MGIE 可以產生「將天空區域的飽和度提高 20%」的指令。

其次,它使用 MLLM 產生視覺想像力,即所需編輯的潛在表徵。這項表徵捕捉了編輯的本質,可用來指導像素級操作。 MGIE 採用了一種新穎的端到端訓練方案,可聯合優化指令推導、視覺想像和影像編輯模組。

MGIE 可以處理各種編輯情況,從簡單的顏色調整到複雜的物件操作。該模型還可以根據使用者的偏好執行全域和局部編輯。 MGIE 的部分特性和功能包括:

MGIE 是 GitHub 上的一個開源項目,使用者可以點擊這裡找到程式碼、資料和預訓練模型。該專案還提供了一個演示筆記本,展示如何使用 MGIE 完成各種編輯任務。

以上是蘋果展示 AI 新模型 MGIE,可一句話精修圖片的詳細內容。更多資訊請關注PHP中文網其他相關文章!