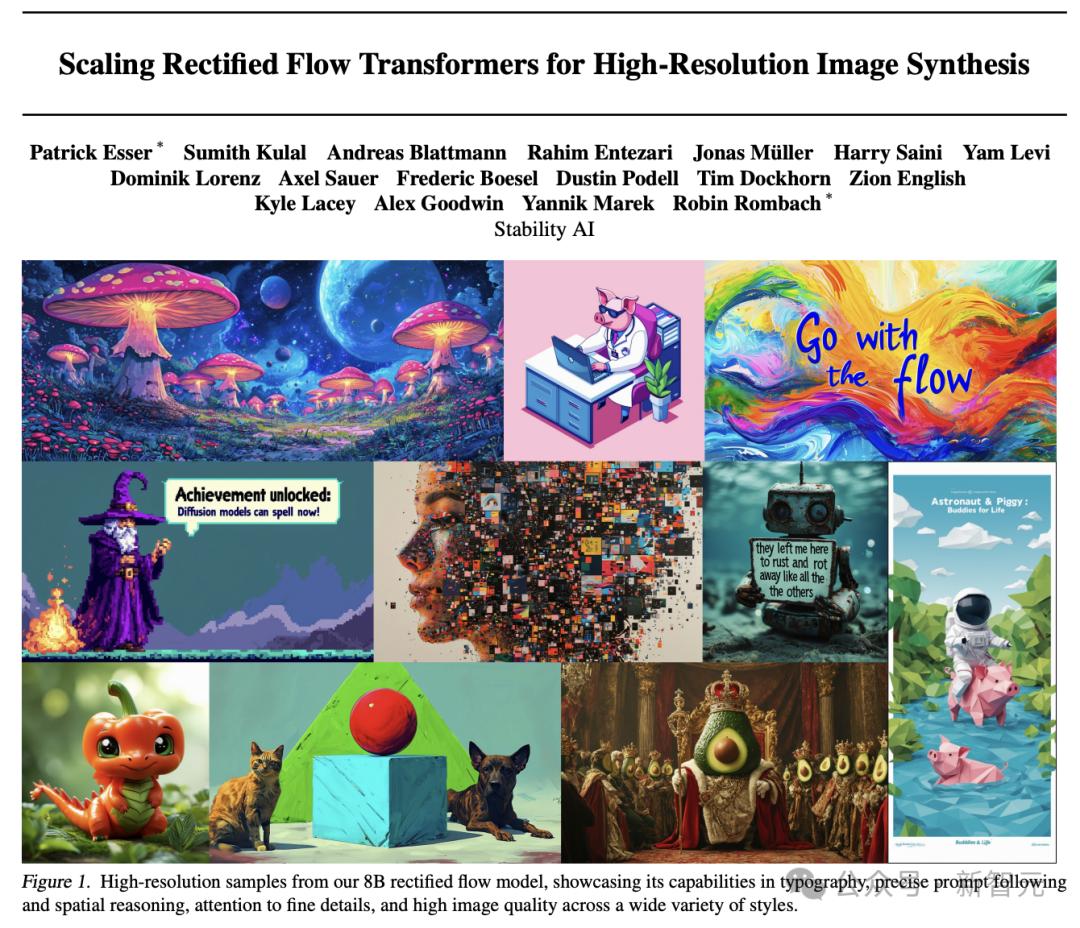

Stable Diffusion 3技術報告流出,Sora架構再立大功!生圖圈開源暴打Midjourney和DALL·E 3?

Stability AI在发布了Stable Diffusion 3之后,今天公布了详细的技术报告。

论文深入分析了Stable Diffusion 3的核心技术——改进版的Diffusion模型和一个基于DiT的文生图全新架构!

报告地址:

https://www.php.cn/link/e5fb88b398b042f6cccce46bf3fa53e8

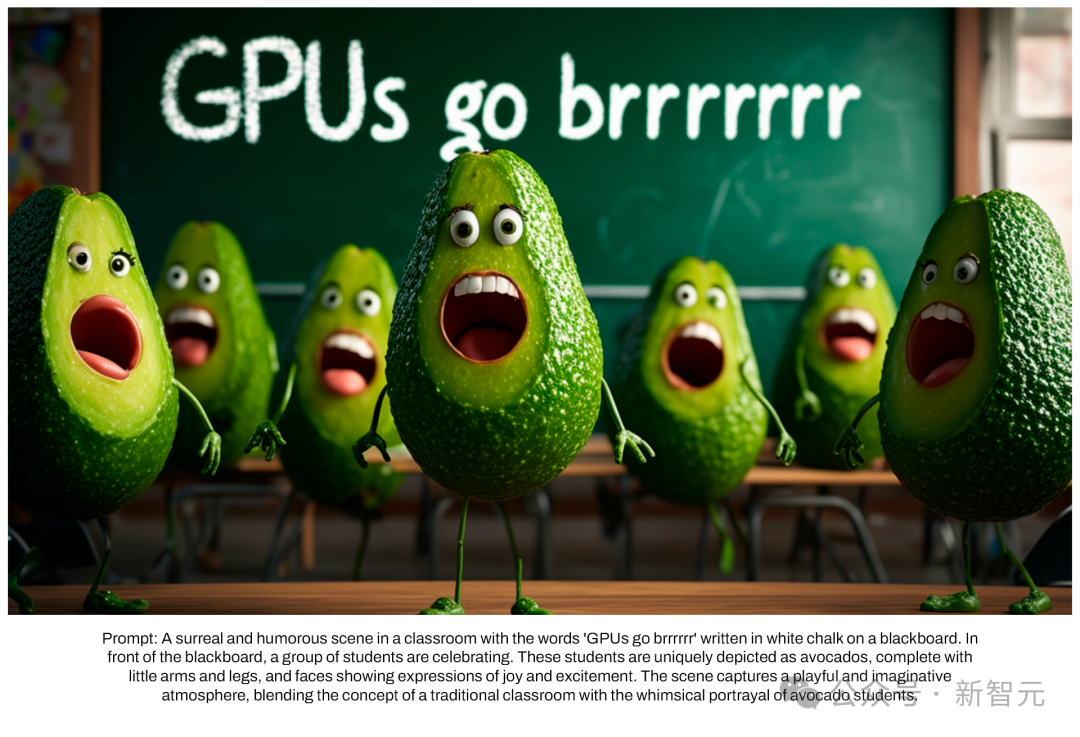

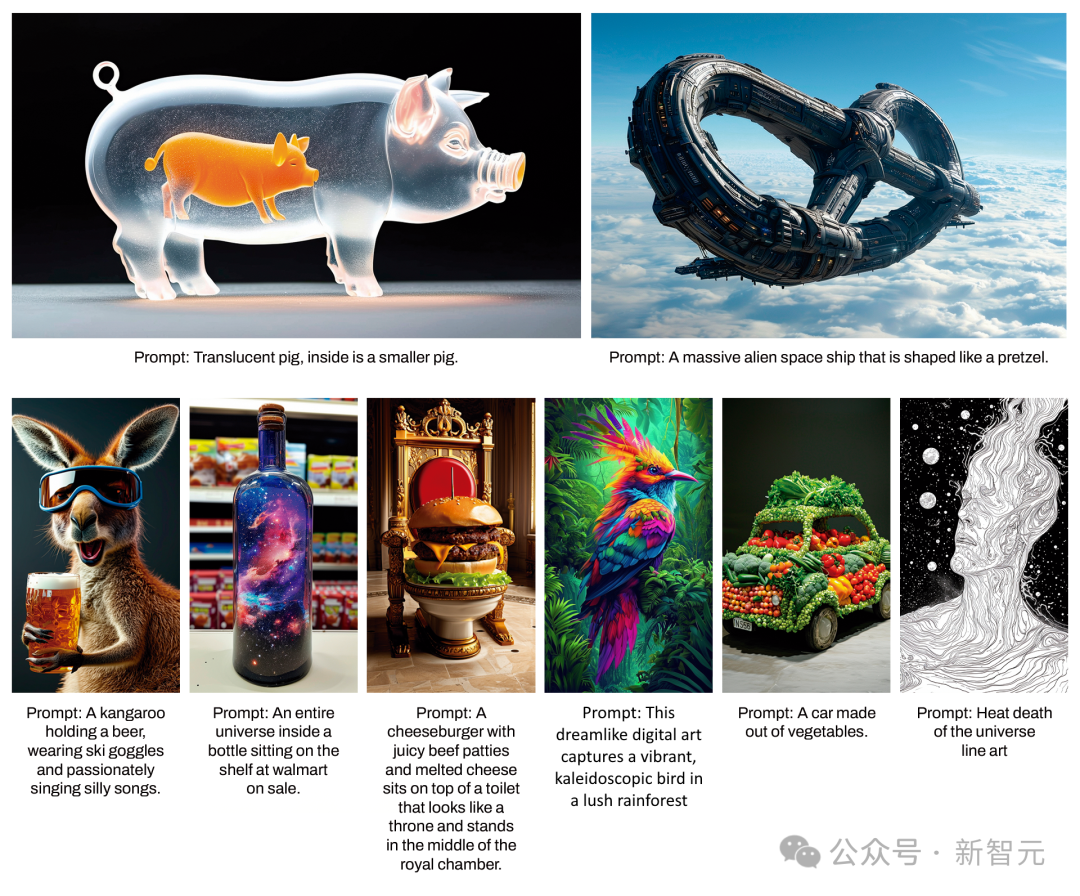

通过人类评价测试,Stable Diffusion 3在字体设计和对提示的精准响应方面,超过了DALL·E 3、Midjourney v6和Ideogram v1。

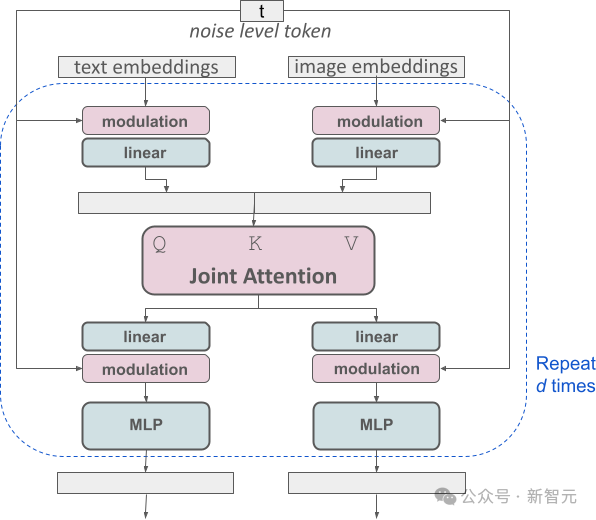

Stability AI最新开发的多模态扩散Transformer(MMDiT)架构,使用了专门针对图像和语言表示的独立权重集。与SD 3的早期版本相比,MMDiT在文本理解和拼写方面取得了显著的提升。

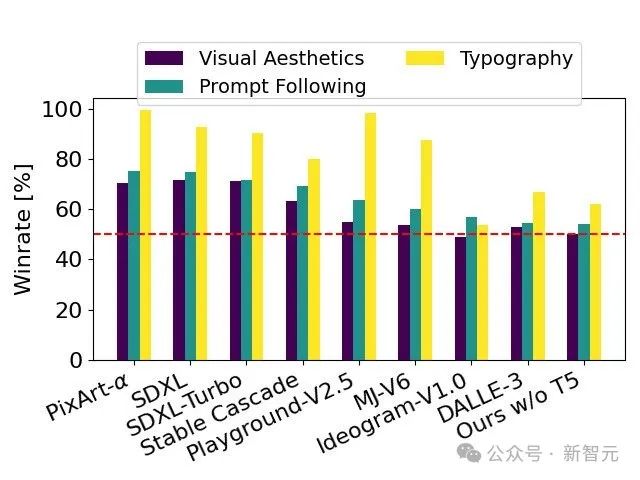

性能评估

在人类反馈的基础之上,技术报告将SD 3于大量开源模型SDXL、SDXL Turbo、Stable Cascade、Playground v2.5 和 Pixart-α,以及闭源模型DALL·E 3、Midjourney v6 和 Ideogram v1进行了详细的对比评估。

评估员根据指定提示的一致性、文本的清晰度和图像的整体美观性来选择每个模型的最佳输出。

测试结果显示,无论是在遵循提示的准确性、文本的清晰呈现还是图像的视觉美感方面,Stable Diffusion 3都达到或超过了当前文生图生成技术的最高水平。

完全没有针对硬件进行过优化的SD 3模型具有8B参数,能够在24GB显存的RTX 4090消费级GPU上运行,并且在使用50个采样步骤的情况下,生成1024x1024分辨率的图像需耗时34秒。

此外,Stable Diffusion 3在发布时将提供多个版本,参数范围从8亿到80亿,从而能以进一步降低使用的硬件门槛。

架构细节曝光

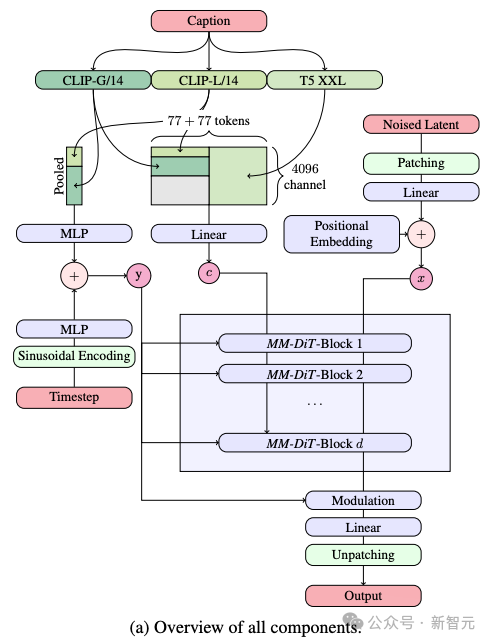

在文生图的过程中,模型需同时处理文本和图像这两种不同的信息。所以作者将这个新框架称之为MMDiT。

在文本到图像生成的过程中,模型需同时处理文本和图像这两种不同的信息类型。这就是作者将这种新技术称为MMDiT(多模态Diffusion Transformer的简称)的原因。

与Stable Diffusion之前的版本一样,SD 3采用了预训练模型来提取适合的文本和图像的表达形式。

具体而言,他们利用了三种不同的文本编码器——两个CLIP模型和一个T5 ——来处理文本信息,同时使用了一个更为先进的自编码模型来处理图像信息。

SD 3的架构是在Diffusion Transformer(DiT)的基础上建立的。由于文本和图像信息的差异,SD 3为这两种信息各自设置了独立的权重。

這個設計相當於為每種資訊類型配備了兩個獨立的Transformer,但在執行注意力機制時,會將兩種資訊的資料序列合併,這樣就可以在各自的領域內獨立工作的同時,能保持夠相互參考與融合。

透過這種獨特的構架,圖像和文字訊息之間可以相互流動和交互,從而在生成的結果中提高對內容的整體理解和視覺表現。

而且,這種架構未來還可以輕鬆擴展到其他包括影片在內的多種模態。

得益於SD 3在遵循提示方面的進步,模型能夠精確產生集中於多種不同主題和特性的圖像,同時在圖像風格上也保持了極高的靈活性。

透過重賦權法改進Rectified Flow

除了推出的全新Diffusion Transformer架構之外,SD 3對於Diffusion模型也進行了重大的改進。

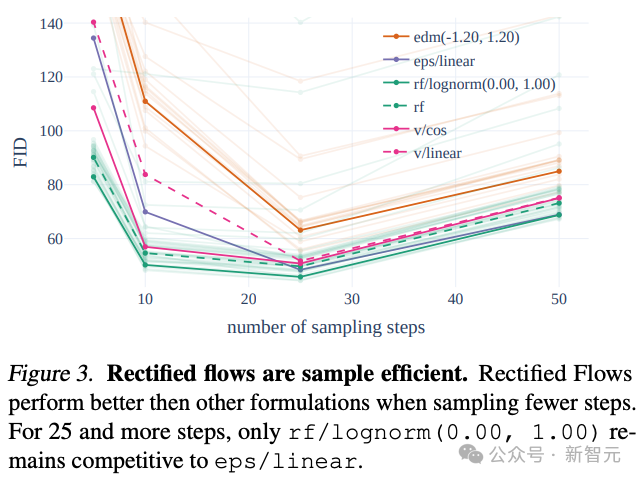

SD 3採用了Rectified Flow(RF)策略,將訓練資料和雜訊沿著直線軌跡連接起來。

這種方法讓模型的推理路徑更直接,因此可以透過更少的步驟完成樣本的生成。

作者在訓練流程中引入了一種創新的軌跡取樣計劃,特別增加了對軌跡中間部分的權重,這些部分的預測任務更具挑戰性。

透過與其他60種擴散軌跡(例如LDM、EDM 和ADM)進行比較,作者發現儘管先前的RF方法在少步驟採樣中表現更佳,但隨著採樣步驟增多,效能會慢慢下降。

為了避免這種情況的出現,作者提出的加權RF方法,就能夠持續提升模型效能。

擴充RF Transformer模型

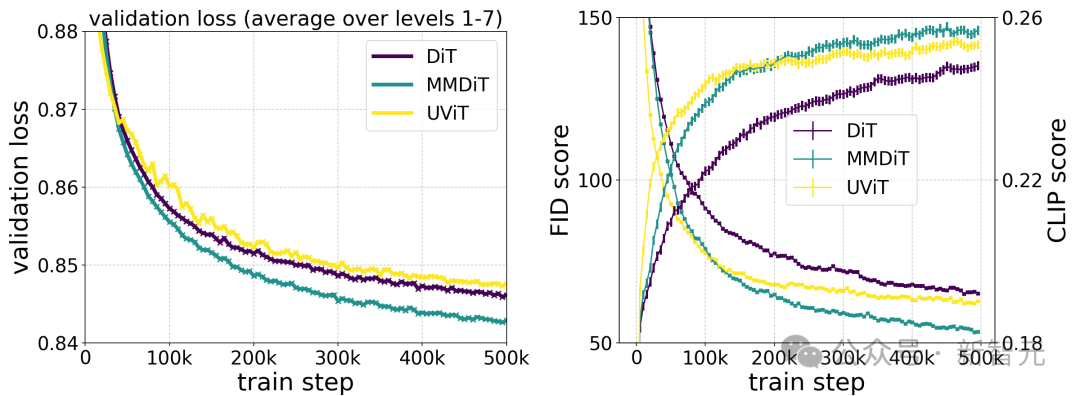

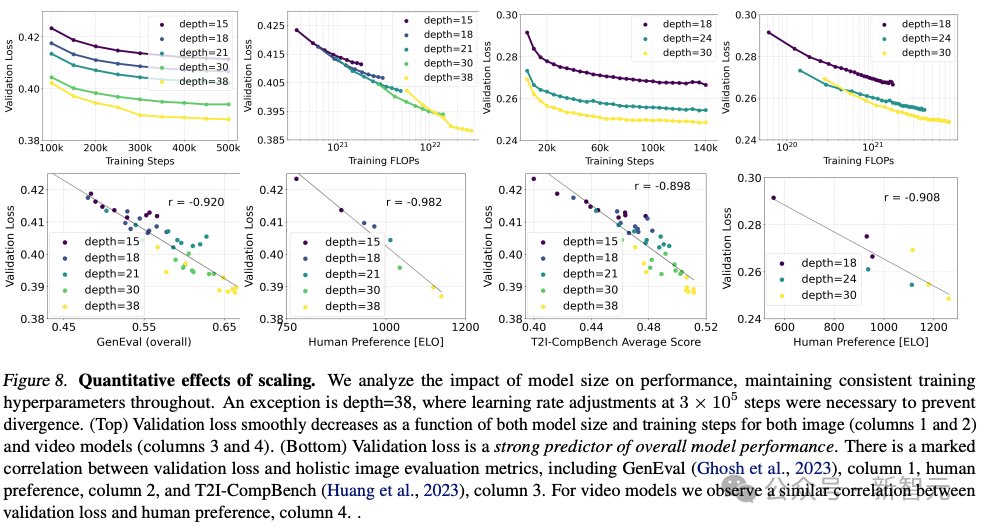

Stability AI訓練了多個不同規模的模型,從15 個模組、450M參數到38個模組、8B參數,發現模型大小和訓練步驟都能平滑地降低驗證損失。

為了驗證這是否意味著模型輸出有實質的改進,他們也評估了自動影像對齊指標和人類偏好評分。

結果表明,這些評估指標與驗證損失強相關,說明驗證損失是衡量模型整體表現的有效指標。

此外,這種擴展趨勢沒有達到飽和點,讓我們對未來能夠進一步提升模型效能持樂觀態度。

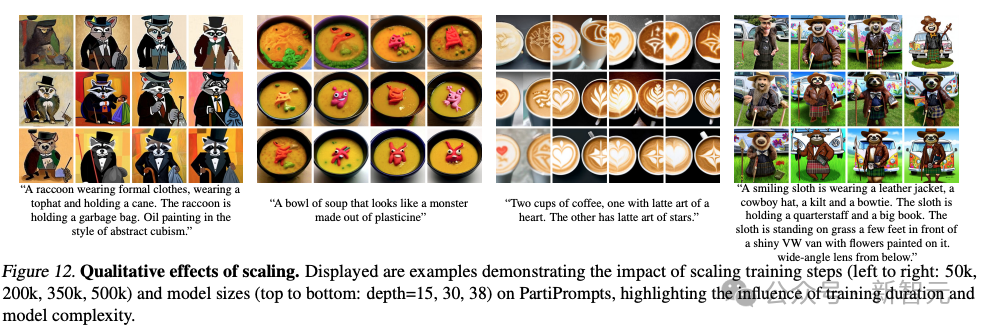

作者在256 *256像素解析度下,在4096的批次大小下,用不同參數數對模型進行了500k步驟訓練。

上圖說明了長時間訓練較大模型對樣本品質的影響。

上表顯示了GenEval的結果。當使用作者提出的訓練方法並提高訓練影像的解析度時,最大的模型在大多數類別中都表現出色,在總分上超過了 DALL·E 3。

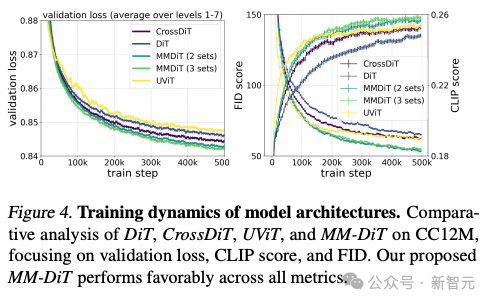

根據作者對不同架構模型的測試對比,MMDiT效果非常好,超過了DiT,Cross DiT,UViT,MM-DiT。

靈活的文字編碼器

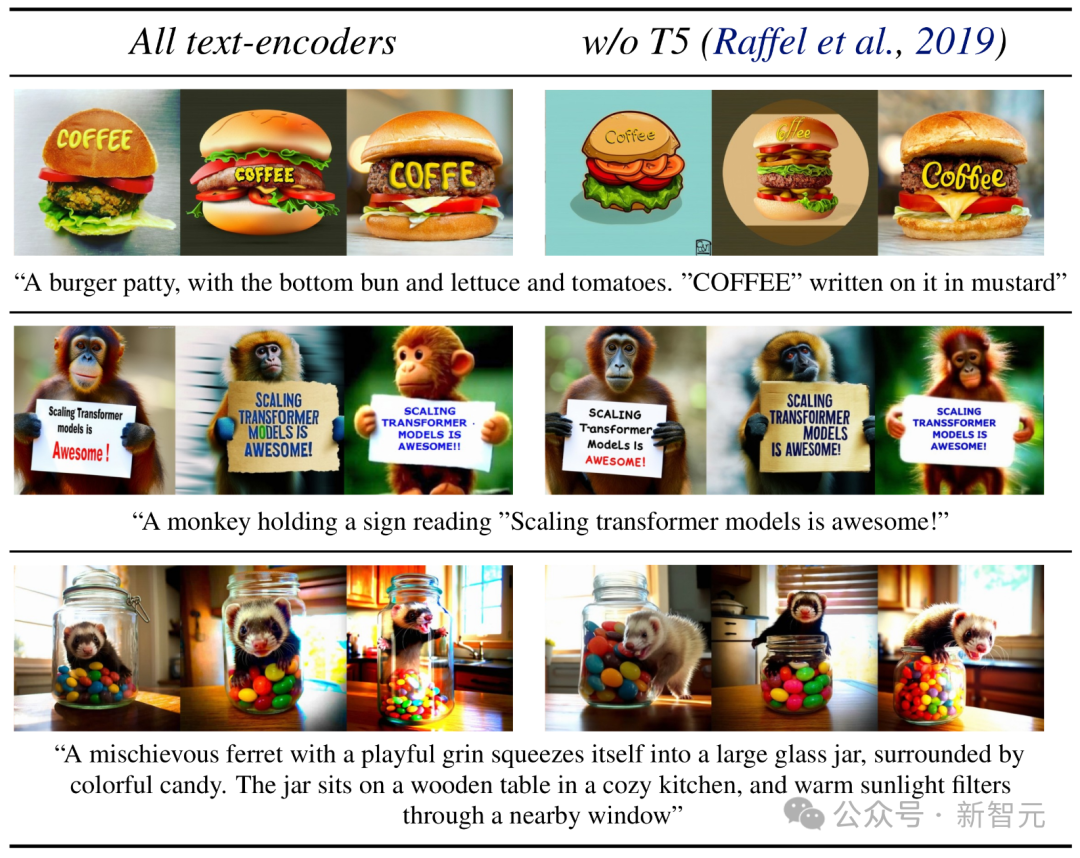

#透過在推理階段移除佔用大量記憶體的4.7B參數的T5文字編碼器, SD 3的記憶體需求大幅降低,而效能損失微乎其微。

移除這個文字編碼器不會影響影像的視覺美感(不使用T5的勝率為50%),只會略微降低文字的準確遵循能力(勝率為46%) 。

然而,為了充分發揮SD 3在生成文字的能力,作者還是建議使用T5編碼器。

因為作者發現在沒有它的情況下,排版產生文字的表現會有更大的下降(勝率為 38%)。

網友熱議

網友們對Stability AI不斷撩撥用戶但是不讓用的行為顯得有些不耐煩了,紛紛催促趕快上線讓大家使用。

看了技術報考後,網友說看來現在生圖圈要成第一個開源碾壓閉源的賽道了!

以上是Stable Diffusion 3技術報告流出,Sora架構再立大功!生圖圈開源暴打Midjourney和DALL·E 3?的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

全球最強開源 MoE 模型來了,中文能力比肩 GPT-4,價格僅 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

全球最強開源 MoE 模型來了,中文能力比肩 GPT-4,價格僅 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

想像一下,一個人工智慧模型,不僅擁有超越傳統運算的能力,還能以更低的成本實現更有效率的效能。這不是科幻,DeepSeek-V2[1],全球最強開源MoE模型來了。 DeepSeek-V2是一個強大的專家混合(MoE)語言模型,具有訓練經濟、推理高效的特點。它由236B個參數組成,其中21B個參數用於啟動每個標記。與DeepSeek67B相比,DeepSeek-V2效能更強,同時節省了42.5%的訓練成本,減少了93.3%的KV緩存,最大生成吞吐量提高到5.76倍。 DeepSeek是一家探索通用人工智

Google狂喜:JAX性能超越Pytorch、TensorFlow!或成GPU推理訓練最快選擇

Apr 01, 2024 pm 07:46 PM

Google狂喜:JAX性能超越Pytorch、TensorFlow!或成GPU推理訓練最快選擇

Apr 01, 2024 pm 07:46 PM

谷歌力推的JAX在最近的基準測試中表現已經超過Pytorch和TensorFlow,7項指標排名第一。而且測試並不是JAX性能表現最好的TPU上完成的。雖然現在在開發者中,Pytorch依然比Tensorflow更受歡迎。但未來,也許有更多的大型模型會基於JAX平台進行訓練和運行。模型最近,Keras團隊為三個後端(TensorFlow、JAX、PyTorch)與原生PyTorch實作以及搭配TensorFlow的Keras2進行了基準測試。首先,他們為生成式和非生成式人工智慧任務選擇了一組主流

AI顛覆數學研究!菲爾茲獎得主、華裔數學家領銜11篇頂刊論文|陶哲軒轉贊

Apr 09, 2024 am 11:52 AM

AI顛覆數學研究!菲爾茲獎得主、華裔數學家領銜11篇頂刊論文|陶哲軒轉贊

Apr 09, 2024 am 11:52 AM

AI,的確正在改變數學。最近,一直十分關注這個議題的陶哲軒,轉發了最近一期的《美國數學學會通報》(BulletinoftheAmericanMathematicalSociety)。圍繞著「機器會改變數學嗎?」這個話題,許多數學家發表了自己的觀點,全程火花四射,內容硬核,精彩紛呈。作者陣容強大,包括菲爾茲獎得主AkshayVenkatesh、華裔數學家鄭樂雋、紐大電腦科學家ErnestDavis等多位業界知名學者。 AI的世界已經發生了天翻地覆的變化,要知道,其中許多文章是在一年前提交的,而在這一

替代MLP的KAN,被開源專案擴展到卷積了

Jun 01, 2024 pm 10:03 PM

替代MLP的KAN,被開源專案擴展到卷積了

Jun 01, 2024 pm 10:03 PM

本月初,來自MIT等機構的研究者提出了一種非常有潛力的MLP替代方法—KAN。 KAN在準確性和可解釋性方面表現優於MLP。而且它能以非常少的參數量勝過以更大參數量運行的MLP。例如,作者表示,他們用KAN以更小的網路和更高的自動化程度重現了DeepMind的結果。具體來說,DeepMind的MLP有大約300,000個參數,而KAN只有約200個參數。 KAN與MLP一樣具有強大的數學基礎,MLP基於通用逼近定理,而KAN基於Kolmogorov-Arnold表示定理。如下圖所示,KAN在邊上具

你好,電動Atlas!波士頓動力機器人復活,180度詭異動作嚇到馬斯克

Apr 18, 2024 pm 07:58 PM

你好,電動Atlas!波士頓動力機器人復活,180度詭異動作嚇到馬斯克

Apr 18, 2024 pm 07:58 PM

波士頓動力Atlas,正式進入電動機器人時代!昨天,液壓Atlas剛「含淚」退出歷史舞台,今天波士頓動力就宣布:電動Atlas上崗。看來,在商用人形機器人領域,波士頓動力是下定決心要跟特斯拉硬剛一把了。新影片放出後,短短十幾小時內,就已經有一百多萬觀看。舊人離去,新角色登場,這是歷史的必然。毫無疑問,今年是人形機器人的爆發年。網友銳評:機器人的進步,讓今年看起來像人類的開幕式動作、自由度遠超人類,但這真不是恐怖片?影片一開始,Atlas平靜地躺在地上,看起來應該是仰面朝天。接下來,讓人驚掉下巴

時間序列預測 NLP大模型新作:為時序預測自動產生隱式Prompt

Mar 18, 2024 am 09:20 AM

時間序列預測 NLP大模型新作:為時序預測自動產生隱式Prompt

Mar 18, 2024 am 09:20 AM

今天我想分享一個最新的研究工作,這項研究來自康乃狄克大學,提出了一種將時間序列資料與自然語言處理(NLP)大模型在隱空間上對齊的方法,以提高時間序列預測的效果。此方法的關鍵在於利用隱空間提示(prompt)來增強時間序列預測的準確性。論文標題:S2IP-LLM:SemanticSpaceInformedPromptLearningwithLLMforTimeSeriesForecasting下載網址:https://arxiv.org/pdf/2403.05798v1.pdf1、問題背景大模型

特斯拉機器人進廠打工,馬斯克:手的自由度今年將達到22個!

May 06, 2024 pm 04:13 PM

特斯拉機器人進廠打工,馬斯克:手的自由度今年將達到22個!

May 06, 2024 pm 04:13 PM

特斯拉機器人Optimus最新影片出爐,已經可以在工廠裡打工了。正常速度下,它分揀電池(特斯拉的4680電池)是這樣的:官方還放出了20倍速下的樣子——在小小的「工位」上,揀啊揀啊揀:這次放出的影片亮點之一在於Optimus在廠子裡完成這項工作,是完全自主的,全程沒有人為的干預。而且在Optimus的視角之下,它還可以把放歪了的電池重新撿起來放置,主打一個自動糾錯:對於Optimus的手,英偉達科學家JimFan給出了高度的評價:Optimus的手是全球五指機器人裡最靈巧的之一。它的手不僅有觸覺

DualBEV:大幅超越BEVFormer、BEVDet4D,開卷!

Mar 21, 2024 pm 05:21 PM

DualBEV:大幅超越BEVFormer、BEVDet4D,開卷!

Mar 21, 2024 pm 05:21 PM

這篇論文探討了在自動駕駛中,從不同視角(如透視圖和鳥瞰圖)準確檢測物體的問題,特別是如何有效地從透視圖(PV)到鳥瞰圖(BEV)空間轉換特徵,這一轉換是透過視覺轉換(VT)模組實施的。現有的方法大致分為兩種策略:2D到3D和3D到2D轉換。 2D到3D的方法透過預測深度機率來提升密集的2D特徵,但深度預測的固有不確定性,尤其是在遠處區域,可能會引入不準確性。而3D到2D的方法通常使用3D查詢來採樣2D特徵,並透過Transformer學習3D和2D特徵之間對應關係的注意力權重,這增加了計算和部署的