WorldGPT來了:打造類Sora影片AI智能體,「復活」圖文

OpenAI 的 Sora 在今年 2 月驚艷亮相,為文字生成影片帶來了全新的突破。它可以根據文字輸入創作出彷彿來自好萊塢的逼真且充滿想像力的影片,讓人嘆為觀止。許多人都對這項創新讚歎不已,認為OpenAI 的表現實現了巔峰之作。

Sora引發的熱潮持續不減,同時研究者們也開始意識到AI影片生成技術的巨大潛力,這一領域正受到越來越多人的關注。

然而,當前AI 視訊生成領域,大部分演算法研究將重點放在了透過文字提示生成視頻,對於多模態輸入,特別是圖片與文字結合的場景,並沒有進行深入探討或廣泛應用。這種偏向降低了生成視訊的多樣性和可控制性,限制了從靜態影像到動態視訊的轉換能力。

另一方面,現有的大部分影片生成模型對生成影片內容缺乏可編輯性的支持,無法滿足用戶對生成影片進行個人化調整的需求。

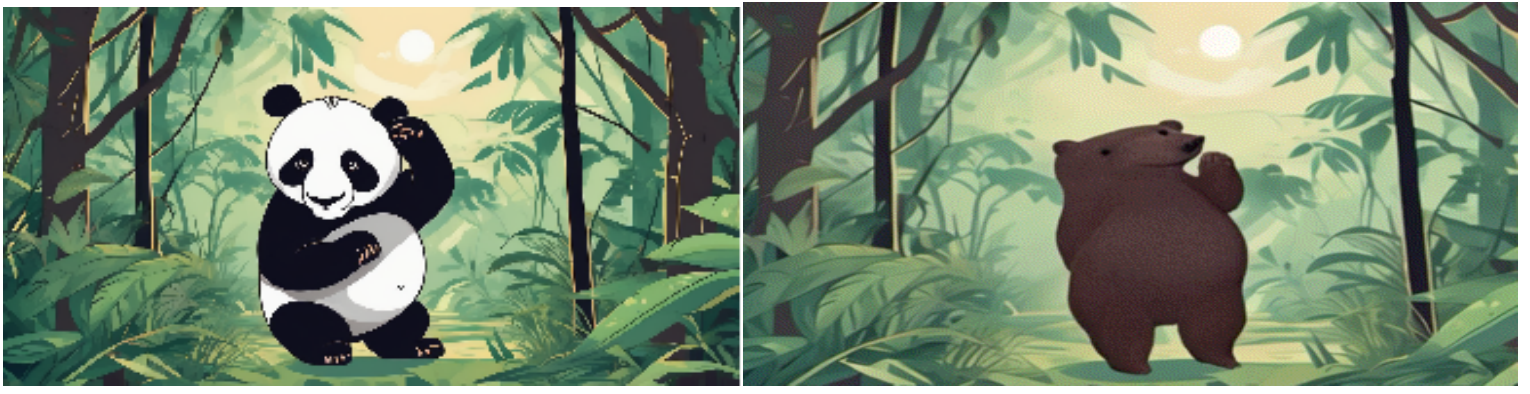

#:把熊貓變成熊,並且讓它跳舞。 (Change the panda to a bear and make it dance.)

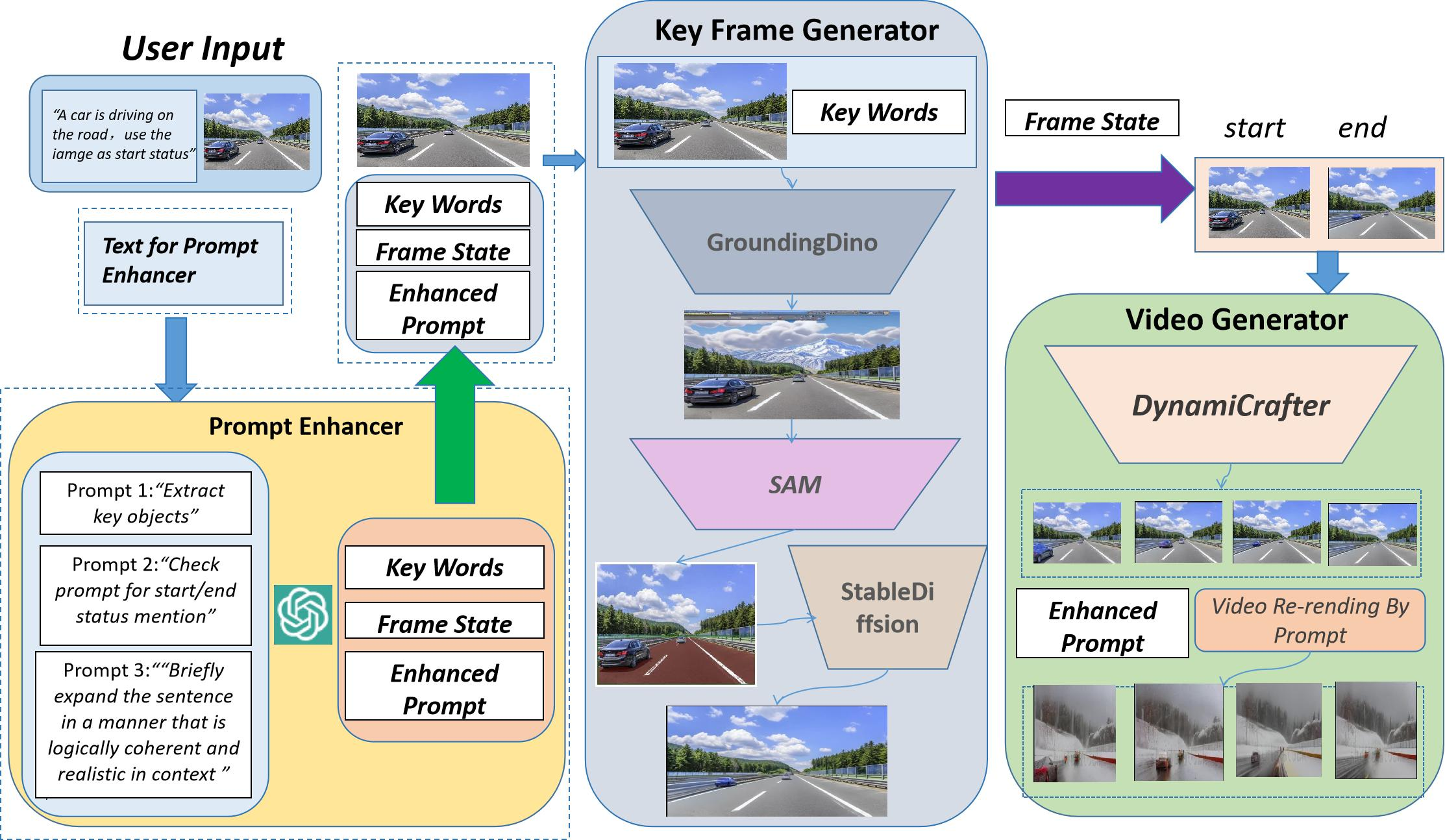

本文,來自SEEKING AI、哈佛大學、斯坦福大學以及北京大學的研究者們共同提出了一種創新的基於圖片- 文本的視頻產生編輯統一框架,名為WorldGPT。該框架建立在SEEKING AI 與上述頂尖高校共同研發的VisionGPT 框架之上,不僅能夠實現由圖片和文字直接生成影片的功能,還支援透過簡單的文字提示(prompt)對生成影片進行風格遷移、背景替換等一系列影片外觀編輯操作。

該框架的另一個顯著優勢在於其無需進行訓練,這使得技術門檻大幅降低,同時也使得部署和使用變得非常方便。使用者可以直接使用模型進行創作,而無需專注於背後繁瑣的訓練過程。

- 論文網址:https://arxiv.org/pdf/2403.07944.pdf

- 論文標題:WorldGPT: A Sora-Inspired Video AI Agent as Rich World Models from Text and Image Inputs

接下來我們來看看WorldGPT 在多種複雜影片產生控制場景中的範例展示。

背景替換生成影片

提示:「一支船隊在呼嘯的風暴中奮力前行,他們的船帆在無情風暴的巨浪中航行。(A fleet of ships pressed on through the howling tempest, their sails billowing as they navigated the towering waves of the relentless storm.)」

背景替換風格化生成影片

提示:「一條可愛的龍在城市的街道上噴火。(A cute dragon is spitting fire on an urban street.)」

物件替換背景替換生成影片

提示:「賽博龐克風格的機器人在霓虹燈照亮的反烏托邦城市景觀中疾馳,高聳的全息圖和數字衰變的反射投影到其光滑的金屬機身上。(A cyberpunk-style automaton raced through the neon-lit, dystopian cityscape, reflections of towering holograms and digital decay playing across its sleek, metallic body.)”

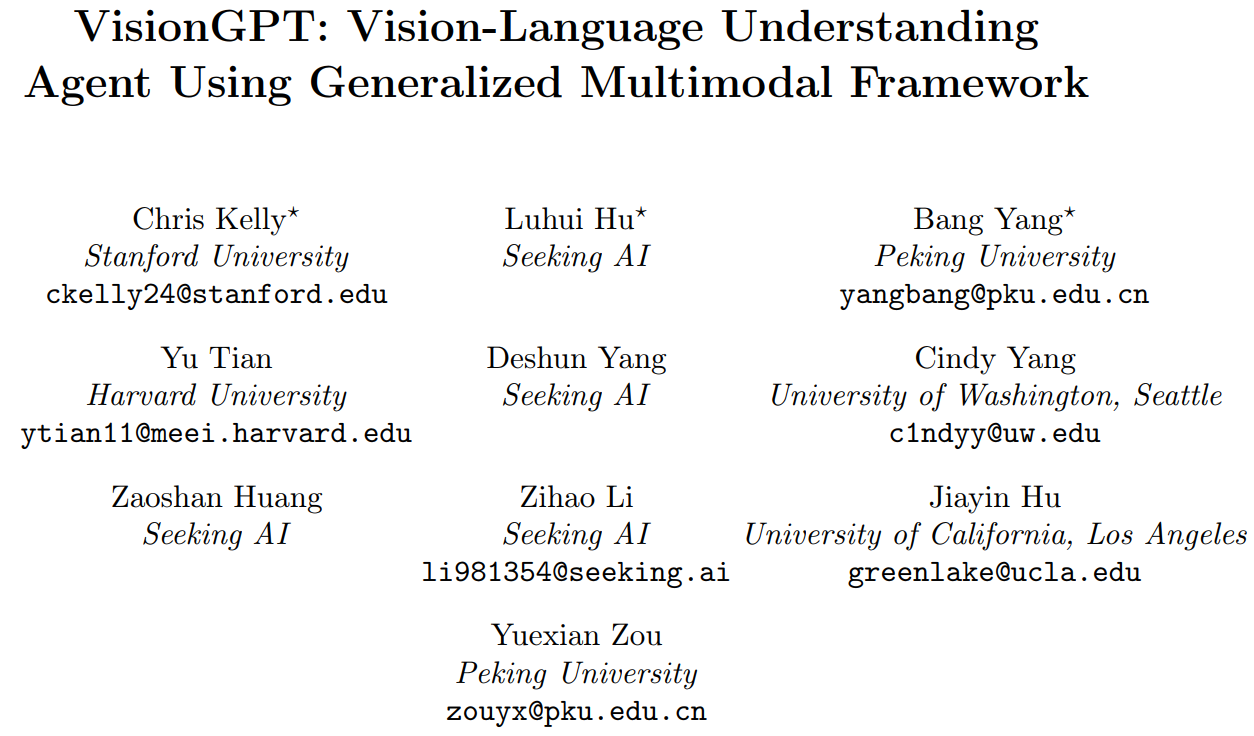

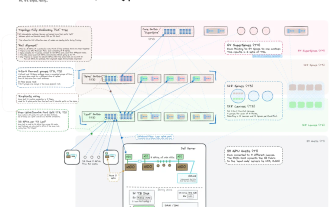

VisonGPT

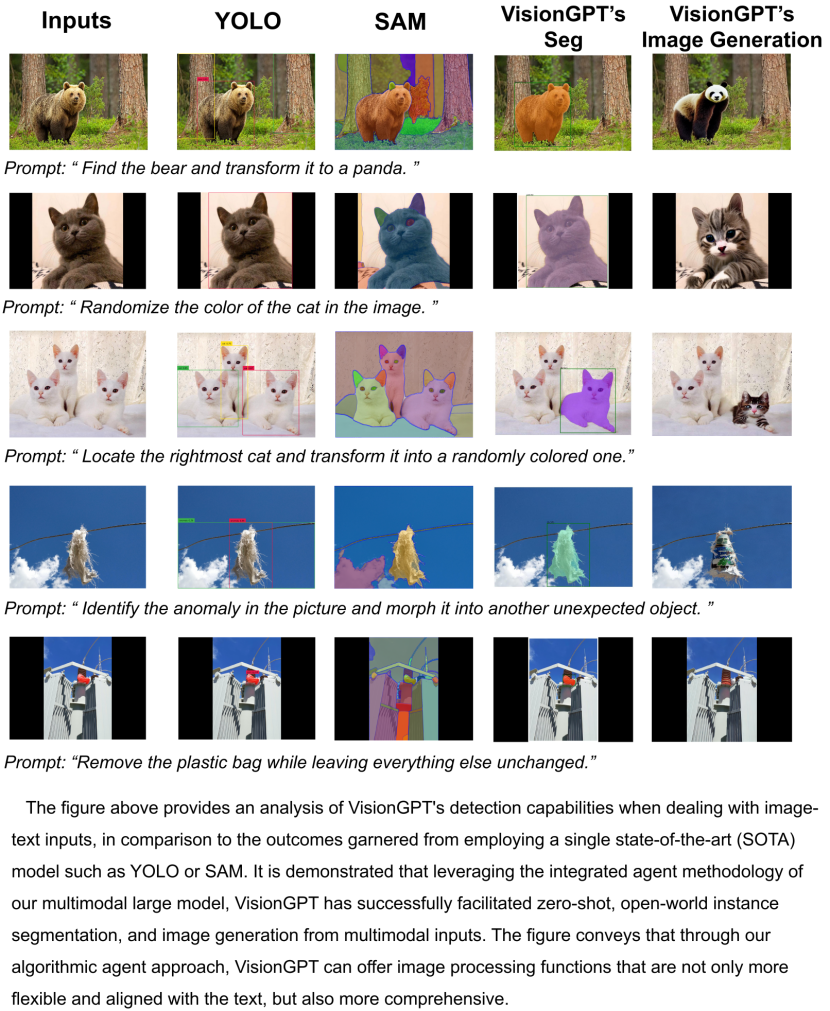

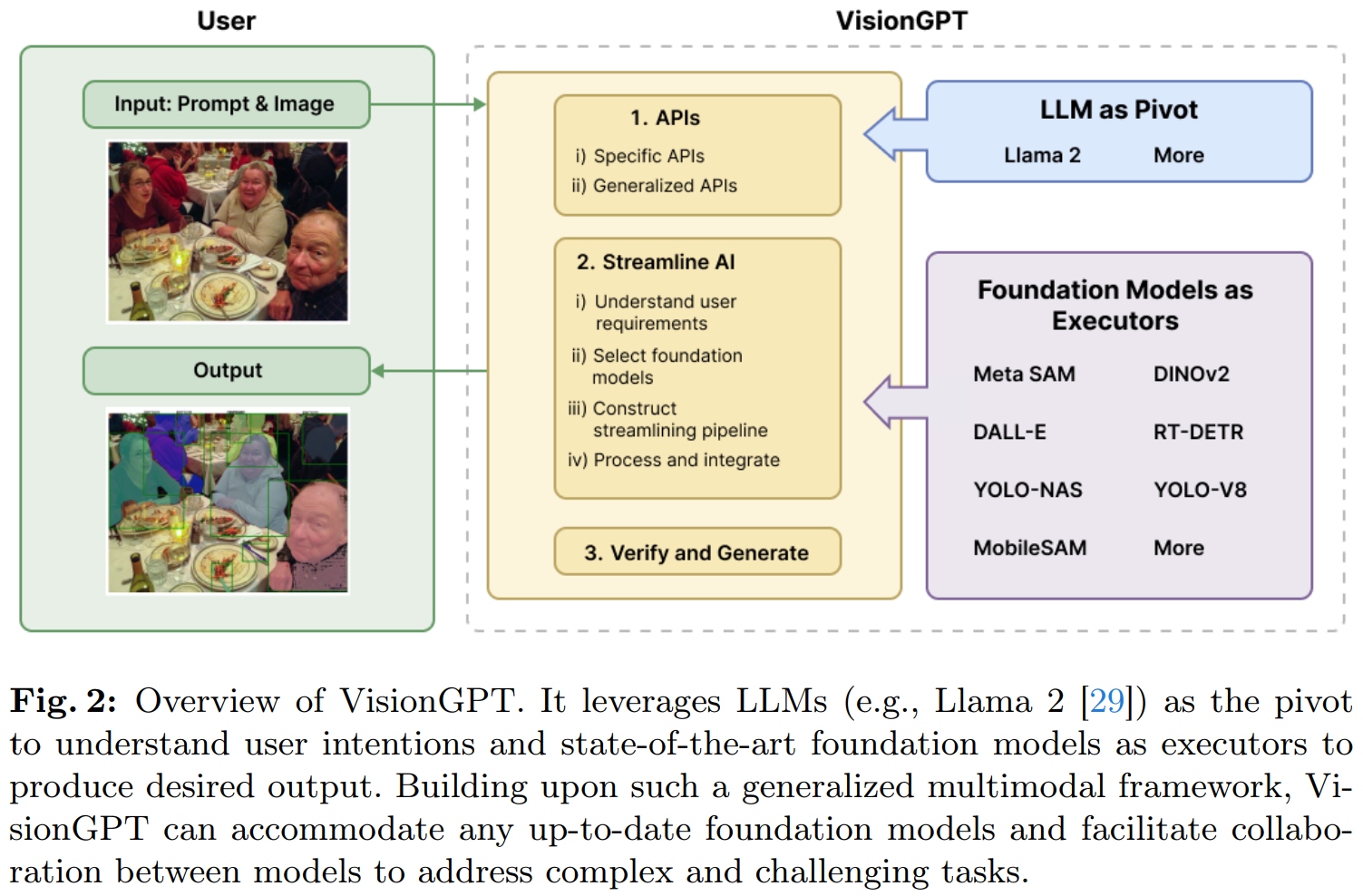

前面已經提到,WorldGPT 框架建立在 VisionGPT 框架之上。接下來我們簡單介紹一下有關 VisionGPT 的資訊。 VisionGPT 是由 SeekingAI、史丹佛大學、哈佛大學及北京大學等世界頂尖機構聯合研發,是一款開創性的開放世界視覺感知大模型架構。該框架透過智慧整合和決策選擇最先進的 SOTA 大模型,提供了強大的 AI 多模態影像處理功能。 VisionGPT 的創新之處主要體現在三個面向:- 首先,它以大型語言模型(例如LLaMA-2)為核心,將使用者的prompt 請求分解成詳細的步驟需求,並自動化調用最合適的大模型進行處理;

- 其次,VisionGPT 自動接受並融合來自多個SOTA 大模型產生的多模態輸出,從而產生針對用戶需求的圖像處理結果;

- 最後,VisionGPT 具有極高的靈活性和多功能性,無需用戶對模型進行微調,就能夠支援包括文字驅動的圖像理解、生成、編輯在內的廣泛應用場景。

- 論文地址:https://arxiv.org/pdf/2403.09027.pdf

- 論文標題:VisionGPT: Vision- Language Understanding Agent Using Generalized Multimodal Framework

VisionGPT 用例

從上面可以看出,VisionGPT 無需 fine-tune,即可以輕鬆實現 1)開放世界的實例分割;2)基於 prompt 的圖像生成和編輯功能等。 VisionGPT 的工作流程如下圖所示。

更多詳細資訊可以參考論文。

VisionGPT-3D

此外,研究者們也推出了VisionGPT-3D,旨在解決從文字到視覺元素轉換中的一大挑戰:如何高效、準確地將2D 影像轉換成3D 表示。在這個過程中,經常面臨演算法與實際需求不匹配的問題,從而影響最終結果的品質。 VisionGPT-3D 透過整合多種最先進的 SOTA 視覺大模型,提出了一個多模態框架,優化了這個轉換流程。其核心創新點在於自動選擇最適合的視覺 SOTA 模型和 3D 點雲創建演算法,並且根據文字提示等多模態輸入產生最符合用戶需求的輸出的能力。

- 論文網址:https://arxiv.org/pdf/2403.09530v1.pdf

- 論文標題: VisionGPT-3D: A Generalized Multimodal Agent for Enhanced 3D Vision Understanding

了解更多信息,請參考原論文。

以上是WorldGPT來了:打造類Sora影片AI智能體,「復活」圖文的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

值得你花時間看的擴散模型教程,來自普渡大學

Apr 07, 2024 am 09:01 AM

值得你花時間看的擴散模型教程,來自普渡大學

Apr 07, 2024 am 09:01 AM

Diffusion不僅可以更好地模仿,而且可以進行「創作」。擴散模型(DiffusionModel)是一種影像生成模型。與先前AI領域大名鼎鼎的GAN、VAE等演算法,擴散模型另闢蹊徑,其主要想法是先對影像增加噪聲,再逐步去噪的過程。其中如何去噪還原原影像是演算法的核心部分。最終演算法能夠從一張隨機的雜訊影像中產生影像。近年來,生成式AI的驚人成長將文字轉換為圖像生成、視訊生成等領域的許多令人興奮的應用提供了支援。這些生成工具背後的基本原理是擴散的概念,這是一種特殊的取樣機制,克服了先前的方法中被

一鍵生成PPT! Kimi :讓「PPT民工」先浪起來

Aug 01, 2024 pm 03:28 PM

一鍵生成PPT! Kimi :讓「PPT民工」先浪起來

Aug 01, 2024 pm 03:28 PM

Kimi:一句話,十幾秒鐘,一份PPT就新鮮出爐了。 PPT這玩意兒,可太招人煩了!開個碰頭會,要有PPT;寫個週報,要做PPT;拉個投資,要展示PPT;就連控訴出軌,都得發個PPT。大學比較像是學了個PPT專業,上課看PPT,下課做PPT。或許,37年前丹尼斯・奧斯汀發明PPT時也沒想到,有一天PPT竟然如此氾濫成災。嗎嘍們做PPT的苦逼經歷,說起來都是淚。 「一份二十多頁的PPT花了三個月,改了幾十遍,看到PPT都想吐」;「最巔峰的時候,一天做了五個PPT,連呼吸都是PPT」;「臨時開個會,都要做個

智譜AI殺入影片產生:「清影」上線,長度6秒,免費不限量

Jul 26, 2024 pm 03:35 PM

智譜AI殺入影片產生:「清影」上線,長度6秒,免費不限量

Jul 26, 2024 pm 03:35 PM

智譜大模型團隊自研打造。自從快手可靈AI火爆海內外,國內視頻生成也如同2023年的文本大模型一樣,越來越捲了。剛剛,又一影片生成大模型產品宣布正式上線:智譜AI正式發布「清影」。只要你有好的創意(幾個字到幾百個字),再加上一點點耐心(30秒),「清影」就能產生1440x960清晰度的高精準度影片。即日起,清影上線清言App,所有用戶都可以全方位體驗對話、圖片、影片、程式碼和Agent生成功能。除了覆蓋智譜清言的網頁端和App,你也可以在「AI動態照片小程式」上進行操作,快速為手機裡的照片實現動態效果

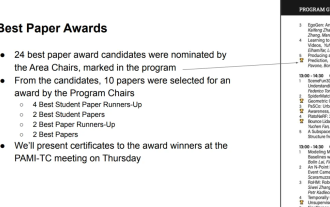

CVPR 2024全部獎項公佈!近萬人線下參會,Google華人研究員獲最佳論文獎

Jun 20, 2024 pm 05:43 PM

CVPR 2024全部獎項公佈!近萬人線下參會,Google華人研究員獲最佳論文獎

Jun 20, 2024 pm 05:43 PM

北京時間6月20日凌晨,在西雅圖舉辦的國際電腦視覺頂會CVPR2024正式公佈了最佳論文等獎項。今年共有10篇論文獲獎,其中2篇最佳論文,2篇最佳學生論文,另外還有2篇最佳論文提名和4篇最佳學生論文提名。電腦視覺(CV)領域的頂級會議是CVPR,每年都會吸引大量研究機構和高校參會。根據統計,今年共提交了11532份論文,2719篇被接收,錄取率為23.6%。根據佐治亞理工學院對CVPR2024的數據統計分析,從研究主題來看,論文數量最多的是圖像和視頻合成與生成(Imageandvideosyn

從裸機到700億參數大模型,這裡有一個教程,還有現成可用的腳本

Jul 24, 2024 pm 08:13 PM

從裸機到700億參數大模型,這裡有一個教程,還有現成可用的腳本

Jul 24, 2024 pm 08:13 PM

我們知道LLM是在大規模電腦叢集上使用海量資料訓練得到的,本站曾介紹過不少用於輔助和改進LLM訓練流程的方法和技術。而今天,我們要分享的是一篇深入技術底層的文章,介紹如何將一堆連作業系統也沒有的「裸機」變成用來訓練LLM的電腦叢集。這篇文章來自於AI新創公司Imbue,該公司致力於透過理解機器的思維方式來實現通用智慧。當然,將一堆連作業系統也沒有的「裸機」變成用於訓練LLM的電腦叢集並不是一個輕鬆的過程,充滿了探索和試錯,但Imbue最終成功訓練了一個700億參數的LLM,並在此過程中積累

AI在用 | AI製作獨居女孩生活Vlog,3天狂攬萬點讚量

Aug 07, 2024 pm 10:53 PM

AI在用 | AI製作獨居女孩生活Vlog,3天狂攬萬點讚量

Aug 07, 2024 pm 10:53 PM

機器之能報道編輯:楊文以大模型、AIGC為代表的人工智慧浪潮已經在悄悄改變我們生活及工作方式,但絕大部分人依然不知道該如何使用。因此,我們推出了「AI在用」專欄,透過直覺、有趣且簡潔的人工智慧使用案例,來具體介紹AI使用方法,並激發大家思考。我們也歡迎讀者投稿親自實踐的創新用例。影片連結:https://mp.weixin.qq.com/s/2hX_i7li3RqdE4u016yGhQ最近,獨居女孩的生活Vlog在小紅書上走紅。一個插畫風格的動畫,再配上幾句治癒系文案,短短幾天就能輕鬆狂攬上

技術入門者必看:C語言和Python難易度解析

Mar 22, 2024 am 10:21 AM

技術入門者必看:C語言和Python難易度解析

Mar 22, 2024 am 10:21 AM

標題:技術入門者必看:C語言和Python難易度解析,需要具體程式碼範例在當今數位化時代,程式設計技術已成為一項越來越重要的能力。無論是想要從事軟體開發、數據分析、人工智慧等領域,還是僅僅出於興趣學習編程,選擇一門合適的程式語言是第一步。而在眾多程式語言中,C語言和Python作為兩種廣泛應用的程式語言,各有其特色。本文將對C語言和Python的難易度進行解析

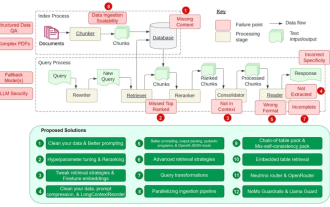

細數RAG的12個痛點,英偉達高級架構師親授解決方案

Jul 11, 2024 pm 01:53 PM

細數RAG的12個痛點,英偉達高級架構師親授解決方案

Jul 11, 2024 pm 01:53 PM

檢索增強式產生(RAG)是一種使用檢索提升語言模型的技術。具體來說,就是在語言模型生成答案之前,先從廣泛的文檔資料庫中檢索相關信息,然後利用這些信息來引導生成過程。這種技術能大幅提升內容的準確性和相關性,並能有效緩解幻覺問題,提高知識更新的速度,並增強內容生成的可追溯性。 RAG無疑是最令人興奮的人工智慧研究領域之一。有關RAG的更多詳情請參閱本站專欄文章《專補大模型短板的RAG有哪些新進展?這篇綜述講明白了》。但RAG也並非完美,使用者在使用時也常會遭遇一些「痛點」。近日,英偉達生成式AI高階解決