Al Agent--大模型時代重要落地方向

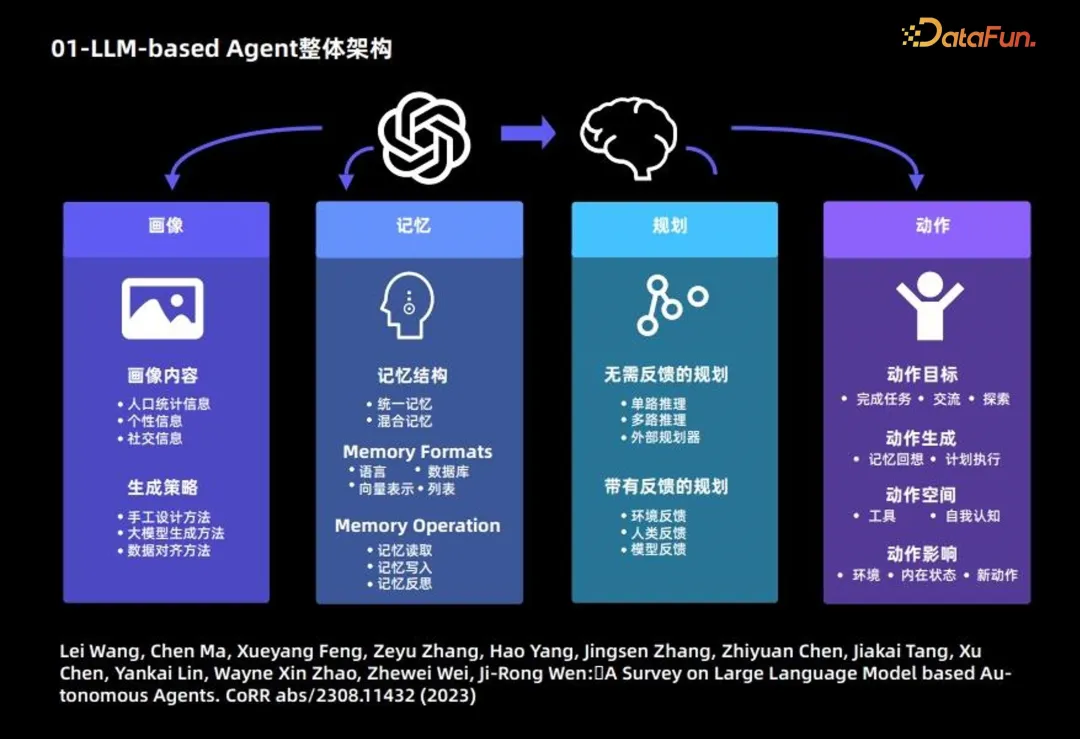

一、LLM-based Agent 整體架構

#大語言模型Agent 的組成,主要分為以下4個模組:

1. 畫像模組:主要描述Agent 的背景資訊

下面介紹畫像模組的主要內容和產生策略。

畫像內容,主要基於 3 種資訊:人口統計資訊、個人資訊和社交資訊。

產生策略:主要採用3 種策略來產生畫像內容:

- 手動設計方法:自行透過指定的方式,將使用者畫像的內容寫入大模型的 prompt 中;適用於 Agent 數量比較少的情況;

- #大模型產生方法:首先指定少量畫像,並將其作為示例,進而使用大語言模型產生更多的畫像;適用於大量 Agent 的情況;

- 資料對齊方法:需要根據事先指定的資料集中人物的背景資訊作為大語言模型的 prompt,進而做對應的預測。

2. 記憶模組:主要目的是記錄Agent 行為,並提供未來Agent 決策支援

記憶結構:

- 統一記憶:只考慮短期記憶,不考慮長期記憶。

- 混合記憶:長期記憶和短期記憶結合。

記憶形式:主要基於以下 4 種形式。

- 語言

- #資料庫

- 向量表示

- 列表

記憶內容:常見以下3 操作:

- #記憶讀取

- 記憶寫入

- #記憶反思

- 無需回饋的規劃:大語言模型在做推理的過程中無需外在環境的回饋。這類規劃進一步細分為三種:基於單路的推理,僅使用一次大語言模型就可以完整輸出推理的步驟;基於多路的推理,借鑒眾包的思想,讓大語言模型生成多個推理路徑,進而確定最佳路徑;借用外部的規劃器。

- 有回饋的規劃:這種規劃方式需要外界環境提供回饋,而大語言模型需要基於環境的回饋進行下一步以及後續的規劃。這類規劃回饋的提供者來自三個面向:環境回饋、人類回饋和模型回饋。

- 4. 動作模組

- #動作目標:有些Agent 的目標是完成某個任務,有些是交流,有些是探索。

動作空間:有些動作空間是工具的集合,有些是基於大語言模型自身知識,從自我認知的角度考慮整個動作空間。

動作影響:包括對環境的影響、對內在狀態的影響,以及對未來新動作的影響。

############以上是Agent 的整體框架,更多內容可參考下述論文:############Lei Wang, Chen Ma, Xueyang Feng, Zeyu Zhang, Hao Yang, Jingsen Zhang, Zhiyuan Chen, Jiakai Tang, Xu Chen, Yankai Lin, Wayne Xin Zhao, Zhewei Wei, Ji-Rong Wen:A Survey on Large Language Model based Autonomous Agents. /2308.11432 (2023)#########################二、LLM-based Agent 重點&困難問題

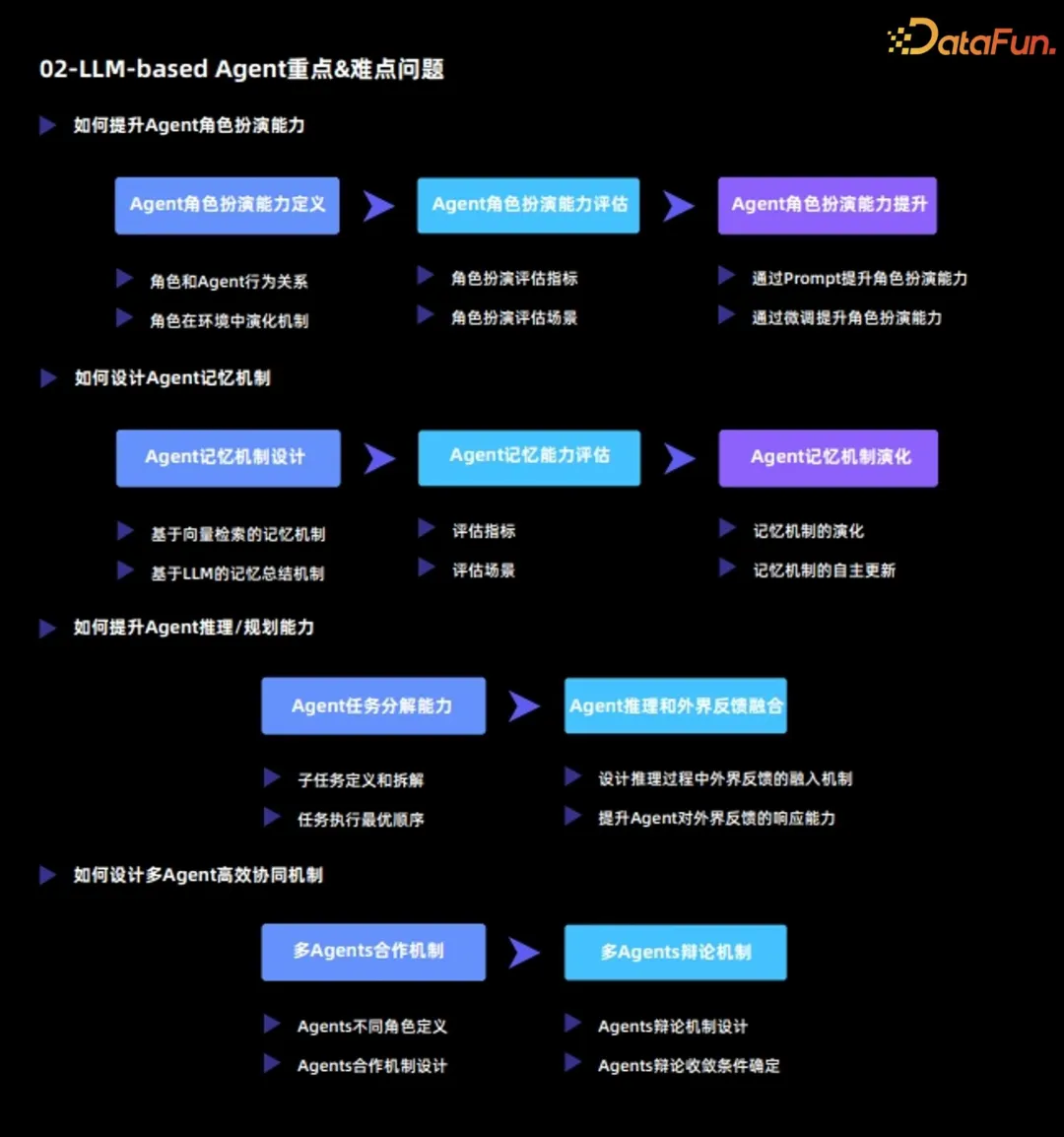

#目前大語言模型Agent 的重點和困難問題主要包括:

1. 如何提升Agent 的角色扮演能力

#Agent 最重要的功能是透過扮演某種角色,來完成特定的任務,或完成各種各樣的模擬,因此Agent 的角色扮演能力至關重要。

(1)Agent 角色扮演能力定義

#Agent 角色扮演能力分為兩個維度:

- 角色與Agent 行為關係

- #角色在環境中演化機制

(2)Agent 角色扮演能力評估

定義了角色扮演能力之後,接下來要對Agent 角色扮演能力,從以下兩個面向進行評估:

- 角色扮演評估指標

- 角色扮演評估場景

(3)Agent 角色扮演能力提升

#在評估的基礎上,需要進一步對Agent 的角色扮演能力進行提升,有以下兩種方法:

- 透過Prompt 提升角色扮演能力:此方法本質是透過設計prompt 來激發原有大語言模型的能力;

- 透過微調提升角色扮演能力:此方法通常是基於外部的數據,重新對大語言模型進行finetune,來提升角色扮演能力。

2. 如何設計Agent 記憶機制

Agent 和大語言模型最大的不同在於,Agent 能夠在環境中不斷進行自我演化和自我學習;而這其中,記憶機制扮演了非常重要的角色。從3 個維度分析Agent 的記憶機制:

##(1)Agent 記憶機制設計

常見有以下兩種記憶機制:

- 基於向量檢索的記憶機制

- #基於LLM 總結的記憶機制

(2)Agent 記憶能力評估

#對Agent 記憶能力的評估,主要需要確定以下兩點:

- 評估指標

- #評估場景

(3)Agent 記憶機制演化

最後需要對Agent 記憶機制演化進行分析,包括:#

- 記憶機制的演化

- #記憶機制的自主更新

3. 如何提升Agent 推理/規劃能力

(1)Agent 任務分解能力

- 子任務定義與拆解

- 任務執行最優順序

# (2)Agent 推理與外界回饋融合

- 設計推理過程中外界回饋的融入機制:讓Agent 和環境形成互相互動的整體;

- 提升Agent 對外界回饋的回應能力:一方面需要Agent 真實應對外界環境,另一方面需要Agent 能夠對外界環境提出問題並尋求解答。

4. 如何設計多Agent 高效率協同機制

(1)多Agents 合作機制

- #Agents 不同角色定義

- #Agents 合作機制設計

#(2)多Agents 辯論機制

#Agents 辯論機制設計

Agents 辯論收斂條件決定

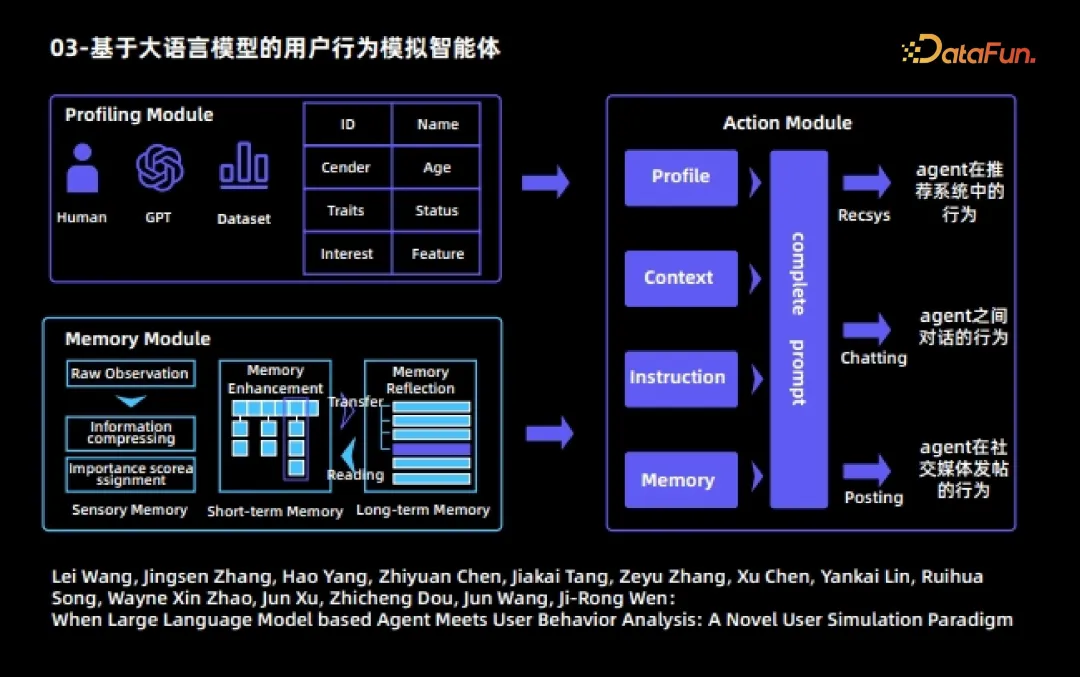

- 三、基於大語言模型的使用者行為模擬智能體

下面會舉出幾個Agent 的實際案例。首先是基於大語言模型的使用者行為模擬智能體。該智能體也是大語言模型智能體與使用者行為分析結合的早期工作。在該工作中,每個Agent 分為三個模組:

- 1. 畫像模組 對不同的Agent 指定不同的屬性,例如ID、姓名、職業、年齡、興趣以及特徵等。

- 2. 記憶模組

- #記憶模組包含三個子模組 (1)感受記憶

(2)短期記憶

- #將客觀觀測到的raw observation 處理後,產生資訊量更高的觀測,將其存放到短期記憶中;

- #短期記憶內容的儲存時間比較短

- (3)長期記憶

- 短期記憶的內容經過反覆的觸發和激活後,會自動傳入到長期記憶中

長期記憶內容的儲存時間比較長

#########長期記憶的內容會根據現有的記憶進行自主的反思以及昇華提煉。 ##################3. 動作模組#############每個Agent 可以執行三個動作:####### ###########Agent 在推薦系統中的行為,包括觀看影片、尋找下一頁、離開推薦系統等;################# #Agent 之間的對話行為;##################Agent 在社群媒體上發佈的行為。 ##################在整個模擬過程中,一個Agent 在每一輪動作中均可自由地、不受外界幹預地選擇三種動作;我們可以看到不同Agent 之間會相互對話,也會在社群媒體或推薦系統中自主地產生各種各樣的行為;透過多輪模擬之後,可以觀察到一些有趣的社會現象,以及使用者在網路上行為的規律。 ############更多內容可參考下述論文:######Lei Wang, Jingsen Zhang, Hao Yang, Zhiyuan Chen, Jiakai Tang, Zeyu Zhang, Xu Chen, Yankai Lin, Ruihua Song, Wayne Xin Zhao, Jun Xu, Zhicheng Dou, Jun Wang, Ji-Rong Wen :When Large Language Model based Agent Meets User Behavior Analysis: A Novel User Simulation Paradigm

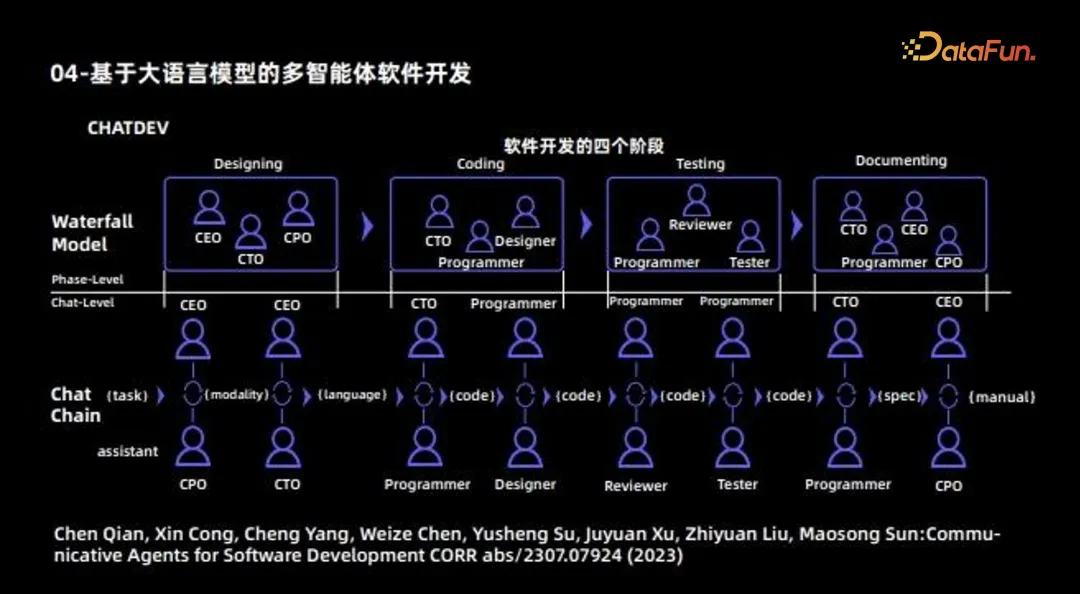

四、基於大語言模型的多智能體軟體開發

下一個Agent 的例子是使用多Agent 進行軟體開發。這篇工作也是早期多Agent 合作的工作,最主要的目的是利用不同 Agent 開發一款完整的軟體。因此可將其視為一個軟體公司,不同的Agent 會扮演不同的角色:一部分Agent 負責設計,包括CEO、CTO、CPO 等角色;一部分Agent 負責編碼,還有一部分Agent 主要負責測試;此外,還會有一部分Agent 負責撰寫文件。這樣,不同 Agent 負責不同的工作;最後再將 Agent 之間的合作機制,透過交流的方式進行協同和更新,最終完成一個軟體完整的開發過程。

-

大語言模型的Agent 目前可以分為兩大方向:#解決特定任務,如MetaGPT、ChatDev、Ghost、DESP 等 -

這類Agent 最終應是一個和人類正確價值觀對齊的“超人”,其中有兩個“限定詞”:

對齊正確的人類價值;

超越常人能力。 模擬現實世界,如Generative Agent、Social Simulation、RecAgent等

這類Agent 所需要的能力,和第一類是完全相反的。

- 讓 Agent 呈現多元的價值觀;

#希望 Agent 盡量符合一般人,而不是超越常人。

此外,大語言模型Agent 目前存在以下兩個痛點:幻覺問題 -

由於Agent 需要跟環境進行不斷交互,因此每個步驟的幻覺都會被累加,即會產生累積效應,讓問題變得更加嚴重;因此大模型的幻覺問題在這裡需要得到進一步的重視。其解決方法包括: 設計高效率的人機協作框架;

以上是Al Agent--大模型時代重要落地方向的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

位元組跳動剪映推出 SVIP 超級會員:連續包年 499 元,提供多種 AI 功能

Jun 28, 2024 am 03:51 AM

位元組跳動剪映推出 SVIP 超級會員:連續包年 499 元,提供多種 AI 功能

Jun 28, 2024 am 03:51 AM

本站6月27日訊息,剪映是由位元組跳動旗下臉萌科技開發的一款影片剪輯軟體,依託於抖音平台且基本面向該平台用戶製作短影片內容,並相容於iOS、安卓、Windows 、MacOS等作業系統。剪映官方宣布會員體系升級,推出全新SVIP,包含多種AI黑科技,例如智慧翻譯、智慧劃重點、智慧包裝、數位人合成等。價格方面,剪映SVIP月費79元,年費599元(本站註:折合每月49.9元),連續包月則為59元每月,連續包年為499元每年(折合每月41.6元) 。此外,剪映官方也表示,為提升用戶體驗,向已訂閱了原版VIP

本地使用Groq Llama 3 70B的逐步指南

Jun 10, 2024 am 09:16 AM

本地使用Groq Llama 3 70B的逐步指南

Jun 10, 2024 am 09:16 AM

譯者|布加迪審校|重樓本文介紹如何使用GroqLPU推理引擎在JanAI和VSCode中產生超快速反應。每個人都致力於建立更好的大語言模型(LLM),例如Groq專注於AI的基礎設施方面。這些大模型的快速響應是確保這些大模型更快捷響應的關鍵。本教學將介紹GroqLPU解析引擎以及如何在筆記型電腦上使用API和JanAI本地存取它。本文也將把它整合到VSCode中,以幫助我們產生程式碼、重構程式碼、輸入文件並產生測試單元。本文將免費創建我們自己的人工智慧程式設計助理。 GroqLPU推理引擎簡介Groq

使用Rag和Sem-Rag提供上下文增強AI編碼助手

Jun 10, 2024 am 11:08 AM

使用Rag和Sem-Rag提供上下文增強AI編碼助手

Jun 10, 2024 am 11:08 AM

透過將檢索增強生成和語意記憶納入AI編碼助手,提升開發人員的生產力、效率和準確性。譯自EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG,作者JanakiramMSV。雖然基本AI程式設計助理自然有幫助,但由於依賴對軟體語言和編寫軟體最常見模式的整體理解,因此常常無法提供最相關和正確的程式碼建議。這些編碼助手產生的代碼適合解決他們負責解決的問題,但通常不符合各個團隊的編碼標準、慣例和風格。這通常會導致需要修改或完善其建議,以便將程式碼接受到應

微調真的能讓LLM學到新東西嗎:引入新知識可能讓模型產生更多的幻覺

Jun 11, 2024 pm 03:57 PM

微調真的能讓LLM學到新東西嗎:引入新知識可能讓模型產生更多的幻覺

Jun 11, 2024 pm 03:57 PM

大型語言模型(LLM)是在龐大的文字資料庫上訓練的,在那裡它們獲得了大量的實際知識。這些知識嵌入到它們的參數中,然後可以在需要時使用。這些模型的知識在訓練結束時被「具體化」。在預訓練結束時,模型實際上停止學習。對模型進行對齊或進行指令調優,讓模型學習如何充分利用這些知識,以及如何更自然地回應使用者的問題。但是有時模型知識是不夠的,儘管模型可以透過RAG存取外部內容,但透過微調使用模型適應新的領域被認為是有益的。這種微調是使用人工標註者或其他llm創建的輸入進行的,模型會遇到額外的實際知識並將其整合

七個很酷的GenAI & LLM技術性面試問題

Jun 07, 2024 am 10:06 AM

七個很酷的GenAI & LLM技術性面試問題

Jun 07, 2024 am 10:06 AM

想了解更多AIGC的內容,請造訪:51CTOAI.x社群https://www.51cto.com/aigc/譯者|晶顏審校|重樓不同於網路上隨處可見的傳統問題庫,這些問題需要跳脫常規思維。大語言模型(LLM)在數據科學、生成式人工智慧(GenAI)和人工智慧領域越來越重要。這些複雜的演算法提升了人類的技能,並在許多產業中推動了效率和創新性的提升,成為企業保持競爭力的關鍵。 LLM的應用範圍非常廣泛,它可以用於自然語言處理、文字生成、語音辨識和推薦系統等領域。透過學習大量的數據,LLM能夠產生文本

你所不知道的機器學習五大學派

Jun 05, 2024 pm 08:51 PM

你所不知道的機器學習五大學派

Jun 05, 2024 pm 08:51 PM

機器學習是人工智慧的重要分支,它賦予電腦從數據中學習的能力,並能夠在無需明確編程的情況下改進自身能力。機器學習在各個領域都有廣泛的應用,從影像辨識和自然語言處理到推薦系統和詐欺偵測,它正在改變我們的生活方式。機器學習領域存在著多種不同的方法和理論,其中最具影響力的五種方法被稱為「機器學習五大派」。這五大派分別為符號派、聯結派、進化派、貝葉斯派和類推學派。 1.符號學派符號學(Symbolism),又稱符號主義,強調利用符號進行邏輯推理和表達知識。該學派認為學習是一種逆向演繹的過程,透過現有的

為大模型提供全新科學複雜問答基準與評估體系,UNSW、阿貢、芝加哥大學等多家機構共同推出SciQAG框架

Jul 25, 2024 am 06:42 AM

為大模型提供全新科學複雜問答基準與評估體系,UNSW、阿貢、芝加哥大學等多家機構共同推出SciQAG框架

Jul 25, 2024 am 06:42 AM

編輯|ScienceAI問答(QA)資料集在推動自然語言處理(NLP)研究中發揮著至關重要的作用。高品質QA資料集不僅可以用於微調模型,也可以有效評估大語言模型(LLM)的能力,尤其是針對科學知識的理解和推理能力。儘管目前已有許多科學QA數據集,涵蓋了醫學、化學、生物等領域,但這些數據集仍有一些不足之處。其一,資料形式較為單一,大多數為多項選擇題(multiple-choicequestions),它們易於進行評估,但限制了模型的答案選擇範圍,無法充分測試模型的科學問題解答能力。相比之下,開放式問答

在OpenHarmony本地部署大語言模型

Jun 07, 2024 am 10:02 AM

在OpenHarmony本地部署大語言模型

Jun 07, 2024 am 10:02 AM

本文將第二屆OpenHarmony技術大會上展示的《在OpenHarmony本地部署大語言模型》成果開源,開源位址:https://gitee.com/openharmony-sig/tpc_c_cplusplus/blob/master/thirdparty/InferLLM/docs/ hap_integrate.md。實作思路與步驟移植輕量級LLM模型推理架構InferLLM到OpenHarmony標準系統,編譯出能在OpenHarmony運作的二進位產物。 InferLLM是個簡單又有效率的L