清華最新! RoadBEV:BEV下的道路表面重建如何實現?

原題: RoadBEV: Road Surface Reconstruction in Bird's Eye View

論文リンク: https://arxiv.org/pdf/2404.06605.pdf

コードリンク: https ://github.com/ztsrxh/RoadBEV

著者の所属: 清華大学、カリフォルニア大学バークレー校

# 論文のアイデア:

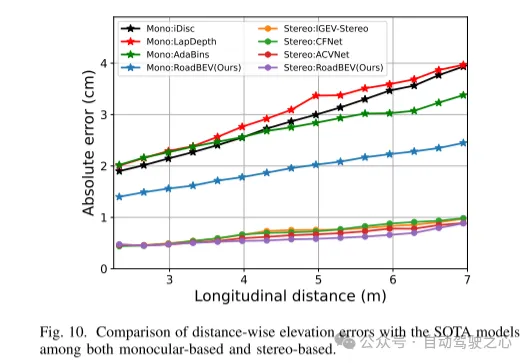

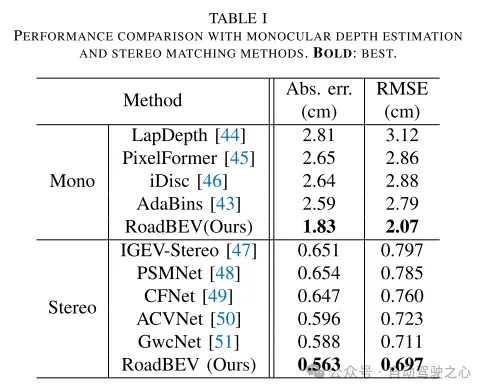

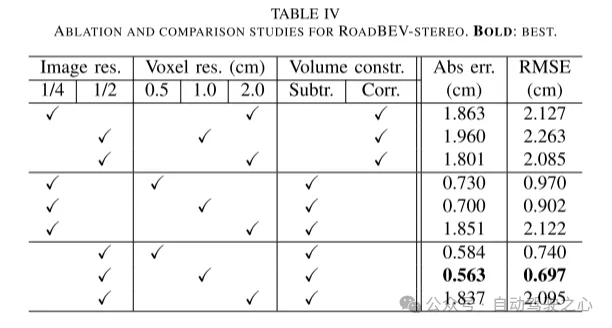

路面状況、特に幾何学的輪郭は自動運転車の運転能力に大きく影響します。ビジョンベースのオンライン道路再構築により、道路情報を事前に取得できることが期待されます。単眼奥行き推定や立体視推定などの既存のソリューションには限界があります。最近の鳥瞰図 (BEV) 認識技術は、より信頼性が高く正確な再構成を実現するための大きな動機となります。この論文は、それぞれRoadBEV-monoとRoadBEV-stereoと名付けられた2つの効果的なBEV道路標高再構成モデルを一律に提案するもので、道路標高推定に単眼画像や両眼画像を使用するのとは異なります。前者は 1 つの画像から直接道路の標高を推定しますが、後者は左右の体積ビューを使用して道路の標高を推定します。綿密な分析により、視点との一貫性と相違点が明らかになります。現実世界のデータセットでの実験により、モデルの有効性と優位性が実証されています。 RoadBEV-mono と RoadBEV-stereo の標高誤差はそれぞれ 1.83 メートルと 0.56 メートルです。単眼画像に基づく BEV 推定のパフォーマンスが 50% 向上しました。この記事のモデルは、ビジョンベースの自動運転技術において貴重な参考となることが期待されます。

主な貢献:

本論文は、路面再構築の必要性と優位性を理論面と実験面の両面から鳥瞰的に初めて実証したものである。

この記事では、RoadBEV-mono と RoadBEV-stereo という 2 つのモデルを紹介します。単眼ベースのスキームとステレオベースのスキームについては、この記事でそのメカニズムについて詳しく説明します。

この論文では、提案されたモデルのパフォーマンスを包括的にテストおよび分析し、将来の研究に貴重な洞察と展望を提供します。

ネットワーク設計:

近年、無人地上車両 (UGV) の急速な開発により、車載認識システムに対する要件がさらに高まっています。正確な動作計画と制御には、運転環境と状況をリアルタイムで理解することが不可欠です [1] ~ [3]。車両にとって、道路は物理世界との唯一の接触媒体です。路面状況は、多くの車両特性と操縦性を決定します [4]。図 1(a) に示すように、凹凸や窪みなどの道路の凹凸は、車両の乗り心地を悪化させますが、これは直感的に認識できます。リアルタイムの路面状況の認識、特に幾何学的な高さは、乗り心地の向上に大きく役立ちます [5]、[6]。

無人地上車両 (UGV) におけるセグメンテーションや検出などの他の認識タスクと比較して、路面再構築 (RSR) は最近注目を集めている新興テクノロジーです。既存の認識プロセスと同様に、RSR は通常、オンボード LiDAR とカメラ センサーを利用して路面情報を保持します。 LiDAR は道路等高線を直接スキャンし、点群を導き出します [7]、[8]。複雑なアルゴリズムを使用せずに、車両軌道上の道路の標高を直接抽出できます。ただし、LiDAR センサーはコストが高いため、経済的な量産車両への応用は制限されます。車両や歩行者などの大きな交通物体とは異なり、道路の凹凸は通常、規模が小さいため、点群の精度が重要です。リアルタイムの道路スキャンでは動き補償とフィルタリングが必要であり、さらにセンチメートルレベルでの高精度の測位が必要です。

画像ベースの路面再構成 (RSR) は、3 次元視覚タスクとして、精度と解像度の点で LiDAR よりも有望です。また、路面のテクスチャも保持し、道路の認識をより包括的にします。視覚ベースの道路標高の再構築は、実際には深度推定の問題です。単眼カメラの場合、単一の画像に基づいて単眼奥行き推定を実装することも、奥行きを直接推定するシーケンスに基づいて多視点ステレオ (MVS) を実装することもできます [9]。双眼カメラの場合、両眼マッチングにより視差マップが回帰され、視差マップは深度に変換できます [10]、[11]。カメラ パラメーターが与えられると、カメラ座標系の道路点群を復元できます。事前の後処理プロセスを経て、最終的に道路構造と標高情報が取得されます。グラウンドトゥルース (GT) ラベルの指導のもと、高精度で信頼性の高い RSR を実現できます。

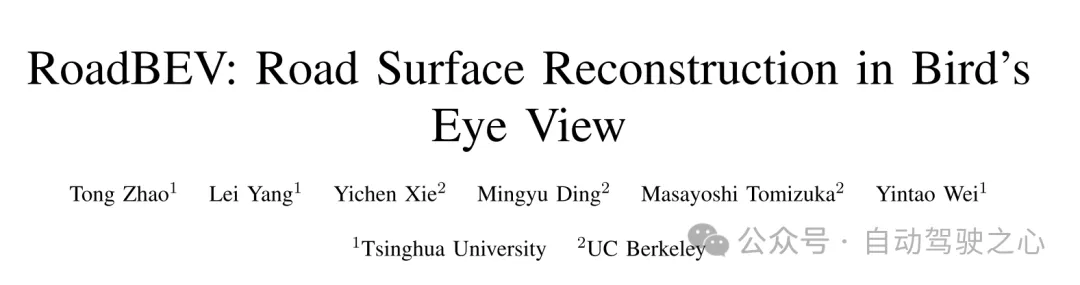

然而,影像視角下的道路表面重建(RSR)存在著固有的缺點。對於特定像素的深度估計實際上是沿著垂直於影像平面方向尋找最優箱體(optimal bins)(如圖1(b)中的橘色點所示)。深度方向與道路表面有一定的角度偏差。道路輪廓特徵的變化和趨勢與搜尋方向上的變化和趨勢不一致。在深度視圖中關於道路高程變化的資訊線索是稀疏的。此外,每個像素的深度搜尋範圍是相同的,導致模型捕捉到的是全域幾何層次結構而不是局部表面結構。由於全局但粗糙的深度搜索,精細的道路高程資訊被破壞。由於本文關注的是垂直方向上的高程,因此在深度方向上所做的努力被浪費了。在透視視圖中,遠距離的紋理細節遺失,這進一步為有效的深度回歸帶來了挑戰,除非進一步引入先驗約束[12]。

從俯視圖(即鳥瞰圖,BEV)估計道路高程是一個自然的想法,因為高程本質上描述了垂直方向的振動。鳥瞰圖是一種有效的範式,用於以統一座標表示多模態和多視圖資料[13],[14]。最近在三維目標檢測和分割任務上取得的 SOTA 性能是透過基於鳥瞰圖的方法實現的[15],這與透視視圖不同,後者透過在視圖轉換的影像特徵上引入估計頭部來進行。圖1展示了本文的動機。與在影像視圖中關注全局結構不同,鳥瞰圖中的重建直接在垂直方向上的一個特定小範圍內識別道路特徵。在鳥瞰圖中投影的道路特徵密集地反映了結構和輪廓變化,有助於進行有效和精細化的搜尋。透視效應的影響也被抑制,因為道路在垂直於觀察角度的平面上被統一表示。基於鳥瞰圖特徵的道路重建有望實現更高的性能。

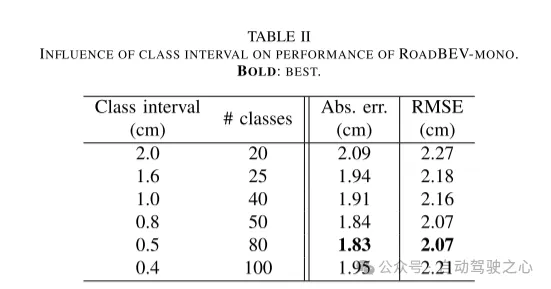

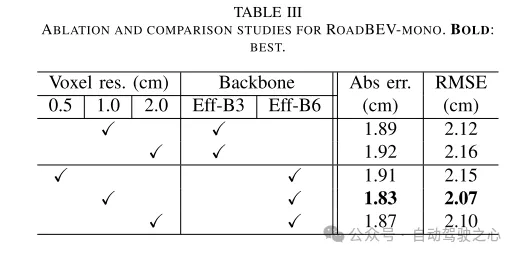

本文重建了BEV下的道路表面,以解決上述識別出的問題。特別地,本文關注道路幾何,即高程(elevation)。為了利用單眼和雙眼影像,並展示鳥瞰圖感知的廣泛可行性,本文提出了兩個子模型,分別命名為RoadBEV-mono和RoadBEV-stereo。遵循鳥瞰圖的範例,本文定義了覆蓋潛在道路起伏的興趣體素。這些體素透過3D-2D投影查詢像素特徵。對於RoadBEV-mono,本文在重塑的體素特徵上引入了高程估計頭。 RoadBEV-stereo的結構與影像視圖中的雙眼匹配保持一致。基於左右體素特徵,在鳥瞰圖中建構了一個4D代價體積,該體積透過3D卷積進行聚合。高程迴歸被視為對預定義箱體的分類,以實現更有效率的模型學習。本文在本文作者先前發布的真實世界資料集上驗證了這些模型,顯示出它們比傳統的單目深度估計和雙眼匹配方法有著巨大的優勢。

圖1. 本文的動機。 (a)無論是單目或雙目配置,本文在鳥瞰圖(BEV)中的重建方法都優於影像視圖中的方法。 (b)在影像視圖中進行深度估計時,搜尋方向與道路高程方向有偏差。在深度視圖中,道路輪廓特徵是稀疏的。坑洼不容易被識別。 (c)在鳥瞰圖中,能夠精確捕捉到輪廓振動,例如坑洞、路邊階梯甚至車轍。垂直方向上的道路高程特徵較為密集,也較容易辨識。

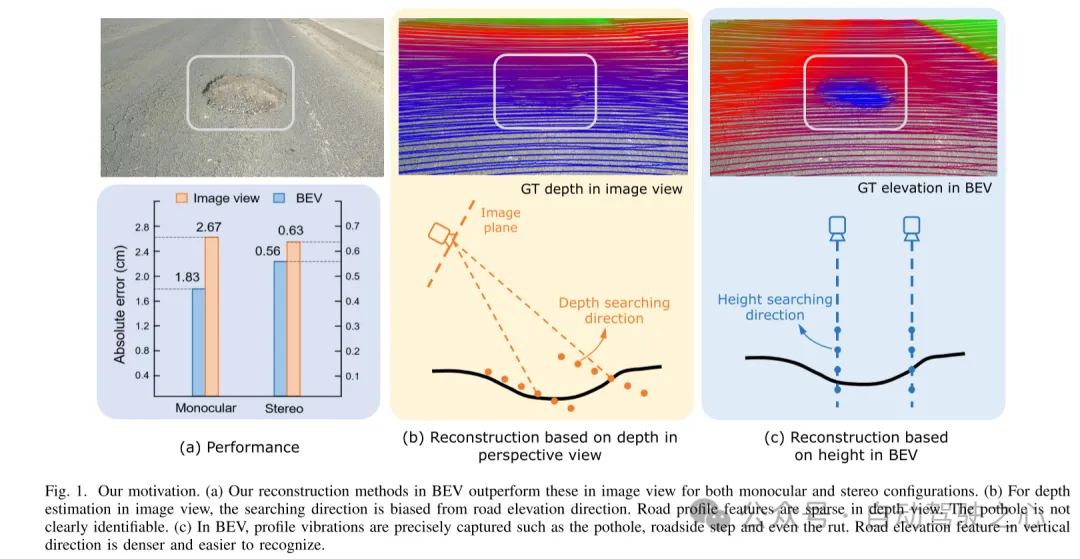

圖2. 座標示意與真值(GT)高程標籤的產生。 (a)座標(b)影像視圖中的興趣區域(ROI)(c)鳥瞰圖中的興趣區域(ROI)(d)在網格中產生真值(GT)標籤

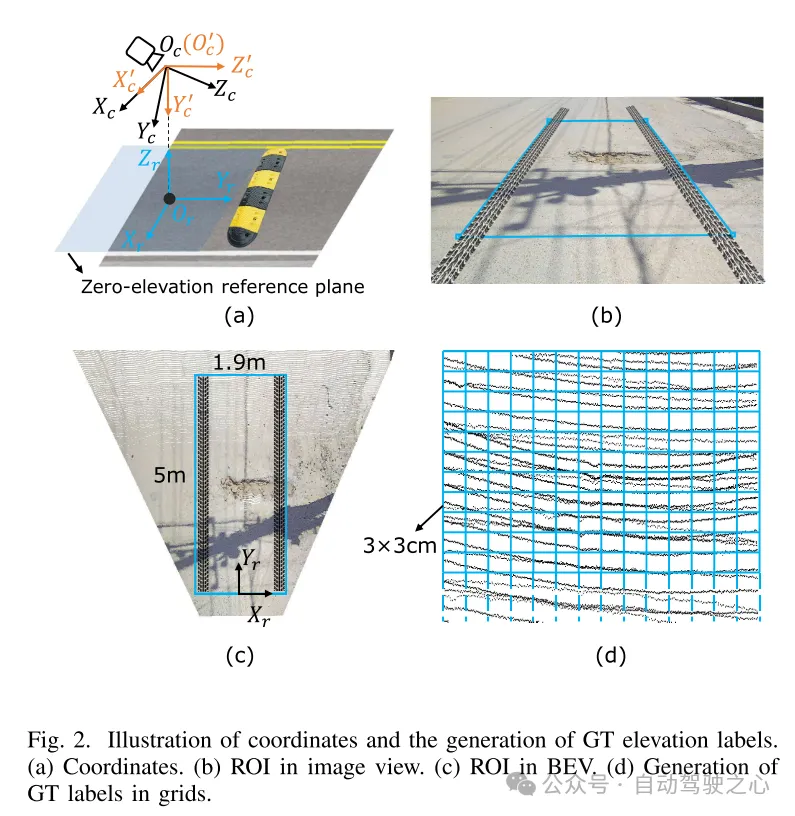

#圖3. 道路影像及真值(GT)高程圖的範例。

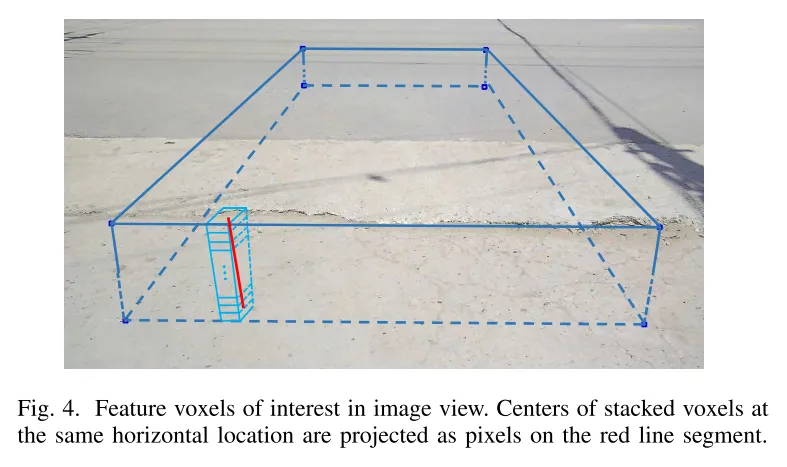

圖4. 影像檢視中感興趣的特徵體素。位於相同水平位置的堆疊體素的中心被投影到紅色線段上的像素點。

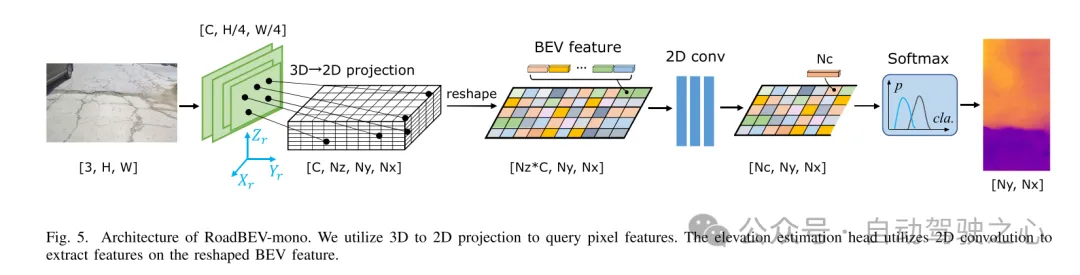

圖5. RoadBEV-mono的架構。本文利用3D到2D的投影來查詢像素特徵。高程估計頭部使用2D卷積在重塑後的鳥瞰圖(BEV)特徵上提取特徵。

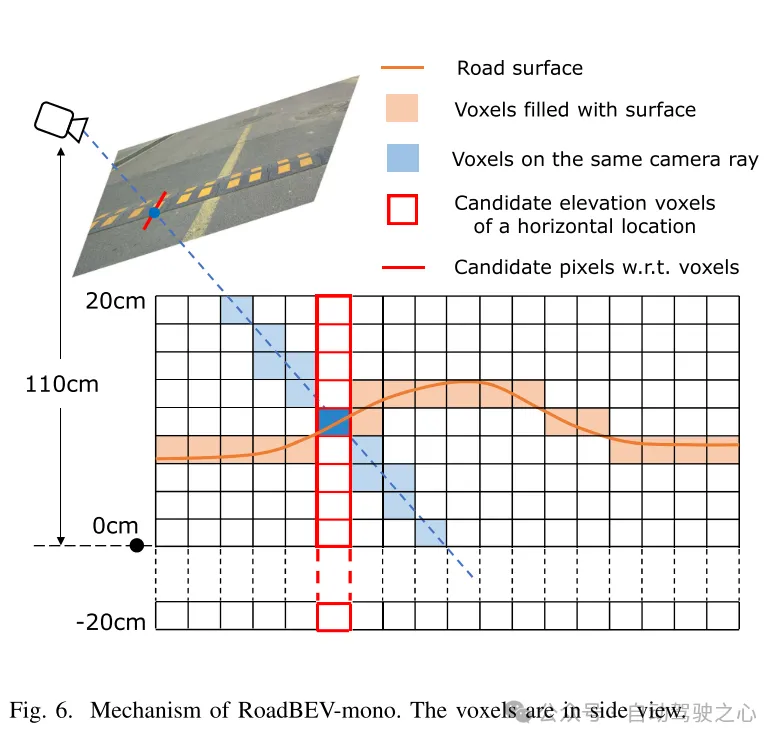

圖6. RoadBEV-mono的機制。體素以側視圖展示。

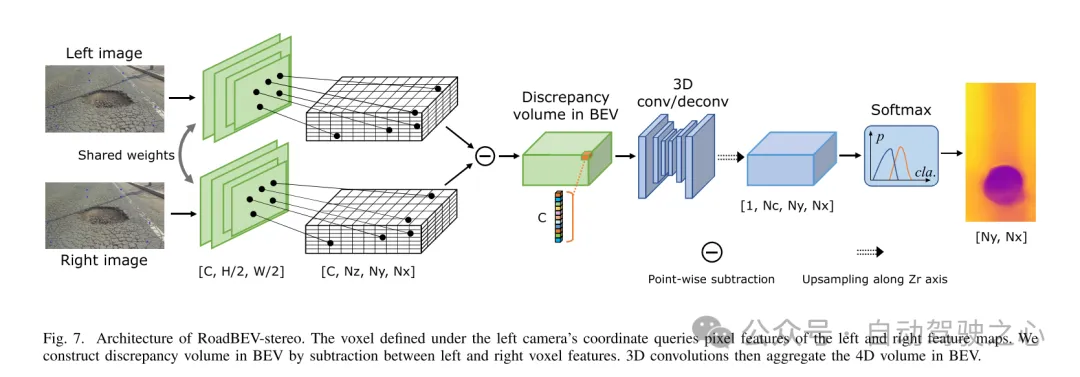

圖7. RoadBEV-stereo的架構。定義在左側相機座標系下的體素查詢左右特徵圖的像素特徵。本文透過左右體素特徵之間的相減,在鳥瞰圖(BEV)中建構差異體積。然後,3D卷積對鳥瞰圖中的4D體積進行聚合。

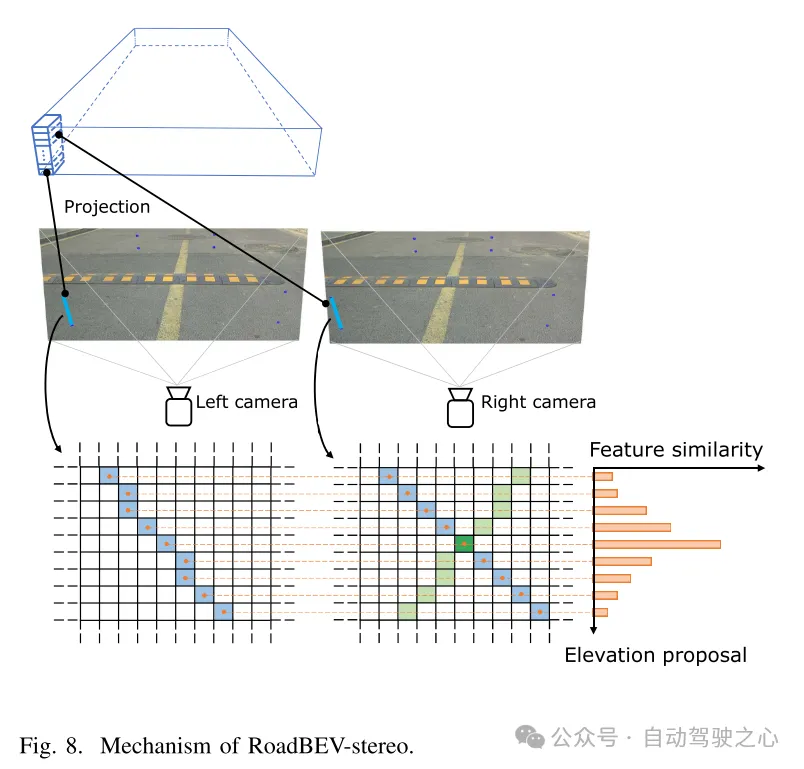

圖8. RoadBEV-stereo的機制。

實驗結果:

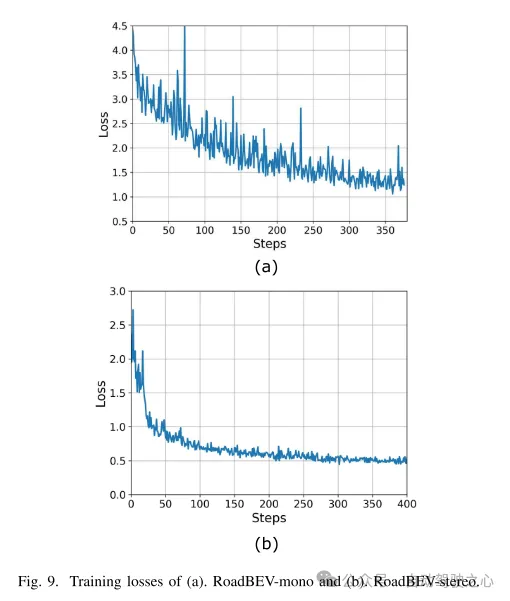

圖9. (a) RoadBEV-mono和 (b) RoadBEV-stereo的訓練損失。

圖10. 在單目與雙眼基礎上,與SOTA模型的距離方向上的高程誤差比較。

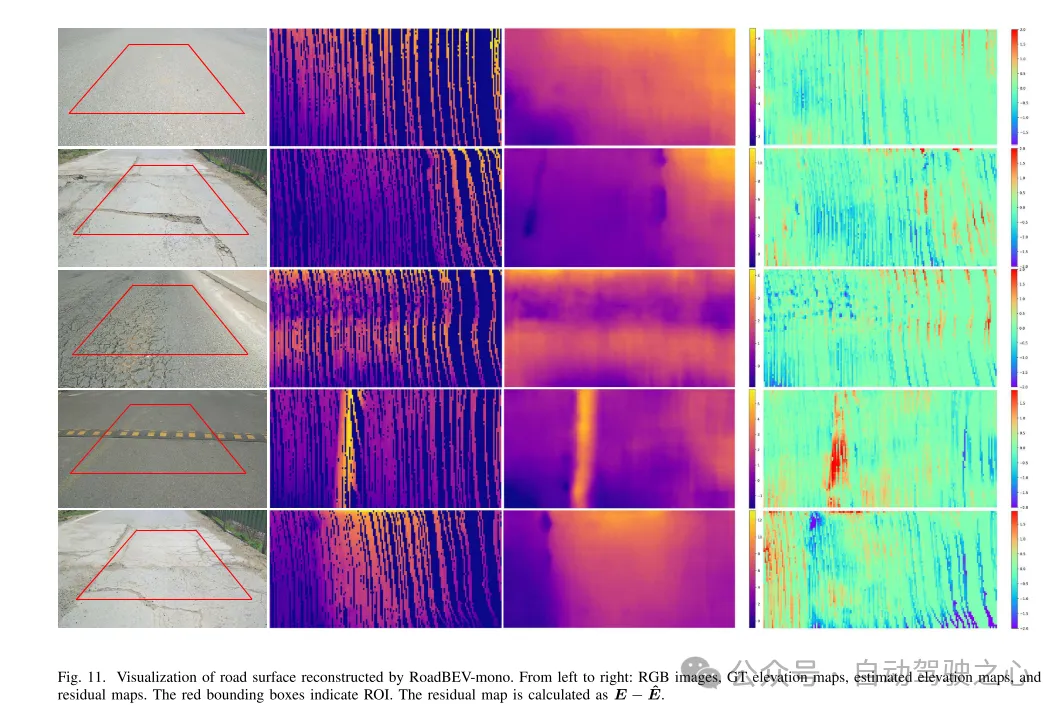

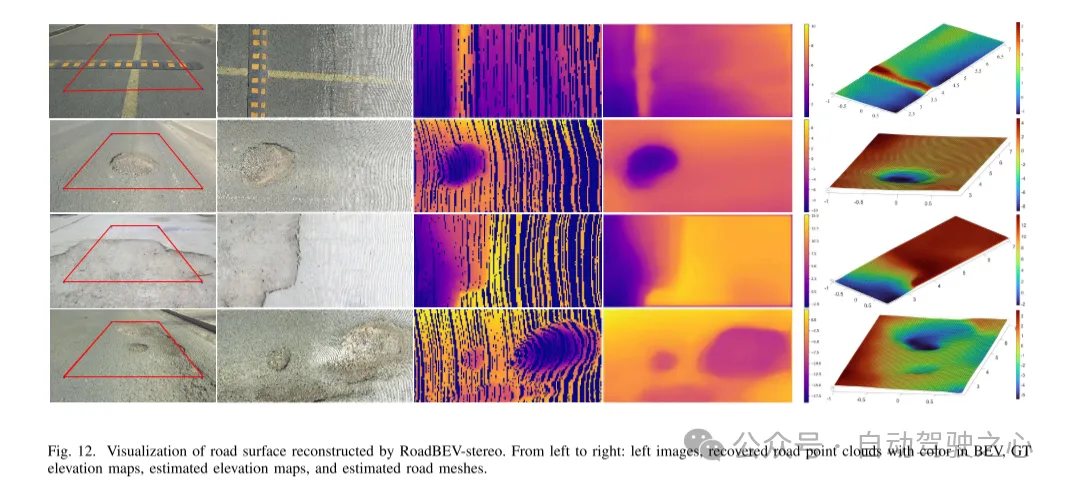

圖11. 由RoadBEV-mono重建的道路表面視覺化。

圖12. 由RoadBEV-stereo重建的道路表面視覺化。

總結:

本文首次在鳥瞰圖中重建了道路表面的高程。本文分別提出並分析了基於單眼和雙眼影像的兩種模型,分別命名為RoadBEV-mono和RoadBEV-stereo。本文發現,BEV中的單目估計和雙眼匹配與透視視圖中的機制相同,透過縮小搜尋範圍和直接在高程方向挖掘特徵而得到改善。在真實世界資料集上的全面實驗驗證了所提出的BEV體積、估計頭和參數設定的可行性和優越性。對於單眼相機,在BEV中的重建性能比透視視圖提高了50%。同時,在BEV中,使用雙眼相機的性能是單目的三倍。本文提供了關於模型的深入分析和指導。本文的開創性探索也為與BEV感知、3D重建和3D檢測相關的進一步研究和應用提供了寶貴的參考。

以上是清華最新! RoadBEV:BEV下的道路表面重建如何實現?的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

git怎麼下載項目到本地

Apr 17, 2025 pm 04:36 PM

git怎麼下載項目到本地

Apr 17, 2025 pm 04:36 PM

要通過 Git 下載項目到本地,請按以下步驟操作:安裝 Git。導航到項目目錄。使用以下命令克隆遠程存儲庫:git clone https://github.com/username/repository-name.git

git怎麼更新代碼

Apr 17, 2025 pm 04:45 PM

git怎麼更新代碼

Apr 17, 2025 pm 04:45 PM

更新 git 代碼的步驟:檢出代碼:git clone https://github.com/username/repo.git獲取最新更改:git fetch合併更改:git merge origin/master推送更改(可選):git push origin master

git怎麼刪除倉庫

Apr 17, 2025 pm 04:03 PM

git怎麼刪除倉庫

Apr 17, 2025 pm 04:03 PM

要刪除 Git 倉庫,請執行以下步驟:確認要刪除的倉庫。本地刪除倉庫:使用 rm -rf 命令刪除其文件夾。遠程刪除倉庫:導航到倉庫設置,找到“刪除倉庫”選項,確認操作。

git下載不動怎麼辦

Apr 17, 2025 pm 04:54 PM

git下載不動怎麼辦

Apr 17, 2025 pm 04:54 PM

解決 Git 下載速度慢時可採取以下步驟:檢查網絡連接,嘗試切換連接方式。優化 Git 配置:增加 POST 緩衝區大小(git config --global http.postBuffer 524288000)、降低低速限制(git config --global http.lowSpeedLimit 1000)。使用 Git 代理(如 git-proxy 或 git-lfs-proxy)。嘗試使用不同的 Git 客戶端(如 Sourcetree 或 Github Desktop)。檢查防火

如何解決PHP項目中的高效搜索問題? Typesense助你實現!

Apr 17, 2025 pm 08:15 PM

如何解決PHP項目中的高效搜索問題? Typesense助你實現!

Apr 17, 2025 pm 08:15 PM

在開發一個電商網站時,我遇到了一個棘手的問題:如何在大量商品數據中實現高效的搜索功能?傳統的數據庫搜索效率低下,用戶體驗不佳。經過一番研究,我發現了Typesense這個搜索引擎,並通過其官方PHP客戶端typesense/typesense-php解決了這個問題,大大提升了搜索性能。

git怎麼合併代碼

Apr 17, 2025 pm 04:39 PM

git怎麼合併代碼

Apr 17, 2025 pm 04:39 PM

Git 代碼合併過程:拉取最新更改以避免衝突。切換到要合併的分支。發起合併,指定要合併的分支。解決合併衝突(如有)。暫存和提交合併,提供提交消息。

git commit怎麼用

Apr 17, 2025 pm 03:57 PM

git commit怎麼用

Apr 17, 2025 pm 03:57 PM

Git Commit 是一種命令,將文件變更記錄到 Git 存儲庫中,以保存項目當前狀態的快照。使用方法如下:添加變更到暫存區域編寫簡潔且信息豐富的提交消息保存並退出提交消息以完成提交可選:為提交添加簽名使用 git log 查看提交內容

git怎麼更新本地代碼

Apr 17, 2025 pm 04:48 PM

git怎麼更新本地代碼

Apr 17, 2025 pm 04:48 PM

如何更新本地 Git 代碼?用 git fetch 從遠程倉庫拉取最新更改。用 git merge origin/<遠程分支名稱> 將遠程變更合併到本地分支。解決因合併產生的衝突。用 git commit -m "Merge branch <遠程分支名稱>" 提交合併更改,應用更新。