超越BEVFormer! CR3DT:RV融合輔助3D檢測&追蹤新SOTA(ETH)

写在前面&笔者的个人理解

本文介绍了一种用于3D目标检测和多目标跟踪的相机-毫米波雷达融合方法(CR3DT)。基于激光雷达的方法已经为这一领域奠定了一个高标准,但是它的高算力、高成本的缺陷制约了该方案在自动驾驶领域的发展;基于相机的3D目标检测和跟踪方案由于其成本较低,也吸引了许多学者的关注,但是由于其成果效果差。因此,将相机与毫米波雷达的融合正在成为一个很有前景的方案。作者在现有的相机框架BEVDet下,融合毫米波雷达的空间和速度信息,结合CC-3DT 跟踪头,显著提高了3D目标检测和跟踪的精度,中和了性能和成本之间的矛盾。

主要贡献

传感器融合架构 提出的CR3DT在BEV编码器的前后均使用中间融合技术来集成毫米波雷达数据;而在跟踪上,采用一种准密集外观嵌入头,使用毫米波雷达的速度估计来进行目标关联。

检测性能评估 CR3DT在nuScenes 3D检测验证集上实现了35.1%的mAP和45.6%的nuScenes检测分数(NDS)。利用雷达数据中包含的丰富的速度信息,与SOTA相机检测器相比,检测器的平均速度误差(mAVE)降低了45.3%。

跟踪性能评估 CR3DT在nuScenes跟踪验证集上的跟踪性能为38.1% AMOTA,与仅使用相机的SOTA跟踪模型相比,AMOTA提高了14.9%,跟踪器中速度信息的明确使用和进一步改进显著减少了约43%IDS的数量。

模型架构

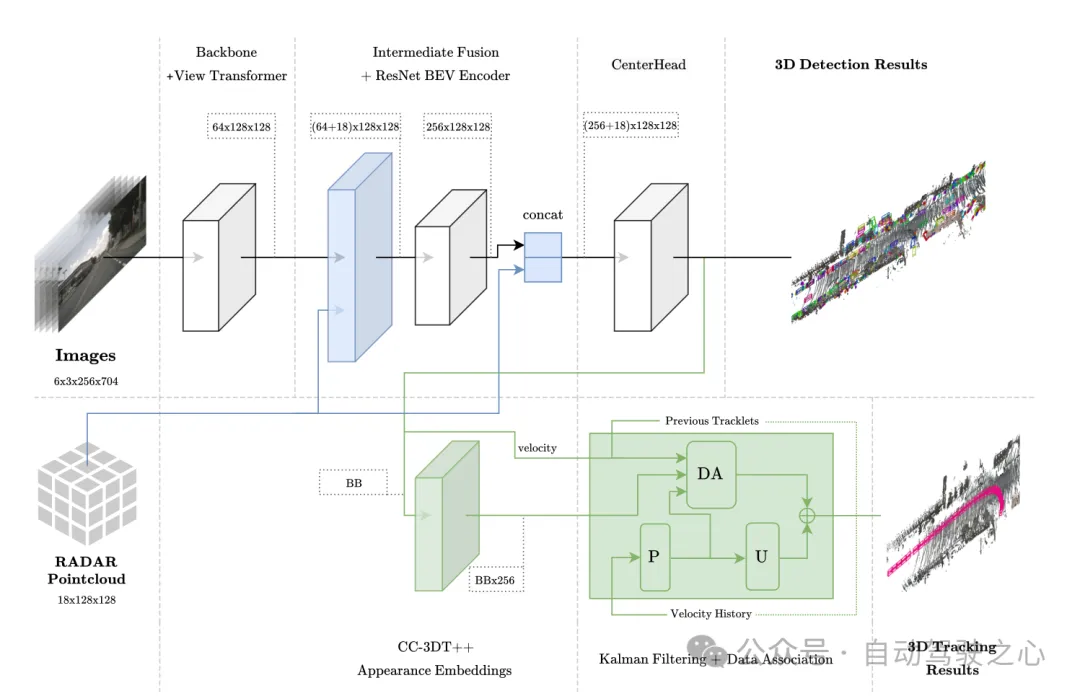

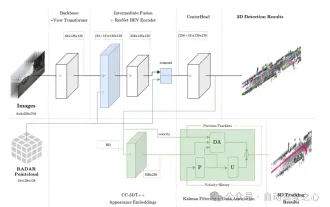

该方法基于EV-Det框架,融合RADAR的空间与速度信息,结合CC-3DT 跟踪头,该头在其数据关联中明确使用了改进的毫米波雷达增强检测器的速度估计,最终实现了3D目标检测和跟踪。

图1 整体架构。检测和跟踪分别以浅蓝色和绿色突出显示。

图1 整体架构。检测和跟踪分别以浅蓝色和绿色突出显示。

BEV 空间中的传感器融合

该模块采用类似 PointPillars 的融合方法,包括其中的聚合和连接。BEV 网格设置为 [-51.2, 51.2],分辨率为 0.8,从而得到一个(128×128)的特征网格。将图像特征直接投射到 BEV 空间中,每个网格单元的通道数是 64,继而得到图像 BEV 特征是(64×128×128);同样地,将 Radar 的 18 个维度信息都聚合到每个网格单元中,这其中包括了点的 x、y、z 坐标,并且不对 Radar 数据做任何增强。作者确认 Radar 点云已经包含比 LiDAR 点云更多的信息,因此得到了 Radar BEV 特征是(18×128×128)。最后将图像 BEV 特征(64×128×128)和 Radar BEV 特征(18×128×128)直接连接起来((64 18)×128×128),作为 BEV 特征编码层的输入。在后续的消融实验中发现,在维度为(256×128×128)的 BEV 特征编码层的输出中添加残差连接是有益的,从而得到了 CenterPoint 检测头的最终输入大小为((256 18)×128×128)。

图2 聚合到BEV空间进行融合操作的Radar点云可视化

跟踪模块架构

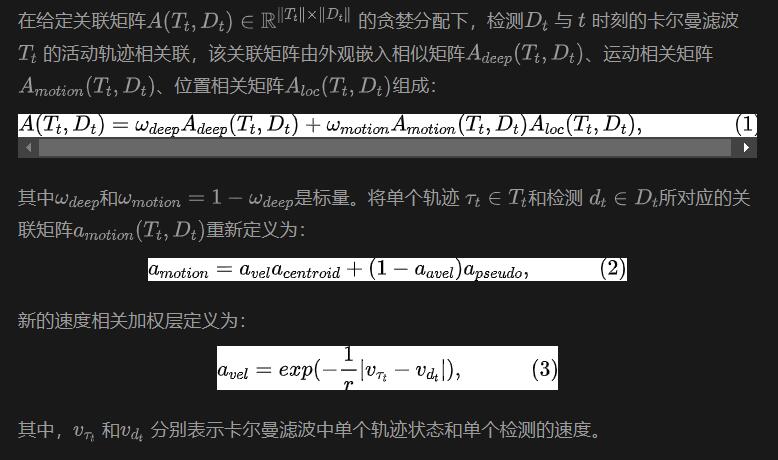

跟踪就是基于运动相关性和视觉特征相似性将两个不同帧的目标关联起来。在训练过程中,通过准密集多元正对比学习获得一维视觉特征嵌入向量,然后在CC-3DT的跟踪阶段同时使用检测和特征嵌入。对数据关联步骤(图1中DA模块)进行了修改,以利用改进的CR3DT位置检测和速度估计。具体如下:

实验及结果

基于nuScenes数据集完成,且所有训练均没有使用CBGS。

受限制模型

因为作者整个模型是在一台3090显卡的电脑上进行的,所以称之为受限制模型。该模型的目标检测部分以BEVDet为检测基线,图像编码的backbone是ResNet50,并且将图像的输入设置为(3×256×704),在模型中不使用过去或者未来的时间图像信息,batchsize设置为8。为了缓解Radar数据的稀疏性,使用了五次扫描以增强数据。在融合模型中也没有使用额外的时间信息。

对于目标检测,采用mAP、NDS、mAVE的分数来评估;对于跟踪,使用AMOTA、AMOTP、IDS来评估。

目标检测结果

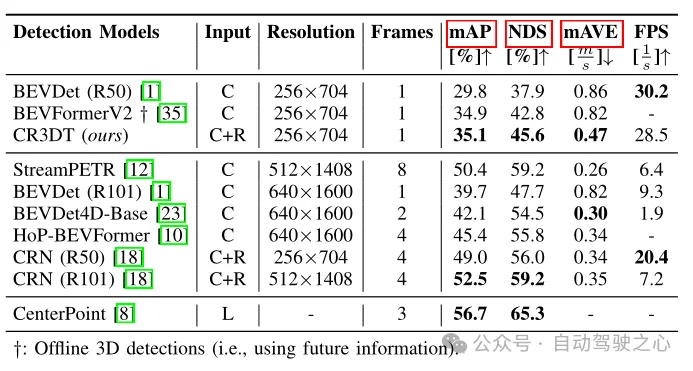

表1 在nuScenes验证集上的检测结果

表1显示了CR3DT与仅使用相机的基线BEVDet (R50)架构相比的检测性能。很明显,Radar的加入显著提高了检测性能。在小分辨率和时间帧的限制下,与仅使用相机的BEVDet相比,CR3DT成功地实现了5.3%的mAP和7.7%的NDS的改进。但是由于算力的限制,论文中并没有实现高分辨率、合并时间信息等的实验结果。此外在表1中最后一列还给出了推理时间。

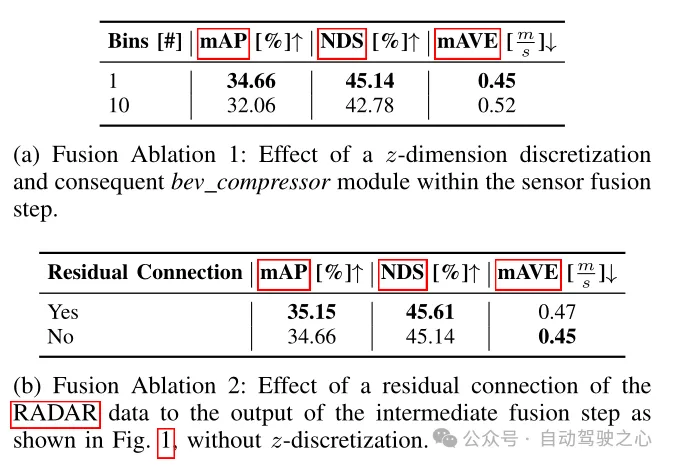

表2 检测框架的消融实验

在表2中比较了不同的融合架构对于检测指标的影响。这里的融合方法分为两种:第一种是论文中提到的,放弃了z维的体素化和随后的3D卷积,直接将提升的图像特征和纯RADAR数据聚合成柱,从而得到已知的特征尺寸为((64 18)×128×128);另一种是将提升的图像特征和纯RADAR数据体素化为尺寸为0.8×0.8×0.8 m的立方体,从而得到替代特征尺寸为((64 18)×10×128×128),因此需要以3D卷积的形式使用BEV压缩器模块。由表2(a)中可以看到,BEV压缩器数量的增加会导致性能下降,由此可以看到第一种方案表现得更为优越。而从表2(b)中也可以看到,加入了Radar数据的残差块同样能够提升性能,也印证了前面模型架构中提到的,在BEV特征编码层的输出中添加残量连接是有益的。

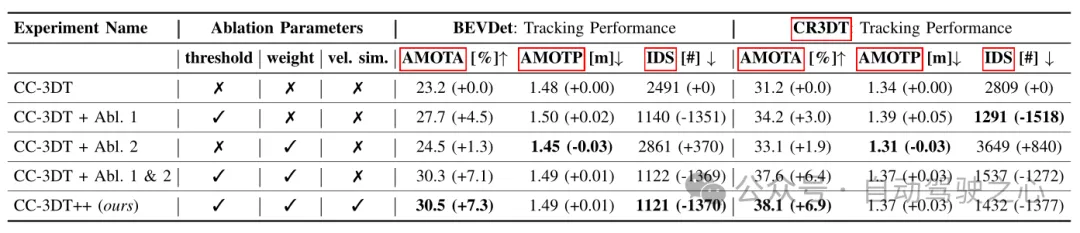

表3 基于基线BEVDet和CR3DT的不同配置在nuScenes验证集上的跟踪结果

表3 基于基线BEVDet和CR3DT的不同配置在nuScenes验证集上的跟踪结果

表3给出了改进的CC3DT 跟踪模型在nuScenes验证集上的跟踪结果,给出了跟踪器在基线和在CR3DT检测模型上的性能。CR3DT模型使AMOTA的性能在基线上提高了14.9%,而在AMOTP中降低了0.11 m。此外,与基线相比,可以看到IDS降低了约43%。

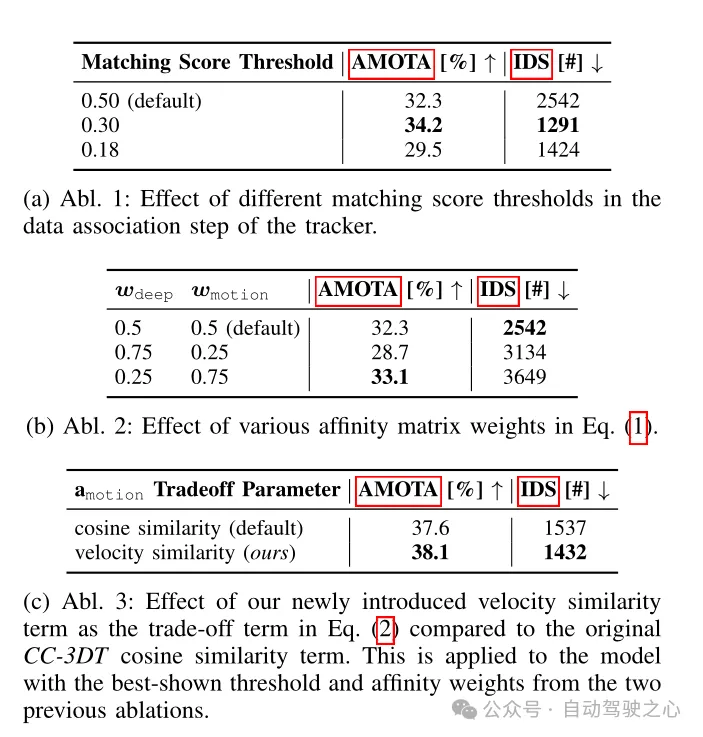

表4 在CR3DT检测骨干上进行了跟踪架构消融实验

结论

这项工作提出了一种高效的相机-雷达融合模型——CR3DT,专门用于3D目标检测和多目标跟踪。通过将Radar数据融合到只有相机的BEVDet架构中,并引入CC-3DT 跟踪架构,CR3DT在3D目标检测和跟踪精度方面都有了大幅提高,mAP和AMOTA分别提高了5.35%和14.9%。

相机和毫米波雷达融合的方案,相较于纯LiDAR或者是LiDAR和相机融合的方案,具有低成本的优势,贴近当前自动驾驶汽车的发展。另外毫米波雷达还有在恶劣天气下鲁棒的优势,能够面对多种多样的应用场景,当前比较大的问题就是毫米波雷达点云的稀疏性以及无法检测高度信息。但是随着4D毫米波雷达的不断发展,相信未来相机和毫米波雷达融合的方案会更上一层楼,取得更为优异的成果!

以上是超越BEVFormer! CR3DT:RV融合輔助3D檢測&追蹤新SOTA(ETH)的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

熱門話題

輕鬆拿捏 4K 高畫質影像理解!這個多模態大模型自動分析網頁海報內容,打工人簡直不要太方便

Apr 23, 2024 am 08:04 AM

輕鬆拿捏 4K 高畫質影像理解!這個多模態大模型自動分析網頁海報內容,打工人簡直不要太方便

Apr 23, 2024 am 08:04 AM

一個可以自動分析PDF、網頁、海報、Excel圖表內容的大模型,對於打工人來說簡直不要太方便。上海AILab,香港中文大學等研究機構提出的InternLM-XComposer2-4KHD(簡寫為IXC2-4KHD)模型讓這一切成為了現實。相較於其他多模態大模型不超過1500x1500的分辨率限制,該工作將多模態大模型的最大輸入影像提升到超過4K(3840x1600)分辨率,並支援任意長寬比和336像素~4K動態解析度變化。發布三天,模型就登頂HuggingFace視覺問答模型熱度排行榜第一。輕鬆拿捏

CVPR 2024 | 面向真實感場景產生的光達擴散模型

Apr 24, 2024 pm 04:28 PM

CVPR 2024 | 面向真實感場景產生的光達擴散模型

Apr 24, 2024 pm 04:28 PM

原標題:TowardsRealisticSceneGenerationwithLiDARDiffusionModels論文連結:https://hancyran.github.io/assets/paper/lidar_diffusion.pdf程式碼連結:https://lidar-diffusion.github.io作者單位:CMU豐田研究院南思路加州大學論文:擴散模型(DMs)在逼真的圖像合成方面表現出色,但將其適配到雷射雷達場景生成中存在著重大挑戰。這主要是因為在點空間運作的DMs很難

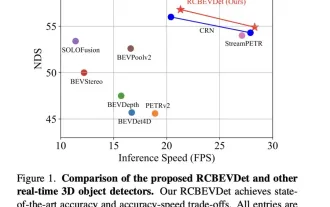

RV融合性能拉爆! RCBEVDet:Radar也有春天,最新SOTA!

Apr 02, 2024 am 11:49 AM

RV融合性能拉爆! RCBEVDet:Radar也有春天,最新SOTA!

Apr 02, 2024 am 11:49 AM

寫在前面&筆者的個人理解這篇討論文關注的主要問題是3D目標檢測技術在自動駕駛進程中的應用。儘管環境視覺相機技術的發展為3D目標檢測提供了高分辨率的語義訊息,但這種方法因無法精確捕獲深度資訊和在惡劣天氣或低光照條件下的表現不佳等問題而受限。針對這一問題,討論提出了一種結合環視相機和經濟型毫米波雷達感測器的多模式3D目標檢測新方法—RCBEVDet。該方法透過綜合使用多感測器的信息,提供了更豐富的語義資訊以及在惡劣天氣或低光照條件下的表現不佳等問題的解決方案。針對這一問題,討論提出了一種結合環視相機

LiDAR模擬新想法 | LidarDM:協助4D世界生成,模擬殺器~

Apr 12, 2024 am 11:46 AM

LiDAR模擬新想法 | LidarDM:協助4D世界生成,模擬殺器~

Apr 12, 2024 am 11:46 AM

原文標題:LidarDM:GenerativeLiDARSimulationinaGeneratedWorld論文連結:https://arxiv.org/pdf/2404.02903.pdf程式碼連結:https://github.com/vzyrianov/lidardm作者單位:伊利諾大學麻省理工學院論文想法:本文介紹了LidarDM,這是一種新穎的光達生成模型,能夠產生逼真、佈局感知、物理可信以及時間上連貫的光達視頻。 LidarDM在雷射雷達生成建模方面具有兩個前所未有的能力:(一

超越BEVFormer! CR3DT:RV融合輔助3D檢測&追蹤新SOTA(ETH)

Apr 24, 2024 pm 06:07 PM

超越BEVFormer! CR3DT:RV融合輔助3D檢測&追蹤新SOTA(ETH)

Apr 24, 2024 pm 06:07 PM

写在前面&笔者的个人理解本文介绍了一种用于3D目标检测和多目标跟踪的相机-毫米波雷达融合方法(CR3DT)。基于激光雷达的方法已经为这一领域奠定了一个高标准,但是它的高算力、高成本的缺陷制约了该方案在自动驾驶领域的发展;基于相机的3D目标检测和跟踪方案由于其成本较低,也吸引了许多学者的关注,但是由于其成果效果差。因此,将相机与毫米波雷达的融合正在成为一个很有前景的方案。作者在现有的相机框架BEVDet下,融合毫米波雷达的空间和速度信息,结合CC-3DT++跟踪头,显著提高了3D目标检测和跟踪的精

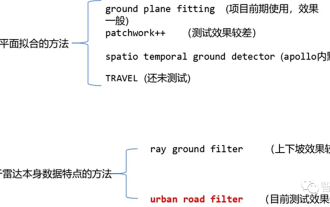

「深度解析」:探究自動駕駛中的光達點雲分割演算法

Apr 23, 2023 pm 04:46 PM

「深度解析」:探究自動駕駛中的光達點雲分割演算法

Apr 23, 2023 pm 04:46 PM

目前常見的雷射點雲分割演算法有基於平面擬合的方法和基於雷射點雲資料特徵的方法兩類。具體如下:點雲地面分割演算法01基於平面擬合的方法-GroundPlaneFitting演算法想法:一個簡單的處理方法就是沿著x方向(車頭的方向)將空間分割成若干個子平面,然後對每個子麵使用地面平面擬合演算法(GPF)從而得到能夠處理陡坡的地面分割方法。此方法是在單幀點雲中擬合全域平面,在點雲數量較多時效果較好,點雲稀疏時極易帶來漏檢和誤檢,例如16線雷射雷達。演算法偽代碼:偽代碼演算法流程是對於給定的點雲P,分割的最終結果

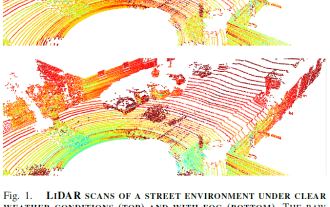

惡劣天氣條件下光達感知技術方案

May 10, 2023 pm 04:07 PM

惡劣天氣條件下光達感知技術方案

May 10, 2023 pm 04:07 PM

01摘要自動駕駛汽車依靠各種感測器來收集周圍環境的資訊。車輛的行為是根據環境感知進行規劃的,因此出於安全考慮,其可靠性至關重要。主動光達感測器能夠創建場景的精確3D表示,使其成為自動駕駛汽車環境感知的寶貴補充。由於光散射和遮擋,雷射雷達的性能在霧、雪或雨等惡劣天氣條件下會發生變化。這種限制最近促進了大量關於緩解感知性能下降的方法的研究。本文收集、分析並討論了基於雷射雷達的環境感知中應對不利天氣條件的不同方面。並討論了適當數據的可用性、原始點雲處理和去噪、穩健感知演算法和感測器融合等主題,以緩解

Java實現的雷達訊號處理技術介紹

Jun 18, 2023 am 10:15 AM

Java實現的雷達訊號處理技術介紹

Jun 18, 2023 am 10:15 AM

導讀:隨著現代科技的不斷發展,雷達訊號處理技術日益廣泛的應用。 Java作為目前最受歡迎的程式語言之一,被廣泛用於雷達訊號處理演算法的實現,本文就介紹一下Java實現的雷達訊號處理技術。一、雷達訊號處理技術簡介雷達訊號處理技術可說是雷達系統發展的核心與靈魂,是實現雷達系統自動化、數位化的關鍵技術。雷達訊號處理技術包含波形處理、濾波處理、脈衝壓縮、自適應波束形