LidaRF:研究用於街景神經輻射場的光達資料(CVPR\'24)

光真實感模擬在自動駕駛等應用中發揮關鍵作用,其中神經網路輻射場(NeRFs)的進步可能透過自動創建數位3D資產來實現更好的可擴展性。然而,由於街道上相機運動的高度共線性和在高速下的稀疏採樣,街景的重建品質受到影響。另一方面,該應用通常需要從偏離輸入視角的相機視角進行渲染,以準確模擬如變換車道等行為。 LidaRF提出了幾個見解,允許更好地利用光達數據來改善街景中NeRF的品質。首先,框架從雷射雷達資料中學習幾何場景表示,這些表示與基於隱式網格的解碼器相結合,從而提供了由顯示點雲提供的更強的幾何資訊。其次,提出了一種穩健的遮蔽感知深度監督訓練策略,允許透過累積使用密集雷射雷達點雲的強勢資訊來改善街景中的NeRF重建品質。第三,根據雷射雷達點的強度產生增強的訓練視角,以進一步改進在真實駕駛場景下的新視角合成中獲得的顯著改進。 這樣,透過框架從雷射雷達數據中學習到的更準確的幾何場景表示,可以一步改進方法並在真實駕駛場景下獲得更好的顯著改進。

LidaRF的貢獻主要體現在三個方面:

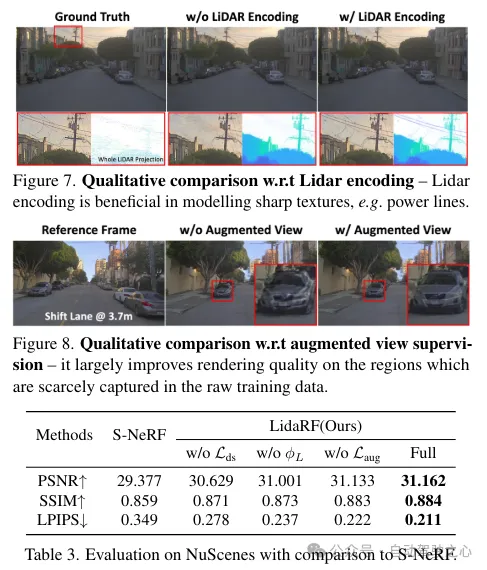

(i)混合雷射雷達編碼和網格特徵以增強場景表示。雖然光達已被用作自然的深度監控來源,但將雷射雷達納入NeRF輸入中,為幾何歸納提供了巨大的潛力,但實現起來並不簡單。為此,借用了基於網格的表示法,但將從點雲中學習的特徵整合到網格中,以繼承顯式點雲表示法的優勢。透過3D感知框架成功的啟動,利用3D稀疏療卷積網路作為有效且高效的結構,從雷射雷達點雲的局部和全局上下文中提取幾何特徵。

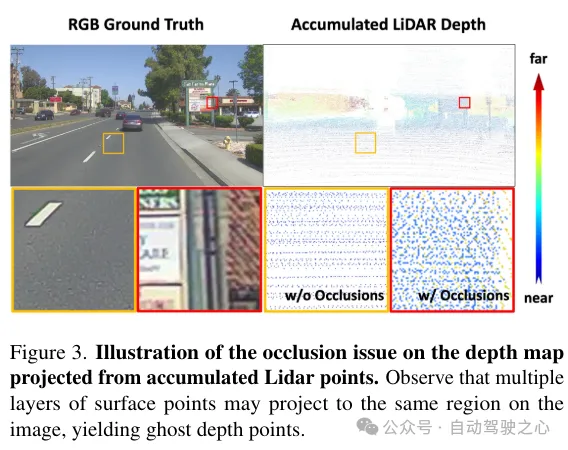

(ii)魯棒的遮蔽感知深度監督。與現有工作類似,這裡也使用光達作為深度監督的來源,但更深入。由於光達點的稀疏性限制了其有效性,尤其是在低紋理區域,透過跨鄰近幀集化光達點來產生更密集的深度圖。然而,這樣獲得的深度圖沒有考慮到遮擋,產生了錯誤的深度監督。因此,提出了一種健壯的深度監督方案,借用class學習的方式-從近場到遠場逐步監督深度,並在NeRF訓練過程中逐漸濾除錯誤的深度,從而更有效地從雷射雷達中學習深度。

(iii)基於光達的視野增強。此外,鑑於駕駛場景中的視圖稀疏性和覆蓋範圍有限,利用光達來密集化訓練視圖。也就是說,將累積的光達點投影到新的訓練視圖中;請注意,這些視圖可能與駕駛軌跡有一定的偏離。這些從雷射雷達投影的視圖被添加到訓練資料集中,它們並沒有考慮到遮蔽問題。然而,我們應用了前面提到的監督方案來解決遮蔽問題,從而提高了效能。雖然我們的方法也適用於一般場景,但在這項工作中更專注於街道場景的評估,並與現有技術相比,無論是定量還是定性,都取得了顯著的改進。

LidaRF在需要更大程度偏離輸入視圖的有趣應用中也顯示出優勢,在具有挑戰性的街道場景應用中顯著提高了NeRF的品質。

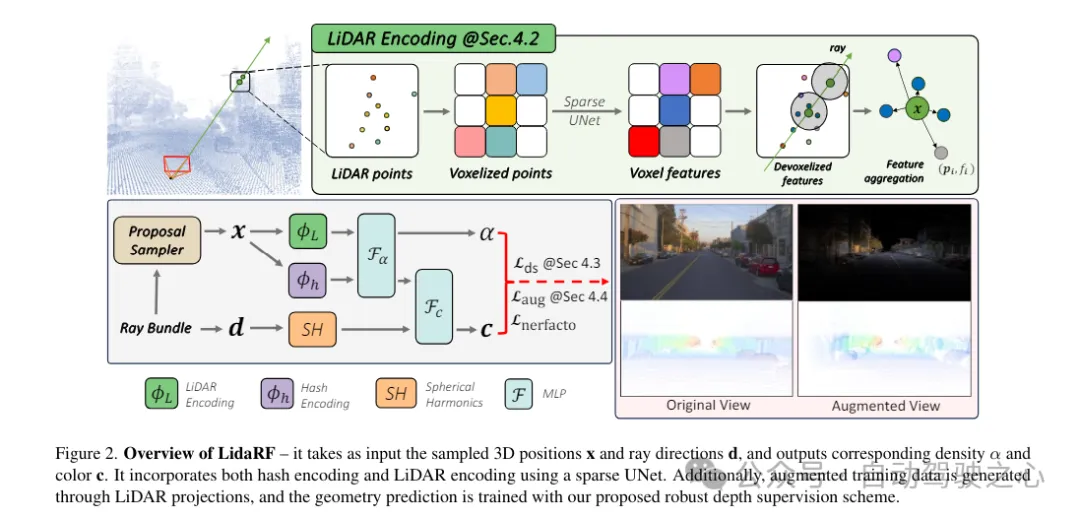

LidaRF整體框架一覽#

##LidaRF是一種用於輸入和輸出對應的密度和顏色的方法,它採用了UNet融合了哈夫編碼和激光雷達編碼。此外,透過光達投影產生強化訓練數據,使用提出的健壯深度監督方案訓練幾何預測。

1)雷射雷達編碼的混合表示法

雷射雷達點雲具有強大的幾何指導潛力,這對NeRF (神經渲染場)來說極具價值。然而,僅依賴光達特徵來進行場景表示,由於光達點的稀疏性(儘管有時間累積),會導致低解析度的渲染。此外,由於光達的視野有限,例如它不能捕獲超過一定高度的建築物表面,因此在這些區域中會出現空白渲染。相較之下,本文的框架融合了雷射雷達特徵和高解析度的空間網格特徵,以利用兩者的優勢,並共同學習以實現高品質和完整的場景渲染。雷射雷達特徵提取。這裡詳細描述了每個雷射雷達點的幾何特徵提取過程,參考圖2,首先將整個序列的所有幀的雷射雷達點雲聚合起來,以建立更密集的點雲集合。然後將點雲體素化為體素網格,其中每個體素單元內的點的空間位置進行平均,為每個體素單元產生一個3維特徵。受到3D感知框架廣泛成功的啟發,在體素網格上使用3D稀疏UNet對場景幾何特徵進行編碼,這允許從場景幾何的全局上下文中學習。 3D稀疏UNet將體素網格及其3維特徵作為輸入,並輸出neural volumetric 特徵,每個被佔用的體素由n維特徵組成。

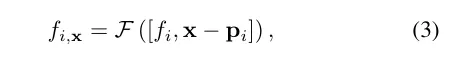

雷射雷達特徵查詢。對於沿著要渲染的射線上的每個樣本點x,如果在搜索半徑R內有至少K個附近的光達點,則查詢其光達特徵;否則,其光達特徵被設定為空(即全零)。具體來說,採用固定半徑最近鄰(FRNN)方法來搜尋與x相關的K個最近的雷射測距儀點索引集,記作。與[9]中在啟動訓練過程之前預先確定射線採樣點的方法不同,本文的方法在執行FRNN搜尋時是即時的,因為隨著NeRF訓練的收斂,來自region網路的樣本點分佈會動態地趨向於集中在表面。遵循Point-NeRF的方法,我們的方法利用一個多層感知機(MLP)F,將每個點的雷射雷達特徵映射到神經場景描述中。對於x的第i個鄰近點,F將光達特徵和相對位置作為輸入,並輸出神經場景描述為:

為了獲得取樣位置x處的最終雷射雷達編碼ϕ,使用標準的反距離權重法來聚合其K個鄰近點的神經場景描述

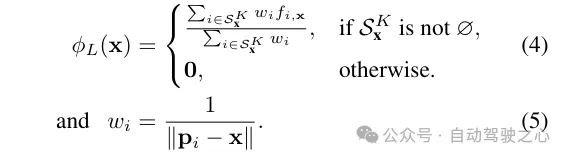

輻射解碼的特徵融合。將雷射雷達編碼ϕL與雜湊編碼ϕh進行拼接,並應用一個多層感知機Fα來預測每個樣本的密度α和密度嵌入h。最後,透過另一個多層感知機Fc,根據觀察方向d的球面諧波編碼SH和密度嵌入h來預測對應的顏色c。

2)魯棒深度監督

#除了特徵編碼外,還透過將光達點投影到影像平面上來從它們中獲取深度監督。然而,由於雷射雷達點的稀疏性,所得益處有限,不足以重建低紋理區域,如路面。在這裡,我們提出累積相鄰的雷射雷達幀以增加密度。儘管3D點能夠準確地捕捉場景結構,但在將它們投影到影像平面以進行深度監督時,需要考慮點之間的遮蔽。遮蔽是由於相機與雷射雷達及其相鄰幀之間的位移增加而產生的,從而產生虛假的深度監督,如圖3所示。由於即使累積後雷射雷達的稀疏性,處理這個問題也非常困難,使得諸如z緩衝之類的基本原理圖形技術無法應用。在這項工作中,提出了一種穩健的監督方案,以在訓練NeRF時自動過濾掉虛假的深度監督。

遮蔽感知的穩健監督方案。本文設計了一個class訓練策略,使得模型最初使用更近、更可靠的深度資料進行訓練,這些資料更不容易受到遮蔽的影響。隨著訓練的進行,模型逐漸開始融合更遠的深度資料。同時,模型也具備了丟棄與其預測相比異常遙遠的深度監督的能力。

回想一下,由於車載攝影機的向前移動,它產生的訓練影像是稀疏的,視野覆蓋有限,這給NeRF重建帶來了挑戰,尤其是當新視圖偏離車輛軌跡時。在這裡,我們提出利用光達來增強訓練資料。首先,我們透過將每個雷射雷達幀的點雲投影到其同步的攝影機上並為RGB值進行插值來為其上色。累積上色的點雲,並將其投影到一組合成增強的視圖上,產生如圖2所示的合成影像和深度圖。

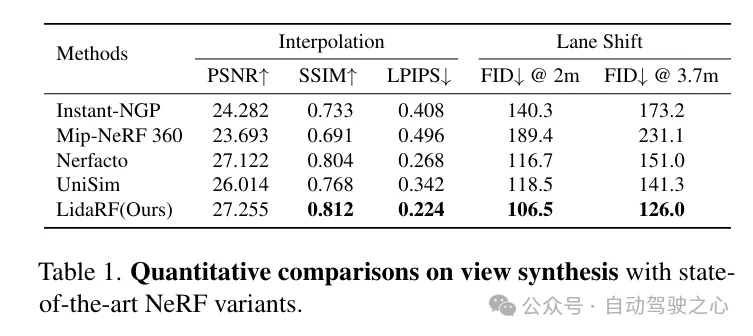

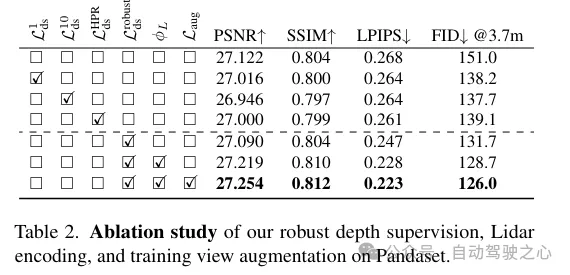

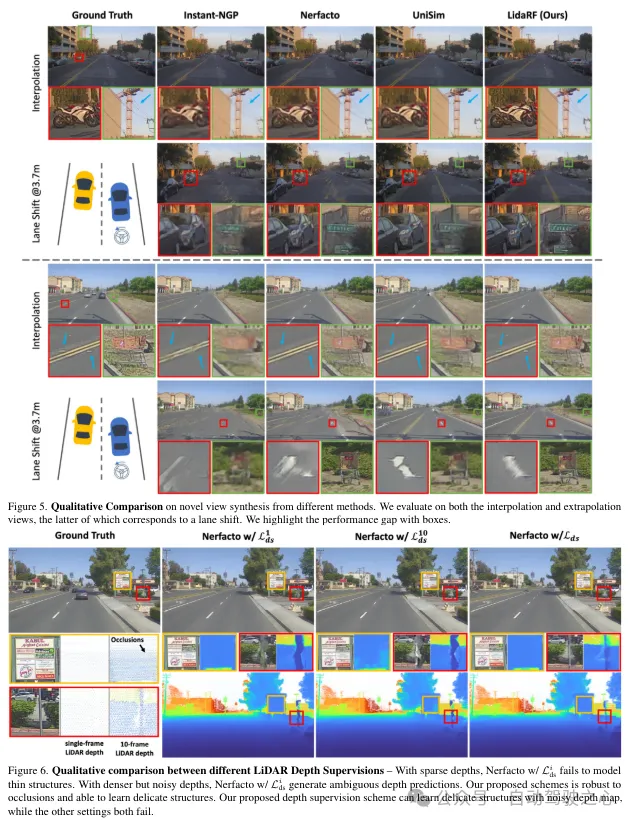

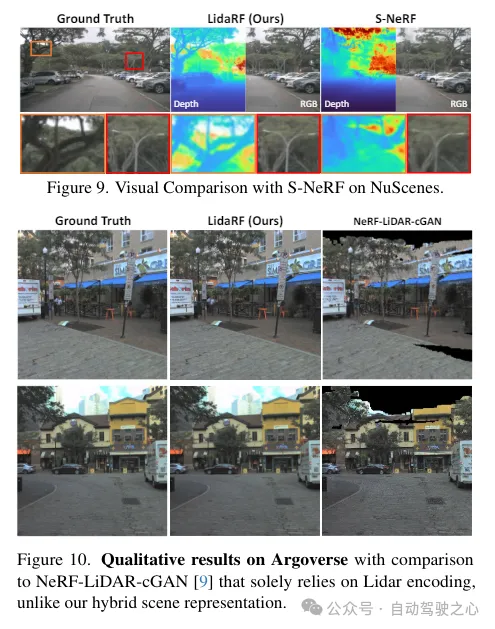

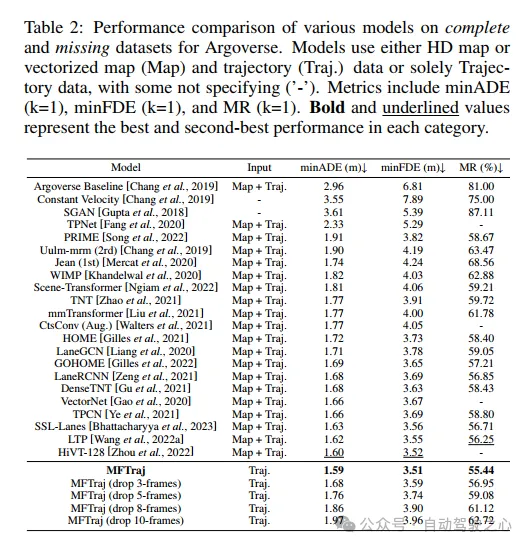

實驗比較分析

以上是LidaRF:研究用於街景神經輻射場的光達資料(CVPR\'24)的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

開源!超越ZoeDepth! DepthFM:快速且精確的單目深度估計!

Apr 03, 2024 pm 12:04 PM

開源!超越ZoeDepth! DepthFM:快速且精確的單目深度估計!

Apr 03, 2024 pm 12:04 PM

0.這篇文章乾了啥?提出了DepthFM:一個多功能且快速的最先進的生成式單目深度估計模型。除了傳統的深度估計任務外,DepthFM還展示了在深度修復等下游任務中的最先進能力。 DepthFM效率高,可以在少數推理步驟內合成深度圖。以下一起來閱讀這項工作~1.論文資訊標題:DepthFM:FastMonocularDepthEstimationwithFlowMatching作者:MingGui,JohannesS.Fischer,UlrichPrestel,PingchuanMa,Dmytr

使用ddrescue在Linux上恢復數據

Mar 20, 2024 pm 01:37 PM

使用ddrescue在Linux上恢復數據

Mar 20, 2024 pm 01:37 PM

DDREASE是一種用於從檔案或區塊裝置(如硬碟、SSD、RAM磁碟、CD、DVD和USB儲存裝置)復原資料的工具。它將資料從一個區塊設備複製到另一個區塊設備,留下損壞的資料區塊,只移動好的資料區塊。 ddreasue是一種強大的恢復工具,完全自動化,因為它在恢復操作期間不需要任何干擾。此外,由於有了ddasue地圖文件,它可以隨時停止和恢復。 DDREASE的其他主要功能如下:它不會覆寫恢復的數據,但會在迭代恢復的情況下填補空白。但是,如果指示工具明確執行此操作,則可以將其截斷。將資料從多個檔案或區塊還原到單

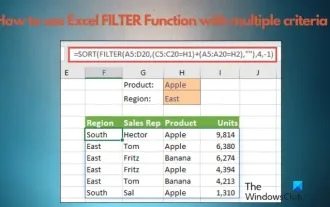

如何多條件使用Excel過濾功能

Feb 26, 2024 am 10:19 AM

如何多條件使用Excel過濾功能

Feb 26, 2024 am 10:19 AM

如果您需要了解如何在Excel中使用具有多個條件的篩選功能,以下教學將引導您完成對應步驟,確保您可以有效地篩選資料和排序資料。 Excel的篩選功能是非常強大的,能夠幫助您從大量資料中提取所需的資訊。這個功能可以根據您設定的條件,過濾資料並只顯示符合條件的部分,讓資料的管理變得更有效率。透過使用篩選功能,您可以快速找到目標數據,節省了尋找和整理數據的時間。這個功能不僅可以應用在簡單的資料清單上,還可以根據多個條件進行篩選,幫助您更精準地定位所需資訊。總的來說,Excel的篩選功能是一個非常實用的

Google狂喜:JAX性能超越Pytorch、TensorFlow!或成GPU推理訓練最快選擇

Apr 01, 2024 pm 07:46 PM

Google狂喜:JAX性能超越Pytorch、TensorFlow!或成GPU推理訓練最快選擇

Apr 01, 2024 pm 07:46 PM

谷歌力推的JAX在最近的基準測試中表現已經超過Pytorch和TensorFlow,7項指標排名第一。而且測試並不是JAX性能表現最好的TPU上完成的。雖然現在在開發者中,Pytorch依然比Tensorflow更受歡迎。但未來,也許有更多的大型模型會基於JAX平台進行訓練和運行。模型最近,Keras團隊為三個後端(TensorFlow、JAX、PyTorch)與原生PyTorch實作以及搭配TensorFlow的Keras2進行了基準測試。首先,他們為生成式和非生成式人工智慧任務選擇了一組主流

iPhone上的蜂窩數據網路速度慢:修復

May 03, 2024 pm 09:01 PM

iPhone上的蜂窩數據網路速度慢:修復

May 03, 2024 pm 09:01 PM

在iPhone上面臨滯後,緩慢的行動數據連線?通常,手機上蜂窩互聯網的強度取決於幾個因素,例如區域、蜂窩網絡類型、漫遊類型等。您可以採取一些措施來獲得更快、更可靠的蜂窩網路連線。修復1–強制重啟iPhone有時,強制重啟設備只會重置許多內容,包括蜂窩網路連線。步驟1–只需按一次音量調高鍵並放開即可。接下來,按降低音量鍵並再次釋放它。步驟2–過程的下一部分是按住右側的按鈕。讓iPhone完成重啟。啟用蜂窩數據並檢查網路速度。再次檢查修復2–更改資料模式雖然5G提供了更好的網路速度,但在訊號較弱

特斯拉機器人進廠打工,馬斯克:手的自由度今年將達到22個!

May 06, 2024 pm 04:13 PM

特斯拉機器人進廠打工,馬斯克:手的自由度今年將達到22個!

May 06, 2024 pm 04:13 PM

特斯拉機器人Optimus最新影片出爐,已經可以在工廠裡打工了。正常速度下,它分揀電池(特斯拉的4680電池)是這樣的:官方還放出了20倍速下的樣子——在小小的「工位」上,揀啊揀啊揀:這次放出的影片亮點之一在於Optimus在廠子裡完成這項工作,是完全自主的,全程沒有人為的干預。而且在Optimus的視角之下,它還可以把放歪了的電池重新撿起來放置,主打一個自動糾錯:對於Optimus的手,英偉達科學家JimFan給出了高度的評價:Optimus的手是全球五指機器人裡最靈巧的之一。它的手不僅有觸覺

超級智能體生命力覺醒!可自我更新的AI來了,媽媽再也不用擔心資料瓶頸難題

Apr 29, 2024 pm 06:55 PM

超級智能體生命力覺醒!可自我更新的AI來了,媽媽再也不用擔心資料瓶頸難題

Apr 29, 2024 pm 06:55 PM

哭死啊,全球狂煉大模型,一網路的資料不夠用,根本不夠用。訓練模型搞得跟《飢餓遊戲》似的,全球AI研究者,都在苦惱怎麼才能餵飽這群資料大胃王。尤其在多模態任務中,這問題尤其突出。一籌莫展之際,來自人大系的初創團隊,用自家的新模型,率先在國內把「模型生成數據自己餵自己」變成了現實。而且還是理解側和生成側雙管齊下,兩側都能產生高品質、多模態的新數據,對模型本身進行數據反哺。模型是啥?中關村論壇上剛露面的多模態大模型Awaker1.0。團隊是誰?智子引擎。由人大高瓴人工智慧學院博士生高一鑷創立,高

阿里7B多模態文件理解大模型拿下新SOTA

Apr 02, 2024 am 11:31 AM

阿里7B多模態文件理解大模型拿下新SOTA

Apr 02, 2024 am 11:31 AM

多模態文件理解能力新SOTA!阿里mPLUG團隊發布最新開源工作mPLUG-DocOwl1.5,針對高解析度圖片文字辨識、通用文件結構理解、指令遵循、外部知識引入四大挑戰,提出了一系列解決方案。話不多說,先來看效果。複雜結構的圖表一鍵識別轉換為Markdown格式:不同樣式的圖表都可以:更細節的文字識別和定位也能輕鬆搞定:還能對文檔理解給出詳細解釋:要知道,“文檔理解”目前是大語言模型實現落地的一個重要場景,市面上有許多輔助文檔閱讀的產品,有的主要透過OCR系統進行文字識別,配合LLM進行文字理