使用Siglip 2提高图像搜索功能2

siglip 2:用增强的视觉语言编码

革命性图像搜索>有效而准确的图像检索对于数字资产管理,电子商务和社交媒体至关重要。 Google DeepMind的Siglip 2(语言图像预训练的Sigmoid损失)是一种尖端的多语言视觉语言编码器,旨在显着提高图像相似性和搜索。 它的创新体系结构增强了语义理解,并在零击分类和图像文本检索中表现出色,在提取有意义的视觉表示方面超过了以前的模型。这是通过统一的培训方法来实现的,该方法结合了自我监督的学习和多样化的数据。

关键学习点- 掌握剪辑模型的基本原理及其在图像检索中的作用。

- 了解基于软马克斯的损失函数在区分微妙的图像变化中的局限性。

- 探索siglip如何利用sigmoid损失函数克服这些局限性。

- 分析Siglip 2对其前身的关键改进。 >使用用户的映像查询构建功能图像检索系统。

- 比较并评估siglip 2与siglip的性能。

- >本文是数据科学博客马拉松的一部分。

表

对比度语言图像预训练(剪辑)> >夹子的核心组件

>软磁功能和横向损失- 剪辑的限制

- siglip和sigmoid损失函数

- >剪辑的关键差异

- siglip 2:超过siglip

- 的进步

- > siglip 2 的核心特征

- >使用Siglip 2构建图像检索系统,并使用Siglip进行比较分析

- 实用检索测试

- > siglip 2模型评估

siglip模型评估 -

- 结论

- 常见问题

- 在 Openai于2021年推出的

- 了解更多信息:剪辑VIT-L14:零拍摄图像分类的多模式奇迹

- >夹子的核心组件

>软磁功能和横向损失

>剪辑使用编码器生成用于图像和文本的嵌入式。 相似得分(DOT产品)测量这些嵌入之间的相似性。 SoftMax函数会生成每个图像文本对的概率分布。

剪辑的限制

剪辑的限制

- 难度与类似对的困难:

- SoftMax努力区分非常相似的图像文本对之间的细微差异。 二次记忆复杂性:

- 成对相似性计算导致高内存需求。

Google的Siglip通过采用基于Sigmoid的损失功能来解决Clip的局限性。这是在每个图像文本对上独立运行的,从而提高了效率和准确性。>

>剪辑的关键差异

siglip 2:超过siglip

的进步 siglip 2在零摄像分类,图像文本检索和视觉表示提取中显着胜过siglip。 一个关键特征是其动态分辨率(NAFLEX)变体。

的核心特征

- 文本解码器增强了接地的字幕和引用表达能力。 改善了细粒度的局部语义:

- 全局本地损失和蒙版的预测损失可改善本地特征提取。 >自我介绍: 改善模型中的知识转移。

- 更好地适应不同的分辨率: 修复程序和naflex变体处理各种图像分辨率和宽高比。

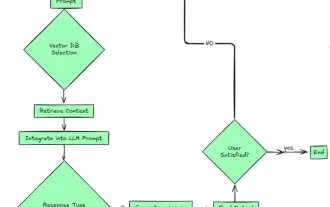

- >使用Siglip 2构建图像检索系统,并使用Siglip

(本节将包含Python代码和用于构建图像检索系统的解释,类似于原始系统,但是具有改善的清晰度和可能简化的简化代码。

实用检索测试(本节将包括测试Siglip和Siglip 2模型与示例图像的结果,显示检索图像并将其相似性与查询图像进行比较。

结论Siglip 2 代表了视觉模型的重大进步,提供了出色的图像检索功能。 它的效率,准确性和适应性使其成为各种应用程序中的宝贵工具。

>常见问题

(本节将基本保持不变,可能会以较小的清晰度的次要重新单词。 (注意:图像将按原始输入中的指定包含。

以上是使用Siglip 2提高图像搜索功能2的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

最佳AI艺术生成器(免费付款)创意项目

Apr 02, 2025 pm 06:10 PM

最佳AI艺术生成器(免费付款)创意项目

Apr 02, 2025 pm 06:10 PM

本文回顾了AI最高的艺术生成器,讨论了他们的功能,对创意项目的适用性和价值。它重点介绍了Midjourney是专业人士的最佳价值,并建议使用Dall-E 2进行高质量的可定制艺术。

开始使用Meta Llama 3.2 -Analytics Vidhya

Apr 11, 2025 pm 12:04 PM

开始使用Meta Llama 3.2 -Analytics Vidhya

Apr 11, 2025 pm 12:04 PM

Meta的Llama 3.2:多模式和移动AI的飞跃 Meta最近公布了Llama 3.2,这是AI的重大进步,具有强大的视觉功能和针对移动设备优化的轻量级文本模型。 以成功为基础

最佳AI聊天机器人比较(Chatgpt,Gemini,Claude&更多)

Apr 02, 2025 pm 06:09 PM

最佳AI聊天机器人比较(Chatgpt,Gemini,Claude&更多)

Apr 02, 2025 pm 06:09 PM

本文比较了诸如Chatgpt,Gemini和Claude之类的顶级AI聊天机器人,重点介绍了其独特功能,自定义选项以及自然语言处理和可靠性的性能。

顶级AI写作助理来增强您的内容创建

Apr 02, 2025 pm 06:11 PM

顶级AI写作助理来增强您的内容创建

Apr 02, 2025 pm 06:11 PM

文章讨论了Grammarly,Jasper,Copy.ai,Writesonic和Rytr等AI最高的写作助手,重点介绍了其独特的内容创建功能。它认为Jasper在SEO优化方面表现出色,而AI工具有助于保持音调的组成

AV字节:Meta' llama 3.2,Google的双子座1.5等

Apr 11, 2025 pm 12:01 PM

AV字节:Meta' llama 3.2,Google的双子座1.5等

Apr 11, 2025 pm 12:01 PM

本周的AI景观:进步,道德考虑和监管辩论的旋风。 OpenAI,Google,Meta和Microsoft等主要参与者已经释放了一系列更新,从开创性的新车型到LE的关键转变

向员工出售AI策略:Shopify首席执行官的宣言

Apr 10, 2025 am 11:19 AM

向员工出售AI策略:Shopify首席执行官的宣言

Apr 10, 2025 am 11:19 AM

Shopify首席执行官TobiLütke最近的备忘录大胆地宣布AI对每位员工的基本期望是公司内部的重大文化转变。 这不是短暂的趋势。这是整合到P中的新操作范式

构建AI代理的前7个代理抹布系统

Mar 31, 2025 pm 04:25 PM

构建AI代理的前7个代理抹布系统

Mar 31, 2025 pm 04:25 PM

2024年见证了从简单地使用LLM进行内容生成的转变,转变为了解其内部工作。 这种探索导致了AI代理的发现 - 自主系统处理任务和最少人工干预的决策。 Buildin

10个生成AI编码扩展,在VS代码中,您必须探索

Apr 13, 2025 am 01:14 AM

10个生成AI编码扩展,在VS代码中,您必须探索

Apr 13, 2025 am 01:14 AM

嘿,编码忍者!您当天计划哪些与编码有关的任务?在您进一步研究此博客之前,我希望您考虑所有与编码相关的困境,这是将其列出的。 完毕? - 让&#8217