Mistral Small 3 |如何访问,功能,性能等

> Mistral AI的最新小语言模型(SLM),Mistral Small 3,提供了令人印象深刻的性能和效率。 这个240亿个参数模型具有跨不同AI任务的快速响应时间和可靠的功能。 让我们探索其功能,应用程序,可访问性和基准比较。

>目录的介绍小型3,这是我们最有效,最通用的模型!预训练和指导版本,Apache 2.0,24B,81%MMLU,150 TOK/s。没有合成数据,使其非常适合推理任务。 快乐的建筑!

表

- 什么是Mistral Small 3? >

- 键功能

- >性能基准

- 访问Mistral Small 3

- 实践测试

- 编码

- 数学推理

- 情感分析

- >应用

- 现实世界用例

- 常见问题

什么是mistral小3?

>

键特征

- 多语言支持(英语,法语,德语,西班牙,意大利语,中文,日语,韩语,葡萄牙语,荷兰语,波兰)

- >具有函数呼叫和JSON输出的以代理为中心的功能

- >高级推理和对话技能

- Apache 2.0灵活的商业和非商业用途的许可

- 强大的系统提示支持 带有131k词汇的Tekken Tokenizer

- >

- 性能基准

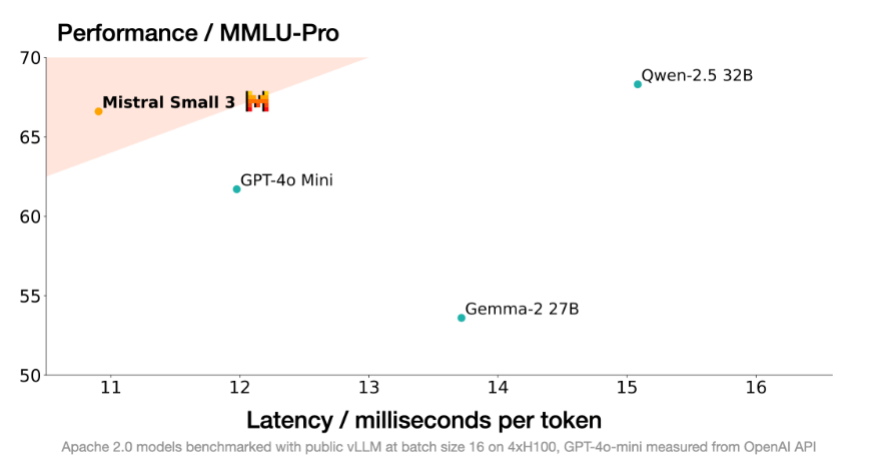

在各种基准测试中,Mistral Small 3脱颖而出,在保持较高速度的同时,在特定区域的表现通常优于较大的模型。 与GPT-4O-MINI,LLAMA 3.3 70B指令,QWEN2.5 32B指示和Gemma 2 27B的比较。 >另请参见:PHI 4 vs GPT 4O-MINI比较

1。大规模的多任务语言理解(MMLU):

2。通用问题回答(GPQA)主:它在回答各种问题,展示强大的推理能力方面优于竞争对手。

3。 Humaneval:

4。数学指示:

4。数学指示:

> Mistral Small 3的速度优势(比Llama 3.3 70B在类似硬件上的指示快三倍以上)强调了其效率。

>另请参见:qwen2.5-vl视觉模型概述> 在 Mistral Small 3在Apache 2.0许可下可通过Mistral AI的网站,拥抱Face,Ollama,Kaggle,AI和Fireworks AI提供。 下面的kaggle示例说明了其集成:> AI提供了与OpenAi兼容的API,Mistral AI通过LA PlateForme提供部署选项。 未来的可用性是在NVIDIA NIM,Amazon Sagemaker,Groq,Databricks和Snowflake上计划的。

>

(将随后进行动手测试,应用程序,现实世界用例和常见问题解答部分,反映原始文本的结构和内容,但进行了较小的措辞调整以改善流程和简洁性。图像将保持其原始位置。)

以上是Mistral Small 3 |如何访问,功能,性能等的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

开始使用Meta Llama 3.2 -Analytics Vidhya

Apr 11, 2025 pm 12:04 PM

开始使用Meta Llama 3.2 -Analytics Vidhya

Apr 11, 2025 pm 12:04 PM

Meta的Llama 3.2:多模式和移动AI的飞跃 Meta最近公布了Llama 3.2,这是AI的重大进步,具有强大的视觉功能和针对移动设备优化的轻量级文本模型。 以成功为基础

10个生成AI编码扩展,在VS代码中,您必须探索

Apr 13, 2025 am 01:14 AM

10个生成AI编码扩展,在VS代码中,您必须探索

Apr 13, 2025 am 01:14 AM

嘿,编码忍者!您当天计划哪些与编码有关的任务?在您进一步研究此博客之前,我希望您考虑所有与编码相关的困境,这是将其列出的。 完毕? - 让&#8217

AV字节:Meta' llama 3.2,Google的双子座1.5等

Apr 11, 2025 pm 12:01 PM

AV字节:Meta' llama 3.2,Google的双子座1.5等

Apr 11, 2025 pm 12:01 PM

本周的AI景观:进步,道德考虑和监管辩论的旋风。 OpenAI,Google,Meta和Microsoft等主要参与者已经释放了一系列更新,从开创性的新车型到LE的关键转变

向员工出售AI策略:Shopify首席执行官的宣言

Apr 10, 2025 am 11:19 AM

向员工出售AI策略:Shopify首席执行官的宣言

Apr 10, 2025 am 11:19 AM

Shopify首席执行官TobiLütke最近的备忘录大胆地宣布AI对每位员工的基本期望是公司内部的重大文化转变。 这不是短暂的趋势。这是整合到P中的新操作范式

视觉语言模型(VLMS)的综合指南

Apr 12, 2025 am 11:58 AM

视觉语言模型(VLMS)的综合指南

Apr 12, 2025 am 11:58 AM

介绍 想象一下,穿过美术馆,周围是生动的绘画和雕塑。现在,如果您可以向每一部分提出一个问题并获得有意义的答案,该怎么办?您可能会问:“您在讲什么故事?

GPT-4O vs OpenAI O1:新的Openai模型值得炒作吗?

Apr 13, 2025 am 10:18 AM

GPT-4O vs OpenAI O1:新的Openai模型值得炒作吗?

Apr 13, 2025 am 10:18 AM

介绍 Openai已根据备受期待的“草莓”建筑发布了其新模型。这种称为O1的创新模型增强了推理能力,使其可以通过问题进行思考

如何在SQL中添加列? - 分析Vidhya

Apr 17, 2025 am 11:43 AM

如何在SQL中添加列? - 分析Vidhya

Apr 17, 2025 am 11:43 AM

SQL的Alter表语句:动态地将列添加到数据库 在数据管理中,SQL的适应性至关重要。 需要即时调整数据库结构吗? Alter表语句是您的解决方案。本指南的详细信息添加了Colu

最新的最佳及时工程技术的年度汇编

Apr 10, 2025 am 11:22 AM

最新的最佳及时工程技术的年度汇编

Apr 10, 2025 am 11:22 AM

对于那些可能是我专栏新手的人,我广泛探讨了AI的最新进展,包括体现AI,AI推理,AI中的高科技突破,及时的工程,AI培训,AI,AI RE RE等主题