DeepSeek:以效率彻底改变AI培训,而不仅仅是资源

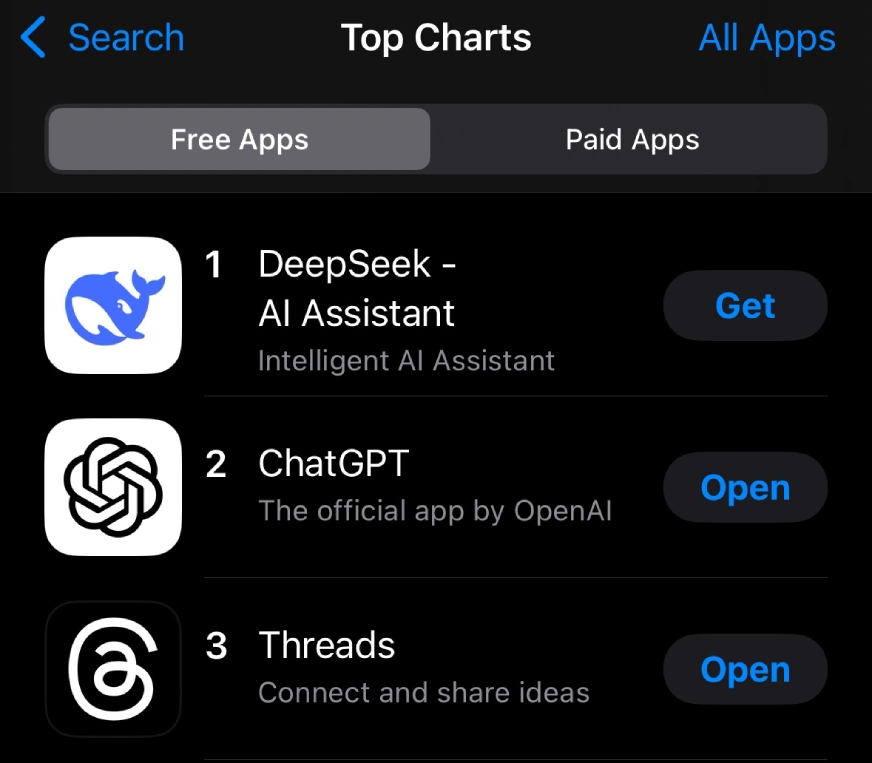

DeepSeek在AI社区中引起了巨大的嗡嗡声,以实现看似不可能的事物:仅以典型成本的1/30培训AI模型。 尽管许多公司拥有“最先进的”模型,但DeepSeek表明,真正的创新在于突破界限并取得以前无法实现的结果。 该公司的应用程序甚至已升至App Store排行榜的顶部,超过了Chatgpt等既定巨人。这种病毒图像说明了其成功:

DeepSeek的杰出成就源于巧妙的策略的结合:

DeepSeek的杰出成就源于巧妙的策略的结合:

有针对性的培训:最大化效率:

有针对性的培训:最大化效率:

> DeepSeek的影响: DeepSeek的成功突出了三个关键原则:有针对性的培训,智能压缩和有效的硬件利用率。 这种方法不仅降低了成本,还可以加速测试和创新周期。 该公司证明了开创性的AI不需要无限的资源。这是关于最大化可用的东西。 这种效率模型是AI的未来的游戏规则。

DeepSeek的成功突出了三个关键原则:有针对性的培训,智能压缩和有效的硬件利用率。 这种方法不仅降低了成本,还可以加速测试和创新周期。 该公司证明了开创性的AI不需要无限的资源。这是关于最大化可用的东西。 这种效率模型是AI的未来的游戏规则。

(注意:行动的电话和相关文章列表保持不变。

>解锁DeepSeek具有成本效益的AI培训的秘密!今天就读我们的“入门”课程,并学习如何以一小部分成本来利用强大的AI技术。不要错过 - 现在开始您的旅程!>查看我们有关DeepSeek工作和与类似模型进行比较的详细文章:

> DeepSeek R1- Openai的O1最大竞争对手在这里!> >使用DeepSeek-V3

构建AI应用程序> deepSeek-v3 vs gpt-4o vs llama 3.3 70b deepseek v3 vs gpt-4o:哪个更好? deepseek r1 vs openai o1:哪个更好?>

敬请期待分析vidhya博客,以获取更多如此出色的内容!

以上是Seek培训了30倍更便宜的AI?的详细内容。更多信息请关注PHP中文网其他相关文章!