经常性神经网络教程(RNN)

经常性神经网络(RNNS):综合指南

经常性的神经网络(RNN)是一种在苹果Siri和Google的语音搜索等应用程序中使用的强大类型人工神经网络(ANN)。它们通过内部记忆保留过去输入的独特能力使它们非常适合诸如股票价格预测,文本生成,转录和机器翻译等任务。与输入和输出是独立的传统神经网络不同,RNN输出取决于序列中的先前元素。此外,RNN在跨网络层共享参数,从而在梯度下降期间优化了重量和偏差调整。

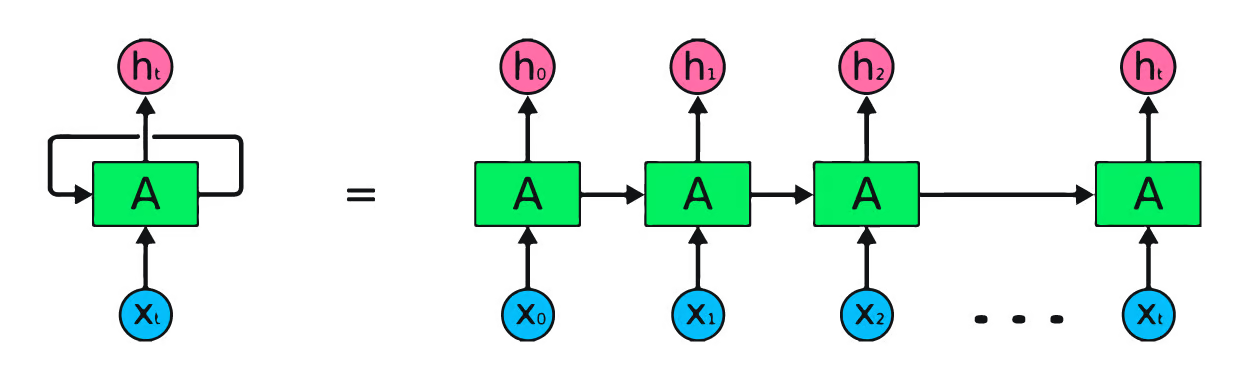

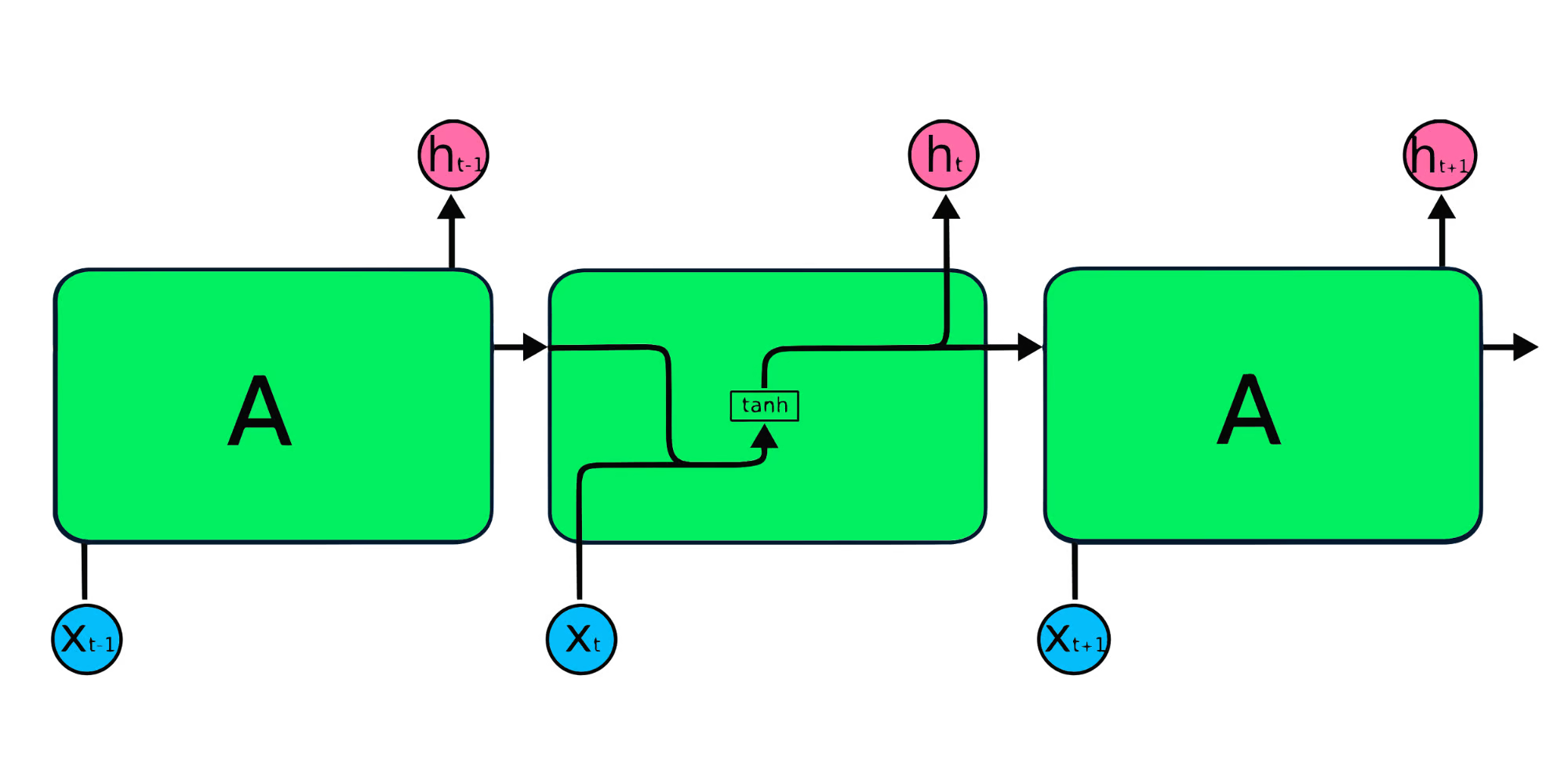

上图说明了基本的RNN。在股票价格预测方案中,使用[45、56、45、49、50,...]之类的数据,每个输入(x0至XT)都包含了过去的值。例如,X0为45,X1为56,这些值有助于预测下一个序列元素。

RNN的功能

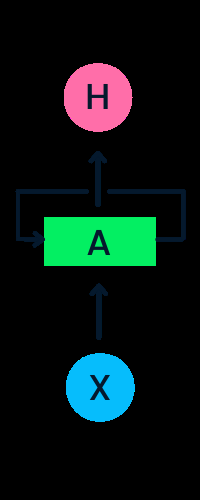

在RNN中,信息通过循环循环,使输出成为当前输入和先前输入的函数。

输入层(x)处理初始输入,将其传递到中间层(a),其中包含具有激活功能,权重和偏见的多个隐藏图层。这些参数在隐藏的层上共享,创建一个单个循环图层,而不是多个不同的层。 RNNS通过时间(BPTT)而不是传统的反向传播来计算梯度。由于共享参数,BPTT在每个时间步长汇总错误。

RNN的类型

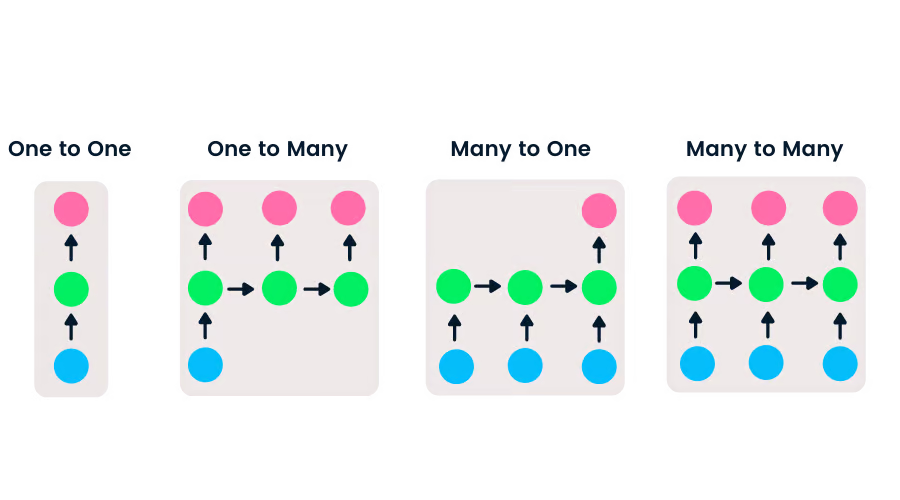

与具有单个输入和输出的FeedForward网络不同,RNN提供的输入和输出长度具有灵活性。这种适应性使RNN可以处理各种任务,包括音乐生成,情感分析和机器翻译。存在四种主要类型:

- 一对一:一个适合单个输入/输出问题的简单神经网络。

- 一对多:处理单个输入以生成多个输出(例如,图像字幕)。

- 多对一:需要多个输入来预测单个输出(例如,情感分类)。

- 多对多:处理多个输入和输出(例如,机器翻译)。

推荐的机器学习课程

CNNS与RNNS

卷积神经网络(CNN)是馈电网络处理空间数据(如图像),通常在计算机视觉中使用。简单的神经网络与图像像素依赖性抗争,而CNN则凭借其卷积,恢复,汇总和完全连接的层在这一领域中表现出色。

关键差异:

- CNNS处理稀疏数据(图像),而RNN管理时间序列和顺序数据。

- CNN使用标准反向流动,RNN使用BPTT。

- CNN具有有限的输入/输出; RNN是灵活的。

- CNN是喂食的; RNN使用循环进行顺序数据。

- CNN用于图像/视频处理;语音/文本分析的RNN。

RNN限制

简单的RNN面临与梯度有关的两个主要挑战:

- 消失的梯度:梯度变得太小,阻碍参数更新和学习。

- 爆炸梯度:梯度变得过大,导致模型不稳定性和较长的训练时间。

解决方案包括减少隐藏层或使用LSTM和GRU等高级体系结构。

高级RNN体系结构

简单的RNN遭受短期内存限制。 LSTM和GRU通过在长时间内保留信息来解决此问题。

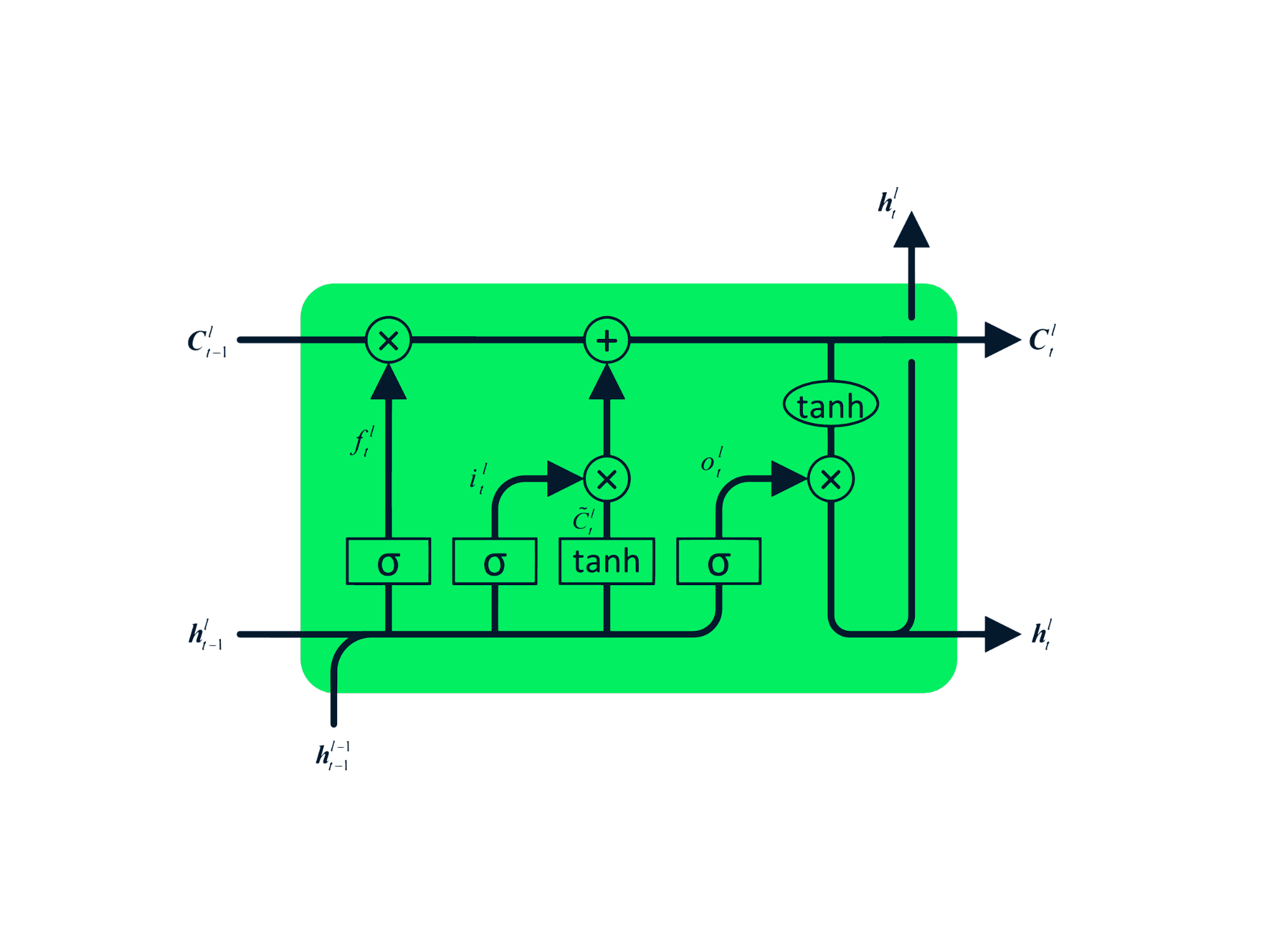

- 长短期内存(LSTM):一种高级RNN,旨在减轻消失/爆炸梯度。它的四个相互作用层有助于长期记忆力保留,使其适合机器翻译,语音合成等。

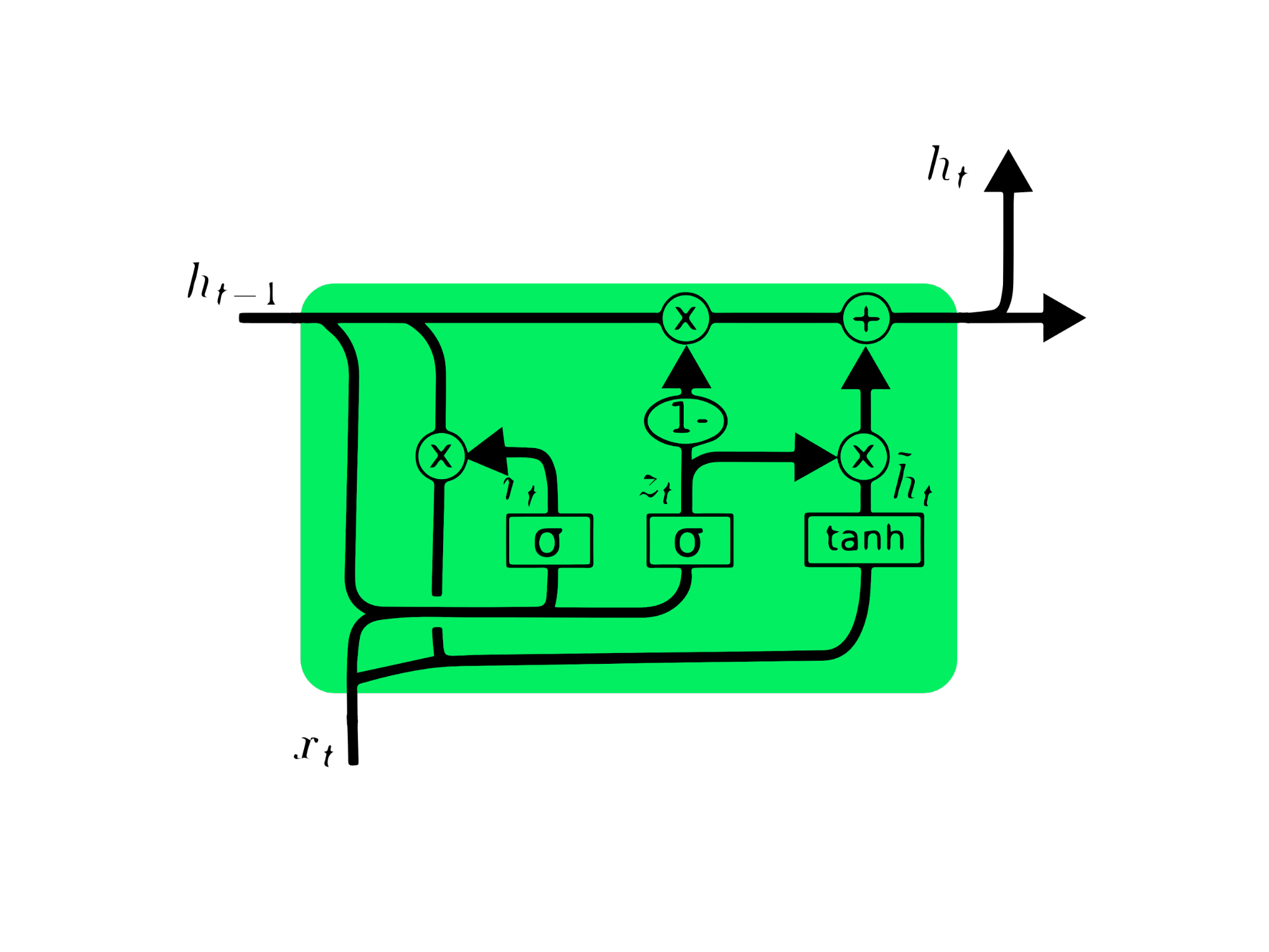

- 门控复发单元(GRU):使用更新和重置门来管理信息流的更简单的LSTM变化。与LSTM相比,其简化的架构通常会导致更快的培训。

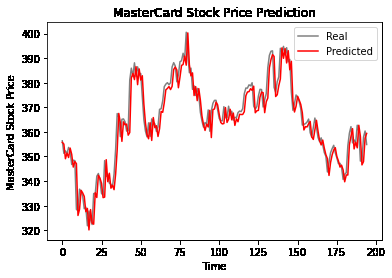

万事达卡股票价格预测使用LSTM&GRU

本节详细介绍了一个使用LSTM和GRU预测万事达卡股价的项目。该代码利用Pandas,Numpy,Matplotlib,Scikit-Learn和TensorFlow等库。

(此处省略了原始输入中的详细代码示例。

- 数据分析:导入和清洁万事达卡库存数据集。

-

数据预处理:将数据分为培训和测试集,使用

MinMaxScaler进行扩展,然后重塑模型输入。 - LSTM模型:构建和训练LSTM模型。

- LSTM结果:使用RMSE评估LSTM模型的性能。

- GRU模型:建立和培训具有类似体系结构的GRU模型。

- GRU结果:使用RMSE评估GRU模型的性能。

- 结论:比较LSTM和GRU模型的性能。

结论

混合CNN-RNN网络越来越多地用于需要空间和时间理解的任务。本教程提供了对LSTM和GRU等高级体系结构提供的RNN,其局限性和解决方案的基本理解。该项目证明了LSTM和GRU在股票价格预测中的应用,在此特定情况下强调了GRU的出色表现。完整的项目可在Datacamp Workspace上找到。

切记替换https://www.php.cn/link/cc6a6632b380f3f6a1c54b1222cd96c2和https://www.php.cn/link/8708107b2ff5de15d0244471ae041fdb假定图像URL是正确且可访问的。

以上是经常性神经网络教程(RNN)的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

最佳AI艺术生成器(免费付款)创意项目

Apr 02, 2025 pm 06:10 PM

最佳AI艺术生成器(免费付款)创意项目

Apr 02, 2025 pm 06:10 PM

本文回顾了AI最高的艺术生成器,讨论了他们的功能,对创意项目的适用性和价值。它重点介绍了Midjourney是专业人士的最佳价值,并建议使用Dall-E 2进行高质量的可定制艺术。

开始使用Meta Llama 3.2 -Analytics Vidhya

Apr 11, 2025 pm 12:04 PM

开始使用Meta Llama 3.2 -Analytics Vidhya

Apr 11, 2025 pm 12:04 PM

Meta的Llama 3.2:多模式和移动AI的飞跃 Meta最近公布了Llama 3.2,这是AI的重大进步,具有强大的视觉功能和针对移动设备优化的轻量级文本模型。 以成功为基础

最佳AI聊天机器人比较(Chatgpt,Gemini,Claude&更多)

Apr 02, 2025 pm 06:09 PM

最佳AI聊天机器人比较(Chatgpt,Gemini,Claude&更多)

Apr 02, 2025 pm 06:09 PM

本文比较了诸如Chatgpt,Gemini和Claude之类的顶级AI聊天机器人,重点介绍了其独特功能,自定义选项以及自然语言处理和可靠性的性能。

顶级AI写作助理来增强您的内容创建

Apr 02, 2025 pm 06:11 PM

顶级AI写作助理来增强您的内容创建

Apr 02, 2025 pm 06:11 PM

文章讨论了Grammarly,Jasper,Copy.ai,Writesonic和Rytr等AI最高的写作助手,重点介绍了其独特的内容创建功能。它认为Jasper在SEO优化方面表现出色,而AI工具有助于保持音调的组成

AV字节:Meta' llama 3.2,Google的双子座1.5等

Apr 11, 2025 pm 12:01 PM

AV字节:Meta' llama 3.2,Google的双子座1.5等

Apr 11, 2025 pm 12:01 PM

本周的AI景观:进步,道德考虑和监管辩论的旋风。 OpenAI,Google,Meta和Microsoft等主要参与者已经释放了一系列更新,从开创性的新车型到LE的关键转变

向员工出售AI策略:Shopify首席执行官的宣言

Apr 10, 2025 am 11:19 AM

向员工出售AI策略:Shopify首席执行官的宣言

Apr 10, 2025 am 11:19 AM

Shopify首席执行官TobiLütke最近的备忘录大胆地宣布AI对每位员工的基本期望是公司内部的重大文化转变。 这不是短暂的趋势。这是整合到P中的新操作范式

10个生成AI编码扩展,在VS代码中,您必须探索

Apr 13, 2025 am 01:14 AM

10个生成AI编码扩展,在VS代码中,您必须探索

Apr 13, 2025 am 01:14 AM

嘿,编码忍者!您当天计划哪些与编码有关的任务?在您进一步研究此博客之前,我希望您考虑所有与编码相关的困境,这是将其列出的。 完毕? - 让&#8217

选择最佳的AI语音生成器:评论的顶级选项

Apr 02, 2025 pm 06:12 PM

选择最佳的AI语音生成器:评论的顶级选项

Apr 02, 2025 pm 06:12 PM

本文评论了Google Cloud,Amazon Polly,Microsoft Azure,IBM Watson和Discript等高级AI语音生成器,重点介绍其功能,语音质量和满足不同需求的适用性。