关于NVIDIA NIM

革命性的AI推论与Nvidia Nim:深入潜水

人工智能(AI)正在全球改变行业,影响医疗保健,自动驾驶汽车,金融和客户服务。尽管AI模型开发受到了极大的关注,但AI推断(将经过训练的模型都应用于新数据以进行预测),是现实世界影响真正表现出来的。随着AI驱动的应用变得越来越普遍,对高效,可扩展和低延迟推理解决方案的需求飙升。 NVIDIA神经推断微服务(NIM)解决了这一需求。 NIM使开发人员将AI模型部署为微服务,从而简化了大规模推理解决方案的交付。本文探讨了NIM的功能,通过NIM API展示了模型使用情况,并展示了其对AI推断的变革性影响。

关键学习目标:

- 掌握AI推理及其跨行业应用的重要性。

- 了解NVIDIA NIM在AI模型部署中的功能和优势。

- 学会通过NVIDIA NIM API访问和利用预训练的模型。

- 掌握测量不同AI模型的推理速度的过程。

- 探索NIM的实际示例,用于文本生成和图像创建。

- 欣赏NIM的模块化体系结构及其对可扩展AI解决方案的好处。

(本文是数据科学博客马拉松的一部分。)

目录:

- 什么是NVIDIA NIM?

- 探索Nvidia Nim的主要特征

- 访问Nvidia Nim中的型号

- 用各种模型评估推理速度

- 稳定扩散3介质:案例研究

- 常见问题

什么是NVIDIA NIM?

NVIDIA NIM是一个平台,利用微服务来简化现实世界应用中的AI推断。微服务(独立但协作服务)可以创建可扩展的,适应性的系统。通过包装现成的AI模型作为微服务,NIM允许开发人员在没有复杂的基础架构或规模考虑的情况下快速整合这些模型。

NVIDIA NIM的关键特征:

- 预先训练的AI模型: NIM提供了用于不同任务的预培训模型的库,包括语音识别,自然语言处理(NLP)和计算机视觉。

- 性能优化: NIM利用NVIDIA的功能强大的GPU和软件优化(如张力),用于低延迟,高通量推断。

- 模块化设计:开发人员可以组合和自定义微服务以满足特定的推理要求。

探索Nvidia Nim的主要特征:

快速部署的预训练模型: NIM提供了各种预训练的模型,准备立即部署,涵盖各种AI任务。

低延迟推断: NIM在提供快速响应方面表现出色,这对于诸如自主驾驶的实时应用程序至关重要,而自动驾驶,即传感器和相机数据的立即处理至关重要。

访问Nvidia Nim的型号:

- 访问NVIDIA NIM并使用您的电子邮件地址登录。

- 选择一个模型并获取您的API密钥。

用各种模型评估推理速度:

本节演示了如何评估不同AI模型的推理速度。响应时间对于实时应用程序至关重要。我们将以推理模型(Llama-3.2-3b-Instruct Preview)为例。

推理模型(Llama-3.2-3b-Instruct):

此NLP模型处理并响应用户查询。以下代码段(需要openai和python-dotenv库)展示了其使用和措施的推理速度:

来自Openai Import Openai

来自dotenv import load_dotenv

导入操作系统

进口时间

load_dotenv()

llama_api_key = os.getEnv('nvidia_api_key')

客户端= OpenAi(

base_url =“ https://integrate.api.nvidia.com/v1”,

api_key = llama_api_key)

user_input =输入(“输入查询:”)

start_time = time.time()

completion = client.chat.completions.create(

型号=“元/llama-3.2-3b-instruct”,

消息= [{{“ cole”:“ user”,“ content”:user_input}],

温度= 0.2,

top_p = 0.7,

max_tokens = 1024,

流= true

)

end_time = time.time()

完成零件:

如果块。

打印(块。

response_time = end_time -start_time

print(f“ \ nResponse时间:{response_time}秒”)

稳定扩散3介质:案例研究

稳定的扩散3介质从文本提示中生成图像。以下代码(使用requests库)说明了其用法:

导入请求 导入基础64 来自dotenv import load_dotenv 导入操作系统 进口时间 load_dotenv() Invoke_url =“ https://ai.api.nvidia.com/v1/genai/stociateai/stable-diffusion-3-medium” api_key = os.getEnv('stable_diffusion_api') #...(其余代码保持不变)

结论:

NVIDIA NIM为有效,可扩展的AI推断提供了强大的解决方案。它的微服务体系结构与GPU加速度和预训练的模型相结合,可以在云和边缘环境中快速部署实时AI应用程序。

关键要点:

- NIM的微服务体系结构允许对AI推理的有效缩放。

- NIM利用NVIDIA GPU和Tensorrt进行优化的推理性能。

- NIM非常适合各个行业的低延期应用。

常见问题:

Q1。 NVIDIA NIM的主要组成部分是什么?答:核心组件包括推理服务器,预训练的模型,张力优化和微服务体系结构。

Q2。 NVIDIA NIM可以与现有的AI模型集成吗?答:是的,NIM支持通过容器化的微服务和标准API与现有模型集成。

Q3。 NVIDIA NIM如何工作?答:NIM通过提供用于建立AI助手和副驾驶的API,并简化为IT和DevOps团队的模型部署来简化AI应用程序的开发。

Q4。提供了多少个API积分?答:个人电子邮件帐户的1000个学分,商业帐户的5000个。

(注意:所使用的图像不由作者所有,并且经过许可。)

以上是关于NVIDIA NIM的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

我尝试了使用光标AI编码的Vibe编码,这太神奇了!

Mar 20, 2025 pm 03:34 PM

我尝试了使用光标AI编码的Vibe编码,这太神奇了!

Mar 20, 2025 pm 03:34 PM

Vibe编码通过让我们使用自然语言而不是无尽的代码行创建应用程序来重塑软件开发的世界。受Andrej Karpathy等有远见的人的启发,这种创新的方法使Dev

2025年2月的Genai推出前5名:GPT-4.5,Grok-3等!

Mar 22, 2025 am 10:58 AM

2025年2月的Genai推出前5名:GPT-4.5,Grok-3等!

Mar 22, 2025 am 10:58 AM

2025年2月,Generative AI又是一个改变游戏规则的月份,为我们带来了一些最令人期待的模型升级和开创性的新功能。从Xai的Grok 3和Anthropic的Claude 3.7十四行诗到Openai的G

如何使用Yolo V12进行对象检测?

Mar 22, 2025 am 11:07 AM

如何使用Yolo V12进行对象检测?

Mar 22, 2025 am 11:07 AM

Yolo(您只看一次)一直是领先的实时对象检测框架,每次迭代都在以前的版本上改善。最新版本Yolo V12引入了进步,可显着提高准确性

最佳AI艺术生成器(免费付款)创意项目

Apr 02, 2025 pm 06:10 PM

最佳AI艺术生成器(免费付款)创意项目

Apr 02, 2025 pm 06:10 PM

本文回顾了AI最高的艺术生成器,讨论了他们的功能,对创意项目的适用性和价值。它重点介绍了Midjourney是专业人士的最佳价值,并建议使用Dall-E 2进行高质量的可定制艺术。

Chatgpt 4 o可用吗?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4 o可用吗?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4当前可用并广泛使用,与诸如ChatGpt 3.5(例如ChatGpt 3.5)相比,在理解上下文和产生连贯的响应方面取得了重大改进。未来的发展可能包括更多个性化的间

哪个AI比Chatgpt更好?

Mar 18, 2025 pm 06:05 PM

哪个AI比Chatgpt更好?

Mar 18, 2025 pm 06:05 PM

本文讨论了AI模型超过Chatgpt,例如Lamda,Llama和Grok,突出了它们在准确性,理解和行业影响方面的优势。(159个字符)

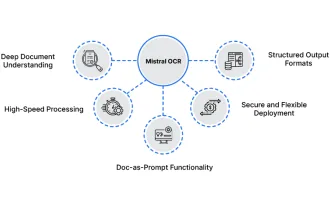

如何将Mistral OCR用于下一个抹布模型

Mar 21, 2025 am 11:11 AM

如何将Mistral OCR用于下一个抹布模型

Mar 21, 2025 am 11:11 AM

MISTRAL OCR:通过多模式文档理解彻底改变检索效果 检索增强的生成(RAG)系统具有明显高级的AI功能,从而可以访问大量的数据存储,以获得更明智的响应

顶级AI写作助理来增强您的内容创建

Apr 02, 2025 pm 06:11 PM

顶级AI写作助理来增强您的内容创建

Apr 02, 2025 pm 06:11 PM

文章讨论了Grammarly,Jasper,Copy.ai,Writesonic和Rytr等AI最高的写作助手,重点介绍了其独特的内容创建功能。它认为Jasper在SEO优化方面表现出色,而AI工具有助于保持音调的组成