nginx 源码学习笔记(二十一)—— event 模块二 ——事件驱动核心ngx_process_events_and_timers

首先继续回忆下,之前子线程执行操作里面有一个未涉及的内容ngx_process_events_and_timers,今天我们就来研究下这个函数。

本篇文章来自于:http://blog.csdn.net/lengzijian/article/details/7601730

先来看一下第十九节的部分截图:

今天主要讲解的就是事件驱动函数,图中的红色部分:

[cpp] view plaincopyprint?

- src/event/ngx_event.c

- void

- ngx_process_events_and_timers(ngx_cycle_t *cycle)

- {

- ngx_uint_t flags;

- ngx_msec_t timer, delta;

- if (ngx_timer_resolution) {

- timer = NGX_TIMER_INFINITE;

- flags = 0;

- } else {

- timer = ngx_event_find_timer();

- flags = NGX_UPDATE_TIME;

- }

- /*

- ngx_use_accept_mutex变量代表是否使用accept互斥体

- 默认是使用,可以通过accept_mutex off;指令关闭;

- accept mutex 的作用就是避免惊群,同时实现负载均衡

- */

- if (ngx_use_accept_mutex) {

- /*

- ngx_accept_disabled变量在ngx_event_accept函数中计算。

- 如果ngx_accept_disabled大于0,就表示该进程接受的链接过多,

- 因此放弃一次争抢accept mutex的机会,同时将自己减一。

- 然后,继续处理已有连接上的事件。

- nginx就利用这一点实现了继承关于连接的基本负载均衡。

- */

- if (ngx_accept_disabled > 0) {

- ngx_accept_disabled--;

- } else {

- /*

- 尝试锁accept mutex,只有成功获取锁的进程,才会将listen套接字放到epoll中。

- 因此,这就保证了只有一个进程拥有监听套接口,故所有进程阻塞在epoll_wait时,

- 才不会惊群现象。

- */

- if (ngx_trylock_accept_mutex(cycle) == NGX_ERROR) {

- return;

- }

- if (ngx_accept_mutex_held) {

- /*

- 如果进程获得了锁,将添加一个 NGX_POST_EVENTS 标志。

- 这个标志的作用是将所有产生的事件放入一个队列中,等释放后,在慢慢来处理事件。

- 因为,处理时间可能会很耗时,如果不先施放锁再处理的话,该进程就长时间霸占了锁,

- 导致其他进程无法获取锁,这样accept的效率就低了。

- */

- flags |= NGX_POST_EVENTS;

- } else {

- /*

- 没有获得所得进程,当然不需要NGX_POST_EVENTS标志。

- 但需要设置延时多长时间,再去争抢锁。

- */

- if (timer == NGX_TIMER_INFINITE

- || timer > ngx_accept_mutex_delay)

- {

- timer = ngx_accept_mutex_delay;

- }

- }

- }

- }

- delta = ngx_current_msec;

- /*接下来,epoll要开始wait事件,

- ngx_process_events的具体实现是对应到epoll模块中的ngx_epoll_process_events函数

- 这里之后会详细讲解的哦

- */

- (void) ngx_process_events(cycle, timer, flags);

- //统计本次wait事件的耗时

- delta = ngx_current_msec - delta;

- ngx_log_debug1(NGX_LOG_DEBUG_EVENT, cycle->log, 0,

- "timer delta: %M", delta);

- /*

- ngx_posted_accept_events是一个事件队列,暂存epoll从监听套接口wait到的accept事件。

- 前文提到的NGX_POST_EVENTS标志被使用后,会将所有的accept事件暂存到这个队列

- */

- if (ngx_posted_accept_events) {

- ngx_event_process_posted(cycle, &ngx_posted_accept_events);

- }

- //所有accept事件处理完之后,如果持有锁的话,就释放掉。

- if (ngx_accept_mutex_held) {

- ngx_shmtx_unlock(&ngx_accept_mutex);

- }

- /*

- delta是之前统计的耗时,存在毫秒级的耗时,就对所有时间的timer进行检查,

- 如果timeout 就从time rbtree中删除到期的timer,同时调用相应事件的handler函数处理

- */

- if (delta) {

- ngx_event_expire_timers();

- }

- ngx_log_debug1(NGX_LOG_DEBUG_EVENT, cycle->log, 0,

- "posted events %p", ngx_posted_events);

- /*

- 处理普通事件(连接上获得的读写事件),

- 因为每个事件都有自己的handler方法,

- */

- if (ngx_posted_events) {

- if (ngx_threaded) {

- ngx_wakeup_worker_thread(cycle);

- } else {

- ngx_event_process_posted(cycle, &ngx_posted_events);

- }

- }

- }

之前有说过accept事件,其实他就是监听套接口上是否有新来的事件,下面介绍下accept时间的handler方法:

ngx_event_accept:

[cpp] view plaincopyprint?

- src/event/ngx_event_accept.c

- void

- ngx_event_accept(ngx_event_t *ev)

- {

- socklen_t socklen;

- ngx_err_t err;

- ngx_log_t *log;

- ngx_socket_t s;

- ngx_event_t *rev, *wev;

- ngx_listening_t *ls;

- ngx_connection_t *c, *lc;

- ngx_event_conf_t *ecf;

- u_char sa[NGX_SOCKADDRLEN];

- //省略部分代码

- lc = ev->data;

- ls = lc->listening;

- ev->ready = 0;

- ngx_log_debug2(NGX_LOG_DEBUG_EVENT, ev->log, 0,

- "accept on %V, ready: %d", &ls->addr_text, ev->available);

- do {

- socklen = NGX_SOCKADDRLEN;

- //accept一个新的连接

- s = accept(lc->fd, (struct sockaddr *) sa, &socklen);

- //省略部分代码

- /*

- accept到一个新的连接后,就重新计算ngx_accept_disabled的值,

- 它主要是用来做负载均衡,之前有提过。

- 这里,我们可以看到他的就只方式

- “总连接数的八分之一 - 剩余的连接数“

- 总连接指每个进程设定的最大连接数,这个数字可以再配置文件中指定。

- 所以每个进程到总连接数的7/8后,ngx_accept_disabled就大于零,连接超载了

- */

- ngx_accept_disabled = ngx_cycle->connection_n / 8

- - ngx_cycle->free_connection_n;

- //获取一个connection

- c = ngx_get_connection(s, ev->log);

- //为新的链接创建起一个memory pool

- //连接关闭的时候,才释放pool

- c->pool = ngx_create_pool(ls->pool_size, ev->log);

- if (c->pool == NULL) {

- ngx_close_accepted_connection(c);

- return;

- }

- c->sockaddr = ngx_palloc(c->pool, socklen);

- if (c->sockaddr == NULL) {

- ngx_close_accepted_connection(c);

- return;

- }

- ngx_memcpy(c->sockaddr, sa, socklen);

- log = ngx_palloc(c->pool, sizeof(ngx_log_t));

- if (log == NULL) {

- ngx_close_accepted_connection(c);

- return;

- }

- /* set a blocking mode for aio and non-blocking mode for others */

- if (ngx_inherited_nonblocking) {

- if (ngx_event_flags & NGX_USE_AIO_EVENT) {

- if (ngx_blocking(s) == -1) {

- ngx_log_error(NGX_LOG_ALERT, ev->log, ngx_socket_errno,

- ngx_blocking_n " failed");

- ngx_close_accepted_connection(c);

- return;

- }

- }

- } else {

- //我们使用epoll模型,这里我们设置连接为nonblocking

- if (!(ngx_event_flags & (NGX_USE_AIO_EVENT|NGX_USE_RTSIG_EVENT))) {

- if (ngx_nonblocking(s) == -1) {

- ngx_log_error(NGX_LOG_ALERT, ev->log, ngx_socket_errno,

- ngx_nonblocking_n " failed");

- ngx_close_accepted_connection(c);

- return;

- }

- }

- }

- *log = ls->log;

- //初始化新的连接

- c->recv = ngx_recv;

- c->send = ngx_send;

- c->recv_chain = ngx_recv_chain;

- c->send_chain = ngx_send_chain;

- c->log = log;

- c->pool->log = log;

- c->socklen = socklen;

- c->listening = ls;

- c->local_sockaddr = ls->sockaddr;

- c->unexpected_eof = 1;

- #if (NGX_HAVE_UNIX_DOMAIN)

- if (c->sockaddr->sa_family == AF_UNIX) {

- c->tcp_nopush = NGX_TCP_NOPUSH_DISABLED;

- c->tcp_nodelay = NGX_TCP_NODELAY_DISABLED;

- #if (NGX_SOLARIS)

- /* Solaris's sendfilev() supports AF_NCA, AF_INET, and AF_INET6 */

- c->sendfile = 0;

- #endif

- }

- #endif

- rev = c->read;

- wev = c->write;

- wev->ready = 1;

- if (ngx_event_flags & (NGX_USE_AIO_EVENT|NGX_USE_RTSIG_EVENT)) {

- /* rtsig, aio, iocp */

- rev->ready = 1;

- }

- if (ev->deferred_accept) {

- rev->ready = 1;

- #if (NGX_HAVE_KQUEUE)

- rev->available = 1;

- #endif

- }

- rev->log = log;

- wev->log = log;

- /*

- * TODO: MT: - ngx_atomic_fetch_add()

- * or protection by critical section or light mutex

- *

- * TODO: MP: - allocated in a shared memory

- * - ngx_atomic_fetch_add()

- * or protection by critical section or light mutex

- */

- c->number = ngx_atomic_fetch_add(ngx_connection_counter, 1);

- if (ngx_add_conn && (ngx_event_flags & NGX_USE_EPOLL_EVENT) == 0) {

- if (ngx_add_conn(c) == NGX_ERROR) {

- ngx_close_accepted_connection(c);

- return;

- }

- }

- log->data = NULL;

- log->handler = NULL;

- /*

- 这里listen handler很重要,它将完成新连接的最后初始化工作,

- 同时将accept到的新的连接放入epoll中;挂在这个handler上的函数,

- 就是ngx_http_init_connection 在之后http模块中在详细介绍

- */

- ls->handler(c);

- if (ngx_event_flags & NGX_USE_KQUEUE_EVENT) {

- ev->available--;

- }

- } while (ev->available);

- }

accpt事件的handler方法也就是如此了。之后就是每个连接的读写事件handler方法,这一部分会直接将我们引入http模块,我们还不急,还要学习下nginx经典模块epoll。

以上就介绍了nginx 源码学习笔记(二十一)—— event 模块二 ——事件驱动核心ngx_process_events_and_timers,包括了队列方面的内容,希望对PHP教程有兴趣的朋友有所帮助。

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

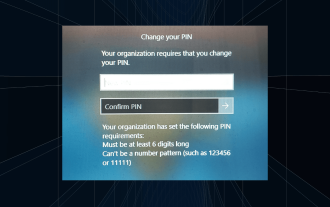

解决方法:您的组织要求您更改 PIN 码

Oct 04, 2023 pm 05:45 PM

解决方法:您的组织要求您更改 PIN 码

Oct 04, 2023 pm 05:45 PM

“你的组织要求你更改PIN消息”将显示在登录屏幕上。当在使用基于组织的帐户设置的电脑上达到PIN过期限制时,就会发生这种情况,在该电脑上,他们可以控制个人设备。但是,如果您使用个人帐户设置了Windows,则理想情况下不应显示错误消息。虽然情况并非总是如此。大多数遇到错误的用户使用个人帐户报告。为什么我的组织要求我在Windows11上更改我的PIN?可能是您的帐户与组织相关联,您的主要方法应该是验证这一点。联系域管理员会有所帮助!此外,配置错误的本地策略设置或不正确的注册表项也可能导致错误。即

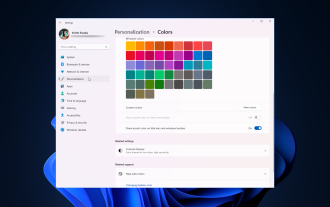

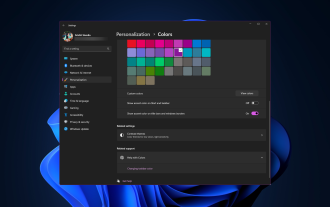

Windows 11 上调整窗口边框设置的方法:更改颜色和大小

Sep 22, 2023 am 11:37 AM

Windows 11 上调整窗口边框设置的方法:更改颜色和大小

Sep 22, 2023 am 11:37 AM

Windows11将清新优雅的设计带到了最前沿;现代界面允许您个性化和更改最精细的细节,例如窗口边框。在本指南中,我们将讨论分步说明,以帮助您在Windows操作系统中创建反映您的风格的环境。如何更改窗口边框设置?按+打开“设置”应用。WindowsI转到个性化,然后单击颜色设置。颜色更改窗口边框设置窗口11“宽度=”643“高度=”500“>找到在标题栏和窗口边框上显示强调色选项,然后切换它旁边的开关。若要在“开始”菜单和任务栏上显示主题色,请打开“在开始”菜单和任务栏上显示主题

如何在 Windows 11 上更改标题栏颜色?

Sep 14, 2023 pm 03:33 PM

如何在 Windows 11 上更改标题栏颜色?

Sep 14, 2023 pm 03:33 PM

默认情况下,Windows11上的标题栏颜色取决于您选择的深色/浅色主题。但是,您可以将其更改为所需的任何颜色。在本指南中,我们将讨论三种方法的分步说明,以更改它并个性化您的桌面体验,使其具有视觉吸引力。是否可以更改活动和非活动窗口的标题栏颜色?是的,您可以使用“设置”应用更改活动窗口的标题栏颜色,也可以使用注册表编辑器更改非活动窗口的标题栏颜色。若要了解这些步骤,请转到下一部分。如何在Windows11中更改标题栏的颜色?1.使用“设置”应用按+打开设置窗口。WindowsI前往“个性化”,然

Windows 11 上启用或禁用任务栏缩略图预览的方法

Sep 15, 2023 pm 03:57 PM

Windows 11 上启用或禁用任务栏缩略图预览的方法

Sep 15, 2023 pm 03:57 PM

任务栏缩略图可能很有趣,但它们也可能分散注意力或烦人。考虑到您将鼠标悬停在该区域的频率,您可能无意中关闭了重要窗口几次。另一个缺点是它使用更多的系统资源,因此,如果您一直在寻找一种提高资源效率的方法,我们将向您展示如何禁用它。不过,如果您的硬件规格可以处理它并且您喜欢预览版,则可以启用它。如何在Windows11中启用任务栏缩略图预览?1.使用“设置”应用点击键并单击设置。Windows单击系统,然后选择关于。点击高级系统设置。导航到“高级”选项卡,然后选择“性能”下的“设置”。在“视觉效果”选

OOBELANGUAGE错误Windows 11 / 10修复中出现问题的问题

Jul 16, 2023 pm 03:29 PM

OOBELANGUAGE错误Windows 11 / 10修复中出现问题的问题

Jul 16, 2023 pm 03:29 PM

您是否在Windows安装程序页面上看到“出现问题”以及“OOBELANGUAGE”语句?Windows的安装有时会因此类错误而停止。OOBE表示开箱即用的体验。正如错误提示所表示的那样,这是与OOBE语言选择相关的问题。没有什么可担心的,你可以通过OOBE屏幕本身的漂亮注册表编辑来解决这个问题。快速修复–1.单击OOBE应用底部的“重试”按钮。这将继续进行该过程,而不会再打嗝。2.使用电源按钮强制关闭系统。系统重新启动后,OOBE应继续。3.断开系统与互联网的连接。在脱机模式下完成OOBE的所

Windows 11 上的显示缩放比例调整指南

Sep 19, 2023 pm 06:45 PM

Windows 11 上的显示缩放比例调整指南

Sep 19, 2023 pm 06:45 PM

在Windows11上的显示缩放方面,我们都有不同的偏好。有些人喜欢大图标,有些人喜欢小图标。但是,我们都同意拥有正确的缩放比例很重要。字体缩放不良或图像过度缩放可能是工作时真正的生产力杀手,因此您需要知道如何对其进行自定义以充分利用系统功能。自定义缩放的优点:对于难以阅读屏幕上的文本的人来说,这是一个有用的功能。它可以帮助您一次在屏幕上查看更多内容。您可以创建仅适用于某些监视器和应用程序的自定义扩展配置文件。可以帮助提高低端硬件的性能。它使您可以更好地控制屏幕上的内容。如何在Windows11

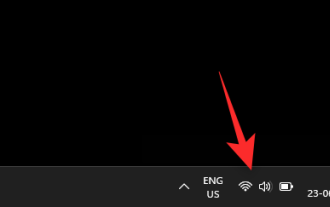

10种在 Windows 11 上调整亮度的方法

Dec 18, 2023 pm 02:21 PM

10种在 Windows 11 上调整亮度的方法

Dec 18, 2023 pm 02:21 PM

屏幕亮度是使用现代计算设备不可或缺的一部分,尤其是当您长时间注视屏幕时。它可以帮助您减轻眼睛疲劳,提高易读性,并轻松有效地查看内容。但是,根据您的设置,有时很难管理亮度,尤其是在具有新UI更改的Windows11上。如果您在调整亮度时遇到问题,以下是在Windows11上管理亮度的所有方法。如何在Windows11上更改亮度[10种方式解释]单显示器用户可以使用以下方法在Windows11上调整亮度。这包括使用单个显示器的台式机系统以及笔记本电脑。让我们开始吧。方法1:使用操作中心操作中心是访问

华为GT3 Pro和GT4的差异是什么?

Dec 29, 2023 pm 02:27 PM

华为GT3 Pro和GT4的差异是什么?

Dec 29, 2023 pm 02:27 PM

许多用户在选择智能手表的时候都会选择的华为的品牌,其中华为GT3pro和GT4都是非常热门的选择,不少用户都很好奇华为GT3pro和GT4有什么区别,下面就就给大家介绍一下二者。华为GT3pro和GT4有什么区别一、外观GT4:46mm和41mm,材质是玻璃表镜+不锈钢机身+高分纤维后壳。GT3pro:46.6mm和42.9mm,材质是蓝宝石玻璃表镜+钛金属机身/陶瓷机身+陶瓷后壳二、健康GT4:采用最新的华为Truseen5.5+算法,结果会更加的精准。GT3pro:多了ECG心电图和血管及安