PHP爬虫技术知识点总结

在的爬虫框架很多,比较流行的是基于python,nodejs,java,C#,PHP的的框架,其中又以基于python的爬虫流行最为广泛,还有的已经是一套傻瓜式的软件操作,如八爪鱼,火车头等软件。

今天我们首先尝试的是使用PHP实现一个爬虫程序,首先在不使用爬虫框架的基础上实践也是为了理解爬虫的原理,然后再利用PHP的lib,框架和扩展进行实践。

1.PHP简单的爬虫–原型

爬虫的原理:

给定原始的url;

分析链接,根据设置的正则表达式获取链接中的内容;

有的会更新原始的url再进行分析链接,获取特定内容,周而复始。

将获取的内容保存在数据库中(mysql)或者本地文件中

下面是网上一个例子,我们列下来然后分析

从<span style="margin:0px;padding:0px;max-width:100%;font-size:15px;">main</span>函数开始

<?php/** * 爬虫程序 -- 原型 * 从给定的url获取html内容 * @param string $url * @return string */function _getUrlContent($url) { $handle = fopen($url, "r");

if ($handle) {

$content = stream_get_contents($handle, -1);

//读取资源流到一个字符串,第二个参数需要读取的最大的字节数。默认是-1(读取全部的缓冲数据) // $content = file_get_contents($url, 1024 * 1024); return $content; } else {

return false; } } /** * 从html内容中筛选链接 * @param string $web_content * @return array */function _filterUrl($web_content) { $reg_tag_a = '/<[a|A].*?href=[\'\"]{0,1}([^>\'\"\ ]*).*?>/';

$result = preg_match_all($reg_tag_a, $web_content, $match_result);

if ($result) {

return $match_result[1]; } } /** * 修正相对路径 * @param string $base_url * @param array $url_list * @return array */function _reviseUrl($base_url, $url_list) { $url_info = parse_url($base_url);//解析url $base_url = $url_info["scheme"] . '://';

if ($url_info["user"] && $url_info["pass"]) {

$base_url .= $url_info["user"] . ":" . $url_info["pass"] . "@"; } $base_url .= $url_info["host"];

if ($url_info["port"]) {

$base_url .= ":" . $url_info["port"]; } $base_url .= $url_info["path"];

if (is_array($url_list)) {

foreach ($url_list as $url_item) {

if (preg_match('/^http/', $url_item)) {

// 已经是完整的url $result[] = $url_item; } else { // 不完整的url

$real_url = $base_url . '/' . $url_item;

$result[] = $real_url; } } return $result; } else {

return; } } /** * 爬虫 * @param string $url * @return array */function crawler($url) { $content = _getUrlContent($url);

if ($content) {

$url_list = _reviseUrl($url, _filterUrl($content));

if ($url_list) {

return $url_list; } else {

return ; } } else {

return ; } } /** * 测试用主程序 */function main() { $file_path = "url-01.txt";

$current_url = "http://www.baidu.com/"; //初始url if(file_exists($file_path)){ unlink($file_path); }

$fp_puts = fopen($file_path, "ab"); //记录url列表 $fp_gets = fopen($file_path, "r"); //保存url列表 do {

$result_url_arr = crawler($current_url);

if ($result_url_arr) {

foreach ($result_url_arr as $url) { fputs($fp_puts, $url . "\r\n"); } } }

while ($current_url = fgets($fp_gets, 1024)); //不断获得url} main();?>2.使用crul lib

Curl是比较成熟的一个lib,异常处理、http header、POST之类都做得很好,重要的是PHP下操作MySQL进行入库操作比较省心。关于curl的说明具体可以查看PHP官方文档,不过在多线程Curl(Curl_multi)方面比较麻烦。

开启crul

针对winow系统:

- php.in中修改(注释;去掉即可)

extension=php_curl.dll

php文件夹下的libeay32.dll, ssleay32.dll, libssh2.dll 还有 php/ext下的php_curl4个文件移入windows/system32

使用crul爬虫的步骤:

- 使用cURL函数的基本思想是先使用curl_init()初始化一个cURL会话;

- 接着你可以通过curl_setopt()设置你需要的全部选项;

- 然后使用curl_exec()来执行会话;

- 当执行完会话后使用curl_close()关闭会话。

例子

$ch = curl_init("http://www.example.com/");

$fp = fopen("example_homepage.txt", "w");curl_setopt($ch, CURLOPT_FILE, $fp);curl_setopt($ch, CURLOPT_HEADER, 0);curl_exec($ch);curl_close($ch);fclose($fp);?>

一个完整点的例子:

<?php/** * 将demo1-01换成curl爬虫 * 爬虫程序 -- 原型 * 从给定的url获取html内容 * @param string $url * @return string */function _getUrlContent($url) { $ch=curl_init(); //初始化一个cURL会话 /*curl_setopt 设置一个cURL传输选项*/ //设置需要获取的 URL 地址 curl_setopt($ch,CURLOPT_URL,$url);

curl_setopt($ch, CURLOPT_RETURNTRANSFER, 1); curl_setopt($ch,CURLOPT_HEADER,1); // 设置浏览器的特定header curl_setopt($ch, CURLOPT_HTTPHEADER,

array(

"Host: www.baidu.com",

"Connection: keep-alive",

"Accept: text/html,

application/xhtml+xml,application/xml;q=0.9,*/*;q=0.8",

"Upgrade-Insecure-Requests: 1",

"DNT:1",

"Accept-Language: zh-CN,zh;q=0.8,en-GB;q=0.6,en;q=0.4,en-US;q=0.2",

));

$result=curl_exec($ch);//执行一个cURL会话 $code=curl_getinfo($ch,CURLINFO_HTTP_CODE);// 最后一个收到的HTTP代码 if($code!='404' && $result){

return $result; } curl_close($ch);//关闭cURL} /** * 从html内容中筛选链接 * @param string $web_content * @return array */function _filterUrl($web_content) { $reg_tag_a = '/<[a|A].*?href=[\'\"]{0,1}([^>\'\"\ ]*).*?>/';

$result = preg_match_all($reg_tag_a, $web_content, $match_result);

if ($result) {

return $match_result[1]; } } /** * 修正相对路径 * @param string $base_url * @param array $url_list * @return array */function _reviseUrl($base_url, $url_list) { $url_info = parse_url($base_url);//解析url $base_url = $url_info["scheme"] . '://';

if ($url_info["user"] && $url_info["pass"]) {

$base_url .= $url_info["user"] . ":" . $url_info["pass"] . "@"; } $base_url .= $url_info["host"];

if ($url_info["port"]) {

$base_url .= ":" . $url_info["port"]; } $base_url .= $url_info["path"];

if (is_array($url_list)) {

foreach ($url_list as $url_item) {

if (preg_match('/^http/', $url_item)) {

// 已经是完整的url $result[] = $url_item; } else {

// 不完整的url $real_url = $base_url . '/' . $url_item;

$result[] = $real_url; } } return $result; } else {

return; } } /** * 爬虫 * @param string $url * @return array */function crawler($url) { $content = _getUrlContent($url);

if ($content) {

$url_list = _reviseUrl($url, _filterUrl($content));

if ($url_list) {

return $url_list; } else {

return ; } } else {

return ; } } /** * 测试用主程序 */function main() { $file_path = "./url-03.txt";

if(file_exists($file_path)){ unlink($file_path); } $current_url = "http://www.baidu.com"; //初始url //记录url列表 ab- 追加打开一个二进制文件,并在文件末尾写数据 $fp_puts = fopen($file_path, "ab"); //保存url列表 r-只读方式打开,将文件指针指向文件头 $fp_gets = fopen($file_path, "r"); do {

$result_url_arr = crawler($current_url);

echo "<p>$current_url</p>";

if ($result_url_arr) {

foreach ($result_url_arr as $url) { fputs($fp_puts, $url . "\r\n"); } } } while ($current_url = fgets($fp_gets, 1024)); //不断获得url} main();?>要对https支持,需要在_getUrlContent函数中加入下面的设置:

curl_setopt($ch, CURLOPT_HTTPAUTH, CURLAUTH_BASIC ) ; curl_setopt($ch, CURLOPT_USERPWD, "username:password"); curl_setopt($ch, CURLOPT_SSLVERSION,3); curl_setopt($ch, CURLOPT_SSL_VERIFYPEER, FALSE); curl_setopt($ch, CURLOPT_SSL_VERIFYHOST, 2);

结果疑惑:

我们通过1和2部分得到的结果差异很大,第1部分能得到四千多条url数据,而第2部分却一直是45条数据。

还有我们获得url数据可能会有重复的,这部分处理在我的github上,对应demo2-01.php,或者demo2-02.php

3.file_get_contents/stream_get_contents与curl对比

3.1 file_get_contents/stream_get_contents对比

stream_get_contents — 读取资源流到一个字符串

与 [file_get_contents()]一样,但是 stream_get_contents() 是对一个已经打开的资源流进行操作,并将其内容写入一个字符串返回

$handle = fopen($url, "r");

$content = stream_get_contents($handle, -1);

//读取资源流到一个字符串,第二个参数需要读取的最大的字节数。默认是-1(读取全部的缓冲数据)

file_get_contents — 将整个文件读入一个字符串

<code style="margin:0px;padding:0px;max-width:100%;font-family:Consolas, Inconsolata, Courier, monospace;white-space:pre;"><span style="color:#4f4f4f;margin:0px;padding:0px;max-width:100%;">$content</span> = file_get_contents(<span style="color:#4f4f4f;margin:0px;padding:0px;max-width:100%;">$url</span>, <span style="margin:0px;padding:0px;max-width:100%;">1024</span> * <span style="margin:0px;padding:0px;max-width:100%;">1024</span>);<br/><span style="font-family:'PingFang SC', 'Microsoft YaHei', SimHei, Arial, SimSun;color:#999999;margin:0px;padding:0px;max-width:100%;text-align:justify;background-color:rgb(238,240,244);">【注】 如果要打开有特殊字符的 URL (比如说有空格),就需要使用进行 URL 编码。</span></code>

3.2 file_get_contents/stream_get_contents与curl对比

- fopen /file_get_contents 每次请求都会重新做DNS查询,并不对 DNS信息进行缓存。但是CURL会自动对DNS信息进行缓存。对同一域名下的网页或者图片的请求只需要一次DNS查询。这大大减少了DNS查询的次数。所以CURL的性能比fopen /file_get_contents 好很多。

fopen /file_get_contents 在请求HTTP时,使用的是http_fopen_wrapper,不会keeplive。而curl却可以。这样在多次请求多个链接时,curl效率会好一些。

fopen / file_get_contents 函数会受到php.ini文件中allow_url_open选项配置的影响。如果该配置关闭了,则该函数也就失效了。而curl不受该配置的影响。

curl 可以模拟多种请求,例如:POST数据,表单提交等,用户可以按照自己的需求来定制请求。而fopen / file_get_contents只能使用get方式获取数据

相关推荐:

以上是PHP爬虫技术知识点总结的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

适用于 Ubuntu 和 Debian 的 PHP 8.4 安装和升级指南

Dec 24, 2024 pm 04:42 PM

适用于 Ubuntu 和 Debian 的 PHP 8.4 安装和升级指南

Dec 24, 2024 pm 04:42 PM

PHP 8.4 带来了多项新功能、安全性改进和性能改进,同时弃用和删除了大量功能。 本指南介绍了如何在 Ubuntu、Debian 或其衍生版本上安装 PHP 8.4 或升级到 PHP 8.4

如何设置 Visual Studio Code (VS Code) 进行 PHP 开发

Dec 20, 2024 am 11:31 AM

如何设置 Visual Studio Code (VS Code) 进行 PHP 开发

Dec 20, 2024 am 11:31 AM

Visual Studio Code,也称为 VS Code,是一个免费的源代码编辑器 - 或集成开发环境 (IDE) - 可用于所有主要操作系统。 VS Code 拥有针对多种编程语言的大量扩展,可以轻松编写

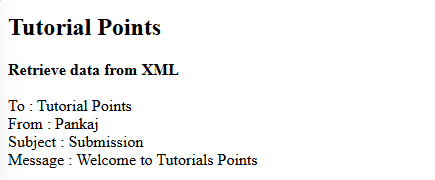

您如何在PHP中解析和处理HTML/XML?

Feb 07, 2025 am 11:57 AM

您如何在PHP中解析和处理HTML/XML?

Feb 07, 2025 am 11:57 AM

本教程演示了如何使用PHP有效地处理XML文档。 XML(可扩展的标记语言)是一种用于人类可读性和机器解析的多功能文本标记语言。它通常用于数据存储

我后悔之前不知道的 7 个 PHP 函数

Nov 13, 2024 am 09:42 AM

我后悔之前不知道的 7 个 PHP 函数

Nov 13, 2024 am 09:42 AM

如果您是一位经验丰富的 PHP 开发人员,您可能会感觉您已经在那里并且已经完成了。您已经开发了大量的应用程序,调试了数百万行代码,并调整了一堆脚本来实现操作

在PHP API中说明JSON Web令牌(JWT)及其用例。

Apr 05, 2025 am 12:04 AM

在PHP API中说明JSON Web令牌(JWT)及其用例。

Apr 05, 2025 am 12:04 AM

JWT是一种基于JSON的开放标准,用于在各方之间安全地传输信息,主要用于身份验证和信息交换。1.JWT由Header、Payload和Signature三部分组成。2.JWT的工作原理包括生成JWT、验证JWT和解析Payload三个步骤。3.在PHP中使用JWT进行身份验证时,可以生成和验证JWT,并在高级用法中包含用户角色和权限信息。4.常见错误包括签名验证失败、令牌过期和Payload过大,调试技巧包括使用调试工具和日志记录。5.性能优化和最佳实践包括使用合适的签名算法、合理设置有效期、

php程序在字符串中计数元音

Feb 07, 2025 pm 12:12 PM

php程序在字符串中计数元音

Feb 07, 2025 pm 12:12 PM

字符串是由字符组成的序列,包括字母、数字和符号。本教程将学习如何使用不同的方法在PHP中计算给定字符串中元音的数量。英语中的元音是a、e、i、o、u,它们可以是大写或小写。 什么是元音? 元音是代表特定语音的字母字符。英语中共有五个元音,包括大写和小写: a, e, i, o, u 示例 1 输入:字符串 = "Tutorialspoint" 输出:6 解释 字符串 "Tutorialspoint" 中的元音是 u、o、i、a、o、i。总共有 6 个元

解释PHP中的晚期静态绑定(静态::)。

Apr 03, 2025 am 12:04 AM

解释PHP中的晚期静态绑定(静态::)。

Apr 03, 2025 am 12:04 AM

静态绑定(static::)在PHP中实现晚期静态绑定(LSB),允许在静态上下文中引用调用类而非定义类。1)解析过程在运行时进行,2)在继承关系中向上查找调用类,3)可能带来性能开销。

什么是PHP魔术方法(__ -construct,__destruct,__call,__get,__ set等)并提供用例?

Apr 03, 2025 am 12:03 AM

什么是PHP魔术方法(__ -construct,__destruct,__call,__get,__ set等)并提供用例?

Apr 03, 2025 am 12:03 AM

PHP的魔法方法有哪些?PHP的魔法方法包括:1.\_\_construct,用于初始化对象;2.\_\_destruct,用于清理资源;3.\_\_call,处理不存在的方法调用;4.\_\_get,实现动态属性访问;5.\_\_set,实现动态属性设置。这些方法在特定情况下自动调用,提升代码的灵活性和效率。