Python爬虫之Anaconda环境下创建Scrapy爬虫框架

在Anaconda环境下如何创建Scrapy 爬虫框架?本篇文章将给大家介绍关于Anaconda环境下创建Scrapy爬虫框架项目的步骤,值得一看。

Python爬虫教程-31-创建 Scrapy 爬虫框架项目

首先说一下,本篇是在 Anaconda 环境下,所以如果没有安装 Anaconda 请先到官网下载安装

Anaconda 下载地址:https://www.anaconda.com/download/

Scrapy 爬虫框架项目的创建

0.打开【cmd】

1.进入你要使用的 Anaconda 环境

这里我们就把项目创建好了,分析一下自动生成的文件的作用

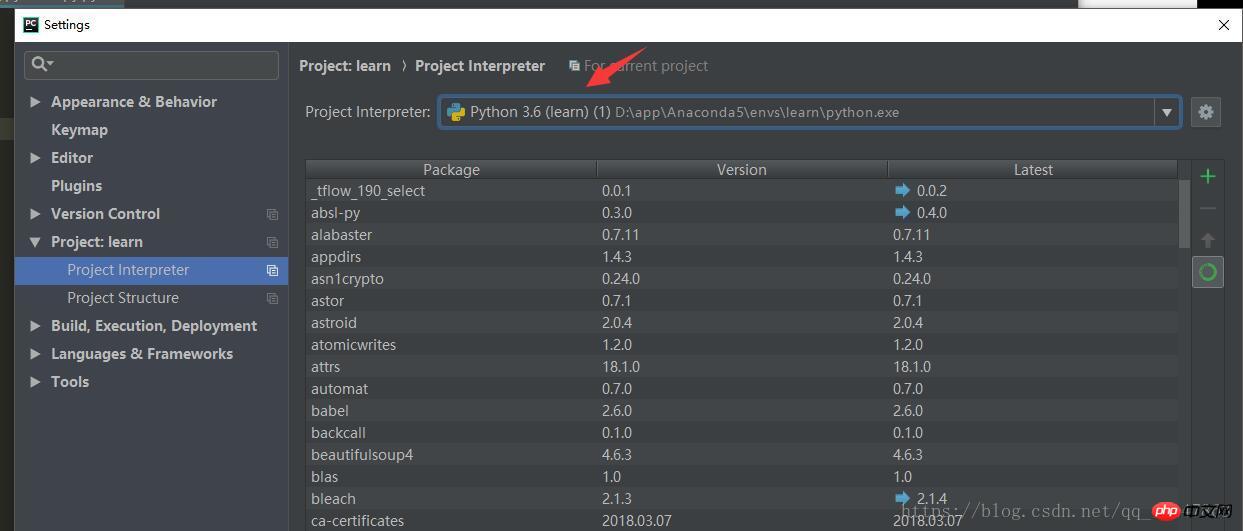

1.环境名可以在【Pycharm】的【Settings】下【Project:】下找到

2.使用命令:activate 环境名,例如:

activate learn

3.进入想要存放 scrapy 项目的目录下 【注意】

4.新建项目:scrapy startproject xxx项目名,例如:

scrapy startproject new_project

5.操作截图:

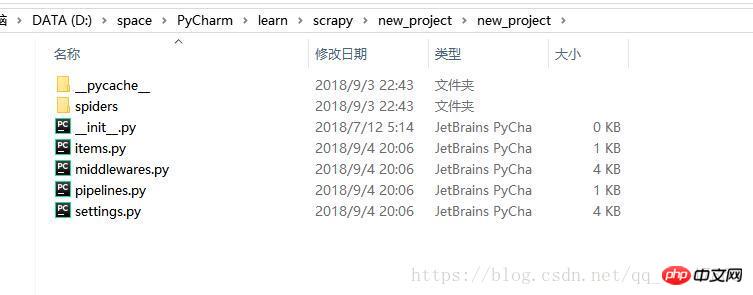

6.在文件资源管理器打开该目录,就会发现生成了好几个文件

7.使用 Pycharm 打开项目所在目录就可以了

Scrapy 爬虫框架项目的开发

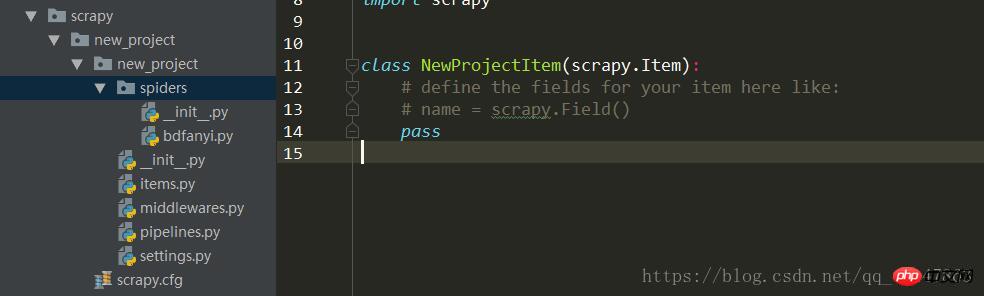

0.使用 Pycharm 打开项目,截图:

项目的开发的大致流程:

地址 spider/xxspider.py 负责分解,提取下载的数据

1.明确需要爬取的目标/产品:编写 item.py

2.在 spider 目录下载创建 python 文件制作爬虫:

3.存储内容:pipelines.py

Pipeline.py 文件

当 spider 对象被关闭的时候调用

spider 对象对开启的时候调用

进行一些必要的参数初始化

spider 提取出来的 item 作为参数传入,同时传入的还有 spider

此方法必须实现

必须返回一个 Item 对象,被丢弃的 item 不会被之后的 pipeline

对应 pipelines 文件

爬虫提取出数据存入 item 后,item 中保存的数据需要进一步处理,比如清洗,去虫,存储等

Pipeline 需要处理 process_item 函数

process_item

_ init _:构造函数

open_spider(spider):

close_spider(spider):

Spider 目录

对应的是文件夹 spider 下的文件

_ init _:初始化爬虫名称,start _urls 列表

start_requests:生成 Requests 对象交给 Scrapy 下载并返回 response

parse:根据返回的 response 解析出相应的 item,item 自动进入 pipeline:如果需要,解析 url,url自动交给 requests 模块,一直循环下去

start_requests:此方法尽能被调用一次,读取 start _urls 内容并启动循环过程

name:设置爬虫名称

start_urls:设置开始第一批爬取的 url

allow_domains:spider 允许去爬的域名列表

start_request(self):只被调用一次

parse:检测编码

log:日志记录

相关推荐:

以上是Python爬虫之Anaconda环境下创建Scrapy爬虫框架的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

如何解决Linux终端中查看Python版本时遇到的权限问题?

Apr 01, 2025 pm 05:09 PM

如何解决Linux终端中查看Python版本时遇到的权限问题?

Apr 01, 2025 pm 05:09 PM

Linux终端中查看Python版本时遇到权限问题的解决方法当你在Linux终端中尝试查看Python的版本时,输入python...

如何在使用 Fiddler Everywhere 进行中间人读取时避免被浏览器检测到?

Apr 02, 2025 am 07:15 AM

如何在使用 Fiddler Everywhere 进行中间人读取时避免被浏览器检测到?

Apr 02, 2025 am 07:15 AM

使用FiddlerEverywhere进行中间人读取时如何避免被检测到当你使用FiddlerEverywhere...

如何在10小时内通过项目和问题驱动的方式教计算机小白编程基础?

Apr 02, 2025 am 07:18 AM

如何在10小时内通过项目和问题驱动的方式教计算机小白编程基础?

Apr 02, 2025 am 07:18 AM

如何在10小时内教计算机小白编程基础?如果你只有10个小时来教计算机小白一些编程知识,你会选择教些什么�...

在Python中如何高效地将一个DataFrame的整列复制到另一个结构不同的DataFrame中?

Apr 01, 2025 pm 11:15 PM

在Python中如何高效地将一个DataFrame的整列复制到另一个结构不同的DataFrame中?

Apr 01, 2025 pm 11:15 PM

在使用Python的pandas库时,如何在两个结构不同的DataFrame之间进行整列复制是一个常见的问题。假设我们有两个Dat...

Uvicorn是如何在没有serve_forever()的情况下持续监听HTTP请求的?

Apr 01, 2025 pm 10:51 PM

Uvicorn是如何在没有serve_forever()的情况下持续监听HTTP请求的?

Apr 01, 2025 pm 10:51 PM

Uvicorn是如何持续监听HTTP请求的?Uvicorn是一个基于ASGI的轻量级Web服务器,其核心功能之一便是监听HTTP请求并进�...

如何绕过Investing.com的反爬虫机制获取新闻数据?

Apr 02, 2025 am 07:03 AM

如何绕过Investing.com的反爬虫机制获取新闻数据?

Apr 02, 2025 am 07:03 AM

攻克Investing.com的反爬虫策略许多人尝试爬取Investing.com(https://cn.investing.com/news/latest-news)的新闻数据时,常常�...