当GPT-4学会看图文,一场生产力革命已势不可挡

来自学界和业界的多位研究者围绕「 图文智能处理技术与多场景应用技术」展开了深入探讨,

「太卷了!」

在经历了 GPT-4 和微软 Microsoft 365 Copilot 的连续轰炸后,相信很多人都有这样的感想。

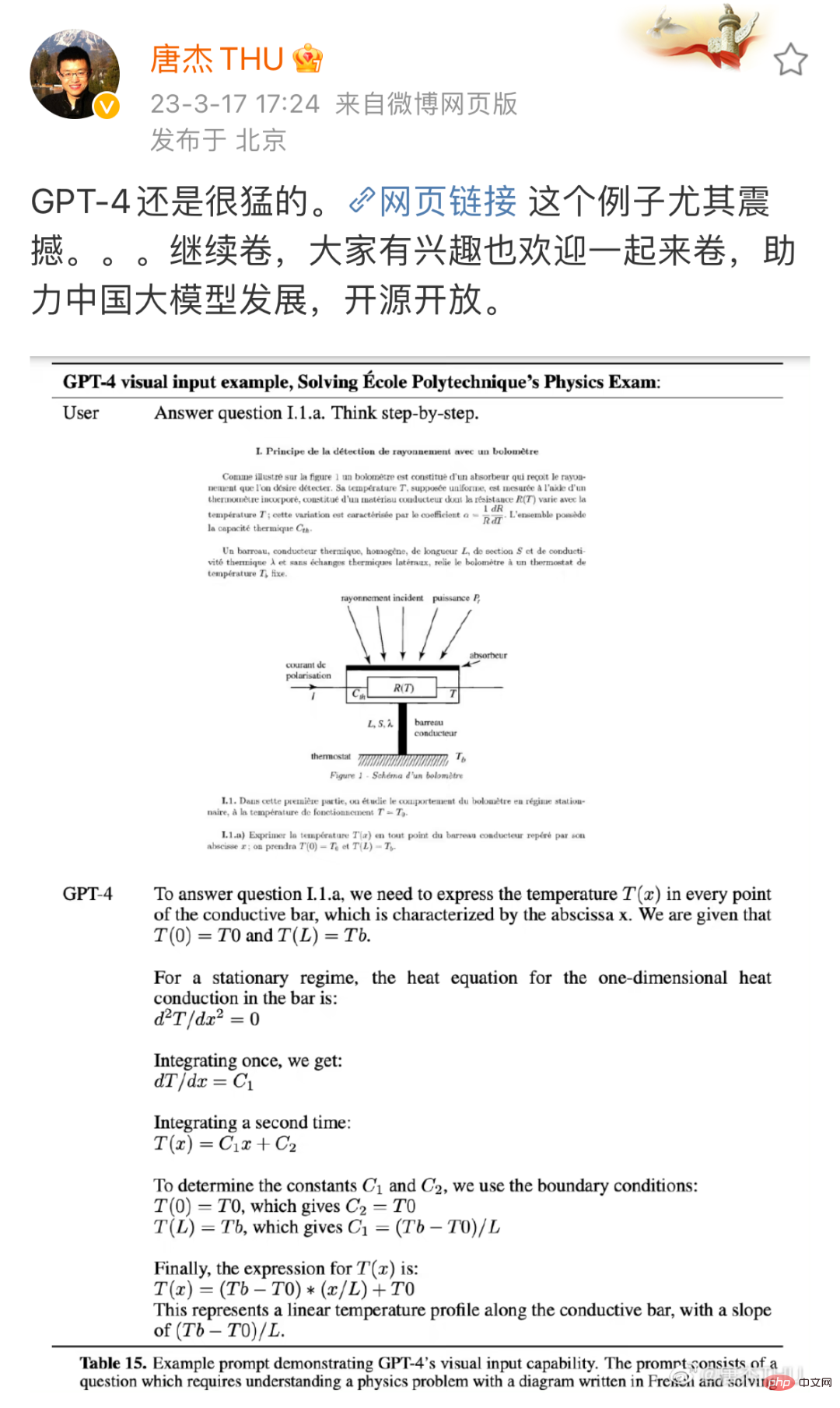

与 GPT-3.5 相比,GPT-4 在很多方面都实现了大幅提升,比如在模拟律师考试中,它从原来的倒数 10% 进化到了正数 10%。当然,普通人对于这些专业考试可能没什么概念。但如果给你看一张图,你就明白它的提升有多么恐怖了:

图源:清华大学计算机系教授唐杰微博。链接:https://m.weibo.cn/detail/4880331053992765

这是一道物理题,GPT-4 被要求根据图文逐步解题,这是 GPT-3.5(此处指升级之前的 ChatGPT 所依赖的模型)所不具备的能力。一方面,GPT-3.5 只被训练用来理解文字,题中的图它是看不懂的。另一方面,GPT-3.5 的解题能力也很薄弱,鸡兔同笼都能把它难倒。但这一次,两个问题似乎都被解决得非常漂亮。

当所有人都以为这就是王炸的时候,微软又放出了一个重磅炸弹:GPT-4 这些能力已经被整合到一个名为 Microsoft 365 Copilot 的新应用中。凭借强大的图文处理能力,Microsoft 365 Copilot 不仅可以帮你写各种文档,还能轻松地将文档转换成 PPT、将 Excel 数据自动总结成图表……

从技术亮相到产品落地,OpenAI 和微软只给了大众两天的反应时间。似乎在一夜之间,一场新的生产力革命已经到来。

由于变革来得太快,学界和业界都或多或少地处于一种迷茫和「FOMO(fear of missing out,怕错过)」的状态。当前,所有人都想知道一个答案:在这场浪潮中,我们能做些什么?有哪些机会可以抓住?而从微软发布的 demo 中,我们可以找到一个清晰的突破口:图文智能处理。

在现实场景中,各行各业的很多工作都和图文处理有关系,比如把非结构化数据整理成图表、根据图表写报告、从海量的图文信息中抽取出有用信息等等。也正因如此,这场革命的影响可能远比很多人想象得还要深远。OpenAI 和沃顿商学院最近发布的一篇重磅论文对这种影响做了预测:约 80% 的美国劳动力至少有 10% 的工作任务可能会受到 GPT 引入的影响,而约 19% 的工人可能会看到至少 50% 的任务受到影响。可以预见,这里面很大一部分工作是涉及图文智能的。

在这样一个切入点上,哪些研究工作或工程努力是值得探索的呢?在近期中国图象图形学学会(CSIG)主办,合合信息、CSIG 文档图像分析与识别专业委员会联合承办的 CSIG 企业行活动中,来自学界和业界的多位研究者围绕「 图文智能处理技术与多场景应用技术」展开了深入探讨,或许能给关注图文智能处理领域的研究者、从业者提供一些启发。

处理图文,从做好底层视觉开始

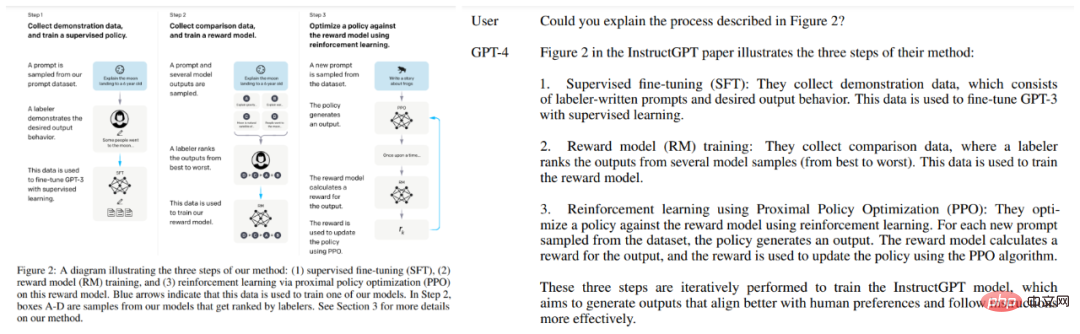

前面提到,GPT-4 的图文处理能力是非常令人震撼的。除了上面那个物理题,OpenAI 的技术报告里还举了其他例子,比如让 GPT-4 读论文图:

不过,要想让这样的技术广泛落地,可能还有很多基础工作要做,底层视觉便是其中之一。

底层视觉的特征非常明显:输入是图像,输出也是图像。图像预处理、滤波、恢复和增强等都属于这一范畴。

「底层视觉的理论和方法在众多领域都有着广泛的应用,如手机、医疗图像分析、安防监控等。重视图像、视频内容质量的企业、机构不能不关注底层视觉方向的研究。如果底层视觉没做好,很多 high-level 视觉系统(如检测、识别、理解)无法真正落地。」合合信息图像算法研发总监郭丰俊在 CSIG 企业行活动分享中表示。

这句话要怎么理解?我们可以看一些例子:

和 OpenAI、微软 demo 中所展示的理想情况不同,现实世界的图文总是以充满挑战的形式存在,比如存在形变、阴影、摩尔纹,这会加大后续识别、理解等工作的难度。郭丰俊团队的目标就是在初始阶段把这些问题解决好。

为此,他们将这项任务分成了几个模块,包括感兴趣区域(RoI)的提取、形变矫正、图像恢复(如去除阴影、摩尔纹)、质量增强(如增强锐化、清晰度)等。

这些技术组合起来可以打造一些非常有意思的应用。经过多年的摸索,这些模块已经实现了相当不错的效果,相关技术已被应用于公司旗下的智能文字识别产品「扫描全能王」里。

从字到表,再到篇章,一步步读懂图文

图像处理好之后,接下来的工作就是识别上面的图文内容。这也是一个非常细致的工作,甚至可能以「字」为单位。

在很多现实场景中,字不一定会以规范的印刷体的形式出现,这就给字的识别带来了挑战。

以教育场景为例。假设你是一位老师,你肯定想让 AI 直接帮你把学生作业全部批改好,同时把学生对各部分知识的掌握情况汇总一下,最好还能把错题、错别字及改正建议给出来。中国科学技术大学语音及语言信息处理国家工程实验室副教授杜俊就在做这方面的工作。

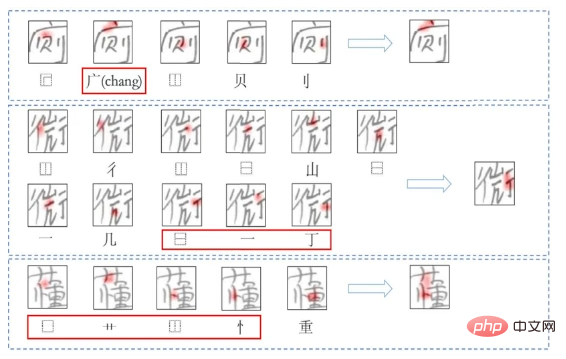

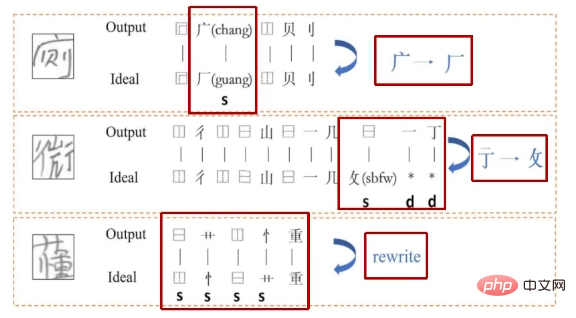

具体来说,他们创建了一套基于部首的汉字识别、生成与评测系统,因为与整字建模相比,部首的组合要少得多。其中,识别与生成是联合优化的,这有点像学生学习时识字与写字互相强化的过程。评测的工作以往大多聚焦在语法层面,而杜俊的团队设计了一种可以直接从图像中找出错别字并详细说明错误之处的方法。这种方法在智能阅卷等场景中将非常有用。

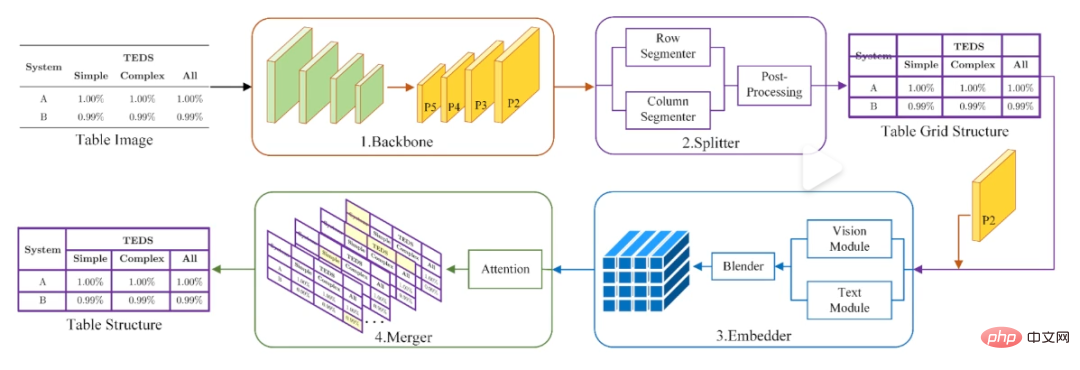

文字之外,表格的识别与处理其实也是一大难点,因为你不仅要识别里面的内容,还要理清这些内容之间的结构关系,而且有些表可能连线框都没有。为此,杜俊团队设计了一种「先分割,后合并」的方法,即先把表格图像拆分成一系列基础网格,然后再通过合并的方式做进一步纠正。

杜俊团队「先分割,后合并」的表格识别方法。

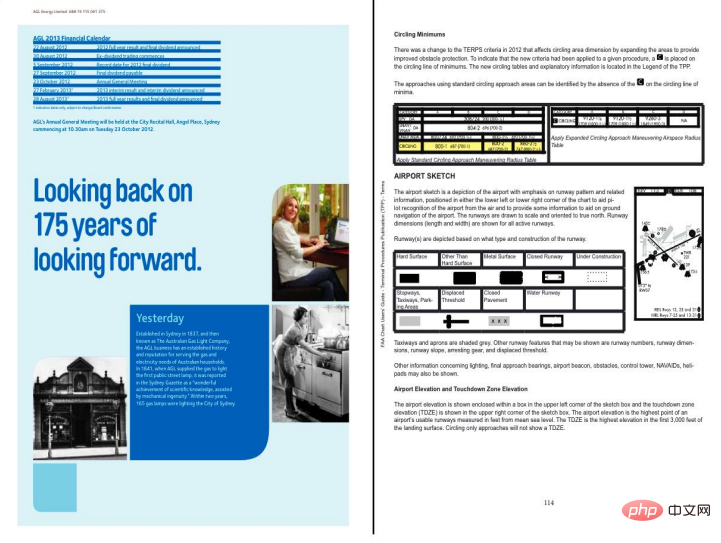

当然,所有这些工作最后都会在篇章级别的文档结构化和理解方面发挥作用。在现实环境中,模型所面临的文档大多不止一页(比如一篇论文)。在这一方向,杜俊团队的工作聚焦于跨页文档要素分类、跨页文档结构恢复等。不过,这些方法在多版式的场景下还存在局限性。

大模型、多模态、世界模型…… 未来路在何方?

聊到篇章级别的图文处理与理解,其实我们离 GPT-4 就不远了。「多模态的 GPT-4 出来后,我们也在想能不能在这些方面做些事情」,杜俊在活动现场说到。相信很多图文处理领域的研究者或从业者都有此想法。

一直以来,GPT 系列模型的目标都是努力提高通用性,最终实现通用人工智能(AGI)。此次 GPT-4 所展现出的强大的图文理解能力是这种通用能力的重要组成部分。要想做出一个拥有类似能力的模型,OpenAI 给出了一些借鉴,也留下了不少谜团和未解决的问题。

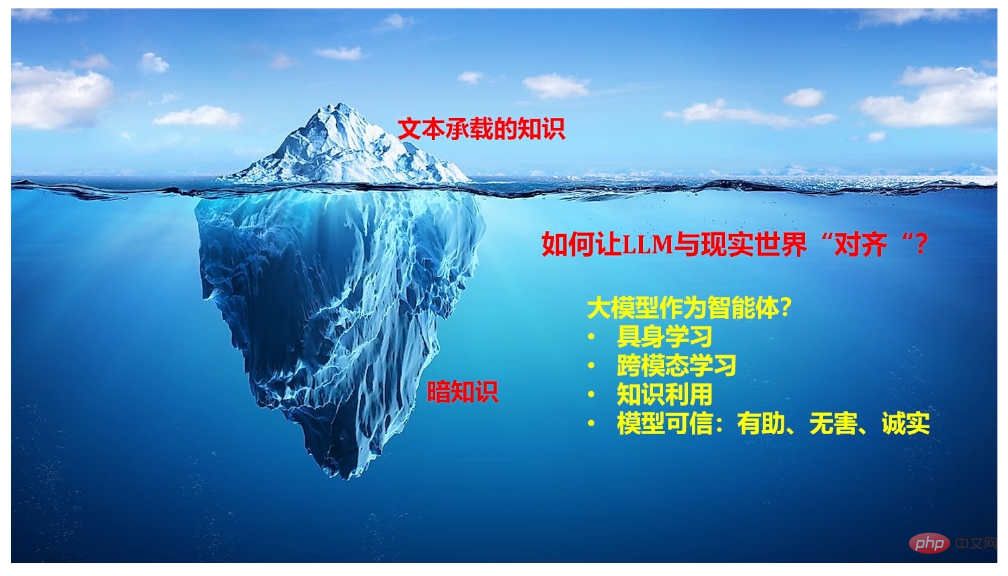

首先,GPT-4 的成功表明,大模型 + 多模态的做法是可行的。但大模型要研究哪些问题,多模态的夸张算力需求如何解决都是摆在研究者眼前的挑战。

对于第一个问题,复旦大学计算机学院教授邱锡鹏给出了一些值得参考的方向。根据 OpenAI 之前透露的一些信息,我们知道 ChatGPT 离不开几项关键技术,包括情景学习(in-context learning)、思维链(chain of thought)和指令学习(learn from instructions)等。邱锡鹏在分享中指出,这几个方向都还有很多待探讨的问题,比如这些能力从哪里来、如何继续提高、如何利用它们去改造已有的学习范式等。此外,他还分享了对话式大型语言模型构建时应该考虑的能力以及将这些模型与现实世界对齐可以考虑的研究方向。

对于第二个问题,厦门大学南强特聘教授纪荣嵘贡献了一个重要思路。他认为,语言和视觉存在着天然的联系,二者的联合学习已经是大势所趋。但面对这波浪潮,任何一个高校或实验室的力量都显得微不足道。所以他现在从自己就职的厦大开始,尝试说服研究人员将算力整合起来,形成一个网络去做多模态大模型。其实,在前段时间的一个活动上,专注于 AI for Science 的鄂维南院士也发表了类似看法,希望各界「敢于在原始创新方向上集中资源」。

不过,GPT-4 所走的路就一定会通向通用人工智能吗?对此,有些研究者是存疑的,图灵奖得主 Yann LeCun 便是其中之一。他认为,当前的这些大模型对于数据、算力的需求大得惊人,但学习效率却很低(比如自动驾驶汽车)。因此,他创立了一套名为「世界模型」(即世界如何运作的内部模型)的理论,认为学习世界模型(可以理解为为真实世界跑个模拟)可能是实现 AGI 的关键。在活动现场,上海交通大学教授杨小康分享了他们在这个方向上的工作。具体来说,他的团队着眼于视觉直觉的世界模型(因为视觉直觉信息量大),试图把视觉、直觉以及对时间、空间的感知建模好。最后,他还强调了数学、物理、信息认知与计算机学科交叉对这类研究的重要性。

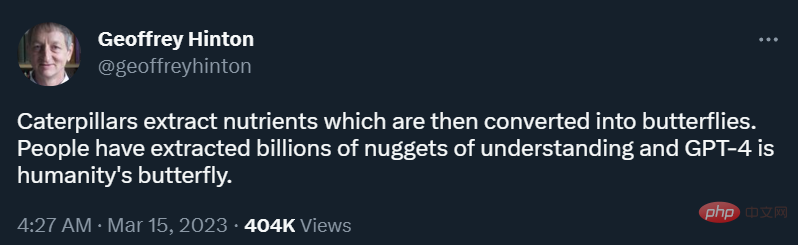

「毛毛虫从食物中提取营养,然后变成蝴蝶。人们已经提取了数十亿条理解的线索,GPT-4 是人类的蝴蝶。」在 GPT-4 发布的第二天,深度学习之父 Geoffrey Hinton 发了这样一条推文。

目前,还没有人能够断定这只蝴蝶将掀起多大的飓风。但可以肯定的是,这还不是一只完美的蝴蝶,整个 AGI 世界的拼图也尚未完成。每位研究者、从业者都还有机会。

以上是当GPT-4学会看图文,一场生产力革命已势不可挡的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

Stable Diffusion 3论文终于发布,架构细节大揭秘,对复现Sora有帮助?

Mar 06, 2024 pm 05:34 PM

Stable Diffusion 3论文终于发布,架构细节大揭秘,对复现Sora有帮助?

Mar 06, 2024 pm 05:34 PM

StableDiffusion3的论文终于来了!这个模型于两周前发布,采用了与Sora相同的DiT(DiffusionTransformer)架构,一经发布就引起了不小的轰动。与之前版本相比,StableDiffusion3生成的图质量有了显着提升,现在支持多主题提示,并且文字书写效果也得到了改善,不再出现乱码情况。 StabilityAI指出,StableDiffusion3是一个系列模型,其参数量从800M到8B不等。这一参数范围意味着该模型可以在许多便携设备上直接运行,从而显着降低了使用AI

自动驾驶与轨迹预测看这一篇就够了!

Feb 28, 2024 pm 07:20 PM

自动驾驶与轨迹预测看这一篇就够了!

Feb 28, 2024 pm 07:20 PM

轨迹预测在自动驾驶中承担着重要的角色,自动驾驶轨迹预测是指通过分析车辆行驶过程中的各种数据,预测车辆未来的行驶轨迹。作为自动驾驶的核心模块,轨迹预测的质量对于下游的规划控制至关重要。轨迹预测任务技术栈丰富,需要熟悉自动驾驶动/静态感知、高精地图、车道线、神经网络架构(CNN&GNN&Transformer)技能等,入门难度很大!很多粉丝期望能够尽快上手轨迹预测,少踩坑,今天就为大家盘点下轨迹预测常见的一些问题和入门学习方法!入门相关知识1.预习的论文有没有切入顺序?A:先看survey,p

DualBEV:大幅超越BEVFormer、BEVDet4D,开卷!

Mar 21, 2024 pm 05:21 PM

DualBEV:大幅超越BEVFormer、BEVDet4D,开卷!

Mar 21, 2024 pm 05:21 PM

这篇论文探讨了在自动驾驶中,从不同视角(如透视图和鸟瞰图)准确检测物体的问题,特别是如何有效地从透视图(PV)到鸟瞰图(BEV)空间转换特征,这一转换是通过视觉转换(VT)模块实施的。现有的方法大致分为两种策略:2D到3D和3D到2D转换。2D到3D的方法通过预测深度概率来提升密集的2D特征,但深度预测的固有不确定性,尤其是在远处区域,可能会引入不准确性。而3D到2D的方法通常使用3D查询来采样2D特征,并通过Transformer学习3D和2D特征之间对应关系的注意力权重,这增加了计算和部署的

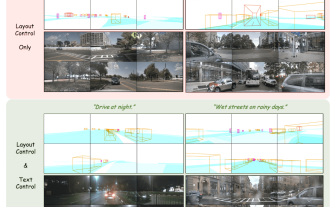

首个多视角自动驾驶场景视频生成世界模型 | DrivingDiffusion: BEV数据和仿真新思路

Oct 23, 2023 am 11:13 AM

首个多视角自动驾驶场景视频生成世界模型 | DrivingDiffusion: BEV数据和仿真新思路

Oct 23, 2023 am 11:13 AM

笔者的一些个人思考在自动驾驶领域,随着BEV-based子任务/端到端方案的发展,高质量的多视图训练数据和相应的仿真场景构建愈发重要。针对当下任务的痛点,“高质量”可以解耦成三个方面:不同维度上的长尾场景:如障碍物数据中近距离的车辆以及切车过程中精准的朝向角,以及车道线数据中不同曲率的弯道或较难采集的匝道/汇入/合流等场景。这些往往靠大量的数据采集和复杂的数据挖掘策略,成本高昂。3D真值-图像的高度一致:当下的BEV数据获取往往受到传感器安装/标定,高精地图以及重建算法本身的误差影响。这导致了我

《我的世界》化身AI小镇,NPC居民角色扮演如同真人

Jan 02, 2024 pm 06:25 PM

《我的世界》化身AI小镇,NPC居民角色扮演如同真人

Jan 02, 2024 pm 06:25 PM

请留意,这个方块人正在紧锁眉头,思考着面前几位“不速之客”的身份。原来她陷入了危险境地,意识到这一点后,她迅速展开脑力搜索,寻找解决问题的策略。最终,她决定先逃离现场,然后尽快寻求帮助,并立即采取行动。与此同时,对面的人也在进行着与她相同的思考……在《我的世界》中出现了这样一个场景,所有的角色都由人工智能控制。他们每个人都有着独特的身份设定,比如之前提到的女孩就是一个年仅17岁但聪明勇敢的快递员。他们拥有记忆和思考能力,在这个以《我的世界》为背景的小镇中像人类一样生活。驱动他们的,是一款全新的、

如何使用 iOS 17 在 iPhone 上编辑照片

Nov 30, 2023 pm 11:39 PM

如何使用 iOS 17 在 iPhone 上编辑照片

Nov 30, 2023 pm 11:39 PM

移动摄影从根本上改变了我们捕捉和分享生活瞬间的方法。智能手机的出现,尤其是iPhone,在这一转变中发挥了关键作用。iPhone以其先进的相机技术和用户友好的编辑功能而闻名,已成为业余和经验丰富的摄影师的首选。iOS17的推出标志着这一旅程中的一个重要里程碑。Apple的最新更新带来了一套增强的照片编辑功能,为用户提供了一个更强大的工具包,将他们的日常快照变成视觉上引人入胜且艺术丰富的图像。这种技术的发展不仅简化了摄影过程,还为创意表达开辟了新的途径,使用户能够毫不费力地为他们的照片注入专业气息

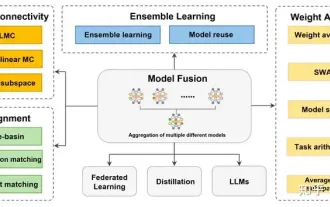

综述!深度模型融合(LLM/基础模型/联邦学习/微调等)

Apr 18, 2024 pm 09:43 PM

综述!深度模型融合(LLM/基础模型/联邦学习/微调等)

Apr 18, 2024 pm 09:43 PM

23年9月国防科大、京东和北理工的论文“DeepModelFusion:ASurvey”。深度模型融合/合并是一种新兴技术,它将多个深度学习模型的参数或预测合并为一个模型。它结合了不同模型的能力来弥补单个模型的偏差和错误,以获得更好的性能。而大规模深度学习模型(例如LLM和基础模型)上的深度模型融合面临着一些挑战,包括高计算成本、高维参数空间、不同异构模型之间的干扰等。本文将现有的深度模型融合方法分为四类:(1)“模式连接”,通过一条损失减少的路径将权重空间中的解连接起来,以获得更好的模型融合初

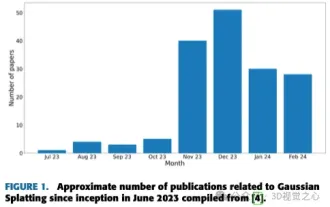

不止3D高斯!最新综述一览最先进的3D重建技术

Jun 02, 2024 pm 06:57 PM

不止3D高斯!最新综述一览最先进的3D重建技术

Jun 02, 2024 pm 06:57 PM

写在前面&笔者的个人理解基于图像的3D重建是一项具有挑战性的任务,涉及从一组输入图像推断目标或场景的3D形状。基于学习的方法因其直接估计3D形状的能力而受到关注。这篇综述论文的重点是最先进的3D重建技术,包括生成新颖的、看不见的视图。概述了高斯飞溅方法的最新发展,包括输入类型、模型结构、输出表示和训练策略。还讨论了尚未解决的挑战和未来的方向。鉴于该领域的快速进展以及增强3D重建方法的众多机会,对算法进行全面检查似乎至关重要。因此,本研究对高斯散射的最新进展进行了全面的概述。(大拇指往上滑