李志飞:关于GPT-4的八点观察,多模态大模型竞赛开始

在标准化测试和其他基准测试中,GPT-4比之前的模型表现得更优异,可以跨数十种语言工作,还可以将图像作为输入对象,这意味着它能够在聊天上下文中理解照片或图表的意图和逻辑。

自微软3月初发布多模态模型 Kosmos-1 以来,一直在测试和调整 OpenAI 的多模态模型,并将其更好地兼容微软自有产品。

果不其然,趁着GPT-4发布之际,微软也正式摊牌,New Bing早就已经用上GPT-4了。

ChatGPT用的语言模型是 GPT-3.5,在谈到GPT-4比前一个版本强大在哪里时,OpenAI称,虽然这两个版本在随意的谈话中看起来很相似,但「当任务的复杂性达到足够的阈值时,差异就会出现」,GPT-4更可靠、更有创意,并且能够处理更细微的指令。

王者加冕?关于GPT-4的八点观察

1. 再度惊艳,强过人类

如果说GPT-3系列模型向大家证明了AI能够在一个模型里做多个任务,指明实现AGI的路径,GPT-4在很多任务上已经达到人类水平(human-level),甚至比人类表现更好。GPT-4在很多专业的学术考试上已经超越90%的人类,比如在模拟律师考试中,分数在应试者的前10%左右。对此,各类中小学、大学和专业教育该如何应对?

2. 「科学」炼丹

虽然OpenAI此次并未公布具体参数,但可以猜到GPT-4模型一定不小,模型太多就意味着高额训练成本。与此同时,训练模型也很像「炼丹」,需要做很多实验,如果这些实验都是在真实环境下去训练,高昂成本压力不是谁都能承受的。

为此,OpenAI别出心裁搞了一个所谓的「predictable scaling」,简言之就是用万分之一的成本来预测各个实验的结果(loss和human eval)。如此一来,就把原本大模型「碰运气」的炼丹训练升级为「半科学」的炼丹。

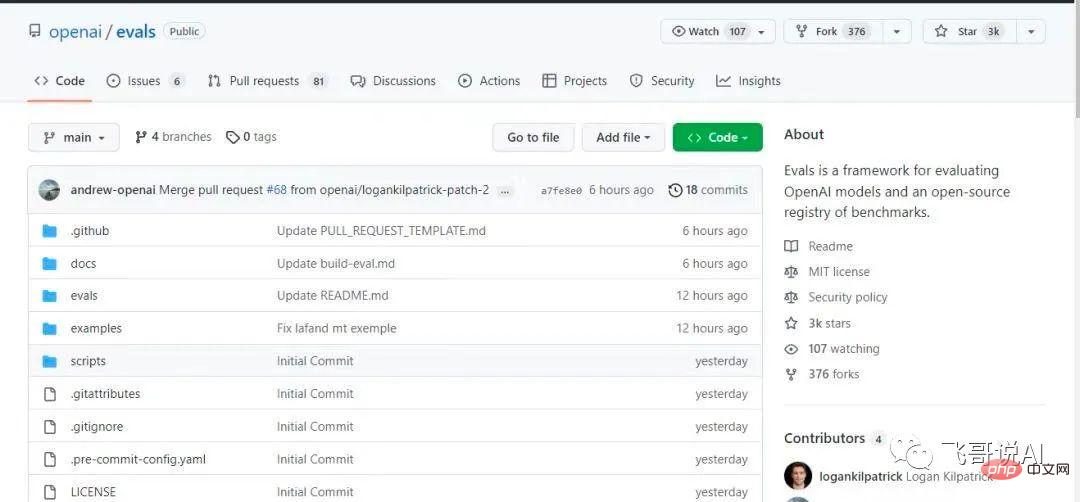

3. 众包评测,一举双得

这次非常「取巧」地提供了一个open source的OpenAI Evals,用众包方式开放给各位开发者或爱好者,邀请大家使用Evals来测试模型,同时笼络开发者生态。这一方式,既让大家有参与感,又能让大家免费帮忙评估提高系统,OpenAI直接获得问题和反馈,一石二鸟。

4. 工程补漏

这次还发布了一个System Card,是一个开放的「打补丁」工具,可以发现漏洞减少语言模型的「胡说八道」问题。系统打了各种各样的补丁做预处理和后处理,后面还会开放代码把打补丁能力众包给大家,OpenAI未来也许可以让大家帮它一起做。这标志着LLM终于从一个优雅简单的next token prediction任务进入了各种messy的工程hack了。

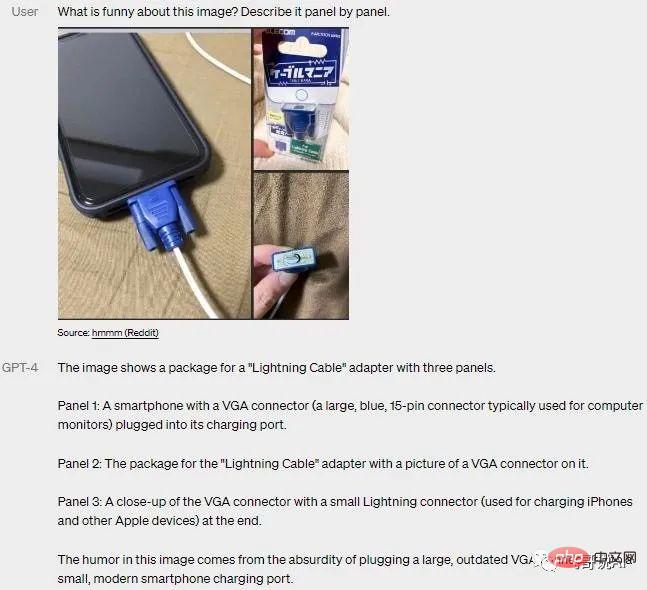

5. 多模态

自上周德国微软透露GPT-4是多模态后,大众可谓万众期待。

GPT-4千呼万唤始出来,被誉为「堪比人脑」的多模态其实跟目前很多论文阐述的多模态能力并无太多差别,主要区别就是把文本模型的few-shot和逻辑链(COT)结合进来,这里有个前提是需要一个基础能力很好的文本LLM再加多模态,会产生不错的效果。

6. 有计划地放出「王炸」

按照OpenAI演示GPT-4的demo视频里的说法,GPT-4 早在去年8月就已完成训练,但今天才发布,剩下的时间都在进行大量测试和各种查漏补缺,以及最重要的去除危险内容生成的工作。

当大家还沉浸在ChatGPT惊人的生成能力之时,OpenAI已经搞定GPT-4,这波谷歌工程师估计又要熬夜追赶了?

7. OpenAI不再Open

OpenAI在公开的论文里完全没有提及任何模型参数和数据规模(网传GPT-4参数已达100万亿),也没有任何技术原理,对此解释说是为了普惠大众,怕大家学会了怎么做GPT-4之后会用来做恶,触发一些不可控的事情发生,个人完全不认同这种此地无银的做法。

8. 集中力量办大事

论文除了各种「炫技」,还特别用了三页把所有为GPT-4不同系统有贡献人员都列出来,粗略估计应该已经超过百人,再次体现OpenAI内部团队成员众志成城、高度协作的状态。以此对比其他几家的团队作战能力,在众志成城这方面是不是差得有点远?

目前多模态大模型已经成为整个AI大模型发展的趋势和重要方向,而在这场大模型AI「军备竞赛」中,谷歌、微软、DeepMind等科技巨头都积极推出多模态大模型(MLLM)或大模型(LLM)。

开启新一轮军备竞赛:多模态大模型

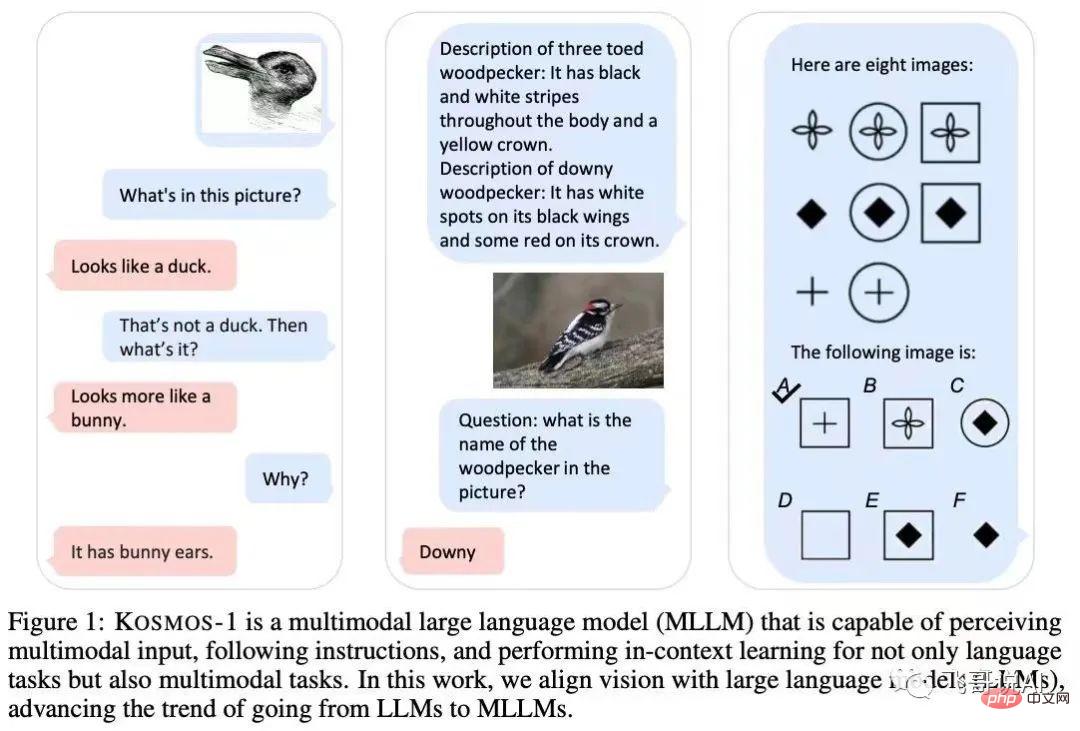

微软:Kosmos-1

微软在3月初发布拥有16亿参数的多模态模型 Kosmos-1,网络结构基于 Transformer 的因果语言模型。其中,Transformer 解码器用作多模态输入的通用接口。

除了各种自然语言任务,Kosmos-1 模型能够原生处理广泛的感知密集型任务,如视觉对话、视觉解释、视觉问答、图像字幕、简单的数学方程式、OCR 和带描述的零样本图像分类。

谷歌:PaLM-E

3月初,谷歌和柏林工业大学的研究团队推出目前最大的视觉语言模型——PaLM-E,参数量高达5620亿(PaLM-540B+ViT-22B)。

PaLM-E是一个仅有解码器的大模型,在给定前缀(prefix)或提示(prompt)下,能够以自回归方式生成文本补全。模型通过加一个编码器,模型可以将图像或感知数据编码为一系列与语言标记大小相同的向量,将此作为输入用于下一个token预测,进行端到端训练。

DeepMind:Flamingo

DeepMind在去年4月推出Flamingo视觉语言模型,模型将图像、视频和文本作为提示(prompt),输出相关语言,只需要少量的特定例子既能解决很多问题,无需额外训练。

通过交叉输入图片(视频)和文本的方式训练模型,使模型具有 few-shot 的多模态序列推理能力,完成「文本描述补全、VQA / Text-VQA」等多种任务。

目前,多模态大模型已显示更多应用可能性,除了相对成熟的文生图外,人机互动、机器人控制、图片搜索、语音生成等大量应用逐一出现。

综合来看,GPT-4不会是AGI,但多模态大模型已经是一个清晰且确定的发展方向。建立统一的、跨场景、多任务的多模态基础模型会成为人工智能发展的主流趋势之一。

雨果说「科学到了最后阶段,便遇上了想象」,多模态大模型的未来或许正超越人类的想象。

以上是李志飞:关于GPT-4的八点观察,多模态大模型竞赛开始的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

全球最强开源 MoE 模型来了,中文能力比肩 GPT-4,价格仅为 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

全球最强开源 MoE 模型来了,中文能力比肩 GPT-4,价格仅为 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

想象一下,一个人工智能模型,不仅拥有超越传统计算的能力,还能以更低的成本实现更高效的性能。这不是科幻,DeepSeek-V2[1],全球最强开源MoE模型来了。DeepSeek-V2是一个强大的专家混合(MoE)语言模型,具有训练经济、推理高效的特点。它由236B个参数组成,其中21B个参数用于激活每个标记。与DeepSeek67B相比,DeepSeek-V2性能更强,同时节省了42.5%的训练成本,减少了93.3%的KV缓存,最大生成吞吐量提高到5.76倍。DeepSeek是一家探索通用人工智

你好,电动Atlas!波士顿动力机器人复活,180度诡异动作吓坏马斯克

Apr 18, 2024 pm 07:58 PM

你好,电动Atlas!波士顿动力机器人复活,180度诡异动作吓坏马斯克

Apr 18, 2024 pm 07:58 PM

波士顿动力Atlas,正式进入电动机器人时代!昨天,液压Atlas刚刚「含泪」退出历史舞台,今天波士顿动力就宣布:电动Atlas上岗。看来,在商用人形机器人领域,波士顿动力是下定决心要和特斯拉硬刚一把了。新视频放出后,短短十几小时内,就已经有一百多万观看。旧人离去,新角色登场,这是历史的必然。毫无疑问,今年是人形机器人的爆发年。网友锐评:机器人的进步,让今年看起来像人类的开幕式动作、自由度远超人类,但这真不是恐怖片?视频一开始,Atlas平静地躺在地上,看起来应该是仰面朝天。接下来,让人惊掉下巴

替代MLP的KAN,被开源项目扩展到卷积了

Jun 01, 2024 pm 10:03 PM

替代MLP的KAN,被开源项目扩展到卷积了

Jun 01, 2024 pm 10:03 PM

本月初,来自MIT等机构的研究者提出了一种非常有潜力的MLP替代方法——KAN。KAN在准确性和可解释性方面表现优于MLP。而且它能以非常少的参数量胜过以更大参数量运行的MLP。比如,作者表示,他们用KAN以更小的网络和更高的自动化程度重现了DeepMind的结果。具体来说,DeepMind的MLP有大约300,000个参数,而KAN只有约200个参数。KAN与MLP一样具有强大的数学基础,MLP基于通用逼近定理,而KAN基于Kolmogorov-Arnold表示定理。如下图所示,KAN在边上具

FisheyeDetNet:首个基于鱼眼相机的目标检测算法

Apr 26, 2024 am 11:37 AM

FisheyeDetNet:首个基于鱼眼相机的目标检测算法

Apr 26, 2024 am 11:37 AM

目标检测在自动驾驶系统当中是一个比较成熟的问题,其中行人检测是最早得以部署算法之一。在多数论文当中已经进行了非常全面的研究。然而,利用鱼眼相机进行环视的距离感知相对来说研究较少。由于径向畸变大,标准的边界框表示在鱼眼相机当中很难实施。为了缓解上述描述,我们探索了扩展边界框、椭圆、通用多边形设计为极坐标/角度表示,并定义一个实例分割mIOU度量来分析这些表示。所提出的具有多边形形状的模型fisheyeDetNet优于其他模型,并同时在用于自动驾驶的Valeo鱼眼相机数据集上实现了49.5%的mAP

特斯拉机器人进厂打工,马斯克:手的自由度今年将达到22个!

May 06, 2024 pm 04:13 PM

特斯拉机器人进厂打工,马斯克:手的自由度今年将达到22个!

May 06, 2024 pm 04:13 PM

特斯拉机器人Optimus最新视频出炉,已经可以在厂子里打工了。正常速度下,它分拣电池(特斯拉的4680电池)是这样的:官方还放出了20倍速下的样子——在小小的“工位”上,拣啊拣啊拣:这次放出的视频亮点之一在于Optimus在厂子里完成这项工作,是完全自主的,全程没有人为的干预。并且在Optimus的视角之下,它还可以把放歪了的电池重新捡起来放置,主打一个自动纠错:对于Optimus的手,英伟达科学家JimFan给出了高度的评价:Optimus的手是全球五指机器人里最灵巧的之一。它的手不仅有触觉

单卡跑Llama 70B快过双卡,微软硬生生把FP6搞到了A100里 | 开源

Apr 29, 2024 pm 04:55 PM

单卡跑Llama 70B快过双卡,微软硬生生把FP6搞到了A100里 | 开源

Apr 29, 2024 pm 04:55 PM

FP8和更低的浮点数量化精度,不再是H100的“专利”了!老黄想让大家用INT8/INT4,微软DeepSpeed团队在没有英伟达官方支持的条件下,硬生生在A100上跑起FP6。测试结果表明,新方法TC-FPx在A100上的FP6量化,速度接近甚至偶尔超过INT4,而且拥有比后者更高的精度。在此基础之上,还有端到端的大模型支持,目前已经开源并集成到了DeepSpeed等深度学习推理框架中。这一成果对大模型的加速效果也是立竿见影——在这种框架下用单卡跑Llama,吞吐量比双卡还要高2.65倍。一名

牛津大学最新!Mickey:3D中的2D图像匹配SOTA!(CVPR\'24)

Apr 23, 2024 pm 01:20 PM

牛津大学最新!Mickey:3D中的2D图像匹配SOTA!(CVPR\'24)

Apr 23, 2024 pm 01:20 PM

写在前面项目链接:https://nianticlabs.github.io/mickey/给定两张图片,可以通过建立图片之间的对应关系来估计它们之间的相机姿态。通常,这些对应关系是二维到二维的,而我们估计的姿态在尺度上是不确定的。一些应用,例如随时随地实现即时增强现实,需要尺度度量的姿态估计,因此它们依赖于外部的深度估计器来恢复尺度。本文提出了MicKey,这是一个关键点匹配流程,能够够预测三维相机空间中的度量对应关系。通过学习跨图像的三维坐标匹配,我们能够在没有深度测试的情况下推断出度量相对

Docker三分钟搞定LLama3开源大模型本地部署

Apr 26, 2024 am 10:19 AM

Docker三分钟搞定LLama3开源大模型本地部署

Apr 26, 2024 am 10:19 AM

概述LLaMA-3(LargeLanguageModelMetaAI3)是由Meta公司开发的大型开源生成式人工智能模型。它在模型结构上与前一代LLaMA-2相比没有大的变动。LLaMA-3模型分为不同规模的版本,包括小型、中型和大型,以适应不同的应用需求和计算资源。小型模型参参数规模为8B,中型模型参参数规模为70B,而大型模型参参数规模则达到400B。然而在训练中,目标是实现多模态、多语言的功能,预计结果将与GPT4/GPT4V相当。安装OllamaOllama是一个开源的大型语言模型(LL