重新审视Prompt优化问题,预测偏差让语言模型上下文学习更强

LLMs 在 In-context Learning 下取得了良好的表现,但是选取不同的示例会导致截然不同的表现。一项最新的研究工作从预测偏差 (predictive bias) 角度,提出了 prompt 搜索策略,近似找到了最优的示例组合。

- 论文链接: https://arxiv.org/abs/2303.13217

- 代码链接: https://github.com/MaHuanAAA/g_fair_searching

研究介绍

大型语言模型在上下文学习中表现出了惊人的能力,这些模型可以通过几个输入输出示例构建的上下文进行学习,无需微调优化直接应用于许多下游任务。然而,先前的研究表明,由于训练样本 (training examples)、示例顺序 (example order) 和提示格式 (prompt formats) 的变化,上下文学习可能会表现出高度的不稳定性。因此,构建适当的 prompt 对于提高上下文学习的表现至关重要。

以前的研究通常从两个方向研究这个问题:(1)编码空间中的提示调整 (prompt tuning),(2)在原始空间中进行搜索 (prompt searching)。

Prompt tuning 的关键思想是将任务特定的 embedding 注入隐藏层,然后使用基于梯度的优化来调整这些 embeddings。然而,这些方法需要修改模型的原始推理过程并且获得模型梯度,这在像 GPT-3 和 ChatGPT 这样的黑盒 LLM 服务中是不切实际的。此外,提示调整会引入额外的计算和存储成本,这对于 LLM 通常是昂贵的。

更可行且高效的方法是通过在原始文本空间中搜索近似的演示样本和顺序来优化提示。一些工作从 “Global view” 或 “Local view” 构建提示。基于 Global view 的方法通常将提示的不同元素作为整体进行优化,以达到更优异的性能。例如,Diversity-guided [1] 的方法利用演示的整体多样性的搜索,或者试图优化整个示例组合顺序 [2],以实现更好的性能。与 Global view 相反,基于 Local view 的方法通过设计不同的启发式选择标准,例如 KATE [3]。

但这些方法都有各自的局限性:(1)目前的大多数研究主要集中在沿着单个因素搜索提示,例如示例选择或顺序。然而各个因素对性能的总体影响尚不清楚。(2)这些方法通常基于启发式标准,需要一个统一的视角来解释这些方法是如何工作的。(3)更重要的是,现有的方法会全局或局部地优化提示,这可能会导致性能不理想。

本文从 “预测偏差” 的角度重新审视了 NLP 领域中的 prompt 优化问题,发现了一个关键现象:一个给定的 prompt 的质量取决于它的内在偏差。基于这个现象,文章提出了一个基于预测偏差的替代标准来评估 prompt 的质量,该度量方法能够在不需要额外开发集 (development set) 的情况下通过单个前向过程来评估 prompt。

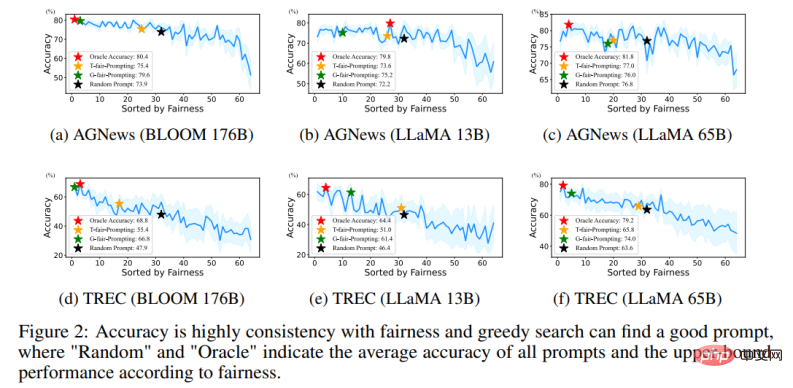

具体来说,通过在一个给定的 prompt 下输入一个 “无内容” 的测试,期望模型输出一个均匀的预测分布(一个 “无内容” 的输入不包含任何有用的信息)。因此,文中利用预测分布的均匀性来表示给定 prompt 的预测偏差。这与先前的后校准方法 [4] 用的指标类似,但与后校准在固定的 prompt 情况下使用这个 metric 进行概率后校准不同的是,文中进一步探索了其在自动搜索近似 prompt 中的应用。并通过大量实验证实了一个给定 prompt 的内在偏差和它在给定测试集上的平均任务表现之间的相关性。

此外,这种基于偏差的度量使该方法能够以 “局部到全局” 的方式搜索合适的 prompt。然而,一个现实的问题是无法通过遍历所有组合的方式搜索最优解,因为它的复杂度将超过 O (N!)。

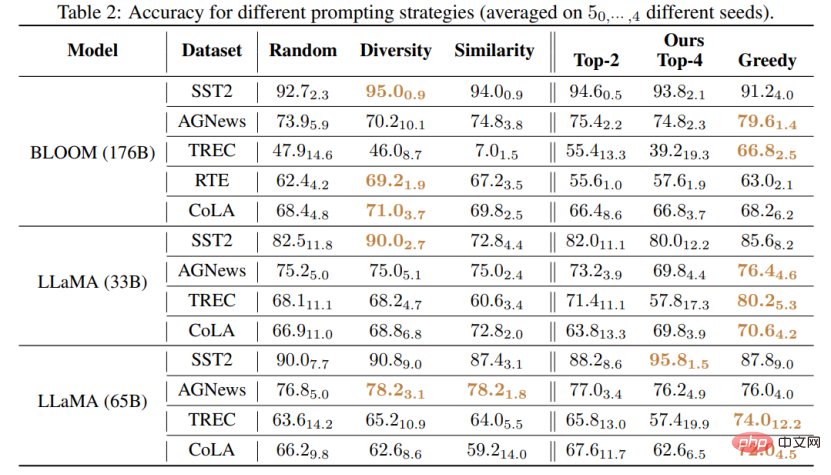

该工作提出了两种新颖的策略以高效的方式搜索高质量的 prompt:(1) T-fair-Prompting (2) G-fair-Prompting。T-fair-Prompting 使用一种直观的方式,首先计算每个示例单独组成 prompt 的偏差,然后选择 Top-k 个最公平示例组合成最终 prompt。这个策略相当高效,复杂度为 O (N)。但需要注意的是,T-fair-Prompting 基于这样的假设:最优的 prompt 通常是由偏差最小的示例构建的。然而,这在实际情况下可能并不成立,并且往往会导致局部最优解。因此,文章中进一步介绍了 G-fair-Prompting 来改善搜索质量。G-fair-Prompting 遵循贪心搜索的常规过程,通过在每个步骤上进行局部最优选择来找到最优解。在算法的每一步,所选择的示例都能使更新的 prompt 获得最佳的公平性,最坏情况时间复杂度为 O (N^2),搜索质量显著提高。G-fair-Prompting 从局部到全局的角度进行工作,其中在早期阶段考虑单个样本的偏差,而在后期阶段则侧重于减少全局预测偏差。

实验结果

该研究提出了一种有效和可解释的方法来提高语言模型的上下文学习性能,这种方法可以应用于各种下游任务。文章验证了这两种策略在各种 LLMs(包括 GPT 系列模型和最近发布的 LMaMA 系列)上的有效性,G-fair-Prompting 与 SOTA 方法相比,在不同的下游任务上获得了超过 10%的相对改进。

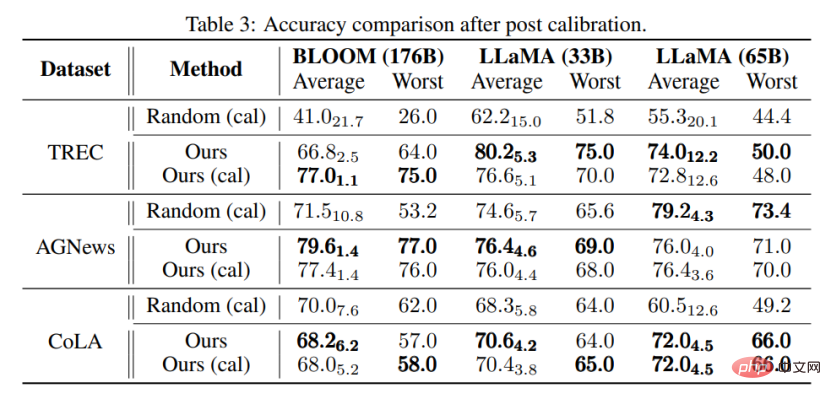

与该研究最相近的是 Calibration-before-use [4] 方法,两者都使用 “无内容” 的输入提高模型的表现。但是,Calibration-before-use 方法旨在使用该标准来校准输出,而该输出仍然容易受到所使用示例的质量的影响。与之相比,本文旨在搜索原始空间找到近似最优的 prompt,以提高模型的性能,而不需要对模型输出进行任何后处理。此外,该文首次通过大量实验验证了预测偏差与最终任务性能之间的联系,这在 Calibration-before-use 方法中尚未研究。

通过实验还能发现,即使不进行校准,该文章所提方法选择的 prompt 也可以优于经过校准的随机选择的 prompt。这表明该方法可以在实际应用中具有实用性和有效性,可以为未来的自然语言处理研究提供启示。

以上是重新审视Prompt优化问题,预测偏差让语言模型上下文学习更强的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

深入探讨模型、数据和框架:一份详尽的54页高效大语言模型综述

Jan 14, 2024 pm 07:48 PM

深入探讨模型、数据和框架:一份详尽的54页高效大语言模型综述

Jan 14, 2024 pm 07:48 PM

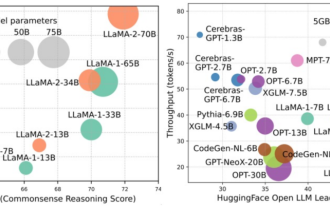

大规模语言模型(LLMs)在许多重要任务中展现出了引人注目的能力,包括自然语言理解、语言生成和复杂推理,并对社会产生了深远的影响。然而,这些出色的能力却需要大量的训练资源(如左图所示)和较长的推理时间(如右图所示)。因此,研究人员需要开发有效的技术手段来解决它们的效率问题。此外,从图的右侧还可以看出,一些高效的LLMs(LanguageModels)如Mistral-7B,已经成功应用于LLMs的设计和部署中。这些高效的LLMs在保持与LLaMA1-33B相近的准确性的同时,能够大大减少推理内存

扩散+超分辨率模型强强联合,谷歌图像生成器Imagen背后的技术

Apr 10, 2023 am 10:21 AM

扩散+超分辨率模型强强联合,谷歌图像生成器Imagen背后的技术

Apr 10, 2023 am 10:21 AM

近年来,多模态学习受到重视,特别是文本 - 图像合成和图像 - 文本对比学习两个方向。一些 AI 模型因在创意图像生成、编辑方面的应用引起了公众的广泛关注,例如 OpenAI 先后推出的文本图像模型 DALL・E 和 DALL-E 2,以及英伟达的 GauGAN 和 GauGAN2。谷歌也不甘落后,在 5 月底发布了自己的文本到图像模型 Imagen,看起来进一步拓展了字幕条件(caption-conditional)图像生成的边界。仅仅给出一个场景的描述,Imagen 就能生成高质量、高分辨率

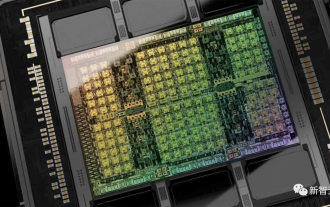

碾压H100,英伟达下一代GPU曝光!首个3nm多芯片模块设计,2024年亮相

Sep 30, 2023 pm 12:49 PM

碾压H100,英伟达下一代GPU曝光!首个3nm多芯片模块设计,2024年亮相

Sep 30, 2023 pm 12:49 PM

3纳米制程,性能超越H100!最近,据外媒DigiTimes爆料,英伟达正在开发下一代GPU,代号为「Blackwell」的B100据称,作为面向人工智能(AI)和高性能计算(HPC)应用的产品,B100将采用台积电的3nm工艺制程,以及更为复杂的多芯片模块(MCM)设计,并将于2024年第四季度现身。对于垄断了人工智能GPU市场80%以上份额的英伟达来说,则可以借着B100趁热打铁,在这波AI部署的热潮中进一步狙击AMD、英特尔等挑战者。根据英伟达的估计,到2027年,该领域的产值预计将达到约

多模态大模型最全综述来了!7位微软研究员大力合作,5大主题,成文119页

Sep 25, 2023 pm 04:49 PM

多模态大模型最全综述来了!7位微软研究员大力合作,5大主题,成文119页

Sep 25, 2023 pm 04:49 PM

多模态大模型最全综述来了!由微软7位华人研究员撰写,足足119页——它从目前已经完善的和还处于最前沿的两类多模态大模型研究方向出发,全面总结了五个具体研究主题:视觉理解视觉生成统一视觉模型LLM加持的多模态大模型多模态agent并重点关注到一个现象:多模态基础模型已经从专用走向通用。Ps.这也是为什么论文开头作者就直接画了一个哆啦A梦的形象。谁适合阅读这份综述(报告)?用微软的原话来说:只要你有兴趣学习多模态基础模型的基础知识和最新进展,无论你是专业研究员还是在校学生,这个内容都非常适合你一起来

SD社区的I2V-Adapter:无需配置,即插即用,完美兼容图生视频插件

Jan 15, 2024 pm 07:48 PM

SD社区的I2V-Adapter:无需配置,即插即用,完美兼容图生视频插件

Jan 15, 2024 pm 07:48 PM

图像到视频生成(I2V)任务是计算机视觉领域的一项挑战,旨在将静态图像转化为动态视频。这个任务的难点在于从单张图像中提取并生成时间维度的动态信息,同时保持图像内容的真实性和视觉上的连贯性。现有的I2V方法通常需要复杂的模型架构和大量的训练数据来实现这一目标。近期,快手主导的一项新研究成果《I2V-Adapter:AGeneralImage-to-VideoAdapterforVideoDiffusionModels》发布。该研究引入了一种创新的图像到视频转换方法,提出了一种轻量级适配器模块,即I

揭晓2022年玻尔兹曼奖:Hopfield网络创始人荣获奖项

Aug 13, 2023 pm 08:49 PM

揭晓2022年玻尔兹曼奖:Hopfield网络创始人荣获奖项

Aug 13, 2023 pm 08:49 PM

两位获得2022年玻尔兹曼奖的科学家已经公布,这个奖项由IUPAP统计物理委员会(C3)设立,旨在表彰在统计物理学领域取得杰出成就的研究者。获奖者必须是之前没有获得过玻尔兹曼奖或诺贝尔奖的科学家。这个奖项始于1975年,每三年颁发一次,以纪念统计物理学的奠基人路德维希·玻尔兹曼DeepakDharistheoriginalstatement.获奖理由:表彰DeepakDharistheoriginalstatement.对统计物理学领域作出的开创性贡献,包括自组织临界模型的精确解、界面生长、无序

VPR 2024 满分论文!Meta提出EfficientSAM:快速分割一切!

Mar 02, 2024 am 10:10 AM

VPR 2024 满分论文!Meta提出EfficientSAM:快速分割一切!

Mar 02, 2024 am 10:10 AM

EfficientSAM这篇工作以5/5/5满分收录于CVPR2024!作者在某社交媒体上分享了该结果,如下图所示:LeCun图灵奖得主也强烈推荐了该工作!在近期的研究中,Meta研究者提出了一种新的改进方法,即使用SAM的掩码图像预训练(SAMI)。这一方法结合了MAE预训练技术和SAM模型,旨在实现高质量的预训练ViT编码器。通过SAMI,研究者试图提高模型的性能和效率,为视觉任务提供更好的解决方案。这一方法的提出为进一步探索和发展计算机视觉和深度学习领域带来了新的思路和机遇。通过结合不同的

谷歌AI新星转投Pika:视频生成Lumiere一作,担任创始科学家

Feb 26, 2024 am 09:37 AM

谷歌AI新星转投Pika:视频生成Lumiere一作,担任创始科学家

Feb 26, 2024 am 09:37 AM

视频生成进展如火如荼,Pika迎来一位大将——谷歌研究员OmerBar-Tal,担任Pika创始科学家。一个月前,还在谷歌以共同一作的身份发布视频生成模型Lumiere,效果十分惊艳。当时网友表示:谷歌加入视频生成战局,又有好戏可看了。StabilityAICEO、谷歌前同事等在内一些业内人士送上了祝福。Lumiere一作,刚硕士毕业OmerBar-Tal,2021年本科毕业于特拉维夫大学的数学与计算机系,随后前往魏茨曼科学研究所攻读计算机硕士,主要聚焦于图像和视频合成领域的研究。其论文成果多次