无线“心灵交流”!崔铁军院士领衔研发新型脑机超表面,灵活、无创

近年来,可编程超表面(coding metasurfaces)已经实现了对电磁功能的实时和可编程控制,而以往的电磁功能要么是静态的,要么是在传统的被动设备中非常有限。但是,这类超表面依然需要人工操作。

为了直接检测和区分人的意愿,科学家们随后提出了脑机接口(brain-computer interface,BCI)的概念,试图通过脑机接口来建立脑与设备之间的通信,为可编程超表面的控制提供了新的视角。通过从“特殊的帽子”收集大脑信号,脑机接口可以解码操作员的意愿,并向被控制对象发送命令,而不需要操作员进行一些复杂的肌肉活动。

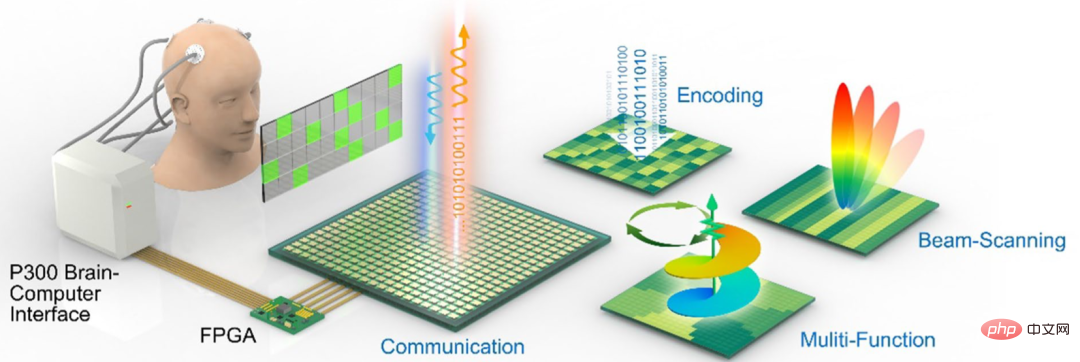

如今,东南大学毫米波国家重点实验室崔铁军院士团队联合华南理工大学、新加坡国立大学等科研机构更进一步,开发出了一种电磁脑机超表面(electromagnetic brain-computer-metasurface,EBCM)。

据介绍,这种超表面能够灵活、无创地控制信息合成和无线传输,将操作者的大脑信息转化为脑电图(EEG)信号,进而转化为各种电磁(EM)指令,从而实现两个操作者之间的无线“心灵交流”。

如下图,操作人员面前放置着显示相关命令的显示器。只需要接收简单的指令,EBCM 就能理解操作人员的意图,就可以实现视束扫描(visual-beam scanning)、波浪调制(wave modulations)、模式编码(pattern encoding)等电磁功能。

相关研究论文以“Directly wireless communication of human minds via non-invasive brain-computer-metasurface platform”为题,发表在科学期刊 eLight 上。

研究人员表示,此次研究将电磁波空间与脑机接口结合,为超表面、人脑智能与人工智能的深度融合的探索开辟了新的方向,有助于构建出新一代生物智能超表面系统。

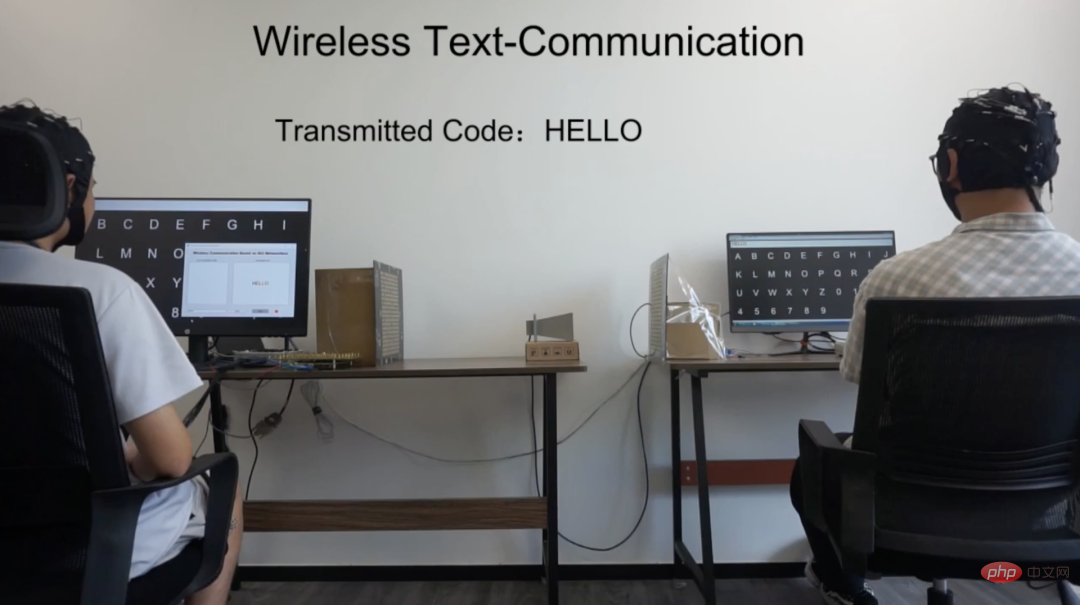

用意念输出“HELLO”

在此次研究中,研究团队设计并实验演示了基于 EBCM 的无线文本通信。

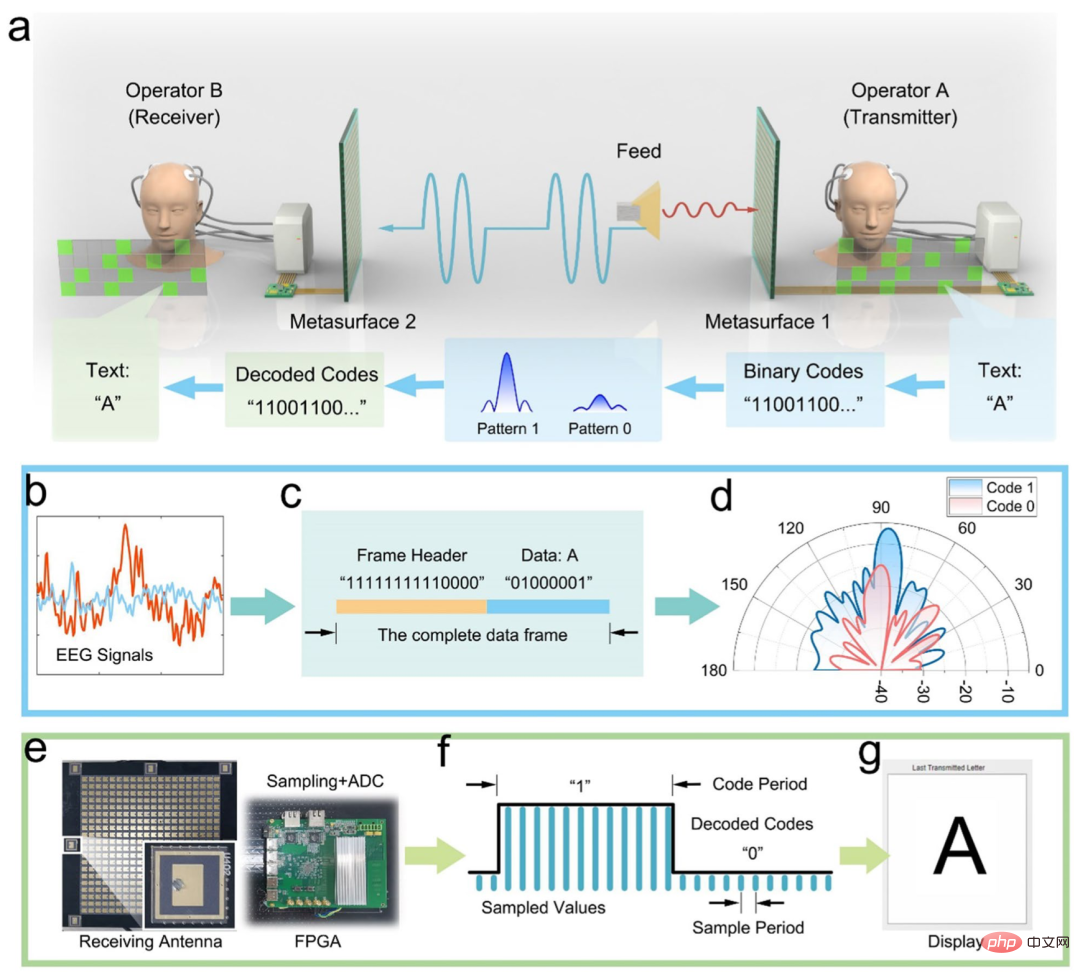

研究团队为脑机接口操作者提供了文本图形用户界面(GUI),使得可视按钮可以直接被编码为由“0”和“1”组成的特定编码序列。

在实验中,采用高增益的单波束模式和低增益的随机散射模式区分超表面反射的振幅,分别对应于用于无线信息传输的编码“1”(高振幅)和“0”(低振幅)。

作为原型的演示,研究人员演示了文本在 EBCM 通信系统中从一个操作员到另一个操作员的无线传输。

操作员 A 作为文本发送者,通过可视地查看 EBCM GUI 上的字符按钮发送字母。当从脑电图信号解码目标字母时,在 FPGA 上实现一个基于 ASCII 的编码序列,以切换时变模式,操纵超表面将信息发送到空间,由操作员 B 的 EBCM 接收、解调和呈现。

如下图,研究团队展示了 5 个字母“HELLO”的无线传输过程,操作员 B 的屏幕上成功显示出了“HELLO”的字样。

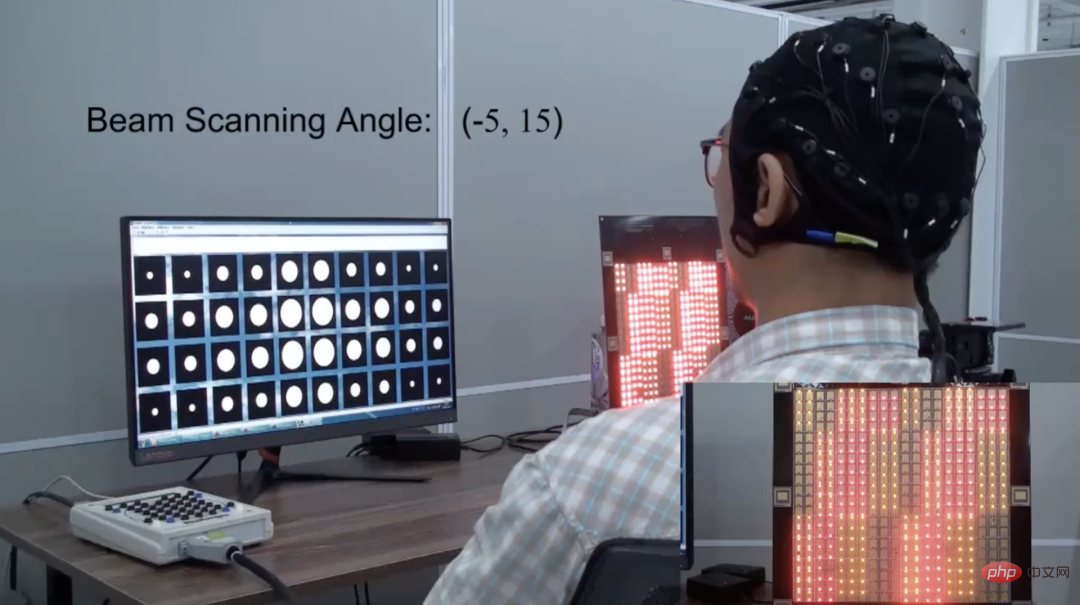

在视觉光束扫描实验中,操作人员通过目视注视特定方向,直接实现了所需的波束扫描方向。在检测到操作者的脑电图后,EBCM 可以显示出相关波束扫描方向的执行编码模式。

另外,研究团队还演示了 EBCM 的模式编码过程。操作人员通过按下特定的按钮输入所需的代码。EBCM 检测到的输入代码以黄色方块显示在屏幕上。最后一个代码“C4”是终止编码过程的停止指令,并命令 FPGA 计算最终的编码模式。之后,EBCM 执行所计算的编码模式,并在超表面显示。

以上实验表明,操作者不再需要任何涉及肌肉的动作,而只需要盯着特定的视觉按钮进行相关的连续刺激,EBCM 可以识别这些刺激并转换成相应的 EM 信号进行通信。

什么是智能超表面?

超表面,是指一种厚度小于波长的人工层状材料。根据面内的结构形式,超表面可以分为两种:一种具有横向亚波长的微细结构,一种为均匀膜层。超表面可实现对电磁波相位、极化方式、传播模式等特性的灵活有效调控。

智能超表面是信息超材料在移动通信领域的重要应用,其基本原理是通过数字编程的方式控制超材料的电磁特性,改变普通墙面对空间电磁波的漫反射,实现对空间电磁波的智能调控与波束赋形,并且具有低功耗、低成本等特点,有望成为未来移动通信网络的重要基础设施。

早在 2014 年,崔铁军院士团队就率先实现了智能超表面的硬件系统,为推动信息超材料的应用开创了先河。

今年 2 月,崔铁军院士团队及其合作者使用多层透射式数字编码超表面构建了可实时调节的全衍射式神经网络(可编程人工智能机,PAIM),成功实现了网络参数的实时编程和光速计算特性,并展示了多种应用案例,包括图像识别、强化学习和通信多通道编解码等,在国际上首次实现和展示了微波空间全衍射式可调神经网络。

当然,超表面的应用场景远不限于此。

超表面丰富独特的物理特性及其对电磁波的灵活调控能力,可以使得其在隐身技术、天线技术、微波和太赫兹器件、光电子器件等诸多领域都具有重要的应用前景。

以上是无线“心灵交流”!崔铁军院士领衔研发新型脑机超表面,灵活、无创的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

深入探讨模型、数据和框架:一份详尽的54页高效大语言模型综述

Jan 14, 2024 pm 07:48 PM

深入探讨模型、数据和框架:一份详尽的54页高效大语言模型综述

Jan 14, 2024 pm 07:48 PM

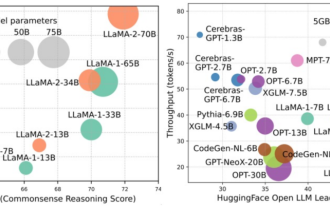

大规模语言模型(LLMs)在许多重要任务中展现出了引人注目的能力,包括自然语言理解、语言生成和复杂推理,并对社会产生了深远的影响。然而,这些出色的能力却需要大量的训练资源(如左图所示)和较长的推理时间(如右图所示)。因此,研究人员需要开发有效的技术手段来解决它们的效率问题。此外,从图的右侧还可以看出,一些高效的LLMs(LanguageModels)如Mistral-7B,已经成功应用于LLMs的设计和部署中。这些高效的LLMs在保持与LLaMA1-33B相近的准确性的同时,能够大大减少推理内存

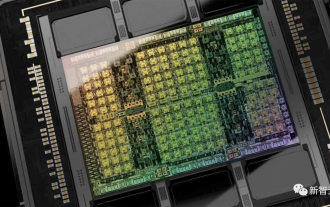

碾压H100,英伟达下一代GPU曝光!首个3nm多芯片模块设计,2024年亮相

Sep 30, 2023 pm 12:49 PM

碾压H100,英伟达下一代GPU曝光!首个3nm多芯片模块设计,2024年亮相

Sep 30, 2023 pm 12:49 PM

3纳米制程,性能超越H100!最近,据外媒DigiTimes爆料,英伟达正在开发下一代GPU,代号为「Blackwell」的B100据称,作为面向人工智能(AI)和高性能计算(HPC)应用的产品,B100将采用台积电的3nm工艺制程,以及更为复杂的多芯片模块(MCM)设计,并将于2024年第四季度现身。对于垄断了人工智能GPU市场80%以上份额的英伟达来说,则可以借着B100趁热打铁,在这波AI部署的热潮中进一步狙击AMD、英特尔等挑战者。根据英伟达的估计,到2027年,该领域的产值预计将达到约

扩散+超分辨率模型强强联合,谷歌图像生成器Imagen背后的技术

Apr 10, 2023 am 10:21 AM

扩散+超分辨率模型强强联合,谷歌图像生成器Imagen背后的技术

Apr 10, 2023 am 10:21 AM

近年来,多模态学习受到重视,特别是文本 - 图像合成和图像 - 文本对比学习两个方向。一些 AI 模型因在创意图像生成、编辑方面的应用引起了公众的广泛关注,例如 OpenAI 先后推出的文本图像模型 DALL・E 和 DALL-E 2,以及英伟达的 GauGAN 和 GauGAN2。谷歌也不甘落后,在 5 月底发布了自己的文本到图像模型 Imagen,看起来进一步拓展了字幕条件(caption-conditional)图像生成的边界。仅仅给出一个场景的描述,Imagen 就能生成高质量、高分辨率

多模态大模型最全综述来了!7位微软研究员大力合作,5大主题,成文119页

Sep 25, 2023 pm 04:49 PM

多模态大模型最全综述来了!7位微软研究员大力合作,5大主题,成文119页

Sep 25, 2023 pm 04:49 PM

多模态大模型最全综述来了!由微软7位华人研究员撰写,足足119页——它从目前已经完善的和还处于最前沿的两类多模态大模型研究方向出发,全面总结了五个具体研究主题:视觉理解视觉生成统一视觉模型LLM加持的多模态大模型多模态agent并重点关注到一个现象:多模态基础模型已经从专用走向通用。Ps.这也是为什么论文开头作者就直接画了一个哆啦A梦的形象。谁适合阅读这份综述(报告)?用微软的原话来说:只要你有兴趣学习多模态基础模型的基础知识和最新进展,无论你是专业研究员还是在校学生,这个内容都非常适合你一起来

SD社区的I2V-Adapter:无需配置,即插即用,完美兼容图生视频插件

Jan 15, 2024 pm 07:48 PM

SD社区的I2V-Adapter:无需配置,即插即用,完美兼容图生视频插件

Jan 15, 2024 pm 07:48 PM

图像到视频生成(I2V)任务是计算机视觉领域的一项挑战,旨在将静态图像转化为动态视频。这个任务的难点在于从单张图像中提取并生成时间维度的动态信息,同时保持图像内容的真实性和视觉上的连贯性。现有的I2V方法通常需要复杂的模型架构和大量的训练数据来实现这一目标。近期,快手主导的一项新研究成果《I2V-Adapter:AGeneralImage-to-VideoAdapterforVideoDiffusionModels》发布。该研究引入了一种创新的图像到视频转换方法,提出了一种轻量级适配器模块,即I

揭晓2022年玻尔兹曼奖:Hopfield网络创始人荣获奖项

Aug 13, 2023 pm 08:49 PM

揭晓2022年玻尔兹曼奖:Hopfield网络创始人荣获奖项

Aug 13, 2023 pm 08:49 PM

两位获得2022年玻尔兹曼奖的科学家已经公布,这个奖项由IUPAP统计物理委员会(C3)设立,旨在表彰在统计物理学领域取得杰出成就的研究者。获奖者必须是之前没有获得过玻尔兹曼奖或诺贝尔奖的科学家。这个奖项始于1975年,每三年颁发一次,以纪念统计物理学的奠基人路德维希·玻尔兹曼DeepakDharistheoriginalstatement.获奖理由:表彰DeepakDharistheoriginalstatement.对统计物理学领域作出的开创性贡献,包括自组织临界模型的精确解、界面生长、无序

VPR 2024 满分论文!Meta提出EfficientSAM:快速分割一切!

Mar 02, 2024 am 10:10 AM

VPR 2024 满分论文!Meta提出EfficientSAM:快速分割一切!

Mar 02, 2024 am 10:10 AM

EfficientSAM这篇工作以5/5/5满分收录于CVPR2024!作者在某社交媒体上分享了该结果,如下图所示:LeCun图灵奖得主也强烈推荐了该工作!在近期的研究中,Meta研究者提出了一种新的改进方法,即使用SAM的掩码图像预训练(SAMI)。这一方法结合了MAE预训练技术和SAM模型,旨在实现高质量的预训练ViT编码器。通过SAMI,研究者试图提高模型的性能和效率,为视觉任务提供更好的解决方案。这一方法的提出为进一步探索和发展计算机视觉和深度学习领域带来了新的思路和机遇。通过结合不同的

谷歌AI新星转投Pika:视频生成Lumiere一作,担任创始科学家

Feb 26, 2024 am 09:37 AM

谷歌AI新星转投Pika:视频生成Lumiere一作,担任创始科学家

Feb 26, 2024 am 09:37 AM

视频生成进展如火如荼,Pika迎来一位大将——谷歌研究员OmerBar-Tal,担任Pika创始科学家。一个月前,还在谷歌以共同一作的身份发布视频生成模型Lumiere,效果十分惊艳。当时网友表示:谷歌加入视频生成战局,又有好戏可看了。StabilityAICEO、谷歌前同事等在内一些业内人士送上了祝福。Lumiere一作,刚硕士毕业OmerBar-Tal,2021年本科毕业于特拉维夫大学的数学与计算机系,随后前往魏茨曼科学研究所攻读计算机硕士,主要聚焦于图像和视频合成领域的研究。其论文成果多次