马库斯发文炮轰LeCun:只靠深度学习无法实现类人智能

今年3月,Gary Marcus(加里·马库斯)提出「深度学习撞墙」这个观点后,在人工智能学界激起千层浪。

当时,就连深度学习三巨头都坐不住了,先是Geoffrey Hinton在一期播客中驳斥了这个观点。

紧接着6月,Yann LeCun撰写了一篇文章对此作出了回应,并指出别把一时困难当撞墙。

现在,马库斯在美国NOEMA杂志发表了一篇题为「Deep Learning Alone Isn’t Getting Us To Human-Like AI」的文章。

同样,他依旧没有改变自己的观点——仅靠深度学习并不能实现类人智能。

并提出,当前人工智能主要集中在深度学习上的研究,是时候该重新考虑一下了。

近70年来,人工智能领域中最根本的争论就是:人工智能系统是否应该建立在「符号操作」上 ,还是应该建立在类脑的「神经网络」系统之上。

其实,这里还有第三种可能性:混合模型 ——将神经网络的深度学习与符号操作的强大抽象能力相结合。

LeCun近期在NOEMA杂志发表的文章「What AI Can Tell Us About Intelligence」同样探讨了这个问题,但是马库斯指出他的文章看似清晰,但又有明显缺陷,即前后逻辑矛盾。

这篇文章开头,他们拒绝混合模型,但文章最后又承认混合模型的存在,并提到它是一种可能的前进方式。

神经网络和符号操作的混合模型

马库斯指出,LeCun和Browning的观点主要是「如果一个模型学会了符号操作,它就不是混合的」。

但机器学习的问题是一个发展的问题(系统是如何产生的?)

而系统一旦发展起来如何运作是一个计算问题(例如,它使用一种机制还是两种机制?),即「任何利用了符号和神经网络两者的系统都是混合模型」。

也许他们真正想说的是,人工智能很可能是一种学习的混合体,而不是天生的混合体。但学习的混合体仍然是混合体。

而马库斯的观点是,「符号操作本身就是与生俱来的,或者有另外一种东西是与生俱来的,这种东西间接促成了符号操作的产生」。

所以我们的研究重心应当放在如何发现这个间接促成符号操作的介质上。

即提出了假设,只要我们能弄清楚是什么介质让系统达到可以学习符号抽象的程度,我们就能构建利用世界上所有知识的系统。

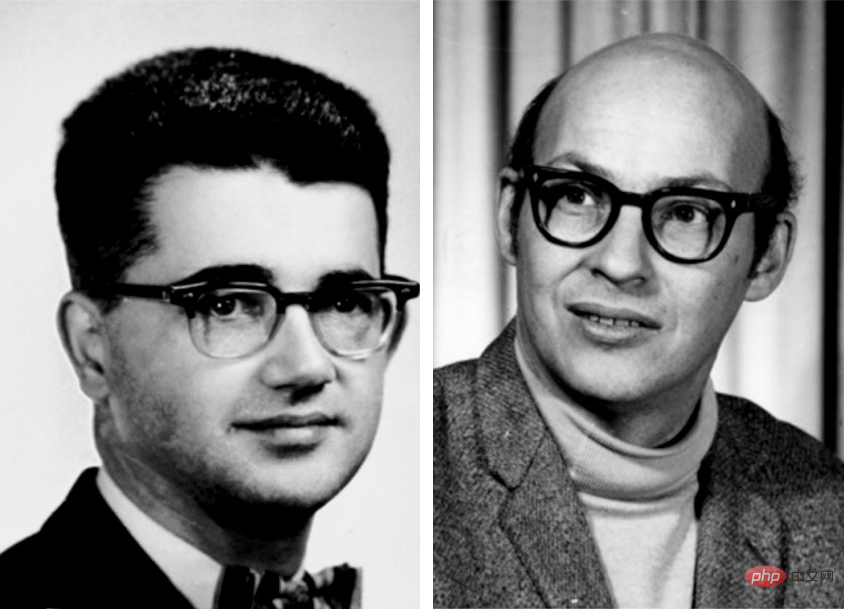

接下来,马库斯引经据典,梳理了人工智能领域关于符号操作和神经网络辩论的历史。

早期的人工智能先驱如Marvin Minsky、John McCarthy认为符号操作是唯一合理的前进方式。

而神经网络先驱Frank Rosenblatt则认为,AI建立在神经节点叠加并处理数字输入的结构上表现可能会更好。

事实上,这两种可能性并不相互排斥。

AI所使用的神经网络并不是字面上的生物神经元网络,相反,它是一个简化的数字模型,它具备一些人类大脑的特性,但复杂性很小。

原则上,这些抽象符号可以以许多不同的方式连接起来,其中一些可以直接实现逻辑和符号操作。

Warren S. McCulloch 和 Walter Pitts在1943年发表的A Logical Calculus of the Ideas Inmanent in Nervous Activity,明确承认了这种可能性。

其他人包括1950 年代的 Frank Rosenblatt 和 1980 年代的 David Rumelhart 和 Jay McClelland,提出了神经网络作为符号操作的替代方案。Geoffrey Hinton 也普遍支持这一立场。

然后马库斯又接连把LeCun、Hinton和Yoshua Bengio等图灵奖获得者cue了个遍。

意思是光我说了不算,其他大佬都这么说的!

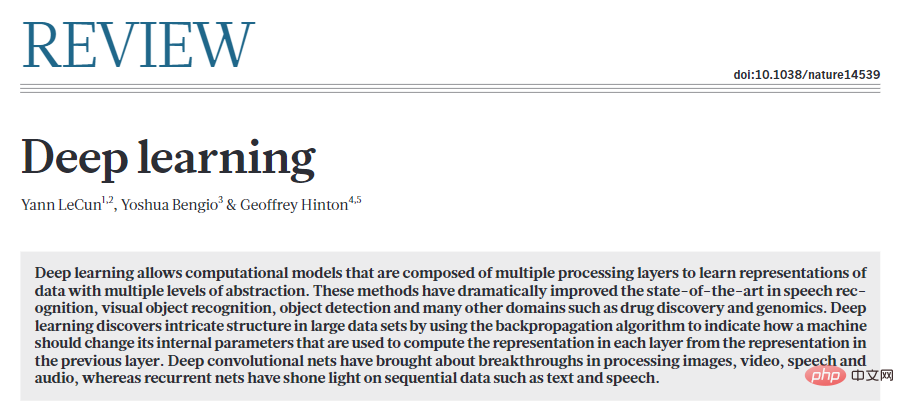

时间来到2015年,LeCun、Bengio和Hinton在Nature上写了一篇关于深度学习的宣言式论文。

这篇文章以对符号的攻击结束,认为「需要新的范式来通过对大向量的操作来取代基于规则的符号表达式操作」。

事实上,Hinton 非常确信符号是一条死胡同,同年他在斯坦福大学发表了一个名为「以太符号」的演讲——将符号比作科学史上最大的错误之一。

上世纪80年代,他的两位前合作者 Rumelhart 和 McClelland 也提出了类似的论点,他们在 1986 年的一本著名著作中辩称,符号不是「人类计算的本质」,引发了大辩论。

马库斯称,2018年他写了一篇文章为符号操作辩护时,LeCun不加解释地否定了他关于混合AI的论点,在 Twitter上将其斥为「大部分错误的观点」。

然后又说,两位著名的深度学习领域的大牛也表示支持混合 AI。

Andrew Ng在3月表示支持此类系统。Sepp Hochreiter——LSTMs 的共同创造者,领先的学习序列深度学习架构之一,也做了同样的事情,他在四月公开表示,最有希望的广泛人工智能方法是神经符号人工智能。

而在LeCun和Browning的新观点里,符号操作实际上是至关重要的,正如马库斯和Steven Pinker从1988年开始提出的观点。

马库斯也就由此指责Lecun,「你的观点我几十年前就提出了,你的研究倒退了几十年」。

而且不只是我一个人说的,其他大佬也这么认为。

LeCun 和 Browning 的其余文章大致可以分为三个部分:

1、对我的立场的错误描述2、努力缩小混合模型的范围3、符号操作可能是通过学习而不是与生俱来的原因。

接下来马库斯又针对LeCun论文中的观点进行反驳:

LeCun和Browning说,「Marcus说,如果你一开始没有符号操作,你就永远不会拥有它」。

而事实上我在2001年的《代数思维》一书中明确承认,我们不确定符号操作是否是与生俱来的。

他们批评我「深度学习无法取得进一步进展」的言论,而我的实际观点并不是DL在任何问题上都不会再有进展,而是深度学习本身对于组合性、推理等某些工作来说是错误的工具。

同样,他们污蔑我说系统中符号推理要么有要么没有(1或者0)。

这根本就是瞎说。

的确DALL-E不使用符号进行推理,但这并不意味着任何包含符号推理的系统都必须是有或者没有。

至少早在上世纪70年代的系统MYCIN中,就有纯粹的符号系统可以进行各种定量推理。

符号操作先天性

符号操作能力是否可以通过学习而不是从一开始就建立?

答案是肯定的。

马库斯称,之前的实验虽然不能保证符号操作的能力是与生俱来的,但几乎与这一观点别无二致。它们确实对任何依赖大量经验的学习理论构成了挑战。

并提出了以下2个主要的论点:

1、可学习性

在2001年出版的The Algebraic Mind一书中,马库斯展示了某些系统都能够学习符号操作。

一个系统,如果有一些内置的起点,将比一块纯粹的白板更能有效地了解这个世界。

事实上,就连LeCun自己最著名的工作——On Convolutional Neural Networks ——就是一个很好的例证:对神经网络学习方式的内置约束,从而大大提高了效率。很好地集成符号操作后,可能会带来更大的收益。

2、人类婴儿表现出一些符号操作的能力

在一系列经常被引用的规则学习实验中,婴儿们将抽象模式推广到了他们所接受过训练的具体例子之外。随后对人类婴儿内隐逻辑推理能力的研究更加证明了这一点。

另外,研究表明,比如蜜蜂可以以将太阳方位角函数推广到它们从未见过的光照条件下。

在LeCun看来,学习符号等同于晚年获得的东西,是因为年轻时候需要更精确、更专业的技能。

而令人费解的是,在反对符号操作的先天性后,LeCun并没有给出强有力的证据,证明符号操作是后天习得的。

如果一只小山羊在出生后不久就可以爬下山坡,为什么新生的神经网络不能开箱即用地结合一点符号操作呢?

同时,LeCun和Browning没有具体说明,缺乏符号操作的内在机制,如何解决语言理解和推理中众所周知的特定问题?

他们只是给出一个微弱的归纳:由于深度学习已经克服了从1到N的问题,我们应该对它能克服N+1问题有信心。

人们应该怀疑深度学习是否已经达到了极限。鉴于最近在DALL-E 2、Gato和PaLM中看到的任务持续增量改进,不要将一时困难误认为是「墙」似乎是明智的。深度学习不可避免的失败之前已经被预言过,但押注它是不值得的。

乐观是一方面,但要看清现实。

深度学习原则上面临着一些特定的挑战,主要在组合性、系统性和语言理解方面,所有这些围绕着一般化和「分布迁移」。

现在,每个人都认识到分布迁移是当前神经网络的致命弱点。当然,深度学习已经取得了进展,但是在这些基础问题上,进展并不大。

在马库斯看来,符号操作可能具有先天性的情况与以往的情况大致相同:

1、当前的系统,在「代数思维」出现的20年后,即使面对海量的数据集和训练,仍然无法可靠地提取符号运算(例如乘法)。

2、人类婴儿的例子表明,在接受正规教育之前,他们有能力概括自然语言和推理的复杂方面。3、一点内在的象征意义可以大大提高学习效率。AlphaFold 2的强大功能部分来自于精心构建的分子生物学与生俱来的表征。

简言之,世界可能大致分为三个垃圾箱:

一是在工厂完全安装了符号操作设备的系统。

二是具有先天的学习装置系统缺乏符号操作,但是在正确的数据和训练环境下,有足够的能力获得它。

三是即使有足够的训练,也无法获得完整的符号操作机制的系统。

当前的深度学习系统似乎属于第三类:一开始没有符号操作机制,并且在此过程中没有可靠的符号操作机制。

当前,了解符号操作的来源是我们的首要任务。即便是神经网络最狂热的支持者现在也认识到符号操作对于实现AI的重要性。

而这正是神经符号学界一直关注的问题: :如何让数据驱动的学习和符号表示在一个单一的、更强大的智能中协调一致地工作?

以上是马库斯发文炮轰LeCun:只靠深度学习无法实现类人智能的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

Python中使用BERT进行情感分析的方法及步骤

Jan 22, 2024 pm 04:24 PM

Python中使用BERT进行情感分析的方法及步骤

Jan 22, 2024 pm 04:24 PM

BERT是由Google在2018年提出的一种预训练的深度学习语言模型。全称为BidirectionalEncoderRepresentationsfromTransformers,它基于Transformer架构,具有双向编码的特点。相比于传统的单向编码模型,BERT在处理文本时能够同时考虑上下文的信息,因此在自然语言处理任务中表现出色。它的双向性使得BERT能够更好地理解句子中的语义关系,从而提高了模型的表达能力。通过预训练和微调的方法,BERT可以用于各种自然语言处理任务,如情感分析、命名

超越ORB-SLAM3!SL-SLAM:低光、严重抖动和弱纹理场景全搞定

May 30, 2024 am 09:35 AM

超越ORB-SLAM3!SL-SLAM:低光、严重抖动和弱纹理场景全搞定

May 30, 2024 am 09:35 AM

写在前面今天我们探讨下深度学习技术如何改善在复杂环境中基于视觉的SLAM(同时定位与地图构建)性能。通过将深度特征提取和深度匹配方法相结合,这里介绍了一种多功能的混合视觉SLAM系统,旨在提高在诸如低光条件、动态光照、弱纹理区域和严重抖动等挑战性场景中的适应性。我们的系统支持多种模式,包括拓展单目、立体、单目-惯性以及立体-惯性配置。除此之外,还分析了如何将视觉SLAM与深度学习方法相结合,以启发其他研究。通过在公共数据集和自采样数据上的广泛实验,展示了SL-SLAM在定位精度和跟踪鲁棒性方面优

潜藏空间嵌入:解释与示范

Jan 22, 2024 pm 05:30 PM

潜藏空间嵌入:解释与示范

Jan 22, 2024 pm 05:30 PM

潜在空间嵌入(LatentSpaceEmbedding)是将高维数据映射到低维空间的过程。在机器学习和深度学习领域中,潜在空间嵌入通常是通过神经网络模型将高维输入数据映射为一组低维向量表示,这组向量通常被称为“潜在向量”或“潜在编码”。潜在空间嵌入的目的是捕捉数据中的重要特征,并将其表示为更简洁和可理解的形式。通过潜在空间嵌入,我们可以在低维空间中对数据进行可视化、分类、聚类等操作,从而更好地理解和利用数据。潜在空间嵌入在许多领域中都有广泛的应用,如图像生成、特征提取、降维等。潜在空间嵌入的主要

一文搞懂:AI、机器学习与深度学习的联系与区别

Mar 02, 2024 am 11:19 AM

一文搞懂:AI、机器学习与深度学习的联系与区别

Mar 02, 2024 am 11:19 AM

在当今科技日新月异的浪潮中,人工智能(ArtificialIntelligence,AI)、机器学习(MachineLearning,ML)与深度学习(DeepLearning,DL)如同璀璨星辰,引领着信息技术的新浪潮。这三个词汇频繁出现在各种前沿讨论和实际应用中,但对于许多初涉此领域的探索者来说,它们的具体含义及相互之间的内在联系可能仍笼罩着一层神秘面纱。那让我们先来看看这张图。可以看出,深度学习、机器学习和人工智能之间存在着紧密的关联和递进关系。深度学习是机器学习的一个特定领域,而机器学习

超强!深度学习Top10算法!

Mar 15, 2024 pm 03:46 PM

超强!深度学习Top10算法!

Mar 15, 2024 pm 03:46 PM

自2006年深度学习概念被提出以来,20年快过去了,深度学习作为人工智能领域的一场革命,已经催生了许多具有影响力的算法。那么,你所认为深度学习的top10算法有哪些呢?以下是我心目中深度学习的顶尖算法,它们在创新性、应用价值和影响力方面都占据重要地位。1、深度神经网络(DNN)背景:深度神经网络(DNN)也叫多层感知机,是最普遍的深度学习算法,发明之初由于算力瓶颈而饱受质疑,直到近些年算力、数据的爆发才迎来突破。DNN是一种神经网络模型,它包含多个隐藏层。在该模型中,每一层将输入传递给下一层,并

AlphaFold 3 重磅问世,全面预测蛋白质与所有生命分子相互作用及结构,准确性远超以往水平

Jul 16, 2024 am 12:08 AM

AlphaFold 3 重磅问世,全面预测蛋白质与所有生命分子相互作用及结构,准确性远超以往水平

Jul 16, 2024 am 12:08 AM

编辑|萝卜皮自2021年发布强大的AlphaFold2以来,科学家们一直在使用蛋白质结构预测模型来绘制细胞内各种蛋白质结构的图谱、发现药物,并绘制每种已知蛋白质相互作用的「宇宙图」 。就在刚刚,GoogleDeepMind发布了AlphaFold3模型,该模型能够对包括蛋白质、核酸、小分子、离子和修饰残基在内的复合物进行联合结构预测。 AlphaFold3的准确性对比过去许多专用工具(蛋白质-配体相互作用、蛋白质-核酸相互作用、抗体-抗原预测)有显着提高。这表明,在单个统一的深度学习框架内,可以实现

改进的RMSprop算法

Jan 22, 2024 pm 05:18 PM

改进的RMSprop算法

Jan 22, 2024 pm 05:18 PM

RMSprop是一种广泛使用的优化器,用于更新神经网络的权重。它是由GeoffreyHinton等人在2012年提出的,并且是Adam优化器的前身。RMSprop优化器的出现主要是为了解决SGD梯度下降算法中遇到的一些问题,例如梯度消失和梯度爆炸。通过使用RMSprop优化器,可以有效地调整学习速率,并且自适应地更新权重,从而提高深度学习模型的训练效果。RMSprop优化器的核心思想是对梯度进行加权平均,以使不同时间步的梯度对权重的更新产生不同的影响。具体而言,RMSprop会计算每个参数的平方

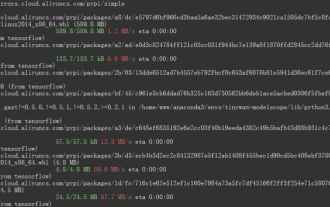

TensorFlow深度学习框架模型推理Pipeline进行人像抠图推理

Mar 26, 2024 pm 01:00 PM

TensorFlow深度学习框架模型推理Pipeline进行人像抠图推理

Mar 26, 2024 pm 01:00 PM

概述为了使ModelScope的用户能够快速、方便的使用平台提供的各类模型,提供了一套功能完备的Pythonlibrary,其中包含了ModelScope官方模型的实现,以及使用这些模型进行推理,finetune等任务所需的数据预处理,后处理,效果评估等功能相关的代码,同时也提供了简单易用的API,以及丰富的使用样例。通过调用library,用户可以只写短短的几行代码,就可以完成模型的推理、训练和评估等任务,也可以在此基础上快速进行二次开发,实现自己的创新想法。目前library提供的算法模型,