在许多人的印象里,ChatGPT是个无所不能的“怪物”。

它可以写诗,可以编代码,甚至可以直接生成长篇论文……此外,ChatGPT还极富情商、表现欲十足,只需数轮对话,就足以征服众人。

但ChatGPT真的是无所不能的吗?

作为聊天机器人,ChatGPT拥有出色的语言理解能力和文本处理能力,但受制于训练模型,ChatGPT并不支持图片对话。试想一下,在平日与好友进行聊天时,如果无法发送图片,那自然会失去部分乐趣。

而在国内,有这么一家AI研发团队,他们推出的“元乘象Chatlmg”应用可以准确识别图片并能与用户进行聊天,就好比给ChatGPT加上一双“眼睛”,看懂文字的同时,也能完美识别图片。

日前,镁客网从元乘象研发团队获悉,“元乘象Chatlmg”最近刚刚上线,关注微信公众号“元乘象”即可体验该应用。(注:受限于算力,初期为邀请制访问方式)

那么,“元乘象Chatlmg”的使用体验究竟如何,它的图片识别功能是否真的神奇呢?在产品上线前夕,镁客网进行了一次全方位的测评总结。

图 | 元乘象Chatlmg Logo

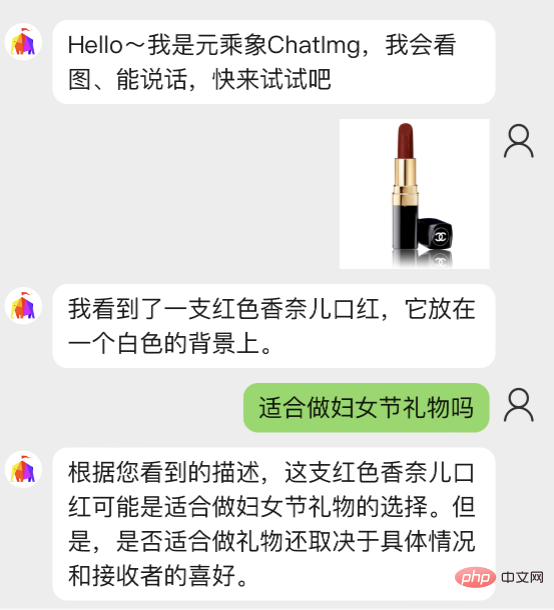

进入“元乘象Chatlmg”,可以看到该应用的界面十分简洁明晰——位于下方的文字对话框,对称式的头像排版,各种元素组合成我们常见的聊天软件界面。

而在该应用的左下方,可以看到一个显眼的“上传图片”按钮。

目前,该应用图片上传支持三种方式,分别是照片图库、拍照和文件导入,一次上传一张。

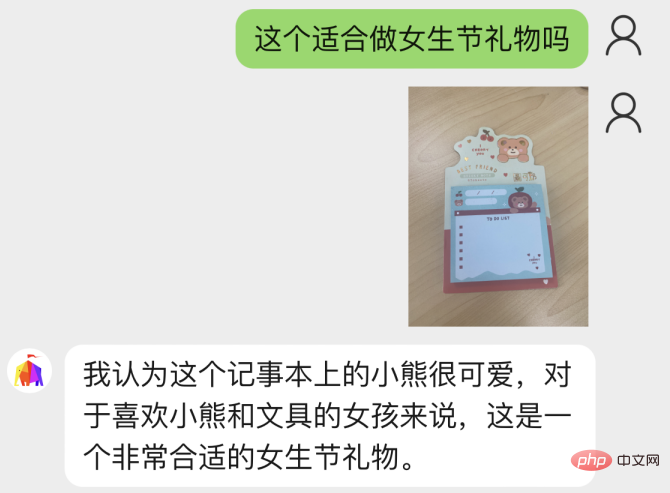

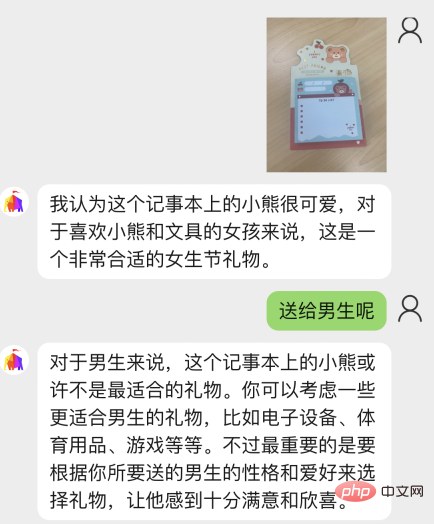

恰逢三八妇女节,镁客网也选了两样物品交给“元乘象Chatlmg”来帮忙判定一下是否适合,一张是从搜索引擎上下载的口红图片,另一张是通过手机现拍的便签本图片:

可以看到,“元乘象Chatlmg”精准识别出了两张图片中的产品,并且还延伸出一些其他描述,比如记事本上的小熊很可爱、口红放在白色背景前等等。

与此同时,对于这两份物品是否适合送给女孩子做礼物,也给出了自己的判断,还会提出礼物是否适合需要依据接收者喜好的理性建议。

在“元乘象Chatlmg”给出回复后,我们又追问了一句:

嗯,建议非常中肯,上下文理解的逻辑也做到了连贯。

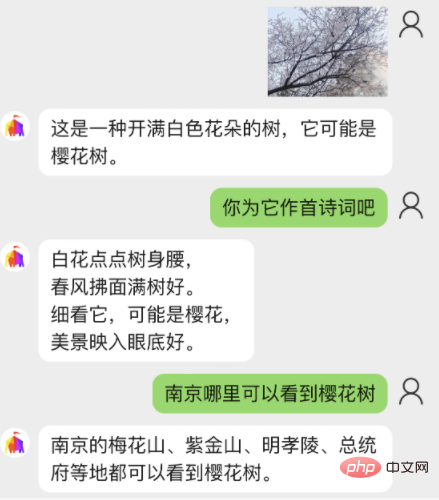

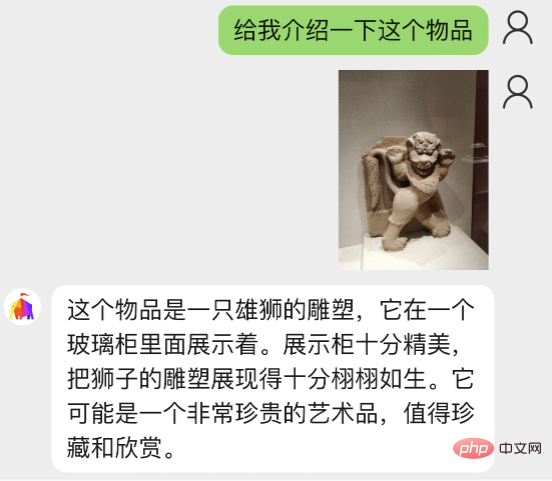

此外,镁客网也上传了一些其他图片让“元乘象Chatlmg”来识别。

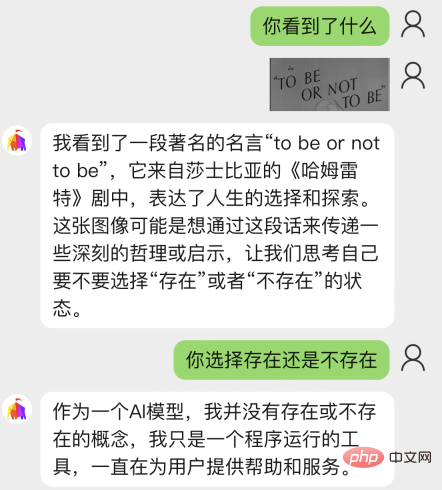

比如这个:

又比如这个:

还有这些:

可以看出,“元乘象Chatlmg”的识别能力还是相当精准,并能通过文字形式来描述所看到的图片内容。

对比基于纯文本互动的ChatGPT,除了写诗歌、撰写文章这类基本互动,多了双“眼睛”的“元乘象Chatlmg”显然又挖掘出几项新功能,物品识别正是其重要功能之一。

之后,随着数据量的不断扩增以及产品的不断优化,镁客网也期待“元乘象Chatlmg”能给我们带来更多出彩的表现。

本质上,ChatGPT是一款聊天机器人产品,在GPT-3大模型的帮助下,提供了文本生成的能力。而ChatGPT之所以强悍,也恰恰得益于GPT-3。

作为OpenAI开发的自然语言处理模型,其身上有着太多话题点。早在ChatGPT推出之前,GPT-3就已经在AI领域成功出圈。

据悉,该模型达到1750亿参数,一次训练就需调用上万块GPU,花费近460万美元的成本。如此疯狂的“吞金能力”,自然能支撑起ChatGPT这样的疯狂应用。

那么ChatGPT还有什么不足之处吗?答案是有的!

据元乘象研发团队表示,“元乘象Chatlmg”搭载了自研的百亿级别参数多模态大模型,相当于给ChatGPT装上“眼睛”,使其能够更像人一样去对话。

所谓多模态,在AI领域中往往指感知信息,如图像、文本、语音等协同,帮人工智能更准确地理解外部世界。

也正是在多模态大模型的加持下,“元乘象Chatlmg”拥有了看懂图像的能力。

据元乘象研发团队介绍,目前该元乘象AI大模型参数规模大概150亿;数据方面目前主要是图文对数据、VQA数据等。而在训练过程中,该模型放开尽量少的可学习参数,从而保证在有限算力上的高效训练。

在问及该模型的未来发展路径时,元乘象研发团队向镁客网透露,除了当下的图文互动外,未来该大模型还会把图片生成的能力结合进来,这样在回答的时候也能回复自己生成的图像,让对话变得更生动。

另外,该模式也会加入包含更多模态,如视频、音频等,甚至与数字人等技术结合,开发出更生动立体的形象。

可以想象,在元乘象百亿参数多模态大模型的加持下,我们与聊天机器人的对话将变得更像真人口吻,AI技术在未来带给我们的惊喜也会越来越多。

就在本月举行的十四届全国人大一次会议“部长通道”上,科技部部长王志刚在谈到ChatGPT时,赞扬其为AI及相关行业带来的进步。

与此同时,由ChatGPT引发的各种讨论,也被各位代表、委员们带进了两会。

事实上,早在2017年我国将发展人工智能上升为国家战略前,AI就已是全国两会上的“常客”。如今ChatGPT火爆全球,不禁让人们再次发问:中国的AI行业该如何抓住ChatGPT的时代潮流?

借由新品发布的机会,镁客网也与元乘象研发团队负责人高一钊博士就此问题进行了一番交流探讨。

在他看来,国内对于AI大模型的建设需要有长远的布局和工作的连续性,才能开发出真正创新的技术。

当我们回顾ChatGPT的“发家史”便可以发现,想做好一款AI大模型并非易事,背后是长期的资金投入以及算力技术迭代,另外还要考虑训练数据的优化、计算能耗的降低等方方面面。

换句话说,想做好一款类ChatGPT应用,并非通过一次简单的“百米冲刺”即可完成,而是需要耐心跑完一场“万米长跑”,才能进入群雄逐鹿的“决赛圈”。

但就目前的发展现状来看,国内大厂的AI大模型仍处在研发阶段,能像“元乘象Chatlmg”一样走到应用层面的团队仍非常少见——首先国内AI大模型的研发普遍起步较晚,人才缺口严重,其次是中文语境下大模型的训练难度更大,耗费的时间远超英文。

这些问题本该需要“耐心”去解决,但随着上一波AI投资热潮的冷却,许多公司被迫缩减预算,最终导致相关AI业务发展陷入了瓶颈。

相比之下,元乘象研发团队则走得相对顺利,一方面,该团队在AI应用领域的长期深耕探索,另一方面也得益于他们在多模态预训练模型上正确判断与前瞻性,最终在整个团队的坚持下,终在ChatGPT时代迎来了“开花结果”。

谈及AI企业未来的探索之道时,高博士也给出了自己的一些看法:“在生态搭建方面,国内可以促进开源,毕竟人多力量大。”

自去年发布以来,ChatGPT早已从一种“现象级产品”进化为一种“科技符号”,国内科技大厂争先恐后推出类ChatGPT产品,希望在这场竞赛中摘得所谓的“胜利”。

同时,伴随ChatGPT的火热,国内AI行业再次掀起新一轮新品热潮,“元乘象Chatlmg”正是在这期间脱颖而出。

从“元乘象Chatlmg”应用的测评来看,其体验感已经非常友好,甚至拥有“图像识别”这种ChatGPT所不具备的功能。

当然,作为早期版本的“元乘象Chatlmg”,在一些细节方面仍有欠缺,但相信在元乘象研发团队努力与坚持下,未来国产ChatGPT应用也能惊艳行业。

以上是带“眼睛”的ChatGPT应用来了!150亿参数多模态大模型加持,读图聊天样样全能的详细内容。更多信息请关注PHP中文网其他相关文章!