细数NLP与CV的融合创新:盘点多模态深度学习这几年

近年来,NLP 和 CV 领域在方法上突破不断。不只是单模态模型有所进展,而大规模多模态方法也已经成为非常热门的研究领域。

- 论文地址:https://arxiv.org/pdf/2301.04856v1.pdf

- 项目地址:https://github.com/slds-lmu/seminar_multimodal_dl

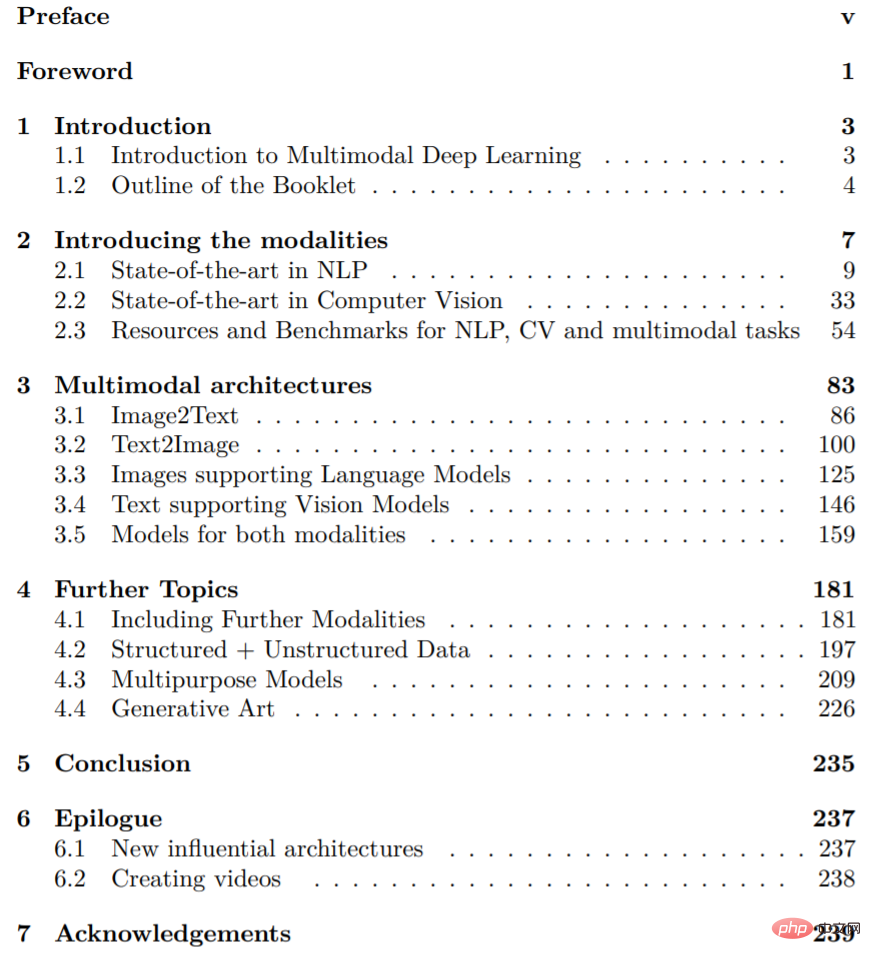

在最近的一篇论文中,研究者Matthias Aßenmacher回顾梳理了深度学习这两个子领域当前最先进的研究方法,并尝试进行全面的概述。此外,还讨论了将一种模态转换为另一种模态的建模框架(第 3.1 章和第 3.2 章),以及利用一种模态增强另一种模态的表征学习模型(第 3.3 章和第 3.4 章)。研究者引入了侧重同时处理两种模态的架构(第 3.5 章)作为第二部分的尾声。最后,论文还涵盖了其他模态(第 4.1 章和第 4.2 章)以及通用多模态模型(第 4.3 章),这些模型能够在一个统一架构中处理不同模态上的不同任务。一个有趣的应用(「生成艺术」,第 4.4 章)最终成为这篇综述的锦上添花之笔。

论文章节目录如下:

多模态深度学习简介

人类有五种基本感官:听觉、触觉、嗅觉、味觉和视觉。借由这五种模式,我们得以感知和理解周围的世界。「多模态」则意味着同时利用多种信息渠道的结合来理解周围环境。例如,当蹒跚学步的孩子学习「猫」这个词时,他们会用不同的方式大声说出这个词,指着猫,发出类似「喵喵」的声音。AI 研究人员以人类学习过程为范式,结合不同模态来训练深度学习模型。

从表面上看,深度学习算法通过训练神经网络以优化损失函数来优化定义的目标函数。优化,即将损失最小化,通过称为梯度下降的数值优化程序完成。因此,深度学习模型只能处理数字输入,也只能产生数字输出。然而,在多模态任务中,我们经常遇到细数NLP与CV的融合创新:盘点多模态深度学习这几年或文本等非结构化数据。所以,关于多模态任务的首要问题是如何用数字表征输入;其次则是如何恰当地组合不同模态。

例如,训练深度学习模型来生成一张猫的细数NLP与CV的融合创新:盘点多模态深度学习这几年可能就是一个典型的任务。首先,计算机需要理解文本输入「猫」,然后以某种方式将这些信息转换成特定图像。因此,确定输入文本中单词间的上下文关系和输出图像中像素点间的空间关系很有必要。对幼儿来说可能很容易这件事,对于计算机却可能是巨大挑战。二者都必须对「猫」这个词有一定理解,包括这个动物的内涵和外观。

当前深度学习领域一种常见方法是生成嵌入,用数字形式将猫表征为某个潜在空间中的向量。为了实现这一点,近年来已经开发出各种方法和算法架构。本文概述了最先进(SOTA)多模态深度学习中使用的各类方法,以克服非结构化数据和不同模态输入组合带来的挑战。

章节介绍

因为多模态模型通常以文本和图像作为输入或输出,所以第2章着重介绍了自然语言处理(NLP)和计算机视觉(CV)方法。NLP 领域的方法主要在于文本数据处理,而 CV 多进行图像处理。

关于 NLP(第 2.1 小节)的一个非常重要的概念叫做词嵌入,几乎是现在所有多模态深度学习架构的重要组成部分。这一概念也为基于Transformer的模型奠定了基础,比如 BERT ,该模型在几个 NLP 任务中都取得了重大进展。特别是Transformer的自注意力机制彻底改变了 NLP 模型,这也是为什么大多数 NLP 模型将Transformer作为核心。

在计算机视觉(第 2.2 小节)中,作者介绍里不同的网络架构,即 ResNet、EfficientNet、SimCLR和BYOL。在这两个领域,比较不同方法及其在富有挑战性的基准上表现如何是非常有意义的。因此,第 2 章末 2.3 小节对 CV 和 NLP 的不同数据集、预训练任务和基准进行了全面概括。

第3章侧重于不同的多模态架构,涵盖文本和图像的多种组合方式,提出的模型相组合并推进了 NLP 和 CV 不同方法的研究。首先介绍了 Img2Text 任务(第 3.1 小节)、用于目标识别的 Microsoft COCO 数据集和用于图像捕获的Meshed-Memory Transformer。

另外,研究人员开发了基于短文本 prompt 生成细数NLP与CV的融合创新:盘点多模态深度学习这几年的方法(第 3.2 小节)。完成这项任务的第一个模型是生成对抗网络(GAN)和变分自编码器(VAE)。近年来,这些方法不断改进,今天的 SOTA Transformer架构和文本引导的扩散模型如 DALL-E和 GLIDE都取得了显著成果。另一个有趣的问题是,如何利用图像来支持语言模型(第 3.3 小节)。可通过顺序嵌入、更高级的实际嵌入或直接在Transformer内部实现。

也可以看一下支持文本的 CV 模型,如 CLIP、ALIGN和 Florence(第 3.4 小节)。基础模型的使用意味着模型重用(例如 DALL-E 2 中的 CLIP),以及文本与图像连接的对比损失。此外,zero-shot 使得通过微调就可毫不费力对新的和不可见的数据进行分类。特别是用于图像分类和生成的开源架构 CLIP去年颇受关注。第3章末介绍了同时处理文本和图像的一些其他架构(第 3.5 小节)。

例如,Data2Sec 用相同的学习方法处理语音、视觉和语言,并尝试以此找到一种通用方法,能在一个架构中处理不同模态。此外,VilBert扩展了流行的 BERT 架构,通过实现共同注意力来处理图像和文本输入。这种方法也用于谷歌的 Deepmind Flamingo。此外,Flamingo 的目标是通过少样本学习和冻结预训练的视觉和语言模型,用单个视觉语言模型处理多个任务。

最后一章(第 4 章)介绍了能够处理文本和图像以外模态的方法,例如视频、语音或表格数据。总体目标是探索通用的多模态架构,并非为模态而模态,而是为从容应对挑战。因此还需处理多模态融合和对齐的问题,决定要使用联合表征还是协调表征(第 4.1 小节)。此外,还将更详细地介绍如何精准组合结构化数据和非结构化数据(第 4.2 小节)。

作者还提出了近年来形成的不同融合策略,本文通过生存分析和经济学中的两个用例加以说明。除此之外,另一个有趣的研究问题是,如何在一个所谓的多用途模型(第 4.3 小节)中处理不同任务,就像谷歌研究人员在其「Pathway」模型中创建的那样。最后,文章会展示多模态深度学习在艺术场景中的一个典型应用,使用 DALL-E等图像生成模型来创建生成艺术领域的艺术作品(第 4.4 小节)。

了解更多内容,请参考原论文。

以上是细数NLP与CV的融合创新:盘点多模态深度学习这几年的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

全球最强开源 MoE 模型来了,中文能力比肩 GPT-4,价格仅为 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

全球最强开源 MoE 模型来了,中文能力比肩 GPT-4,价格仅为 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

想象一下,一个人工智能模型,不仅拥有超越传统计算的能力,还能以更低的成本实现更高效的性能。这不是科幻,DeepSeek-V2[1],全球最强开源MoE模型来了。DeepSeek-V2是一个强大的专家混合(MoE)语言模型,具有训练经济、推理高效的特点。它由236B个参数组成,其中21B个参数用于激活每个标记。与DeepSeek67B相比,DeepSeek-V2性能更强,同时节省了42.5%的训练成本,减少了93.3%的KV缓存,最大生成吞吐量提高到5.76倍。DeepSeek是一家探索通用人工智

AI颠覆数学研究!菲尔兹奖得主、华裔数学家领衔11篇顶刊论文|陶哲轩转赞

Apr 09, 2024 am 11:52 AM

AI颠覆数学研究!菲尔兹奖得主、华裔数学家领衔11篇顶刊论文|陶哲轩转赞

Apr 09, 2024 am 11:52 AM

AI,的确正在改变数学。最近,一直十分关注这个议题的陶哲轩,转发了最近一期的《美国数学学会通报》(BulletinoftheAmericanMathematicalSociety)。围绕「机器会改变数学吗?」这个话题,众多数学家发表了自己的观点,全程火花四射,内容硬核,精彩纷呈。作者阵容强大,包括菲尔兹奖得主AkshayVenkatesh、华裔数学家郑乐隽、纽大计算机科学家ErnestDavis等多位业界知名学者。AI的世界已经发生了天翻地覆的变化,要知道,其中很多文章是在一年前提交的,而在这一

替代MLP的KAN,被开源项目扩展到卷积了

Jun 01, 2024 pm 10:03 PM

替代MLP的KAN,被开源项目扩展到卷积了

Jun 01, 2024 pm 10:03 PM

本月初,来自MIT等机构的研究者提出了一种非常有潜力的MLP替代方法——KAN。KAN在准确性和可解释性方面表现优于MLP。而且它能以非常少的参数量胜过以更大参数量运行的MLP。比如,作者表示,他们用KAN以更小的网络和更高的自动化程度重现了DeepMind的结果。具体来说,DeepMind的MLP有大约300,000个参数,而KAN只有约200个参数。KAN与MLP一样具有强大的数学基础,MLP基于通用逼近定理,而KAN基于Kolmogorov-Arnold表示定理。如下图所示,KAN在边上具

谷歌狂喜:JAX性能超越Pytorch、TensorFlow!或成GPU推理训练最快选择

Apr 01, 2024 pm 07:46 PM

谷歌狂喜:JAX性能超越Pytorch、TensorFlow!或成GPU推理训练最快选择

Apr 01, 2024 pm 07:46 PM

谷歌力推的JAX在最近的基准测试中性能已经超过Pytorch和TensorFlow,7项指标排名第一。而且测试并不是在JAX性能表现最好的TPU上完成的。虽然现在在开发者中,Pytorch依然比Tensorflow更受欢迎。但未来,也许有更多的大模型会基于JAX平台进行训练和运行。模型最近,Keras团队为三个后端(TensorFlow、JAX、PyTorch)与原生PyTorch实现以及搭配TensorFlow的Keras2进行了基准测试。首先,他们为生成式和非生成式人工智能任务选择了一组主流

你好,电动Atlas!波士顿动力机器人复活,180度诡异动作吓坏马斯克

Apr 18, 2024 pm 07:58 PM

你好,电动Atlas!波士顿动力机器人复活,180度诡异动作吓坏马斯克

Apr 18, 2024 pm 07:58 PM

波士顿动力Atlas,正式进入电动机器人时代!昨天,液压Atlas刚刚「含泪」退出历史舞台,今天波士顿动力就宣布:电动Atlas上岗。看来,在商用人形机器人领域,波士顿动力是下定决心要和特斯拉硬刚一把了。新视频放出后,短短十几小时内,就已经有一百多万观看。旧人离去,新角色登场,这是历史的必然。毫无疑问,今年是人形机器人的爆发年。网友锐评:机器人的进步,让今年看起来像人类的开幕式动作、自由度远超人类,但这真不是恐怖片?视频一开始,Atlas平静地躺在地上,看起来应该是仰面朝天。接下来,让人惊掉下巴

FisheyeDetNet:首个基于鱼眼相机的目标检测算法

Apr 26, 2024 am 11:37 AM

FisheyeDetNet:首个基于鱼眼相机的目标检测算法

Apr 26, 2024 am 11:37 AM

目标检测在自动驾驶系统当中是一个比较成熟的问题,其中行人检测是最早得以部署算法之一。在多数论文当中已经进行了非常全面的研究。然而,利用鱼眼相机进行环视的距离感知相对来说研究较少。由于径向畸变大,标准的边界框表示在鱼眼相机当中很难实施。为了缓解上述描述,我们探索了扩展边界框、椭圆、通用多边形设计为极坐标/角度表示,并定义一个实例分割mIOU度量来分析这些表示。所提出的具有多边形形状的模型fisheyeDetNet优于其他模型,并同时在用于自动驾驶的Valeo鱼眼相机数据集上实现了49.5%的mAP

特斯拉机器人进厂打工,马斯克:手的自由度今年将达到22个!

May 06, 2024 pm 04:13 PM

特斯拉机器人进厂打工,马斯克:手的自由度今年将达到22个!

May 06, 2024 pm 04:13 PM

特斯拉机器人Optimus最新视频出炉,已经可以在厂子里打工了。正常速度下,它分拣电池(特斯拉的4680电池)是这样的:官方还放出了20倍速下的样子——在小小的“工位”上,拣啊拣啊拣:这次放出的视频亮点之一在于Optimus在厂子里完成这项工作,是完全自主的,全程没有人为的干预。并且在Optimus的视角之下,它还可以把放歪了的电池重新捡起来放置,主打一个自动纠错:对于Optimus的手,英伟达科学家JimFan给出了高度的评价:Optimus的手是全球五指机器人里最灵巧的之一。它的手不仅有触觉

DualBEV:大幅超越BEVFormer、BEVDet4D,开卷!

Mar 21, 2024 pm 05:21 PM

DualBEV:大幅超越BEVFormer、BEVDet4D,开卷!

Mar 21, 2024 pm 05:21 PM

这篇论文探讨了在自动驾驶中,从不同视角(如透视图和鸟瞰图)准确检测物体的问题,特别是如何有效地从透视图(PV)到鸟瞰图(BEV)空间转换特征,这一转换是通过视觉转换(VT)模块实施的。现有的方法大致分为两种策略:2D到3D和3D到2D转换。2D到3D的方法通过预测深度概率来提升密集的2D特征,但深度预测的固有不确定性,尤其是在远处区域,可能会引入不准确性。而3D到2D的方法通常使用3D查询来采样2D特征,并通过Transformer学习3D和2D特征之间对应关系的注意力权重,这增加了计算和部署的