稀疏模型最新进展!马毅+LeCun强强联手:「白盒」非监督式学习

最近马毅教授和图灵奖得主Yann LeCun联手在ICLR 2023上发表了一篇论文,描述了一种极简和可解释的非监督式学习方法,不需要求助于数据增强、超参数调整或其他工程设计,就可以实现接近 SOTA SSL 方法的性能。

论文链接:https://arxiv.org/abs/2209.15261

该方法利用了稀疏流形变换,将稀疏编码、流形学习和慢特征分析(slow feature analysis)相结合。

采用单层确定性稀疏流形变换,在 MNIST 上可以达到99.3% 的 KNN top-1精度,在 CIFAR-10上可以达到81.1% 的 KNN top-1精度,在 CIFAR-100上可以达到53.2% 的 KNN top-1精度。

通过简单的灰度增强,模型在 CIFAR-10和 CIFAR-100上的精度分别达到83.2% 和57% ,这些结果显著地缩小了简单的「白盒」方法和 SOTA 方法之间的差距。

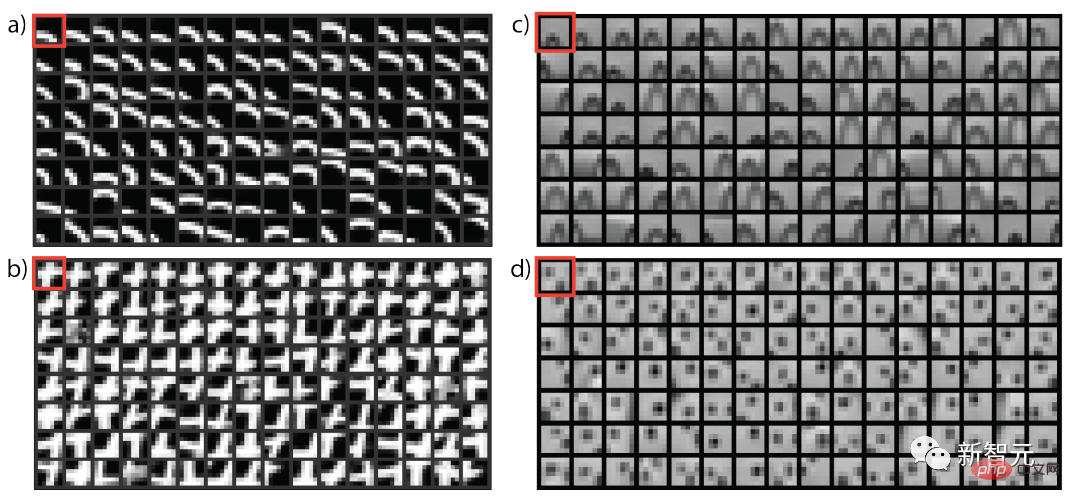

此外,文中还提供了可视化解释如何形成一个无监督的表征变换。该方法与潜在嵌入自监督方法密切相关,可以看作是最简单的 VICReg 方法。

尽管在我们简单的建设性模型和 SOTA 方法之间仍然存在很小的性能差距,但有证据表明,这是一个有希望的方向,可以实现一个原则性的、白盒式的非监督式学习。

文章第一作者Yubei Chen是纽约大学数据科学中心(CDS)和Meta基础人工智能研究(FAIR)的博士后助理,导师为Yann LeCun教授,博士毕业于加州大学伯克利分校的Redwood Center理论神经科学和伯克利人工智能研究所(BAIR),本科毕业于清华大学。

主要研究方向研究为计算神经科学学习和深度无监督(自监督)学习的交叉,研究结果增强了对大脑和机器无监督表征学习的计算原理的理解,并重塑对自然信号统计的认识。

马毅教授于1995年获得清华大学自动化与应用数学双学士学位,并于1997年获加州大学伯克利分校EECS硕士学位,2000年获数学硕士学位与EECS博士学位。目前是加州大学伯克利分校电子工程与计算机科学系教授,同时也是IEEE Fellow,ACM Fellow,SIAM Fellow。

Yann LeCun最著名的工作是在光学字符识别和计算机视觉上使用卷积神经网络(CNN),也被称为卷积网络之父;2019年他同Bengio以及Hinton共同获得计算机学界最高奖项图灵奖。

从最简单的无监督学习开始

在过去的几年里,无监督表征学习取得了巨大的进展,并且有望在数据驱动的机器学习中提供强大的可扩展性。

不过什么是学习到的表征,以及它究竟是如何以无监督的方式形成的,这些问题仍然不清楚;此外,是否存在一套支撑所有这些无监督表征的共同原则仍不清楚。

许多研究者已经意识到提高模型理解力的重要性,并采取了一些开创性的措施,试图简化SOTA方法,建立与经典方法之间的联系,统一不同的方法,使表征可视化,并从理论角度分析这些方法,并希望能够开发出一种不同的计算理论:使我们能够基于第一原理从数据中建立简单的、完全可以解释的「白盒」模型,该理论也可以为理解人脑中无监督学习的原则提供指导。

在这项工作中,研究人员又朝着这个目标迈出了一小步,试图建立一个最简单的 「白盒」无监督学习模型,并且不需要深度网络、projection heads、数据增强或其他各种工程设计。

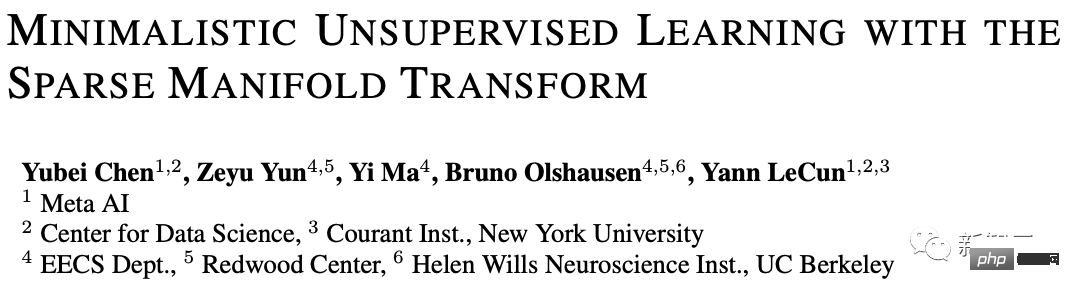

文中通过利用两个经典的无监督学习原则,即稀疏性(sparsity)和频谱嵌入(spectral embedding),建立了一个两层模型,在几个标准数据集上取得了非显著的基准结果。

实验结果表明,基于稀疏流形变换(sparse manifold transform)的两层模型,与latent-embedding自监督方法具有相同的objective,并且在没有任何数据增强的情况下,在MNIST上取得了99.3%的KNN最高1级准确率,在CIFAR-10上取得了81.1%的KNN最高1级准确率,在CIFAR-100上取得了53.2%的准确率。

通过简单的灰度增强,进一步在CIFAR-10上实现了83.2%的KNN top-1精度,在CIFAR-100上实现了57%的KNN top-1精度。

这些结果为缩小「白盒」模型和SOTA自监督(SSL)模型之间的差距迈出了重要一步,虽然差距仍然很明显,但研究人员认为进一步缩小差距有可能对无监督表征的学习获得更深入的理解,这也是通往该理论实用化的一条有前景的研究路线。

三个基本问题

什么是无监督(自监督)的re-presentation

从本质上讲,原始信号的任何非同一性转换(non-identity transformation)都可以被称为表征(re-presentation),不过学术界更感兴趣的是那些有用的转换。

无监督re-presentation学习的一个宏观目标是找到一个函数,将原始数据转换到一个新的空间,使「相似」的东西被放在更接近的地方;同时,新的空间不应该是一个collapsed且trivial的,也就是说,必须保留数据的几何或随机结构。

如果这一目标得以实现,那么「不相似」的内容自然会在表示空间中被放置得很远。

相似性(similarity)从何而来?

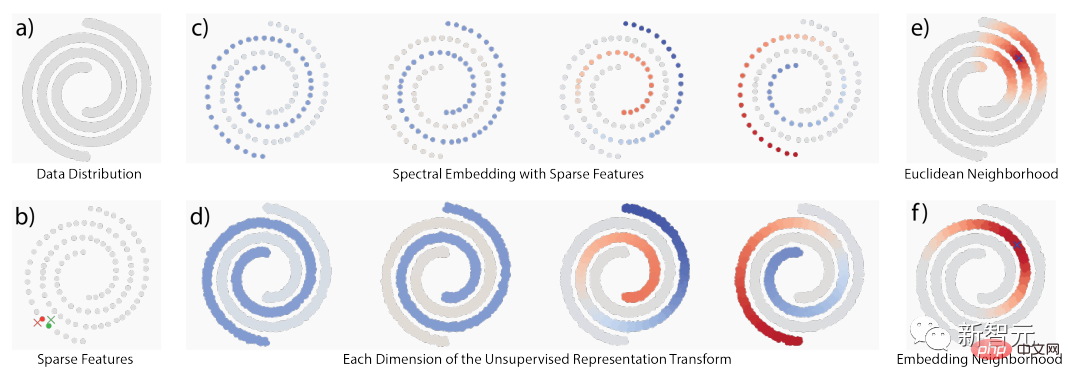

相似性主要来自三个经典的想法:1)时序共现,2)空间共现;和3)原始信号空间中的局部相邻(local neighborhoods)。

当基础结构为几何结构时,这些想法在相当程度上是重叠的;但当结构为随机结构时,它们在概念上也会有所不同,下图展现了流形结构(manifold structure)和随机共现结构(stochastic co-occurrence structure.)之间的区别。

利用局部性,相关工作提出了两种无监督的学习方法:流形学习和共现统计建模,这些想法很多都达到了谱系分解的表述或密切相关的矩阵分解表述。

流形学习的理念是,只有原始信号空间中的局部邻域才是可信的,通过综合考虑所有的局部邻域,就会出现全局几何,即「全局思考,局部适配」(think globally, fit locally)。

相比之下,共现统计建模遵循一种概率理念,因为有些结构不能用连续流形来建模,所以它也是对流形理念的补充。

一个最明显的例子来自于自然语言,其中的原始数据基本不会来自于平滑的几何,比如在单词嵌入中,「西雅图」和「达拉斯」的嵌入可能很相似,尽管它们并没有频繁共现,其根本原因是它们有类似的上下文模式。

概率和流形的观点对于理解「相似性」是相互补充的 ,当有了相似性的定义后,就可以构造一个转换,使得相似的概念离得更近。

本文如何建立表征转换?基本原则:稀疏性和低秩(low rank)

大体上来说,可以用稀疏性来处理数据空间中的局部性和分解,以建立support;然后用低频函数构建表征变换,将相似的值分配给support上的相似点。

整个过程也可以称为稀疏流形变换(sparse manifold transform)。

以上是稀疏模型最新进展!马毅+LeCun强强联手:「白盒」非监督式学习的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

全球最强开源 MoE 模型来了,中文能力比肩 GPT-4,价格仅为 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

全球最强开源 MoE 模型来了,中文能力比肩 GPT-4,价格仅为 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

想象一下,一个人工智能模型,不仅拥有超越传统计算的能力,还能以更低的成本实现更高效的性能。这不是科幻,DeepSeek-V2[1],全球最强开源MoE模型来了。DeepSeek-V2是一个强大的专家混合(MoE)语言模型,具有训练经济、推理高效的特点。它由236B个参数组成,其中21B个参数用于激活每个标记。与DeepSeek67B相比,DeepSeek-V2性能更强,同时节省了42.5%的训练成本,减少了93.3%的KV缓存,最大生成吞吐量提高到5.76倍。DeepSeek是一家探索通用人工智

替代MLP的KAN,被开源项目扩展到卷积了

Jun 01, 2024 pm 10:03 PM

替代MLP的KAN,被开源项目扩展到卷积了

Jun 01, 2024 pm 10:03 PM

本月初,来自MIT等机构的研究者提出了一种非常有潜力的MLP替代方法——KAN。KAN在准确性和可解释性方面表现优于MLP。而且它能以非常少的参数量胜过以更大参数量运行的MLP。比如,作者表示,他们用KAN以更小的网络和更高的自动化程度重现了DeepMind的结果。具体来说,DeepMind的MLP有大约300,000个参数,而KAN只有约200个参数。KAN与MLP一样具有强大的数学基础,MLP基于通用逼近定理,而KAN基于Kolmogorov-Arnold表示定理。如下图所示,KAN在边上具

你好,电动Atlas!波士顿动力机器人复活,180度诡异动作吓坏马斯克

Apr 18, 2024 pm 07:58 PM

你好,电动Atlas!波士顿动力机器人复活,180度诡异动作吓坏马斯克

Apr 18, 2024 pm 07:58 PM

波士顿动力Atlas,正式进入电动机器人时代!昨天,液压Atlas刚刚「含泪」退出历史舞台,今天波士顿动力就宣布:电动Atlas上岗。看来,在商用人形机器人领域,波士顿动力是下定决心要和特斯拉硬刚一把了。新视频放出后,短短十几小时内,就已经有一百多万观看。旧人离去,新角色登场,这是历史的必然。毫无疑问,今年是人形机器人的爆发年。网友锐评:机器人的进步,让今年看起来像人类的开幕式动作、自由度远超人类,但这真不是恐怖片?视频一开始,Atlas平静地躺在地上,看起来应该是仰面朝天。接下来,让人惊掉下巴

AI颠覆数学研究!菲尔兹奖得主、华裔数学家领衔11篇顶刊论文|陶哲轩转赞

Apr 09, 2024 am 11:52 AM

AI颠覆数学研究!菲尔兹奖得主、华裔数学家领衔11篇顶刊论文|陶哲轩转赞

Apr 09, 2024 am 11:52 AM

AI,的确正在改变数学。最近,一直十分关注这个议题的陶哲轩,转发了最近一期的《美国数学学会通报》(BulletinoftheAmericanMathematicalSociety)。围绕「机器会改变数学吗?」这个话题,众多数学家发表了自己的观点,全程火花四射,内容硬核,精彩纷呈。作者阵容强大,包括菲尔兹奖得主AkshayVenkatesh、华裔数学家郑乐隽、纽大计算机科学家ErnestDavis等多位业界知名学者。AI的世界已经发生了天翻地覆的变化,要知道,其中很多文章是在一年前提交的,而在这一

谷歌狂喜:JAX性能超越Pytorch、TensorFlow!或成GPU推理训练最快选择

Apr 01, 2024 pm 07:46 PM

谷歌狂喜:JAX性能超越Pytorch、TensorFlow!或成GPU推理训练最快选择

Apr 01, 2024 pm 07:46 PM

谷歌力推的JAX在最近的基准测试中性能已经超过Pytorch和TensorFlow,7项指标排名第一。而且测试并不是在JAX性能表现最好的TPU上完成的。虽然现在在开发者中,Pytorch依然比Tensorflow更受欢迎。但未来,也许有更多的大模型会基于JAX平台进行训练和运行。模型最近,Keras团队为三个后端(TensorFlow、JAX、PyTorch)与原生PyTorch实现以及搭配TensorFlow的Keras2进行了基准测试。首先,他们为生成式和非生成式人工智能任务选择了一组主流

特斯拉机器人进厂打工,马斯克:手的自由度今年将达到22个!

May 06, 2024 pm 04:13 PM

特斯拉机器人进厂打工,马斯克:手的自由度今年将达到22个!

May 06, 2024 pm 04:13 PM

特斯拉机器人Optimus最新视频出炉,已经可以在厂子里打工了。正常速度下,它分拣电池(特斯拉的4680电池)是这样的:官方还放出了20倍速下的样子——在小小的“工位”上,拣啊拣啊拣:这次放出的视频亮点之一在于Optimus在厂子里完成这项工作,是完全自主的,全程没有人为的干预。并且在Optimus的视角之下,它还可以把放歪了的电池重新捡起来放置,主打一个自动纠错:对于Optimus的手,英伟达科学家JimFan给出了高度的评价:Optimus的手是全球五指机器人里最灵巧的之一。它的手不仅有触觉

FisheyeDetNet:首个基于鱼眼相机的目标检测算法

Apr 26, 2024 am 11:37 AM

FisheyeDetNet:首个基于鱼眼相机的目标检测算法

Apr 26, 2024 am 11:37 AM

目标检测在自动驾驶系统当中是一个比较成熟的问题,其中行人检测是最早得以部署算法之一。在多数论文当中已经进行了非常全面的研究。然而,利用鱼眼相机进行环视的距离感知相对来说研究较少。由于径向畸变大,标准的边界框表示在鱼眼相机当中很难实施。为了缓解上述描述,我们探索了扩展边界框、椭圆、通用多边形设计为极坐标/角度表示,并定义一个实例分割mIOU度量来分析这些表示。所提出的具有多边形形状的模型fisheyeDetNet优于其他模型,并同时在用于自动驾驶的Valeo鱼眼相机数据集上实现了49.5%的mAP

单卡跑Llama 70B快过双卡,微软硬生生把FP6搞到了A100里 | 开源

Apr 29, 2024 pm 04:55 PM

单卡跑Llama 70B快过双卡,微软硬生生把FP6搞到了A100里 | 开源

Apr 29, 2024 pm 04:55 PM

FP8和更低的浮点数量化精度,不再是H100的“专利”了!老黄想让大家用INT8/INT4,微软DeepSpeed团队在没有英伟达官方支持的条件下,硬生生在A100上跑起FP6。测试结果表明,新方法TC-FPx在A100上的FP6量化,速度接近甚至偶尔超过INT4,而且拥有比后者更高的精度。在此基础之上,还有端到端的大模型支持,目前已经开源并集成到了DeepSpeed等深度学习推理框架中。这一成果对大模型的加速效果也是立竿见影——在这种框架下用单卡跑Llama,吞吐量比双卡还要高2.65倍。一名