基于GAN生成流畅视频,效果很能打:无纹理粘连、抖动缓解

近年来,基于生成对抗式网络(Generative Adversarial Network, GAN)的图片生成研究工作取得了显著的进展。除了能够生成高分辨率、逼真的图片之外,许多创新应用也应运而生,诸如图片个性化编辑、图片动画化等。然而,如何利用 GAN 进行视频生成仍然是一个颇有挑战的问题。

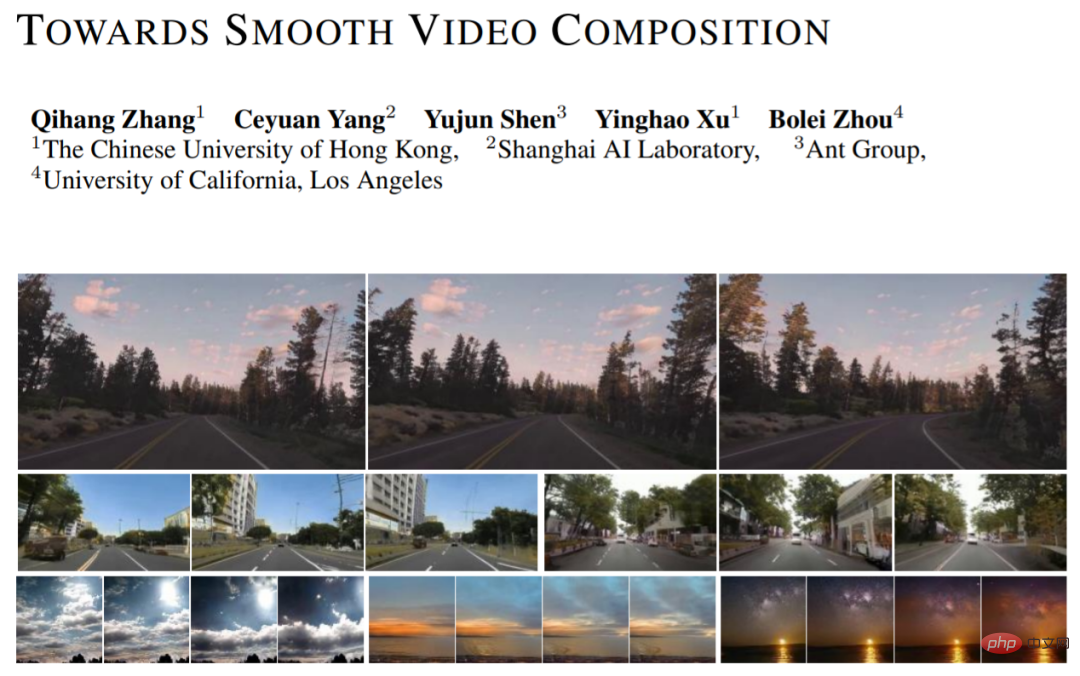

除了对单帧图片的建模之外,视频生成还需要学习复杂的时序关系。近来,来自香港中文大学、上海人工智能实验室、蚂蚁技术研究院以及加州大学洛杉矶分校的研究者提出了一个新的视频生成方法(Towards Smooth Video Composition)。文中,他们针对不同跨度(短时范围、适中范围、长范围)的时序关系,分别进行了细致的建模与改进,并在多个数据集上取得了相较于之前工作大幅度的提升。该工作为基于 GAN 的视频生成方向提供了一个简单且有效的新基准。

- 论文地址:https://arxiv.org/pdf/2212.07413.pdf

- 项目代码链接:https://github.com/genforce/StyleSV

模型架构

基于 GAN 的图像生成网络可以表示为:I=G(Z),其中 Z 是随机变量,G 是生成网络,I 是生成图片。我们可以简单地将此框架拓展到视频生成范畴:I_i=G(z_i),i=[1,...,N],其中我们一次性采样 N 个随机变量 z_i,每一个随机变量 z_i 对应生成一帧图片 I_i。将生成的图片在时间维度堆叠起来就可以得到生成的视频。

MoCoGAN, StyleGAN-V 等工作在此基础上提出了一种解耦的表达:I_i=G(u, v_i),i=[1,...,N],其中 u 表示控制内容的随机变量,v_i 表示控制动作的随机变量。这种表达认为,所有帧共享相同的内容,并具有独特的动作。通过这种解耦的表达,我们可以更好地生成内容风格一致,同时具有多变真实的动作视频。新工作采纳了 StyleGAN-V 的设计,并将其作为基准。

视频生成的难点:如何有效并合理地建模时序关系?

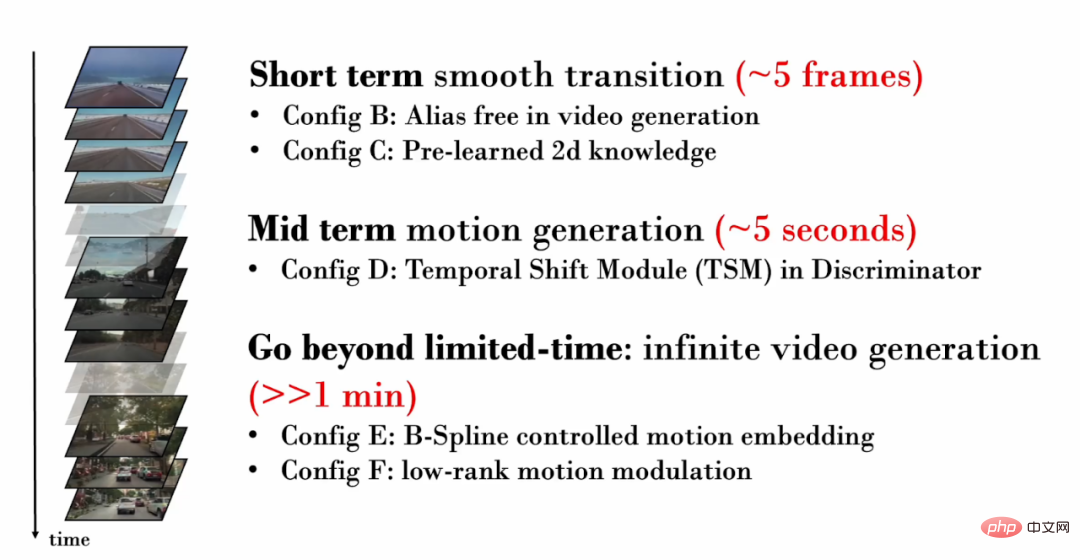

新工作着眼于不同跨度(短时范围、适中范围、长范围)的时序关系,分别进行了细致的建模与改进:

1. 短时间(~5 帧)时序关系

让我们首先考虑仅有几帧的视频。这些短时间的视频帧通常包含了非常相似的内容,仅仅展示了非常细微的动作。因此,真实地生成帧间的细微动作至关重要。然而,StyleGAN-V 生成的视频中出现了严重的纹理粘连(texture sticking)现象。

纹理粘连指的是生成的部分内容对特定坐标产生了依赖,造成了 “黏” 在固定区域上的现象。在图像生成领域中,StyleGAN3 通过细致的信号处理、扩大 padding 范围等操作缓解了纹理粘连问题。本工作验证了同样的技术对视频生成仍然有效。

在下图的可视化中,我们追踪视频每一帧中相同位置的像素。容易发现,在 StyleGAN-V 的视频中,有些内容长期 “黏” 在固定坐标,并没有随着时间移动,因此在可视化中产生了“笔刷现象”。而在新工作生成的视频中,所有像素都展示了自然的移动。

然而,研究员发现,引用 StyleGAN3 的 backbone 会让图像生成质量有所下降。为了缓解这个问题,他们引入了图像层面的预训练。在预训练阶段, 网络仅需考虑视频中某一帧的生成质量,无需学习时序范围的建模,从而更易学习有关图像分布知识。

2. 中等长度(~5 秒)时序关系

随着生成的视频拥有更多的帧数,它将能够展现更具体的动作。因此,确保生成的视频中拥有真实的动作非常重要。例如,如果我们想要生成第一人称开车的视频,就应该生成逐渐后退的地面、街景,临车也应当遵循自然的驾驶轨迹。

在对抗训练中,为了确保生成网络获得足够的训练监督,判别网络至关重要。因此在视频生成中,为了确保生成网络能够生成真实的动作,判别网络需要对多帧中的时序关系进行建模,并捕获生成的不真实的运动。然而,在之前的工作中,判别网络仅仅使用了简单的拼接操作(concatenation operation)来进行时序建模:y = cat (y_i),其中 y_i 表示单帧特征,y 表示时域融合后的特征。

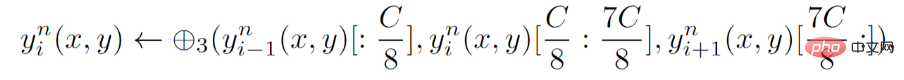

针对判别网络,新工作提出了一种显式的时序建模,即在判别网络的每一层,引入时序移位模块(Temporal Shift Module,TSM)。TSM 来自动作识别领域,通过简单的移位操作实现时序上的信息交换:

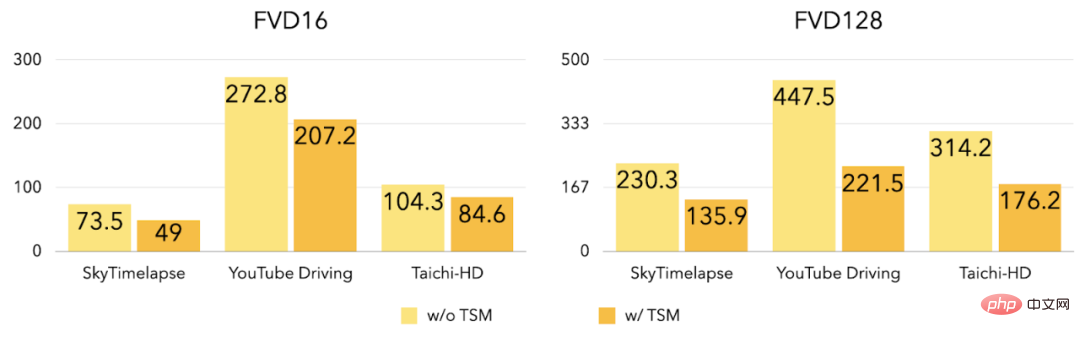

实验表明,在引入 TSM 之后,三个数据集上的 FVD16,FVD128 得到了很大程度的降低。

3. 无限长视频生成

先前介绍的改进主要围绕短时和适中时间长度的视频生成,新工作进一步探索了如何生成高质量的任意长度(包括无限长)的视频。之前工作(StyleGAN-V)能够生成无限长的视频,然而视频中却包含着非常明显的周期性抖动现象:

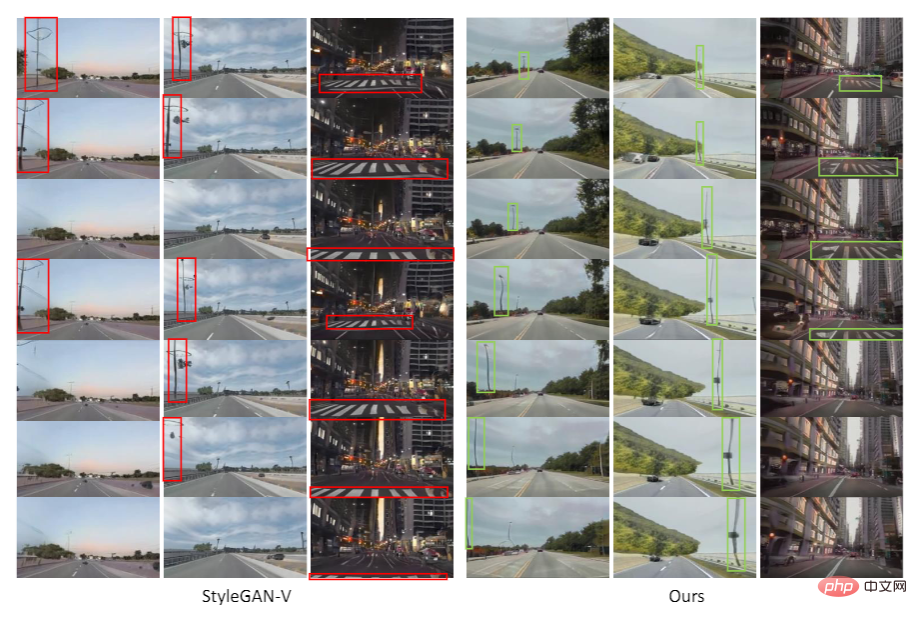

如图所示,在 StyleGAN-V 生成的视频中,随着自车前进,斑马线原本正常的后退,随后却突然改为向前运动。本工作发现,动作特征(motion embedding)的不连续性导致了此抖动现象。

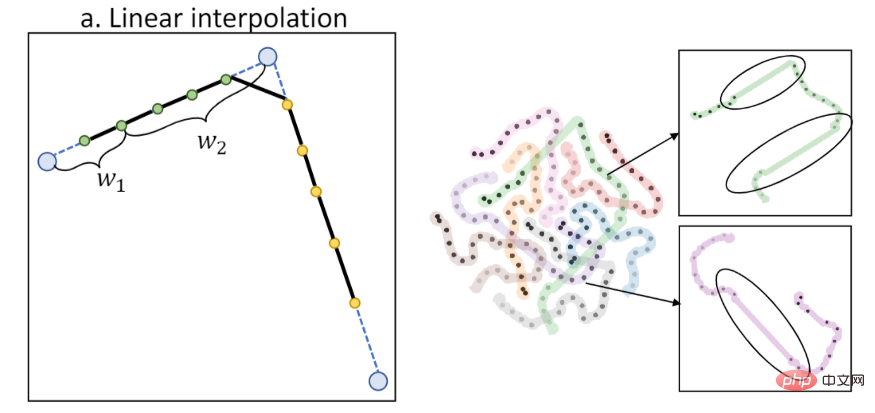

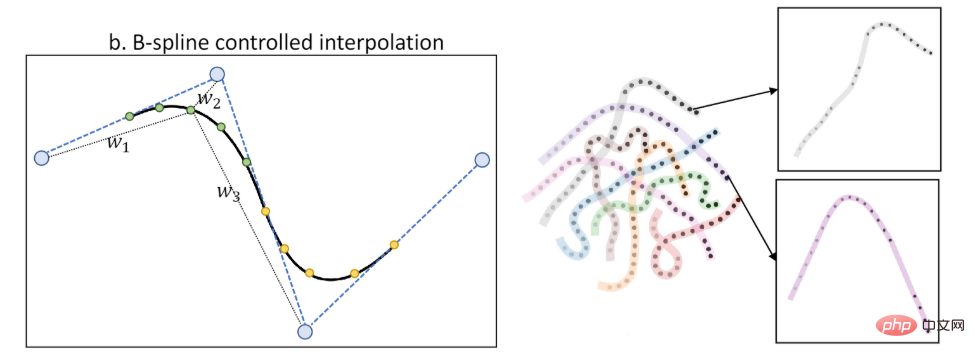

先前工作采用线性插值来计算动作特征,然而线性插值会导致一阶不连续性,如下图所示(左边为插值示意图,右图为 T-SNE 特征可视化):

本工作提出了 B 样条控制的动作特征(B-Spline based motion embedding)。通过 B 样条进行插值,能够获得关于时间更加平滑的动作特征,如图所示(左边为插值示意图,右图为 T-SNE 特征可视化):

通过引入 B 样条控制的动作特征,新工作缓解了抖动现象:

如图所示,StyleGAN-V 生成的视频中,路灯、地面会突然改变运动方向。而在新工作生成的视频中,运动的方向是一致、自然的。

同时,新工作针对动作特征还提出了一个低秩(low rank)的约束,来进一步缓解周期性重复内容的出现。

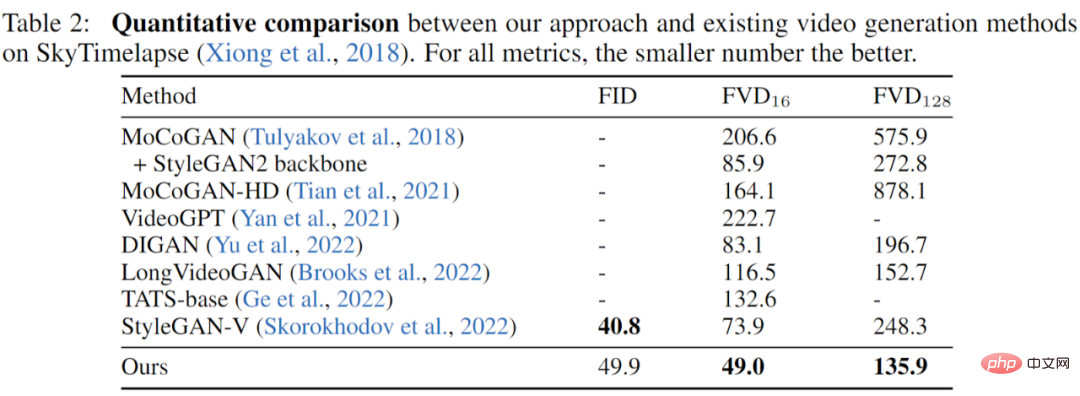

实验

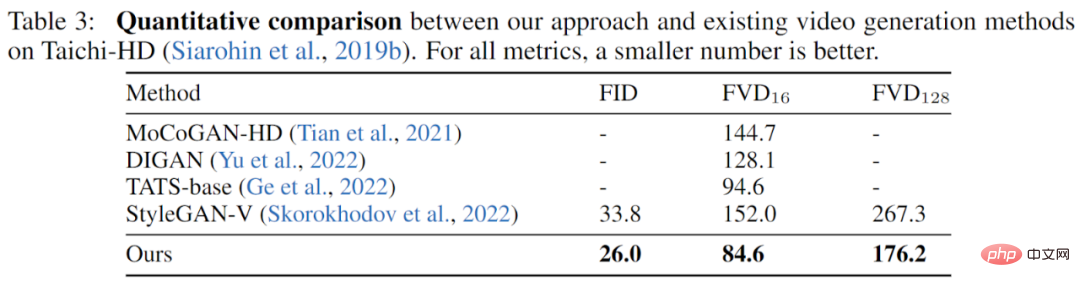

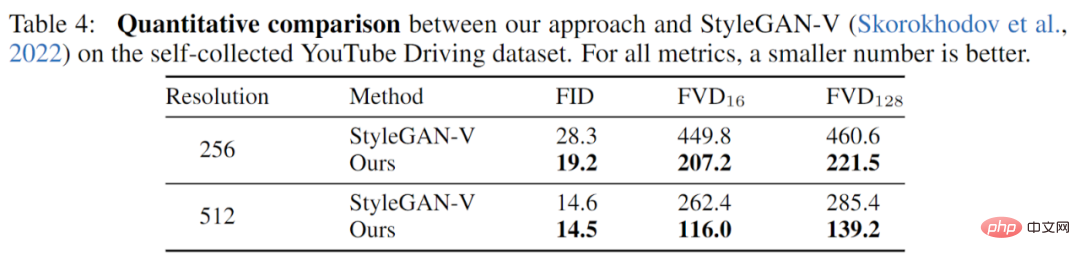

工作在三个数据集(YouTube Driving, Timelapse, Taichi-HD)上进行了充分的实验,并充分对比了先前的工作,结果显示,新工作在图片质量(FID)以及视频质量(FVD)上,都取得了充分的提升。

SkyTimelapse 实验结果:

Taichi-HD 实验结果:

YouTube Driving 实验结果:

总结

新工作基于 GAN 模型,提出了一个全新的视频生成基准,从不同尺度的时序关系出发,提出了新颖、有效地改进。在多个数据集上的实验显示,新工作成功取得了大幅度超越先前工作的视频质量。

以上是基于GAN生成流畅视频,效果很能打:无纹理粘连、抖动缓解的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

怎么在番茄免费小说app中写小说 分享番茄小说写小说方法教程

Mar 28, 2024 pm 12:50 PM

怎么在番茄免费小说app中写小说 分享番茄小说写小说方法教程

Mar 28, 2024 pm 12:50 PM

番茄小说是一款非常热门的小说阅读软件,我们在番茄小说中经常会有新的小说和漫画可以去阅读,每一本小说和漫画都很有意思,很多小伙伴也想着要去写小说来赚取赚取零花钱,在把自己想要写的小说内容编辑成文字,那么我们要怎么样在这里面去写小说呢?小伙伴们都不知道,那就让我们一起到本站本站中花点时间来看写小说的方法介绍吧。分享番茄小说写小说方法教程 1、首先在手机上打开番茄免费小说app,点击个人中心——作家中心 2、跳转到番茄作家助手页面——点击创建新书在小说的结

微信删除的人如何找回(简单教程告诉你如何恢复被删除的联系人)

May 01, 2024 pm 12:01 PM

微信删除的人如何找回(简单教程告诉你如何恢复被删除的联系人)

May 01, 2024 pm 12:01 PM

而后悔莫及、人们常常会因为一些原因不小心将某些联系人删除、微信作为一款广泛使用的社交软件。帮助用户解决这一问题,本文将介绍如何通过简单的方法找回被删除的联系人。1.了解微信联系人删除机制这为我们找回被删除的联系人提供了可能性、微信中的联系人删除机制是将其从通讯录中移除,但并未完全删除。2.使用微信内置“通讯录恢复”功能微信提供了“通讯录恢复”节省时间和精力,用户可以通过该功能快速找回之前被删除的联系人,功能。3.进入微信设置页面点击右下角,打开微信应用“我”再点击右上角设置图标、进入设置页面,,

抖音发布他人视频侵权吗?它怎样剪辑视频不算侵权?

Mar 21, 2024 pm 05:57 PM

抖音发布他人视频侵权吗?它怎样剪辑视频不算侵权?

Mar 21, 2024 pm 05:57 PM

随着短视频平台的兴起,抖音成为了大家日常生活中不可或缺的一部分。在抖音上,我们可以看到来自世界各地的有趣视频。有些人喜欢发布他人的视频,这就引发了一个问题:抖音发布他人视频侵权吗?本文将围绕这个问题展开讨论,告诉大家怎样剪辑视频不算侵权,以及如何避免侵权问题。一、抖音发布他人视频侵权吗?根据我国《著作权法》的规定,未经著作权人许可,擅自使用其作品,属于侵权行为。因此,在抖音上发布他人视频,如果未经原作者或著作权人许可,就属于侵权行为。二、怎样剪辑视频不算侵权?1.使用公共领域或已授权的内容:公共

抖音发布视频如何赚收益?新手小白怎么在抖音上赚钱啊?

Mar 21, 2024 pm 08:17 PM

抖音发布视频如何赚收益?新手小白怎么在抖音上赚钱啊?

Mar 21, 2024 pm 08:17 PM

抖音,这个全民短视频平台,不仅让我们在闲暇时间享受到各种有趣、新奇的短视频,同时也给了我们一个展示自我、实现价值的舞台。那么,如何在抖音发布视频赚取收益呢?本文将详细解答这个问题,帮助你在抖音上赚取更多的收益。一、抖音发布视频如何赚收益?发布视频在抖音上获得一定的播放量后,可以有机会参与广告分成计划。这一收益方式是抖音用户最为熟悉的之一,也是许多创作者主要的收入来源。抖音根据账号权重、视频内容以及观众反馈等多种因素来决定是否提供广告分成的机会。抖音平台允许观众通过发送礼物来支持自己喜欢的创作者,

如何发布小红书视频作品?发视频要注意什么?

Mar 23, 2024 pm 08:50 PM

如何发布小红书视频作品?发视频要注意什么?

Mar 23, 2024 pm 08:50 PM

随着短视频平台的兴起,小红书成为了许多人分享生活、表达自我、获取流量的平台。在这个平台上,发布视频作品是一种非常受欢迎的互动方式。那么,如何发布小红书视频作品呢?一、如何发布小红书视频作品?首先,确保准备好一段适合分享的视频内容。你可以利用手机或其他摄像设备进行拍摄,需要注意画质和声音的清晰度。2.剪辑视频:为了让作品更具吸引力,可以对视频进行剪辑。可以使用专业的视频剪辑软件,如抖音、快手等,添加滤镜、音乐、字幕等元素。3.选择封面:封面是吸引用户点击的关键,选择一张清晰、有趣的图片作为封面,让

手机版龙蛋孵化方法大揭秘(一步一步教你如何成功孵化手机版龙蛋)

May 04, 2024 pm 06:01 PM

手机版龙蛋孵化方法大揭秘(一步一步教你如何成功孵化手机版龙蛋)

May 04, 2024 pm 06:01 PM

手机游戏成为了人们生活中不可或缺的一部分,随着科技的发展。它以其可爱的龙蛋形象和有趣的孵化过程吸引了众多玩家的关注,而其中一款备受瞩目的游戏就是手机版龙蛋。帮助玩家们在游戏中更好地培养和成长自己的小龙,本文将向大家介绍手机版龙蛋的孵化方法。1.选择合适的龙蛋种类玩家需要仔细选择自己喜欢并且适合自己的龙蛋种类,根据游戏中提供的不同种类的龙蛋属性和能力。2.提升孵化机的等级玩家需要通过完成任务和收集道具来提升孵化机的等级,孵化机的等级决定了孵化速度和孵化成功率。3.收集孵化所需的资源玩家需要在游戏中

手机字体大小设置方法(轻松调整手机字体大小)

May 07, 2024 pm 03:34 PM

手机字体大小设置方法(轻松调整手机字体大小)

May 07, 2024 pm 03:34 PM

字体大小的设置成为了一项重要的个性化需求,随着手机成为人们日常生活的重要工具。以满足不同用户的需求、本文将介绍如何通过简单的操作,提升手机使用体验,调整手机字体大小。为什么需要调整手机字体大小-调整字体大小可以使文字更清晰易读-适合不同年龄段用户的阅读需求-方便视力不佳的用户使用手机系统自带字体大小设置功能-如何进入系统设置界面-在设置界面中找到并进入"显示"选项-找到"字体大小"选项并进行调整第三方应用调整字体大小-下载并安装支持字体大小调整的应用程序-打开应用程序并进入相关设置界面-根据个人

微博发视频怎么不压缩画质_微博发视频不压缩画质方法

Mar 30, 2024 pm 12:26 PM

微博发视频怎么不压缩画质_微博发视频不压缩画质方法

Mar 30, 2024 pm 12:26 PM

1、首先打开手机微博,点击右下角【我】(如图所示)。2、接着点击右上角【齿轮】打开设置(如图所示)。3、然后找到并打开【通用设置】(如图所示)。4、随后进入【视频随着】选项(如图所示)。5、再打开【视频上传清晰度】设置(如图所示)。6、最后选择【原画质】就能不压缩了(如图所示)。