无需下游训练,Tip-Adapter大幅提升CLIP图像分类准确率

- 论文链接:https://arxiv.org/pdf/2207.09519.pdf

- 代码链接:https://github.com/gaopengcuhk/Tip-Adapter

一.研究背景

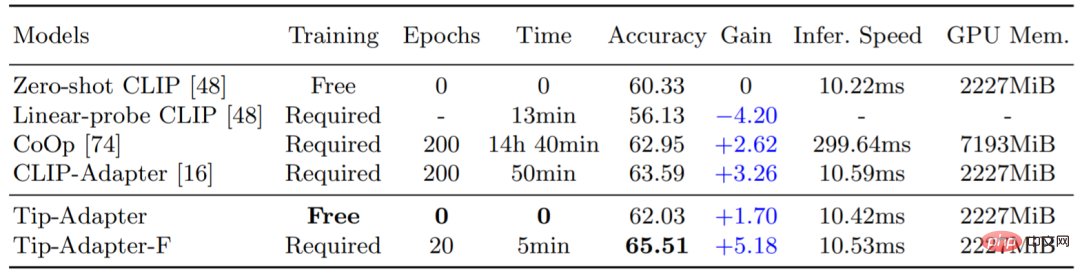

对比性图像语言预训练模型(CLIP)在近期展现出了强大的视觉领域迁移能力,可以在一个全新的下游数据集上进行 zero-shot 图像识别。为了进一步提升 CLIP 的迁移性能,现有方法使用了 few-shot 的设置,例如 CoOp 和 CLIP-Adapter,即提供了少量下游数据集的训练数据,使得 CLIP 能够更好的针对不同的视觉场景做出调整。但是,这种额外的训练步骤会带来不小的时间和空间资源开销,一定程度上影响了 CLIP 固有的快速知识迁移能力。因此,我们提出了 Tip-Adapter,一种不需要额外下游训练并且能很大程度提升 CLIP 准确率的 few-shot 图像分类方法。基于此,我们又提出了一种仅需要少量微调就能达到 state-of-the-art 性能的方案:Tip-Adapter-F,实现了效率和性能的最佳折中。如下表 1 所示,Tip-Adapter 不需要任何训练时间,即可以将 CLIP 在 ImageNet 数据集提升 + 1.7% 准确率(Accuracy),而 Tip-Adapter-F 仅需要之前方案十分之一的训练时间(Epochs,Time),就可以实现现有最佳的分类性能。

表 1:不同方案在 ImageNet 数据集上 16-shot 的图像分类准确率和训练时间的比较

二.研究方法

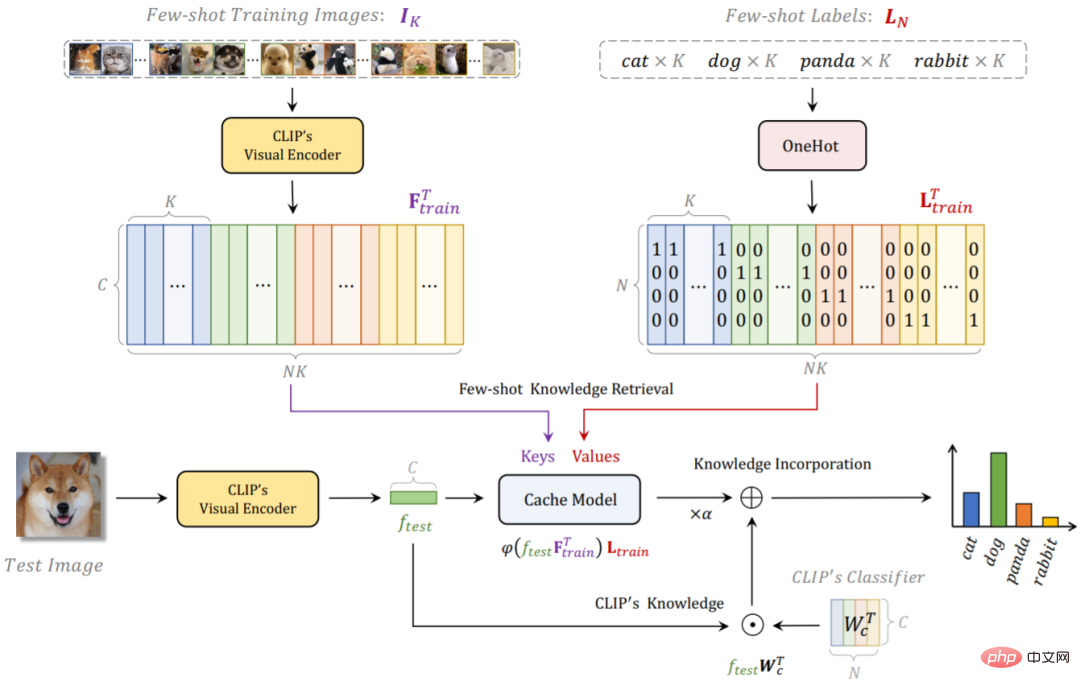

1.Tip-Adapter

Tip-Adapter 的整体网络结构如下图 1 所示,对于给定的 few-shot 训练数据集和标签,我们借助 CLIP 通过一个非训练的方案来构建一个缓存模型(Cache Model),它存储了来自下游训练数据的分类知识;在测试时,Tip-Adapter 通过将 Cache Model 的预测和原始 CLIP 的预测进行线性加和,来得到更强的最终分类结果。

详细的来说,我们使用 CLIP 预训练好的视觉编码器(Visual Encoder)来提取 few-shot 训练集所有图片的特征,作为 Cache Model 的 Keys;并且将对应的图片标签转化为 one-hot 编码的形式,作为 Cache Model 的 Values。这种 Key-Value Cache Model 的构建方法由于使用的是已经预训练好的 Visual Encoder,所以不需要任何训练开销;并且考虑到 few-shot 训练集中,每一个类别只含有少量的图片(1~16 shots),Cache Model 也几乎不会占用额外的显存开销,参考表一中的 GPU Mem. 指标。

对于一张测试图片,我们首先会利用 CLIP 的 Visual Encoder 来得到它的特征,再将该特征视为 Query 去 Cache Model 中进行下游 few-shot 数据的知识检索。由于 Keys 也是由 CLIP 的 Visual Encoder 提取得倒,因此和测试图片特征 Query 同源,我们可以直接计算它们之间的余弦相似度得倒一个 Key-Query 的邻接矩阵,此矩阵可以看作是每一个对应 Value 的权重。因此,我们可以计算 Values 的加权和来得到该测试图像通过检索 Cache Model 得到的分类预测。除此之外,我们还可以通过将测试图片特征和 CLIP 的 Textual Encoder 文本特征进行匹配,来得到 CLIP 的 zero-shot 预测。通过将两者进行线性加权求和,我们得到了最终的分类预测,该预测既蕴含了 CLIP 预训练的图像语言对比性知识,也结合了下游新数据集的 few-shot 知识,因此可以实现更强的图像分类准确率。

基于 Tip-Adapter 的网络结构,我们可以进一步将 Cache Model 中的 Keys 部分变为学习参数,即可以通过训练来进行更新,该方案为 Tip-Adapter-F。借助已经构建好的 Cache Model,Tip-Adapter-F 仅需要现有 CLIP-Adapter 十分之一的训练回合数和时间,就可以实现更高的性能,如表一所示。

图 1:Tip-Adapter 和 Tip-Adapter-F 的网络流程图

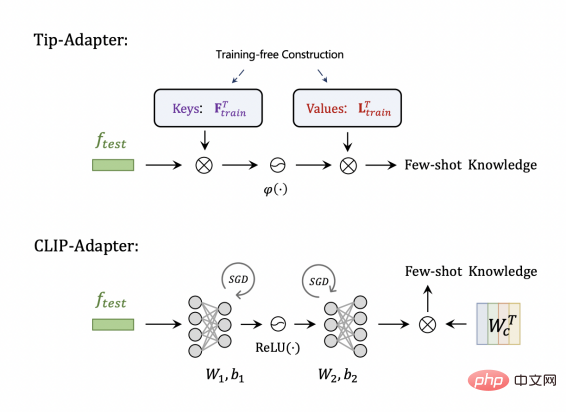

2.Tip-Adapter 和现有方案的区别与联系

对比 CLIP-Adapter,如图 2 所示,Tip-Adapter 存储的 Keys 和 Values 其实可以分别对应于 CLIP-Adapter 中 adapter 结构的两个线性层,只不过前者是不需要训练来构建的,后者是随机初始化,然后需要训练来学习最佳的参数。

图 2:Tip-Adapter 相比于 CLIP-Adapter

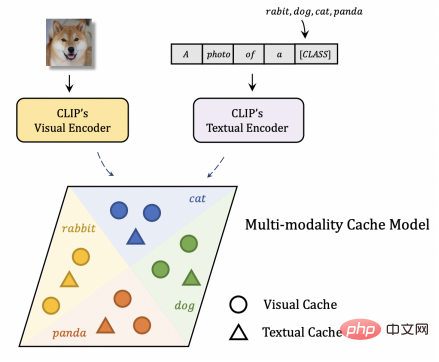

对比现有的其他构建 Cache Model 的方案,如图 3 所示,Tip-Adapter 的 Cache Model 可以看作是一种多模态的视觉语言 Cache。因为 CLIP 的 Textual Encoder 输出的特征可以看作是文本的 Key-Value,即相当于测试图片特征作为 Query,分别在视觉和文本的 Cache 中检索知识,相对于现有的仅含视觉 Cache 的方案,Tip-Adapter 能够利用多模态知识得到更强的识别性能。

图 3:Tip-Adapter 相比于其他构建 Cache Model 的方案

三.实验结果

1. 在 ImageNet 的分类准确率

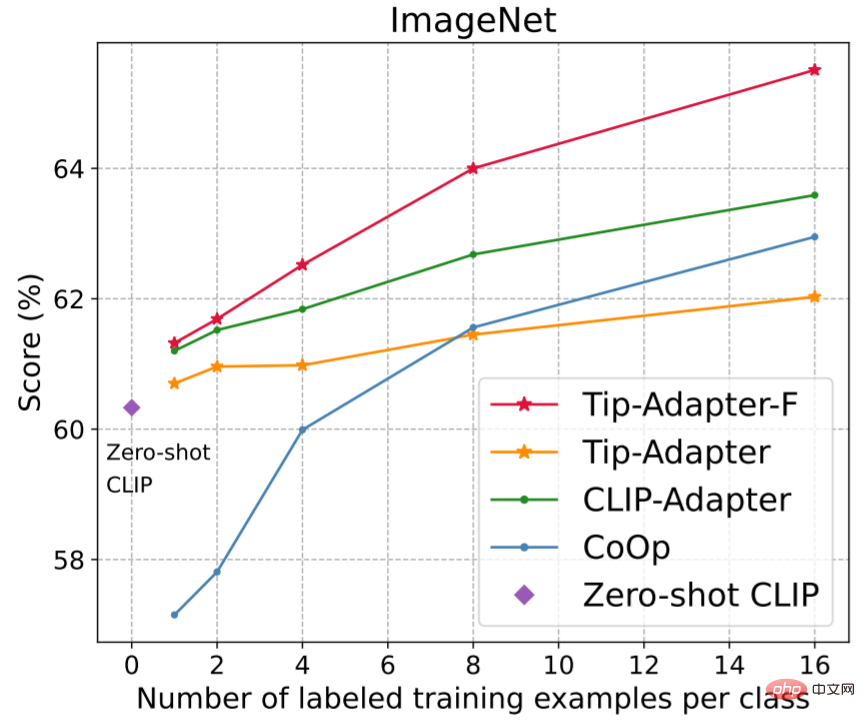

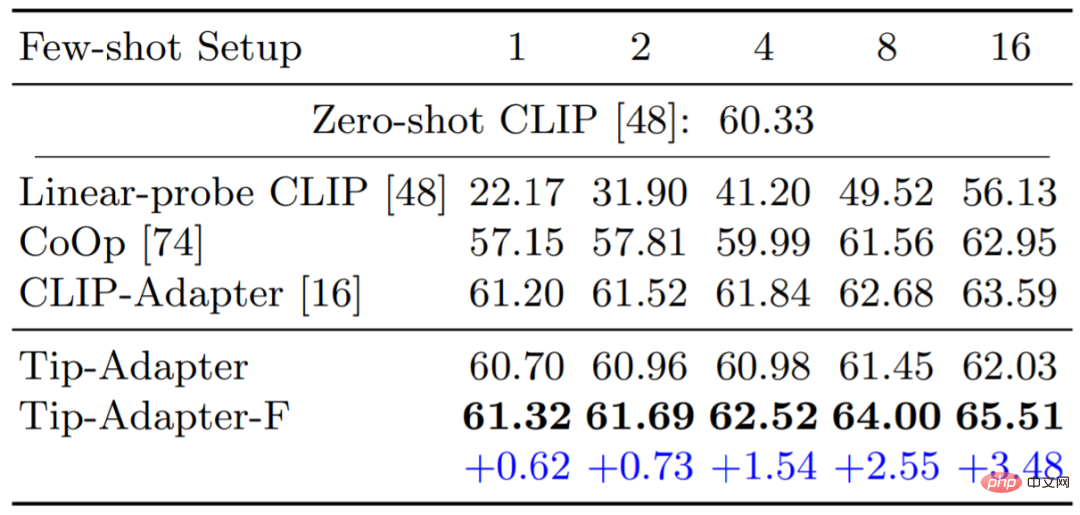

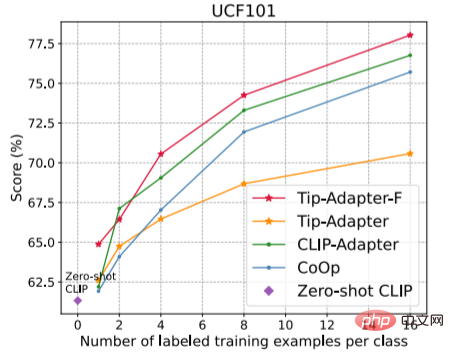

图 4 和表 2 比较了 Tip-Adapter、Tip-Adapter-F 和现有各个方案在 1、2、4、8、16 shots 的 few-shot 图像分类准确率;表 3 比较了 16-shot ImageNet 数据集上使用不同 CLIP 的 Visual Encoder 的准确率比较。可见,我们的两种方案都在资源开销很小的情况下,达到了非常卓越的性能。

图 4 和表 2:ImageNet 数据集上不同方法的 1~16-shot 图像分类准确率比较

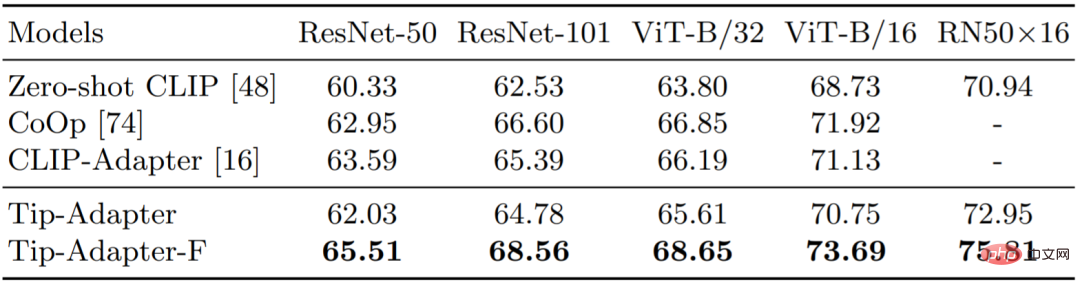

表 5:16-shot ImageNet 上不同 CLIP 的 Visual Encoder 的图像分类准确率比较

2. 在另外 10 个图像分类数据集

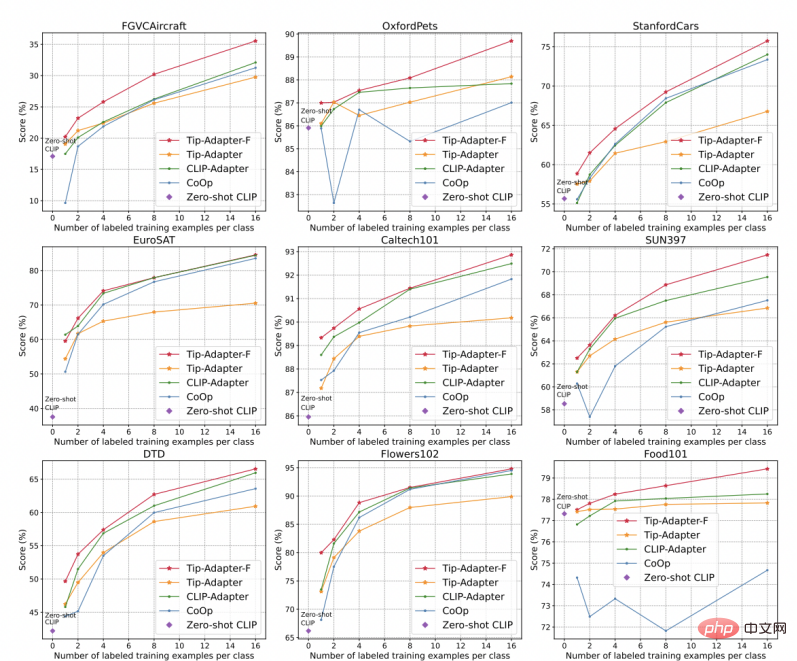

如图 5 所示,我们提供了另外 10 个图像分类数据集的准确率比较结果,分别是 StandfordCars,UCF101,Caltech101,Flowers102,SUN397,DTD,EuroSAT,FGVCAircraft,OxfordPets 和 Food101。如图所示,我们的 Tip-Adapter-F 均取得了最高的识别准确率。

图 5:另外 10 个数据集上不同方法的 1~16-shot 图像分类准确率比较

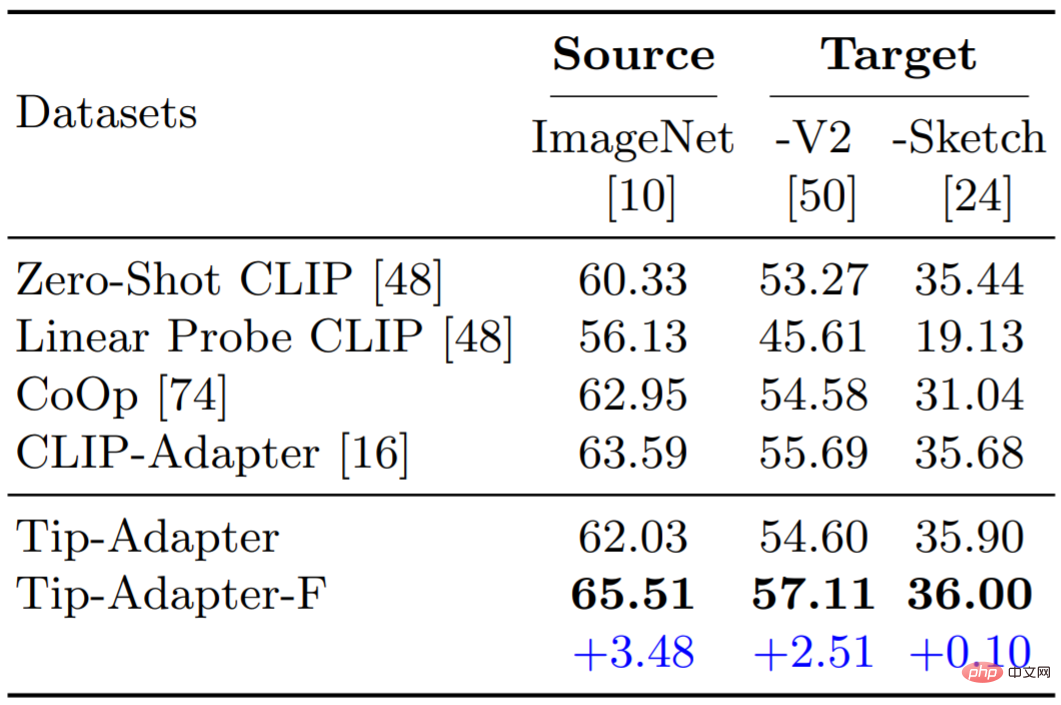

3. 领域泛化能力的测评

我们也测试了 Tip-Adapter 和 Tip-Adapter-F 在领域泛化(Domain Generalization)方面的表现。如表 6 所示,我们的两种方案都表现出了很强的鲁棒性以及特征迁移能力。

四.结论

本文提出了 Tip-Adapter,一种可以免于训练的将 CLIP 用于下游 few-shot 图像分类的方案。Tip-Adapter 通过构建一个 Key-Value Cache Model,来作为测试图片 Query 的知识检索库,并通过融合 Cache Model 的预测和 CLIP 的 zero-shot 预测,来得到更强的识别性能。我们期望 Tip-Adapter 可以启发更多预训练模型高效迁移的后续工作。

以上是无需下游训练,Tip-Adapter大幅提升CLIP图像分类准确率的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

开源!超越ZoeDepth! DepthFM:快速且精确的单目深度估计!

Apr 03, 2024 pm 12:04 PM

开源!超越ZoeDepth! DepthFM:快速且精确的单目深度估计!

Apr 03, 2024 pm 12:04 PM

0.这篇文章干了啥?提出了DepthFM:一个多功能且快速的最先进的生成式单目深度估计模型。除了传统的深度估计任务外,DepthFM还展示了在深度修复等下游任务中的最先进能力。DepthFM效率高,可以在少数推理步骤内合成深度图。下面一起来阅读一下这项工作~1.论文信息标题:DepthFM:FastMonocularDepthEstimationwithFlowMatching作者:MingGui,JohannesS.Fischer,UlrichPrestel,PingchuanMa,Dmytr

抛弃编码器-解码器架构,用扩散模型做边缘检测效果更好,国防科大提出DiffusionEdge

Feb 07, 2024 pm 10:12 PM

抛弃编码器-解码器架构,用扩散模型做边缘检测效果更好,国防科大提出DiffusionEdge

Feb 07, 2024 pm 10:12 PM

当前的深度边缘检测网络通常采用编码器-解码器架构,其中包含上下采样模块,以更好地提取多层次的特征。然而,这种结构限制了网络输出准确且细致的边缘检测结果。针对这一问题,一篇AAAI2024上的论文给出了新的解决方案。论文题目:DiffusionEdge:DiffusionProbabilisticModelforCrispEdgeDetection作者:叶云帆(国防科技大学),徐凯(国防科技大学),黄雨行(国防科技大学),易任娇(国防科技大学),蔡志平(国防科技大学)论文链接:https://ar

通义千问再开源,Qwen1.5带来六种体量模型,性能超越GPT3.5

Feb 07, 2024 pm 10:15 PM

通义千问再开源,Qwen1.5带来六种体量模型,性能超越GPT3.5

Feb 07, 2024 pm 10:15 PM

赶在春节前,通义千问大模型(Qwen)的1.5版上线了。今天上午,新版本的消息引发了AI社区关注。新版大模型包括六个型号尺寸:0.5B、1.8B、4B、7B、14B和72B。其中,最强版本的性能超越了GPT3.5和Mistral-Medium。该版本包含Base模型和Chat模型,并提供多语言支持。阿里通义千问团队表示,相关技术也已经上线到了通义千问官网和通义千问App。除此以外,今天Qwen1.5的发布还有如下一些重点:支持32K上下文长度;开放了Base+Chat模型的checkpoint;

大模型也能切片,微软SliceGPT让LLAMA-2计算效率大增

Jan 31, 2024 am 11:39 AM

大模型也能切片,微软SliceGPT让LLAMA-2计算效率大增

Jan 31, 2024 am 11:39 AM

大型语言模型(LLM)通常拥有数十亿参数,经过数万亿token的数据训练。然而,这样的模型训练和部署成本都非常昂贵。为了降低计算需求,人们常常采用各种模型压缩技术。这些模型压缩技术一般可以分为四类:蒸馏、张量分解(包括低秩因式分解)、剪枝和量化。剪枝方法已经存在一段时间,但许多方法需要在剪枝后进行恢复微调(RFT)以保持性能,这使得整个过程成本高且难以扩展。苏黎世联邦理工学院和微软的研究者提出了一个解决此问题的方法,名为SliceGPT。该方法的核心思想是通过删除权重矩阵中的行和列来降低网络的嵌

你好,电动Atlas!波士顿动力机器人复活,180度诡异动作吓坏马斯克

Apr 18, 2024 pm 07:58 PM

你好,电动Atlas!波士顿动力机器人复活,180度诡异动作吓坏马斯克

Apr 18, 2024 pm 07:58 PM

波士顿动力Atlas,正式进入电动机器人时代!昨天,液压Atlas刚刚「含泪」退出历史舞台,今天波士顿动力就宣布:电动Atlas上岗。看来,在商用人形机器人领域,波士顿动力是下定决心要和特斯拉硬刚一把了。新视频放出后,短短十几小时内,就已经有一百多万观看。旧人离去,新角色登场,这是历史的必然。毫无疑问,今年是人形机器人的爆发年。网友锐评:机器人的进步,让今年看起来像人类的开幕式动作、自由度远超人类,但这真不是恐怖片?视频一开始,Atlas平静地躺在地上,看起来应该是仰面朝天。接下来,让人惊掉下巴

快手版Sora「可灵」开放测试:生成超120s视频,更懂物理,复杂运动也能精准建模

Jun 11, 2024 am 09:51 AM

快手版Sora「可灵」开放测试:生成超120s视频,更懂物理,复杂运动也能精准建模

Jun 11, 2024 am 09:51 AM

什么?疯狂动物城被国产AI搬进现实了?与视频一同曝光的,是一款名为「可灵」全新国产视频生成大模型。Sora利用了相似的技术路线,结合多项自研技术创新,生产的视频不仅运动幅度大且合理,还能模拟物理世界特性,具备强大的概念组合能力和想象力。数据上看,可灵支持生成长达2分钟的30fps的超长视频,分辨率高达1080p,且支持多种宽高比。另外再划个重点,可灵不是实验室放出的Demo或者视频结果演示,而是短视频领域头部玩家快手推出的产品级应用。而且主打一个务实,不开空头支票、发布即上线,可灵大模型已在快影

超级智能体生命力觉醒!可自我更新的AI来了,妈妈再也不用担心数据瓶颈难题

Apr 29, 2024 pm 06:55 PM

超级智能体生命力觉醒!可自我更新的AI来了,妈妈再也不用担心数据瓶颈难题

Apr 29, 2024 pm 06:55 PM

哭死啊,全球狂炼大模型,一互联网的数据不够用,根本不够用。训练模型搞得跟《饥饿游戏》似的,全球AI研究者,都在苦恼怎么才能喂饱这群数据大胃王。尤其在多模态任务中,这一问题尤为突出。一筹莫展之际,来自人大系的初创团队,用自家的新模型,率先在国内把“模型生成数据自己喂自己”变成了现实。而且还是理解侧和生成侧双管齐下,两侧都能生成高质量、多模态的新数据,对模型本身进行数据反哺。模型是啥?中关村论坛上刚刚露面的多模态大模型Awaker1.0。团队是谁?智子引擎。由人大高瓴人工智能学院博士生高一钊创立,高

赶超Gemini Pro,提升推理、OCR能力的LLaVA-1.6太强了

Feb 01, 2024 pm 04:51 PM

赶超Gemini Pro,提升推理、OCR能力的LLaVA-1.6太强了

Feb 01, 2024 pm 04:51 PM

在去年4月,威斯康星大学麦迪逊分校、微软研究院和哥伦比亚大学的研究者们联合发布了LLaVA(LargeLanguageandVisionAssistant)。尽管LLaVA只是用一个小的多模态指令数据集进行训练,但在一些样本上展现出了与GPT-4非常相似的推理结果。然后在10月,他们推出了LLaVA-1.5,通过对原始LLaVA进行简单修改,在11个基准测试中刷新了SOTA。这次升级的结果非常令人振奋,为多模态AI助手领域带来了新的突破。研究团队宣布推出LLaVA-1.6版本,针对推理、OCR和