CoRL 2022优秀论文;语言模型生成自然界没有的蛋白质

目录

- 语言模型超越天然蛋白质

- 用于生成蛋白质设计的高级编程语言

- DOC:通过详细的大纲控制提高长故事的连贯性

- 使用 Transformer 的可扩展扩散模型

- Point-E:根据复杂提示生成 3D 点云的系统

- 重新编程以恢复年轻的表观遗传信息和恢复视力

- 训练机器人评估机器人:基于实例的策略学习互动奖励函数

- ArXiv 每周广播电台:NLP、CV、ML更多精选论文(附音频)

论文1:语言模型泛化超越天然蛋白质

- 作者:Robert Verkuil 、 Ori Kabeli 等

- 论文地址:https:// www.biorxiv.org/content/10.1101/2022.12.21.521521v1.full.pdf

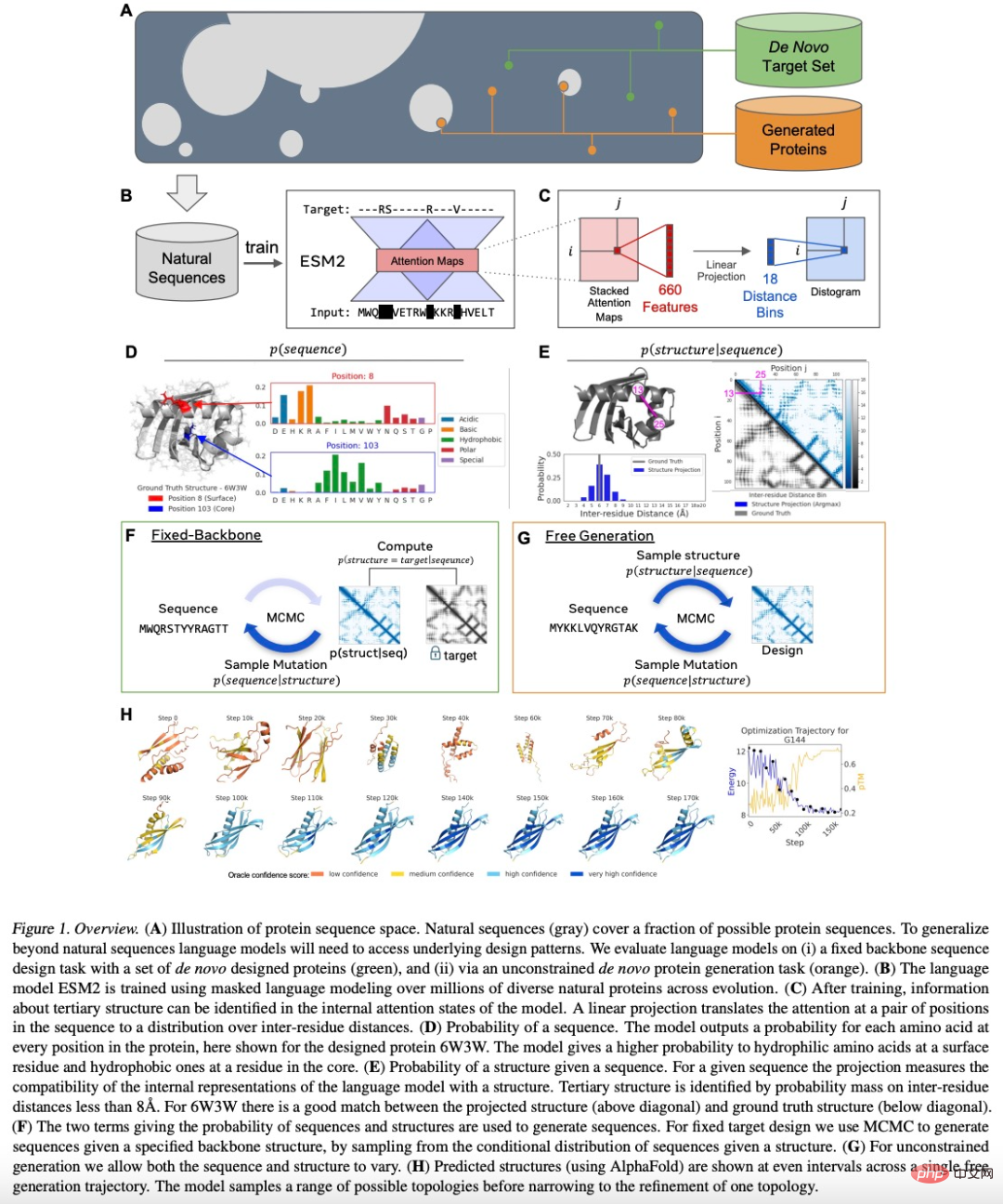

摘要:拐点于两个设计任务:指定结构的固定蛋白质结构设计;从模型中采样结构的无约束生成。虽然语言模型仅针对序列进行训练,但该研究发现它们能够设计结构。在该研究的实验结果中,总共生成了228种蛋白质,设计成功的部分是152/228(67%)。

在152个实验成功的设计中,有35个与已知的天然蛋白质没有明显的序列匹配。

对于固定主干设计,语言模型成功为8个经过实验评估的人工创建的固定主干目标生成了蛋白质设计。

针对不受约束生成的情况,采样的蛋白质结构采用了不同的拓扑结构和二级结构组成,结果获得了很多的实验成功率71/129(55%)。

下图1是ESM2模型设计蛋白质总体流程:

推荐 :该研究发现ESM2语言模型通过学习精细语法,能够生成天然蛋白质以外的新蛋白质。

论文2:一种用于生成蛋白质设计的高级编程语言

- 作者:Brian Hie 、 Salvatore Candido 等

- 论文地址:https://www.biorxiv.org/content/10.1101/2022.12.21.521526v1.full.pdf

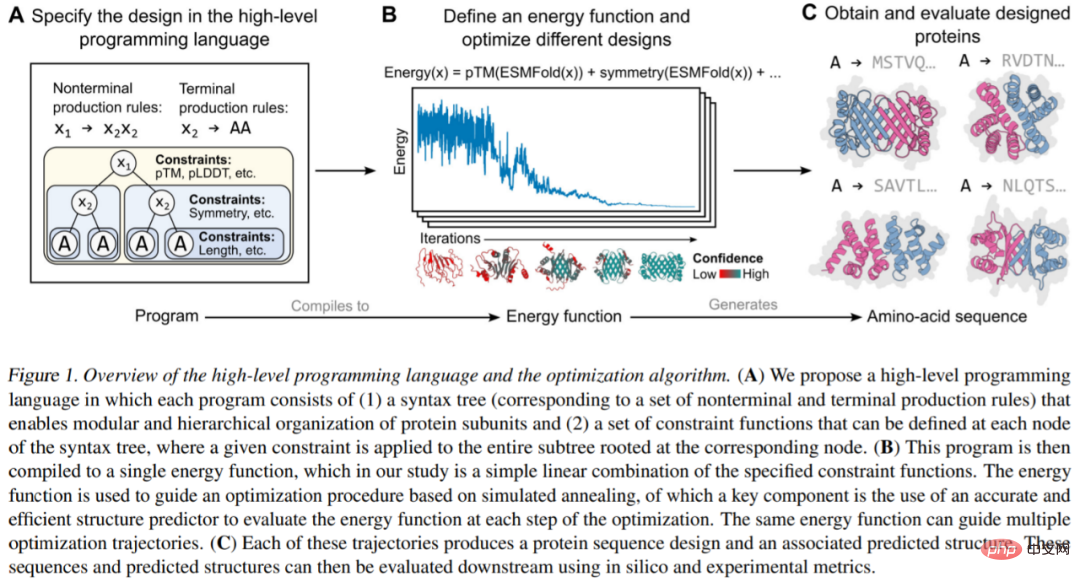

摘要:公平初始化从自定义和即时性入手,将两者设置更高的抽象层次,蛋白质设计者只需要重新组合高级指令,然后在生成模型上执行指令即可。

他们提出了生成蛋白质设计的编程语言,允许设计人员指定精细和分层的程序。编程语言首先需要一个语法树(图1A),由终止符号(即树的叶子)和非终止符号(即树的内部节点)组成,前面对应一个独特的蛋白质序列(在蛋白质中可能重复),晚上支持分层组织。

此外还需要一个基于能量的生成模型。首先,蛋白质设计器指定一个高级程序,该程序由一组按层次组织的约束组成(图 1A)。然后,该程序编译为一个能量函数,用于评估与约束的兼容性,约束是任意的且不可微的(图 1B)。最后通过将原子级结构预测(由语言模型支持)合并到能量函数中,可以生成大量复杂的蛋白质设计(图 1C)。

推荐:编程生成复杂和模块化的蛋白质结构。

论文 3:DOC: Improving Long Story Coherence With Detailed Outline Contro

- 作者:Kevin Yang 、 Dan Klein 等

- 论文地址:https://arxiv.org/pdf/2212.10077.pdf

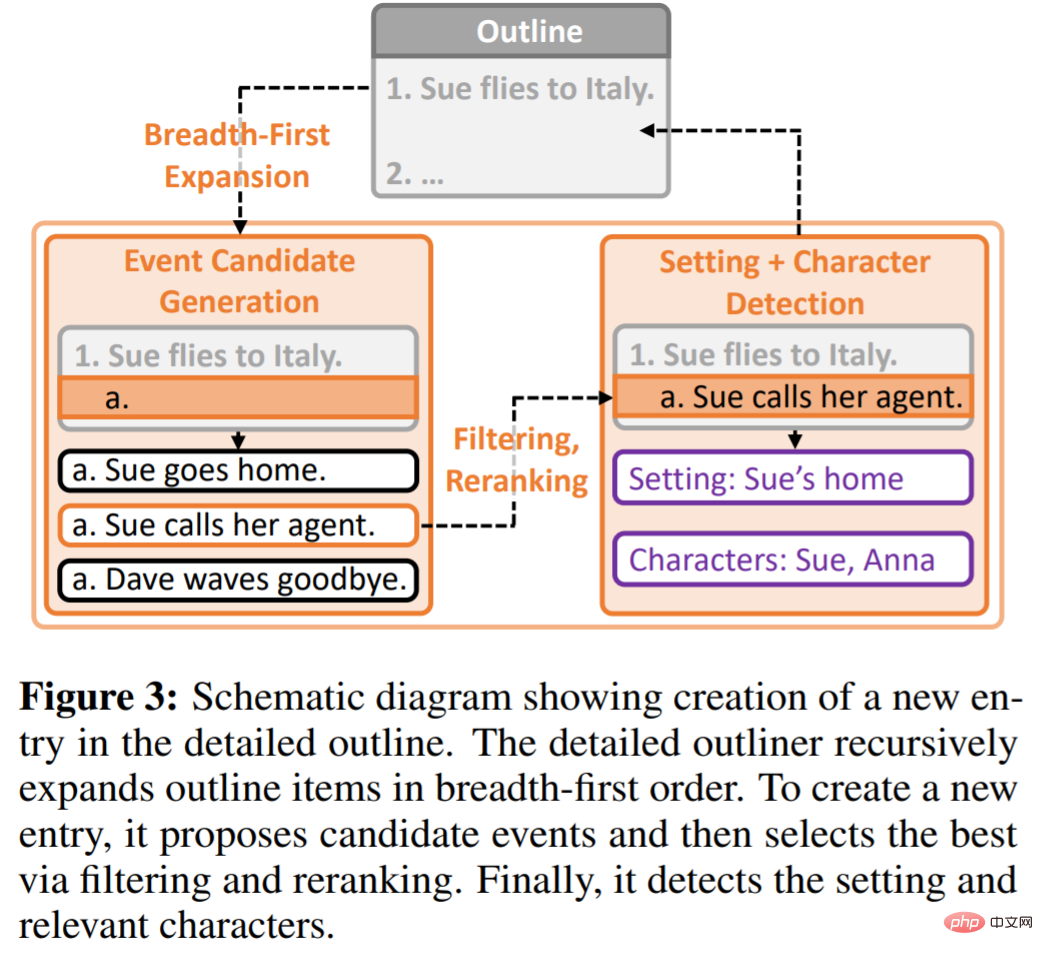

摘要:前段时间,模仿人类写作过程的语言模型 Re^3 发布,该模型不需要微调大模型,而是通过设计 prompt 来生成一致性强的故事。

现在,该研究团队又提出了一个生成故事的新模型 DOC。论文作者 Kevin Yang、田渊栋也在推特上发文宣传了 DOC 模型,表示 DOC 比 Re^3 生成的故事更加连贯、有趣。

DOC 框架意指详细大纲控制(Detailed Outline Control),用于在自动生成数千字长故事时提高情节的连贯性。DOC 由两个互补的组件组成:详细大纲组件(Detailed Outliner)、详细控制器(Detailed Controller)。

Detailed Outliner 负责创建详细的、分层结构的大纲,将写作创意从起草转移到规划阶段。Detailed Controller 则通过控制故事段落与大纲细节对齐,确保生成结果遵循详细的大纲。

该研究对模型自动生成故事的功能进行了人工评估,DOC 在多个指标上获得了大幅增益:情节连贯性(22.5%)、大纲相关性(28.2%)和趣味性(20.7%),大大优于 Re^3 模型。此外,DOC 在交互式生成环境中更易于控制。

推荐:田渊栋等原班人马又一新作:AI 生成长篇故事,数千字长文也能连贯、有趣。

论文 4:Scalable Diffusion Models with Transformers

- 作者:William Peebles 、谢赛宁

- 论文地址:https://arxiv.org/pdf/2212.09748.pdf

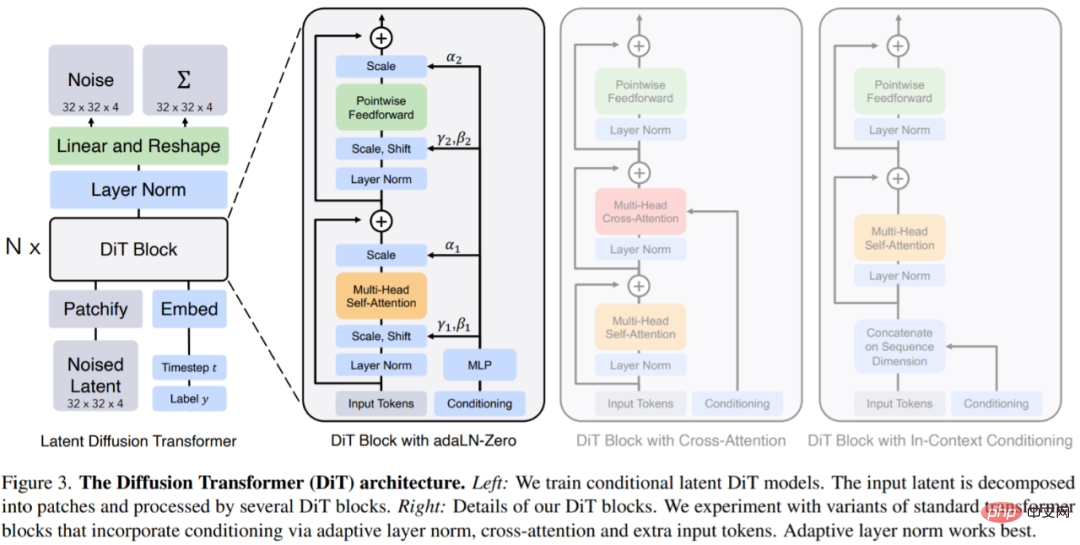

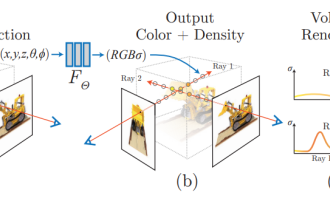

摘要:本文中来自 UC 伯克利的 William Peebles 以及纽约大学的谢赛宁撰文《 Scalable Diffusion Models with Transformers 》,目标是揭开扩散模型中架构选择的意义,并为未来的生成模型研究提供经验基线。该研究表明,U-Net 归纳偏置对扩散模型的性能不是至关重要的,并且可以很容易地用标准设计(如 transformer)取代。

该研究专注于一类新的基于 Transformer 的扩散模型:Diffusion Transformers(简称 DiTs)。DiTs 遵循 Vision Transformers (ViTs) 的最佳实践,有一些小但重要的调整。DiT 已被证明比传统的卷积网络(例如 ResNet )具有更有效地扩展性。

具体而言,本文研究了 Transformer 在网络复杂度与样本质量方面的扩展行为。研究表明,通过在潜在扩散模型 (LDM) 框架下构建 DiT 设计空间并对其进行基准测试,其中扩散模型在 VAE 的潜在空间内进行训练,可以成功地用 transformer 替换 U-Net 主干。本文进一步表明 DiT 是扩散模型的可扩展架构:网络复杂性(由 Gflops 测量)与样本质量(由 FID 测量)之间存在很强的相关性。通过简单地扩展 DiT 并训练具有高容量主干(118.6 Gflops)的 LDM,可以在类条件 256 × 256 ImageNet 生成基准上实现 2.27 FID 的最新结果。

推荐:统治扩散模型的 U-Net 要被取代了,谢赛宁等引入 Transformer 提出 DiT。

论文 5:Point-E: A System for Generating 3D Point Clouds from Complex Prompts

- 作者:Alex Nichol、Heewoo Jun 等

- 论文地址:https://arxiv.org/abs/2212.08751

摘要:OpenAI 开源的 3D 模型生成器 Point-E 引发了 AI 圈的新一轮热潮。根据与开源内容一并发布的论文介绍,Point-E 可以在单块 Nvidia V100 GPU 上在一到两分钟内生成 3D 模型。相比之下,现有系统(如谷歌的 DreamFusion)通常需要数小时和多块 GPU。

Point-E 不输出传统意义上的 3D 图像,它会生成点云,或空间中代表 3D 形状的离散数据点集。Point-E 中的 E 是「效率」的缩写,表示其比以前的 3D 对象生成方法更快。不过从计算的角度来看,点云更容易合成,但它们无法捕获对象的细粒度形状或纹理 —— 这是目前 Point-E 的一个关键限制。

为了解决这一问题,OpenAI 团队训练了一个额外的人工智能系统来将 Point-E 的点云转换为网格。

推荐:三次元的文本到图像 AI 成了:单 GPU 不到一分钟出货,OpenAI 出品。

论文 6:Reprogramming to recover youthful epigenetic information and restore vision

- 作者:Yuancheng Lu、Benedikt Brommer

- 论文地址:https://www.nature.com/articles/s41586-020-2975-4

摘要:2020 年 12 月 2 日,顶级科学期刊《Nature》的封面上,出现了几个令人惊奇的词汇:「Turning Back Time」(时光倒流)。

登上封面的研究来自于哈佛大学医学院终身教授 David Sinclair 的团队。尽管文章只有寥寥数页,却展示了全新的前景 —— 利用基因治疗诱导神经节细胞重编程,恢复年轻的表观遗传信息,从而使得视神经能在损伤后再生,并逆转青光眼和衰老造成的视力下降。

David Sinclair 表示,团队的研究目标始终是减缓和逆转人体衰老,通过解决病因而不是症状来治疗疾病。

在 2020 年这项研究的基础上,David Sinclair 的团队正使用名为「REVIVER」的年龄逆转技术在非人类灵长类动物身上进行测试,以观察看它是否安全并能像小鼠一样治疗失明。

最新的研究则来自 David Sinclair 及其领导的 60 人团队,他表示,衰老就像 CD 上可以擦掉的划痕,或者系统里损坏的软件,只需重新安装即可实现逆转,就像《Lifespan》书中所说的那样。

在预印版论文中,作者表示所有生物都会随时间推移丢失遗传信息,逐渐丧失细胞功能。使用被称为 ICE(用于表观基因组的可诱导变化)的转基因小鼠系统,研究人员证明了修复非诱变 DNA 断裂的过程加速了与年龄相关的生理、认知和分子变化,包括表观遗传的侵蚀, 细胞能力丧失、细胞衰老等。

研究人员称,通过异位表达进行的表观遗传重编程可恢复年轻基因表达的模式。

推荐:逆转衰老的研究。

论文 7:Training Robots to Evaluate Robots: Example-Based Interactive Reward Functions for Policy Learning

- 作者:Kun Huang、Edward Hu、Dinesh Jayaraman

- 论文地址:https://openreview.net/pdf?id=sK2aWU7X9b8

摘要:通常来说,物理相互作用有助于揭示不太明显的信息,例如我们可能会拉一下桌腿来评估它是否稳固,或者把一个水瓶倒过来检查它是否漏水,该研究建议可以通过训练机器人来自动获得这种交互行为,以评估机器人尝试执行技能的结果。这些评估反过来作为 IRF(interactive reward functions),用于训练强化学习策略以执行目标技能,例如拧紧桌腿。此外,即使完全训练完成之后,IRF 也可以作为改进在线任务执行的验证机制。对于任何给定的任务, IRF 训练非常方便,并且不需要进一步的规范。

评估结果表明,IRF 可以实现显着的性能改进,甚至可以通过访问演示或精心设计的奖励来超越基线。比如下图中,机器人必须先关门,然后旋转对称的门把手才能完全锁住门。

以上是CoRL 2022优秀论文;语言模型生成自然界没有的蛋白质的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

Stable Diffusion 3论文终于发布,架构细节大揭秘,对复现Sora有帮助?

Mar 06, 2024 pm 05:34 PM

Stable Diffusion 3论文终于发布,架构细节大揭秘,对复现Sora有帮助?

Mar 06, 2024 pm 05:34 PM

StableDiffusion3的论文终于来了!这个模型于两周前发布,采用了与Sora相同的DiT(DiffusionTransformer)架构,一经发布就引起了不小的轰动。与之前版本相比,StableDiffusion3生成的图质量有了显着提升,现在支持多主题提示,并且文字书写效果也得到了改善,不再出现乱码情况。 StabilityAI指出,StableDiffusion3是一个系列模型,其参数量从800M到8B不等。这一参数范围意味着该模型可以在许多便携设备上直接运行,从而显着降低了使用AI

ICCV'23论文颁奖'神仙打架”!Meta分割一切和ControlNet共同入选,还有一篇让评委们很惊讶

Oct 04, 2023 pm 08:37 PM

ICCV'23论文颁奖'神仙打架”!Meta分割一切和ControlNet共同入选,还有一篇让评委们很惊讶

Oct 04, 2023 pm 08:37 PM

在法国巴黎举行的计算机视觉顶峰大会ICCV2023刚刚结束!今年的最佳论文奖,简直是“神仙打架”。例如,获得最佳论文奖的两篇论文中,就包括颠覆文生图AI领域的著作——ControlNet。自从开源以来,ControlNet在GitHub上已经获得了24k个星。无论是对于扩散模型还是整个计算机视觉领域来说,这篇论文的获奖都是实至名归的而最佳论文奖荣誉提名,则颁给了另一篇同样出名的论文,Meta的「分割一切」模型SAM。自推出以来,「分割一切」已经成为了各种图像分割AI模型的“标杆”,包括后来居上的

NeRF与自动驾驶的前世今生,近10篇论文汇总!

Nov 14, 2023 pm 03:09 PM

NeRF与自动驾驶的前世今生,近10篇论文汇总!

Nov 14, 2023 pm 03:09 PM

神经辐射场(NeuralRadianceFields)自2020年被提出以来,相关论文数量呈指数增长,不但成为了三维重建的重要分支方向,也逐渐作为自动驾驶重要工具活跃在研究前沿。NeRF这两年异军突起,主要因为它跳过了传统CV重建pipeline的特征点提取和匹配、对极几何与三角化、PnP加BundleAdjustment等步骤,甚至跳过mesh的重建、贴图和光追,直接从2D输入图像学习一个辐射场,然后从辐射场输出逼近真实照片的渲染图像。也就是说,让一个基于神经网络的隐式三维模型,去拟合指定视角

论文插图也能自动生成了,用到了扩散模型,还被ICLR接收

Jun 27, 2023 pm 05:46 PM

论文插图也能自动生成了,用到了扩散模型,还被ICLR接收

Jun 27, 2023 pm 05:46 PM

生成式AI已经风靡了人工智能社区,无论是个人还是企业,都开始热衷于创建相关的模态转换应用,比如文生图、文生视频、文生音乐等等。最近呢,来自ServiceNowResearch、LIVIA等科研机构的几位研究者尝试基于文本描述生成论文中的图表。为此,他们提出了一种FigGen的新方法,相关论文还被ICLR2023收录为了TinyPaper。图片论文地址:https://arxiv.org/pdf/2306.00800.pdf也许有人会问了,生成论文中的图表有什么难的呢?这样做对于科研又有哪些帮助呢

聊天截图曝出AI顶会审稿潜规则!AAAI 3000块即可strong accept?

Apr 12, 2023 am 08:34 AM

聊天截图曝出AI顶会审稿潜规则!AAAI 3000块即可strong accept?

Apr 12, 2023 am 08:34 AM

正值AAAI 2023论文截止提交之际,知乎上突然出现了一张AI投稿群的匿名聊天截图。其中有人声称,自己可以提供「3000块一个strong accept」的服务。爆料一出,顿时引起了网友们的公愤。不过,先不要着急。知乎大佬「微调」表示,这大概率只是「口嗨」而已。据「微调」透露,打招呼和团伙作案这个是任何领域都不能避免的问题。随着openreview的兴起,cmt的各种弊端也越来越清楚,未来留给小圈子操作的空间会变小,但永远会有空间。因为这是个人的问题,不是投稿系统和机制的问题。引入open r

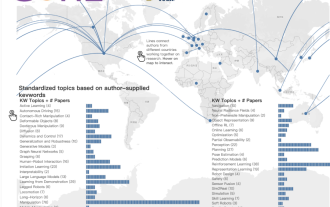

CVPR 2023放榜,录用率25.78%!2360篇论文被接收,提交量暴涨至9155篇

Apr 13, 2023 am 09:37 AM

CVPR 2023放榜,录用率25.78%!2360篇论文被接收,提交量暴涨至9155篇

Apr 13, 2023 am 09:37 AM

刚刚,CVPR 2023发文称:今年,我们收到了创纪录的9155份论文(比CVPR2022增加了12%),并录用了2360篇论文,接收率为25.78%。据统计,CVPR的投稿量在2010-2016的7年间仅从1724增加到2145。在2017年后则迅速飙升,进入快速增长期,2019年首次突破5000,至2022年投稿数已达到8161份。可以看到,今年提交了共9155份论文确实创下了最高记录。疫情放开后,今年的CVPR顶会将在加拿大举行。今年采用单轨会议的形式,并取消了传统Oral的评选。谷歌研究

华人团队斩获最佳论文、最佳系统论文奖项,CoRL研究成果获奖公布

Nov 10, 2023 pm 02:21 PM

华人团队斩获最佳论文、最佳系统论文奖项,CoRL研究成果获奖公布

Nov 10, 2023 pm 02:21 PM

自2017年首次举办以来,CoRL已经成为了机器人学与机器学习交叉领域的全球顶级学术会议之一。CoRL是面向机器人学习研究的单一主题会议,涵盖了机器人学、机器学习和控制等多个主题,包括理论与应用2023年的CoRL大会将于11月6日至9日在美国亚特兰大举行。根据官方数据透露,今年有来自25个国家的199篇论文入选CoRL。热门主题包括操作、强化学习等。虽然相较于AAAI、CVPR等大型AI学术会议,CoRL的规模较小,但随着今年大模型、具身智能、人形机器人等概念的热度上升,值得关注的相关研究也会

微软新出热乎论文:Transformer扩展到10亿token

Jul 22, 2023 pm 03:34 PM

微软新出热乎论文:Transformer扩展到10亿token

Jul 22, 2023 pm 03:34 PM

当大家不断升级迭代自家大模型的时候,LLM(大语言模型)对上下文窗口的处理能力,也成为一个重要评估指标。比如明星大模型GPT-4支持32ktoken,相当于50页的文字;OpenAI前成员创立的Anthropic更是将Claude处理token能力提升到100k,约75000个单词,大概相当于一键总结《哈利波特》第一部。在微软最新的一项研究中,他们这次直接将Transformer扩展到10亿token。这为建模非常长的序列开辟了新的可能性,例如将整个语料库甚至整个互联网视为一个序列。作为比较,普