时间序列机器学习数据集的非常规拆分技术

确保机器学习模型在未知环境中泛化的一种尝试是拆分数据。这可以通过多种方式实现,从3-way(训练、测试、评估)拆分到交叉验证的k拆分。其基本原理是,通过在数据子集上训练机器学习模型,并在未知数据上进行评估,可以更好地推理模型在训练中是否存在欠拟合或过拟合。

对于大多数工作来说,简单的3-way就足够了。在现实生产中,拆分方式往往需要更复杂的方法来确保泛化问题。这些拆分更加复杂,因为它们源自实际数据,而不是普通拆分方法所基于的数据结构。这篇文章试图讲解一些在机器学习开发中拆分数据的非常规方法,以及它们背后的原因。

让我们从数据集开始

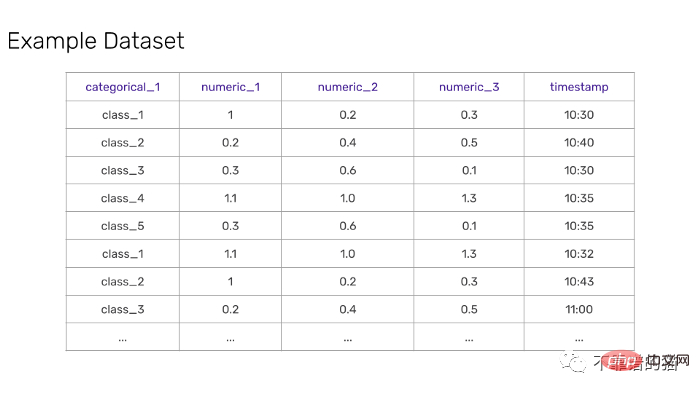

为了简单起见,让我们使用以表格格式来表示简单多变量时间序列数据集。该数据由3个数字特征、1个分类特征和1个时间戳特征组成。下面是可视化的:

这种类型的数据集在机器学习的许多用例和行业中都很常见。一个具体的例子是从工厂车间里面多个传感器传输的时间流数据。分类变量将是机器的ID,数字特征将是传感器正在记录的信息(例如,压力、温度等),时间戳将是数据传输和记录在数据库中的时间。

拆分

假设您从数据工程部门以csv文件的形式收到了这个数据集,并承担编写分类或回归模型的任务。在这种情况下,标签可以是任何特征或额外的列。要做的第一件事是将数据拆分成有意义的子集。

为方便起见,您可以简单拆分成训练集和测试集。马上问题来了,数据的简单拆分在这里是行不通的:数据是由多个按时间索引的传感器数据流组成的。那么,如何对数据进行拆分,从而保持顺序,并使后续机器学习模型具有很好的泛化性呢?

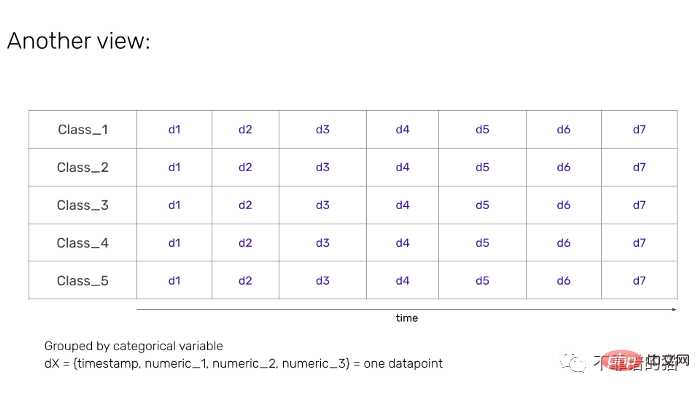

数据的另一种观点

我们可以做的最直接的转换是表示每个分类类的数据(在我们的运行示例中,可视化每台机器的数据)。这将产生以下结果:

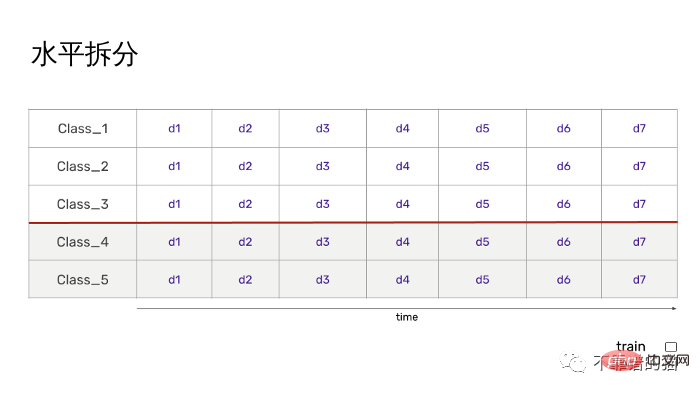

水平拆分

分组使拆分的问题变得简单了一些,并且很大程度上取决于你的假设。您可能会问:针对一个组训练的机器学习模型如何泛化到其他组,也就是说,如果在class_1、class_2和class_3时间流上进行训练,该模型在class_4和class_5时间流上的会如何呢?以下是这种拆分的可视化图:

上面的这种拆分方式,我称之为水平拆分。在大多数机器学习库中,通过简单地按分类特征进行分组并沿着分类进行分区,可以轻松实现这种拆分。使用这种拆分进行训练,该模型就已经收集到了在未知分组中泛化的信息。

值得注意的是,拆分并没有把时间作为拆分本身的基础。不过,可以假设您还将按每个时间流的时间排序来拆分,以在数据中维护这种关系。这就引出了下一个拆分方式。

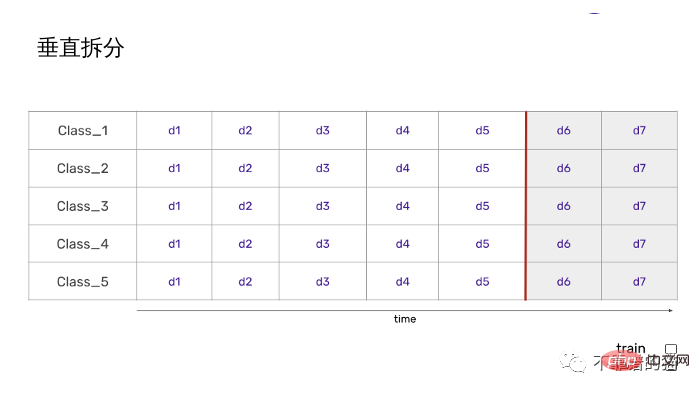

垂直拆分

但如果你想跨越时间本身呢?对于大多数时间序列建模,拆分数据的常用方法是past和future。也就是说,将训练集的历史数据与评估集的数据相比较。在这种情况下的假设是:机器学习模型如何训练每组的历史数据泛化到每组的未来数据?这个问题可以通过所谓的垂直拆分来回答:

这种拆分的成功训练将表明该模型能够在它已经看到的时间流中提取模式,并对未来的行为做出准确的预测。然而,这本身并不能表明该模型可以很好地泛化到来自不同组的其他时间流。

当然,您的多个时间流现在必须单独排序,所以我们仍然需要分组。但这次,我们不是跨组,而是从past每个组中抽取样本并将其放入train中,并将future组相应的放入eval 中。在这个理想化的例子中,所有时间流具有相同的长度,即每个时间流具有完全相同数量的数据点。但是,在现实世界中,情况可能并非如此——因此您需要一个系统来为每个组构建索引以进行拆分。

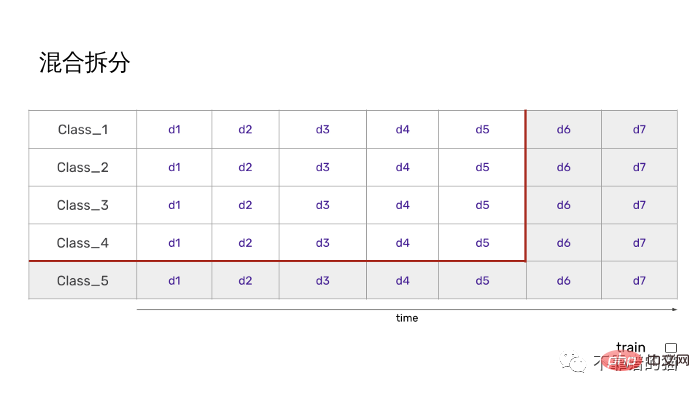

混合拆分

大家可能想知道,他们是否可以生成一个模型,在水平和垂直拆分的约束下都可以很好的进行泛化呢?在这种情况下,假设将是:如何在一些组的历史数据上训练的机器学习模型泛化到这些组的未来数据和其他组的所有数据?这种混合拆分的可视化结果如下所示:

当然,如果模型训练是成功的,这个模型肯定会比其他模型在现实世界中更健壮。它不仅可以证明它已经看到的一些组的学习模式,而且还可以证明它已经获得了跨组泛化的信息。如果我们将来要向工厂增加更多类似的机器,这可能是有用的。

多维拆分

水平和垂直拆分的概念可以推广到许多维度。例如,可能需要根据两个分类特征而不是一个分类特征进行分组,以便进一步隔离数据中的子组,并按子组对它们进行排序。中间可能还存在用于筛选样本数量较少的组的复杂逻辑,以及与该域相关的其他业务级逻辑。

结论

这个假设的例子用来说明可以创建的各种机器学习拆分的无限可能性。就像在评估模型时确保机器学习的公平性很重要一样,花足够的时间考虑划分数据集及其对下游模型产生偏差的后果也同样重要。

以上是时间序列机器学习数据集的非常规拆分技术的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

一文带您了解SHAP:机器学习的模型解释

Jun 01, 2024 am 10:58 AM

一文带您了解SHAP:机器学习的模型解释

Jun 01, 2024 am 10:58 AM

在机器学习和数据科学领域,模型的可解释性一直是研究者和实践者关注的焦点。随着深度学习和集成方法等复杂模型的广泛应用,理解模型的决策过程变得尤为重要。可解释人工智能(ExplainableAI|XAI)通过提高模型的透明度,帮助建立对机器学习模型的信任和信心。提高模型的透明度可以通过多种复杂模型的广泛应用等方法来实现,以及用于解释模型的决策过程。这些方法包括特征重要性分析、模型预测区间估计、局部可解释性算法等。特征重要性分析可以通过评估模型对输入特征的影响程度来解释模型的决策过程。模型预测区间估计

通过学习曲线识别过拟合和欠拟合

Apr 29, 2024 pm 06:50 PM

通过学习曲线识别过拟合和欠拟合

Apr 29, 2024 pm 06:50 PM

本文将介绍如何通过学习曲线来有效识别机器学习模型中的过拟合和欠拟合。欠拟合和过拟合1、过拟合如果一个模型对数据进行了过度训练,以至于它从中学习了噪声,那么这个模型就被称为过拟合。过拟合模型非常完美地学习了每一个例子,所以它会错误地分类一个看不见的/新的例子。对于一个过拟合的模型,我们会得到一个完美/接近完美的训练集分数和一个糟糕的验证集/测试分数。略有修改:"过拟合的原因:用一个复杂的模型来解决一个简单的问题,从数据中提取噪声。因为小数据集作为训练集可能无法代表所有数据的正确表示。"2、欠拟合如

iPhone上的蜂窝数据互联网速度慢:修复

May 03, 2024 pm 09:01 PM

iPhone上的蜂窝数据互联网速度慢:修复

May 03, 2024 pm 09:01 PM

在iPhone上面临滞后,缓慢的移动数据连接?通常,手机上蜂窝互联网的强度取决于几个因素,例如区域、蜂窝网络类型、漫游类型等。您可以采取一些措施来获得更快、更可靠的蜂窝互联网连接。修复1–强制重启iPhone有时,强制重启设备只会重置许多内容,包括蜂窝网络连接。步骤1–只需按一次音量调高键并松开即可。接下来,按降低音量键并再次释放它。步骤2–该过程的下一部分是按住右侧的按钮。让iPhone完成重启。启用蜂窝数据并检查网络速度。再次检查修复2–更改数据模式虽然5G提供了更好的网络速度,但在信号较弱

特斯拉机器人进厂打工,马斯克:手的自由度今年将达到22个!

May 06, 2024 pm 04:13 PM

特斯拉机器人进厂打工,马斯克:手的自由度今年将达到22个!

May 06, 2024 pm 04:13 PM

特斯拉机器人Optimus最新视频出炉,已经可以在厂子里打工了。正常速度下,它分拣电池(特斯拉的4680电池)是这样的:官方还放出了20倍速下的样子——在小小的“工位”上,拣啊拣啊拣:这次放出的视频亮点之一在于Optimus在厂子里完成这项工作,是完全自主的,全程没有人为的干预。并且在Optimus的视角之下,它还可以把放歪了的电池重新捡起来放置,主打一个自动纠错:对于Optimus的手,英伟达科学家JimFan给出了高度的评价:Optimus的手是全球五指机器人里最灵巧的之一。它的手不仅有触觉

超级智能体生命力觉醒!可自我更新的AI来了,妈妈再也不用担心数据瓶颈难题

Apr 29, 2024 pm 06:55 PM

超级智能体生命力觉醒!可自我更新的AI来了,妈妈再也不用担心数据瓶颈难题

Apr 29, 2024 pm 06:55 PM

哭死啊,全球狂炼大模型,一互联网的数据不够用,根本不够用。训练模型搞得跟《饥饿游戏》似的,全球AI研究者,都在苦恼怎么才能喂饱这群数据大胃王。尤其在多模态任务中,这一问题尤为突出。一筹莫展之际,来自人大系的初创团队,用自家的新模型,率先在国内把“模型生成数据自己喂自己”变成了现实。而且还是理解侧和生成侧双管齐下,两侧都能生成高质量、多模态的新数据,对模型本身进行数据反哺。模型是啥?中关村论坛上刚刚露面的多模态大模型Awaker1.0。团队是谁?智子引擎。由人大高瓴人工智能学院博士生高一钊创立,高

使用C++实现机器学习算法:常见挑战及解决方案

Jun 03, 2024 pm 01:25 PM

使用C++实现机器学习算法:常见挑战及解决方案

Jun 03, 2024 pm 01:25 PM

C++中机器学习算法面临的常见挑战包括内存管理、多线程、性能优化和可维护性。解决方案包括使用智能指针、现代线程库、SIMD指令和第三方库,并遵循代码风格指南和使用自动化工具。实践案例展示了如何利用Eigen库实现线性回归算法,有效地管理内存和使用高性能矩阵操作。

美国空军高调展示首个AI战斗机!部长亲自试驾全程未干预,10万行代码试飞21次

May 07, 2024 pm 05:00 PM

美国空军高调展示首个AI战斗机!部长亲自试驾全程未干预,10万行代码试飞21次

May 07, 2024 pm 05:00 PM

最近,军事圈被这个消息刷屏了:美军的战斗机,已经能由AI完成全自动空战了。是的,就在最近,美军的AI战斗机首次公开,揭开了神秘面纱。这架战斗机的全名是可变稳定性飞行模拟器测试飞机(VISTA),由美空军部长亲自搭乘,模拟了一对一的空战。5月2日,美国空军部长FrankKendall在Edwards空军基地驾驶X-62AVISTA升空注意,在一小时的飞行中,所有飞行动作都由AI自主完成!Kendall表示——在过去的几十年中,我们一直在思考自主空对空作战的无限潜力,但它始终显得遥不可及。然而如今,

你所不知道的机器学习五大学派

Jun 05, 2024 pm 08:51 PM

你所不知道的机器学习五大学派

Jun 05, 2024 pm 08:51 PM

机器学习是人工智能的重要分支,它赋予计算机从数据中学习的能力,并能够在无需明确编程的情况下改进自身能力。机器学习在各个领域都有着广泛的应用,从图像识别和自然语言处理到推荐系统和欺诈检测,它正在改变我们的生活方式。机器学习领域存在着多种不同的方法和理论,其中最具影响力的五种方法被称为“机器学习五大派”。这五大派分别为符号派、联结派、进化派、贝叶斯派和类推学派。1.符号学派符号学(Symbolism),又称为符号主义,强调利用符号进行逻辑推理和表达知识。该学派认为学习是一种逆向演绎的过程,通过已有的