“视频领域的Midjourney”!AI视频生成新秀Gen-2内测作品流出,网友直呼太逼真

号称可以一句话拍大片的AI视频生成工具Gen-2,开始露出庐山真面目。

有推特博主已经率先拿到了内测资格。

这是他用提示词“一个身材匀称or对称(symmetrical)的男人在酒吧接受采访”生成的结果:

只见一个身着深色衬衣的男人正望着对方侃侃而谈,眼神和表情透露着一股认真和坦率,对面的人则时不时点头以示附和。

视频整体非常连贯且画质很是清晰,乍一看,真实访谈感满满有没有!

同样的提示词生成的另一个版本也不赖:

这次镜头更加拉近,背景更逼真,人物则仍然富有表现力。

有网友看完这组作品直呼:

太不可思议了吧,只靠文字提示就能生成这样的结果!

还有人直言:

这是视频领域的Midjourney来了。

博主实测Gen-2

这位博主名叫Nick St. Pierre,专门在推上分享他用AI制作的作品。

除了开头所见的写实风,他还发布了一组Gen-2的科幻作品。

比如“宇航员穿越太空”:

“一名武装士兵沿着宇宙飞船的走廊奔跑,身后一道黑影摧毁了墙壁”:

“一家在人类动物园吃微芯片的机器人”:

“人形机器人大军在冰冻的平地上进行殖民”:

(有种权游里面异鬼大军进击长城的气势……)

“地球上最后一个人看着入侵的宇宙飞船降落在东京上空”:

……

以上这些全部都只凭一句提示词就能完成,不需要借鉴其它图片和视频。

虽然说这组科幻的效果相比“酒吧男人接受采访”稍显逊色,但神奇的是,它和AI图像生成模型诞生之初的那种“混沌不清”的味道可以说不相上下——仿佛看到了Stable diffusion等AI当时的影子。

如Nick St. Pierre表示:

Gen-2还处于婴儿期,后面一定会更好。

我们也在网上找到了其他已经拿到内测资格的人测试的一些效果:

可以说,除了比较难的科幻作品,其它它拿捏的都还不错的亚子。

AI视频生成也狂飙

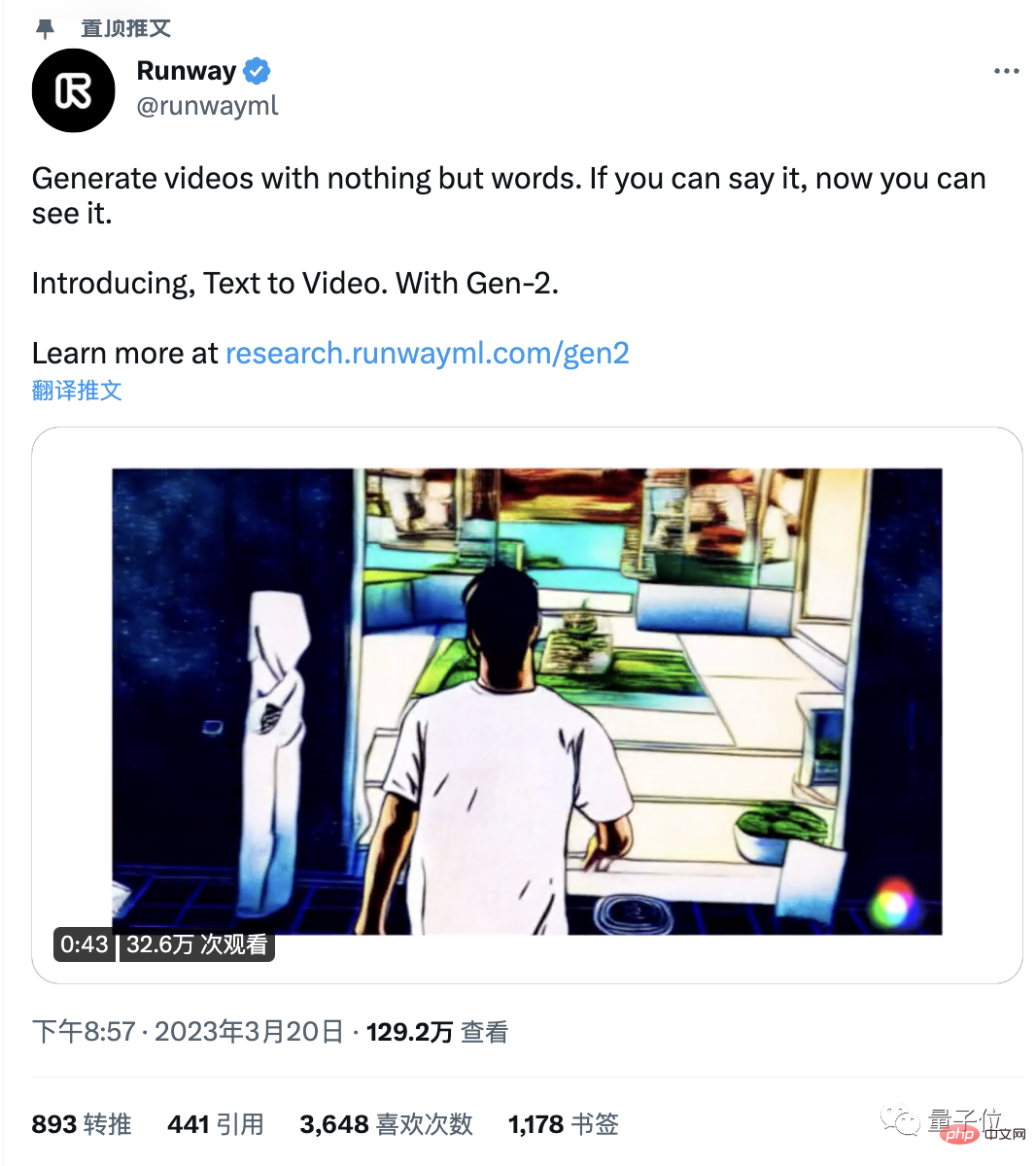

专攻视频生成的AI工具Gen-2于3月20日发布(论文3月11号)。

作为AIGC领域的新秀,它的迭代速度和质量也是相当快了:

Gen-1版本2月才刚诞生,那会还只能对已有视频进行编辑;

现在Gen-2就已经可以用文字和图像作为提示词直接生成视频了。

官方号称它为“生成式AI的下一步”,宣传语给的也是很霸气:

say it,see it。(只要你能说出来,我就能让你看到)

Gen-2的更新一口气带来了八大功能:

文生视频、文本+参考图像生视频、静态图片转视频、视频风格迁移、故事板(Storyboard)、Mask(比如把一只正在走路的小白狗变成斑点狗)、渲染和个性化(比如把甩头小哥秒变海龟人)。

它的出现和AI绘画一样,让人看到了影视、游戏和营销等领域暗藏的巨大变革。

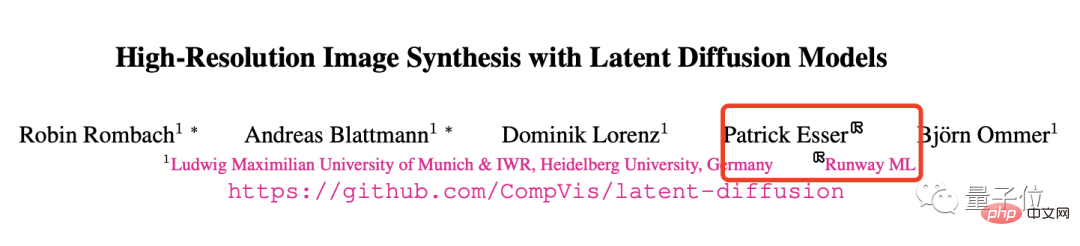

其背后开发公司也值得说道,它就是Runway。

Runway成立于2018年,为《瞬息全宇宙》特效提供过技术支持,也参与了Stable Diffusion的开发(妥妥的潜力股)。

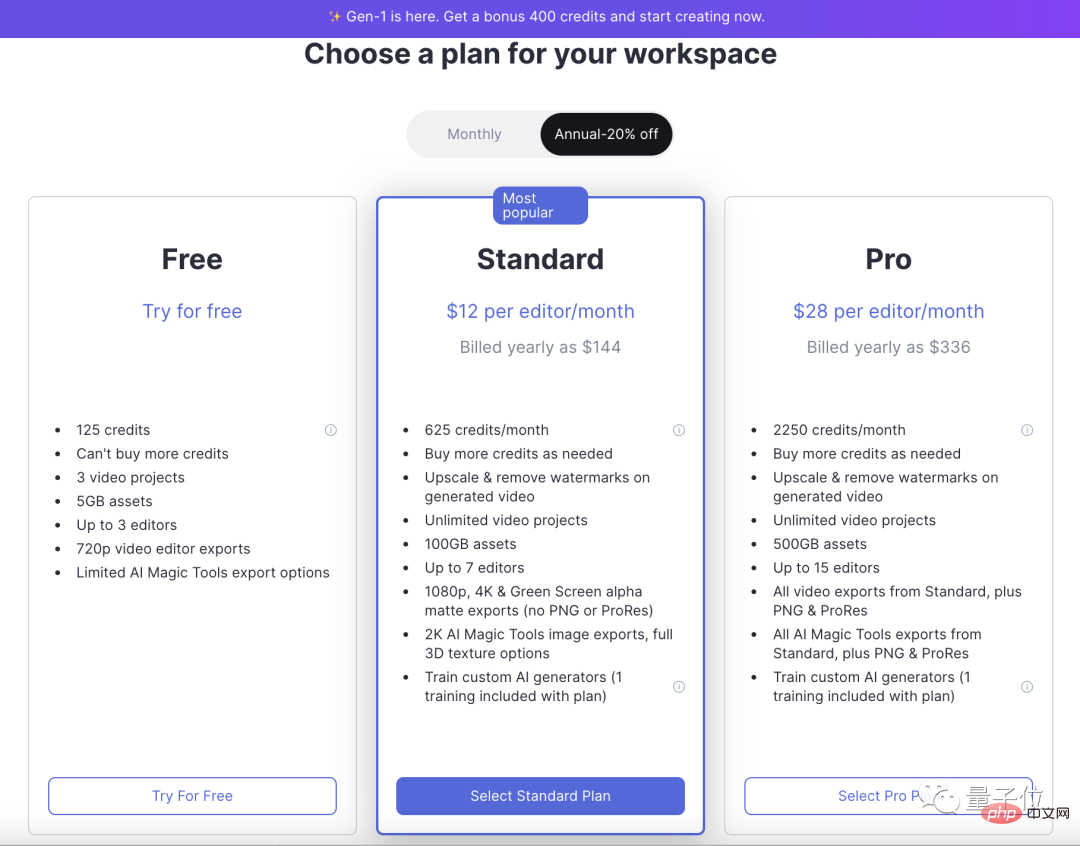

提示:Gen-1已经可以开始玩了(125次机会用完之后就只能按月付费了),Gen-2还没有正式对公开放。

除了Gen系列,微软亚研院还最新发布了一个可以根据文字生成超长视频的AI:NUWA-XL。

只用16句简单描述,它就能get一段长达11分钟的动画:

在往前一点儿,就在Gen-2发布同一天,阿里达摩院也开源了17亿参数的文本转视频AI:

效果是酱婶的:

……

可以预见,不止图像生成,视频领域也要变得热闹起来了。

咳咳,所以下一波大众AI狂欢,会是它吗?

参考链接:

[1]https://www.php.cn/link/4d7e0d72898ae7ea3593eb5ebf20c744

[2]https://www.php.cn/link/e00944d55e6432ccf20f9fda2492b6fd

[3]https://www.php.cn/link/ce653013fadbb2ff27530d3de3790f1b

[4]https://www.php.cn/link/6e3adb1ae0e02c934766182313b6775d

[5]https://www.php.cn/link/b9b72b29352f3764ea4dec130772bd9d

[6]https://www.php.cn/link/79d37fb2893b428f7ea4ed3b07a84096

以上是“视频领域的Midjourney”!AI视频生成新秀Gen-2内测作品流出,网友直呼太逼真的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

全球最强开源 MoE 模型来了,中文能力比肩 GPT-4,价格仅为 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

全球最强开源 MoE 模型来了,中文能力比肩 GPT-4,价格仅为 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

想象一下,一个人工智能模型,不仅拥有超越传统计算的能力,还能以更低的成本实现更高效的性能。这不是科幻,DeepSeek-V2[1],全球最强开源MoE模型来了。DeepSeek-V2是一个强大的专家混合(MoE)语言模型,具有训练经济、推理高效的特点。它由236B个参数组成,其中21B个参数用于激活每个标记。与DeepSeek67B相比,DeepSeek-V2性能更强,同时节省了42.5%的训练成本,减少了93.3%的KV缓存,最大生成吞吐量提高到5.76倍。DeepSeek是一家探索通用人工智

AI颠覆数学研究!菲尔兹奖得主、华裔数学家领衔11篇顶刊论文|陶哲轩转赞

Apr 09, 2024 am 11:52 AM

AI颠覆数学研究!菲尔兹奖得主、华裔数学家领衔11篇顶刊论文|陶哲轩转赞

Apr 09, 2024 am 11:52 AM

AI,的确正在改变数学。最近,一直十分关注这个议题的陶哲轩,转发了最近一期的《美国数学学会通报》(BulletinoftheAmericanMathematicalSociety)。围绕「机器会改变数学吗?」这个话题,众多数学家发表了自己的观点,全程火花四射,内容硬核,精彩纷呈。作者阵容强大,包括菲尔兹奖得主AkshayVenkatesh、华裔数学家郑乐隽、纽大计算机科学家ErnestDavis等多位业界知名学者。AI的世界已经发生了天翻地覆的变化,要知道,其中很多文章是在一年前提交的,而在这一

你好,电动Atlas!波士顿动力机器人复活,180度诡异动作吓坏马斯克

Apr 18, 2024 pm 07:58 PM

你好,电动Atlas!波士顿动力机器人复活,180度诡异动作吓坏马斯克

Apr 18, 2024 pm 07:58 PM

波士顿动力Atlas,正式进入电动机器人时代!昨天,液压Atlas刚刚「含泪」退出历史舞台,今天波士顿动力就宣布:电动Atlas上岗。看来,在商用人形机器人领域,波士顿动力是下定决心要和特斯拉硬刚一把了。新视频放出后,短短十几小时内,就已经有一百多万观看。旧人离去,新角色登场,这是历史的必然。毫无疑问,今年是人形机器人的爆发年。网友锐评:机器人的进步,让今年看起来像人类的开幕式动作、自由度远超人类,但这真不是恐怖片?视频一开始,Atlas平静地躺在地上,看起来应该是仰面朝天。接下来,让人惊掉下巴

替代MLP的KAN,被开源项目扩展到卷积了

Jun 01, 2024 pm 10:03 PM

替代MLP的KAN,被开源项目扩展到卷积了

Jun 01, 2024 pm 10:03 PM

本月初,来自MIT等机构的研究者提出了一种非常有潜力的MLP替代方法——KAN。KAN在准确性和可解释性方面表现优于MLP。而且它能以非常少的参数量胜过以更大参数量运行的MLP。比如,作者表示,他们用KAN以更小的网络和更高的自动化程度重现了DeepMind的结果。具体来说,DeepMind的MLP有大约300,000个参数,而KAN只有约200个参数。KAN与MLP一样具有强大的数学基础,MLP基于通用逼近定理,而KAN基于Kolmogorov-Arnold表示定理。如下图所示,KAN在边上具

特斯拉机器人进厂打工,马斯克:手的自由度今年将达到22个!

May 06, 2024 pm 04:13 PM

特斯拉机器人进厂打工,马斯克:手的自由度今年将达到22个!

May 06, 2024 pm 04:13 PM

特斯拉机器人Optimus最新视频出炉,已经可以在厂子里打工了。正常速度下,它分拣电池(特斯拉的4680电池)是这样的:官方还放出了20倍速下的样子——在小小的“工位”上,拣啊拣啊拣:这次放出的视频亮点之一在于Optimus在厂子里完成这项工作,是完全自主的,全程没有人为的干预。并且在Optimus的视角之下,它还可以把放歪了的电池重新捡起来放置,主打一个自动纠错:对于Optimus的手,英伟达科学家JimFan给出了高度的评价:Optimus的手是全球五指机器人里最灵巧的之一。它的手不仅有触觉

FisheyeDetNet:首个基于鱼眼相机的目标检测算法

Apr 26, 2024 am 11:37 AM

FisheyeDetNet:首个基于鱼眼相机的目标检测算法

Apr 26, 2024 am 11:37 AM

目标检测在自动驾驶系统当中是一个比较成熟的问题,其中行人检测是最早得以部署算法之一。在多数论文当中已经进行了非常全面的研究。然而,利用鱼眼相机进行环视的距离感知相对来说研究较少。由于径向畸变大,标准的边界框表示在鱼眼相机当中很难实施。为了缓解上述描述,我们探索了扩展边界框、椭圆、通用多边形设计为极坐标/角度表示,并定义一个实例分割mIOU度量来分析这些表示。所提出的具有多边形形状的模型fisheyeDetNet优于其他模型,并同时在用于自动驾驶的Valeo鱼眼相机数据集上实现了49.5%的mAP

单卡跑Llama 70B快过双卡,微软硬生生把FP6搞到了A100里 | 开源

Apr 29, 2024 pm 04:55 PM

单卡跑Llama 70B快过双卡,微软硬生生把FP6搞到了A100里 | 开源

Apr 29, 2024 pm 04:55 PM

FP8和更低的浮点数量化精度,不再是H100的“专利”了!老黄想让大家用INT8/INT4,微软DeepSpeed团队在没有英伟达官方支持的条件下,硬生生在A100上跑起FP6。测试结果表明,新方法TC-FPx在A100上的FP6量化,速度接近甚至偶尔超过INT4,而且拥有比后者更高的精度。在此基础之上,还有端到端的大模型支持,目前已经开源并集成到了DeepSpeed等深度学习推理框架中。这一成果对大模型的加速效果也是立竿见影——在这种框架下用单卡跑Llama,吞吐量比双卡还要高2.65倍。一名

牛津大学最新!Mickey:3D中的2D图像匹配SOTA!(CVPR\'24)

Apr 23, 2024 pm 01:20 PM

牛津大学最新!Mickey:3D中的2D图像匹配SOTA!(CVPR\'24)

Apr 23, 2024 pm 01:20 PM

写在前面项目链接:https://nianticlabs.github.io/mickey/给定两张图片,可以通过建立图片之间的对应关系来估计它们之间的相机姿态。通常,这些对应关系是二维到二维的,而我们估计的姿态在尺度上是不确定的。一些应用,例如随时随地实现即时增强现实,需要尺度度量的姿态估计,因此它们依赖于外部的深度估计器来恢复尺度。本文提出了MicKey,这是一个关键点匹配流程,能够够预测三维相机空间中的度量对应关系。通过学习跨图像的三维坐标匹配,我们能够在没有深度测试的情况下推断出度量相对