单机训练200亿参数大模型:Cerebras打破新纪录

本周,芯片创业公司 Cerebras 宣布了一个里程碑式的新进展:在单个计算设备中训练了超过百亿参数的 NLP(自然语言处理)人工智能模型。

由 Cerebras 训练的 AI 模型体量达到了前所未有的 200 亿参数,所有这些都无需横跨多个加速器扩展工作负载。这项工作足以满足目前网络上最火的文本到图像 AI 生成模型——OpenAI 的 120 亿参数大模型 DALL-E。

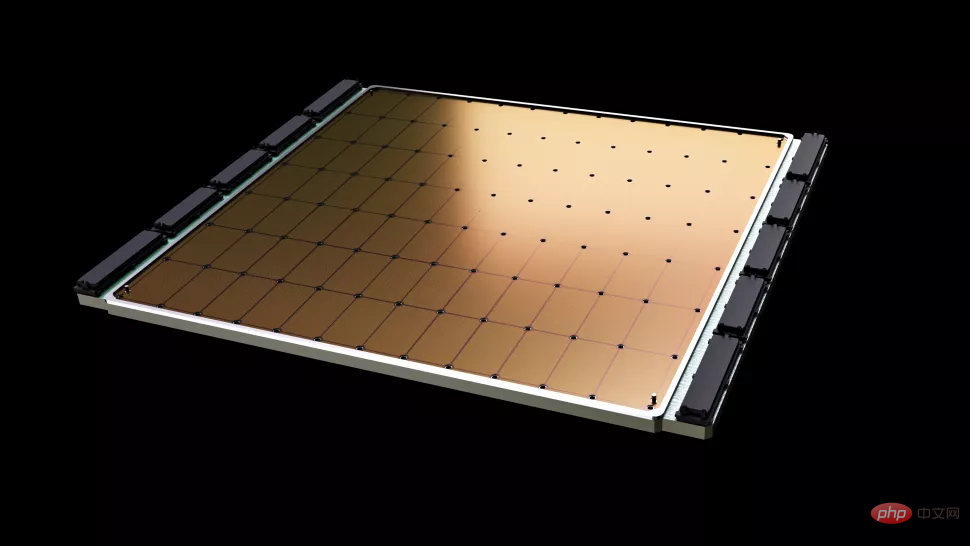

Cerebras 新工作中最重要的一点是对基础设施和软件复杂性的要求降低了。这家公司提供的芯片 Wafer Scale Engine-2(WSE2)顾名思义,蚀刻在单个台积电 7 nm 制程的整块晶圆上,该面积通常足以容纳数百个主流芯片——具有惊人的 2.6 万亿个晶体管、85 万个 AI 计算内核和 40 GB 集成缓存,封装后功耗高达 15kW。

接近晶圆大小的 Wafer Scale Engine-2,面积比一个 iPad 还大。

虽然 Cerebras 的单机在体量上已经类似于超算了,但在单块芯片中保留多达 200 亿个参数的 NLP 模型仍然显著降低了数千个 GPU 的训练成本,以及相关的硬件和扩展要求,同时消除了在它们之间分割模型的技术困难。Cerebras 表示,后者是「NLP 工作负载中最痛苦的方面之一」,有时「需要几个月才能完成」。

这是一个定制化的问题,不仅对每个正在处理的神经网络,对于每个 GPU 的规格以及将它们联系在一起的网络都是独一无二的——这些元素必须在第一次训练开始之前提前设置好,而且也不能跨系统移植。

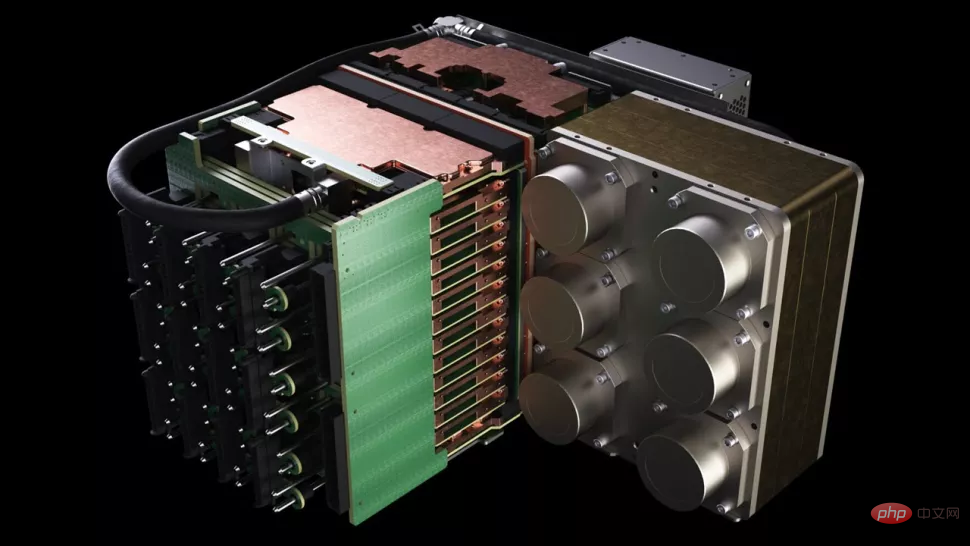

Cerebras 的 CS-2 是一个独立的超级计算集群,其中包括 Wafer Scale Engine-2 芯片,所有相关的电源、内存和存储子系统。

200 亿的参数量大概是个什么水平?在人工智能领域里,大规模预训练模型是最近各家科技公司和机构正在努力发展的方向,OpenAI 的 GPT-3 是一种 NLP 模型,它可以写出足以欺骗人类读者的整篇文章、做数学运算和翻译,其具有惊人的 1750 亿个参数。DeepMind 的 Gopher 于去年年底推出,将参数量的纪录提高到 2800 亿。

最近一段时间,谷歌大脑甚至宣布训练了一个超过万亿参数的模型 Switch Transformer。

「在 NLP 领域中,体量更大的模型被证明效果更好。但传统上,只有极少数公司拥有足够的资源和专业知识来完成分解这些大型模型,将其分散到数百或数千个图形处理单元的艰苦工作,」Cerebras 首席执行官、联合创始人 Andrew Feldman 说道。「因此也只有极少数公司可以训练大型 NLP 模型——这对于行业的其他人来说太昂贵、太耗时且无法使用。」

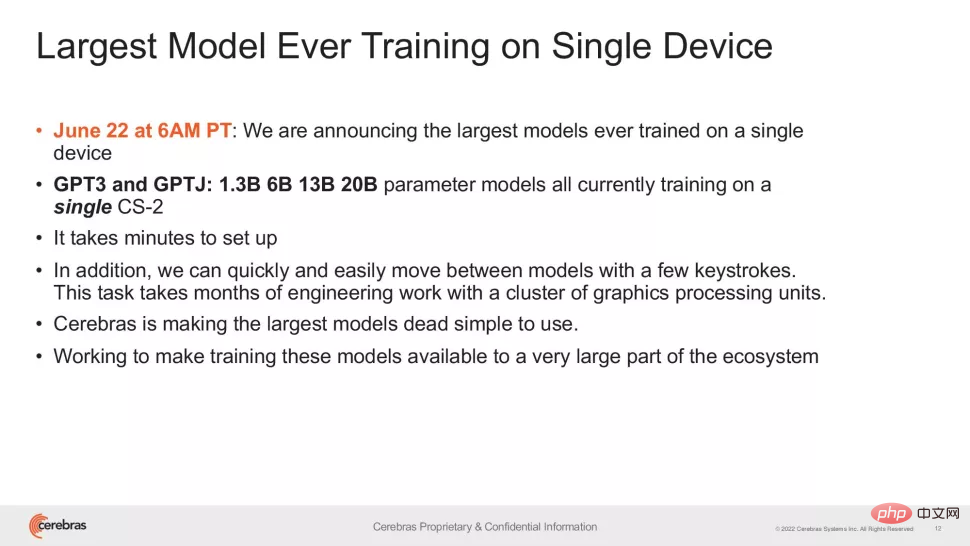

现在,Cerebras 的方法能够降低 GPT-3XL 1.3B、GPT-J 6B、GPT-3 13B 和 GPT-NeoX 20B 模型的应用门槛,使整个 AI 生态系统能够在几分钟内建立大型模型,并在单个 CS-2 系统上训练它们 。

然而,就像旗舰级 CPU 的时钟速度一样,参数量只是大模型性能的其中一项指标。最近,一些研究在减少参数的前提下已经取得了更好的结果,例如 DeepMind 今年 4 月提出的 Chinchilla,只用 700 亿个参数就在常规情况下超过了 GPT-3 和 Gopher。

这类研究的目标当然是更智能的工作,而不是更努力地工作。因此 Cerebras 的成就比人们第一眼看到的更为重要——该研究让我们相信现有的芯片制程水平能够适应日益复杂的模型,该公司表示,以特殊芯片为核心的系统具备了支撑「数千亿甚至数万亿参数」模型的能力。

在单芯片上可训练参数量的爆炸式增长需要依赖 Cerebras 的 Weight Streaming 技术。该技术可以将计算和内存占用分离,根据 AI 工作负载中快速增长的参数量,允许内存进行任意量级的扩展。这使得设置时间从几个月减少到几分钟,并且可以在 GPT-J 和 GPT-Neo 等型号之间切换。正如研究者所说:「只需要敲几次键盘。」

「Cerebras 以低成本、便捷的方式向人们提供了运行大型语言模型的能力,开启了人工智能令人兴奋的新时代。它为那些不能花费数千万美元的组织提供了一个简单而廉价的,参与到大模型竞争之中的方式,」Intersect360 研究公司的首席研究官 Dan Olds 说道。「当 CS-2 客户在大量数据集上训练 GPT-3 和 GPT-J 级模型时,我们非常期待 CS-2 客户的新应用和新发现。」

以上是单机训练200亿参数大模型:Cerebras打破新纪录的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

字节跳动剪映推出 SVIP 超级会员:连续包年 499 元,提供多种 AI 功能

Jun 28, 2024 am 03:51 AM

字节跳动剪映推出 SVIP 超级会员:连续包年 499 元,提供多种 AI 功能

Jun 28, 2024 am 03:51 AM

本站6月27日消息,剪映是由字节跳动旗下脸萌科技开发的一款视频剪辑软件,依托于抖音平台且基本面向该平台用户制作短视频内容,并兼容iOS、安卓、Windows、MacOS等操作系统。剪映官方宣布会员体系升级,推出全新SVIP,包含多种AI黑科技,例如智能翻译、智能划重点、智能包装、数字人合成等。价格方面,剪映SVIP月费79元,年费599元(本站注:折合每月49.9元),连续包月则为59元每月,连续包年为499元每年(折合每月41.6元)。此外,剪映官方还表示,为提升用户体验,向已订阅了原版VIP

使用Rag和Sem-Rag提供上下文增强AI编码助手

Jun 10, 2024 am 11:08 AM

使用Rag和Sem-Rag提供上下文增强AI编码助手

Jun 10, 2024 am 11:08 AM

通过将检索增强生成和语义记忆纳入AI编码助手,提升开发人员的生产力、效率和准确性。译自EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG,作者JanakiramMSV。虽然基本AI编程助手自然有帮助,但由于依赖对软件语言和编写软件最常见模式的总体理解,因此常常无法提供最相关和正确的代码建议。这些编码助手生成的代码适合解决他们负责解决的问题,但通常不符合各个团队的编码标准、惯例和风格。这通常会导致需要修改或完善其建议,以便将代码接受到应

微调真的能让LLM学到新东西吗:引入新知识可能让模型产生更多的幻觉

Jun 11, 2024 pm 03:57 PM

微调真的能让LLM学到新东西吗:引入新知识可能让模型产生更多的幻觉

Jun 11, 2024 pm 03:57 PM

大型语言模型(LLM)是在巨大的文本数据库上训练的,在那里它们获得了大量的实际知识。这些知识嵌入到它们的参数中,然后可以在需要时使用。这些模型的知识在训练结束时被“具体化”。在预训练结束时,模型实际上停止学习。对模型进行对齐或进行指令调优,让模型学习如何充分利用这些知识,以及如何更自然地响应用户的问题。但是有时模型知识是不够的,尽管模型可以通过RAG访问外部内容,但通过微调使用模型适应新的领域被认为是有益的。这种微调是使用人工标注者或其他llm创建的输入进行的,模型会遇到额外的实际知识并将其整合

七个很酷的GenAI & LLM技术性面试问题

Jun 07, 2024 am 10:06 AM

七个很酷的GenAI & LLM技术性面试问题

Jun 07, 2024 am 10:06 AM

想了解更多AIGC的内容,请访问:51CTOAI.x社区https://www.51cto.com/aigc/译者|晶颜审校|重楼不同于互联网上随处可见的传统问题库,这些问题需要跳出常规思维。大语言模型(LLM)在数据科学、生成式人工智能(GenAI)和人工智能领域越来越重要。这些复杂的算法提升了人类的技能,并在诸多行业中推动了效率和创新性的提升,成为企业保持竞争力的关键。LLM的应用范围非常广泛,它可以用于自然语言处理、文本生成、语音识别和推荐系统等领域。通过学习大量的数据,LLM能够生成文本

快手版Sora「可灵」开放测试:生成超120s视频,更懂物理,复杂运动也能精准建模

Jun 11, 2024 am 09:51 AM

快手版Sora「可灵」开放测试:生成超120s视频,更懂物理,复杂运动也能精准建模

Jun 11, 2024 am 09:51 AM

什么?疯狂动物城被国产AI搬进现实了?与视频一同曝光的,是一款名为「可灵」全新国产视频生成大模型。Sora利用了相似的技术路线,结合多项自研技术创新,生产的视频不仅运动幅度大且合理,还能模拟物理世界特性,具备强大的概念组合能力和想象力。数据上看,可灵支持生成长达2分钟的30fps的超长视频,分辨率高达1080p,且支持多种宽高比。另外再划个重点,可灵不是实验室放出的Demo或者视频结果演示,而是短视频领域头部玩家快手推出的产品级应用。而且主打一个务实,不开空头支票、发布即上线,可灵大模型已在快影

你所不知道的机器学习五大学派

Jun 05, 2024 pm 08:51 PM

你所不知道的机器学习五大学派

Jun 05, 2024 pm 08:51 PM

机器学习是人工智能的重要分支,它赋予计算机从数据中学习的能力,并能够在无需明确编程的情况下改进自身能力。机器学习在各个领域都有着广泛的应用,从图像识别和自然语言处理到推荐系统和欺诈检测,它正在改变我们的生活方式。机器学习领域存在着多种不同的方法和理论,其中最具影响力的五种方法被称为“机器学习五大派”。这五大派分别为符号派、联结派、进化派、贝叶斯派和类推学派。1.符号学派符号学(Symbolism),又称为符号主义,强调利用符号进行逻辑推理和表达知识。该学派认为学习是一种逆向演绎的过程,通过已有的

为大模型提供全新科学复杂问答基准与测评体系,UNSW、阿贡、芝加哥大学等多家机构联合推出SciQAG框架

Jul 25, 2024 am 06:42 AM

为大模型提供全新科学复杂问答基准与测评体系,UNSW、阿贡、芝加哥大学等多家机构联合推出SciQAG框架

Jul 25, 2024 am 06:42 AM

编辑|ScienceAI问答(QA)数据集在推动自然语言处理(NLP)研究发挥着至关重要的作用。高质量QA数据集不仅可以用于微调模型,也可以有效评估大语言模型(LLM)的能力,尤其是针对科学知识的理解和推理能力。尽管当前已有许多科学QA数据集,涵盖了医学、化学、生物等领域,但这些数据集仍存在一些不足。其一,数据形式较为单一,大多数为多项选择题(multiple-choicequestions),它们易于进行评估,但限制了模型的答案选择范围,无法充分测试模型的科学问题解答能力。相比之下,开放式问答

AI初创集体跳槽OpenAI,Ilya出走后安全团队重整旗鼓!

Jun 08, 2024 pm 01:00 PM

AI初创集体跳槽OpenAI,Ilya出走后安全团队重整旗鼓!

Jun 08, 2024 pm 01:00 PM

上周,在内部的离职潮和外部的口诛笔伐之下,OpenAI可谓是内忧外患:-侵权寡姐引发全球热议-员工签署「霸王条款」被接连曝出-网友细数奥特曼「七宗罪」辟谣:根据Vox获取的泄露信息和文件,OpenAI的高级领导层,包括Altman在内,非常了解这些股权回收条款,并且签署了它们。除此之外,还有一个严峻而紧迫的问题摆在OpenAI面前——AI安全。最近,五名与安全相关的员工离职,其中包括两名最著名的员工,“超级对齐”团队的解散让OpenAI的安全问题再次被置于聚光灯下。《财富》杂志报道称,OpenA