解读2023毕业论文放榜:中稿胆战心惊?rebuttal难改宿命?审稿人是否带有偏见?

又到顶会放榜时,几家欢喜几家愁。

本次IJCAI 2023共收到4566份提交全文,接收率大约15%

问题链接:https://www.zhihu.com/question/578082970

从知乎上反馈的结果来看,整体审稿质量依然不尽如人意(也可能是被拒稿的怨念...),甚至有的审稿人根本没看rebuttal的内容就给拒了。

也存在都是分数相同,但结局不同的论文。

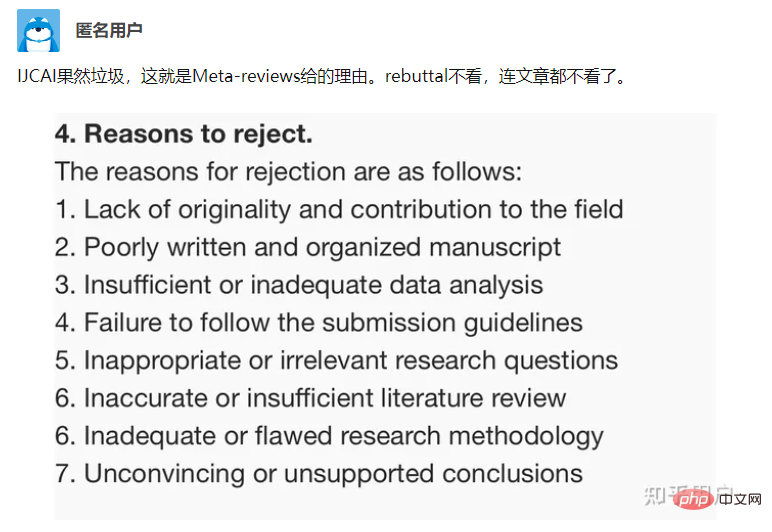

也有网友贴出meta review的拒绝理由,全是大缺点。

不过拒稿并不是终点,更重要的是继续出发。

网友Lower_Evening_4056认为,即便是里程碑式的论文也会被多次拒稿,也有一些论文即便不够出色,也能被录用。

当你继续前行,再回过头来看那些合理的审稿意见时,你会发现自己的工作还能再上一个层次。

审稿系统确实存在缺陷,更重要的是不要把reject看作是对你个人或作品价值的评估结果。如果你是一个学生,并且你的导师根据审稿结果而不是工作质量来评价你的话,那你可能就要重新考虑和导师的合作关系了。

NeurIPS会议此前开展过一致性实验,对于平均分在5到6.5之间的论文,录用结果基本就是随机的,取决于你碰到的审稿人。

比如说有个人的论文结果是9665,如果他没碰到给他9分的审稿人,那结果必然是reject,只不过他刚好碰到了伯乐,并且扭转了审稿结果。

最后,恭喜那些论文录用的科研人,助力推动人工智能研究的发展!

下面是一些在社交媒体上分享已录用的论文。

IJCAI 2023接收论文

端到端抗噪语音识别中多任务学习的梯度修正

在下游语音自动识别系统(ASR)中,语音增强学习策略(SE)被证明能够有效地减少噪声语音信号产生的噪声,该系统采用多任务学习策略对这两个任务进行联合优化。

然而,通过 SE 目标学习的增强语音并不总是产生良好的 ASR 结果。

从优化的角度来看,自适应任务和自适应反应任务的梯度之间有时会存在干扰,这会阻碍多任务学习,最终导致自适应反应性能不理想。

论文链接:https://arxiv.org/pdf/2302.11362.pdf

这篇论文提出了一种简单而有效的梯度补偿(GR)方法来解决噪声鲁棒语音识别中任务梯度之间的干扰问题。

具体来说,首先将 SE 任务的梯度投影到一个与 ASR 梯度呈锐角的动态曲面上,以消除它们之间的冲突,协助 ASR 优化。

此外,自适应地调整两个梯度的大小,以防止主导 ASR 任务被 SE 梯度误导。

实验结果表明,该方法较好地解决了梯度干扰问题,在多任务学习基线上,在 RATS 和 CHiME-4数据集上分别实现了9.3% 和11.1% 的相对词错误率(WER)降低。

约束 Tsetlin 机器子句大小构建简明逻辑模式

Tsetlin 机器(TM)是一种基于逻辑的机器学习方法,具有透明和硬件友好的关键优势。

虽然 TM 在越来越多的应用程序中匹配或超越了深度学习的准确性,但是大子句池往往产生具有许多文字(长子句)的子句,使得它们变得不那么容易理解。

此外,较长的子句增加了硬件中子句逻辑的切换活动,具有更高的功耗。

论文链接:https://arxiv.org/abs/2301.08190

这篇论文介绍了一种新的 TM 学习方法,即子句大小受限的子句学习方法(CSC-TM) ,可以对子句大小设置软约束。

一旦子句包含比约束允许的更多的字面值(literals),就开始排除字面值,因此只会短暂出现较大的子句。

为了评价 CSC-TM,研究人员对表格数据、自然语言文本、图像和棋盘游戏进行了分类、聚类和回归实验。

结果表明,CSC-TM 保持准确性与多达80倍的文字减少,实际上,TREC、 IMDb 和 BBC Sports 的子句越短,准确性就越高,在准确性达到峰值之后,当子句大小接近单个文字时,就会缓慢地下降。

文章最后分析了 CSC-TM 的功耗,得到了新的收敛性质。

#DNN-Verification问题:计算深度神经网络的不安全输入

深度神经网络越来越多地用于需要高安全级别的关键任务,比如说自动驾驶,虽然可以采用最先进的验证器来检查DNN是否是不安全的:

给定一些属性(即,是否存在至少一个不安全的输入配置)后,模型的yes/no输出对于其它目的(例如shielding、模型选择或训练改进)而言信息量不足。

论文链接:https://arxiv.org/abs/2301.07068

这篇论文介绍了#DNN-Verification问题,该问题涉及计算导致违反特定安全属性的DNN输入配置的数量,研究人员分析了这个问题的复杂性,并提出了一种新的方法,返回确切的违规计数。

由于问题是P-完备性的,文中提出了一个随机的近似方法,提供了一个可证明的概率界的正确计数,同时显着降低计算要求。

文中还提出了一组安全关键的基准,证明该近似方法的有效性和评估的约束的紧密性的实验结果。

以上是解读2023毕业论文放榜:中稿胆战心惊?rebuttal难改宿命?审稿人是否带有偏见?的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

Stable Diffusion 3论文终于发布,架构细节大揭秘,对复现Sora有帮助?

Mar 06, 2024 pm 05:34 PM

Stable Diffusion 3论文终于发布,架构细节大揭秘,对复现Sora有帮助?

Mar 06, 2024 pm 05:34 PM

StableDiffusion3的论文终于来了!这个模型于两周前发布,采用了与Sora相同的DiT(DiffusionTransformer)架构,一经发布就引起了不小的轰动。与之前版本相比,StableDiffusion3生成的图质量有了显着提升,现在支持多主题提示,并且文字书写效果也得到了改善,不再出现乱码情况。 StabilityAI指出,StableDiffusion3是一个系列模型,其参数量从800M到8B不等。这一参数范围意味着该模型可以在许多便携设备上直接运行,从而显着降低了使用AI

ICCV'23论文颁奖'神仙打架”!Meta分割一切和ControlNet共同入选,还有一篇让评委们很惊讶

Oct 04, 2023 pm 08:37 PM

ICCV'23论文颁奖'神仙打架”!Meta分割一切和ControlNet共同入选,还有一篇让评委们很惊讶

Oct 04, 2023 pm 08:37 PM

在法国巴黎举行的计算机视觉顶峰大会ICCV2023刚刚结束!今年的最佳论文奖,简直是“神仙打架”。例如,获得最佳论文奖的两篇论文中,就包括颠覆文生图AI领域的著作——ControlNet。自从开源以来,ControlNet在GitHub上已经获得了24k个星。无论是对于扩散模型还是整个计算机视觉领域来说,这篇论文的获奖都是实至名归的而最佳论文奖荣誉提名,则颁给了另一篇同样出名的论文,Meta的「分割一切」模型SAM。自推出以来,「分割一切」已经成为了各种图像分割AI模型的“标杆”,包括后来居上的

NeRF与自动驾驶的前世今生,近10篇论文汇总!

Nov 14, 2023 pm 03:09 PM

NeRF与自动驾驶的前世今生,近10篇论文汇总!

Nov 14, 2023 pm 03:09 PM

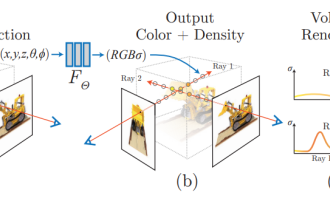

神经辐射场(NeuralRadianceFields)自2020年被提出以来,相关论文数量呈指数增长,不但成为了三维重建的重要分支方向,也逐渐作为自动驾驶重要工具活跃在研究前沿。NeRF这两年异军突起,主要因为它跳过了传统CV重建pipeline的特征点提取和匹配、对极几何与三角化、PnP加BundleAdjustment等步骤,甚至跳过mesh的重建、贴图和光追,直接从2D输入图像学习一个辐射场,然后从辐射场输出逼近真实照片的渲染图像。也就是说,让一个基于神经网络的隐式三维模型,去拟合指定视角

聊天截图曝出AI顶会审稿潜规则!AAAI 3000块即可strong accept?

Apr 12, 2023 am 08:34 AM

聊天截图曝出AI顶会审稿潜规则!AAAI 3000块即可strong accept?

Apr 12, 2023 am 08:34 AM

正值AAAI 2023论文截止提交之际,知乎上突然出现了一张AI投稿群的匿名聊天截图。其中有人声称,自己可以提供「3000块一个strong accept」的服务。爆料一出,顿时引起了网友们的公愤。不过,先不要着急。知乎大佬「微调」表示,这大概率只是「口嗨」而已。据「微调」透露,打招呼和团伙作案这个是任何领域都不能避免的问题。随着openreview的兴起,cmt的各种弊端也越来越清楚,未来留给小圈子操作的空间会变小,但永远会有空间。因为这是个人的问题,不是投稿系统和机制的问题。引入open r

论文插图也能自动生成了,用到了扩散模型,还被ICLR接收

Jun 27, 2023 pm 05:46 PM

论文插图也能自动生成了,用到了扩散模型,还被ICLR接收

Jun 27, 2023 pm 05:46 PM

生成式AI已经风靡了人工智能社区,无论是个人还是企业,都开始热衷于创建相关的模态转换应用,比如文生图、文生视频、文生音乐等等。最近呢,来自ServiceNowResearch、LIVIA等科研机构的几位研究者尝试基于文本描述生成论文中的图表。为此,他们提出了一种FigGen的新方法,相关论文还被ICLR2023收录为了TinyPaper。图片论文地址:https://arxiv.org/pdf/2306.00800.pdf也许有人会问了,生成论文中的图表有什么难的呢?这样做对于科研又有哪些帮助呢

华人团队斩获最佳论文、最佳系统论文奖项,CoRL研究成果获奖公布

Nov 10, 2023 pm 02:21 PM

华人团队斩获最佳论文、最佳系统论文奖项,CoRL研究成果获奖公布

Nov 10, 2023 pm 02:21 PM

自2017年首次举办以来,CoRL已经成为了机器人学与机器学习交叉领域的全球顶级学术会议之一。CoRL是面向机器人学习研究的单一主题会议,涵盖了机器人学、机器学习和控制等多个主题,包括理论与应用2023年的CoRL大会将于11月6日至9日在美国亚特兰大举行。根据官方数据透露,今年有来自25个国家的199篇论文入选CoRL。热门主题包括操作、强化学习等。虽然相较于AAAI、CVPR等大型AI学术会议,CoRL的规模较小,但随着今年大模型、具身智能、人形机器人等概念的热度上升,值得关注的相关研究也会

CVPR 2023放榜,录用率25.78%!2360篇论文被接收,提交量暴涨至9155篇

Apr 13, 2023 am 09:37 AM

CVPR 2023放榜,录用率25.78%!2360篇论文被接收,提交量暴涨至9155篇

Apr 13, 2023 am 09:37 AM

刚刚,CVPR 2023发文称:今年,我们收到了创纪录的9155份论文(比CVPR2022增加了12%),并录用了2360篇论文,接收率为25.78%。据统计,CVPR的投稿量在2010-2016的7年间仅从1724增加到2145。在2017年后则迅速飙升,进入快速增长期,2019年首次突破5000,至2022年投稿数已达到8161份。可以看到,今年提交了共9155份论文确实创下了最高记录。疫情放开后,今年的CVPR顶会将在加拿大举行。今年采用单轨会议的形式,并取消了传统Oral的评选。谷歌研究

微软新出热乎论文:Transformer扩展到10亿token

Jul 22, 2023 pm 03:34 PM

微软新出热乎论文:Transformer扩展到10亿token

Jul 22, 2023 pm 03:34 PM

当大家不断升级迭代自家大模型的时候,LLM(大语言模型)对上下文窗口的处理能力,也成为一个重要评估指标。比如明星大模型GPT-4支持32ktoken,相当于50页的文字;OpenAI前成员创立的Anthropic更是将Claude处理token能力提升到100k,约75000个单词,大概相当于一键总结《哈利波特》第一部。在微软最新的一项研究中,他们这次直接将Transformer扩展到10亿token。这为建模非常长的序列开辟了新的可能性,例如将整个语料库甚至整个互联网视为一个序列。作为比较,普