阿里云启动全面改造计划,推出大语言模型"通义千问"

5月23日消息,阿里巴巴集团旗下的阿里云计划进行一轮组织和人员优化,以进一步改善其业务战略、组织和运营。这一消息是在阿里巴巴集团董事会主席兼阿里云智能CEO张勇宣布阿里云将在未来12个月从阿里集团完全分拆并完成上市的五天前发布的。

多个消息来源称,在5月中旬开始了这次优化计划,而阿里集团在上个月刚刚公布了去年的绩效。虽然有关阿里云裁员7%的消息备受关注,但阿里云方面已回应,这是一次常规的组织岗位和人员优化。据一位公司内部人士透露,公司的裁员补偿标准为“N+1+1”,并且未休的年假和陪伴假等可以转换成现金。

每年都会进行组织和人员的优化,阿里云作为阿里巴巴集团重要的业务板块,也不例外。此次优化被视为进一步强化业务战略、提升组织效率的举措。去年12月,张勇接管阿里云以来,已经采取了多项重要举措,其中之一是对阿里云产品进行了史上最大规模的降价。这次降价旨在降低云服务的成本,扩大市场份额。

据IDC数据显示,阿里云在国内公有云市场的份额一直居于领先地位,但在2022年下半年,其市场份额较去年同期下滑了4.8%。同时,公有云市场整体增速明显缓慢,收入增长率同比下降了近24个百分点。这可能是阿里云进行优化的一个背景原因。

抵消跨分部交易影响后,阿里巴巴集团今年第一季度的云业务收入同比下降了2%,营收为185.82亿元。为应对这一局面,阿里云于4月推出了最新的大语言模型"通义千问",并计划将所有产品进行全面改造,以适应人工智能时代的发展。

综上所述,阿里云的组织和人员优化计划旨在进一步优化业务战略、提升组

织效率,并适应当前公有云市场的变化。阿里云将继续努力保持其在云计算领域的领先地位,以向用户提供更优质的云服务。

以上是阿里云启动全面改造计划,推出大语言模型"通义千问"的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

7648

7648

15

15

1392

1392

52

52

91

91

11

11

73

73

19

19

36

36

110

110

阿里云宣布 2024 云栖大会于 9 月 19 日至 21 日在杭州举办,畅享票免费申请

Aug 07, 2024 pm 07:12 PM

阿里云宣布 2024 云栖大会于 9 月 19 日至 21 日在杭州举办,畅享票免费申请

Aug 07, 2024 pm 07:12 PM

本站8月5日消息,阿里云宣布,2024云栖大会将于9月19日~21日在杭州云栖小镇举办,将设三日主论坛、400场分论坛与并行话题以及近四万平方米展区。云栖大会对公众免费开放,即日起公众可以通过云栖大会官网免费申请畅享票,另有5000元的全通票可购买,本站附门票网址:https://yunqi.aliyun.com/2024/ticket-list据介绍,云栖大会起源于2009年,最初命名为第一届中国网站发展论坛,2011年演变成阿里云开发者大会,2015年正式更名为“云栖大会”,至今已连续成功举

阿里云宣布开源通义千问 140 亿参数模型 Qwen-14B 及其对话模型,免费可商用

Sep 26, 2023 pm 08:05 PM

阿里云宣布开源通义千问 140 亿参数模型 Qwen-14B 及其对话模型,免费可商用

Sep 26, 2023 pm 08:05 PM

阿里云今天宣布了一个开源项目,名为Qwen-14B,该项目包括一个参数模型和一个对话模型。这个开源项目允许免费商用本站声明:阿里云之前已经开源了一个价值70亿的参数模型Qwen-7B,一个多月的下载量已经突破了100万次通过阿里云给出的数据来看,Qwen-14B在多个权威评测中超越同等规模模型,部分指标甚至接近Llama2-70B。据介绍,Qwen-14B是一款高性能的开源模型,支持多种语言。它的整体训练数据超过3万亿Token,具备更强的推理、认知、规划和记忆能力,并且最大支持8k的上下文窗口

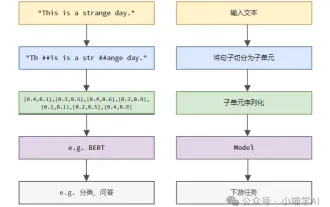

一文搞懂Tokenization!

Apr 12, 2024 pm 02:31 PM

一文搞懂Tokenization!

Apr 12, 2024 pm 02:31 PM

语言模型是对文本进行推理的,文本通常是字符串形式,但模型的输入只能是数字,因此需要将文本转换成数字形式。Tokenization是自然语言处理的基本任务,根据特定需求能够把一段连续的文本序列(如句子、段落等)切分为一个字符序列(如单词、短语、字符、标点等多个单元),其中的单元称为token或词语。根据下图所示的具体流程,首先将文本句子切分成一个个单元,然后将单元素数值化(映射为向量),再将这些向量输入到模型进行编码,最后输出到下游任务进一步得到最终的结果。文本切分按照文本切分的粒度可以将Toke

云端部署大模型的三个秘密

Apr 24, 2024 pm 03:00 PM

云端部署大模型的三个秘密

Apr 24, 2024 pm 03:00 PM

编译|星璇出品|51CTO技术栈(微信号:blog51cto)在过去的两年里,我更多地参与了使用大型语言模型(LLMs)的生成AI项目,而非传统的系统。我开始怀念无服务器云计算。它们的应用范围广泛,从增强对话AI到为各行各业提供复杂的分析解决方案,以及其他许多功能。许多企业将这些模型部署在云平台上,因为公共云提供商已经提供了现成的生态系统,而且这是阻力最小的路径。然而,这并不便宜。云还提供了其他好处,如可扩展性、效率和高级计算能力(按需提供GPU)。在公共云平台上部署LLM的过程有一些鲜为人知的

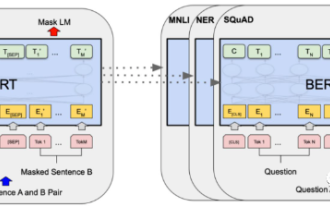

大规模语言模型高效参数微调--BitFit/Prefix/Prompt 微调系列

Oct 07, 2023 pm 12:13 PM

大规模语言模型高效参数微调--BitFit/Prefix/Prompt 微调系列

Oct 07, 2023 pm 12:13 PM

2018年谷歌发布了BERT,一经面世便一举击败11个NLP任务的State-of-the-art(Sota)结果,成为了NLP界新的里程碑;BERT的结构如下图所示,左边是BERT模型预训练过程,右边是对于具体任务的微调过程。其中,微调阶段是后续用于一些下游任务的时候进行微调,例如:文本分类,词性标注,问答系统等,BERT无需调整结构就可以在不同的任务上进行微调。通过”预训练语言模型+下游任务微调”的任务设计,带来了强大的模型效果。从此,“预训练语言模型+下游任务微调”便成为了NLP领域主流训

为大模型提供全新科学复杂问答基准与测评体系,UNSW、阿贡、芝加哥大学等多家机构联合推出SciQAG框架

Jul 25, 2024 am 06:42 AM

为大模型提供全新科学复杂问答基准与测评体系,UNSW、阿贡、芝加哥大学等多家机构联合推出SciQAG框架

Jul 25, 2024 am 06:42 AM

编辑|ScienceAI问答(QA)数据集在推动自然语言处理(NLP)研究发挥着至关重要的作用。高质量QA数据集不仅可以用于微调模型,也可以有效评估大语言模型(LLM)的能力,尤其是针对科学知识的理解和推理能力。尽管当前已有许多科学QA数据集,涵盖了医学、化学、生物等领域,但这些数据集仍存在一些不足。其一,数据形式较为单一,大多数为多项选择题(multiple-choicequestions),它们易于进行评估,但限制了模型的答案选择范围,无法充分测试模型的科学问题解答能力。相比之下,开放式问答

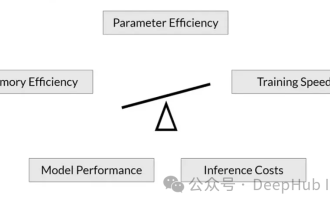

RoSA: 一种高效微调大模型参数的新方法

Jan 18, 2024 pm 05:27 PM

RoSA: 一种高效微调大模型参数的新方法

Jan 18, 2024 pm 05:27 PM

随着语言模型扩展到前所未有的规模,对下游任务进行全面微调变得十分昂贵。为了解决这个问题,研究人员开始关注并采用PEFT方法。PEFT方法的主要思想是将微调的范围限制在一小部分参数上,以降低计算成本,同时仍能实现自然语言理解任务的最先进性能。通过这种方式,研究人员能够在保持高性能的同时,节省计算资源,为自然语言处理领域带来新的研究热点。RoSA是一种新的PEFT技术,通过在一组基准测试的实验中,发现在使用相同参数预算的情况下,RoSA表现出优于先前的低秩自适应(LoRA)和纯稀疏微调方法。本文将深

阿里云缓存机制有哪些

Nov 15, 2023 am 11:22 AM

阿里云缓存机制有哪些

Nov 15, 2023 am 11:22 AM

阿里云缓存机制有阿里云Redis、阿里云Memcache、分布式缓存服务DSC、阿里云Table Store、CDN等。详细介绍:1、阿里云Redis:阿里云提供的分布式内存数据库,支持高速读写和数据持久化。通过将数据存储在内存中,可以提供低延迟的数据访问和高并发的处理能力;2、阿里云Memcache:阿里云提供的高速缓存系统等等。