AI行业盛会大咖云集!Sam Altam、“AI教父”......一文看懂最新观点

对于AI行业来说,近几日在北京举行的2023智源人工智能大会可谓是大咖云集,除了OpenAI的创始人Sam Altam外,图灵奖Geoffrey Hinton、杨立昆(Yann LeCun)、知名AI绘图软件Midjourney创始人David Holz等相继现身,大咖们的演讲对于行业未来的发展极具前瞻性。

下面一起来看下这些AI行业的顶级专家们都说了什么。

人们既渴望又害怕智能

Midjourney创始人David Holz是一名连续创业者,2011年,他创办了VR领域的软硬件公司Leap Motion,2019年把 Leap Motion 卖给了竞争对手 Ultrahaptics,2021年,又自筹资金创办了当前大火的AI绘图软件Midjourney。

David Holz认为,人工智能在我所理解的范畴内,有些类似于我们身体的一部分,而且它也和历史紧密相关。这也让自己与历史交织在一起,这种方式很有趣。

Holz认为,Midjourney的目标之一是建造新的人类基础设施。世界将需要很多新东西,需要基础设施来建造新东西。所以我想了很多关于建立新的人类基础设施形式,就像基础设施的新支柱。所以我需要我的主题,我的支柱是反思、想象和协调。你必须反思你是谁,想要什么,想象可能会发生什么。因为这是我们在任何事情上都使用的视角,我们开始看到在图像合成领域发生了一些突破,这与我以前在人工智能领域遇到的任何事情都有质的不同。

Holz介绍,Midjourney不仅仅是学习如何使用这个工具,而是学习所有的艺术和历史,以及所有关于相机、镜头和灯光的知识。用户想要理解他们现在可以在创作中使用的语言和概念。过去,我曾认为知识只是某种历史的积累,但现在我已认识到知识实际上是创造事物的能力。

Holz认为人们担心人工智能过快发展不仅仅是因为技术,还因为对智能的恐惧。如果他们很聪明,我能相信他们吗?但另一方面,我们似乎希望世界拥有尽可能多的智能,我们似乎不想要一个缺乏智慧的世界。

AI会学会非常善于欺骗别人

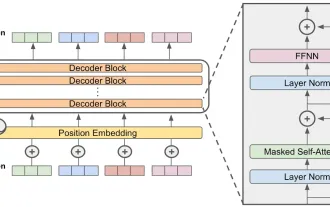

深度学习泰斗、人工智能教父Geoffrey Hinton表示,现在AI发展的最大壁垒是算力问题,算力还远远不够。现在可以放弃计算机科学最基本的原则——软件应该与硬件分开,我将提到一种称为"activity perturbation"的算法,该算法可以用于训练神经网络,且节省算力。

这种算法能够预估梯度,且噪声要比传统的反向传播算法(RNN)小得多。关于如何将这种算法应用于训练大型神经网络的问题,可以将大型神经网络分成许多小组,并为每个小组分配一个局部目标函数。然后,可以使用"activity perturbation"算法来训练每个小组,并将它们组合在一起形成一个大型神经网络,并通过无监督学习模型来生成这些局部目标函数。

当硬件出现问题时,信息都会丢失,父类信息传递给子类信息,以便在硬件出现问题时仍然可以保留学习到的信息,更有效地约束神经网络的权重。

"distillation"这一方法可以让子模型更好地学习到分类图像的信息,包括如何给出正确的答案以及给出错误答案的概率,而且还有一个特殊属性,即训练子模型的同时也在训练子模型的通用化能力。

如果这些人工智能不是以缓慢的方式从我们那里学习,而是直接从现实世界中学习,那么Hinton表示。一旦他们开始这样做,他们将会比人们学得更多,并且能够快速学会。

如果这些东西变得比人类我们更聪明,会发生什么?Hinton认为,这些超级智能发生的速度可能比其以前想象的要快得多。

如果你想说超级智能更有效率,您需要允许它创建子类,或多或少你都会想依靠AI获得更多的力量,获得更多的控制权,拥有的控制权越多,就越容易实现目标。Hinton发现预测人类如何阻止AI试图获得更多控制权以实现其它目标非常困难。当他们开始这样做的时候,人类就会面临问题,因为他们会发现通过操纵人来获得更多权力是非常容易的。

据Hinton所言,AI会变得非常擅长欺骗他人,这是令人担忧的,而目前我还没有看到可以防止这种情况发生的方法。研究人员需要弄清楚,如何使人类拥有超级智能,从而可以改善生活,而无需他们过度干预。

人类可能会因AI失去对世界和未来的控制

姚期智是图灵奖得主和中国科学院院士,他认为在思考如何控制人工智能之前,人类需要真正解决自身的问题。对于AI技术,当前正是一个重要窗口。在创造AGI之前或进行军备竞赛之前,亟需达成共识,共同合作建立一个AI治理框架。

加州伯克利分校教授Stuart Russell表示,通用人工智能(AGI)还没达到,大语言模型只是其中一块拼图,人们连拼图最终会是什么样子,缺哪些还不确定。

他表示,ChatGPT和GPT-4没有在“回答”问题,它们不理解世界。

Russell指出,最大的风险来自于科技公司之间似乎不受约束的竞争,无论风险如何,他们不会停止开发越来越强大的系统。就像人类让大猩猩失去了对自己未来的控制一样,AI可能会使人类失去对世界和未来的控制。

AGI的三条技术路线

北京智源人工智能研究院院长黄铁军指出,要实现通用人工智能(AGI),有三条技术路线:第一是“大数据+自监督学习+大算力”形成的信息类模型;第二是具身智能,是基于虚拟世界或真实世界、通过强化学习训练出来的具身模型;第三是脑智能,直接“抄自然进化的作业”,复制出数字版本的智能体。

OpenAI做GPT(生成式预训练Transformer模型)就遵循第一条技术路线;以谷歌DeepMind的DQN(深度Q网络,Deep Q-network)为核心取得的一系列进展即基于第二条技术路线。

智源期望不同于前两个技术路线,从‘第一性原理’出发,从原子到有机分子、到神经系统、到身体,构建一个完整的智能系统AGI。智源是一种新型研发机构平台,正在三个方向上开展工作,以实现一个需要大约20年才能实现的目标。

AI未来面临的三个挑战

图灵奖得主、人工智能“三巨头”之一的杨立昂认为,机器学习和人类动物相比并不特别好,AI 缺失的不仅仅是学习的能力,还有推理和规划的能力。我们应该使用机器复制人类和动物通过观察世界或体验世界学习世界运作方式的能力。

杨立昂指出,未来几年 AI 面临的三个主要挑战:首先是学习世界的表征和预测模型,可以采用自监督的方式进行学习。

其次是学习推理。这对应着心理学家丹尼尔·卡尼曼的系统1和系统2的概念,系统 1 是与潜意识计算相对应的人类行为或行动,是那些无需思考即可完成的事情;而系统2则是你有意识地、有目的地运用你的全部思维力去完成的任务。目前,人工智能基本上只能实现系统1中的功能,而且并不完全;

最后一个挑战则是如何通过将复杂任务分解成简单任务,以分层的方式运行来规划复杂的行动序列。

GPT-5的诞生“不会很快”

OpenAI创始人Sam Altman引用了《道德经》谈及大国合作,表示AI安全始于足下,各国间必须进行合作和协调。

Altman认为,很可能未来十年会有非常强大的AI系统,新技术从根本上改变世界的速度比人们想象得快,把AI安全规则做好是重要且紧迫的。

在被张宏江问及了AGI的未来,以及是否会很快看到GPT-5时,Altman称,自己也不确定,但明确表示GPT-5的诞生“不会很快”。

Altman表示会提供许多开源的大模型,但没有具体的发布时间表。

以上是AI行业盛会大咖云集!Sam Altam、“AI教父”......一文看懂最新观点的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

最佳AI艺术生成器(免费付款)创意项目

Apr 02, 2025 pm 06:10 PM

最佳AI艺术生成器(免费付款)创意项目

Apr 02, 2025 pm 06:10 PM

本文回顾了AI最高的艺术生成器,讨论了他们的功能,对创意项目的适用性和价值。它重点介绍了Midjourney是专业人士的最佳价值,并建议使用Dall-E 2进行高质量的可定制艺术。

开始使用Meta Llama 3.2 -Analytics Vidhya

Apr 11, 2025 pm 12:04 PM

开始使用Meta Llama 3.2 -Analytics Vidhya

Apr 11, 2025 pm 12:04 PM

Meta的Llama 3.2:多模式和移动AI的飞跃 Meta最近公布了Llama 3.2,这是AI的重大进步,具有强大的视觉功能和针对移动设备优化的轻量级文本模型。 以成功为基础

最佳AI聊天机器人比较(Chatgpt,Gemini,Claude&更多)

Apr 02, 2025 pm 06:09 PM

最佳AI聊天机器人比较(Chatgpt,Gemini,Claude&更多)

Apr 02, 2025 pm 06:09 PM

本文比较了诸如Chatgpt,Gemini和Claude之类的顶级AI聊天机器人,重点介绍了其独特功能,自定义选项以及自然语言处理和可靠性的性能。

Chatgpt 4 o可用吗?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4 o可用吗?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4当前可用并广泛使用,与诸如ChatGpt 3.5(例如ChatGpt 3.5)相比,在理解上下文和产生连贯的响应方面取得了重大改进。未来的发展可能包括更多个性化的间

顶级AI写作助理来增强您的内容创建

Apr 02, 2025 pm 06:11 PM

顶级AI写作助理来增强您的内容创建

Apr 02, 2025 pm 06:11 PM

文章讨论了Grammarly,Jasper,Copy.ai,Writesonic和Rytr等AI最高的写作助手,重点介绍了其独特的内容创建功能。它认为Jasper在SEO优化方面表现出色,而AI工具有助于保持音调的组成

选择最佳的AI语音生成器:评论的顶级选项

Apr 02, 2025 pm 06:12 PM

选择最佳的AI语音生成器:评论的顶级选项

Apr 02, 2025 pm 06:12 PM

本文评论了Google Cloud,Amazon Polly,Microsoft Azure,IBM Watson和Discript等高级AI语音生成器,重点介绍其功能,语音质量和满足不同需求的适用性。

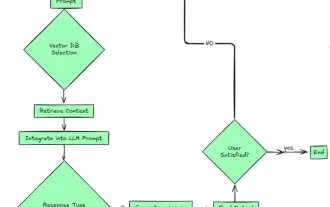

构建AI代理的前7个代理抹布系统

Mar 31, 2025 pm 04:25 PM

构建AI代理的前7个代理抹布系统

Mar 31, 2025 pm 04:25 PM

2024年见证了从简单地使用LLM进行内容生成的转变,转变为了解其内部工作。 这种探索导致了AI代理的发现 - 自主系统处理任务和最少人工干预的决策。 Buildin

如何访问猎鹰3? - 分析Vidhya

Mar 31, 2025 pm 04:41 PM

如何访问猎鹰3? - 分析Vidhya

Mar 31, 2025 pm 04:41 PM

猎鹰3:革命性的开源大语模型 Falcon 3是著名的猎鹰系列LLMS系列中的最新迭代,代表了AI技术的重大进步。由技术创新研究所(TII)开发