无需标注数据,「3D理解」进入多模态预训练时代!ULIP系列全面开源,刷新SOTA

通过对齐三维形状、二维图片以及相应的语言描述,多模态预训练方法也带动了3D表征学习的发展。

不过现有的多模态预训练框架收集数据的方法缺乏可扩展性,极大限制了多模态学习的潜力,其中最主要的瓶颈在于语言模态的可扩展性和全面性。

最近,Salesforce AI联手斯坦福大学和得克萨斯大学奥斯汀分校,发布了ULIP(CVP R2023)和ULIP-2项目,这些项目正在引领3D理解的新篇章。

论文链接:https://arxiv.org/pdf/2212.05171.pdf

论文链接:https://arxiv.org/pdf/2305.08275.pdf

代码链接:https://github.com/salesforce/ULIP

研究人员采用了独特的方法,使用3D点云、图像和文本进行模型的预训练,将它们对齐到一个统一的特征空间。这种方法在3D分类任务中取得了最先进的结果,并为跨领域任务(如图像到3D检索)开辟了新的可能性。

并且ULIP-2将这种多模态预训练变得可以不需要任何人工标注,从而可以大规模扩展。

ULIP-2在ModelNet40的下游零样本分类上取得了显著的性能提升,达到74.0%的最高准确率;在现实世界的ScanObjectNN基准上,仅用140万个参数就获得了91.5%的总体准确率,标志着在无需人类3D标注的可扩展多模态3D表示学习方面的突破。

对齐(3D,图像,文本)这三种特征的预训练框架示意图

代码以及发布的大规模tri-modal的数据集(「ULIP - Objaverse Triplets」和「ULIP - ShapeNet Triplets」)已经开源。

背景

3D理解是人工智能领域的重要组成部分,它让机器能像人类一样在三维空间中感知和互动。这种能力在自动驾驶汽车、机器人、虚拟现实和增强现实等领域都有着重要的应用。

然而,由于3D数据的处理和解释复杂性,以及收集和注释3D数据的成本,3D理解一直面临着巨大的挑战。

ULIP

Tri-modal 预训练框架以及其下游任务

ULIP(已经被CVPR2023接收)采用了一种独特的方法,使用3D点云、图像和文本进行模型的预训练,将它们对齐到一个统一的表示空间。

这种方法在3D分类任务中取得了最先进的结果,并为跨领域任务(如图像到3D检索)开辟了新的可能性。

ULIP的成功关键在于使用预先对齐的图像和文本编码器,如CLIP,它在大量的图像-文本对上进行预训练。

这些编码器将三种模态的特征对齐到一个统一的表示空间,使模型能够更有效地理解和分类3D对象。

这种改进的3D表示学习不仅增强了模型对3D数据的理解,而且还使得跨模态应用如zero-shot 3D分类和图像到3D检索成为可能,因为3D编码器获得了多模态上下文。

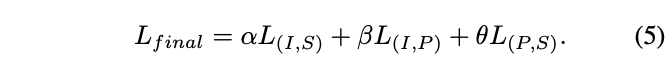

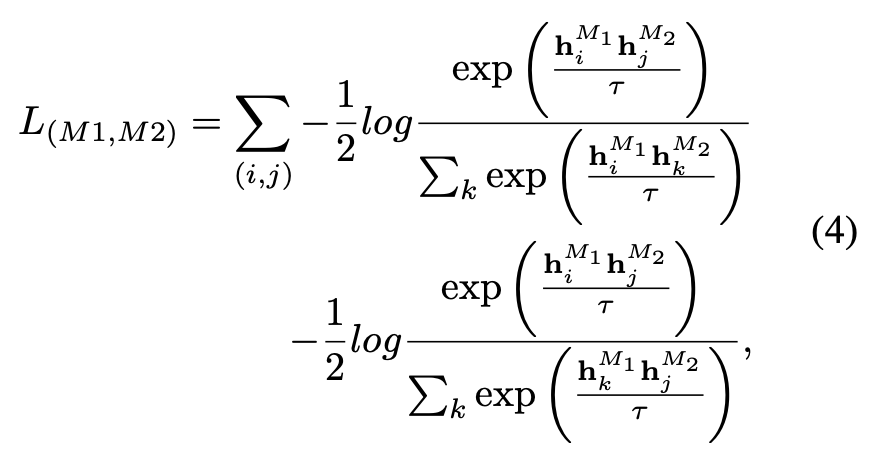

ULIP的预训练损失函数如下:

在ULIP的默认设置中,α被设置为0, β和θ被设置为1,每两个模态之间的对比学习损失函数的定义如下,这里M1和M2指三个模态中的任意两个模态:

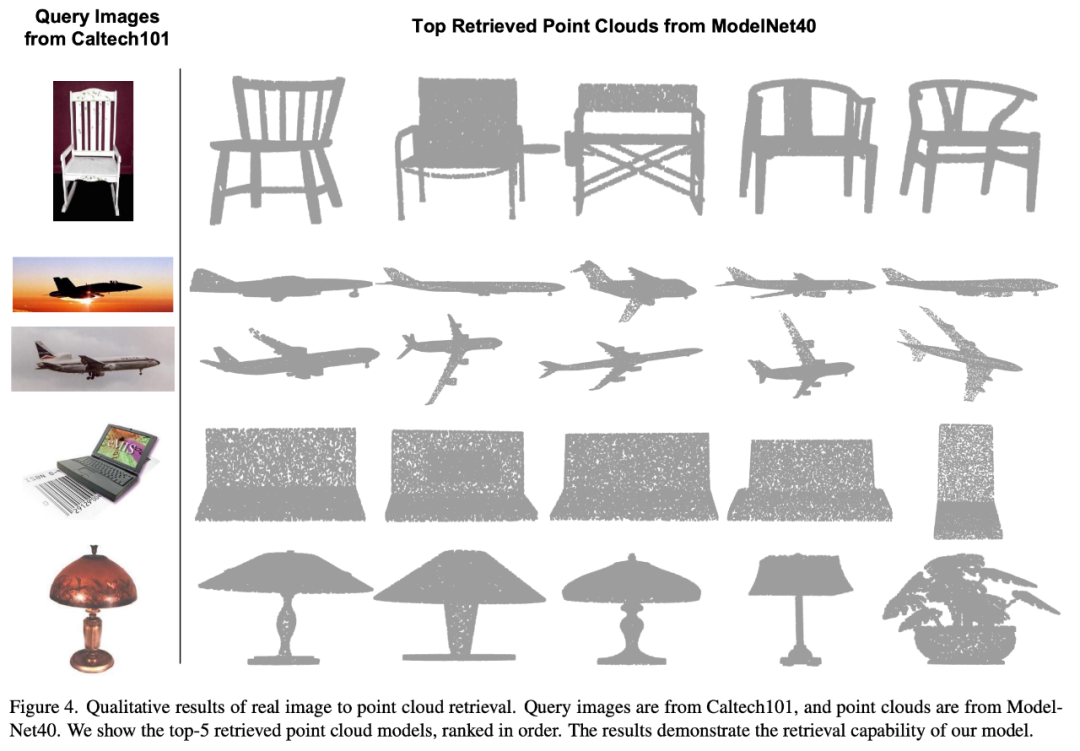

ULIP还做了由图像到3D的retrieval的实验,效果如下:

实验结果可以看出ULIP预训练的模型已经能够学习到图像和三维点云间有意义的多模态特征。

令人惊讶的是,相较于其他的检索到的三维模型,第一名检索到的三维模型与查询图像的外观最为接近。

例如,当我们使用来自不同飞机类型(战斗机和客机)的图片进行检索(第二行和第三行),检索到的最接近的3D点云仍然保留了查询图像的微妙差异。

ULIP-2

这里是一个3D物体生成多角度文字描述的示例。我们先将3D物体以一组视角渲染成2D图像,接着使用大型多模态模型为所生成的所有图像生成描述

ULIP-2在ULIP的基础上,利用大型多模态模型为3D物体生成全方面对应的语言描述,从而收集可扩展的多模态预训练数据,无需任何人工标注,使预训练过程和训练后的模型更加高效并且增强其适应性。

ULIP-2的方法包括为每个3D物体生成多角度不同的语言描述,然后用这些描述来训练模型,使3D物体、2D图像、和语言描述在特征空间对齐一致。

这个框架使得无需手动注释就可以创建大量的三模态数据集,从而充分发挥多模态预训练的潜力。

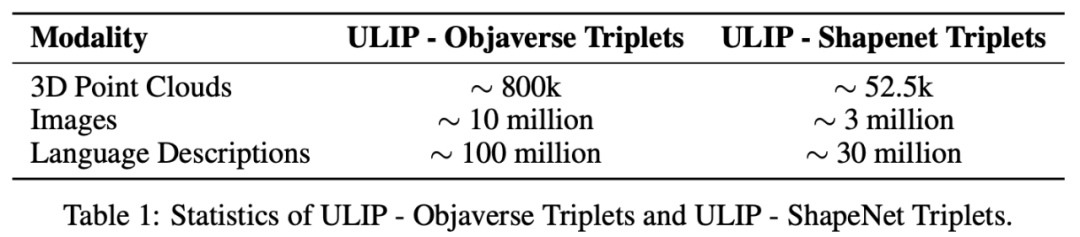

ULIP-2还发布了生成的大规模三模态数据集:「ULIP - Objaverse Triplets」和「ULIP - ShapeNet Triplets」。

两个tri-modal的datasets的一些统计数据

实验结果

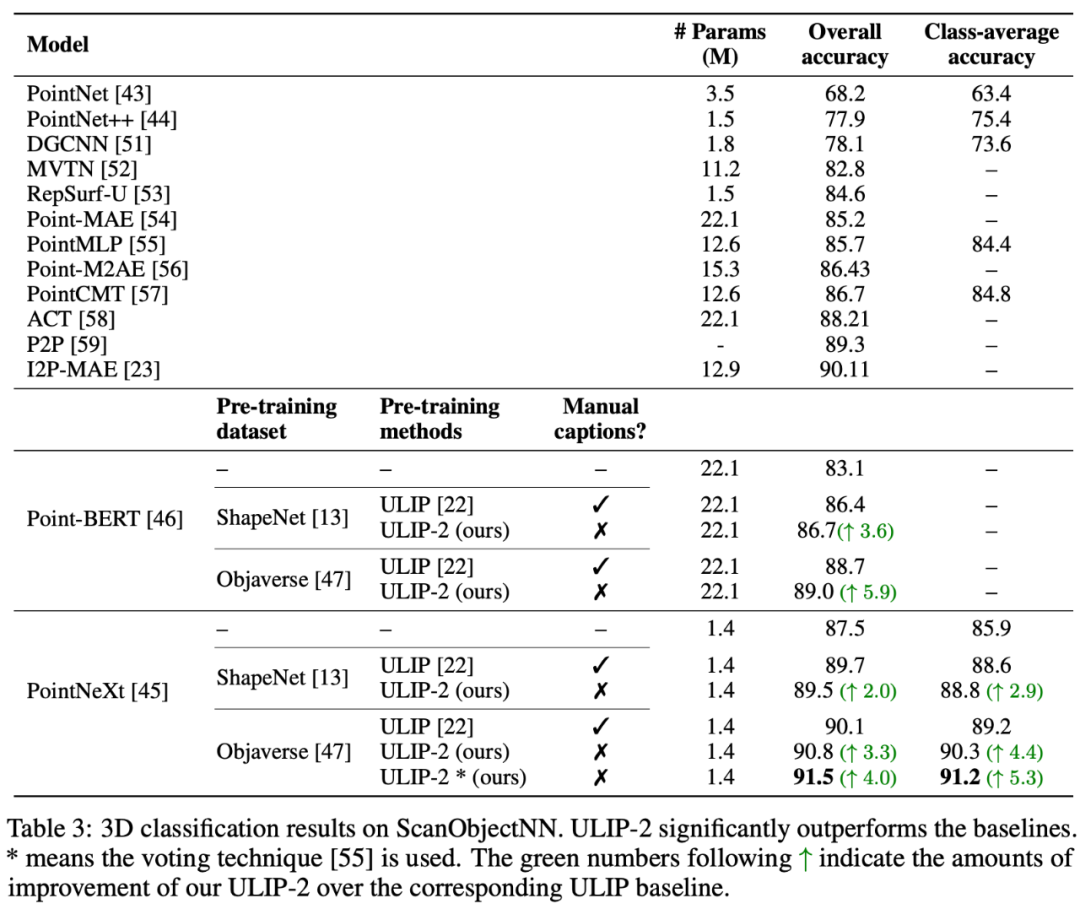

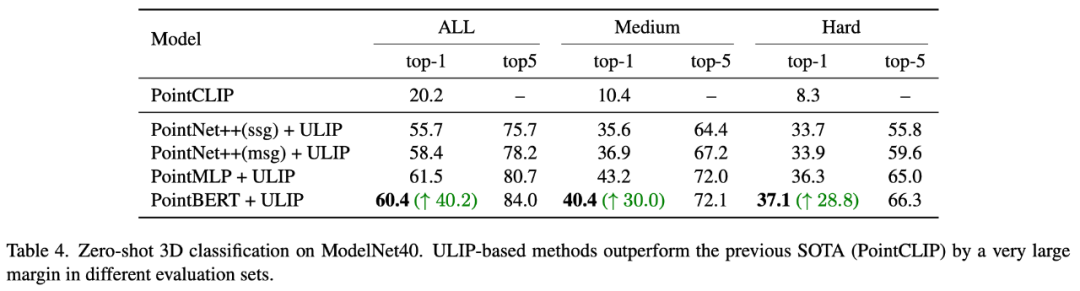

ULIP系列在多模态下游任务和3D表达的微调实验中均取得了惊人的效果,尤其ULIP-2中的预训练是完全不需要借助任何人工的标注就可以实现的。

ULIP-2在ModelNet40的下游零样本分类任务中取得了显著的提升(74.0%的top-1准确率);在真实世界的ScanObjectNN基准测试中,它仅用1.4M参数就取得了91.5%的总体准确率,这标志着在无需人工3D标注的情况下,实现了可扩展的多模态3D表示学习的突破。

消融实验

两篇论文均做了详尽的消融实验。

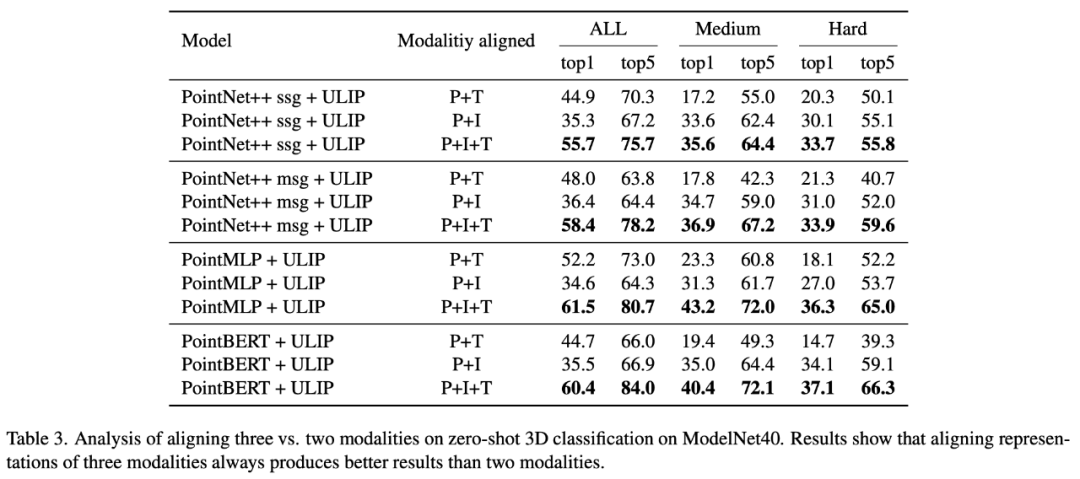

在「ULIP: Learning a Unified Representation of Language, Images, and Point Clouds for 3D Understanding」中,由于ULIP的预训练框架有三个模态的参与,所以作者用实验探究了究竟是只对齐其中的两个模态好还是对齐所有三个模态好,实验结果如下:

从实验结果中可以看到,在不同的3D backbone中,对齐三个模态一致的比只对齐两个模态好,这也应证了ULIP的预训练框架的合理性。

在「ULIP-2: Towards Scalable Multimodal Pre-training for 3D Understanding」中,作者探究了不同的大型多模态模型会对预训练的框架有什么影响,结果如下:

实验结果可以看出,ULIP-2框架预训练的效果可以随着使用的大型多模态模型的升级而提升,具有一定的成长性。

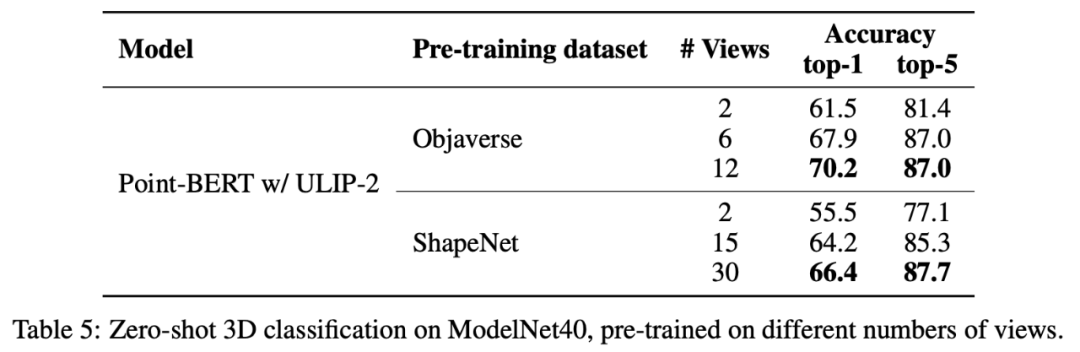

在ULIP-2中,作者还探索了在生成tri-modal的数据集是采用不同数量的视角会如何影响整体预训练的表现,实验结果如下:

实验结果显示,随着使用的视角数量的增加,预训练的模型的zero-shot classification的效果也会随之增加。

这也应证了ULIP-2中的观点,更全方位多样性的语言描述会对多模态预训练有正向的作用。

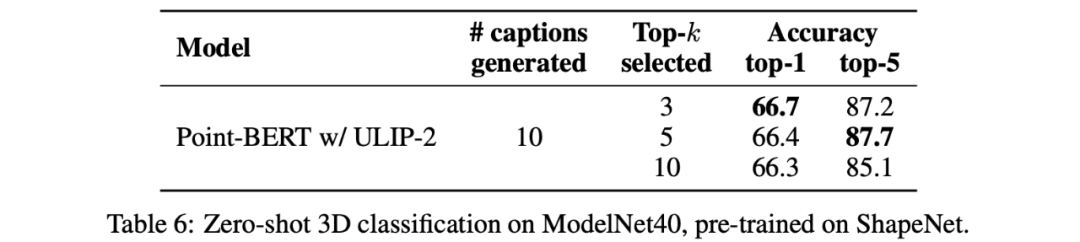

除此之外,ULIP-2还探究了取CLIP排序过的不同topk的语言描述会对多模态预训练有什么影响,实验结果如下:

实验结果表明:ULIP-2的框架对不同的topk有一定的鲁棒性,论文中采用了top 5作为默认设置。

结论

由Salesforce AI,斯坦福大学,得克萨斯大学奥斯汀分校联手发布的ULIP项目(CVPR2023)和ULIP-2正在改变3D理解领域。

ULIP将不同的模态对齐到一个统一的空间,增强了3D特征的学习并启用了跨模态应用。

ULIP-2进一步发展,为3D对象生成整体语言描述,创建并开源了大量的三模态数据集,并且这个过程无需人工标注。

这些项目在3D理解方面设定了新的基准,为机器真正理解我们三维世界的未来铺平了道路。

团队

Salesforce AI:

Le Xue (薛乐), Mingfei Gao (高明菲),Chen Xing(星辰),Ning Yu(于宁), Shu Zhang(张澍),Junnan Li(李俊男), Caiming Xiong(熊蔡明),Ran Xu(徐然),Juan carlos niebles, Silvio savarese。

斯坦福大学:

Prof. Silvio Savarese, Prof. Juan Carlos Niebles, Prof. Jiajun Wu(吴佳俊)。

UT Austin:

Prof. Roberto Martín-Martín。

以上是无需标注数据,「3D理解」进入多模态预训练时代!ULIP系列全面开源,刷新SOTA的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

为何在自动驾驶方面Gaussian Splatting如此受欢迎,开始放弃NeRF?

Jan 17, 2024 pm 02:57 PM

为何在自动驾驶方面Gaussian Splatting如此受欢迎,开始放弃NeRF?

Jan 17, 2024 pm 02:57 PM

写在前面&笔者的个人理解三维Gaussiansplatting(3DGS)是近年来在显式辐射场和计算机图形学领域出现的一种变革性技术。这种创新方法的特点是使用了数百万个3D高斯,这与神经辐射场(NeRF)方法有很大的不同,后者主要使用隐式的基于坐标的模型将空间坐标映射到像素值。3DGS凭借其明确的场景表示和可微分的渲染算法,不仅保证了实时渲染能力,而且引入了前所未有的控制和场景编辑水平。这将3DGS定位为下一代3D重建和表示的潜在游戏规则改变者。为此我们首次系统地概述了3DGS领域的最新发展和关

了解 Microsoft Teams 中的 3D Fluent 表情符号

Apr 24, 2023 pm 10:28 PM

了解 Microsoft Teams 中的 3D Fluent 表情符号

Apr 24, 2023 pm 10:28 PM

您一定记得,尤其是如果您是Teams用户,Microsoft在其以工作为重点的视频会议应用程序中添加了一批新的3DFluent表情符号。在微软去年宣布为Teams和Windows提供3D表情符号之后,该过程实际上已经为该平台更新了1800多个现有表情符号。这个宏伟的想法和为Teams推出的3DFluent表情符号更新首先是通过官方博客文章进行宣传的。最新的Teams更新为应用程序带来了FluentEmojis微软表示,更新后的1800表情符号将为我们每天

选择相机还是激光雷达?实现鲁棒的三维目标检测的最新综述

Jan 26, 2024 am 11:18 AM

选择相机还是激光雷达?实现鲁棒的三维目标检测的最新综述

Jan 26, 2024 am 11:18 AM

0.写在前面&&个人理解自动驾驶系统依赖于先进的感知、决策和控制技术,通过使用各种传感器(如相机、激光雷达、雷达等)来感知周围环境,并利用算法和模型进行实时分析和决策。这使得车辆能够识别道路标志、检测和跟踪其他车辆、预测行人行为等,从而安全地操作和适应复杂的交通环境.这项技术目前引起了广泛的关注,并认为是未来交通领域的重要发展领域之一。但是,让自动驾驶变得困难的是弄清楚如何让汽车了解周围发生的事情。这需要自动驾驶系统中的三维物体检测算法可以准确地感知和描述周围环境中的物体,包括它们的位置、

CLIP-BEVFormer:显式监督BEVFormer结构,提升长尾检测性能

Mar 26, 2024 pm 12:41 PM

CLIP-BEVFormer:显式监督BEVFormer结构,提升长尾检测性能

Mar 26, 2024 pm 12:41 PM

写在前面&笔者的个人理解目前,在整个自动驾驶系统当中,感知模块扮演了其中至关重要的角色,行驶在道路上的自动驾驶车辆只有通过感知模块获得到准确的感知结果后,才能让自动驾驶系统中的下游规控模块做出及时、正确的判断和行为决策。目前,具备自动驾驶功能的汽车中通常会配备包括环视相机传感器、激光雷达传感器以及毫米波雷达传感器在内的多种数据信息传感器来收集不同模态的信息,用于实现准确的感知任务。基于纯视觉的BEV感知算法因其较低的硬件成本和易于部署的特点,以及其输出结果能便捷地应用于各种下游任务,因此受到工业

Windows 11中的Paint 3D:下载、安装和使用指南

Apr 26, 2023 am 11:28 AM

Windows 11中的Paint 3D:下载、安装和使用指南

Apr 26, 2023 am 11:28 AM

当八卦开始传播新的Windows11正在开发中时,每个微软用户都对新操作系统的外观以及它将带来什么感到好奇。经过猜测,Windows11就在这里。操作系统带有新的设计和功能更改。除了一些添加之外,它还带有功能弃用和删除。Windows11中不存在的功能之一是Paint3D。虽然它仍然提供经典的Paint,它对抽屉,涂鸦者和涂鸦者有好处,但它放弃了Paint3D,它提供了额外的功能,非常适合3D创作者。如果您正在寻找一些额外的功能,我们建议AutodeskMaya作为最好的3D设计软件。如

牛津大学最新!Mickey:3D中的2D图像匹配SOTA!(CVPR\'24)

Apr 23, 2024 pm 01:20 PM

牛津大学最新!Mickey:3D中的2D图像匹配SOTA!(CVPR\'24)

Apr 23, 2024 pm 01:20 PM

写在前面项目链接:https://nianticlabs.github.io/mickey/给定两张图片,可以通过建立图片之间的对应关系来估计它们之间的相机姿态。通常,这些对应关系是二维到二维的,而我们估计的姿态在尺度上是不确定的。一些应用,例如随时随地实现即时增强现实,需要尺度度量的姿态估计,因此它们依赖于外部的深度估计器来恢复尺度。本文提出了MicKey,这是一个关键点匹配流程,能够够预测三维相机空间中的度量对应关系。通过学习跨图像的三维坐标匹配,我们能够在没有深度测试的情况下推断出度量相对

单卡30秒跑出虚拟3D老婆!Text to 3D生成看清毛孔细节的高精度数字人,无缝衔接Maya、Unity等制作工具

May 23, 2023 pm 02:34 PM

单卡30秒跑出虚拟3D老婆!Text to 3D生成看清毛孔细节的高精度数字人,无缝衔接Maya、Unity等制作工具

May 23, 2023 pm 02:34 PM

ChatGPT给AI行业注入一剂鸡血,一切曾经的不敢想,都成为如今的基操。正持续进击的Text-to-3D,就被视为继Diffusion(图像)和GPT(文字)后,AIGC领域的下一个前沿热点,得到了前所未有的关注度。这不,一款名为ChatAvatar的产品低调公测,火速收揽超70万浏览与关注,并登上抱抱脸周热门(Spacesoftheweek)。△ChatAvatar也将支持从AI生成的单视角/多视角原画生成3D风格化角色的Imageto3D技术,受到了广泛关注现行beta版本生成的3D模型,

「从未被制造出的最重要机器」,艾伦·图灵及图灵机那些事

Jun 25, 2023 pm 07:42 PM

「从未被制造出的最重要机器」,艾伦·图灵及图灵机那些事

Jun 25, 2023 pm 07:42 PM

计算是我们大多数人凭直觉就能理解的一个熟悉概念。我们以函数f(x)=x+3为例,当x为3时,f(3)=3+3。答案是6,非常简单。很明显,这个函数是可计算的。但是有些函数并非那么简单,而且要确定它们是否可以计算也非易事,这意味着它们可能永远都无法得出一个最终答案。1928年,德国数学家大卫・希尔伯特(DavidHilbert)和威廉・阿克曼(WilhelmAckermann)提出了一个名为Entscheidungsproblem(即「判定性问题」)的问题。随着时间推移,他们提出的这个问题将引出可