如何使用PHP和swoole进行大规模的网络爬虫开发?

如何使用PHP和swoole进行大规模的网络爬虫开发?

引言:

随着互联网的迅速发展,大数据已经成为当今社会的重要资源之一。为了获取这些宝贵的数据,网络爬虫应运而生。网络爬虫可以自动化地访问互联网上的各种网站,并从中提取所需的信息。在本文中,我们将探讨如何使用PHP和swoole扩展来开发高效的、大规模的网络爬虫。

一、了解网络爬虫的基本原理

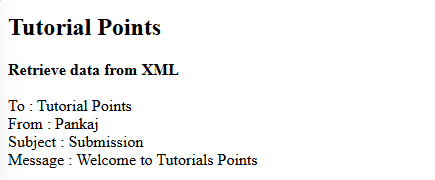

网络爬虫的基本原理很简单:通过发送HTTP请求,模拟浏览器访问网页,解析网页的内容,然后提取所需的信息。在实现网络爬虫时,我们可以使用PHP的cURL库来发送HTTP请求,使用正则表达式或者DOM解析器来解析HTML。

二、使用swoole扩展优化网络爬虫的性能

swoole是一个面向生产环境的PHP协程框架,它利用协程技术极大地提高了PHP的并发性能。在网络爬虫开发中,使用swoole可以支持几千个甚至更多的并发连接,使得爬虫可以同时处理多个网页的请求和解析,大大提高了爬虫的效率。

下面是一个使用swoole编写的简单的网络爬虫示例:

<?php

// 引入swoole库

require_once 'path/to/swoole/library/autoload.php';

use SwooleCoroutine as Co;

// 爬虫逻辑

function crawler($url) {

$html = file_get_contents($url);

// 解析HTML,提取所需的信息

// ...

return $data;

}

// 主函数

Coun(function () {

$urls = [

'https://example.com/page1',

'https://example.com/page2',

'https://example.com/page3',

// ...

];

// 创建协程任务

$tasks = [];

foreach ($urls as $url) {

$tasks[] = Co::create(function() use ($url) {

$data = crawler($url);

echo $url . ' completed.' . PHP_EOL;

// 处理爬取到的数据

// ...

});

}

// 等待协程任务完成

Co::listWait($tasks);

});

?>在上述示例中,我们使用了swoole的协程属性Coun()来创建了一个协程环境,然后使用swoolecoroutine命名空间下的Co::create()方法创建了多个协程任务。每个协程任务在完成时会输出完成的URL,并进行数据处理。最后,使用Co::listWait()等待所有协程任务完成。

通过这种方式,我们可以方便地实现高并发的网络爬虫。你可以根据实际需求,调整协程任务的数量和爬取的URL列表。

三、网络爬虫的其他优化方法

除了使用swoole扩展提高并发性能之外,还可以通过以下几个方法进一步优化网络爬虫:

- 合理设置请求头和请求频率:模拟浏览器的请求头,避免被网站屏蔽,同时设置合理的请求频率,以免对目标网站造成过大的压力。

- 使用代理IP:使用代理IP可以避免被目标网站限制或封禁IP的情况发生。

- 设置合理的并发数:爬虫的并发数不宜过高,否则可能会给目标网站造成负担。根据目标网站的性能和本机的性能,进行合理的调整。

结论:

本文介绍了如何使用PHP和swoole扩展开发大规模的网络爬虫。通过使用swoole,我们可以充分发挥PHP的并发性能,提高网络爬虫的效率。同时,我们还介绍了一些其他优化方法,以确保爬虫的稳定性和可靠性。希望本文对你理解和开发网络爬虫起到一定的帮助。

以上是如何使用PHP和swoole进行大规模的网络爬虫开发?的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

适用于 Ubuntu 和 Debian 的 PHP 8.4 安装和升级指南

Dec 24, 2024 pm 04:42 PM

适用于 Ubuntu 和 Debian 的 PHP 8.4 安装和升级指南

Dec 24, 2024 pm 04:42 PM

PHP 8.4 带来了多项新功能、安全性改进和性能改进,同时弃用和删除了大量功能。 本指南介绍了如何在 Ubuntu、Debian 或其衍生版本上安装 PHP 8.4 或升级到 PHP 8.4

如何设置 Visual Studio Code (VS Code) 进行 PHP 开发

Dec 20, 2024 am 11:31 AM

如何设置 Visual Studio Code (VS Code) 进行 PHP 开发

Dec 20, 2024 am 11:31 AM

Visual Studio Code,也称为 VS Code,是一个免费的源代码编辑器 - 或集成开发环境 (IDE) - 可用于所有主要操作系统。 VS Code 拥有针对多种编程语言的大量扩展,可以轻松编写

我后悔之前不知道的 7 个 PHP 函数

Nov 13, 2024 am 09:42 AM

我后悔之前不知道的 7 个 PHP 函数

Nov 13, 2024 am 09:42 AM

如果您是一位经验丰富的 PHP 开发人员,您可能会感觉您已经在那里并且已经完成了。您已经开发了大量的应用程序,调试了数百万行代码,并调整了一堆脚本来实现操作

您如何在PHP中解析和处理HTML/XML?

Feb 07, 2025 am 11:57 AM

您如何在PHP中解析和处理HTML/XML?

Feb 07, 2025 am 11:57 AM

本教程演示了如何使用PHP有效地处理XML文档。 XML(可扩展的标记语言)是一种用于人类可读性和机器解析的多功能文本标记语言。它通常用于数据存储

在PHP API中说明JSON Web令牌(JWT)及其用例。

Apr 05, 2025 am 12:04 AM

在PHP API中说明JSON Web令牌(JWT)及其用例。

Apr 05, 2025 am 12:04 AM

JWT是一种基于JSON的开放标准,用于在各方之间安全地传输信息,主要用于身份验证和信息交换。1.JWT由Header、Payload和Signature三部分组成。2.JWT的工作原理包括生成JWT、验证JWT和解析Payload三个步骤。3.在PHP中使用JWT进行身份验证时,可以生成和验证JWT,并在高级用法中包含用户角色和权限信息。4.常见错误包括签名验证失败、令牌过期和Payload过大,调试技巧包括使用调试工具和日志记录。5.性能优化和最佳实践包括使用合适的签名算法、合理设置有效期、

php程序在字符串中计数元音

Feb 07, 2025 pm 12:12 PM

php程序在字符串中计数元音

Feb 07, 2025 pm 12:12 PM

字符串是由字符组成的序列,包括字母、数字和符号。本教程将学习如何使用不同的方法在PHP中计算给定字符串中元音的数量。英语中的元音是a、e、i、o、u,它们可以是大写或小写。 什么是元音? 元音是代表特定语音的字母字符。英语中共有五个元音,包括大写和小写: a, e, i, o, u 示例 1 输入:字符串 = "Tutorialspoint" 输出:6 解释 字符串 "Tutorialspoint" 中的元音是 u、o、i、a、o、i。总共有 6 个元

解释PHP中的晚期静态绑定(静态::)。

Apr 03, 2025 am 12:04 AM

解释PHP中的晚期静态绑定(静态::)。

Apr 03, 2025 am 12:04 AM

静态绑定(static::)在PHP中实现晚期静态绑定(LSB),允许在静态上下文中引用调用类而非定义类。1)解析过程在运行时进行,2)在继承关系中向上查找调用类,3)可能带来性能开销。

什么是PHP魔术方法(__ -construct,__destruct,__call,__get,__ set等)并提供用例?

Apr 03, 2025 am 12:03 AM

什么是PHP魔术方法(__ -construct,__destruct,__call,__get,__ set等)并提供用例?

Apr 03, 2025 am 12:03 AM

PHP的魔法方法有哪些?PHP的魔法方法包括:1.\_\_construct,用于初始化对象;2.\_\_destruct,用于清理资源;3.\_\_call,处理不存在的方法调用;4.\_\_get,实现动态属性访问;5.\_\_set,实现动态属性设置。这些方法在特定情况下自动调用,提升代码的灵活性和效率。