大模型的推理速度,仅仅一个月就提高了一倍!

近日,英伟达宣布推出了一款专为H100设计的“鸡血包”,旨在加速LLM推理过程

或许这下可以不用空等明年才能交付的GH200了 。

。

GPU的计算能力一直在影响着大型模型的性能,无论是硬件供应商还是使用者,都希望能够获得更快的计算速度

而作为大模型背后硬件的最大供应商,英伟达一直在研究怎么给大模型硬件加速。

通过与多家AI公司合作,英伟达终于推出了大模型推理优化程序TensorRT-LLM(暂且简称TensorRT)。

TensorRT不仅能让大模型的推理速度翻番,使用起来也十分方便。

无需深入了解C++和CUDA,也能快速定制优化策略,在H100上更快地跑大模型。

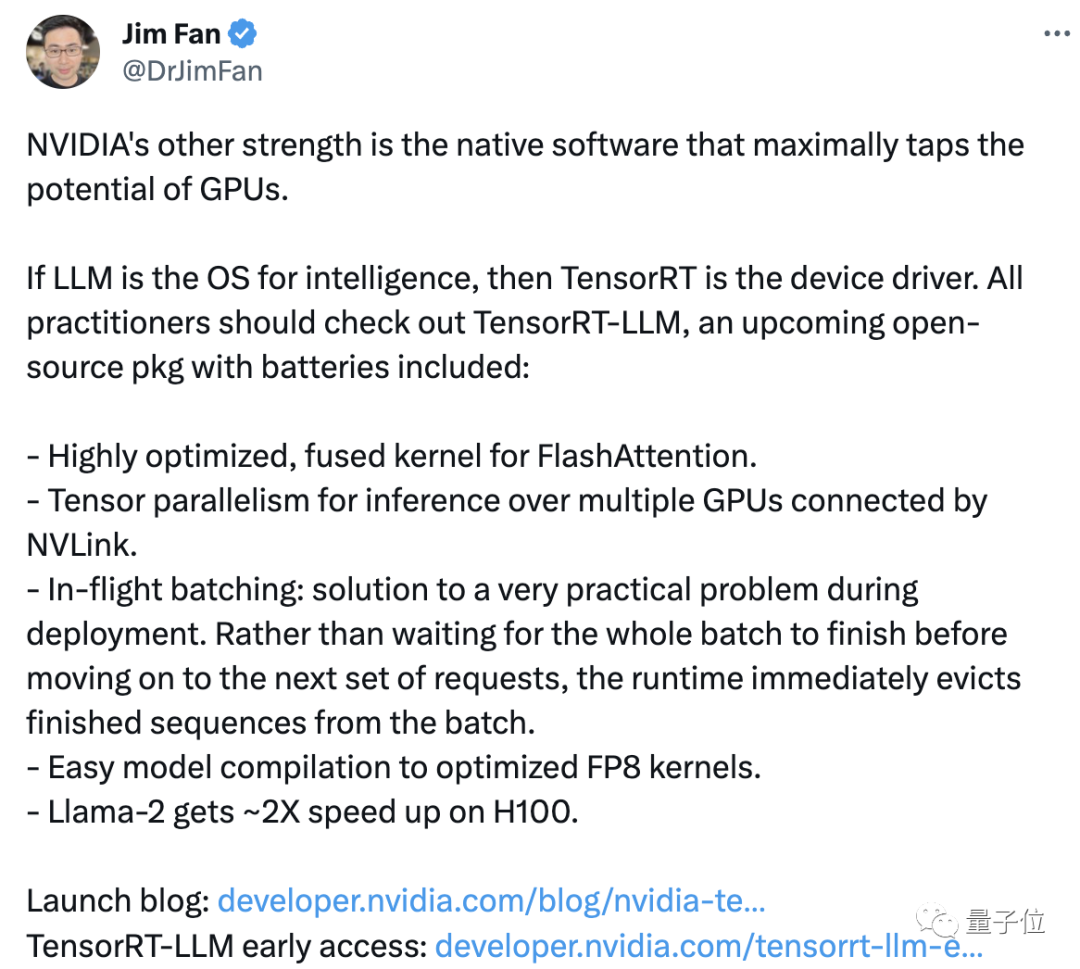

英伟达科学家范麟熙(Jim Fan)转发并评论称,英伟达的“另一项优势”就是可以最大化利用GPU性能的配套软件。

英伟达通过软件给产品注入了新的活力,就像实践了老黄的那句“买得越多,省得越多”。然而,这并不妨碍一些人觉得产品价格太高

除了价格,也有网友对其运行效果提出了质疑:

我们总是看到(宣传中的)多少倍的性能提升,但自己运行Llama 2的时候每秒还是只能处理几十个token。

对于TensorRT来说,我们需要进一步进行检验,以确定它是否真的有效。让我们先来详细了解一下TensorRT

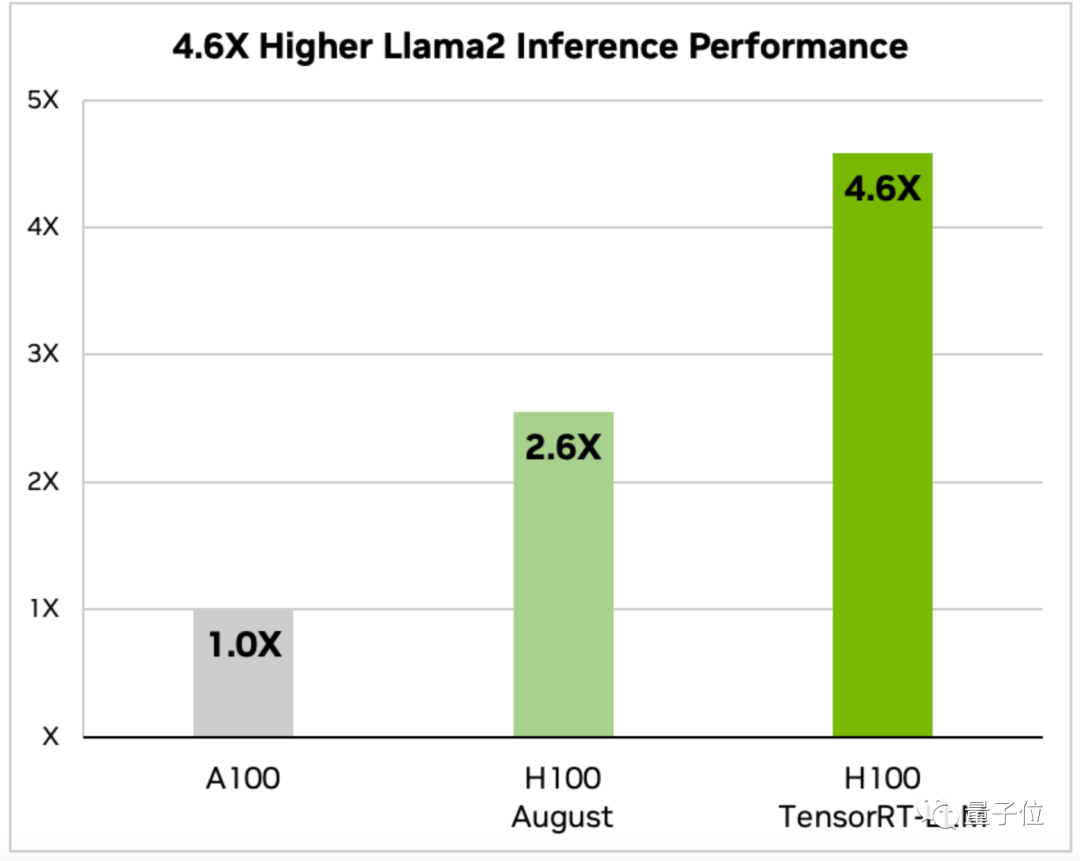

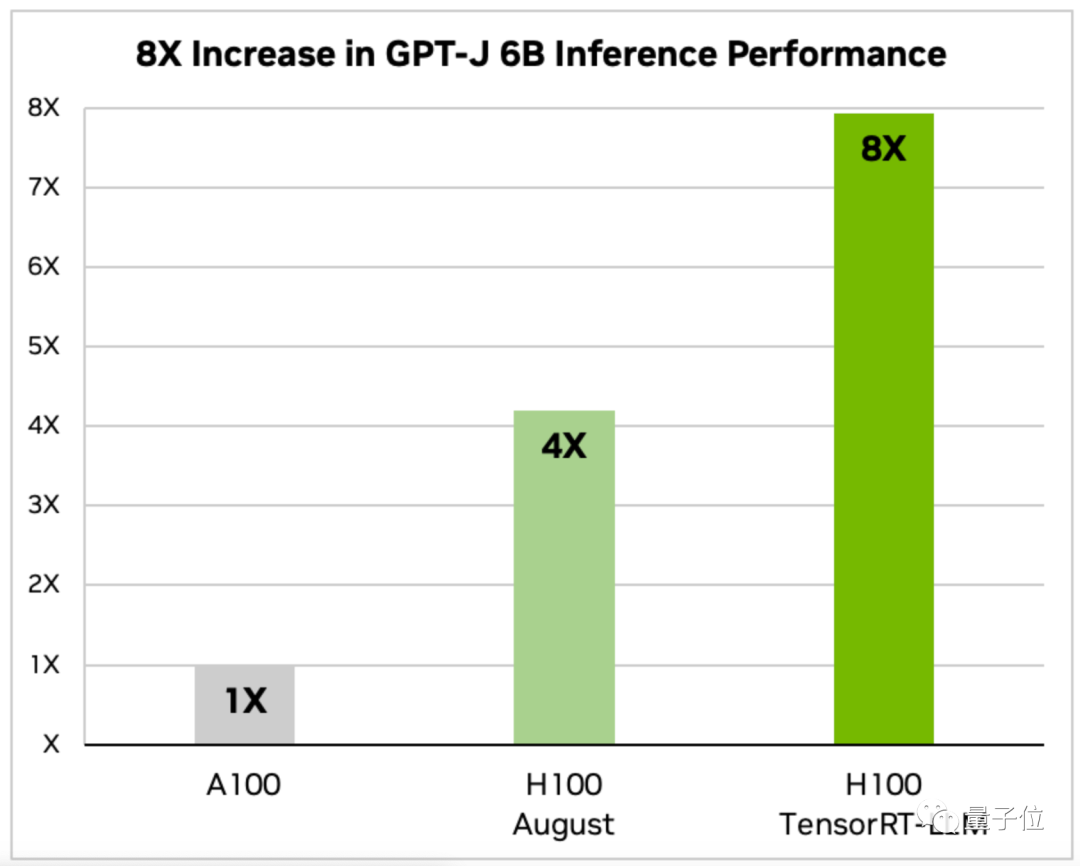

TensorRT-LLM优化后的H100,对于运行大型模型来说速度有多快呢?

英伟达的通告中给出了Llama 2和GPT-J-6B两种模型的数据。

在经过优化后的H100上,跑Llama 2的推理速度是A100的4.6倍,也是八月份未经优化的H100的1.77倍

而GPT-J-6B的推理速度是A100上的8倍、八月未优化版的2倍。

TensorRT还提供了一个开源的模块化Python API,可以根据不同的LLM需求快速定制优化方案

这个API将深度学习编译器、内核优化、预/后处理和多节点通信功能集成到了一起。

其中针对GPT(2/3)、Llama等常见模型,还有已经定制好的版本,可以“开箱即用”。

通过TensorRT中最新的开源AI内核,开发者还可以对模型自身进行优化,其中就包括了让Transformer大大提速的注意力算法FlashAttention。

TensorRT是一个用于优化深度学习推理的高性能推理引擎。它通过使用混合精度计算、动态图优化和层融合等技术,对LLM推理速度进行了优化。具体而言,TensorRT通过将浮点计算转换为半精度浮点计算,减少了计算量和内存带宽的需求,从而提高了推理速度。此外,TensorRT还使用了动态图优化技术,根据输入数据的特征动态地选择最优的网络结构,进一步提高了推理速度。另外,TensorRT还通过层融合技术将多个计算层合并为一个更高效的计算层,减少了计算和内存访问的开销,进一步提高了推理速度。总之,TensorRT通过多种优化技术,显著提升了LLM推理的速度和效率

首先要得益于TensorRT对多节点协同工作方式进行了优化。

像Llama这样庞大的模型,在单卡上是跑不起来的,需要多块GPU一起跑才能带动。

过去,这一工作需要人们手工把模型拆开来实现。

有了TensorRT,系统能够自动地对模型进行拆分,并且通过NVLink在多个GPU之间高效运行

其次,TensorRT还利用了一种名为动态批处理的优化调度技术。

在推理过程中,LLM实际上是通过多次执行模型迭代来进行的

动态批处理技术会将已完成的序列立即踢出,而不是等待整批任务完成后再处理下一组请求。

在实际测试中,动态批处理技术成功地将LLM的GPU请求吞吐量减少了一半,从而显着降低了运行成本

另一个关键点则是将16位精度浮点数转换为8位精度,从而降低内存消耗。

FP8相对于训练阶段的FP16来说,资源消耗更低,同时精确度又高于INT-8,既能提高性能,又不影响模型的准确性

使用Hopper Transformer引擎,系统会自动完成FP16到FP8的转换编译,无需手动修改模型中的任何代码

目前,TensorRT-LLM的早鸟版已经可以下载,正式版将在几周内推出并集成到NeMo框架中

每当大事件出现,总少不了“列文虎克”的身影。

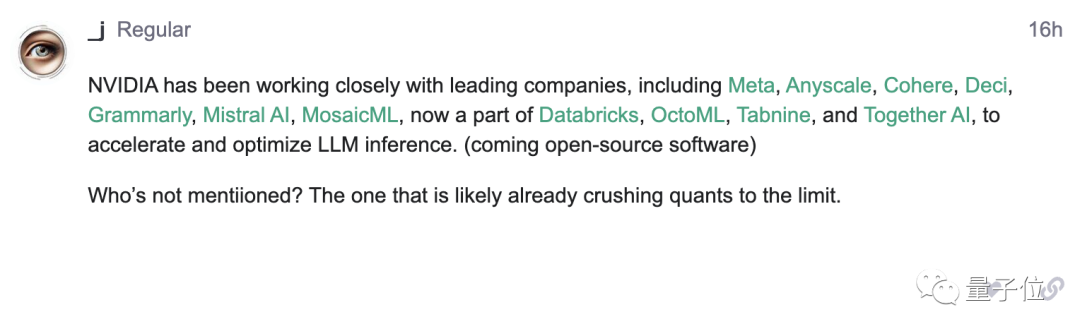

在英伟达的公告中提到了与Meta等人工智能领军企业合作,但没有提及OpenAI

从这则通告中,就有网友发现了这个华点,并发到了OpenAI论坛上:

请让我看看是谁没有被老黄cue到(手动狗头)

你还期待老黄会给我们带来怎样的“惊喜”呢?

以上是老黄给H100'打鸡血”:英伟达推出大模型加速包,Llama2推理速度翻倍的详细内容。更多信息请关注PHP中文网其他相关文章!