计算机视觉中的人体姿态估计问题

计算机视觉中的人体姿态估计问题,需要具体代码示例

人体姿态估计是计算机视觉领域的重要研究方向,其目标是从图像或视频中准确地获取人体的姿态信息,包括关节位置、关节角度等。人体姿态估计在许多应用领域具有广泛的应用,例如动作捕捉、人机交互、虚拟现实等。本文将介绍人体姿态估计的基本原理,并提供具体的代码示例。

人体姿态估计的基本原理是通过解析图像中的人体关键点(例如头、肩膀、手、脚等)来推测人体的姿态。为了实现这一目标,我们可以使用深度学习模型,如卷积神经网络(Convolutional Neural Network,CNN)或递归神经网络(Recurrent Neural Network,RNN)。

下面是一个使用开源库OpenPose实现人体姿态估计的示例代码:

import cv2

import numpy as np

from openpose import OpenPose

# 加载OpenPose模型

openpose = OpenPose("path/to/openpose/models")

# 加载图像

image = cv2.imread("path/to/image.jpg")

# 运行OpenPose模型

poses = openpose.detect(image)

# 显示姿态估计结果

for pose in poses:

# 绘制骨骼连接

image = openpose.draw_skeleton(image, pose)

# 绘制关节点

image = openpose.draw_keypoints(image, pose)

# 显示图像

cv2.imshow("Pose Estimation", image)

cv2.waitKey(0)

cv2.destroyAllWindows()在上述示例代码中,我们首先导入必要的库,然后加载OpenPose模型并加载待估计的图像。接下来,我们运行OpenPose模型来检测姿态,返回的结果是一个包含多个姿态的列表。最后,我们使用OpenPose提供的绘制函数绘制出姿态估计结果,并显示图像。

需要注意的是,上述示例代码仅用于演示目的,实际上实现人体姿态估计需要更复杂的预处理、后处理以及调参过程。此外,OpenPose是一个开源库,它提供了更多的功能和选项供用户使用。

总而言之,人体姿态估计是计算机视觉领域的一个重要问题,通过解析图像中的关键点来推测人体的姿态。本文提供了使用开源库OpenPose实现人体姿态估计的示例代码,读者可以根据自己的需求进行更深入的研究和开发。

以上是计算机视觉中的人体姿态估计问题的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

超越ORB-SLAM3!SL-SLAM:低光、严重抖动和弱纹理场景全搞定

May 30, 2024 am 09:35 AM

超越ORB-SLAM3!SL-SLAM:低光、严重抖动和弱纹理场景全搞定

May 30, 2024 am 09:35 AM

写在前面今天我们探讨下深度学习技术如何改善在复杂环境中基于视觉的SLAM(同时定位与地图构建)性能。通过将深度特征提取和深度匹配方法相结合,这里介绍了一种多功能的混合视觉SLAM系统,旨在提高在诸如低光条件、动态光照、弱纹理区域和严重抖动等挑战性场景中的适应性。我们的系统支持多种模式,包括拓展单目、立体、单目-惯性以及立体-惯性配置。除此之外,还分析了如何将视觉SLAM与深度学习方法相结合,以启发其他研究。通过在公共数据集和自采样数据上的广泛实验,展示了SL-SLAM在定位精度和跟踪鲁棒性方面优

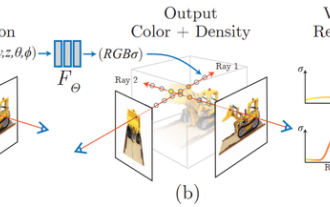

NeRF是什么?基于NeRF的三维重建是基于体素吗?

Oct 16, 2023 am 11:33 AM

NeRF是什么?基于NeRF的三维重建是基于体素吗?

Oct 16, 2023 am 11:33 AM

1介绍神经辐射场(NeRF)是深度学习和计算机视觉领域的一个相当新的范式。ECCV2020论文《NeRF:将场景表示为视图合成的神经辐射场》(该论文获得了最佳论文奖)中介绍了这项技术,该技术自此大受欢迎,迄今已获得近800次引用[1]。该方法标志着机器学习处理3D数据的传统方式发生了巨大变化。神经辐射场场景表示和可微分渲染过程:通过沿着相机射线采样5D坐标(位置和观看方向)来合成图像;将这些位置输入MLP以产生颜色和体积密度;并使用体积渲染技术将这些值合成图像;该渲染函数是可微分的,因此可以通过

自动驾驶第一性之纯视觉静态重建

Jun 02, 2024 pm 03:24 PM

自动驾驶第一性之纯视觉静态重建

Jun 02, 2024 pm 03:24 PM

纯视觉的标注方案,主要是利用视觉加上一些GPS、IMU和轮速传感器的数据进行动态标注。当然面向量产场景的话,不一定非要是纯视觉,有一些量产的车辆里面,会有像固态雷达(AT128)这样的传感器。如果从量产的角度做数据闭环,把这些传感器都用上,可以有效地解决动态物体的标注问题。但是我们的方案里面,是没有固态雷达的。所以,我们就介绍这种最通用的量产标注方案。纯视觉的标注方案的核心在于高精度的pose重建。我们采用StructurefromMotion(SFM)的pose重建方案,来保证重建精度。但是传

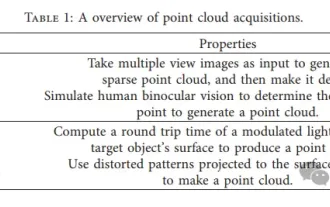

3D视觉绕不开的点云配准!一文搞懂所有主流方案与挑战

Apr 02, 2024 am 11:31 AM

3D视觉绕不开的点云配准!一文搞懂所有主流方案与挑战

Apr 02, 2024 am 11:31 AM

作为点集合的点云有望通过3D重建、工业检测和机器人操作中,在获取和生成物体的三维(3D)表面信息方面带来一场改变。最具挑战性但必不可少的过程是点云配准,即获得一个空间变换,该变换将在两个不同坐标中获得的两个点云对齐并匹配。这篇综述介绍了点云配准的概述和基本原理,对各种方法进行了系统的分类和比较,并解决了点云配准中存在的技术问题,试图为该领域以外的学术研究人员和工程师提供指导,并促进对点云配准统一愿景的讨论。点云获取的一般方式分为主动和被动方式,由传感器主动获取的点云为主动方式,后期通过重建的方式

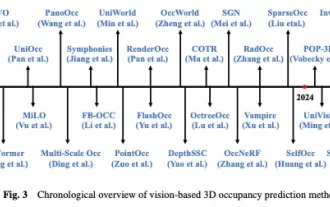

一览Occ与自动驾驶的前世今生!首篇综述全面汇总特征增强/量产部署/高效标注三大主题

May 08, 2024 am 11:40 AM

一览Occ与自动驾驶的前世今生!首篇综述全面汇总特征增强/量产部署/高效标注三大主题

May 08, 2024 am 11:40 AM

写在前面&笔者的个人理解近年来,自动驾驶因其在减轻驾驶员负担和提高驾驶安全方面的潜力而越来越受到关注。基于视觉的三维占用预测是一种新兴的感知任务,适用于具有成本效益且对自动驾驶安全全面调查的任务。尽管许多研究已经证明,与基于物体为中心的感知任务相比,3D占用预测工具具有更大的优势,但仍存在专门针对这一快速发展领域的综述。本文首先介绍了基于视觉的3D占用预测的背景,并讨论了这一任务中遇到的挑战。接下来,我们从特征增强、部署友好性和标签效率三个方面全面探讨了当前3D占用预测方法的现状和发展趋势。最后

光动嘴就能玩原神!用AI切换角色,还能攻击敌人,网友:“绫华,使用神里流·霜灭”

May 13, 2023 pm 07:52 PM

光动嘴就能玩原神!用AI切换角色,还能攻击敌人,网友:“绫华,使用神里流·霜灭”

May 13, 2023 pm 07:52 PM

说到这两年风靡全球的国产游戏,原神肯定是当仁不让。根据5月公布的本年度Q1季度手游收入调查报告,在抽卡手游里《原神》以5.67亿美金的绝对优势稳稳拿下第一,这也宣告《原神》在上线短短18个月之后单在手机平台总收入就突破30亿美金(大约RM130亿)。如今,开放须弥前最后的2.8海岛版本姗姗来迟,在漫长的长草期后终于又有新的剧情和区域可以肝了。不过不知道有多少“肝帝”,现在海岛已经满探索,又开始长草了。宝箱总共182个+1个摩拉箱(不计入)长草期根本没在怕的,原神区从来不缺整活儿。这不,在长草期间

AAAI2024:Far3D - 创新的直接干到150m视觉3D目标检测思路

Dec 15, 2023 pm 01:54 PM

AAAI2024:Far3D - 创新的直接干到150m视觉3D目标检测思路

Dec 15, 2023 pm 01:54 PM

最近在Arxiv上阅读到一篇关于纯视觉环视感知的最新研究,该研究基于PETR系列方法,并专注于解决远距离目标检测的纯视觉感知问题,将感知范围扩大到150米。这篇论文的方法和结果对我们来说有很大的参考价值,所以我尝试着对其进行解读原标题:Far3D:ExpandingtheHorizonforSurround-view3DObjectDetection论文链接:https://arxiv.org/abs/2308.09616作者单位:北京理工大学&旷视科技任务背景三维物体检测在理解自动驾驶

颜水成挂帅,奠定「通用视觉多模态大模型」终极形态!一统理解/生成/分割/编辑

Apr 25, 2024 pm 08:04 PM

颜水成挂帅,奠定「通用视觉多模态大模型」终极形态!一统理解/生成/分割/编辑

Apr 25, 2024 pm 08:04 PM

近日,颜水成教授团队联合发布并开源了Vitron通用像素级视觉多模态大语言模型。项目主页&Demo:https://vitron-llm.github.io/论文链接:https://is.gd/aGu0VV开源代码:https://github.com/SkyworkAI/Vitron这是一个重磅的通用视觉多模态大模型,支持从视觉理解到视觉生成、从低层次到高层次的一系列视觉任务,解决了困扰大语言模型产业已久的图像/视频模型割裂问题,提供了一个全面统一静态图像与动态视频内容的理解、生成、分割、编