对抗训练中的收敛问题

对抗训练(Adversarial Training)是近年来在深度学习领域引起广泛关注的一种训练方法。它旨在增强模型的鲁棒性,使其能够对抗各种攻击手段。然而,在实际应用中,对抗训练面临着一个重要的问题,即收敛问题。在本文中,我们将讨论收敛问题,并给出一种具体的代码示例来解决这个问题。

首先,让我们来了解一下收敛问题是什么。在对抗训练中,我们通过在训练集中添加对抗样本来训练模型。对抗样本是经过人为修改的样本,它们在人类和模型之间有很大的相似性,但能够欺骗模型的分类器。这使得模型在面对对抗样本时变得更为鲁棒。

然而,由于对抗样本的引入,训练过程变得更加困难。传统的优化方法很难找到一个收敛的解,导致模型无法获得良好的泛化能力。这就是收敛问题。具体而言,收敛问题表现为模型在训练过程中的损失函数无法稳定下降,或者模型在测试集上的表现无法得到明显的提升。

为了解决这个问题,研究者们提出了许多方法。其中,一种常用的方法是通过调整训练过程中的参数来改善模型的收敛性。例如,可以调整学习率、正则化项、训练集的大小等。此外,还有一些方法是专门为对抗训练设计的,如Madry等人提出的PGD(Projected Gradient Descent)算法。

下面,我们将给出一种具体的代码示例,展示如何使用PGD算法来解决收敛问题。首先,我们需要定义一个对抗训练的模型。这个模型可以是任意的深度学习模型,如卷积神经网络(CNN)、循环神经网络(RNN)等。

接下来,我们需要定义一个对抗样本生成器。PGD算法是一种迭代的攻击方法,它通过多次迭代来生成对抗样本。在每一次迭代中,我们通过计算当前模型的梯度来更新对抗样本。具体而言,我们使用梯度上升的方式来更新对抗样本,以使其对模型更具欺骗性。

最后,我们需要进行对抗训练的过程。在每一次迭代中,我们先生成对抗样本,然后使用对抗样本和真实样本进行训练。这样,模型就能够在不断的对抗中逐渐提高其鲁棒性。

下面是一个简单的代码示例,展示了如何使用PGD算法进行对抗训练:

import torch

import torch.nn as nn

import torch.optim as optim

class AdversarialTraining:

def __init__(self, model, eps=0.01, alpha=0.01, iterations=10):

self.model = model

self.eps = eps

self.alpha = alpha

self.iterations = iterations

def generate_adversarial_sample(self, x, y):

x_adv = x.clone().detach().requires_grad_(True)

for _ in range(self.iterations):

loss = nn.CrossEntropyLoss()(self.model(x_adv), y)

loss.backward()

x_adv.data += self.alpha * torch.sign(x_adv.grad.data)

x_adv.grad.data.zero_()

x_adv.data = torch.max(torch.min(x_adv.data, x + self.eps), x - self.eps)

x_adv.data = torch.clamp(x_adv.data, 0.0, 1.0)

return x_adv

def train(self, train_loader, optimizer, criterion):

for x, y in train_loader:

x_adv = self.generate_adversarial_sample(x, y)

logits = self.model(x_adv)

loss = criterion(logits, y)

optimizer.zero_grad()

loss.backward()

optimizer.step()

# 定义模型和优化器

model = YourModel()

optimizer = optim.SGD(model.parameters(), lr=0.01, momentum=0.9)

criterion = nn.CrossEntropyLoss()

# 创建对抗训练对象

adv_training = AdversarialTraining(model)

# 进行对抗训练

adv_training.train(train_loader, optimizer, criterion)在上面的代码中,model是我们要训练的模型,eps是生成对抗样本时的扰动范围,alpha是每一次迭代的步长,iterations是迭代次数。generate_adversarial_sample方法用来生成对抗样本,train方法用来进行对抗训练。

通过以上的代码示例,我们可以看到如何使用PGD算法来解决对抗训练中的收敛问题。当然,这只是一种方法,针对不同的问题可能需要根据实际情况进行调整。希望本文能够对你理解和解决收敛问题有所帮助。

以上是对抗训练中的收敛问题的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

我尝试了使用光标AI编码的Vibe编码,这太神奇了!

Mar 20, 2025 pm 03:34 PM

我尝试了使用光标AI编码的Vibe编码,这太神奇了!

Mar 20, 2025 pm 03:34 PM

Vibe编码通过让我们使用自然语言而不是无尽的代码行创建应用程序来重塑软件开发的世界。受Andrej Karpathy等有远见的人的启发,这种创新的方法使Dev

2025年2月的Genai推出前5名:GPT-4.5,Grok-3等!

Mar 22, 2025 am 10:58 AM

2025年2月的Genai推出前5名:GPT-4.5,Grok-3等!

Mar 22, 2025 am 10:58 AM

2025年2月,Generative AI又是一个改变游戏规则的月份,为我们带来了一些最令人期待的模型升级和开创性的新功能。从Xai的Grok 3和Anthropic的Claude 3.7十四行诗到Openai的G

如何使用Yolo V12进行对象检测?

Mar 22, 2025 am 11:07 AM

如何使用Yolo V12进行对象检测?

Mar 22, 2025 am 11:07 AM

Yolo(您只看一次)一直是领先的实时对象检测框架,每次迭代都在以前的版本上改善。最新版本Yolo V12引入了进步,可显着提高准确性

最佳AI艺术生成器(免费付款)创意项目

Apr 02, 2025 pm 06:10 PM

最佳AI艺术生成器(免费付款)创意项目

Apr 02, 2025 pm 06:10 PM

本文回顾了AI最高的艺术生成器,讨论了他们的功能,对创意项目的适用性和价值。它重点介绍了Midjourney是专业人士的最佳价值,并建议使用Dall-E 2进行高质量的可定制艺术。

Chatgpt 4 o可用吗?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4 o可用吗?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4当前可用并广泛使用,与诸如ChatGpt 3.5(例如ChatGpt 3.5)相比,在理解上下文和产生连贯的响应方面取得了重大改进。未来的发展可能包括更多个性化的间

哪个AI比Chatgpt更好?

Mar 18, 2025 pm 06:05 PM

哪个AI比Chatgpt更好?

Mar 18, 2025 pm 06:05 PM

本文讨论了AI模型超过Chatgpt,例如Lamda,Llama和Grok,突出了它们在准确性,理解和行业影响方面的优势。(159个字符)

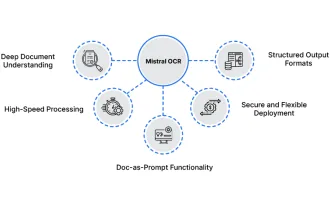

如何将Mistral OCR用于下一个抹布模型

Mar 21, 2025 am 11:11 AM

如何将Mistral OCR用于下一个抹布模型

Mar 21, 2025 am 11:11 AM

MISTRAL OCR:通过多模式文档理解彻底改变检索效果 检索增强的生成(RAG)系统具有明显高级的AI功能,从而可以访问大量的数据存储,以获得更明智的响应

顶级AI写作助理来增强您的内容创建

Apr 02, 2025 pm 06:11 PM

顶级AI写作助理来增强您的内容创建

Apr 02, 2025 pm 06:11 PM

文章讨论了Grammarly,Jasper,Copy.ai,Writesonic和Rytr等AI最高的写作助手,重点介绍了其独特的内容创建功能。它认为Jasper在SEO优化方面表现出色,而AI工具有助于保持音调的组成