目标检测技术中的目标尺度变化问题

目标检测技术中的目标尺度变化问题,需要具体代码示例

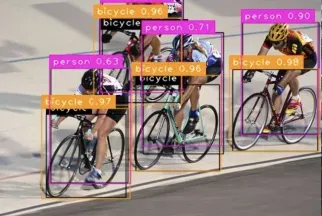

近年来,目标检测技术在计算机视觉领域的发展取得了巨大的突破。然而,目标尺度变化问题一直是困扰目标检测算法的一个重要挑战。目标的尺度变化指的是目标在图像中的大小与其在训练集中的大小不一致,这会对目标检测的准确性和稳定性造成很大的影响。本文将介绍目标尺度变化问题的原因、影响和解决方法,并给出具体的代码示例。

首先,目标尺度变化问题的主要原因是现实世界中物体的尺度多样性。同一个目标在不同场景和视角下尺度会有所变化,例如,人的身高在不同距离下会产生显着的变化。而目标检测算法通常是在有限的数据集上训练的,无法覆盖到所有可能的尺度变化情况。因此,当目标的尺度发生变化时,算法往往难以准确地检测到目标。

目标尺度变化问题对目标检测的影响非常明显。一方面,目标尺度变化会导致目标的特征发生变化,使得训练好的模型很难对其进行准确的匹配。另一方面,目标尺度变化还会导致目标的外观变化,从而引入噪声信号,降低检测的精度和稳定性。因此,解决目标尺度变化问题对于提高目标检测算法的性能至关重要。

针对目标尺度变化问题,研究者们提出了一系列解决方法。其中一种常用的方法是使用多尺度检测器。该方法通过在不同尺度下对图像进行检测,从而能够更好地适应目标尺度变化。具体而言,多尺度检测器通过对输入图像进行缩放或裁剪,生成一系列不同尺度的图像,并在这些图像上进行目标检测。这种方法可以有效地改善目标尺度变化问题,提高检测的准确性。

以下是一个示例代码,展示了如何使用多尺度检测器解决目标尺度变化问题:

import cv2

import numpy as np

# 加载图像

image = cv2.imread("image.jpg")

# 定义尺度因子

scales = [0.5, 1.0, 1.5]

# 创建检测器

detector = cv2.CascadeClassifier("haarcascade_frontalface_default.xml")

# 多尺度检测

for scale in scales:

# 尺度变换

resized_image = cv2.resize(image, None, fx=scale, fy=scale, interpolation=cv2.INTER_LINEAR)

# 目标检测

faces = detector.detectMultiScale(resized_image, scaleFactor=1.1, minNeighbors=5, minSize=(30, 30))

# 绘制检测结果

for (x, y, w, h) in faces:

cv2.rectangle(resized_image, (x, y), (x + w, y + h), (0, 255, 0), 2)

# 显示图像

cv2.imshow("Multi-scale Detection", resized_image)

cv2.waitKey(0)在上述代码中,首先加载了图像,然后定义了一组尺度因子,在这个示例中我们选择了三个尺度因子。之后,通过缩放图像,生成了不同尺度的图像。接着,使用OpenCV的级联分类器CascadeClassifier进行目标检测,并在图像上绘制检测结果。最后,显示结果图像,并等待用户的键盘输入。

通过使用多尺度检测器,我们可以有效地解决目标尺度变化问题,提高目标检测的性能。当然,除了多尺度检测器外,还有其他一些方法和技巧可以用来解决目标尺度变化问题。希望这个示例代码对理解和应用目标尺度变化问题有所帮助。

以上是目标检测技术中的目标尺度变化问题的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

Stable Diffusion 3论文终于发布,架构细节大揭秘,对复现Sora有帮助?

Mar 06, 2024 pm 05:34 PM

Stable Diffusion 3论文终于发布,架构细节大揭秘,对复现Sora有帮助?

Mar 06, 2024 pm 05:34 PM

StableDiffusion3的论文终于来了!这个模型于两周前发布,采用了与Sora相同的DiT(DiffusionTransformer)架构,一经发布就引起了不小的轰动。与之前版本相比,StableDiffusion3生成的图质量有了显着提升,现在支持多主题提示,并且文字书写效果也得到了改善,不再出现乱码情况。 StabilityAI指出,StableDiffusion3是一个系列模型,其参数量从800M到8B不等。这一参数范围意味着该模型可以在许多便携设备上直接运行,从而显着降低了使用AI

你是否真正掌握了坐标系转换?自动驾驶离不开的多传感器问题

Oct 12, 2023 am 11:21 AM

你是否真正掌握了坐标系转换?自动驾驶离不开的多传感器问题

Oct 12, 2023 am 11:21 AM

一先导与重点文章主要介绍自动驾驶技术中几种常用的坐标系统,以及他们之间如何完成关联和转换,最终构建出统一的环境模型。这里重点理解自车到相机刚体转换(外参),相机到图像转换(内参),图像到像素有单位转换。3d向2d转换会有相应的畸变,平移等。重点:自车坐标系相机机体坐标系需要被重写的是:平面坐标系像素坐标系难点:要考虑图像畸变,去畸变和加畸变都是在像平面上去补偿二简介视觉系统一共有四个坐标系:像素平面坐标系(u,v)、图像坐标系(x,y)、相机坐标系()和世界坐标系()。每种坐标系之间均存在联系,

自动驾驶与轨迹预测看这一篇就够了!

Feb 28, 2024 pm 07:20 PM

自动驾驶与轨迹预测看这一篇就够了!

Feb 28, 2024 pm 07:20 PM

轨迹预测在自动驾驶中承担着重要的角色,自动驾驶轨迹预测是指通过分析车辆行驶过程中的各种数据,预测车辆未来的行驶轨迹。作为自动驾驶的核心模块,轨迹预测的质量对于下游的规划控制至关重要。轨迹预测任务技术栈丰富,需要熟悉自动驾驶动/静态感知、高精地图、车道线、神经网络架构(CNN&GNN&Transformer)技能等,入门难度很大!很多粉丝期望能够尽快上手轨迹预测,少踩坑,今天就为大家盘点下轨迹预测常见的一些问题和入门学习方法!入门相关知识1.预习的论文有没有切入顺序?A:先看survey,p

用于精确目标检测的多网格冗余边界框标注

Jun 01, 2024 pm 09:46 PM

用于精确目标检测的多网格冗余边界框标注

Jun 01, 2024 pm 09:46 PM

一、前言目前领先的目标检测器是基于深度CNN的主干分类器网络重新调整用途的两级或单级网络。YOLOv3就是这样一种众所周知的最先进的单级检测器,它接收输入图像并将其划分为大小相等的网格矩阵。具有目标中心的网格单元负责检测特定目标。今天分享的,就是提出了一种新的数学方法,该方法为每个目标分配多个网格,以实现精确的tight-fit边界框预测。研究者还提出了一种有效的离线复制粘贴数据增强来进行目标检测。新提出的方法显着优于一些当前最先进的目标检测器,并有望获得更好的性能。二、背景目标检测网络旨在使用

目标检测新SOTA:YOLOv9问世,新架构让传统卷积重焕生机

Feb 23, 2024 pm 12:49 PM

目标检测新SOTA:YOLOv9问世,新架构让传统卷积重焕生机

Feb 23, 2024 pm 12:49 PM

在目标检测领域,YOLOv9在实现过程中不断进步,通过采用新架构和方法,有效提高了传统卷积的参数利用率,这使得其性能远超前代产品。继2023年1月YOLOv8正式发布一年多以后,YOLOv9终于来了!自2015年JosephRedmon和AliFarhadi等人提出了第一代YOLO模型以来,目标检测领域的研究者们对其进行了多次更新和迭代。 YOLO是一种基于图像全局信息的预测系统,其模型性能不断得到增强。通过不断改进算法和技术,研究人员取得了显着的成果,使得YOLO在目标检测任务中表现出越来越强大

DualBEV:大幅超越BEVFormer、BEVDet4D,开卷!

Mar 21, 2024 pm 05:21 PM

DualBEV:大幅超越BEVFormer、BEVDet4D,开卷!

Mar 21, 2024 pm 05:21 PM

这篇论文探讨了在自动驾驶中,从不同视角(如透视图和鸟瞰图)准确检测物体的问题,特别是如何有效地从透视图(PV)到鸟瞰图(BEV)空间转换特征,这一转换是通过视觉转换(VT)模块实施的。现有的方法大致分为两种策略:2D到3D和3D到2D转换。2D到3D的方法通过预测深度概率来提升密集的2D特征,但深度预测的固有不确定性,尤其是在远处区域,可能会引入不准确性。而3D到2D的方法通常使用3D查询来采样2D特征,并通过Transformer学习3D和2D特征之间对应关系的注意力权重,这增加了计算和部署的

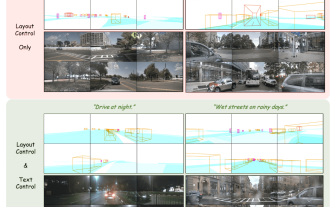

首个多视角自动驾驶场景视频生成世界模型 | DrivingDiffusion: BEV数据和仿真新思路

Oct 23, 2023 am 11:13 AM

首个多视角自动驾驶场景视频生成世界模型 | DrivingDiffusion: BEV数据和仿真新思路

Oct 23, 2023 am 11:13 AM

笔者的一些个人思考在自动驾驶领域,随着BEV-based子任务/端到端方案的发展,高质量的多视图训练数据和相应的仿真场景构建愈发重要。针对当下任务的痛点,“高质量”可以解耦成三个方面:不同维度上的长尾场景:如障碍物数据中近距离的车辆以及切车过程中精准的朝向角,以及车道线数据中不同曲率的弯道或较难采集的匝道/汇入/合流等场景。这些往往靠大量的数据采集和复杂的数据挖掘策略,成本高昂。3D真值-图像的高度一致:当下的BEV数据获取往往受到传感器安装/标定,高精地图以及重建算法本身的误差影响。这导致了我

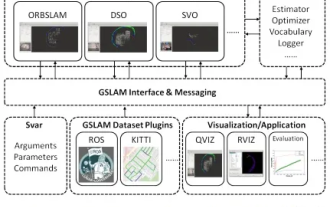

GSLAM | 一个通用的SLAM架构和基准

Oct 20, 2023 am 11:37 AM

GSLAM | 一个通用的SLAM架构和基准

Oct 20, 2023 am 11:37 AM

突然发现了一篇19年的论文GSLAM:AGeneralSLAMFrameworkandBenchmark开源代码:https://github.com/zdzhaoyong/GSLAM直接上全文,感受这项工作的质量吧~1摘要SLAM技术最近取得了许多成功,并吸引了高科技公司的关注。然而,如何同一现有或新兴算法的界面,一级有效地进行关于速度、稳健性和可移植性的基准测试仍然是问题。本文,提出了一个名为GSLAM的新型SLAM平台,它不仅提供评估功能,还为研究人员提供了快速开发自己的SLAM系统的有用