强化学习中的奖励函数设计问题

强化学习中的奖励函数设计问题

引言

强化学习是一种通过智能体与环境的交互来学习最优策略的方法。在强化学习中,奖励函数的设计对于智能体的学习效果至关重要。本文将探讨强化学习中的奖励函数设计问题,并提供具体代码示例。

- 奖励函数的作用及目标

奖励函数是强化学习中的重要组成部分,用于评估智能体在某一状态下所获得的奖励值。它的设计有助于引导智能体通过选择最优行动来最大化长期累积奖励。

一个好的奖励函数应当具备以下两个目标:

(1) 提供足够的信息使得智能体能够学习到最优策略;

(2) 通过适当的奖励反馈,指导智能体避免无效和有害的行为。

- 奖励函数设计的挑战

奖励函数的设计可能面临以下挑战:

(1) 稀疏性:在某些情况下,环境的奖励信号可能很稀疏,导致学习过程变慢或不稳定。

(2) 误导性:不正确或不充分的奖励信号可能导致智能体学习到错误的策略。

(3) 高维度:在具有大量状态和动作的复杂环境中,设计奖励函数变得更加困难。

(4) 目标冲突:不同的目标可能会导致奖励函数设计的冲突,如短期与长期目标的平衡。 - 奖励函数设计的方法

为了克服奖励函数设计中的挑战,可以采用以下方法:

(1) 人工设计:根据先验知识和经验,手动设计奖励函数。这种方法通常适用于简单的问题,但对于复杂问题可能会面临挑战。

(2) 奖励工程:通过引入辅助奖励或惩罚来改善奖励函数的性能。例如,对某些状态或动作进行额外的奖励或惩罚,以更好地指导智能体学习。

(3) 自适应奖励函数:采用自适应算法来动态地调整奖励函数。这种方法可以通过随时间推进而改变奖励函数的权重,以适应不同阶段的学习需求。

- 具体代码示例

以下是一个使用深度强化学习框架TensorFlow和Keras的示例代码,展示了奖励函数的设计方式:

import numpy as np

from tensorflow import keras

# 定义强化学习智能体的奖励函数

def reward_function(state, action):

# 根据当前状态和动作计算奖励值

reward = 0

# 添加奖励和惩罚条件

if state == 0 and action == 0:

reward += 1

elif state == 1 and action == 1:

reward -= 1

return reward

# 定义强化学习智能体的神经网络模型

def create_model():

model = keras.Sequential([

keras.layers.Dense(64, activation='relu', input_shape=(2,)),

keras.layers.Dense(64, activation='relu'),

keras.layers.Dense(1)

])

model.compile(optimizer='adam', loss='mean_squared_error')

return model

# 训练智能体

def train_agent():

model = create_model()

# 智能体的训练过程

for episode in range(num_episodes):

state = initial_state

# 智能体根据当前策略选择动作

action = model.predict(state)

# 获得当前状态下的奖励值

reward = reward_function(state, action)

# 更新模型的权重

model.fit(state, reward)在上述代码中,我们通过定义reward_function函数来设计奖励函数,在训练智能体时根据当前状态和动作计算奖励值。同时,我们使用create_model函数创建了一个神经网络模型来训练智能体,并使用model.predict函数根据当前策略选择动作。

结论

强化学习中的奖励函数设计是一个重要且有挑战性的问题。正确设计的奖励函数可以有效指导智能体学习最优策略。本文通过讨论奖励函数的作用及目标、设计挑战以及具体代码示例,希望能为读者在强化学习中的奖励函数设计提供一些参考和启示。

以上是强化学习中的奖励函数设计问题的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

强化学习中的奖励函数设计问题

Oct 09, 2023 am 11:58 AM

强化学习中的奖励函数设计问题

Oct 09, 2023 am 11:58 AM

强化学习中的奖励函数设计问题引言强化学习是一种通过智能体与环境的交互来学习最优策略的方法。在强化学习中,奖励函数的设计对于智能体的学习效果至关重要。本文将探讨强化学习中的奖励函数设计问题,并提供具体代码示例。奖励函数的作用及目标奖励函数是强化学习中的重要组成部分,用于评估智能体在某一状态下所获得的奖励值。它的设计有助于引导智能体通过选择最优行动来最大化长期累

使用Panda-Gym的机器臂模拟实现Deep Q-learning强化学习

Oct 31, 2023 pm 05:57 PM

使用Panda-Gym的机器臂模拟实现Deep Q-learning强化学习

Oct 31, 2023 pm 05:57 PM

强化学习(RL)是一种机器学习方法,它允许代理通过试错来学习如何在环境中表现。行为主体会因为采取行动导致预期结果而获得奖励或受到惩罚。随着时间的推移,代理会学会采取行动,以使得其预期回报最大化RL代理通常使用马尔可夫决策过程(MDP)进行训练,MDP是为顺序决策问题建模的数学框架。MDP由四个部分组成:状态:环境的可能状态的集合。动作:代理可以采取的一组动作。转换函数:在给定当前状态和动作的情况下,预测转换到新状态的概率的函数。奖励函数:为每次转换分配奖励给代理的函数。代理的目标是学习策略函数,

C++中的深度强化学习技术

Aug 21, 2023 pm 11:33 PM

C++中的深度强化学习技术

Aug 21, 2023 pm 11:33 PM

深度强化学习技术是人工智能领域备受关注的一个分支,目前在赢得多个国际竞赛的同时也被广泛应用于个人助手、自动驾驶、游戏智能等领域。而在实现深度强化学习的过程中,C++作为一种高效、优秀的编程语言,在硬件资源有限的情况下尤其重要。深度强化学习,顾名思义,结合了深度学习和强化学习两个领域的技术。简单理解,深度学习是指通过构建多层神经网络,从数据中学习特征并进行决策

如何使用 Go 语言进行深度强化学习研究?

Jun 10, 2023 pm 02:15 PM

如何使用 Go 语言进行深度强化学习研究?

Jun 10, 2023 pm 02:15 PM

深度强化学习(DeepReinforcementLearning)是一种结合了深度学习和强化学习的先进技术,被广泛应用于语音识别、图像识别、自然语言处理等领域。Go语言作为一门快速、高效、可靠的编程语言,可以为深度强化学习研究提供帮助。本文将介绍如何使用Go语言进行深度强化学习研究。一、安装Go语言和相关库在开始使用Go语言进行深度强化学习

再掀强化学习变革!DeepMind提出「算法蒸馏」:可探索的预训练强化学习Transformer

Apr 12, 2023 pm 06:58 PM

再掀强化学习变革!DeepMind提出「算法蒸馏」:可探索的预训练强化学习Transformer

Apr 12, 2023 pm 06:58 PM

在当下的序列建模任务上,Transformer可谓是最强大的神经网络架构,并且经过预训练的Transformer模型可以将prompt作为条件或上下文学习(in-context learning)适应不同的下游任务。大型预训练Transformer模型的泛化能力已经在多个领域得到验证,如文本补全、语言理解、图像生成等等。从去年开始,已经有相关工作证明,通过将离线强化学习(offline RL)视为一个序列预测问题,那么模型就可以从离线数据中学习策略。但目前的方法要么是从不包含学习的数据中学习策略

使用Actor-Critic的DDPG强化学习算法控制双关节机械臂

May 12, 2023 pm 09:55 PM

使用Actor-Critic的DDPG强化学习算法控制双关节机械臂

May 12, 2023 pm 09:55 PM

在本文中,我们将介绍在Reacher环境中训练智能代理控制双关节机械臂,这是一种使用UnityML-Agents工具包开发的基于Unity的模拟程序。我们的目标是高精度的到达目标位置,所以这里我们可以使用专为连续状态和动作空间设计的最先进的DeepDeterministicPolicyGradient(DDPG)算法。现实世界的应用程序机械臂在制造业、生产设施、空间探索和搜救行动中发挥着关键作用。控制机械臂的高精度和灵活性是非常重要的。通过采用强化学习技术,可以使这些机器人系统实时学习和调整其行

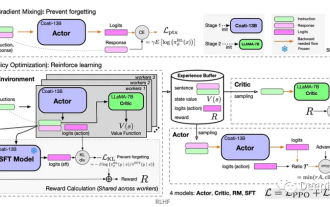

如何运用强化学习来提升快手用户留存?

May 07, 2023 pm 06:31 PM

如何运用强化学习来提升快手用户留存?

May 07, 2023 pm 06:31 PM

短视频推荐系统的核心目标是通过提升用户留存,牵引DAU增长。因此留存是各APP的核心业务优化指标之一。然而留存是用户和系统多次交互后的长期反馈,很难分解到单个item或者单个list,因此传统的point-wise和list-wise模型难以直接优化留存。强化学习(RL)方法通过和环境交互的方式优化长期奖励,适合直接优化用户留存。该工作将留存优化问题建模成一个无穷视野请求粒度的马尔科夫决策过程(MDP),用户每次请求推荐系统决策一个动作(action),用于聚合多个不同的短期反馈预估(观看时长、

20分钟学会装配电路板!开源SERL框架精密操控成功率100%,速度三倍于人类

Feb 21, 2024 pm 03:31 PM

20分钟学会装配电路板!开源SERL框架精密操控成功率100%,速度三倍于人类

Feb 21, 2024 pm 03:31 PM

现在,机器人学会工厂精密操控任务了。近年来,机器人强化学习技术领域取得显着的进展,例如四足行走,抓取,灵巧操控等,但大多数局限于实验室展示阶段。将机器人强化学习技术广泛应用到实际生产环境仍面临众多挑战,这在一定程度上限制了其在真实场景的应用范围。强化学习技术在实际应用的过程中,任需克服包括奖励机制设定、环境重置、样本效率提升及动作安全性保障等多重复杂的问题。业内专家强调,解决强化学习技术实际落地的诸多难题,与算法本身的持续创新同等重要。面对这一挑战,来自加州大学伯克利、斯坦福大学、华盛顿大学以及