微软推出 '从错误中学习” 模型训练法,号称可'模仿人类学习过程,改善 AI 推理能力”

微软亚洲研究院联合北京大学、西安交通大学等高校,最近提出了一种名为“从错误中学习(LeMA)”的人工智能训练方法。该方法声称能够通过模仿人类学习的过程,来提升人工智能的推理能力

当下 OpenAI GPT-4 和谷歌 aLM-2 等大语言模型在自然语言处理(NLP)任务,及思维链(chain-of-thought,CoT)推理的数学难题任务中都有不错的表现。

但例如 LLaMA-2 及 Baichuan-2 等开源大模型,在处理相关问题时则有待加强。为了提升开源这些大语言模型的思维链推理能力,研究团队提出了 LeMA 方法。这种方法主要是模仿人类的学习过程,通过“从错误中学习”,以改进模型的推理能力。

▲ 图源 相关论文

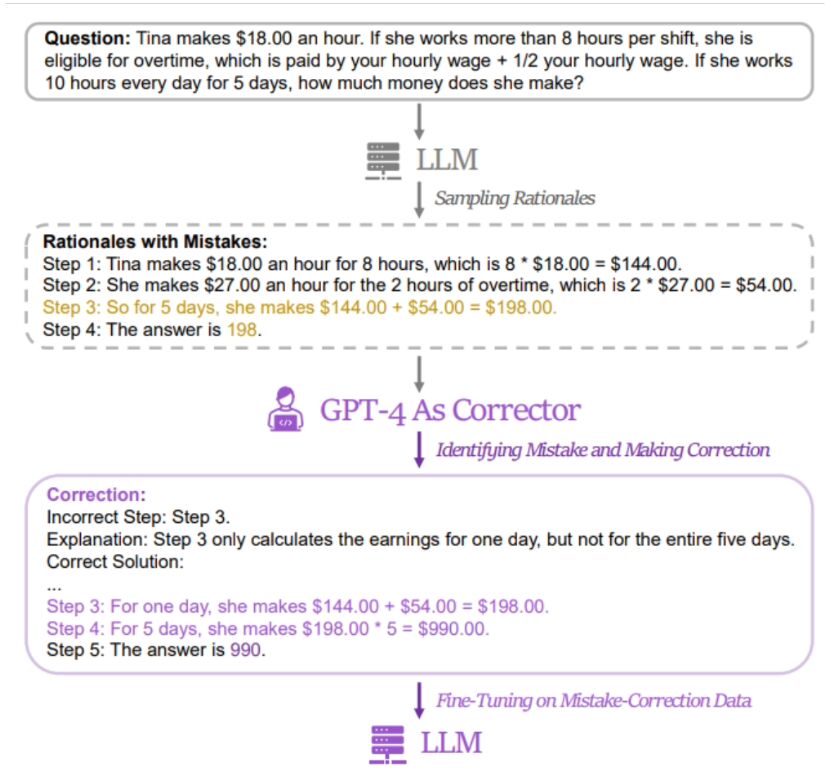

本站发现,研究人员的方法是使用一对包含“错误解答”与“修正后正确答案”的数据来微调相关模型。为取得相关数据,研究人员收集了 5 个不同大语言模型(包括 LLaMA 及 GPT 系列)的错误答案和推理过程,再以 GPT-4 作为“订正者”,提供修正后的正确答案。

据悉,修正后的正确答案中包含三类信息,分别是原推理过程中错误片段、原推理过程出错的原因、以及如何修正原方法以获得正确答案。

研究人员使用GSM8K和MATH测试了LeMa训练法对5个开源大模型的效果。结果显示,在改进后的LLaMA-2-70B模型中,GSM8K的准确率分别为83.5%和81.4%,而MATH的准确率分别为25.0%和23.6%

目前研究人员已将 LeMA 的相关资料公开在 GitHub 上,感兴趣的小伙伴们可以点此跳转。

以上是微软推出 '从错误中学习” 模型训练法,号称可'模仿人类学习过程,改善 AI 推理能力”的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

本地使用Groq Llama 3 70B的逐步指南

Jun 10, 2024 am 09:16 AM

本地使用Groq Llama 3 70B的逐步指南

Jun 10, 2024 am 09:16 AM

译者|布加迪审校|重楼本文介绍了如何使用GroqLPU推理引擎在JanAI和VSCode中生成超快速响应。每个人都致力于构建更好的大语言模型(LLM),例如Groq专注于AI的基础设施方面。这些大模型的快速响应是确保这些大模型更快捷地响应的关键。本教程将介绍GroqLPU解析引擎以及如何在笔记本电脑上使用API和JanAI本地访问它。本文还将把它整合到VSCode中,以帮助我们生成代码、重构代码、输入文档并生成测试单元。本文将免费创建我们自己的人工智能编程助手。GroqLPU推理引擎简介Groq

全球最强开源 MoE 模型来了,中文能力比肩 GPT-4,价格仅为 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

全球最强开源 MoE 模型来了,中文能力比肩 GPT-4,价格仅为 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

想象一下,一个人工智能模型,不仅拥有超越传统计算的能力,还能以更低的成本实现更高效的性能。这不是科幻,DeepSeek-V2[1],全球最强开源MoE模型来了。DeepSeek-V2是一个强大的专家混合(MoE)语言模型,具有训练经济、推理高效的特点。它由236B个参数组成,其中21B个参数用于激活每个标记。与DeepSeek67B相比,DeepSeek-V2性能更强,同时节省了42.5%的训练成本,减少了93.3%的KV缓存,最大生成吞吐量提高到5.76倍。DeepSeek是一家探索通用人工智

七个很酷的GenAI & LLM技术性面试问题

Jun 07, 2024 am 10:06 AM

七个很酷的GenAI & LLM技术性面试问题

Jun 07, 2024 am 10:06 AM

想了解更多AIGC的内容,请访问:51CTOAI.x社区https://www.51cto.com/aigc/译者|晶颜审校|重楼不同于互联网上随处可见的传统问题库,这些问题需要跳出常规思维。大语言模型(LLM)在数据科学、生成式人工智能(GenAI)和人工智能领域越来越重要。这些复杂的算法提升了人类的技能,并在诸多行业中推动了效率和创新性的提升,成为企业保持竞争力的关键。LLM的应用范围非常广泛,它可以用于自然语言处理、文本生成、语音识别和推荐系统等领域。通过学习大量的数据,LLM能够生成文本

大模型做时序预测也很强!华人团队激活LLM新能力,超越一众传统模型实现SOTA

Apr 11, 2024 am 09:43 AM

大模型做时序预测也很强!华人团队激活LLM新能力,超越一众传统模型实现SOTA

Apr 11, 2024 am 09:43 AM

大语言模型潜力被激发——无需训练大语言模型就能实现高精度时序预测,超越一切传统时序模型。蒙纳士大学、蚂蚁和IBM研究院联合开发了一种通用框架,成功推动了大语言模型跨模态处理序列数据的能力。该框架已经成为一项重要的技术创新。时序预测有益于城市、能源、交通、遥感等典型复杂系统的决策制定。自此,大模型有望彻底改变时序/时空数据挖掘方式。通用大语言模型重编程框架研究团队提出了一个通用框架,将大语言模型轻松用于一般时间序列预测,而无需做任何训练。主要提出两大关键技术:时序输入重编程;提示做前缀。Time-

第二代Ameca来了!和观众对答如流,面部表情更逼真,会说几十种语言

Mar 04, 2024 am 09:10 AM

第二代Ameca来了!和观众对答如流,面部表情更逼真,会说几十种语言

Mar 04, 2024 am 09:10 AM

人形机器人Ameca升级第二代了!最近,在世界移动通信大会MWC2024上,世界上最先进机器人Ameca又现身了。会场周围,Ameca引来一大波观众。得到GPT-4加持后,Ameca能够对各种问题做出实时反应。「来一段舞蹈」。当被问及是否有情感时,Ameca用一系列的面部表情做出回应,看起来非常逼真。就在前几天,Ameca背后的英国机器人公司EngineeredArts刚刚演示了团队最新的开发成果。视频中,机器人Ameca具备了视觉能力,能看到并描述房间整个情况、描述具体物体。最厉害的是,她还能

在OpenHarmony本地部署大语言模型

Jun 07, 2024 am 10:02 AM

在OpenHarmony本地部署大语言模型

Jun 07, 2024 am 10:02 AM

本文将第二届OpenHarmony技术大会上展示的《在OpenHarmony本地部署大语言模型》成果开源,开源地址:https://gitee.com/openharmony-sig/tpc_c_cplusplus/blob/master/thirdparty/InferLLM/docs/hap_integrate.md。实现思路和步骤移植轻量级LLM模型推理框架InferLLM到OpenHarmony标准系统,编译出能在OpenHarmony运行的二进制产物。InferLLM是一个简单高效的L

大模型一对一战斗75万轮,GPT-4夺冠,Llama 3位列第五

Apr 23, 2024 pm 03:28 PM

大模型一对一战斗75万轮,GPT-4夺冠,Llama 3位列第五

Apr 23, 2024 pm 03:28 PM

关于Llama3,又有测试结果新鲜出炉——大模型评测社区LMSYS发布了一份大模型排行榜单,Llama3位列第五,英文单项与GPT-4并列第一。图片不同于其他Benchmark,这份榜单的依据是模型一对一battle,由全网测评者自行命题并打分。最终,Llama3取得了榜单中的第五名,排在前面的是GPT-4的三个不同版本,以及Claude3超大杯Opus。而在英文单项榜单中,Llama3反超了Claude,与GPT-4打成了平手。对于这一结果,Meta的首席科学家LeCun十分高兴,转发了推文并

全球最强大模型一夜易主,GPT-4时代终结!Claude 3提前狙击GPT-5,3秒读懂万字论文理解力接近人类

Mar 06, 2024 pm 12:58 PM

全球最强大模型一夜易主,GPT-4时代终结!Claude 3提前狙击GPT-5,3秒读懂万字论文理解力接近人类

Mar 06, 2024 pm 12:58 PM

卷疯了卷疯了,大模型又变天了。就在刚刚,全球最强AI模型一夜易主,GPT-4被拉下神坛。Anthropic发布了最新的Claude3系列模型,一句话评价:真·全面碾压GPT-4!多模态和语言能力指标上,Claude3都赢麻了。用Anthropic的话说,Claude3系列模型在推理、数学、编码、多语言理解和视觉方面,都树立了新的行业基准!Anthropic,就是曾因安全理念不合,而从OpenAI「叛逃」出的员工组成的初创公司,他们的产品一再给OpenAI暴击。这次的Claude3,更是整了个大的