Sparse4D v3来了!推进端到端3D检测和跟踪

新标题:Sparse4D v3:推进端到端的3D检测和跟踪技术

论文链接:https://arxiv.org/pdf/2311.11722.pdf

需要重新写的内容是:代码链接:https://github.com/linxuewu/Sparse4D

重新写的内容:作者所属单位为地平线公司

论文思路:

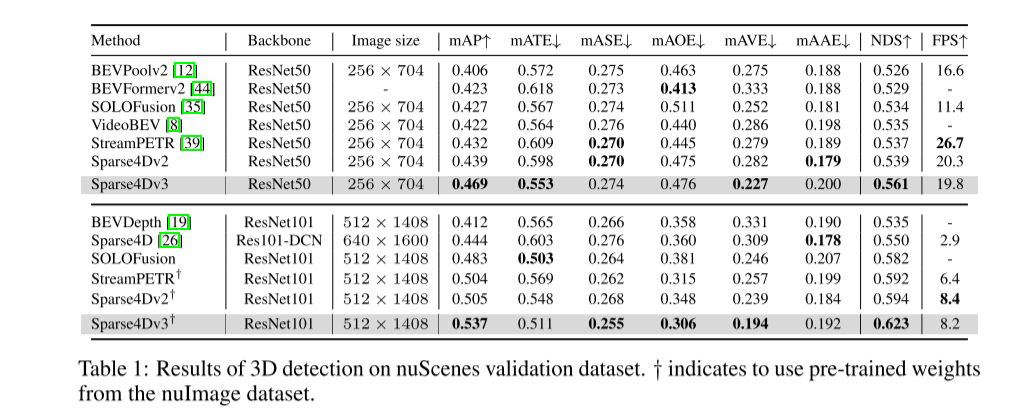

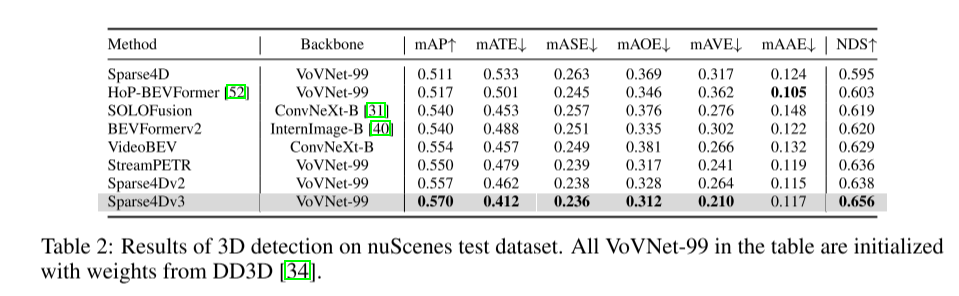

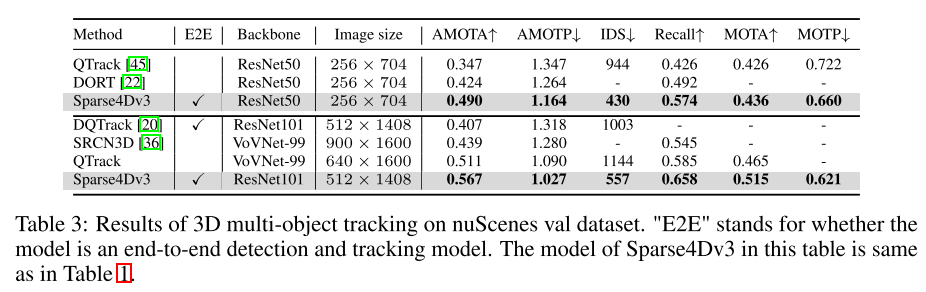

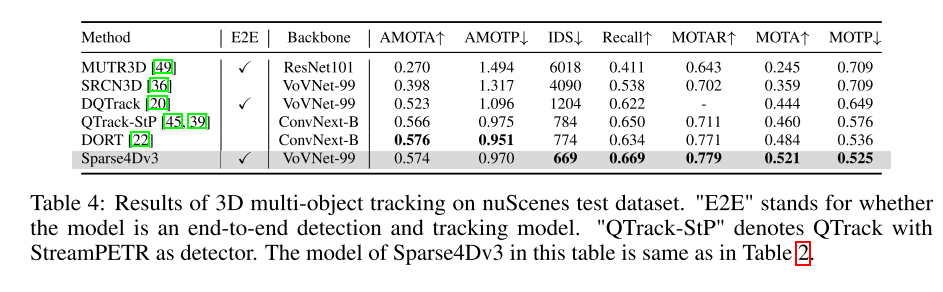

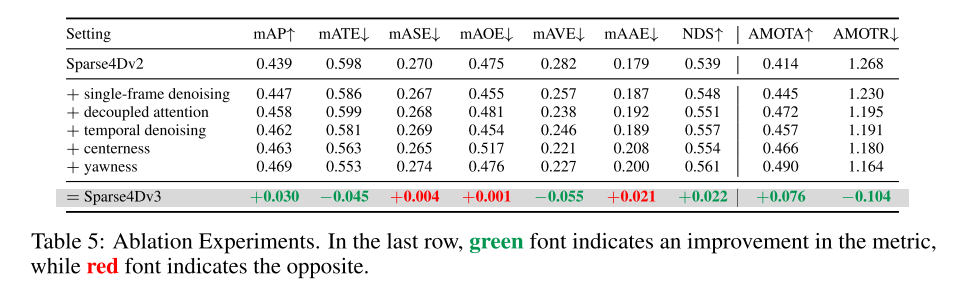

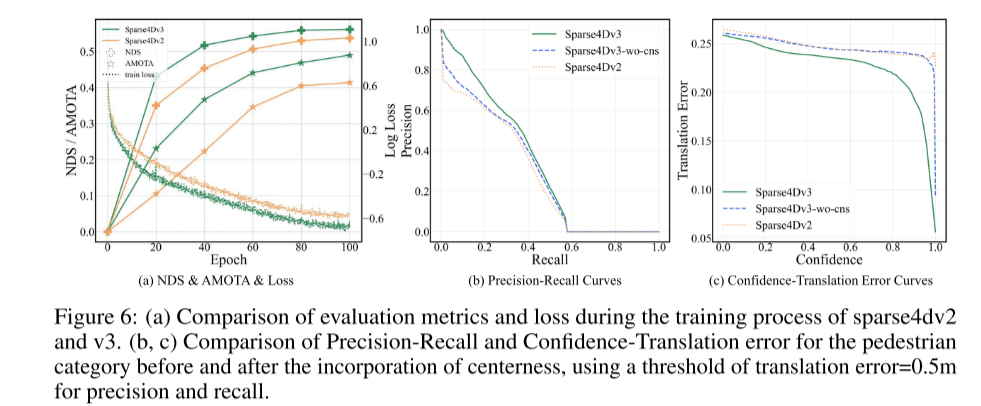

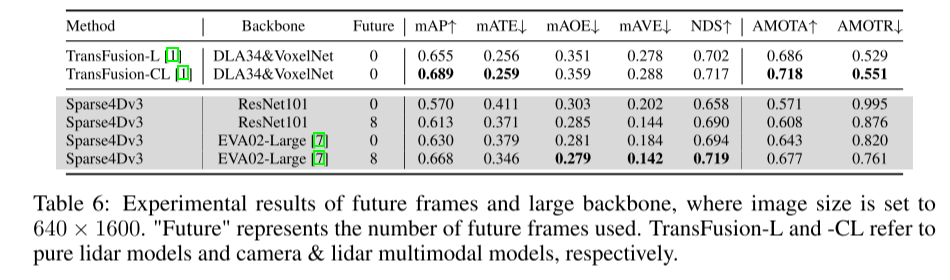

在自动驾驶感知系统中,3D检测和跟踪是两项基本任务。本文基于 Sparse4D 框架更深入地研究了该领域。本文引入了两个辅助训练任务(时序实例去噪-Temporal Instance Denoising和质量估计-Quality Estimation),并提出解耦注意力(decoupled attention)来进行结构改进,从而显着提高检测性能。此外,本文使用一种简单的方法将检测器扩展到跟踪器,该方法在推理过程中分配实例 ID,进一步突出了 query-based 算法的优势。在 nuScenes 基准上进行的大量实验验证了所提出的改进的有效性。以ResNet50为骨干,mAP、NDS和AMOTA分别提高了3.0%、2.2%和7.6%,分别达到46.9%、56.1%和49.0%。本文最好的模型在 nuScenes 测试集上实现了 71.9% NDS 和 67.7% AMOTA

主要贡献:

Sparse4D-v3 是一个强大的 3D 感知框架,它提出了三种有效的策略:时序实例去噪、质量估计和解耦注意力

本文将 Sparse4D 扩展为端到端跟踪模型。

本文展示了 nuScenes 改进的有效性,在检测和跟踪任务中实现了最先进的性能。

网络设计:

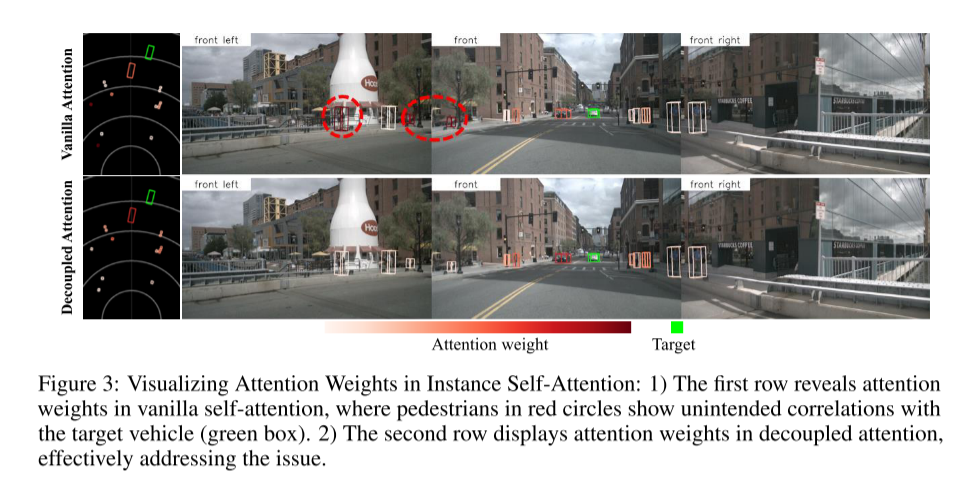

首先,观察到与稠密算法相比,稀疏算法在收敛方面面临更大的挑战,从而影响了最终性能。这个问题已经在2D检测领域得到了充分研究[17,48,53],主要原因是稀疏算法使用了一对一的正样本匹配。这种匹配方式在训练初期不稳定,而且与一对多匹配相比,正样本数量有限,从而降低了解码器训练的效率。此外,Sparse4D使用稀疏特征采样而不是全局交叉注意力,由于正样本稀缺,这进一步阻碍了编码器的收敛。在Sparse4Dv2中,引入了密集深度监督来部分缓解图像编码器面临的这些收敛问题。本文的主要目标是通过关注解码器训练的稳定性来增强模型性能。本文将去噪任务作为辅助监督,并将去噪技术从2D单帧检测扩展到3D时序检测。这不仅保证了稳定的正样本匹配,而且显著增加了正样本的数量。此外,本文还引入了质量评估任务作为辅助监督。这使得输出的置信度分数更加合理,提高了检测结果排名的准确性,从而获得更高的评估指标。此外,本文改进了Sparse4D中实例自注意力和时序交叉注意力模块的结构,引入了一种解耦注意力机制,旨在减少注意力权重计算过程中的特征干扰。通过将锚点嵌入和实例特征作为注意力计算的输入,可以减少注意力权重中存在异常值的实例。这样可以更准确地反映目标特征之间的相互关联,从而实现正确的特征聚合。本文使用连接而不是注意力机制来显著减少这种错误。这种增强方法与条件DETR有相似之处,但关键区别在于本文强调查询之间的注意力,而条件DETR则专注于查询和图像特征之间的交叉注意力。此外,本文还涉及独特的编码方法

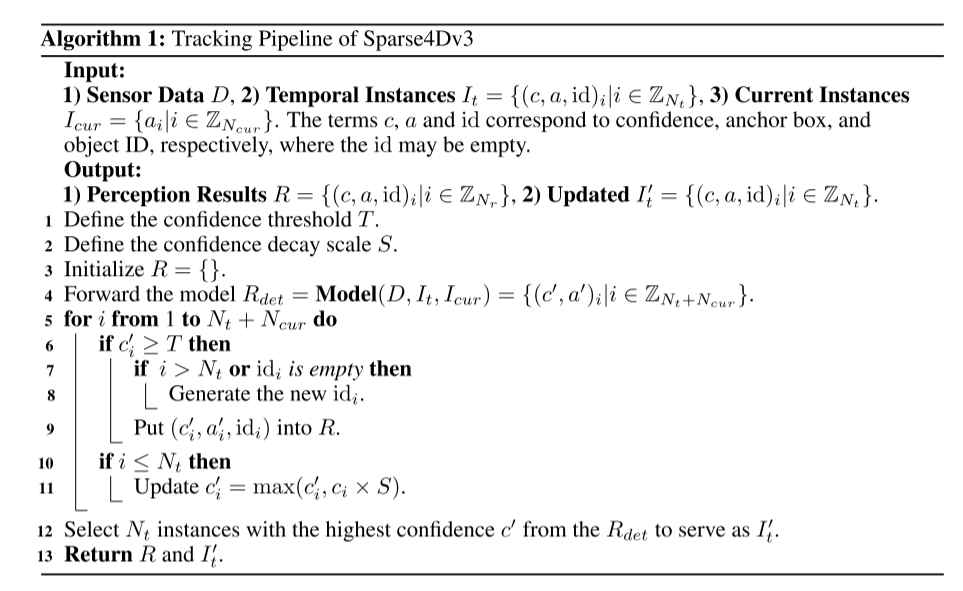

为了提高感知系统的端到端能力,本文研究了将3D多目标跟踪任务集成到Sparse4D框架中的方法,以直接输出目标的运动轨迹。与基于检测的跟踪方法不同,本文通过消除数据关联和过滤的需求,将所有跟踪功能整合到检测器中。此外,与现有的联合检测和跟踪方法不同,本文的跟踪器在训练过程中无需进行修改或调整损失函数。它不需要提供ground truth IDs,而是实现了预定义的实例到跟踪的回归。本文的跟踪实现充分融合了检测器和跟踪器,无需修改检测器的训练过程,也无需额外微调

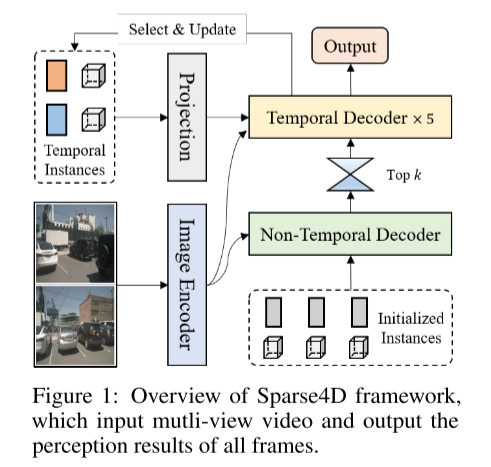

这是一个关于Sparse4D框架概述的图1,输入是多视图视频,输出是所有帧的感知结果

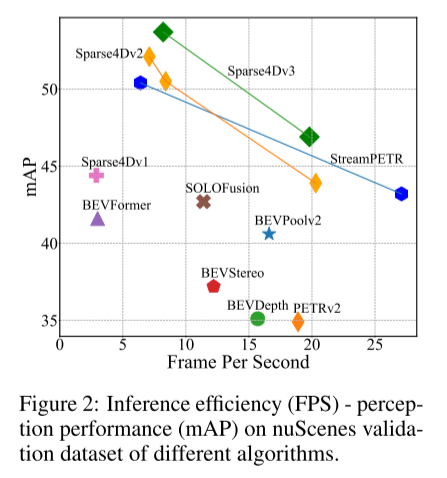

图 2:不同算法的 nuScenes 验证数据集上的推理效率 (FPS) - 感知性能 (mAP)。

图 3:实例自注意力中的注意力权重的可视化:1)第一行显示了普通自注意力中的注意力权重,其中红色圆圈中的行人显示出与目标车辆(绿色框)的意外相关性。2)第二行显示了解耦注意力中的注意力权重,有效解决了该问题。

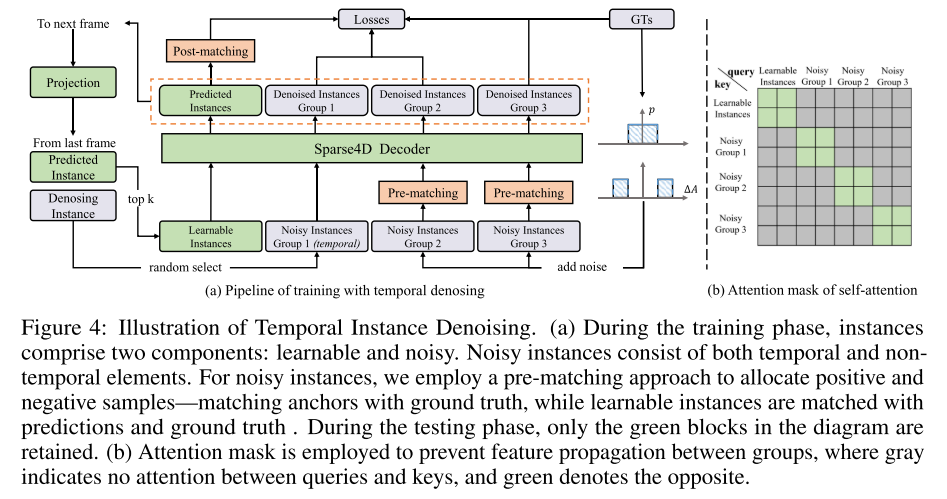

第四张图展示了时序实例去噪的示例。在训练阶段,实例包括两个部分:可学习的和噪声的。噪声实例由时间和非时间元素组成。本文采用预匹配方法来分配正样本和负样本,即将 anchors 与 ground truth 进行匹配,而可学习实例则与预测和 ground truth 进行匹配。在测试阶段,只保留绿色块。为防止特征在 groups 之间传播,采用了 Attention mask,灰色表示 queries 和 keys 之间没有注意力,绿色表示相反

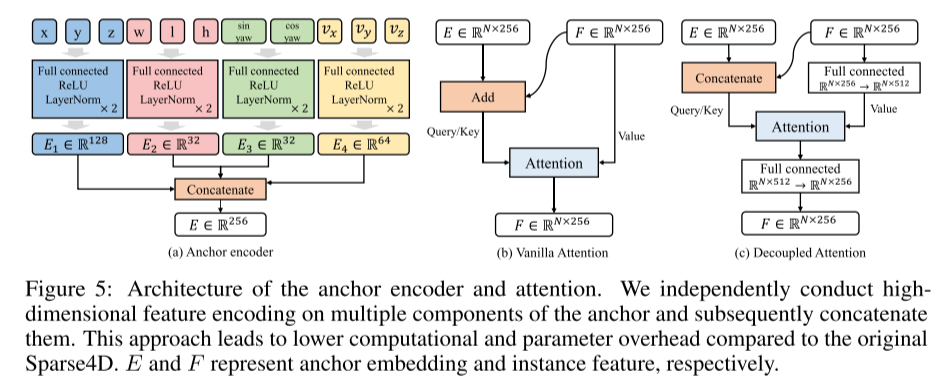

请看图5:锚点编码器和注意力的架构。本文独立地对锚点的多个组件进行了高维特征编码,然后将它们连接起来。与原始的Sparse4D相比,这种方法可以减少计算和参数的开销。E和F分别表示锚点嵌入和实例特征

实验结果:

总结:

本文首先提出了增强 Sparse4D 检测性能的方法。这一增强主要包括三个方面:时序实例去噪、质量估计和解耦注意力。随后,本文说明了将 Sparse4D 扩展为端到端跟踪模型的过程。本文在 nuScenes 上的实验表明,这些增强功能显着提高了性能,使 Sparse4Dv3 处于该领域的前沿。

引用:

Lin, X., Pei, Z., Lin, T., Huang, L., & Su, Z. (2023). Sparse4D v3: Advancing End-to-End 3D Detection and Tracking. ArXiv. /abs/2311.11722

以上是Sparse4D v3来了!推进端到端3D检测和跟踪的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

开源!超越ZoeDepth! DepthFM:快速且精确的单目深度估计!

Apr 03, 2024 pm 12:04 PM

开源!超越ZoeDepth! DepthFM:快速且精确的单目深度估计!

Apr 03, 2024 pm 12:04 PM

0.这篇文章干了啥?提出了DepthFM:一个多功能且快速的最先进的生成式单目深度估计模型。除了传统的深度估计任务外,DepthFM还展示了在深度修复等下游任务中的最先进能力。DepthFM效率高,可以在少数推理步骤内合成深度图。下面一起来阅读一下这项工作~1.论文信息标题:DepthFM:FastMonocularDepthEstimationwithFlowMatching作者:MingGui,JohannesS.Fischer,UlrichPrestel,PingchuanMa,Dmytr

自动驾驶场景中的长尾问题怎么解决?

Jun 02, 2024 pm 02:44 PM

自动驾驶场景中的长尾问题怎么解决?

Jun 02, 2024 pm 02:44 PM

昨天面试被问到了是否做过长尾相关的问题,所以就想着简单总结一下。自动驾驶长尾问题是指自动驾驶汽车中的边缘情况,即发生概率较低的可能场景。感知的长尾问题是当前限制单车智能自动驾驶车辆运行设计域的主要原因之一。自动驾驶的底层架构和大部分技术问题已经被解决,剩下的5%的长尾问题,逐渐成了制约自动驾驶发展的关键。这些问题包括各种零碎的场景、极端的情况和无法预测的人类行为。自动驾驶中的边缘场景"长尾"是指自动驾驶汽车(AV)中的边缘情况,边缘情况是发生概率较低的可能场景。这些罕见的事件

你好,电动Atlas!波士顿动力机器人复活,180度诡异动作吓坏马斯克

Apr 18, 2024 pm 07:58 PM

你好,电动Atlas!波士顿动力机器人复活,180度诡异动作吓坏马斯克

Apr 18, 2024 pm 07:58 PM

波士顿动力Atlas,正式进入电动机器人时代!昨天,液压Atlas刚刚「含泪」退出历史舞台,今天波士顿动力就宣布:电动Atlas上岗。看来,在商用人形机器人领域,波士顿动力是下定决心要和特斯拉硬刚一把了。新视频放出后,短短十几小时内,就已经有一百多万观看。旧人离去,新角色登场,这是历史的必然。毫无疑问,今年是人形机器人的爆发年。网友锐评:机器人的进步,让今年看起来像人类的开幕式动作、自由度远超人类,但这真不是恐怖片?视频一开始,Atlas平静地躺在地上,看起来应该是仰面朝天。接下来,让人惊掉下巴

超级智能体生命力觉醒!可自我更新的AI来了,妈妈再也不用担心数据瓶颈难题

Apr 29, 2024 pm 06:55 PM

超级智能体生命力觉醒!可自我更新的AI来了,妈妈再也不用担心数据瓶颈难题

Apr 29, 2024 pm 06:55 PM

哭死啊,全球狂炼大模型,一互联网的数据不够用,根本不够用。训练模型搞得跟《饥饿游戏》似的,全球AI研究者,都在苦恼怎么才能喂饱这群数据大胃王。尤其在多模态任务中,这一问题尤为突出。一筹莫展之际,来自人大系的初创团队,用自家的新模型,率先在国内把“模型生成数据自己喂自己”变成了现实。而且还是理解侧和生成侧双管齐下,两侧都能生成高质量、多模态的新数据,对模型本身进行数据反哺。模型是啥?中关村论坛上刚刚露面的多模态大模型Awaker1.0。团队是谁?智子引擎。由人大高瓴人工智能学院博士生高一钊创立,高

快手版Sora「可灵」开放测试:生成超120s视频,更懂物理,复杂运动也能精准建模

Jun 11, 2024 am 09:51 AM

快手版Sora「可灵」开放测试:生成超120s视频,更懂物理,复杂运动也能精准建模

Jun 11, 2024 am 09:51 AM

什么?疯狂动物城被国产AI搬进现实了?与视频一同曝光的,是一款名为「可灵」全新国产视频生成大模型。Sora利用了相似的技术路线,结合多项自研技术创新,生产的视频不仅运动幅度大且合理,还能模拟物理世界特性,具备强大的概念组合能力和想象力。数据上看,可灵支持生成长达2分钟的30fps的超长视频,分辨率高达1080p,且支持多种宽高比。另外再划个重点,可灵不是实验室放出的Demo或者视频结果演示,而是短视频领域头部玩家快手推出的产品级应用。而且主打一个务实,不开空头支票、发布即上线,可灵大模型已在快影

聊聊端到端与下一代自动驾驶系统,以及端到端自动驾驶的一些误区?

Apr 15, 2024 pm 04:13 PM

聊聊端到端与下一代自动驾驶系统,以及端到端自动驾驶的一些误区?

Apr 15, 2024 pm 04:13 PM

最近一个月由于众所周知的一些原因,非常密集地和行业内的各种老师同学进行了交流。交流中必不可免的一个话题自然是端到端与火爆的特斯拉FSDV12。想借此机会,整理一下在当下这个时刻的一些想法和观点,供大家参考和讨论。如何定义端到端的自动驾驶系统,应该期望端到端解决什么问题?按照最传统的定义,端到端的系统指的是一套系统,输入传感器的原始信息,直接输出任务关心的变量。例如,在图像识别中,CNN相对于传统的特征提取器+分类器的方法就可以称之为端到端。在自动驾驶任务中,输入各种传感器的数据(相机/LiDAR

nuScenes最新SOTA | SparseAD:稀疏查询助力高效端到端自动驾驶!

Apr 17, 2024 pm 06:22 PM

nuScenes最新SOTA | SparseAD:稀疏查询助力高效端到端自动驾驶!

Apr 17, 2024 pm 06:22 PM

写在前面&出发点端到端的范式使用统一的框架在自动驾驶系统中实现多任务。尽管这种范式具有简单性和清晰性,但端到端的自动驾驶方法在子任务上的性能仍然远远落后于单任务方法。同时,先前端到端方法中广泛使用的密集鸟瞰图(BEV)特征使得扩展到更多模态或任务变得困难。这里提出了一种稀疏查找为中心的端到端自动驾驶范式(SparseAD),其中稀疏查找完全代表整个驾驶场景,包括空间、时间和任务,无需任何密集的BEV表示。具体来说,设计了一个统一的稀疏架构,用于包括检测、跟踪和在线地图绘制在内的任务感知。此外,重

FisheyeDetNet:首个基于鱼眼相机的目标检测算法

Apr 26, 2024 am 11:37 AM

FisheyeDetNet:首个基于鱼眼相机的目标检测算法

Apr 26, 2024 am 11:37 AM

目标检测在自动驾驶系统当中是一个比较成熟的问题,其中行人检测是最早得以部署算法之一。在多数论文当中已经进行了非常全面的研究。然而,利用鱼眼相机进行环视的距离感知相对来说研究较少。由于径向畸变大,标准的边界框表示在鱼眼相机当中很难实施。为了缓解上述描述,我们探索了扩展边界框、椭圆、通用多边形设计为极坐标/角度表示,并定义一个实例分割mIOU度量来分析这些表示。所提出的具有多边形形状的模型fisheyeDetNet优于其他模型,并同时在用于自动驾驶的Valeo鱼眼相机数据集上实现了49.5%的mAP