DetZero:Waymo在3D检测榜单上位列第一,与人工标注媲美!

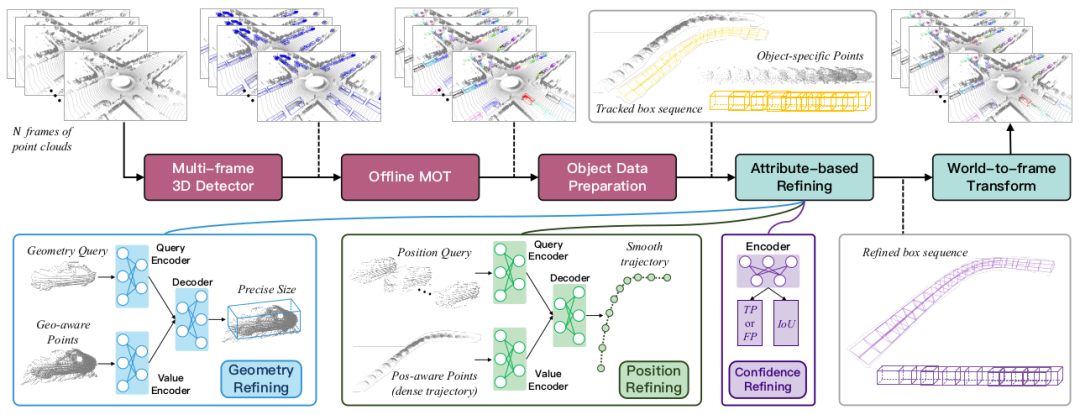

本文提出了一套离线3D物体检测算法框架DetZero,通过在 Waymo 公开数据集上进行全面的研究和评估,DetZero可生成连续且完整的物体轨迹序列,并充分利用长时序点云特征显着提升感知结果的质量。同时以 85.15 mAPH (L2) 的性能在 WOD 3D 物体检测排行榜上取得排名第一。此外,DetZero可以为在线模型的训练提供高质量的自动标签,其结果已经达到甚至高于人工标签的水平。

这是论文链接:https://arxiv.org/abs/2306.06023

需要重新写的内容是:代码链接:https://github.com/PJLab-ADG/DetZero

请访问主页链接:https://superkoma.github.io/detzero-page

1 引言

为了提高数据标注的效率,我们研究了一种新的方法。这种方法基于深度学习和无监督学习,可以自动生成标注数据。通过使用大量的未标注数据,我们可以训练一个自动驾驶感知模型,使其能够识别和检测道路上的物体。这种方法不仅可以减少标注数据的成本,还可以提高后处理的效率。我们在实验中使用了Waymo的离线3D物体检测方法3DAL[]作为基准进行比较,结果表明我们提出的方法在准确性和效率方面都有显著的改进。我们相信这种方法将在未来的自动驾驶技术中发挥重要作用

- 目标检测(Detection):输入少量连续的点云帧数据,输出每一帧中3D物体的边界框和类别信息;

- 多目标跟踪(Tracking):将每一帧检测到的物体进行关联,形成物体序列,并分配唯一的物体ID;

- 运动状态分类(Motion Classification):基于物体轨迹特征,确定物体的运动状态(静止或运动);

- 物体为中心的优化(Object-centric Refining):根据前一模块预测的运动状态,分别提取静止和运动物体的时序点云特征,以预测准确的边界框。最终,通过姿态矩阵将优化后的3D边界框转移回该物体所在的每一帧坐标系中。

然而,很多主流的在线3D目标检测方法通过利用点云的时序上下文特征,取得了比现有的离线3D检测方法更好的效果。然而,我们意识到这些方法未能有效地利用长序列点云的特征

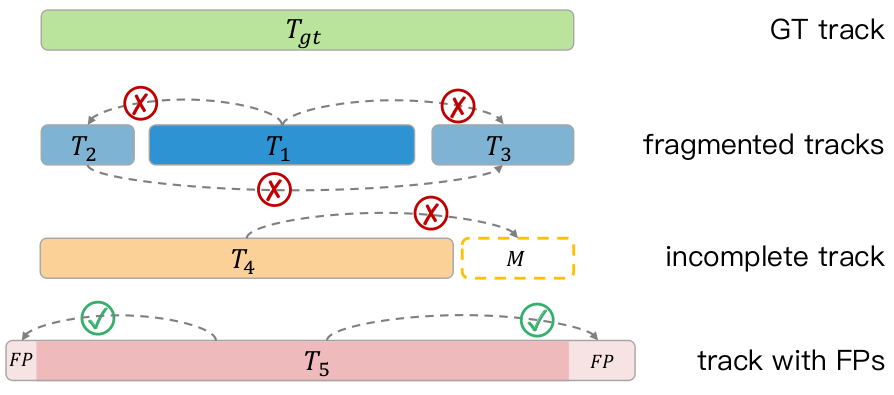

- 目前的目标检测和跟踪算法主要关注边界框层面(box-level)的性能指标,将在线的3D检测算法经过TTA和多模型融合之后所产生的大量冗余框作为跟踪算法的输入,通常很容易引发严重的轨迹分段、ID切换以及错误关联等问题,无法保证连续、完整的物体序列的生成,进而妨碍利用物体对应的长时序点云特征。如下图所示,原本一个物体的轨迹被分割成多个子序列(T1, T2, T3),导致拥有更多信息的T1片段的特征无法共享到T2和T3中;T4片段中经过优化的框也无法召回已经丢失掉的片段;T5片段中经过优化的框在转移到原先是FP的位置后依然是FP。

物体序列的质量会对下游的优化模型产生很大的影响

物体序列的质量会对下游的优化模型产生很大的影响

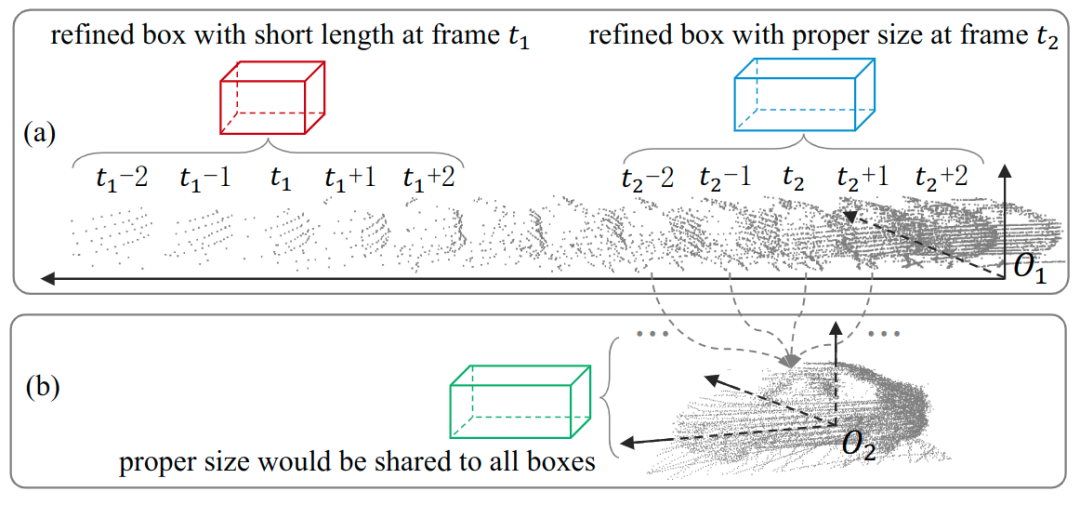

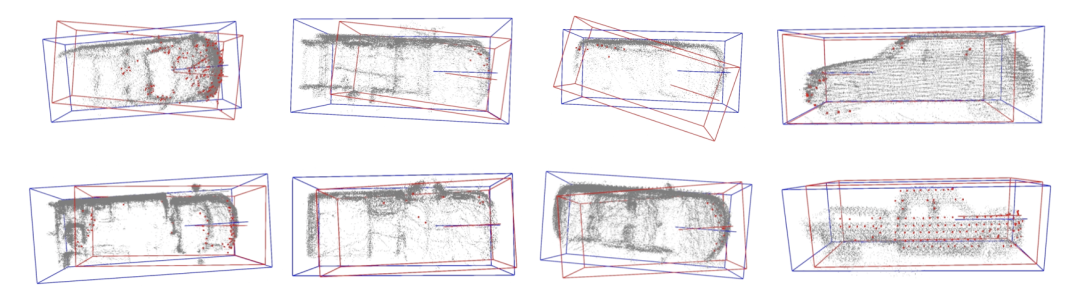

- 基于运动状态分类的优化模型没有充分利用到物体的时序特征。例如,刚性物体的尺寸大小随时间保持一致,通过从不同角度捕捉数据可以实现更准确的尺寸估计;物体的运动轨迹应当遵循一定的运动学约束,表现为轨迹的平滑性。如下图(a)所示,对于动态物体来说,基于滑动窗口的优化机制未考虑物体几何形状的一致性,仅通过邻近几帧的时序点云信息对边界框进行更新,导致预测的几何尺寸出现偏差。而在(b)的例子中,通过把该物体的点云全部聚合在一起,可获得稠密的时序点云特征,为每一帧都预测出边界框的准确的几何尺寸。

基于运动状态的优化模型预测物体的尺寸(a),几何优化模型将不同视角的点云全部聚合后预测物体的尺寸(b)

基于运动状态的优化模型预测物体的尺寸(a),几何优化模型将不同视角的点云全部聚合后预测物体的尺寸(b)

2 方法

本文提出了一个名为DetZero的新离线3D物体检测算法框架。该框架具有以下特点:(1)使用多帧3D检测器和离线跟踪器作为上游模块,以提供准确和完整的物体跟踪,重点关注物体序列的高召回率(track-level recall);(2)下游模块包括基于注意力机制的优化模型,利用长时序点云特征分别学习预测物体的不同属性,包括精细化几何尺寸、平滑运动轨迹位置以及更新置信度分数

2.1 生成完整的物体序列

我们采用公开的CenterPoint[]作为基础检测器,为了提供更多的检测候选框,我们在三个方面进行了加强:(1)将不同帧点云组合作为输入,最大化性能而不降低性能;(2)使用点云密度信息将原始点云特征和体素特征融合为二阶段模块,以优化一阶段的边界结果;(3)使用推理阶段数据增强(TTA)、多模型结果融合(Ensemble)等技术来提高模型对复杂环境的适应能力

离线跟踪模块中引入了两阶段关联策略以减少错误匹配,根据置信度将框分为高分组和低分组,对高分组进行关联更新现有轨迹,未更新的轨迹与低分组关联。同时,物体轨迹的长度可持续至序列终止,避免ID切换问题。此外,我们会反向执行跟踪算法生成另一组轨迹,并通过位置相似性关联,最后用WBF策略融合匹配成功的轨迹,进一步提升序列首尾的完整性。最后,对于区分好的物体序列,提取出其对应的每一帧点云进行保存;而未更新的冗余框和一些较短的序列和会直接合并至最终的输出,无需下游优化。

2.2 基于属性预测的物体优化模块

以前的以物体为中心的优化模型忽略了物体之间在不同运动状态下的相关性,例如几何形状的一致性以及相邻时刻的物体运动状态的一致性。基于这些观察,我们将传统的边界框回归任务分解为三个模块:分别预测物体的几何形状、位置和置信度属性

- 多视角几何交互:通过拼接多个视角的物体点云,可以补全物体的外观和形状。首先进行局部坐标变换,将物体点云与不同位置的局部框对齐,并计算出每个点到边界框6个表面的投影距离,加强边界框的信息表征,随后直接合并不同帧的所有点云作为多视角几何特征的key和value,同时从物体序列中随机选择t个样本作为单视角几何特征的query。几何query会被送入自注意力层来查看彼此之间的差异性,随后被送入交叉注意力层来补充所需要视角的特征,并预测出精确的几何尺寸。

- 局部与全局位置的交互:随机选择物体序列中的任意框作为原点,将所有其他框和对应的物体点云转移到此坐标系下,并计算出每个点到各自边界框中心点和8个角点的距离,作为全局位置特征的key和value。物体序列中的每一个样本都会作为位置query,送入自注意力层来判断当前位置与其他位置的相对距离,随后输入交叉注意力层模拟局部到全局位置的上下文关系,并预测出此坐标系下每个初始中心点与真值中心点之间的偏移量,以及航向角差异。

- 置信度优化:分类分支用于分类该物体是TP还是FP,IoU回归分支预测出一个物体在被几何模型和位置模型优化后,与真值框之间的IoU大小。最终的置信度得分就是这两个分支的几何平均值。

3 实验

3.1 主要性能

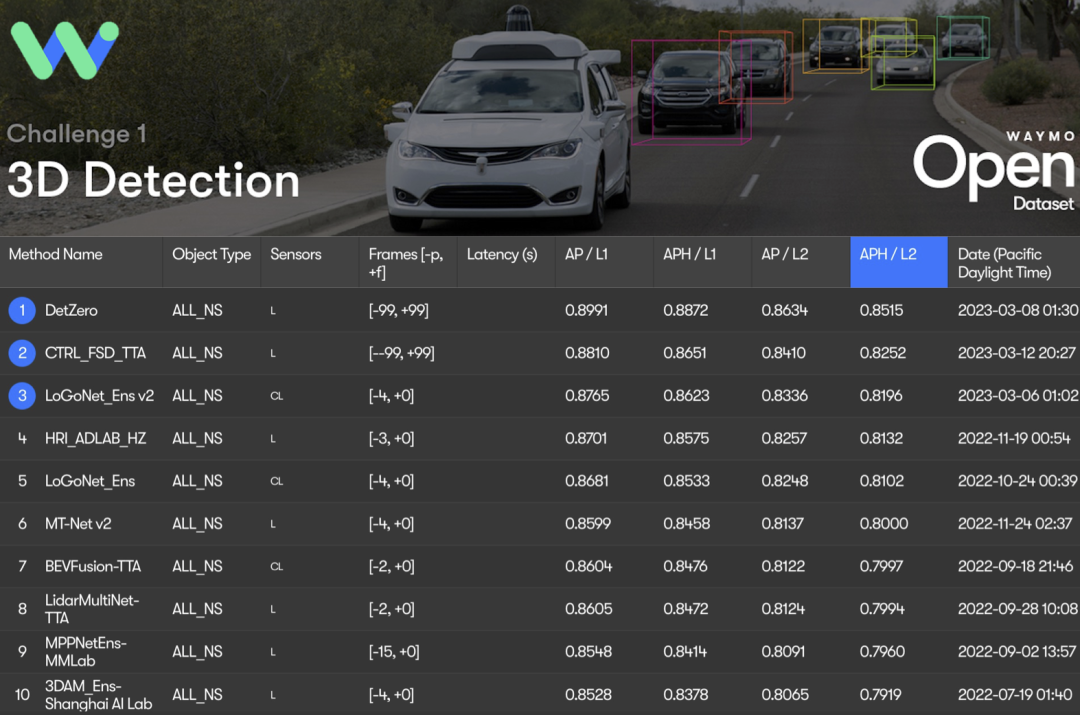

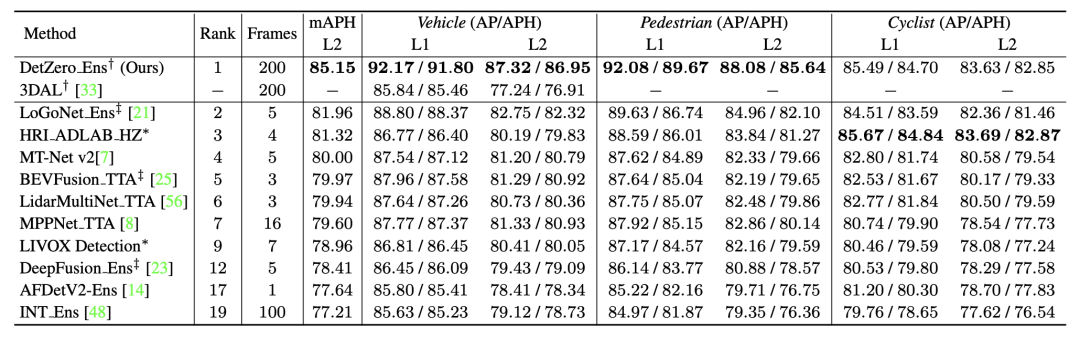

DetZero在Waymo 3D检测排行榜上以85.15 mAPH (L2)取得了最佳成绩,无论是与处理长时序点云的方法相比,还是与最先进的多模态融合3D检测器相比,DetZero都展现出了显著的性能优势

Waymo 3D检测排行榜结果,所有结果均使用TTA或ensemble技术,†指离线模型,‡指点云图像融合模型,*表示匿名提交结果

Waymo 3D检测排行榜结果,所有结果均使用TTA或ensemble技术,†指离线模型,‡指点云图像融合模型,*表示匿名提交结果

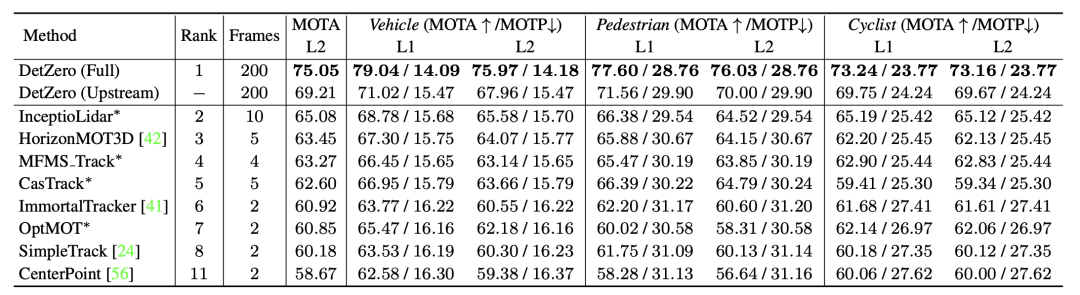

同样,得益于检测框的准确性和物体跟踪序列的完整性,我们以75.05 MOTA(L2)取得了Waymo 3D跟踪排行榜上的性能第一。

Waymo 3D跟踪排行榜,*表示匿名提交结果

Waymo 3D跟踪排行榜,*表示匿名提交结果

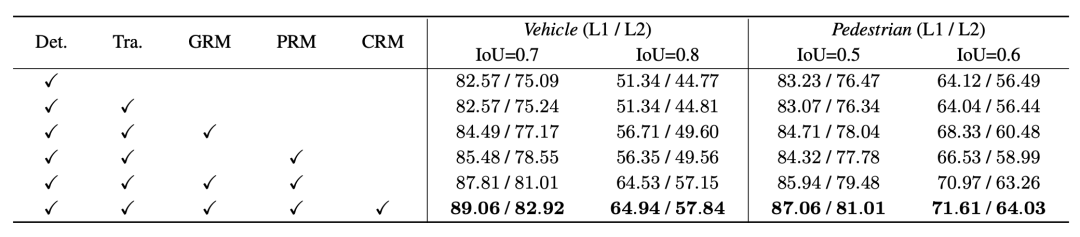

3.2 消融实验

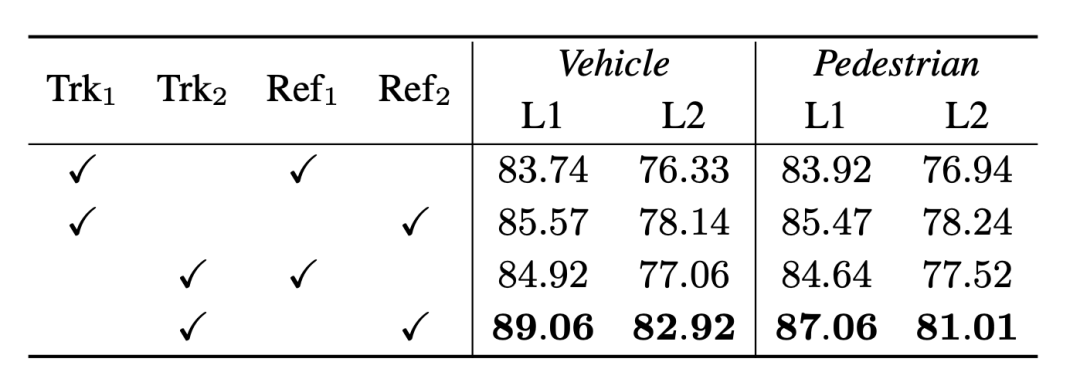

为了更好地验证我们提出的每个模块的作用,我们在Waymo验证集上进行了消融实验,并且采用了更严格的IoU阈值作为衡量标准

在Waymo验证集上对Vehicle和Pedestrian进行,IoU阈值分别选取标准值(0.7 & 0.5)和严格值(0.8 & 0.6)

在Waymo验证集上对Vehicle和Pedestrian进行,IoU阈值分别选取标准值(0.7 & 0.5)和严格值(0.8 & 0.6)

同时,对于同一组检测结果,我们分别选择3DAL中的跟踪器和优化模型与DetZero进行交叉组合验证,结果进一步证明DetZero的跟踪器和优化器性能更好,且二者组合在一起后发挥出更大的优势。

不同上下游模块组合的交叉验证实验,下角标1和2分别代表3DAL和DetZero,指标是3D APH

不同上下游模块组合的交叉验证实验,下角标1和2分别代表3DAL和DetZero,指标是3D APH

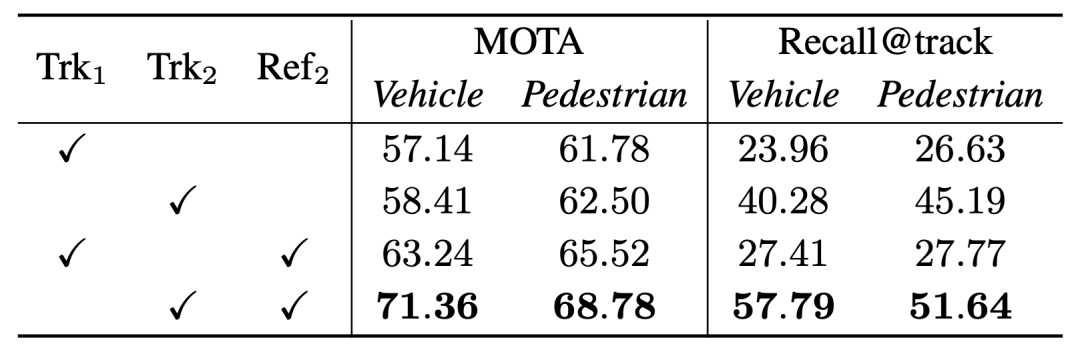

我们的离线追踪器更注重物体序列的完整性,虽然两者的MOTA性能差异很小,但是Recall@track的性能却是导致最终优化性能差异很大的一个原因

离线跟踪器(Trk2)与3DAL跟踪器(Trk1)的性能对比,性能为MOTA和Recall@track

离线跟踪器(Trk2)与3DAL跟踪器(Trk1)的性能对比,性能为MOTA和Recall@track

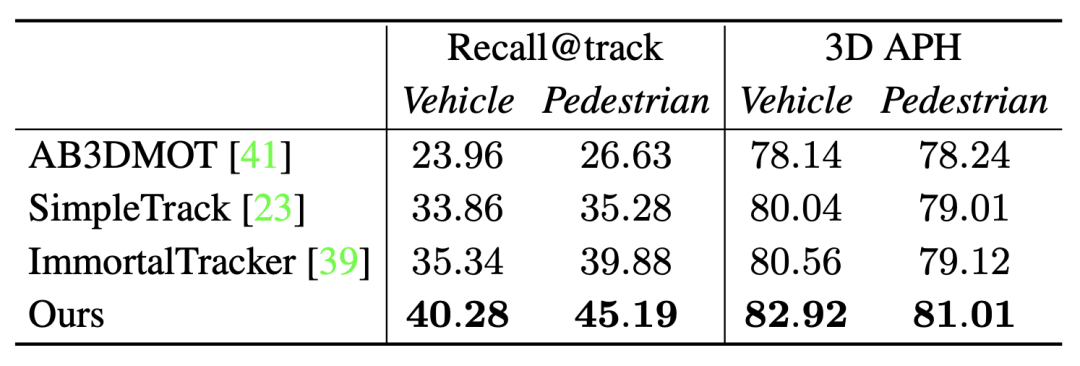

此外,与其他最先进的跟踪器相比,也能证明这一点

Recall@track是经过跟踪算法处理后的序列召回,3D APH是经过同一个优化模型处理后的最终性能

Recall@track是经过跟踪算法处理后的序列召回,3D APH是经过同一个优化模型处理后的最终性能

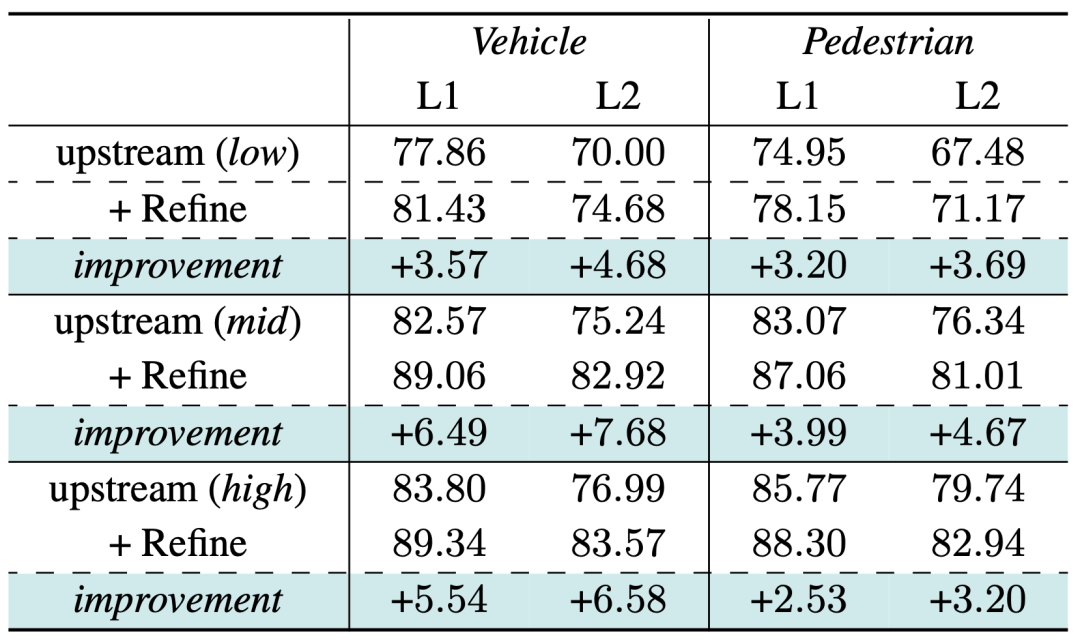

3.3 泛化性能

为了验证我们的优化模型是否能够固定拟合到特定的上游结果集,我们选择了具有不同性能的上游检测跟踪结果作为输入。结果显示,我们取得了明显的性能提升,进一步证明了只要上游模块能够召回更多更完整的物体序列,我们的优化器就能够有效地利用其时序点云的特征进行优化

Waymo验证集上的泛化性能验证,指标是3D APH

Waymo验证集上的泛化性能验证,指标是3D APH

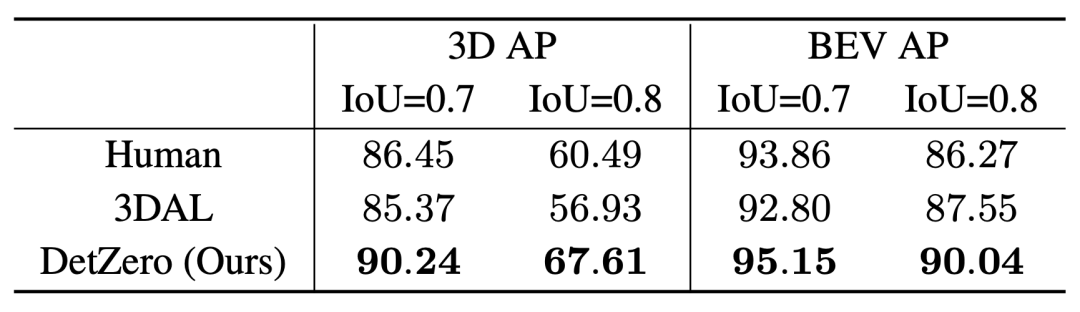

3.4 与人类标注能力进行对比

我们将根据3DAL的实验设置来报告DetZero在5个指定序列上的AP性能,通过比较基于单帧的重标注结果与原始真值标注结果的一致性来衡量人类性能。相对于3DAL和人类,DetZero在不同的性能指标上都表现出了优势

对于Vehicle类别在不同IoU阈值下的3D AP和BEV AP性能对比

对于Vehicle类别在不同IoU阈值下的3D AP和BEV AP性能对比

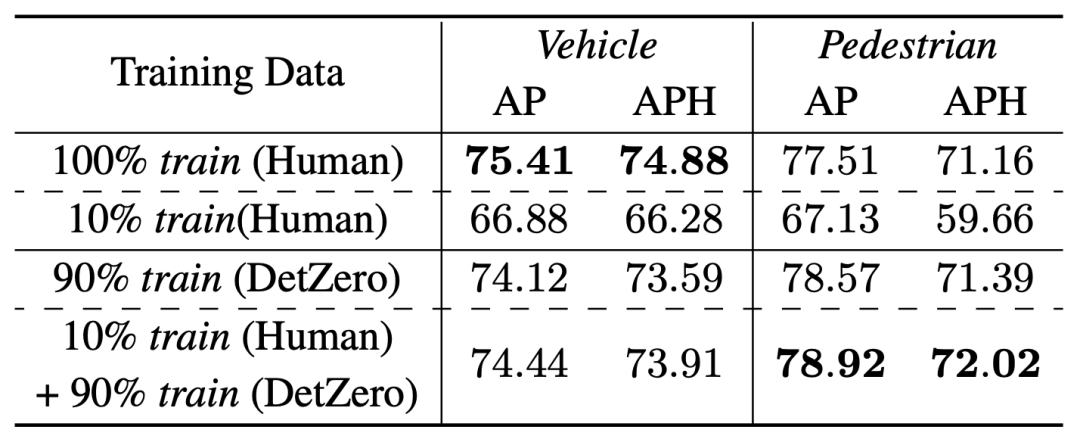

为了验证高质量的自动标注结果是否能够替代人工标注结果进行在线模型训练,我们在Waymo验证集上进行了半监督学习的验证。我们从训练数据中随机选择了10%作为老师模型(DetZero)的训练数据,并对剩下的90%数据进行推理,得到了自动标注的结果,这些结果将作为学生模型的标签。我们选择了单帧CenterPoint作为学生模型。在车辆类别上,使用90%的自动标签和10%的真值标签进行训练的结果接近于使用100%真值标签训练的结果,而在行人类别上,自动标签训练的模型结果已经优于原始结果,这表明自动标签可以用于在线模型训练

在Waymo验证集上进行的半监督实验结果

在Waymo验证集上进行的半监督实验结果

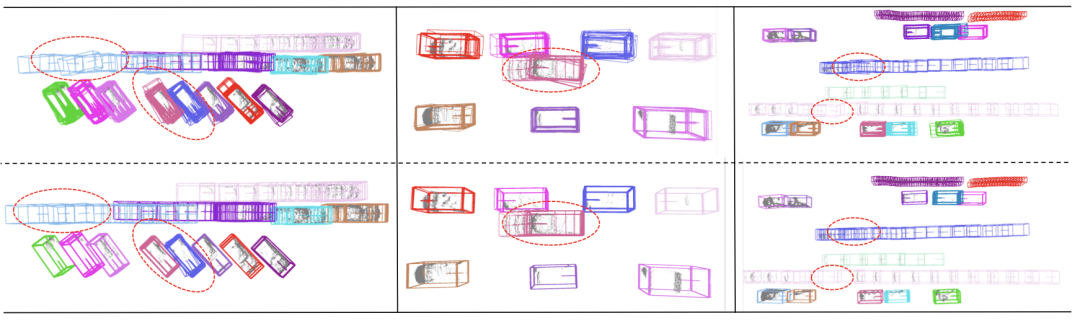

3.5 可视化结果

红色框代表上游的输入结果,蓝色框代表优化模型的输出结果

红色框代表上游的输入结果,蓝色框代表优化模型的输出结果 第一行代表上游的输入结果,第二行代表优化模型的输出结果,虚线内的物体表示优化前后差异明显的位置

第一行代表上游的输入结果,第二行代表优化模型的输出结果,虚线内的物体表示优化前后差异明显的位置

原文链接:https://mp.weixin.qq.com/s/HklBecJfMOUCC8gclo-t7Q

以上是DetZero:Waymo在3D检测榜单上位列第一,与人工标注媲美!的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

自动驾驶场景中的长尾问题怎么解决?

Jun 02, 2024 pm 02:44 PM

自动驾驶场景中的长尾问题怎么解决?

Jun 02, 2024 pm 02:44 PM

昨天面试被问到了是否做过长尾相关的问题,所以就想着简单总结一下。自动驾驶长尾问题是指自动驾驶汽车中的边缘情况,即发生概率较低的可能场景。感知的长尾问题是当前限制单车智能自动驾驶车辆运行设计域的主要原因之一。自动驾驶的底层架构和大部分技术问题已经被解决,剩下的5%的长尾问题,逐渐成了制约自动驾驶发展的关键。这些问题包括各种零碎的场景、极端的情况和无法预测的人类行为。自动驾驶中的边缘场景"长尾"是指自动驾驶汽车(AV)中的边缘情况,边缘情况是发生概率较低的可能场景。这些罕见的事件

CLIP-BEVFormer:显式监督BEVFormer结构,提升长尾检测性能

Mar 26, 2024 pm 12:41 PM

CLIP-BEVFormer:显式监督BEVFormer结构,提升长尾检测性能

Mar 26, 2024 pm 12:41 PM

写在前面&笔者的个人理解目前,在整个自动驾驶系统当中,感知模块扮演了其中至关重要的角色,行驶在道路上的自动驾驶车辆只有通过感知模块获得到准确的感知结果后,才能让自动驾驶系统中的下游规控模块做出及时、正确的判断和行为决策。目前,具备自动驾驶功能的汽车中通常会配备包括环视相机传感器、激光雷达传感器以及毫米波雷达传感器在内的多种数据信息传感器来收集不同模态的信息,用于实现准确的感知任务。基于纯视觉的BEV感知算法因其较低的硬件成本和易于部署的特点,以及其输出结果能便捷地应用于各种下游任务,因此受到工业

自动驾驶与轨迹预测看这一篇就够了!

Feb 28, 2024 pm 07:20 PM

自动驾驶与轨迹预测看这一篇就够了!

Feb 28, 2024 pm 07:20 PM

轨迹预测在自动驾驶中承担着重要的角色,自动驾驶轨迹预测是指通过分析车辆行驶过程中的各种数据,预测车辆未来的行驶轨迹。作为自动驾驶的核心模块,轨迹预测的质量对于下游的规划控制至关重要。轨迹预测任务技术栈丰富,需要熟悉自动驾驶动/静态感知、高精地图、车道线、神经网络架构(CNN&GNN&Transformer)技能等,入门难度很大!很多粉丝期望能够尽快上手轨迹预测,少踩坑,今天就为大家盘点下轨迹预测常见的一些问题和入门学习方法!入门相关知识1.预习的论文有没有切入顺序?A:先看survey,p

使用C++实现机器学习算法:常见挑战及解决方案

Jun 03, 2024 pm 01:25 PM

使用C++实现机器学习算法:常见挑战及解决方案

Jun 03, 2024 pm 01:25 PM

C++中机器学习算法面临的常见挑战包括内存管理、多线程、性能优化和可维护性。解决方案包括使用智能指针、现代线程库、SIMD指令和第三方库,并遵循代码风格指南和使用自动化工具。实践案例展示了如何利用Eigen库实现线性回归算法,有效地管理内存和使用高性能矩阵操作。

聊聊端到端与下一代自动驾驶系统,以及端到端自动驾驶的一些误区?

Apr 15, 2024 pm 04:13 PM

聊聊端到端与下一代自动驾驶系统,以及端到端自动驾驶的一些误区?

Apr 15, 2024 pm 04:13 PM

最近一个月由于众所周知的一些原因,非常密集地和行业内的各种老师同学进行了交流。交流中必不可免的一个话题自然是端到端与火爆的特斯拉FSDV12。想借此机会,整理一下在当下这个时刻的一些想法和观点,供大家参考和讨论。如何定义端到端的自动驾驶系统,应该期望端到端解决什么问题?按照最传统的定义,端到端的系统指的是一套系统,输入传感器的原始信息,直接输出任务关心的变量。例如,在图像识别中,CNN相对于传统的特征提取器+分类器的方法就可以称之为端到端。在自动驾驶任务中,输入各种传感器的数据(相机/LiDAR

nuScenes最新SOTA | SparseAD:稀疏查询助力高效端到端自动驾驶!

Apr 17, 2024 pm 06:22 PM

nuScenes最新SOTA | SparseAD:稀疏查询助力高效端到端自动驾驶!

Apr 17, 2024 pm 06:22 PM

写在前面&出发点端到端的范式使用统一的框架在自动驾驶系统中实现多任务。尽管这种范式具有简单性和清晰性,但端到端的自动驾驶方法在子任务上的性能仍然远远落后于单任务方法。同时,先前端到端方法中广泛使用的密集鸟瞰图(BEV)特征使得扩展到更多模态或任务变得困难。这里提出了一种稀疏查找为中心的端到端自动驾驶范式(SparseAD),其中稀疏查找完全代表整个驾驶场景,包括空间、时间和任务,无需任何密集的BEV表示。具体来说,设计了一个统一的稀疏架构,用于包括检测、跟踪和在线地图绘制在内的任务感知。此外,重

FisheyeDetNet:首个基于鱼眼相机的目标检测算法

Apr 26, 2024 am 11:37 AM

FisheyeDetNet:首个基于鱼眼相机的目标检测算法

Apr 26, 2024 am 11:37 AM

目标检测在自动驾驶系统当中是一个比较成熟的问题,其中行人检测是最早得以部署算法之一。在多数论文当中已经进行了非常全面的研究。然而,利用鱼眼相机进行环视的距离感知相对来说研究较少。由于径向畸变大,标准的边界框表示在鱼眼相机当中很难实施。为了缓解上述描述,我们探索了扩展边界框、椭圆、通用多边形设计为极坐标/角度表示,并定义一个实例分割mIOU度量来分析这些表示。所提出的具有多边形形状的模型fisheyeDetNet优于其他模型,并同时在用于自动驾驶的Valeo鱼眼相机数据集上实现了49.5%的mAP

探究C++sort函数的底层原理与算法选择

Apr 02, 2024 pm 05:36 PM

探究C++sort函数的底层原理与算法选择

Apr 02, 2024 pm 05:36 PM

C++sort函数底层采用归并排序,其复杂度为O(nlogn),并提供不同的排序算法选择,包括快速排序、堆排序和稳定排序。