AI应用下一个热门应用已经出现:阿里巴巴和字节跳动悄悄上线了一款类似神器,可以让梅西跳舞轻而易举

AI视频生成神器再次登场。最近,阿里巴巴和字节跳动秘密上线了各自的工具

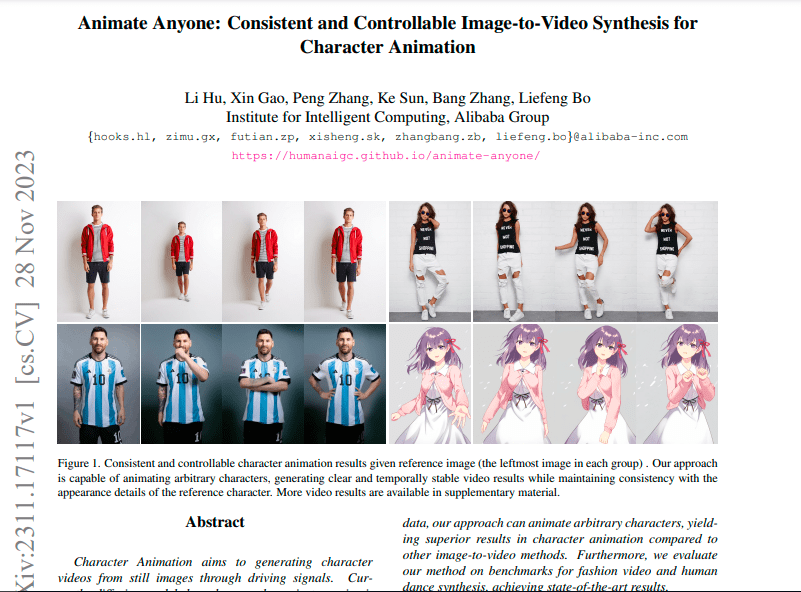

阿里推出了Animate Anyone,该项目由阿里巴巴智能计算研究院开发,你只需提供一个静态的角色图像(包括真人、动漫/卡通角色等)和一些动作、姿势(比如跳舞、走路),便可将其动画化,同时保留角色的细节特征(如面部表情、服装细节等)。

只要有一张梅西的照片,就能让“球王”摆各种Pose(见下图),按照这一原理,让梅西跳舞也不在话下。

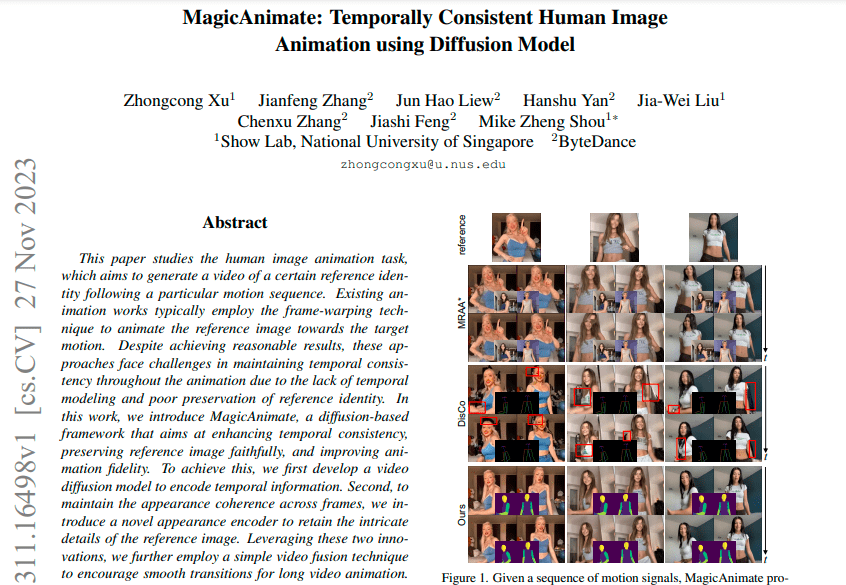

新加坡国立大学和字节跳动则联合推出了Magic Animate,同样是利用AI技术,将静态图像变成动态视频。字节方面表示,在挑战性极高的TikTok舞蹈数据集上,Magic Animate生成的视频的真实度比最强基线提高了超过38%。

在图生视频项目中,阿里巴巴和字节跳动齐头并进,几乎同时完成了论文发布、代码公开和测试地址公开等一系列操作,两者的相关论文发布时间仅相差一天

11月27日发布了有关字节的相关论文:

阿里相关的论文将于11月28日发布:

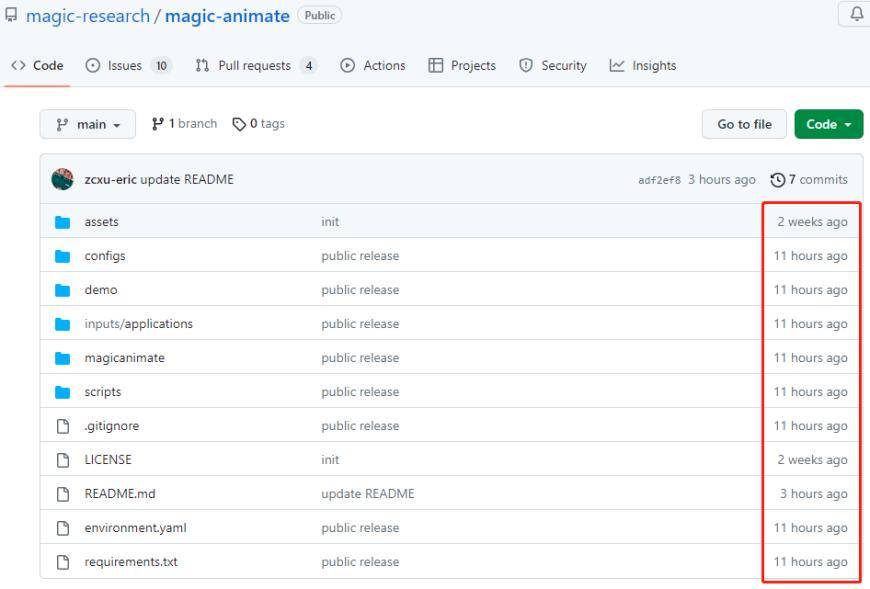

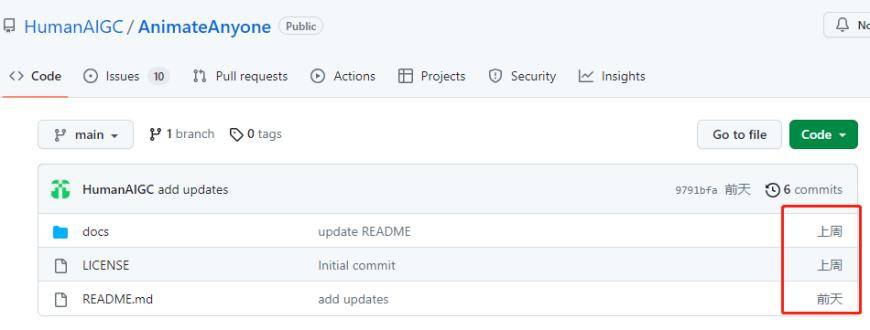

两家公司的开源文件在Github上持续更新

需要重写的内容是:Magic Animate的开源项目文件包

Animate Anyone的开源项目文件包

这再次点出一个事实:视频生成是AIGC热门竞技项目,科技巨头、明星公司均密切关注并积极投入。据了解,Runway、Meta、Stable AI已经推出AI文生视频应用,Adobe也在近日宣布收购AI视频创作公司Rephrase.ai。

从上述两家公司的展示视频来看,生成效果有了十分显著的提升,流畅度、真实感更胜以往。一改当下图像/视频生成应用存在的缺点,如局部扭曲、细节模糊、不符合提示词、与原图有差别、掉帧、画面抖动。

这两个工具都是通过扩散模型(diffusion models)创造时间连贯的人像动画,其训练数据很多是一样的。两者都用到的Stable Diffusion是由CompVis、Stability AI和LAION的研究人员和工程师创建的文本到图像的潜在扩散模型,该模型使用来自LAION-5B数据库子集的 512x512图像进行训练。LAION-5B是目前存在的最大的、可免费访问的多模式数据集。

谈及应用,阿里的研究人员在论文中表示,Animate Anybody作为基础方法,未来有可能扩展到各种图生视频应用,该工具有许多潜在的应用场景,例如在线零售、娱乐视频、艺术创作和虚拟角色。字节跳动也强调Magic Animate展示了强大的泛化能力,可以应用到多个场景。

多模态应用的“圣杯”:文生视频 文生视频是指通过结合文本和语音的技术,实现对视频内容进行多模态分析和处理的应用。它将文本和语音信息与视频图像进行关联,从而提供更丰富的视频理解和交互体验。 文生视频应用具有广泛的应用领域,包括智能视频监控、虚拟现实、视频编辑和内容分析等。通过文本和语音的分析,文生视频可以识别和理解视频中的对象、场景和动作,从而为用户提供更智能化的视频处理和控制功能。 在智能视频监控领域,文生视频可以实现对监控视频内容的自动标注和分类,从而提高监控效率和准确性。在虚拟现实领域,文生视频可以将用户的语音指令与虚拟环境进行交互,实现更沉浸式的虚拟体验。在视频编辑和内容分析领域,文生视频可以帮助用户自动提取视频中的关键信息,并进行智能编辑和剪辑。 总之,文生视频作为多模态应用的“圣杯”,为视频内容的理解和交互提供了更全面和智能化的解决方案。它的发展将为各个领域带来更多的创新和便利,推动科技进步和社会发展

视频比文字和图片更具优势,它能够更好地表达信息,丰富画面,并具有动态性。视频可以将文本、图像、声音和视觉效果相结合,融合多种信息形式在一个媒体中呈现

AI视频工具具备强大的产品功能,可以开拓更广阔的应用场景。通过简单的文本描述或其他操作,AI视频工具能够生成高质量和完整度的视频内容,从而降低了视频创作的门槛。这使得非专业人士也能够通过视频准确展示内容,有望在各个细分行业中提高内容生产的效率并输出更多创意

国盛证券宋嘉吉此前指出,AI文生视频是多模态应用的下一站,是多模态AIGC“圣杯”,随着AI视频补齐了AI创作多模态的最后一块拼图,下游应用的加速时刻也将到来;申港证券表示,视频AI是多模态领域的最后一环;华泰证券表示,AIGC大潮已逐步从文生文和文生图转向文生视频领域,文生视频的高计算难度和高数据要求将支撑上游AI算力需求持续旺盛。

不过,大公司之间、大公司与初创企业间的差距不算大,甚至可以说处于同一起跑线。当前文生视频可公测应用较少,仅有Runway Gen-2、Zero Scope及Pika等少数几个。即便如Meta和谷歌这样的硅谷人工智能巨头,在文生视频上同样进展缓慢,它们分别推出的Make-A-Video和Phenaki均尚未公测。

从技术方面来看,视频生成工具的底层模型和技术仍在不断优化。目前主流的文生视频模型主要使用Transformer模型和扩散模型。扩散模型的工具主要致力于提升视频质量,克服了效果粗糙、缺少细节的问题。不过,这些视频的时长都在4秒以内

另一方面,尽管扩散模型效果出色,但其训练过程需要大量的内存和算力,这使得只有大公司和获得大量投资的初创企业才能承担得起模型训练的成本

来源:科创板日报

以上是AI应用下一个热门应用已经出现:阿里巴巴和字节跳动悄悄上线了一款类似神器,可以让梅西跳舞轻而易举的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

我尝试了使用光标AI编码的Vibe编码,这太神奇了!

Mar 20, 2025 pm 03:34 PM

我尝试了使用光标AI编码的Vibe编码,这太神奇了!

Mar 20, 2025 pm 03:34 PM

Vibe编码通过让我们使用自然语言而不是无尽的代码行创建应用程序来重塑软件开发的世界。受Andrej Karpathy等有远见的人的启发,这种创新的方法使Dev

如何使用DALL-E 3:技巧,示例和功能

Mar 09, 2025 pm 01:00 PM

如何使用DALL-E 3:技巧,示例和功能

Mar 09, 2025 pm 01:00 PM

DALL-E 3:生成的AI图像创建工具 Generative AI正在彻底改变内容的创建,而Openai最新的图像生成模型Dall-E 3处于最前沿。它于2023年10月发行,建立在其前任Dall-E和Dall-E 2上

2025年2月的Genai推出前5名:GPT-4.5,Grok-3等!

Mar 22, 2025 am 10:58 AM

2025年2月的Genai推出前5名:GPT-4.5,Grok-3等!

Mar 22, 2025 am 10:58 AM

2025年2月,Generative AI又是一个改变游戏规则的月份,为我们带来了一些最令人期待的模型升级和开创性的新功能。从Xai的Grok 3和Anthropic的Claude 3.7十四行诗到Openai的G

如何使用Yolo V12进行对象检测?

Mar 22, 2025 am 11:07 AM

如何使用Yolo V12进行对象检测?

Mar 22, 2025 am 11:07 AM

Yolo(您只看一次)一直是领先的实时对象检测框架,每次迭代都在以前的版本上改善。最新版本Yolo V12引入了进步,可显着提高准确性

Elon Musk&Sam Altman冲突超过5000亿美元的星际之门项目

Mar 08, 2025 am 11:15 AM

Elon Musk&Sam Altman冲突超过5000亿美元的星际之门项目

Mar 08, 2025 am 11:15 AM

这项耗资5000亿美元的星际之门AI项目由OpenAI,Softbank,Oracle和Nvidia等科技巨头支持,并得到美国政府的支持,旨在巩固美国AI的领导力。 这项雄心勃勃

Sora vs veo 2:哪个创建更现实的视频?

Mar 10, 2025 pm 12:22 PM

Sora vs veo 2:哪个创建更现实的视频?

Mar 10, 2025 pm 12:22 PM

Google的VEO 2和Openai的Sora:哪个AI视频发电机占据了至尊? 这两个平台都产生了令人印象深刻的AI视频,但它们的优势在于不同的领域。 使用各种提示,这种比较揭示了哪种工具最适合您的需求。 t

Google的Gencast:Gencast Mini Demo的天气预报

Mar 16, 2025 pm 01:46 PM

Google的Gencast:Gencast Mini Demo的天气预报

Mar 16, 2025 pm 01:46 PM

Google DeepMind的Gencast:天气预报的革命性AI 天气预报经历了巨大的转变,从基本观察到复杂的AI驱动预测。 Google DeepMind的Gencast,开创性

哪个AI比Chatgpt更好?

Mar 18, 2025 pm 06:05 PM

哪个AI比Chatgpt更好?

Mar 18, 2025 pm 06:05 PM

本文讨论了AI模型超过Chatgpt,例如Lamda,Llama和Grok,突出了它们在准确性,理解和行业影响方面的优势。(159个字符)