开源大模型必须超越闭源——LeCun揭示2024年AI趋势图

2023 年即将过去。一年以来,各式各样的大模型争相发布。当 OpenAI 和谷歌等科技巨头正在角逐时,另一方「势力」悄然崛起 —— 开源。

开源模型受到的质疑一向不少。它们是否能像专有模型一样优秀?是否能够媲美专有模型的性能?迄今为止,我们一直还只能说是某些方面接近。即便如此,开源模型总会给我们带来经验的表现,让我们刮目相看。

开源模型的兴起正在改变游戏规则。如 Meta 的 LLaMA 系列以其快速迭代、可定制性和隐私性正受到追捧。这些模型被社区迅速发展,给专有模型带来了强有力的挑战,能够改变大型科技公司的竞争格局。

不过此前人们的想法大多只是来自于「感觉」。今天早上,Meta 首席 AI 科学家、图灵奖获得者 Yann LeCun 突然发出了这样的感叹:「开源人工智能模型正走在超越专有模型的路上。」

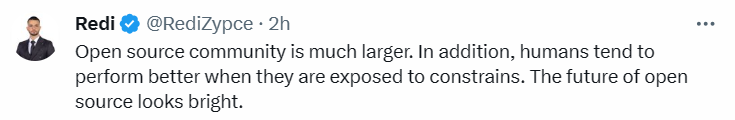

这个由方舟投资(ARK Invest)团队制作的趋势图被认为可能预测了2024年的人工智能发展。它展示了开源社区与专有模型在生成式人工智能方面的发展

随着OpenAI和Google等公司变得越来越封闭,他们公开最新模型信息的频率越来越少。因此,开源社区及其企业支持者Meta开始步入其后,使得生成式AI更加民主化,这或许会对专有模型的商业模式构成挑战

在这个散点图中显示了各种 AI 模型的性能百分比。专有模型用蓝色表示,开源模型用黑色表示。我们可以看到不同的 AI 模型如 GPT-3、Chinchilla 70B(谷歌)、PaLM(谷歌)、GPT-4(OpenAI)和 Llama65B(Meta)等在不同时间点的性能。

Meta 最初发布 LLaMA 时,参数量从 70 亿到 650 亿不等。这些模型的性能非常优异:具有 130 亿参数的 Llama 模型「在大多数基准上」可以胜过 GPT-3( 参数量达 1750 亿),而且可以在单块 V100 GPU 上运行;而最大的 650 亿参数的 Llama 模型可以媲美谷歌的 Chinchilla-70B 和 PaLM-540B。

Falcon-40B 刚发布就冲上了 Huggingface 的 OpenLLM 排行榜首位,改变了 Llama 一枝独秀的场面。

Llama 2 开源,再一次使大模型格局发生巨变。相比于 Llama 1,Llama 2 的训练数据多了 40%,上下文长度也翻倍,并采用了分组查询注意力机制。

最近,开源大模型宇宙又有了新的重量级成员 ——Yi 模型。它能一次处理 40 万汉字、中英均霸榜。Yi-34B 也成为迄今为止唯一成功登顶 Hugging Face 开源模型排行榜的国产模型。

根据散点图所示,开源模型的性能不断追赶专有模型。这意味着在不久的将来,开源模型有望与专有模型在性能上并驾齐驱,甚至超越

Mistral 8x7B在上周末以最朴素的发布方式和强大的性能引起了研究者的高度评价,他们表示「闭源大模型走到结局了。」

已经有网友开始预祝「2024年成为开源人工智能年」,认为「我们正在接近一个临界点。考虑到当前开源社区项目的发展速度,我们预计未来12个月内将达到GPT-4的水平。」

接下来,我们将拭目以待开源模型的未来是否一帆风顺,以及它将展现出怎样的表现

以上是开源大模型必须超越闭源——LeCun揭示2024年AI趋势图的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

centos关机命令行

Apr 14, 2025 pm 09:12 PM

centos关机命令行

Apr 14, 2025 pm 09:12 PM

CentOS 关机命令为 shutdown,语法为 shutdown [选项] 时间 [信息]。选项包括:-h 立即停止系统;-P 关机后关电源;-r 重新启动;-t 等待时间。时间可指定为立即 (now)、分钟数 ( minutes) 或特定时间 (hh:mm)。可添加信息在系统消息中显示。

CentOS上GitLab的备份方法有哪些

Apr 14, 2025 pm 05:33 PM

CentOS上GitLab的备份方法有哪些

Apr 14, 2025 pm 05:33 PM

CentOS系统下GitLab的备份与恢复策略为了保障数据安全和可恢复性,CentOS上的GitLab提供了多种备份方法。本文将详细介绍几种常见的备份方法、配置参数以及恢复流程,帮助您建立完善的GitLab备份与恢复策略。一、手动备份利用gitlab-rakegitlab:backup:create命令即可执行手动备份。此命令会备份GitLab仓库、数据库、用户、用户组、密钥和权限等关键信息。默认备份文件存储于/var/opt/gitlab/backups目录,您可通过修改/etc/gitlab

如何检查CentOS HDFS配置

Apr 14, 2025 pm 07:21 PM

如何检查CentOS HDFS配置

Apr 14, 2025 pm 07:21 PM

检查CentOS系统中HDFS配置的完整指南本文将指导您如何有效地检查CentOS系统上HDFS的配置和运行状态。以下步骤将帮助您全面了解HDFS的设置和运行情况。验证Hadoop环境变量:首先,确认Hadoop环境变量已正确设置。在终端执行以下命令,验证Hadoop是否已正确安装并配置:hadoopversion检查HDFS配置文件:HDFS的核心配置文件位于/etc/hadoop/conf/目录下,其中core-site.xml和hdfs-site.xml至关重要。使用

CentOS上PyTorch的GPU支持情况如何

Apr 14, 2025 pm 06:48 PM

CentOS上PyTorch的GPU支持情况如何

Apr 14, 2025 pm 06:48 PM

在CentOS系统上启用PyTorchGPU加速,需要安装CUDA、cuDNN以及PyTorch的GPU版本。以下步骤将引导您完成这一过程:CUDA和cuDNN安装确定CUDA版本兼容性:使用nvidia-smi命令查看您的NVIDIA显卡支持的CUDA版本。例如,您的MX450显卡可能支持CUDA11.1或更高版本。下载并安装CUDAToolkit:访问NVIDIACUDAToolkit官网,根据您显卡支持的最高CUDA版本下载并安装相应的版本。安装cuDNN库:前

centos安装mysql

Apr 14, 2025 pm 08:09 PM

centos安装mysql

Apr 14, 2025 pm 08:09 PM

在 CentOS 上安装 MySQL 涉及以下步骤:添加合适的 MySQL yum 源。执行 yum install mysql-server 命令以安装 MySQL 服务器。使用 mysql_secure_installation 命令进行安全设置,例如设置 root 用户密码。根据需要自定义 MySQL 配置文件。调整 MySQL 参数和优化数据库以提升性能。

docker原理详解

Apr 14, 2025 pm 11:57 PM

docker原理详解

Apr 14, 2025 pm 11:57 PM

Docker利用Linux内核特性,提供高效、隔离的应用运行环境。其工作原理如下:1. 镜像作为只读模板,包含运行应用所需的一切;2. 联合文件系统(UnionFS)层叠多个文件系统,只存储差异部分,节省空间并加快速度;3. 守护进程管理镜像和容器,客户端用于交互;4. Namespaces和cgroups实现容器隔离和资源限制;5. 多种网络模式支持容器互联。理解这些核心概念,才能更好地利用Docker。

centos8重启ssh

Apr 14, 2025 pm 09:00 PM

centos8重启ssh

Apr 14, 2025 pm 09:00 PM

重启 SSH 服务的命令为:systemctl restart sshd。步骤详解:1. 访问终端并连接到服务器;2. 输入命令:systemctl restart sshd;3. 验证服务状态:systemctl status sshd。

CentOS上PyTorch的分布式训练如何操作

Apr 14, 2025 pm 06:36 PM

CentOS上PyTorch的分布式训练如何操作

Apr 14, 2025 pm 06:36 PM

在CentOS系统上进行PyTorch分布式训练,需要按照以下步骤操作:PyTorch安装:前提是CentOS系统已安装Python和pip。根据您的CUDA版本,从PyTorch官网获取合适的安装命令。对于仅需CPU的训练,可以使用以下命令:pipinstalltorchtorchvisiontorchaudio如需GPU支持,请确保已安装对应版本的CUDA和cuDNN,并使用相应的PyTorch版本进行安装。分布式环境配置:分布式训练通常需要多台机器或单机多GPU。所