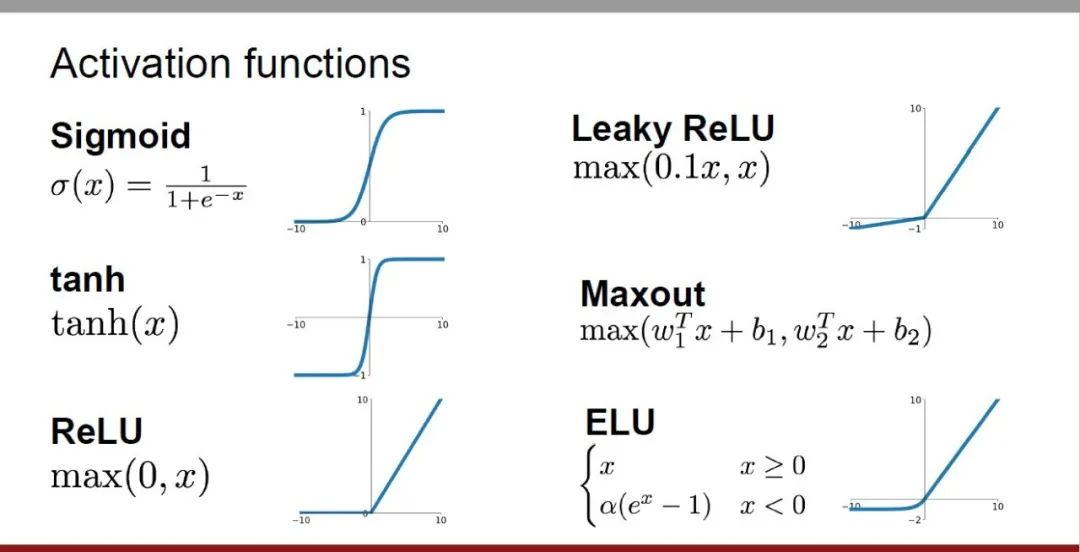

激活函数在深度学习中扮演着至关重要的角色,它们能够为神经网络引入非线性特性,使得网络能够更好地学习和模拟复杂的输入输出关系。正确选择和使用激活函数对于神经网络的性能和训练效果有着重要的影响

本文将介绍四种常用的激活函数:Sigmoid、Tanh、ReLU和Softmax,从简介、使用场景、优点、缺点和优化方案五个维度进行探讨,为您提供关于激活函数的全面理解。

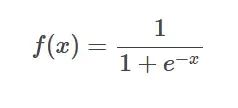

SIgmoid函数公式

SIgmoid函数公式

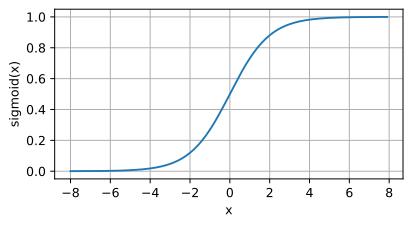

简介:Sigmoid函数是一种常用的非线性函数,可以将任何实数映射到0到1之间。它通常用于将不归一化的预测值转换为概率分布。

SIgmoid函数图像

SIgmoid函数图像

应用场景:

以下是优点:

缺点:在输入值非常大时,梯度可能会变得非常小,导致梯度消失问题。

优化方案:

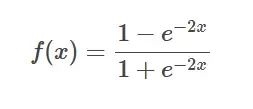

Tanh函数公式

Tanh函数公式

简介:Tanh函数是Sigmoid函数的双曲版本,它将任何实数映射到-1到1之间。

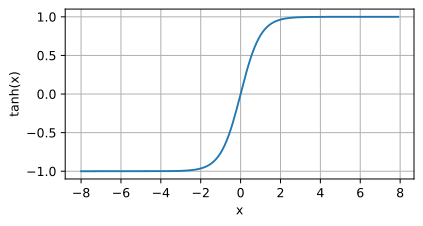

Tanh函数图像

Tanh函数图像

应用场景:当需要一个比Sigmoid更陡峭的函数,或者在某些需要-1到1范围输出的特定应用中。

以下是优点:提供了更大的动态范围和更陡峭的曲线,可以加快收敛速度

Tanh函数的缺点在于,当输入接近于±1时,其导数迅速接近于0,导致梯度消失的问题

优化方案:

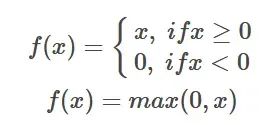

ReLU函数公式

ReLU函数公式

简介:ReLU激活函数是一种简单的非线性函数,其数学表达式为f(x) = max(0, x)。当输入值大于0时,ReLU函数输出该值;当输入值小于或等于0时,ReLU函数输出0。

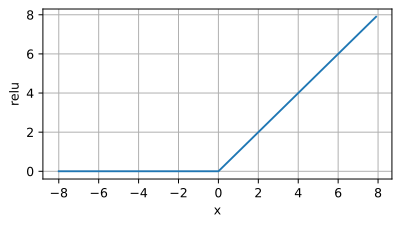

ReLU函数图像

ReLU函数图像

应用场景:ReLU激活函数广泛应用于深度学习模型中,尤其在卷积神经网络(CNN)中。它的主要优点是计算简单、能有效缓解梯度消失问题,并能够加速模型的训练。因此,在训练深度神经网络时,ReLU常常作为首选的激活函数。

以下是优点:

缺点:

优化方案:

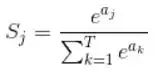

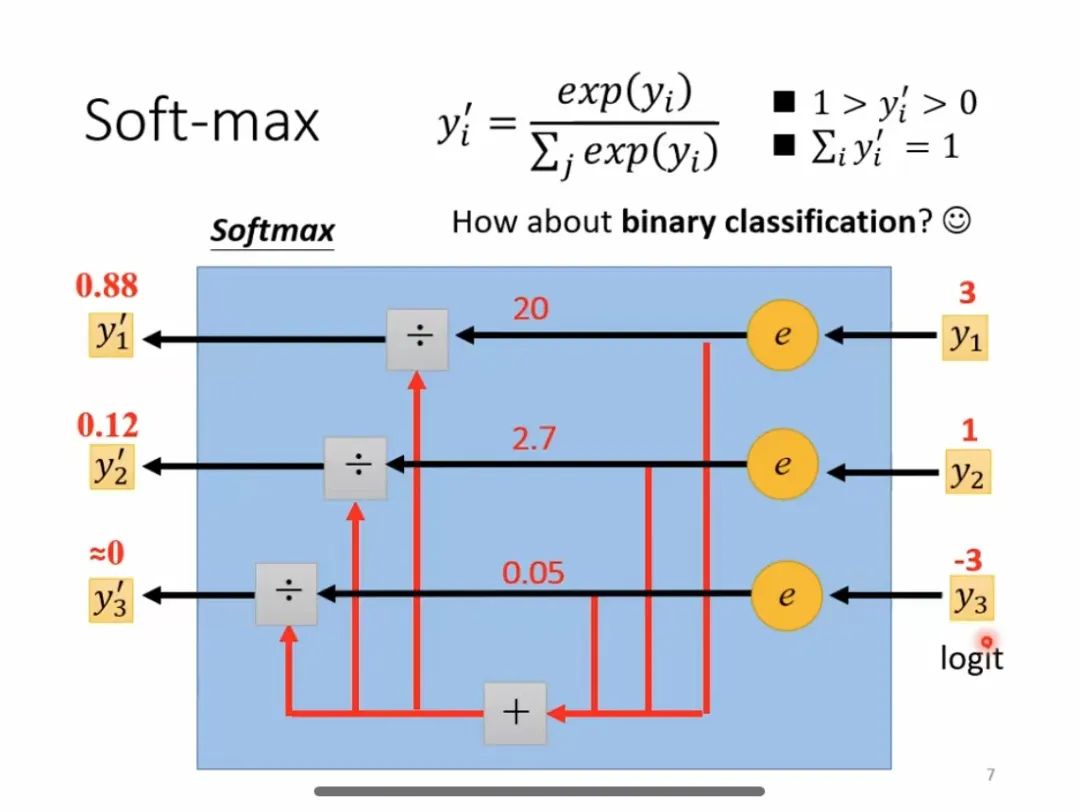

Softmax函数公式

Softmax函数公式

简介:Softmax是一种常用的激活函数,主要用于多分类问题中,可以将输入的神经元转化为概率分布。它的主要特点是输出值范围在0-1之间,且所有输出值的总和为1。

Softmax计算过程

Softmax计算过程

应用场景:

以下是优点:在多分类问题中,能够为每个类别提供一个相对的概率值,方便后续的决策和分类。

缺点:会出现梯度消失或梯度爆炸问题。

优化方案:

以上是常用的AI激活函数解析:Sigmoid、Tanh、ReLU和Softmax的深度学习实践的详细内容。更多信息请关注PHP中文网其他相关文章!