云天励飞五年连续巨亏20亿元!AI芯片投资冒险狂赌

在大模型兴起之前,人工智能的1.0时代出现了文本识别、语音识别和图像识别这三大杀手级应用。2015年,总部位于深圳的云天励飞推出了名为“云天深目”的系统,成为全球首个动态人像识别系统。几年来,“云天深目”在AI+安防领域得到广泛应用,成功协助公安机关破获了数万起案件

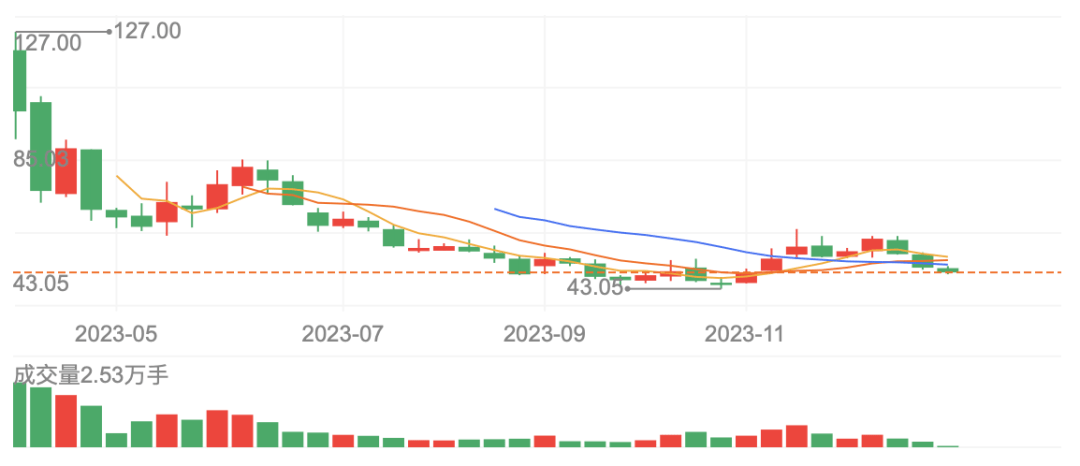

2023年4月,云天励飞登陆科创板,以每股121元的高价报出,在集合竞价中,较发行价上涨了175.5%,市值超过400亿元,与“AI四小龙”之一的云从科技相媲美。上市后,云天励飞发布了一份惨淡的年报,导致股价一路下跌,较最高点下降了60%

进入人工智能2.0,云天励飞动作连连,一边推出AI推理芯片DeepEdge10,一边又发布千亿参数级的“天书”大模型,启动一场技术转型。面对巨无霸级的竞争对手,年营收仅为5亿元的云天励飞,如何突围?

五年亏20亿元,一张失血的报表

在国内的AI公司中,亏损已经成为常态,而不亏损才是例外情况

2019-2022年,云天励飞分别实现营收2.3亿元、4.3亿元、5.7亿元、5.5亿元,对应的净利润分别为-5.1亿元、-4.0亿元、-3.9亿元、-4.5亿元,经营活动产生的现金流净额分别为-1.9亿元、-2.4亿元、-1.8亿元、-2.0亿元。

2023年前三季度,云天励飞的营收达到2.3亿元,同比下降11.4%;净利润为-3.0亿元,同比增长11.8%。不到五年的时间里,云天励飞遭遇了巨额亏损,达到20亿元,而自2022年以来,其营收一直陷入负增长的困境

巨亏的主要原因之一是研发费用居高不下。从2019年到2022年,研发费用分别为2.0亿元、2.2亿元、3.0亿元、3.5亿元,呈逐年递增的趋势。值得注意的是,尽管公司投入了大量的研发资金,但却没有带来毛利率的增长,相反,毛利率逐年下降。2019年到2022年,毛利率分别为43.6%、35.6%、38.8%、31.9%。到2023年前三季度,毛利率略有上升,为32.5%

对于云天励飞联合创始人、董事长兼CEO陈宁来说,平衡“失血”的财务报表无疑是一项巨大的挑战

技术路线之争,创始人分道扬镳

技术方面,云天励飞打造AI算法、AI芯片、大数据处理三大技术平台,其中,巨资投入AI芯片、推进算法芯片化,为主打特色。

云天励飞成立于2014年,创始人有两位,一位是陈宁,持股70%;一位是田第鸿,持股30%。陈、田二人均毕业于美国佐治亚理工学院,获博士学位。毕业后,陈宁先在美国飞思卡尔半导体公司工作,后又在中兴通讯担任IC技术总监。云天励飞成立后,陈、田二人一个“主外”负责销售,一个“主内”负责研发,终于凭借“云天深目”的成功存活下来。

然而,陈、田二人在未来技术方向上存在巨大的分歧。作为长期在IC行业工作的陈宁认为芯片应该优先于算法,而田第鸿则持相反观点,认为算法应该优先于芯片。这场技术争论的结果是,在云天励飞递交招股书之时,田第鸿清空了自己的股权并退出了公司,套现不足3500万元。云天励飞上市后,陈宁持有约25%的股份,市值一度超过百亿元

在田第鸿退出后,云天励飞加大了投资力度,推进了算法芯片化的进程,希望通过将算法与芯片相结合,实现对AI技术的优化。在陈宁的领导下,云天励飞相继完成了三代指令集架构和四代神经网络处理器的研发,试图建立起一道技术壁垒

人脸识别红海竞争,商汤一马当先

在算法芯片基础上,云天励飞组合硬件,形成行业解决方案,启动商业化。AI+安防,是第一个突破口。这之后,云天励飞又针对城市交通场景推出特种车辆监管、交通事件智能预测、城市基层治理等应用。招股书显示,来自数字城市运营管理板块的收入占比八成以上。

2020年,云天励飞发布了“1+1+N”自进化城市智能体战略,旨在为数字城市构建智能且广泛感知的网络,以及一个自学习、自进化的城市超级大脑,同时为智慧应用赋予多个人工智能。然而,该战略也面临两大挑战,一是人脸识别管控政策越来越严格,二是人工智能与产业的深度融合

商业模式上存在一个隐忧,即数字政府带来的收入来源过于单一。此外,以项目制为主的工程式交付导致订单储备不足,毛利率不断下降。更重要的是,人脸识别技术早已成为一项老技术,各个厂商都争相进入市场,竞争激烈。根据IDC的数据显示,国内计算机视觉行业前五强分别是商汤、旷视、海康威视、创新奇智、云从,他们的市场份额合计达到42%

与对手相比,云天励飞早已落后。有数据显示,近两年,云天励飞的市占率仅为1%左右。另一方面,行业可比公司毛利率高达50%以上,云天励飞的毛利率徘徊在35%左右,难以望其项背。

一手芯片一手模型,云天两线突围

技术公司突围,唯一的利器就是技术。生成式AI兴起之后,云天励飞一边发布新一代AI芯片,一边推出千亿级“天书”大模型,展开新一轮技术研发。

云天励飞推出了新一代的AI芯片DeepEdge10,它搭载了公司自研的神经网络处理器NNP400T,可广泛应用于AIoT边缘视频、移动机器人等场景。云天励飞还依托DeepEdge10芯片和公司自研的创新D2D芯片架构,推出了X5000推理卡,可以支持Llama2等百亿级大模型的计算

千亿级参数的“天书”大模型包括通用大模型、行业大模型、场景大模型三个层次。具体而言,就是基于算法开发平台、算法芯片化平台,通过海量数据打造通用大模型;在通用大模型基础上,引入高质量行业数据,形成行业大模型;行业大模型通过细分场景数据微调,形成场景大模型。

12月,云天励飞在接待投资者调研时称,“天书”大模型已完成两次版本更新,下一版将对标GPT-4,进一步提升多模态能力。公司披露,“天书”大模型在通用问答、语言理解、数学推理、文本生成、角色扮演等方面达到行业先进水平,在9月上旬的C-Eval中文大模型榜单中位列第一。

上市之际,云天励飞募资净额为35.8亿元,比原计划超募5.8亿元。一手AI芯片,一手大模型,云天励飞可否决胜于百模大战?行业拭目以待。

——结束——

以上是云天励飞五年连续巨亏20亿元!AI芯片投资冒险狂赌的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

新标题:英伟达H200发布:HBM容量提升76%,大幅提升大模型性能90%的最强AI芯片

Nov 14, 2023 pm 03:21 PM

新标题:英伟达H200发布:HBM容量提升76%,大幅提升大模型性能90%的最强AI芯片

Nov 14, 2023 pm 03:21 PM

11月14日消息,英伟达(Nvidia)在当地时间13日上午的“Supercomputing23”会议上正式发布了全新的H200GPU,并更新了GH200产品线其中,H200依然是建立在现有的HopperH100架构之上,但增加了更多高带宽内存(HBM3e),从而更好地处理开发和实施人工智能所需的大型数据集,使得运行大模型的综合性能相比前代H100提升了60%到90%。而更新后的GH200,也将为下一代AI超级计算机提供动力。2024年将会有超过200exaflops的AI计算能力上线。H200

传联发科拿下谷歌服务器AI芯片大单,将供应高速Serdes芯片

Jun 19, 2023 pm 08:23 PM

传联发科拿下谷歌服务器AI芯片大单,将供应高速Serdes芯片

Jun 19, 2023 pm 08:23 PM

6月19日消息,据中国台湾媒体报道,谷歌(Google)为了研发最新的面向服务器的AI芯片,已经找来联发科合合作,并计划交由台积电5nm制程代工,计划明年初量产。报道称,消息人士透露,这次谷歌与联发科的合作,将由联发科提供串行器及解串器(SerDes)方案,并协助整合谷歌自研的张量处理器(TPU),助力谷歌打造最新的服务器AI晶片,性能将比CPU或GPU架构更强大。业界指出,谷歌目前的多项服务都与AI有关,早在多年前就投入到了深度学习技术当中,发现运用GPU来进行AI运算成本十分昂贵,因此谷歌决

AI的下一个热门:英伟达B100芯片和OpenAI GPT-5模型的巅峰表现

Nov 18, 2023 pm 03:39 PM

AI的下一个热门:英伟达B100芯片和OpenAI GPT-5模型的巅峰表现

Nov 18, 2023 pm 03:39 PM

号称世界最强AI芯片英伟达H200亮相后,业内开始期待英伟达更强大的B100芯片,与此同时,今年以来最红的初创AI公司OpenAI已经开始研发更强大、更复杂的GPT-5模型。国泰君安在最新的研报中指出,性能无边的B100与GPT5预计在2024年发布,重磅升级或释放前所未有的生产力。该机构表示,看好AI进入快速发展的成长期,能见度持续至2024年。相较于前几代产品,B100和GPT-5究竟有多强大?英伟达和OpenAI已经给出了预告:B100速度可能是H100的4倍以上,而GPT-5可能会实现超

耐能推出最新款AI芯片KL730,驱动轻量级GPT解决方案的大规模应用

Aug 17, 2023 pm 01:37 PM

耐能推出最新款AI芯片KL730,驱动轻量级GPT解决方案的大规模应用

Aug 17, 2023 pm 01:37 PM

KL730在能效方面的进步使得解决了人工智能模型落地方面最大的瓶颈——能源成本,相较于行业及以往耐能的芯片,提高了3到4倍KL730芯片支持最先进的轻量级GPT大语言模型,如nanoGPT,并提供每秒0.35-4tera的有效计算能力AI公司耐能今日宣布发布KL730芯片,该芯片集成了车规级NPU和图像信号处理(ISP),将安全而低能耗的AI能力赋能到边缘服务器、智能家居及汽车辅助驾驶系统等各类应用场景中。总部位于圣迭戈的耐能以其开创性的神经处理单元(NPU)而闻名耐能最新款芯片KL730旨在实

AI芯片,全球缺货!

May 30, 2023 pm 09:53 PM

AI芯片,全球缺货!

May 30, 2023 pm 09:53 PM

谷歌CEO将AI革命比作人类对火的使用,但现在为该行业提供燃料的数字火种——AI芯片,很难获得。驱动AI运行的新一代先进芯片几乎都是由英伟达制造的,随着ChatGPT爆火出圈,市场对英伟达图形处理芯片(GPU)的需求远远超过了供应。帮助企业构建聊天机器人等AI模型的初创公司Lamini的联合创始人兼首席执行官SharonZhou表示:“因为存在短缺,所以关键在于你的朋友圈。”“就像疫情期间的厕纸一样。”这种情况限制了亚马逊和微软等云服务提供商向ChatGPT的创建者OpenAI等客户提供的计算能

英伟达推出全新AI芯片H200,性能大幅提升90%!中国算力实现自主突破!

Nov 14, 2023 pm 05:37 PM

英伟达推出全新AI芯片H200,性能大幅提升90%!中国算力实现自主突破!

Nov 14, 2023 pm 05:37 PM

当全球还在为英伟达H100芯片痴迷并疯狂购买以满足持续增长的AI算力需求之时,当地时间周一,英伟达悄然推出了最新的AI芯片H200,用于AI大模型的训练,相比于其前一代产品H100,H200的性能提升了约60%到90%。H200是英伟达H100的升级版,与H100同样基于Hopper架构,主要升级包括141GB的HBM3e显存,显存带宽从H100的3.35TB/s增加到了4.8TB/s。据英伟达官网消息,H200也是公司第一款使用HBM3e内存的芯片,这种内存速度更快,容量更大,因此更适合大语言

耐能公司宣布推出最新的AI芯片KL730

Aug 17, 2023 am 10:09 AM

耐能公司宣布推出最新的AI芯片KL730

Aug 17, 2023 am 10:09 AM

根据原话,可以将其重写为:(全球TMT2023年8月16日讯)AI公司耐能,总部位于圣迭戈,以其开创性的神经处理单元(NPU)而闻名,宣布发布KL730芯片。该芯片集成了车规级NPU和图像信号处理(ISP),并将安全而低能耗的AI能力赋予边缘服务器、智能家居及汽车辅助驾驶系统等各类应用场景KL730芯片在能效方面取得了巨大的突破,相较于以往的耐能芯片,其能效提升了3至4倍,比主要行业同类产品提高了150%~200%。该芯片具备每秒0.35-4tera的有效计算能力,可以支持最先进的轻量级GPT大

微软正在自主开发AI芯片“Athena”

Apr 25, 2023 pm 01:07 PM

微软正在自主开发AI芯片“Athena”

Apr 25, 2023 pm 01:07 PM

微软正在开发AI优化芯片,以降低训练生成式AI模型(例如为OpenAIChatGPT聊天机器人提供动力的模型)的成本。TheInformation近日援引两位知情人士的话说,至少从2019年开始,微软就一直在研发代号为“Athena”的新芯片组。微软和OpenAI的员工已经可以使用新芯片,并正在使用这些芯片在GPT-4等大型语言模型上测试芯片的性能。训练大型语言模型需要摄取和分析大量数据,以便为AI创建新的输出内容来模仿人类对话,这是生成式AI模型的一大标志,这个过程需要大量(大约数万个)针对A