字节新一代视频生成模型,让绿巨人戴上VR眼镜的效果更胜Gen-2!

一句话,就让绿巨人戴上VR眼镜。

4K画质那种。

熊猫的奇幻漂流~

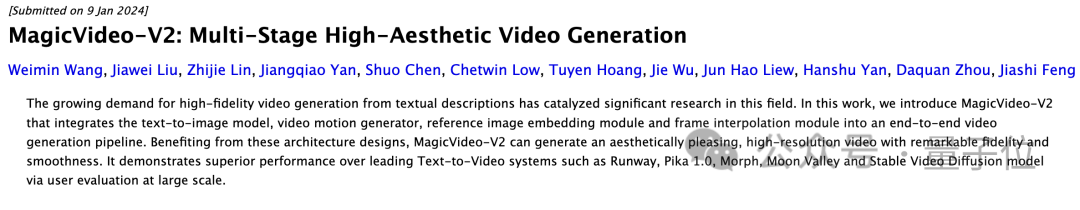

这是字节最新的AI视频生成模型MagicVideo-V2,各种奇思妙想的想法都能实现。它不仅支持4K、8K超高分辨率,轻松hold各种绘图风格。

△从左往右:油画风、赛博风、设计风

测评效果超过Gen-2、Pika以及现有AI视频生成工具。

结果上线不到24小时就引发众人围观,比如一条推文就有近20万浏览量。

不少网友惊讶其效果,甚至直言:比runway和pika还要好。

“比runway和pika还要好”

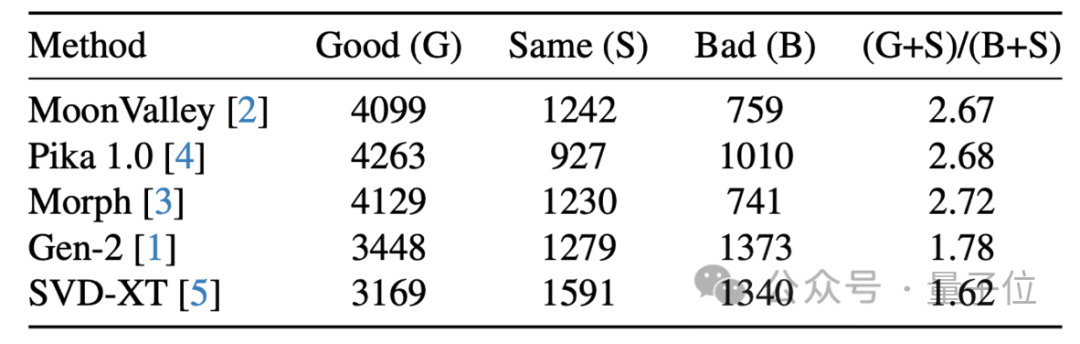

研究人员也的确进行了实际的效果比较。选手分别为:MagicVideo-V2、StabilityAI的SVD-XT,新潜力玩家Pika1.0,以及Runway的Gen-2。

第一轮:光影效果。

夕阳西下,旅行者独自行走在迷雾森林中。

(从左到右依次是:MagicVideo-V2、SVD-XT,右上Pika,右下Gen-2,下同)

可以看到,MagicVideo-V2、Gen-2和Pika都有明显的光影。不过Pika看不出是为旅行者,MagicVideo-V2的色调更为丰富。

第二轮:情境剧情的表达。

1910 年代的情景喜剧,讲述社会中的日常生活和琐事

这一轮明显也是MagicVideo-V2、Gen-2更胜一筹。SVD-XT呈现的中景构图,虽然年代体现出来了,但表达不够。

第三轮:写实。

小男孩在公园的小路上骑着自行车,车轮踩在碎石上发出嘎吱嘎吱的声音.

这次对比就更为明显了。MagicVideo-V2和SVD-XT是完整体现出句子意思的,不过MagicVideo-V2可以看到小孩明显脚在动的细节。

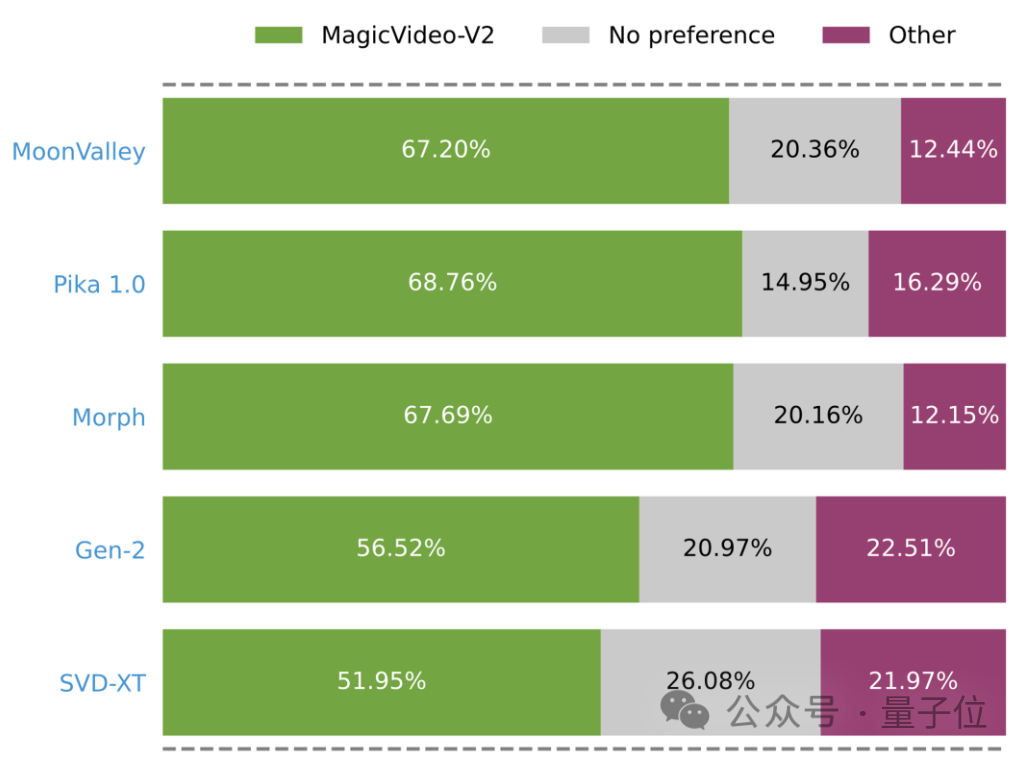

除此之外,研究人员还将MagicVideo-V2与当下最先方法进行一对一的人类评估。

结果显示,相较于其他方法,人们认为MagicVideo-V2的效果更好。

(绿色、灰色和粉色条分别代表 MagicVideo-V2 被评价为更好、相当或较差的试验效果。)

如何实现?

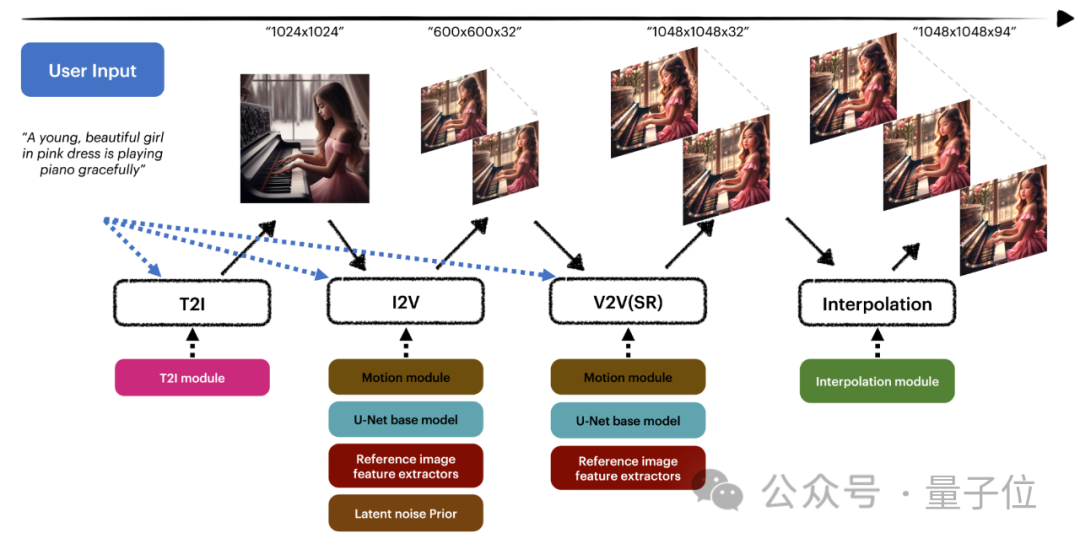

简单来说,MagicVideo-V2是一条视频生成流水线,集成了文本到图像模型、视频运动生成器、参考图像嵌入模块、插值模块。

首先是有T2I模块首先根据文字生成1024×1024图像,随后I2V模块对该静态图像进行动画处理,生成600×600×32的帧序列,然后再用V2V模块增强,并完善视频内容,最后再用插值模块将序列扩展到94个帧。

这样一来,既保证了高保真,时间上也有连续性。

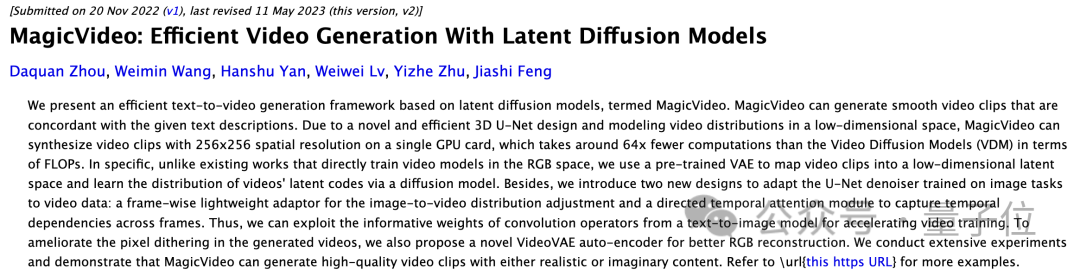

不过早在2022年11月字节曾推出了MagicVideo V1版。

不过,当时更强调的是高效性,它能在单个GPU卡上生成256x256分辨率的视频。

参考链接:

https://twitter.com/arankomatsuzaki/status/1744918551415443768?s=20

项目链接:

https://magicvideov2.github.io/

论文链接:

https://arxiv.org/abs/2401.04468

https://arxiv.org/abs/2211.11018

以上是字节新一代视频生成模型,让绿巨人戴上VR眼镜的效果更胜Gen-2!的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

centos关机命令行

Apr 14, 2025 pm 09:12 PM

centos关机命令行

Apr 14, 2025 pm 09:12 PM

CentOS 关机命令为 shutdown,语法为 shutdown [选项] 时间 [信息]。选项包括:-h 立即停止系统;-P 关机后关电源;-r 重新启动;-t 等待时间。时间可指定为立即 (now)、分钟数 ( minutes) 或特定时间 (hh:mm)。可添加信息在系统消息中显示。

CentOS上GitLab的备份方法有哪些

Apr 14, 2025 pm 05:33 PM

CentOS上GitLab的备份方法有哪些

Apr 14, 2025 pm 05:33 PM

CentOS系统下GitLab的备份与恢复策略为了保障数据安全和可恢复性,CentOS上的GitLab提供了多种备份方法。本文将详细介绍几种常见的备份方法、配置参数以及恢复流程,帮助您建立完善的GitLab备份与恢复策略。一、手动备份利用gitlab-rakegitlab:backup:create命令即可执行手动备份。此命令会备份GitLab仓库、数据库、用户、用户组、密钥和权限等关键信息。默认备份文件存储于/var/opt/gitlab/backups目录,您可通过修改/etc/gitlab

如何检查CentOS HDFS配置

Apr 14, 2025 pm 07:21 PM

如何检查CentOS HDFS配置

Apr 14, 2025 pm 07:21 PM

检查CentOS系统中HDFS配置的完整指南本文将指导您如何有效地检查CentOS系统上HDFS的配置和运行状态。以下步骤将帮助您全面了解HDFS的设置和运行情况。验证Hadoop环境变量:首先,确认Hadoop环境变量已正确设置。在终端执行以下命令,验证Hadoop是否已正确安装并配置:hadoopversion检查HDFS配置文件:HDFS的核心配置文件位于/etc/hadoop/conf/目录下,其中core-site.xml和hdfs-site.xml至关重要。使用

CentOS上Zookeeper性能调优有哪些方法

Apr 14, 2025 pm 03:18 PM

CentOS上Zookeeper性能调优有哪些方法

Apr 14, 2025 pm 03:18 PM

在CentOS上对Zookeeper进行性能调优,可以从多个方面入手,包括硬件配置、操作系统优化、配置参数调整以及监控与维护等。以下是一些具体的调优方法:硬件配置建议使用SSD硬盘:由于Zookeeper的数据写入磁盘,强烈建议使用SSD以提高I/O性能。足够的内存:为Zookeeper分配足够的内存资源,避免频繁的磁盘读写。多核CPU:使用多核CPU,确保Zookeeper可以并行处理请

CentOS上如何进行PyTorch模型训练

Apr 14, 2025 pm 03:03 PM

CentOS上如何进行PyTorch模型训练

Apr 14, 2025 pm 03:03 PM

在CentOS系统上高效训练PyTorch模型,需要分步骤进行,本文将提供详细指南。一、环境准备:Python及依赖项安装:CentOS系统通常预装Python,但版本可能较旧。建议使用yum或dnf安装Python3并升级pip:sudoyumupdatepython3(或sudodnfupdatepython3),pip3install--upgradepip。CUDA与cuDNN(GPU加速):如果使用NVIDIAGPU,需安装CUDATool

CentOS上PyTorch的GPU支持情况如何

Apr 14, 2025 pm 06:48 PM

CentOS上PyTorch的GPU支持情况如何

Apr 14, 2025 pm 06:48 PM

在CentOS系统上启用PyTorchGPU加速,需要安装CUDA、cuDNN以及PyTorch的GPU版本。以下步骤将引导您完成这一过程:CUDA和cuDNN安装确定CUDA版本兼容性:使用nvidia-smi命令查看您的NVIDIA显卡支持的CUDA版本。例如,您的MX450显卡可能支持CUDA11.1或更高版本。下载并安装CUDAToolkit:访问NVIDIACUDAToolkit官网,根据您显卡支持的最高CUDA版本下载并安装相应的版本。安装cuDNN库:前

docker原理详解

Apr 14, 2025 pm 11:57 PM

docker原理详解

Apr 14, 2025 pm 11:57 PM

Docker利用Linux内核特性,提供高效、隔离的应用运行环境。其工作原理如下:1. 镜像作为只读模板,包含运行应用所需的一切;2. 联合文件系统(UnionFS)层叠多个文件系统,只存储差异部分,节省空间并加快速度;3. 守护进程管理镜像和容器,客户端用于交互;4. Namespaces和cgroups实现容器隔离和资源限制;5. 多种网络模式支持容器互联。理解这些核心概念,才能更好地利用Docker。

CentOS下PyTorch版本怎么选

Apr 14, 2025 pm 02:51 PM

CentOS下PyTorch版本怎么选

Apr 14, 2025 pm 02:51 PM

在CentOS下选择PyTorch版本时,需要考虑以下几个关键因素:1.CUDA版本兼容性GPU支持:如果你有NVIDIAGPU并且希望利用GPU加速,需要选择支持相应CUDA版本的PyTorch。可以通过运行nvidia-smi命令查看你的显卡支持的CUDA版本。CPU版本:如果没有GPU或不想使用GPU,可以选择CPU版本的PyTorch。2.Python版本PyTorch